(4) $ {F_2} = \frac{1}{{NM}}\mathop \sum \limits_{i = 0}^{N - 1} \left( {\mathop \sum \limits_{j = 0}^{M - 1} \frac{{\left| {\left( {{{\boldsymbol{P}}_{i,M-1}}-{{\boldsymbol{P}}_{i,0}}} \right) \cdot {\left({{\boldsymbol{P}}_{N-1,j}}-{{\boldsymbol{P}}_{0,j}}\right)} } \right|}}{{\left| { {{{\boldsymbol{P}}_{i,M-1}}-{{\boldsymbol{P}}_{i,0}}} } \right| \cdot \left| { {{{\boldsymbol{P}}_{N-1,j}} , {{\boldsymbol{P}}_{0,j}}} } \right|}}} \right). $

[1]

LUO S, BIMBO J, DAHIYA R, et al Robotic tactile perception of object properties: a review

[J]. Mechatronics , 2017 , 48 (7 ): 54 - 67

[本文引用: 1]

[2]

SUN H, KUCHENBECKER K J, MARTIUS G A soft thumb-sized vision-based sensor with accurate all-round force perception

[J]. Nature Machine Intelligence , 2022 , 4 (2 ): 135 - 145

DOI:10.1038/s42256-021-00439-3

[本文引用: 1]

[3]

ZOU L, GE C, WANG Z, et al Novel tactile sensor technology and smart tactile sensing systems: a review

[J]. Sensors , 2017 , 17 (11 ): 2653

DOI:10.3390/s17112653

[本文引用: 1]

[4]

王云灏, 孙铭会, 辛毅, 等 基于压电薄膜传感器的机器人触觉识别系统

[J]. 浙江大学学报: 工学版 , 2022 , 56 (4 ): 702 - 710

[本文引用: 1]

WANG Yunhao, SUN Minghui, XIN Yi, et al Robot tactile recognition system based on piezoelectric film sensor

[J]. Journal of Zhejiang University: Engineering Science , 2022 , 56 (4 ): 702 - 710

[本文引用: 1]

[5]

HARADA S, KANAO K, YAMAMOTO Y, et al Fully printed flexible fingerprint-like three-axis tactile and slip force and temperature sensors for artificial skin

[J]. ACS Nano , 2014 , 8 (12 ): 12851 - 12857

DOI:10.1021/nn506293y

[本文引用: 1]

[6]

SHIMONOMURA K Tactile image sensors employing camera: a review

[J]. Sensors , 2019 , 19 (18 ): 3933

DOI:10.3390/s19183933

[本文引用: 1]

[7]

崔少伟, 王硕, 胡静怡, 等 面向机器人操作任务的视触觉传感技术综述

[J]. 智能科学与技术学报 , 2022 , 4 (2 ): 186 - 199

DOI:10.11959/j.issn.2096-6652.202222

CUI Shaowei, WANG Shuo, HU Jingyi, et al A survey of visuotactile sensing technologies for robotic manipulation

[J]. Chinese Journal of Intelligent Science and Technology , 2022 , 4 (2 ): 186 - 199

DOI:10.11959/j.issn.2096-6652.202222

[8]

ZHANG S, CHEN Z, GAO Y, et al Hardware technology of vision-based tactile sensor: a review

[J]. IEEE Sensors Journal , 2022 , 22 (22 ): 21410 - 21427

DOI:10.1109/JSEN.2022.3210210

[本文引用: 1]

[9]

WARD-CHERRIER B, PESTELL N, CRAMPHORN L, et al The TacTip family: soft optical tactile sensors with 3D-printed biomimetic morphologies

[J]. Soft Robotics , 2018 , 5 (2 ): 216 - 227

DOI:10.1089/soro.2017.0052

[本文引用: 1]

[10]

KAMIYAMA K, VLACK K, MIZOTA T, et al Vision-based sensor for real-time measuring of surface traction fields

[J]. IEEE Computer Graphics and Applications , 2005 , 25 (1 ): 68 - 75

DOI:10.1109/MCG.2005.27

[本文引用: 1]

[11]

YAMAGUCHI A, ATKESON C G. Combining finger vision and optical tactile sensing: reducing and handling errors while cutting vegetables [C]// IEEE-RAS 16th International Conference on Humanoid Robots . Cancun: IEEE, 2016: 1045–1051.

[本文引用: 1]

[12]

YUAN W, DONG S, ADELSON E GelSight: high-resolution robot tactile sensors for estimating geometry and force

[J]. Sensors , 2017 , 17 (12 ): 2762

DOI:10.3390/s17122762

[本文引用: 1]

[13]

ABAD A C, RANASINGHE A Visuotactile sensors with emphasis on GelSight sensor: a review

[J]. IEEE Sensors Journal , 2020 , 20 (14 ): 7628 - 7638

DOI:10.1109/JSEN.2020.2979662

[本文引用: 1]

[14]

SHE Y, WANG S, DONG S, et al Cable manipulation with a tactile-reactive gripper

[J]. The International Journal of Robotics Research , 2021 , 40 (12/13/14 ): 1385 - 1401

DOI:10.1177/02783649211027233

[本文引用: 1]

[15]

DO W K, KENNEDY M. DenseTact: optical tactile sensor for dense shape reconstruction [C]// International Conference on Robotics and Automation . Philadelphia: IEEE, 2022: 6188–6194.

[本文引用: 1]

[16]

LAMBETA M, CHOU P W, TIAN S, et al DIGIT: a novel design for a low-cost compact high-resolution tactile sensor with application to in-hand manipulation

[J]. IEEE Robotics and Automation Letters , 2020 , 5 (3 ): 3838 - 3845

DOI:10.1109/LRA.2020.2977257

[17]

ROMERO B, VEIGA F, ADELSON E. Soft, round, high resolution tactile fingertip sensors for dexterous robotic manipulation [C]// IEEE International Conference on Robotics and Automation . Paris: IEEE, 2020: 4796–4802.

[本文引用: 1]

[18]

ALSPACH A, HASHIMOTO K, KUPPUSWAMY N, et al. Soft-bubble: a highly compliant dense geometry tactile sensor for robot manipulation [C]// 2nd IEEE International Conference on Soft Robotics . Seoul: IEEE, 2019: 597–604.

[本文引用: 1]

[19]

CUI S, WANG R, HU J, et al In-hand object localization using a novel high-resolution visuotactile sensor

[J]. IEEE Transactions on Industrial Electronics , 2022 , 69 (6 ): 6015 - 6025

DOI:10.1109/TIE.2021.3090697

[本文引用: 1]

[20]

HU J, CUI S, WANG S, et al GelStereo Palm: a novel curved visuotactile sensor for 3-D geometry sensing

[J]. IEEE Transactions on Industrial Informatics , 2023 , 19 (11 ): 10853 - 10863

DOI:10.1109/TII.2023.3241685

[本文引用: 1]

[21]

SORENSEN S, KOLAGUNDA A, SAPONARO P, et al. Refractive stereo ray tracing for reconstructing underwater structures [C]// IEEE International Conference on Image Processing . Quebec City: IEEE, 2015: 1712–1716.

[本文引用: 1]

[22]

GU C, CONG Y, SUN G, et al MedUCC: medium-driven underwater camera calibration for refractive 3-D reconstruction

[J]. IEEE Transactions on Systems, Man, and Cybernetics: Systems , 2022 , 52 (9 ): 5937 - 5948

DOI:10.1109/TSMC.2021.3132146

[本文引用: 1]

[23]

KUNZ C, SINGH H. Hemispherical refraction and camera calibration in underwater vision [C]// OCEANS . Quebec City: IEEE, 2008: 1–7.

[本文引用: 1]

[24]

YOON S, CHOI T, SULL S Depth estimation from stereo cameras through a curved transparent medium

[J]. Pattern Recognition Letters , 2020 , 129 : 101 - 107

DOI:10.1016/j.patrec.2019.11.012

[本文引用: 1]

[25]

SHE M, NAKATH D, SONG Y, et al Refractive geometry for underwater domes

[J]. ISPRS Journal of Photogrammetry and Remote Sensing , 2022 , 183 (3 ): 525 - 540

[本文引用: 1]

[26]

LEPORA N F Soft biomimetic optical tactile sensing with the TacTip: a review

[J]. IEEE Sensors Journal , 2021 , 21 (19 ): 21131 - 21143

DOI:10.1109/JSEN.2021.3100645

[本文引用: 1]

[27]

SATO K, KAMIYAMA K, KAWAKAMI N, et al Finger-shaped GelForce: sensor for measuring surface traction fields for robotic hand

[J]. IEEE Transactions on Haptics , 2010 , 3 (1 ): 37 - 47

[本文引用: 1]

[28]

LIN X, WILLEMET L, BAILLEUL A, et al. Curvature sensing with a spherical tactile sensor using the color-interference of a marker array [C]// IEEE International Conference on Robotics and Automation . Paris: IEEE, 2020: 603–609.

[本文引用: 1]

[29]

KAKANI V, CUI X, MA M, et al Vision-based tactile sensor mechanism for the estimation of contact position and force distribution using deep learning

[J]. Sensors , 2021 , 21 (5 ): 1920

DOI:10.3390/s21051920

[本文引用: 1]

Robotic tactile perception of object properties: a review

1

2017

... 物体的三维形状为人类和机器人对环境的感知和操作提供了丰富的信息[1 ] . 视觉通常被用于感知物体的全局三维形状,但在一些极端情况下会面临显著的挑战,例如光照不佳、存在反射或遮挡. 相比之下,触觉感知更擅长捕获物体的局部和细节三维形状,并且不受上述不利条件的限制[2 ] . 为了让机器人具备类似于人类的触觉感知能力,基于多种传导原理的不同类型的触觉传感器被相继研发出来,包括压阻式、压电式、电容式以及光学传感器[3 -4 ] . ...

A soft thumb-sized vision-based sensor with accurate all-round force perception

1

2022

... 物体的三维形状为人类和机器人对环境的感知和操作提供了丰富的信息[1 ] . 视觉通常被用于感知物体的全局三维形状,但在一些极端情况下会面临显著的挑战,例如光照不佳、存在反射或遮挡. 相比之下,触觉感知更擅长捕获物体的局部和细节三维形状,并且不受上述不利条件的限制[2 ] . 为了让机器人具备类似于人类的触觉感知能力,基于多种传导原理的不同类型的触觉传感器被相继研发出来,包括压阻式、压电式、电容式以及光学传感器[3 -4 ] . ...

Novel tactile sensor technology and smart tactile sensing systems: a review

1

2017

... 物体的三维形状为人类和机器人对环境的感知和操作提供了丰富的信息[1 ] . 视觉通常被用于感知物体的全局三维形状,但在一些极端情况下会面临显著的挑战,例如光照不佳、存在反射或遮挡. 相比之下,触觉感知更擅长捕获物体的局部和细节三维形状,并且不受上述不利条件的限制[2 ] . 为了让机器人具备类似于人类的触觉感知能力,基于多种传导原理的不同类型的触觉传感器被相继研发出来,包括压阻式、压电式、电容式以及光学传感器[3 -4 ] . ...

基于压电薄膜传感器的机器人触觉识别系统

1

2022

... 物体的三维形状为人类和机器人对环境的感知和操作提供了丰富的信息[1 ] . 视觉通常被用于感知物体的全局三维形状,但在一些极端情况下会面临显著的挑战,例如光照不佳、存在反射或遮挡. 相比之下,触觉感知更擅长捕获物体的局部和细节三维形状,并且不受上述不利条件的限制[2 ] . 为了让机器人具备类似于人类的触觉感知能力,基于多种传导原理的不同类型的触觉传感器被相继研发出来,包括压阻式、压电式、电容式以及光学传感器[3 -4 ] . ...

基于压电薄膜传感器的机器人触觉识别系统

1

2022

... 物体的三维形状为人类和机器人对环境的感知和操作提供了丰富的信息[1 ] . 视觉通常被用于感知物体的全局三维形状,但在一些极端情况下会面临显著的挑战,例如光照不佳、存在反射或遮挡. 相比之下,触觉感知更擅长捕获物体的局部和细节三维形状,并且不受上述不利条件的限制[2 ] . 为了让机器人具备类似于人类的触觉感知能力,基于多种传导原理的不同类型的触觉传感器被相继研发出来,包括压阻式、压电式、电容式以及光学传感器[3 -4 ] . ...

Fully printed flexible fingerprint-like three-axis tactile and slip force and temperature sensors for artificial skin

1

2014

... 传统的触觉传感器多为阵列式结构,由众多小型触觉感知单元紧密排列而成. 然而,这类传感器的空间分辨率较低,难以捕捉触觉接触时物体的具体几何形态,限制了其在高精度触觉感知中的应用[5 ] . 近年来,视触觉传感器作为一种光学触觉传感器,因高空间分辨率的触觉信息捕捉能力受到了广泛的关注[6 -8 ] . 这类传感器通常使用相机捕捉弹性体表面的形变来测量接触信息,代表性工作包括TacTip[9 ] 、GelForce[10 ] 和 FingerVision[11 ] 传感器等. 然而,这些视触觉传感器大多局限于平面感知,无法获取接触区域的完整三维几何形状信息. ...

Tactile image sensors employing camera: a review

1

2019

... 传统的触觉传感器多为阵列式结构,由众多小型触觉感知单元紧密排列而成. 然而,这类传感器的空间分辨率较低,难以捕捉触觉接触时物体的具体几何形态,限制了其在高精度触觉感知中的应用[5 ] . 近年来,视触觉传感器作为一种光学触觉传感器,因高空间分辨率的触觉信息捕捉能力受到了广泛的关注[6 -8 ] . 这类传感器通常使用相机捕捉弹性体表面的形变来测量接触信息,代表性工作包括TacTip[9 ] 、GelForce[10 ] 和 FingerVision[11 ] 传感器等. 然而,这些视触觉传感器大多局限于平面感知,无法获取接触区域的完整三维几何形状信息. ...

面向机器人操作任务的视触觉传感技术综述

0

2022

面向机器人操作任务的视触觉传感技术综述

0

2022

Hardware technology of vision-based tactile sensor: a review

1

2022

... 传统的触觉传感器多为阵列式结构,由众多小型触觉感知单元紧密排列而成. 然而,这类传感器的空间分辨率较低,难以捕捉触觉接触时物体的具体几何形态,限制了其在高精度触觉感知中的应用[5 ] . 近年来,视触觉传感器作为一种光学触觉传感器,因高空间分辨率的触觉信息捕捉能力受到了广泛的关注[6 -8 ] . 这类传感器通常使用相机捕捉弹性体表面的形变来测量接触信息,代表性工作包括TacTip[9 ] 、GelForce[10 ] 和 FingerVision[11 ] 传感器等. 然而,这些视触觉传感器大多局限于平面感知,无法获取接触区域的完整三维几何形状信息. ...

The TacTip family: soft optical tactile sensors with 3D-printed biomimetic morphologies

1

2018

... 传统的触觉传感器多为阵列式结构,由众多小型触觉感知单元紧密排列而成. 然而,这类传感器的空间分辨率较低,难以捕捉触觉接触时物体的具体几何形态,限制了其在高精度触觉感知中的应用[5 ] . 近年来,视触觉传感器作为一种光学触觉传感器,因高空间分辨率的触觉信息捕捉能力受到了广泛的关注[6 -8 ] . 这类传感器通常使用相机捕捉弹性体表面的形变来测量接触信息,代表性工作包括TacTip[9 ] 、GelForce[10 ] 和 FingerVision[11 ] 传感器等. 然而,这些视触觉传感器大多局限于平面感知,无法获取接触区域的完整三维几何形状信息. ...

Vision-based sensor for real-time measuring of surface traction fields

1

2005

... 传统的触觉传感器多为阵列式结构,由众多小型触觉感知单元紧密排列而成. 然而,这类传感器的空间分辨率较低,难以捕捉触觉接触时物体的具体几何形态,限制了其在高精度触觉感知中的应用[5 ] . 近年来,视触觉传感器作为一种光学触觉传感器,因高空间分辨率的触觉信息捕捉能力受到了广泛的关注[6 -8 ] . 这类传感器通常使用相机捕捉弹性体表面的形变来测量接触信息,代表性工作包括TacTip[9 ] 、GelForce[10 ] 和 FingerVision[11 ] 传感器等. 然而,这些视触觉传感器大多局限于平面感知,无法获取接触区域的完整三维几何形状信息. ...

1

... 传统的触觉传感器多为阵列式结构,由众多小型触觉感知单元紧密排列而成. 然而,这类传感器的空间分辨率较低,难以捕捉触觉接触时物体的具体几何形态,限制了其在高精度触觉感知中的应用[5 ] . 近年来,视触觉传感器作为一种光学触觉传感器,因高空间分辨率的触觉信息捕捉能力受到了广泛的关注[6 -8 ] . 这类传感器通常使用相机捕捉弹性体表面的形变来测量接触信息,代表性工作包括TacTip[9 ] 、GelForce[10 ] 和 FingerVision[11 ] 传感器等. 然而,这些视触觉传感器大多局限于平面感知,无法获取接触区域的完整三维几何形状信息. ...

GelSight: high-resolution robot tactile sensors for estimating geometry and force

1

2017

... 作为主流视触觉传感器之一,GelSight传感器[12 ] 创新性地采用光度立体算法来重建接触表面的高精度三维几何形状,在机器人触觉感知和操作领域取得了丰富的研究成果[13 -14 ] . 为了增强传感器的灵活性,研究人员进一步在GelSight的基础上改进结构,设计带有曲面接触面的GelSight类传感器[15 -17 ] . 然而,由于光度立体算法本身的局限性,这些曲面传感器在三维几何形状估计中存在较大的误差,同时光学路径设计复杂,制造工艺难度较高. 除了GelSight类传感器,一些研究团队还开发了其他能够感知三维接触几何形状的曲面视触觉传感器. 例如,SoftBubble传感器[18 ] 利用深度相机捕捉弹性体表面的形变,实现了三维触觉重建. 然而,这类传感器通常成本高昂,制造工艺复杂,且在实际应用中仍有较大的改进空间. 为了解决上述问题,近期Cui等[19 ] 提出GelStereo视触觉传感器,采用双目立体视觉算法重建接触表面的三维几何形状. 该传感器具有较高的触觉点云重建精度,并且传感器形状易于扩展至曲面,为曲面视触觉传感器的设计提供了新的思路. 在此基础上,Hu等[20 ] 设计了一种曲面手掌视触觉传感器,可以更灵活地感知复杂物体表面的三维形状. 然而,其触觉感知深度范围仍然有限,显著接触点提取效率有待提高. ...

Visuotactile sensors with emphasis on GelSight sensor: a review

1

2020

... 作为主流视触觉传感器之一,GelSight传感器[12 ] 创新性地采用光度立体算法来重建接触表面的高精度三维几何形状,在机器人触觉感知和操作领域取得了丰富的研究成果[13 -14 ] . 为了增强传感器的灵活性,研究人员进一步在GelSight的基础上改进结构,设计带有曲面接触面的GelSight类传感器[15 -17 ] . 然而,由于光度立体算法本身的局限性,这些曲面传感器在三维几何形状估计中存在较大的误差,同时光学路径设计复杂,制造工艺难度较高. 除了GelSight类传感器,一些研究团队还开发了其他能够感知三维接触几何形状的曲面视触觉传感器. 例如,SoftBubble传感器[18 ] 利用深度相机捕捉弹性体表面的形变,实现了三维触觉重建. 然而,这类传感器通常成本高昂,制造工艺复杂,且在实际应用中仍有较大的改进空间. 为了解决上述问题,近期Cui等[19 ] 提出GelStereo视触觉传感器,采用双目立体视觉算法重建接触表面的三维几何形状. 该传感器具有较高的触觉点云重建精度,并且传感器形状易于扩展至曲面,为曲面视触觉传感器的设计提供了新的思路. 在此基础上,Hu等[20 ] 设计了一种曲面手掌视触觉传感器,可以更灵活地感知复杂物体表面的三维形状. 然而,其触觉感知深度范围仍然有限,显著接触点提取效率有待提高. ...

Cable manipulation with a tactile-reactive gripper

1

2021

... 作为主流视触觉传感器之一,GelSight传感器[12 ] 创新性地采用光度立体算法来重建接触表面的高精度三维几何形状,在机器人触觉感知和操作领域取得了丰富的研究成果[13 -14 ] . 为了增强传感器的灵活性,研究人员进一步在GelSight的基础上改进结构,设计带有曲面接触面的GelSight类传感器[15 -17 ] . 然而,由于光度立体算法本身的局限性,这些曲面传感器在三维几何形状估计中存在较大的误差,同时光学路径设计复杂,制造工艺难度较高. 除了GelSight类传感器,一些研究团队还开发了其他能够感知三维接触几何形状的曲面视触觉传感器. 例如,SoftBubble传感器[18 ] 利用深度相机捕捉弹性体表面的形变,实现了三维触觉重建. 然而,这类传感器通常成本高昂,制造工艺复杂,且在实际应用中仍有较大的改进空间. 为了解决上述问题,近期Cui等[19 ] 提出GelStereo视触觉传感器,采用双目立体视觉算法重建接触表面的三维几何形状. 该传感器具有较高的触觉点云重建精度,并且传感器形状易于扩展至曲面,为曲面视触觉传感器的设计提供了新的思路. 在此基础上,Hu等[20 ] 设计了一种曲面手掌视触觉传感器,可以更灵活地感知复杂物体表面的三维形状. 然而,其触觉感知深度范围仍然有限,显著接触点提取效率有待提高. ...

1

... 作为主流视触觉传感器之一,GelSight传感器[12 ] 创新性地采用光度立体算法来重建接触表面的高精度三维几何形状,在机器人触觉感知和操作领域取得了丰富的研究成果[13 -14 ] . 为了增强传感器的灵活性,研究人员进一步在GelSight的基础上改进结构,设计带有曲面接触面的GelSight类传感器[15 -17 ] . 然而,由于光度立体算法本身的局限性,这些曲面传感器在三维几何形状估计中存在较大的误差,同时光学路径设计复杂,制造工艺难度较高. 除了GelSight类传感器,一些研究团队还开发了其他能够感知三维接触几何形状的曲面视触觉传感器. 例如,SoftBubble传感器[18 ] 利用深度相机捕捉弹性体表面的形变,实现了三维触觉重建. 然而,这类传感器通常成本高昂,制造工艺复杂,且在实际应用中仍有较大的改进空间. 为了解决上述问题,近期Cui等[19 ] 提出GelStereo视触觉传感器,采用双目立体视觉算法重建接触表面的三维几何形状. 该传感器具有较高的触觉点云重建精度,并且传感器形状易于扩展至曲面,为曲面视触觉传感器的设计提供了新的思路. 在此基础上,Hu等[20 ] 设计了一种曲面手掌视触觉传感器,可以更灵活地感知复杂物体表面的三维形状. 然而,其触觉感知深度范围仍然有限,显著接触点提取效率有待提高. ...

DIGIT: a novel design for a low-cost compact high-resolution tactile sensor with application to in-hand manipulation

0

2020

1

... 作为主流视触觉传感器之一,GelSight传感器[12 ] 创新性地采用光度立体算法来重建接触表面的高精度三维几何形状,在机器人触觉感知和操作领域取得了丰富的研究成果[13 -14 ] . 为了增强传感器的灵活性,研究人员进一步在GelSight的基础上改进结构,设计带有曲面接触面的GelSight类传感器[15 -17 ] . 然而,由于光度立体算法本身的局限性,这些曲面传感器在三维几何形状估计中存在较大的误差,同时光学路径设计复杂,制造工艺难度较高. 除了GelSight类传感器,一些研究团队还开发了其他能够感知三维接触几何形状的曲面视触觉传感器. 例如,SoftBubble传感器[18 ] 利用深度相机捕捉弹性体表面的形变,实现了三维触觉重建. 然而,这类传感器通常成本高昂,制造工艺复杂,且在实际应用中仍有较大的改进空间. 为了解决上述问题,近期Cui等[19 ] 提出GelStereo视触觉传感器,采用双目立体视觉算法重建接触表面的三维几何形状. 该传感器具有较高的触觉点云重建精度,并且传感器形状易于扩展至曲面,为曲面视触觉传感器的设计提供了新的思路. 在此基础上,Hu等[20 ] 设计了一种曲面手掌视触觉传感器,可以更灵活地感知复杂物体表面的三维形状. 然而,其触觉感知深度范围仍然有限,显著接触点提取效率有待提高. ...

1

... 作为主流视触觉传感器之一,GelSight传感器[12 ] 创新性地采用光度立体算法来重建接触表面的高精度三维几何形状,在机器人触觉感知和操作领域取得了丰富的研究成果[13 -14 ] . 为了增强传感器的灵活性,研究人员进一步在GelSight的基础上改进结构,设计带有曲面接触面的GelSight类传感器[15 -17 ] . 然而,由于光度立体算法本身的局限性,这些曲面传感器在三维几何形状估计中存在较大的误差,同时光学路径设计复杂,制造工艺难度较高. 除了GelSight类传感器,一些研究团队还开发了其他能够感知三维接触几何形状的曲面视触觉传感器. 例如,SoftBubble传感器[18 ] 利用深度相机捕捉弹性体表面的形变,实现了三维触觉重建. 然而,这类传感器通常成本高昂,制造工艺复杂,且在实际应用中仍有较大的改进空间. 为了解决上述问题,近期Cui等[19 ] 提出GelStereo视触觉传感器,采用双目立体视觉算法重建接触表面的三维几何形状. 该传感器具有较高的触觉点云重建精度,并且传感器形状易于扩展至曲面,为曲面视触觉传感器的设计提供了新的思路. 在此基础上,Hu等[20 ] 设计了一种曲面手掌视触觉传感器,可以更灵活地感知复杂物体表面的三维形状. 然而,其触觉感知深度范围仍然有限,显著接触点提取效率有待提高. ...

In-hand object localization using a novel high-resolution visuotactile sensor

1

2022

... 作为主流视触觉传感器之一,GelSight传感器[12 ] 创新性地采用光度立体算法来重建接触表面的高精度三维几何形状,在机器人触觉感知和操作领域取得了丰富的研究成果[13 -14 ] . 为了增强传感器的灵活性,研究人员进一步在GelSight的基础上改进结构,设计带有曲面接触面的GelSight类传感器[15 -17 ] . 然而,由于光度立体算法本身的局限性,这些曲面传感器在三维几何形状估计中存在较大的误差,同时光学路径设计复杂,制造工艺难度较高. 除了GelSight类传感器,一些研究团队还开发了其他能够感知三维接触几何形状的曲面视触觉传感器. 例如,SoftBubble传感器[18 ] 利用深度相机捕捉弹性体表面的形变,实现了三维触觉重建. 然而,这类传感器通常成本高昂,制造工艺复杂,且在实际应用中仍有较大的改进空间. 为了解决上述问题,近期Cui等[19 ] 提出GelStereo视触觉传感器,采用双目立体视觉算法重建接触表面的三维几何形状. 该传感器具有较高的触觉点云重建精度,并且传感器形状易于扩展至曲面,为曲面视触觉传感器的设计提供了新的思路. 在此基础上,Hu等[20 ] 设计了一种曲面手掌视触觉传感器,可以更灵活地感知复杂物体表面的三维形状. 然而,其触觉感知深度范围仍然有限,显著接触点提取效率有待提高. ...

GelStereo Palm: a novel curved visuotactile sensor for 3-D geometry sensing

1

2023

... 作为主流视触觉传感器之一,GelSight传感器[12 ] 创新性地采用光度立体算法来重建接触表面的高精度三维几何形状,在机器人触觉感知和操作领域取得了丰富的研究成果[13 -14 ] . 为了增强传感器的灵活性,研究人员进一步在GelSight的基础上改进结构,设计带有曲面接触面的GelSight类传感器[15 -17 ] . 然而,由于光度立体算法本身的局限性,这些曲面传感器在三维几何形状估计中存在较大的误差,同时光学路径设计复杂,制造工艺难度较高. 除了GelSight类传感器,一些研究团队还开发了其他能够感知三维接触几何形状的曲面视触觉传感器. 例如,SoftBubble传感器[18 ] 利用深度相机捕捉弹性体表面的形变,实现了三维触觉重建. 然而,这类传感器通常成本高昂,制造工艺复杂,且在实际应用中仍有较大的改进空间. 为了解决上述问题,近期Cui等[19 ] 提出GelStereo视触觉传感器,采用双目立体视觉算法重建接触表面的三维几何形状. 该传感器具有较高的触觉点云重建精度,并且传感器形状易于扩展至曲面,为曲面视触觉传感器的设计提供了新的思路. 在此基础上,Hu等[20 ] 设计了一种曲面手掌视触觉传感器,可以更灵活地感知复杂物体表面的三维形状. 然而,其触觉感知深度范围仍然有限,显著接触点提取效率有待提高. ...

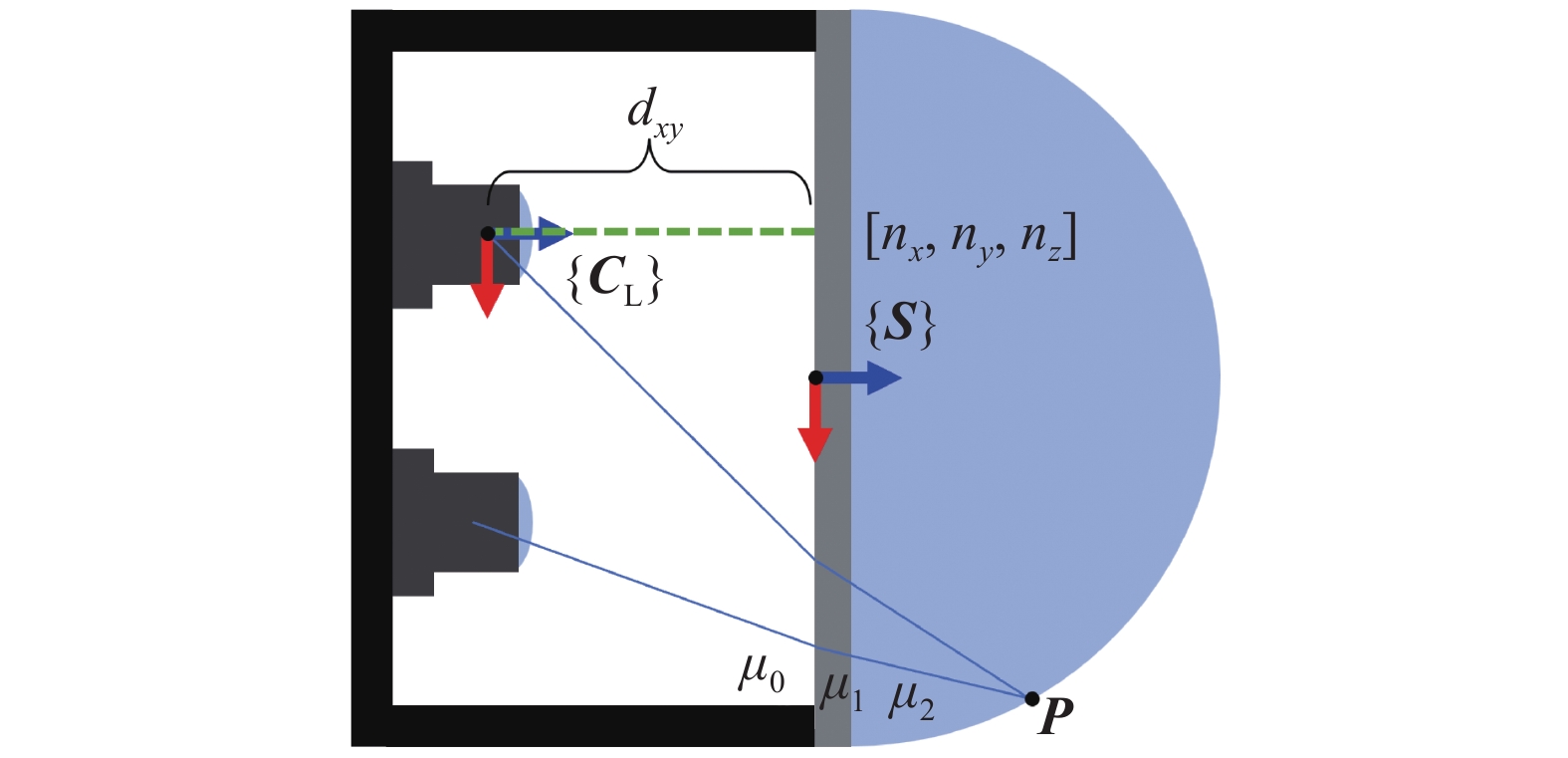

1

... 经过多介质折射的双目立体视觉一直是水下三维重建领域的重要研究方向. Sorensen等[21 ] 提出折射立体光线追踪(refractive stereo ray tracing, RSRT)模型,使用光线追踪技术来建模相机到多重介质后三维点的光线轨迹. Gu等[22 ] 在此基础上,提出RSRT模型的参数标定方法,使得三维重建更加准确. Kunz等[23 ] 、Yoon等[24 ] 和She等[25 ] 进一步将RSRT模型扩展到曲面折射面场景. 然而,这些研究都是针对范围较为广阔的水下场景,模型的假设和标定方法不适用于尺度较小的视触觉传感器. ...

MedUCC: medium-driven underwater camera calibration for refractive 3-D reconstruction

1

2022

... 经过多介质折射的双目立体视觉一直是水下三维重建领域的重要研究方向. Sorensen等[21 ] 提出折射立体光线追踪(refractive stereo ray tracing, RSRT)模型,使用光线追踪技术来建模相机到多重介质后三维点的光线轨迹. Gu等[22 ] 在此基础上,提出RSRT模型的参数标定方法,使得三维重建更加准确. Kunz等[23 ] 、Yoon等[24 ] 和She等[25 ] 进一步将RSRT模型扩展到曲面折射面场景. 然而,这些研究都是针对范围较为广阔的水下场景,模型的假设和标定方法不适用于尺度较小的视触觉传感器. ...

1

... 经过多介质折射的双目立体视觉一直是水下三维重建领域的重要研究方向. Sorensen等[21 ] 提出折射立体光线追踪(refractive stereo ray tracing, RSRT)模型,使用光线追踪技术来建模相机到多重介质后三维点的光线轨迹. Gu等[22 ] 在此基础上,提出RSRT模型的参数标定方法,使得三维重建更加准确. Kunz等[23 ] 、Yoon等[24 ] 和She等[25 ] 进一步将RSRT模型扩展到曲面折射面场景. 然而,这些研究都是针对范围较为广阔的水下场景,模型的假设和标定方法不适用于尺度较小的视触觉传感器. ...

Depth estimation from stereo cameras through a curved transparent medium

1

2020

... 经过多介质折射的双目立体视觉一直是水下三维重建领域的重要研究方向. Sorensen等[21 ] 提出折射立体光线追踪(refractive stereo ray tracing, RSRT)模型,使用光线追踪技术来建模相机到多重介质后三维点的光线轨迹. Gu等[22 ] 在此基础上,提出RSRT模型的参数标定方法,使得三维重建更加准确. Kunz等[23 ] 、Yoon等[24 ] 和She等[25 ] 进一步将RSRT模型扩展到曲面折射面场景. 然而,这些研究都是针对范围较为广阔的水下场景,模型的假设和标定方法不适用于尺度较小的视触觉传感器. ...

Refractive geometry for underwater domes

1

2022

... 经过多介质折射的双目立体视觉一直是水下三维重建领域的重要研究方向. Sorensen等[21 ] 提出折射立体光线追踪(refractive stereo ray tracing, RSRT)模型,使用光线追踪技术来建模相机到多重介质后三维点的光线轨迹. Gu等[22 ] 在此基础上,提出RSRT模型的参数标定方法,使得三维重建更加准确. Kunz等[23 ] 、Yoon等[24 ] 和She等[25 ] 进一步将RSRT模型扩展到曲面折射面场景. 然而,这些研究都是针对范围较为广阔的水下场景,模型的假设和标定方法不适用于尺度较小的视触觉传感器. ...

Soft biomimetic optical tactile sensing with the TacTip: a review

1

2021

... Performance comparison of marker-based curved visuotactile sensors

Tab.2 传感器 E m /mmR /mmn z /mmTacTip[26 ] — ~3.00 127 1.20 Finger-shaped GelForce[27 ] — ~2.50 48 — Spherical sensor[28 ] — ~3.00 77 2.00 Vision-based tactile sensor[29 ] — 2.50 292 — 本研究传感器 0.20 1.67~2.24 397 0.50

4. 物体形状感知实验 为了进一步验证传感器的性能和触觉感知算法的有效性,设计物体形状感知实验. 实验选用6种不同形状的3D打印物体、3种日常物品(如螺丝、剪刀、U盘)以及手指来验证传感器的形状感知性能. 首先,使用物体或手指分别在传感器表面施加不同大小的按压力,定性观察触觉感知算法在不同接触条件下提取的显著点云的变化情况,实验结果如图10 所示. 图中,第1列展示感知实验中使用的物体实物图,其余列依次展示按压过程中在不同力作用下提取的显著点云. 可以看出,随着按压力的增大,物体与传感器表面的接触深度和接触面积逐渐增加,显著点云逐步覆盖更大的区域. 同时,提取的显著点云形状逐渐接近实际物体的轮廓,能够准确反映物体的三维几何形状特征. 这表明提出的触觉点云显著性检测算法在不同接触条件下具有良好的鲁棒性. 此外,实验结果还表明该算法对不同形状和材质的物体具有较强的泛化能力. 在面对具有复杂几何形状的3D打印物体时,算法依然能够准确提取关键的显著点云,且在按压过程中保持形状的连贯性和稳定性. 这一结果证明了本方法在复杂触觉感知任务中的广泛适用性,为机器人在真实环境中的触觉感知与操作奠定了坚实的基础. ...

Finger-shaped GelForce: sensor for measuring surface traction fields for robotic hand

1

2010

... Performance comparison of marker-based curved visuotactile sensors

Tab.2 传感器 E m /mmR /mmn z /mmTacTip[26 ] — ~3.00 127 1.20 Finger-shaped GelForce[27 ] — ~2.50 48 — Spherical sensor[28 ] — ~3.00 77 2.00 Vision-based tactile sensor[29 ] — 2.50 292 — 本研究传感器 0.20 1.67~2.24 397 0.50

4. 物体形状感知实验 为了进一步验证传感器的性能和触觉感知算法的有效性,设计物体形状感知实验. 实验选用6种不同形状的3D打印物体、3种日常物品(如螺丝、剪刀、U盘)以及手指来验证传感器的形状感知性能. 首先,使用物体或手指分别在传感器表面施加不同大小的按压力,定性观察触觉感知算法在不同接触条件下提取的显著点云的变化情况,实验结果如图10 所示. 图中,第1列展示感知实验中使用的物体实物图,其余列依次展示按压过程中在不同力作用下提取的显著点云. 可以看出,随着按压力的增大,物体与传感器表面的接触深度和接触面积逐渐增加,显著点云逐步覆盖更大的区域. 同时,提取的显著点云形状逐渐接近实际物体的轮廓,能够准确反映物体的三维几何形状特征. 这表明提出的触觉点云显著性检测算法在不同接触条件下具有良好的鲁棒性. 此外,实验结果还表明该算法对不同形状和材质的物体具有较强的泛化能力. 在面对具有复杂几何形状的3D打印物体时,算法依然能够准确提取关键的显著点云,且在按压过程中保持形状的连贯性和稳定性. 这一结果证明了本方法在复杂触觉感知任务中的广泛适用性,为机器人在真实环境中的触觉感知与操作奠定了坚实的基础. ...

1

... Performance comparison of marker-based curved visuotactile sensors

Tab.2 传感器 E m /mmR /mmn z /mmTacTip[26 ] — ~3.00 127 1.20 Finger-shaped GelForce[27 ] — ~2.50 48 — Spherical sensor[28 ] — ~3.00 77 2.00 Vision-based tactile sensor[29 ] — 2.50 292 — 本研究传感器 0.20 1.67~2.24 397 0.50

4. 物体形状感知实验 为了进一步验证传感器的性能和触觉感知算法的有效性,设计物体形状感知实验. 实验选用6种不同形状的3D打印物体、3种日常物品(如螺丝、剪刀、U盘)以及手指来验证传感器的形状感知性能. 首先,使用物体或手指分别在传感器表面施加不同大小的按压力,定性观察触觉感知算法在不同接触条件下提取的显著点云的变化情况,实验结果如图10 所示. 图中,第1列展示感知实验中使用的物体实物图,其余列依次展示按压过程中在不同力作用下提取的显著点云. 可以看出,随着按压力的增大,物体与传感器表面的接触深度和接触面积逐渐增加,显著点云逐步覆盖更大的区域. 同时,提取的显著点云形状逐渐接近实际物体的轮廓,能够准确反映物体的三维几何形状特征. 这表明提出的触觉点云显著性检测算法在不同接触条件下具有良好的鲁棒性. 此外,实验结果还表明该算法对不同形状和材质的物体具有较强的泛化能力. 在面对具有复杂几何形状的3D打印物体时,算法依然能够准确提取关键的显著点云,且在按压过程中保持形状的连贯性和稳定性. 这一结果证明了本方法在复杂触觉感知任务中的广泛适用性,为机器人在真实环境中的触觉感知与操作奠定了坚实的基础. ...

Vision-based tactile sensor mechanism for the estimation of contact position and force distribution using deep learning

1

2021

... Performance comparison of marker-based curved visuotactile sensors

Tab.2 传感器 E m /mmR /mmn z /mmTacTip[26 ] — ~3.00 127 1.20 Finger-shaped GelForce[27 ] — ~2.50 48 — Spherical sensor[28 ] — ~3.00 77 2.00 Vision-based tactile sensor[29 ] — 2.50 292 — 本研究传感器 0.20 1.67~2.24 397 0.50

4. 物体形状感知实验 为了进一步验证传感器的性能和触觉感知算法的有效性,设计物体形状感知实验. 实验选用6种不同形状的3D打印物体、3种日常物品(如螺丝、剪刀、U盘)以及手指来验证传感器的形状感知性能. 首先,使用物体或手指分别在传感器表面施加不同大小的按压力,定性观察触觉感知算法在不同接触条件下提取的显著点云的变化情况,实验结果如图10 所示. 图中,第1列展示感知实验中使用的物体实物图,其余列依次展示按压过程中在不同力作用下提取的显著点云. 可以看出,随着按压力的增大,物体与传感器表面的接触深度和接触面积逐渐增加,显著点云逐步覆盖更大的区域. 同时,提取的显著点云形状逐渐接近实际物体的轮廓,能够准确反映物体的三维几何形状特征. 这表明提出的触觉点云显著性检测算法在不同接触条件下具有良好的鲁棒性. 此外,实验结果还表明该算法对不同形状和材质的物体具有较强的泛化能力. 在面对具有复杂几何形状的3D打印物体时,算法依然能够准确提取关键的显著点云,且在按压过程中保持形状的连贯性和稳定性. 这一结果证明了本方法在复杂触觉感知任务中的广泛适用性,为机器人在真实环境中的触觉感知与操作奠定了坚实的基础. ...