随着建筑智能化的发展,传统人工砌筑因效率低、质量不稳定等问题而难以满足现代施工要求[1 ] 。泥浆涂抹作为砌筑施工的关键工序,其质量直接关系着建筑结构的性能。采用泥浆涂抹机器人可提升砌筑施工的自动化水平[2 ] ,但现场泥浆飞溅常常导致砖块涂抹面被遮挡,严重干扰机器人对砖块涂抹面的识别与定位,制约其作业精度与效率。因此,急需具有抗遮挡性能的识别与定位方法,来提升涂抹机器人在复杂工况下的实用性和工作稳定性。

目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法。点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位。如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测。2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置。如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取。端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤。如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计。基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度。如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计。单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景。传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定。而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制。

此外,深度图像的质量是影响定位精度的关键因素[13 ] 。复杂光照和物体遮挡等均会引发深度空洞、轮廓模糊等问题[14 ] ,导致点云质量下降。已有研究尝试从图像补全和深度引导等方面进行优化。如:Liu等[15 ] 构建了彩色-深度联合模型,来提升修复精度;Wang等[16 ] 利用三边约束进行稀疏表示,以改善深度边缘填充效果。常见的深度修复方法主要包括彩色-深度联合补全、深度梯度与边缘约束优化、学习型深度补全以及基于几何先验的补全方法。彩色-深度联合补全和深度梯度与边缘约束优化方法在一般场景中表现良好,但缺乏对规则几何轮廓的显式建模;学习型与几何型方法则在遮挡导致的结构缺失的情况下仍可能产生深度模糊或突变,因此也难以直接应用于泥浆遮挡下的涂抹面定位研究。

针对耐火砖定位需求以及处理深度信息时遮挡干扰、深度缺失、轮廓模糊等问题,本研究以耐火砖为对象,构建机械臂与双目相机协同的实验平台,提出一种基于机器视觉的遮挡区域深度修复与涂抹面定位方法。将深度修复与点云处理相结合,实现对砖块涂抹面的位姿计算;针对泥浆遮挡造成的深度缺失、深度覆盖等问题,构建了修复模型来对深度异常区域进行补偿,以提高定位精度;同时,在涂抹面实例分割中引入轮廓约束,区分涂抹面与背景深度,以保证边缘结构的完整性。

1 实验平台与系统标定

1.1 实验平台

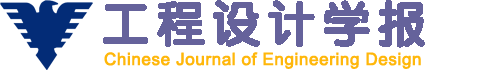

砖块涂抹面定位实验平台如图1 所示。其中:UR10六轴机械臂承担主要执行任务,用于砖块涂抹面识别定位后喷涂动作的精准实施;Intel RealSense D435深度相机作为双目视觉传感器,能够同时采集彩色图像和深度图像,为涂抹面识别、深度修复和三维空间定位提供原始输入数据。

图1

图1

砖块涂抹面定位实验平台

Fig.1

Brick plastered surface positioning experimental platform

1.2 双目相机成像

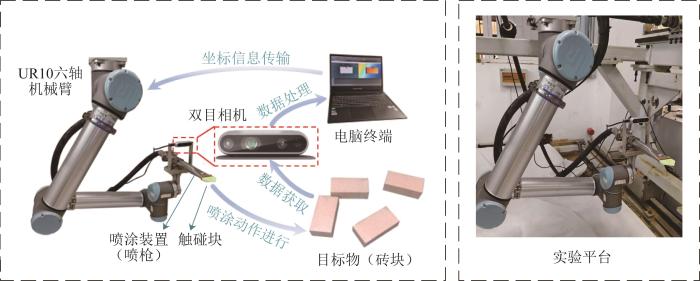

双目相机根据特征点在2个成像平面中的视差、相机内参数及基线长度计算出特征点的位置信息。本研究采用的双目相机在出厂前已精确标定,故可直接使用其标定参数进行深度计算与空间定位。相机的主要参数如表1 所示。

双目相机的成像原理如图2 所示。在理想状态下,左、右摄像头的成像平面共面且水平方向(X 向)对齐。

图2

图2

双目相机成像原理示意

Fig.2

Schematic of stereo camera imaging principle

设空间中目标点 P x , y , z ),其在左、右成像平面的投影点分别为P l (x l , y l )、P r (x r , y r ),可得其深度坐标z 为:

z = f ⋅ T x l - x r (1)

在以左相机光心O l 为原点的相机坐标系下,目标点 P ( x , y , z ) P l (x l , y l )满足以下关系:

x = ( x l - c x ) ⋅ z f , y = ( y l - c y ) ⋅ z f (2)

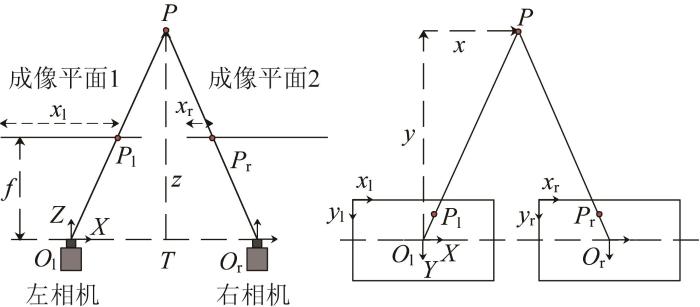

1.3 手眼标定

手眼标定是为了实现相机坐标系向机器臂基坐标系转换。本研究采用棋盘格手眼标定方法,如图 3 所示。标定板为具有6×9个内角点、单格宽为25 mm的平面棋盘格。为了提高标定精度,共采集24组不同姿态相机的数据。通过控制UR10六轴机械臂末端执行器使相机产生平移与旋转,使棋盘格在相机视野中呈现多样的深度与角度,以避免位姿分布单一导致的标定不稳定性。

图3

图3

手眼标定(眼在手上)

Fig.3

Hand-eye calibration (eye-in-hand)

机械臂末端执行器相对于机器臂基坐标系的位姿为T B E T C O X n

T B O = T B E n X T C n O (3)

式中:T B O

故当机械臂处于任意两个不同的拍摄位姿k 与l

T E l E k X = X T C l C k (4)

根据上述坐标系之间的相对关系,可将其转换为A X = X B A B A X = X B

X = - 0.032 6 0.999 2 0.019 7 - 119.65 - 0.034 9 0.018 6 - 0.999 2 271.61 - 0.998 8 - 0.033 2 0.034 3 41.05 0 0 0 1 (5)

2 涂抹面深度修复与定位

2.1 深度修复与定位算法

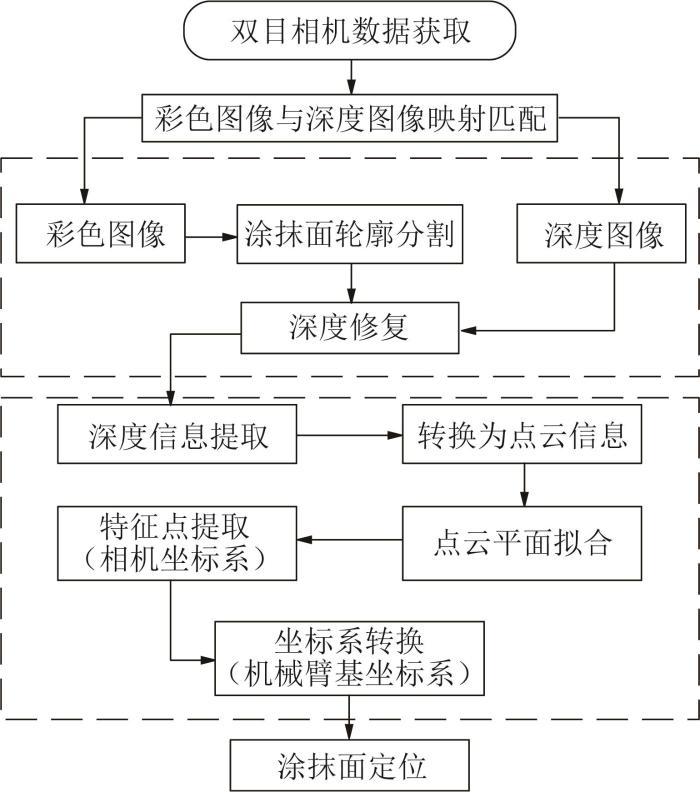

本文提出了在砖块涂抹面局部遮挡下基于机器视觉的深度修复与定位算法。该算法的结构如图4 所示。

图4

图4

深度修复与定位算法结构

Fig.4

Architecture of depth restoration and localization algorithm

算法包括涂抹面轮廓分割、深度修复和三维空间定位三部分。利用YOLOv11实例分割模型提取砖块轮廓,并针对遮挡、噪声和边缘模糊等问题构建深度修复模型,以提升深度数据的完整性;深度图像修复后生成三维点云,经密度加权、平面拟合与最小外接矩形计算后获得涂抹面在相机坐标系下的位置,最后通过手眼标定转换至机械臂基坐标系,为喷涂路径的规划提供精确的位姿信息。

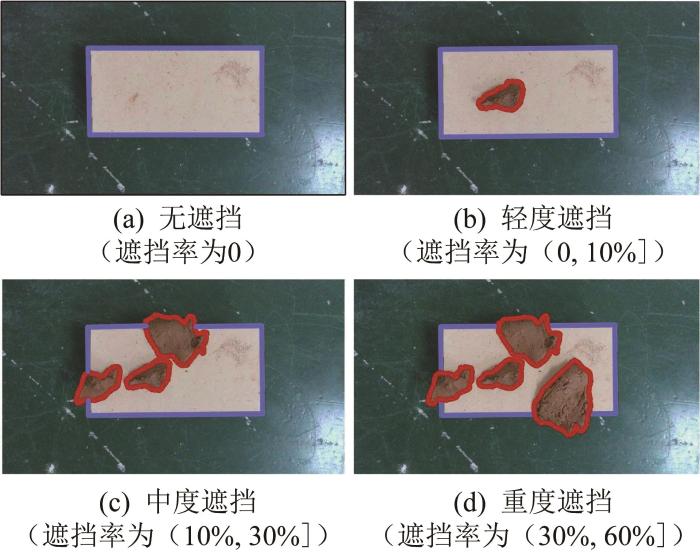

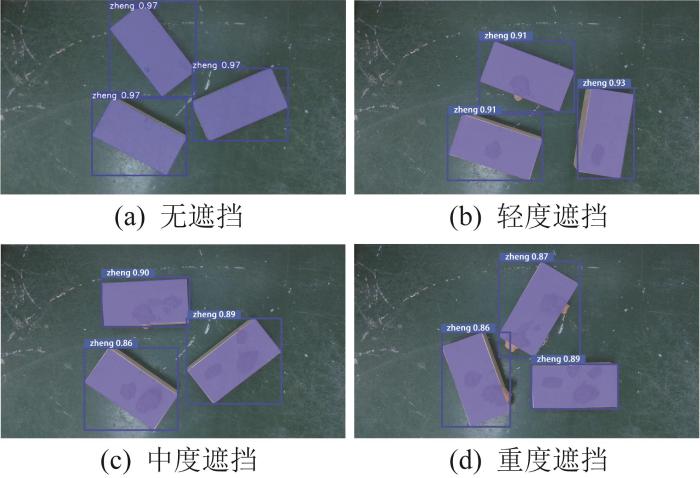

2.2 涂抹面轮廓分割

为评估泥浆遮挡对涂抹面定位的影响,设置了无遮挡、轻度遮挡、中度遮挡和重度遮挡等4种工况。本文中遮挡率按泥浆覆盖区域占涂抹面有效区域的比例计算,如图5 所示。随着遮挡率提升,砖块表面被泥浆局部或大面积覆盖,涂抹区域的边界逐渐模糊,这贴近实际砌筑中的复杂工况。基于上述工况,共采集1 280张不同泥浆遮挡率和不同拍摄角度(即相机光轴与涂抹面法向的夹角为0~35°)的砖块图像,以增强数据的多样性和可泛化能力。各遮挡率的数据集均按70%∶20%∶10%的比例划分为训练集、验证集和测试集。

图5

图5

泥浆遮挡工况

Fig.5

Mud occlusion working condition

常用的语义分割与实例分割模型包括YOLOv8-Seg、Mask R-CNN、FCN和DeepLab等。经过综合比较,选用YOLOv11作为涂抹面分割模型。原因如下:YOLOv11采用单阶段检测架构及多尺度特征提取,其推理速度明显优于Mask R-CNN、DeepLab等双阶段或密集像素级方法,能满足机器人实时检测要求;此外,深层特征融合和注意力机制使其对泥浆遮挡引起的局部结构变化更敏感,泛化能力优于FCN和DeepLab。因此,基于实时性、鲁棒性和适应性等方面的考虑,选择YOLOv11分割模型进行涂抹面轮廓分割。

2.3 深度修复

2.3.1 涂抹区域标记

利用YOLOV11实例分割模型输出砖块彩色图像,对其涂抹面轮廓边界点集合C = ( x i , y i ) E ( x , y )

E ( x , y ) = 1 , 轮廓 内部 0 , 轮廓 外部 (6)

2.3.2 置信度分层

由于砖块涂抹面无遮挡时呈规则平面,其深度值在水平和垂直方向连续。深度突变通常意味着泥浆遮挡、光照干扰或传感器噪声导致的区域深度缺失。为避免将真实的涂抹面区域深度误判为异常,在连续性检测时结合了实例分割涂抹区域标记与局部梯度分析:在对涂抹面区域的像素点进行深度连续性判断时,仅当局部深度梯度超过阈值且该像素点位于掩模内部而非真实物体边缘附近时,才将它判定为异常深度区域。通过该策略,可有效区分涂抹面的自然边缘与由泥浆遮挡等引起的异常深度突变。

深度连续性检测用于判断像素点pi (x , y )的深度值变化在水平和垂直方向是否符合连续性原则,可定义为:

T ( x , y ) = ( d 2 - d ) - ( d - d 1 ) p 2 - p 1 (7)

式中:T ( x , y ) d p i d 1 d 2 p i p 1 p 2

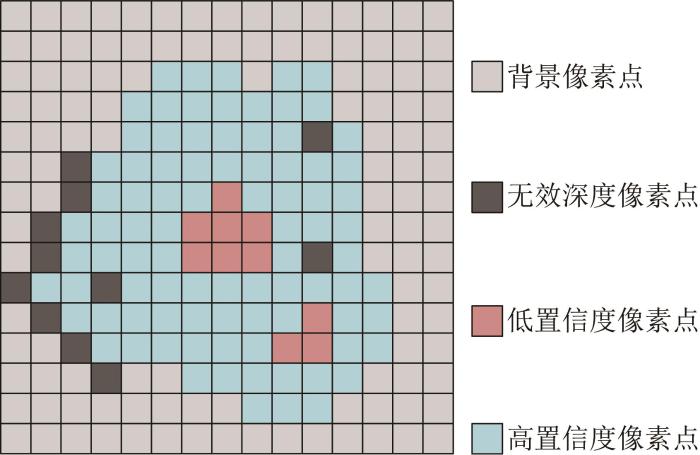

结合连续性检测和深度值进行置信度评估,将涂抹面内的像素点进行分类。水平连续度T h T v T t 的像素点归为高置信度像素点;无效深度像素点对应深度为空值的像素点;其余的则归为低置信度像素点。像素点置信度分层如图6 所示。高置信度区域所对应的深度信息被认为具有较高的可靠性,作为后续修复的基准;低置信度及无效深度区域则在修复过程中主要依赖于高置信度区域深度信息的指导进行补全和修复。

图6

图6

像素点置信度分层

Fig.6

Pixel confidence level stratification

2.3.3 深度修复模型

本研究采用置信度分层机制对砖块涂抹面的深度信息进行分层处理。通过对高置信度区域的梯度统计,建立梯度变化模型,预测待修复像素点的深度值。根据像素点置信度动态调整滤波权重,有针对性地修复低置信度和无效深度区域,同时保留高置信度区域的深度信息。引入轮廓信息约束,保证修复过程中边缘结构不被过度平滑,防止细节丢失。基于传统联合双边滤波,结合置信度分层、深度梯度预测和轮廓约束,构建深度修复模型,用于砖块涂抹面深度修复。

结合砖块涂抹面为规则平面的结构特点,利用高置信度区域内的梯度变化来构建深度预测模型,对低置信度和无效深度区域内目标像素点的深度值进行预测。设d (p )为像素点p 的深度值,其在水平和垂直方向的梯度G ( p )

G ( p ) = d ( p + Δ s ) - d ( p ) (8)

统计出涂抹面内高置信度区域像素点在水平和垂直方向的平均梯度G x ¯ G y ¯ p D ' ( p , q ) q

D ' ( p , q ) = d ( q ) + Δ x ( q , p ) ⋅ G x ¯ + Δ y ( q , p ) ⋅ G y ¯ (9)

式中:∆ x ( q , p ) ∆ y ( q , p ) q p

传统联合双边滤波因滤波核参数固定且未区分深度覆盖与深度缺失区域,容易导致异常深度数据扩散。为此,本研究引入深度置信度分层机制,对高置信度、低置信度和无效深度区域分配不同的权重。此策略既保护了高置信度区域的原始深度,又防止了深度信息的错误扩散。置信度加权函数定义如下:

Q ( x , y ) = 1 , 高置 信度 0 , 无效 深度 e - d e σ Q , 低置 信度 (10)

式中:d e 为滤波器中心像素点与目标像素点的欧几里得距离,σ Q

根据测试数据中置信度分布的统计结果可知,当σ Q σ Q

传统联合双边滤波对引导彩色图像依赖过强,对深度边缘缺乏区分,当物体颜色变化与深度变化不一致时,基于颜色的边缘保持机制会应用错误。为了弥补其不足,本研究提出了轮廓信息约束。通过涂抹面二值掩模函数E ( x , y ) q p W e ( p , q )

W e ( p , q ) = α , E ( p ) = E ( q ) 0 , E ( p ) ≠ E ( q ) (11)

通过深度信息预测、置信度分层加权和轮廓信息约束,在传统联合双边滤波基础上构建了深度修复模型,从而实现对深度图像因局部泥浆遮挡导致的深度覆盖、深度缺失及边缘结构模糊等深度异常问题的自适应修复。深度修复模型可表示为:

W = ∑ q ∈ N p Q m ( q ) ⋅ W e , m ( q , p ) (12)

D m n e w ( p ) = 1 W ⋅ ∑ q ∈ N p Q m ( q ) ⋅ W e , m ( q , p ) ⋅ D m ' ( q , p ) (13)

式中:Q m ( q ) W e , m ( q , p ) m q p N ( p ) Dm 为第m D m ' ( q , p ) p

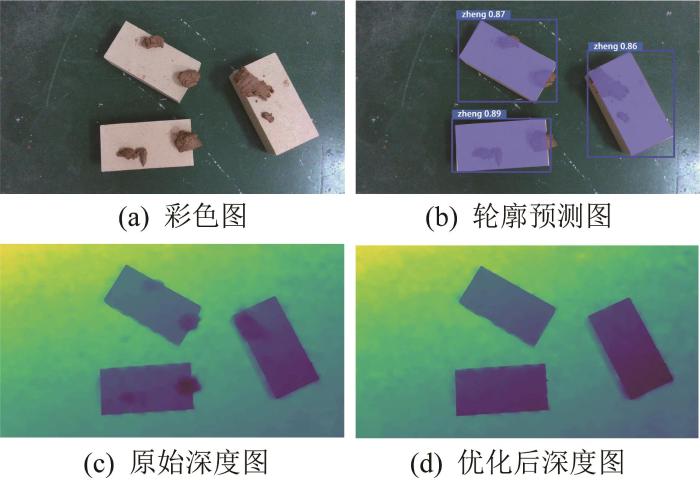

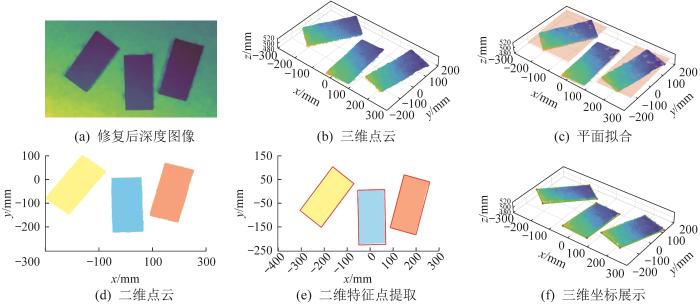

深度信息优化效果如图7 所示。由图可知,修复后深度图像的边界较清晰,深度分布更连续。这主要得益于以下两方面的机制:其一,通过实例分割实现了轮廓约束,有效改善了边界模糊状况;其二,通过置信度分层机制结合分割区域标记与局部梯度分析,检测出深度异常区域,并通过深度修复模型进行补偿,从而显著提升了平面区域的深度完整性与连续性。

图7

图7

深度信息优化效果

Fig.7

Depth information optimization results

2.4 三维空间定位

图8

图8

涂抹面三维空间定位步骤

Fig.8

Steps for three-dimensional spatial localization of plastered surface

2.4.1 深度图像转换为三维点云

深度图像转换为三维点云是基于双目相机成像原理实现的。根据式(2),根据相机内参数将图像中每个像素点的深度值映射到相机坐标系中,如图8 (b)所示。

2.4.2 涂抹面平面拟合

为提取点云中涂抹面的平面参数,本研究引入一种点云密度加权的随机采样一致性(random sample consensus,RANSAC)平面拟合方法[17 ] 。该方法将点云局部密度作为权重,在传统RANSAC框架下结合加权最小二乘优化,有效应对因相机倾斜拍摄造成的点云分布不均与噪声干扰问题。

设目标点云集合K = p i = ( x i , y i , z i ) i = 1 N

a x + b y + c z + d p = 0 (14)

式中:向量 n a b c )表示平面法向量,d P 为平面到原点的距离。

像素点p i ρi 定义为其邻点之间平均距离的倒数,即:

ρ i = 1 ∑ i = 1 N d i / N (15)

据此构建加权误差函数,并结合加权RANSAC平面拟合,得到最优平面参数及对应的点集合,如图8 (c)所示,其属于拟合平面的有效点云区域。

2.4.3 涂抹面轮廓特征点提取

为进一步精确提取砖块涂抹面的特征点,引入平面投影与最小外接矩形相结合的方法。首先,依据涂抹面法向量 n a b c )构造旋转矩阵,使其对齐Z 图8 (d)所示;其次,采用最小外接矩形提取该投影的矩形边界角点坐标,如图8 (e)所示;最后,通过逆变换恢复至原三维坐标系,获取角点的三维位姿,如图8 (f)所示。为实现涂抹装置与机械臂协同作业,通过手眼标定矩阵将角点坐标转换至机械臂基坐标系下,为涂抹路径的规划提供空间约束。

3 实验验证

3.1 砖块涂抹面分割性能实验

用于模型训练的硬件包括Intel i5-11400H处理器、GeForce RTX 3050显卡以及16 GB内存。YOLOv11实例分割模型训练参数如表2 所示。

为了评估模型的检测效果和整体性能,本文选取了常用的评价指标,包括精确率A 、召回率R 及精度均值P m 。其计算公式分别为:

A = T p T p + F p , R = T p T p + F n P m = 1 U ∑ u = 1 U A u R u (16)

式中:T p F p F n u U

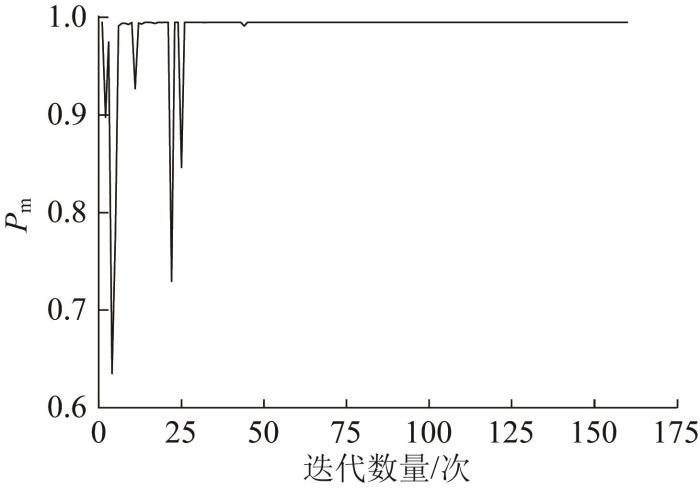

训练完成后,用验证集对模型进行评估。模型识别精度均值如图9 所示。由图可知,约经过50次迭代后,模型性能基本趋于稳定,精度均值收敛至0.974。将此时的模型参数视为最优模型参数进行保存,用于后续测试与性能评估。

图9

图9

模型识别精度均值

Fig.9

Average recognition accuracy of model

为综合评估模型的识别性能,采用综合识别性能参数F 1

F 1 = 2 × A × R A + R (17)

对不同遮挡工况下的砖块涂抹面图像进行测试,得到的识别性能参数如表3 所示,轮廓分割效果如图10 所示。

图10

图10

不同遮挡工况下涂抹面轮廓分割效果

Fig.10

Segmentation results of plastered surfaces under different occlusion working conditions

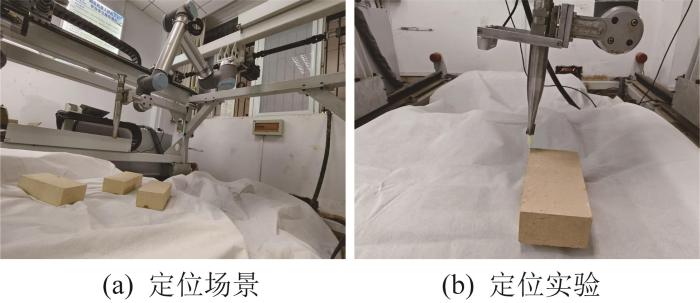

3.2 砖块涂抹面定位实验

为验证本文提出的涂抹面深度修复与定位方法的性能,基于实验平台开展实验,对比本文方法与其他常用深度修复方法在定位精度与速度上的表现,评估机械臂在不同姿态和不同遮挡工况下的定位精度稳定性。定位场景及实验如图11 所示。

图11

图11

涂抹面定位场景及实验

Fig.11

Scene and experiment of plastered surface localization

3.2.1 不同深度修复方法性能对比实验

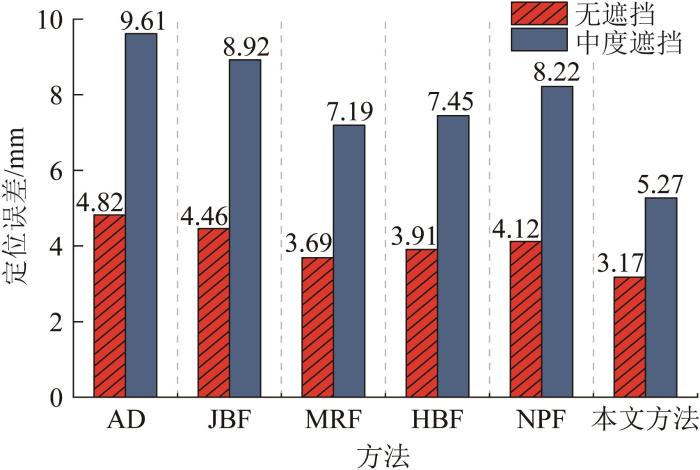

为全面验证本文方法在遮挡工况下的有效性,本研究将各向异性扩散(anisotropic diffusion, AD)[18 ] 、联合双边滤波(joint bilateral filter,JBF)[19 ] 、马尔可夫随机场(Markov random field,MRF)[20 ] 、分层双边滤波(hierarchical bilateral filter,HBF)[21 ] 以及噪声感知滤波函数(noise perception filter,NPF)[22 ] 等5种经典深度修复方法作为对照组,进行三轴定位误差和运行时间对比实验。

为接近实际涂抹作业工况,实验中设置了遮挡和相机姿态变化等实验条件。遮挡条件包括无遮挡和中度遮挡工况;相机姿态变化条件包括0~20°的拍摄角度和400~600 mm的拍摄距离,涵盖了机器人作业时典型观测范围。

对各方法的定位性能进行评估。将通过各方法修复后的深度图像生成点云和平面拟合,获得涂抹面的三维位姿,并计算X 、Y 、Z 三个方向的定位误差,并计算其平均值,结果如图12 所示。由图可知:在无遮挡工况下,各方法在边缘细节保持性方面有所差异;在中度遮挡工况下,因受到泥浆遮挡导致的深度突变与大面积深度缺失的影响,经典方法的定位误差明显比本文方法大。本文方法在2种遮挡工况下的三轴平均定位误差均为最小,显示出最强的遮挡区域恢复能力。

图12

图12

不同深度修复方法定位误差对比

Fig.12

Comparison of localization errors among different depth restoration methods

为进一步考察方法的实时性,统计了各方法在相同硬件平台的平均运行时间,结果如表4 所示。由表可知:MRF与HBF的运行时间明显较长,因其依赖迭代优化或多层级处理;AD、JBF和NPF的运行速度稍快,但其修复精度不能满足机器人定位需求;本文方法在保持高精度的同时运行时间最短,在速度与精度之间实现了良好的平衡,更能满足涂抹机器人在线定位的实时性要求。

3.2.2 机械臂姿态变化下的三轴定位误差分析

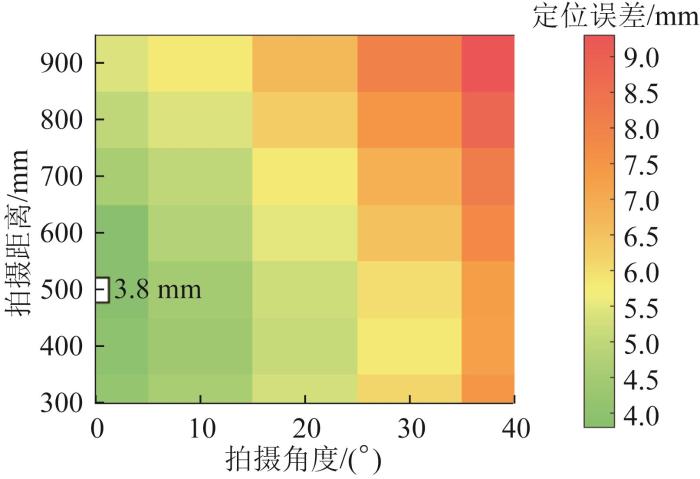

为验证本文方法在机械臂多姿态条件下的适应性,构建了接近实际涂抹场景的测试环境:在每次数据采集时耐火砖随机摆放,使其平移与旋转后呈现不同的姿态,且涂抹面设为泥浆中度遮挡,以模拟真实作业中的局部覆盖。在此基础上,进一步考察拍摄角度(0~40°)和拍摄距离(300~900 mm)的变化对定位精度的影响,并获取各姿态下的三轴平均定位误差。根据实验结果绘制角度-距离二维定位误差热力图,如图13 所示。

图13

图13

角度-距离二维定位误差热力图

Fig.13

Angle-distance 2D localization error heatmap

由图13 可知,随着拍摄角度增大,定位误差整体提高。当拍摄角度超过30°时,误差增幅明显,部分误差已接近或超过允许值(5 mm)。这主要是由于随着拍摄角度增大,双目视差的有效覆盖区域减小,涂抹面可匹配特征点的密度降低,定位噪声和误差扩散加剧。同时,拍摄距离对定位误差也有显著影响,当距离从300 mm增至900 mm,涂抹面在成像平面的投影尺寸减小,其像素点随之减少,导致可用于视差计算的有效匹配点减少,深度分辨率下降,以致定位精度降低。综合来看,最佳相机姿态为0~20°的小角度和400~600 mm的中等距离。

3.2.3 泥浆遮挡率变化下的三轴定位误差分析

为验证本文方法在不同泥浆遮挡率下的鲁棒性与精度,设计了对比实验。实验组采用本文方法,对照组则无深度修复,直接采用基于原始深度图像生成的点云并执行相同的处理流程。实验中保持机械臂姿态一致,拍摄角度为0,拍摄距离为600 mm,仅改变泥浆遮挡率。

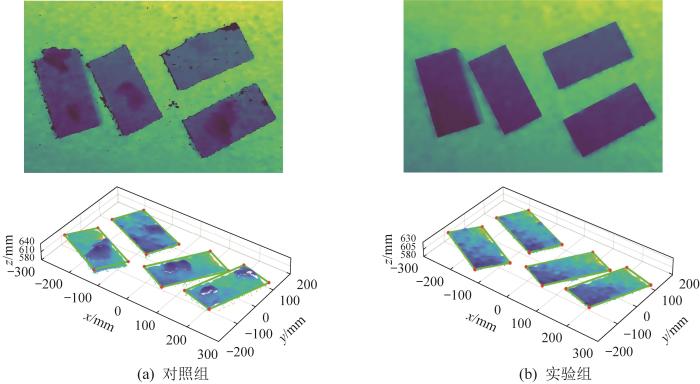

泥浆遮挡工况下深度图像与特征点的提取如图14 所示。由图可知:对照组因泥浆遮挡导致点云局部凸起、空洞和边缘模糊等问题,破坏了原始平面结构,使得提取的角点定位误差较大;实验组通过引入深度修复模型,有效地对遮挡、空洞和边缘模糊区域的深度进行修复,显著提升了点云的完整性与平整度,从而提升了角点定位的准确性。

图14

图14

泥浆遮挡工况下深度图像与特征点提取

Fig.14

Depth images and feature point extractions under mud occlusion working conditions

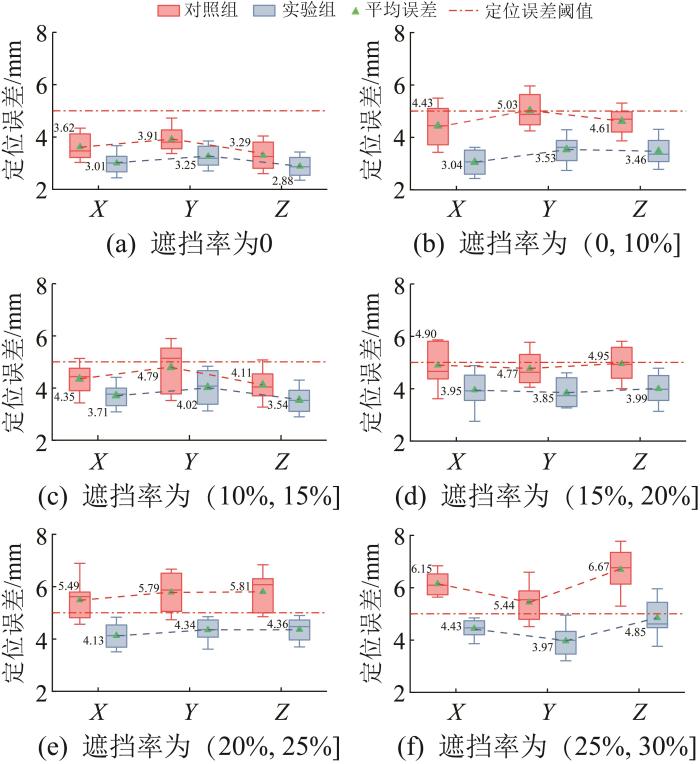

记录不同泥浆遮挡率下的三轴定位误差,并将数据绘制成箱线图,如图15 所示。

图15

图15

不同泥浆遮挡率下三轴定位误差

Fig.15

Three axis localization errors under different mud occlusion rates

由图15 (a)可知,在无遮挡工况下,实验组始终表现出比对照组更小的三轴定位误差,X 、Y 、Z 向的平均定位误差分别减少17.8%、16.1%和12.6%。X 、Y 向定位误差的减小主要是由于深度修复过程中引入的轮廓边缘约束有效解决了深度信息中边缘模糊的问题,特征点提取机制使得平面内的几何结构得到了更精确的拟合;Z 向定位主要依赖于双目相机的直接测距精度,主要通过修复深度缺失实现深度信息优化,因此相较于平面的X 、Y 向,Z 向定位误差降低幅度相对有限。

由图15 (b)至图15 (f)可知:在轻度和中度遮挡工况下,随着泥浆遮挡率增大,三轴定位误差有所增大,且对照组在高遮挡率下误差增大显著,最大误差远超涂抹机器人5 mm的定位误差阈值;实验组X 、Y 、Z 向的平均定位误差相比对照组分别减少23.8%、21.2%、25.1%;当遮挡率不超过25%时,实验组的误差始终控制在5 mm以内,且在30%遮挡率下仍然有较好的优化效果,X 、Y 、Z 向的平均误差相比对照组分别减少了1.71、1.48和2.73 mm。

实验组三轴定位误差显著减小主要归因于深度修复对涂抹面局部泥浆遮挡造成的深度覆盖区域的有效补偿。

4 结 论

为满足砌筑施工中涂抹机器人对砖块涂抹面快速、精准定位的需求,针对泥浆飞溅引起的涂抹面局部遮挡问题,设计了一种基于机器视觉的局部遮挡涂抹面修复与定位方法。主要工作如下:

1)构建了集轮廓分割、深度修复和三维空间定位于一体的砖块涂抹面定位框架,实现了泥浆局部遮挡工况下的涂抹面精准定位。

2)设计的深度修复模型有效弥补了环境噪声等因素导致的深度缺失和边缘模糊等缺陷。在无遮挡工况下,深度修复后X 、Y 、Z 向的平均定位误差分别减少17.8%、16.1%和12.6%。

3)采用本文方法能显著减小遮挡导致的定位误差。在轻度和中度遮挡工况下,X 、Y 、Z 向的平均定位误差分别减少23.8%、21.2%和25.1%。当遮挡率不超过25%时,最大误差控制在5 mm以内。

本文方法在相机多姿态变化和泥浆中度遮挡等典型工况下具有较高的定位稳定性,为涂抹机器人进一步适应复杂施工环境提供了支撑。未来将结合工业视觉与多机器人协同,拓展本文方法在大规模、多目标、多遮挡砌筑场景中的应用。

参考文献

View Option

[1]

章严 传统抹灰与抹灰机器人的应用分析

[J]. 绿色建造与智能建筑 , 2025 (1 ): 96 -98 .

[本文引用: 1]

ZHANG Y Application analysis of traditional plastering and plastering robots

[J]. Green Construction and Intelligent Building , 2025 (1 ): 96 -98 .

[本文引用: 1]

[2]

张广川 可实现自动砌墙的建筑机器人设计

[J]. 机械 , 2011 , 38 (8 ): 79 -80 .

[本文引用: 1]

ZHANG G C Design of building robot that can realize automatic wall-built

[J]. Machinery , 2011 , 38 (8 ): 79 -80 .

[本文引用: 1]

[3]

LI H ZENG Q F ZHUANG T D et al Accurate pose estimation of the texture-less objects with known CAD models via point cloud matching

[J]. IEEE Sensors Journal , 2023 , 23 (21 ): 26259 -26268 .

[本文引用: 1]

[4]

张旭辉 , 杨骏豪 , 杨文娟 , 等 基于双目视觉的掘进装备定位系统移站自主标定方法

[J]. 工程设计学报 , 2025 , 32 (1 ): 1 -10 .

[本文引用: 1]

ZHANG X H YANG J H YANG W J et al Automatic calibration method for station transfer in tunneling equipment positioning system based on binocular vision

[J]. Chinese Journal of Engineering Design , 2025 , 32 (1 ): 1 -10 .

[本文引用: 1]

[5]

张宇廷 , 王宗彦 , 王曦 , 等 改进K-means聚类算法的自适应Canny算子工件边缘检测

[J]. 组合机床与自动化加工技术 , 2022 (5 ): 1 -5 .

[本文引用: 1]

ZHANG Y T WANG Z Y WANG X et al Edge detection of workpiece based on improved K-means clustering algorithm and adaptive canny algorithm

[J]. Modular Machine Tool & Automatic Manufacturing Technique , 2022 (5 ): 1 -5 .

[本文引用: 1]

[6]

CHEN J L WEI X L LIANG X Q et al High precision 3D reconstruction and target location based on the fusion of visual features and point cloud registration

[J]. Measurement , 2025 , 243 : 116455 .

[本文引用: 1]

[7]

BIGLIA A ZAMAN S GAY P , et al 3D point cloud density-based segmentation for vine rows detection and localisation

[J]. Computers and Electronics in Agriculture , 2022 , 199 : 107166 .

[本文引用: 1]

[8]

ZHANG X L LI H L MENG F M et al Segmenting beyond the bounding box for instance segmentation

[J]. IEEE Transactions on Circuits and Systems for Video Technology , 2022 , 32 (2 ): 704 -714 .

[本文引用: 1]

[9]

JIN T T HAN X Z WANG P G et al Enhanced deep learning model for apple detection, localization, and counting in complex orchards for robotic arm-based harvesting

[J]. Smart Agricultural Technology , 2025 , 10 : 100784 .

[本文引用: 1]

[10]

AARTHI R RISHMA G A vision based approach to localize waste objects and geometric features exaction for robotic manipulation

[J]. Procedia Computer Science , 2023 , 218 : 1342 -1352 .

[本文引用: 1]

[11]

LIU X WANG H XUE S B et al SEMPose: a single end-to-end network for multi-object pose estimation

[J]. Neurocomputing , 2025 , 654 : 131194 .

[本文引用: 1]

[12]

NI P Y ANG M H Graduated non-convex feature-metric-based 6D object pose refinement via deep reinforcement learning

[J]. Robotics and Autonomous Systems , 2025 , 194 : 105177 .

[本文引用: 1]

[13]

ZHAO H W MA W H JI P R et al Modeling the measurement accuracy for binocular stereo vision system

[J]. Optics Express , 2025 , 33 (9 ): 19051 -19066 .

[本文引用: 1]

[14]

BI X YANG B ZENG J et al A novel holes filling method based on layered depth map and patch sparsity for complex-scene images

[J]. Microelectronics Journal , 2021 , 114 : 105140 .

[本文引用: 1]

[15]

LIU W CHEN X G YANG J et al Robust color guided depth map restoration

[J]. IEEE Transactions on Image Processing , 2017 , 26 (1 ): 315 -327 .

[本文引用: 1]

[16]

WANG Z Y HU J H WANG S Z et al Trilateral constrained sparse representation for Kinect depth hole filling

[J]. Pattern Recognition Letters , 2015 , 65 : 95 -102 .

[本文引用: 1]

[17]

叶锦华 , 林旭敏 , 吴海彬 基于DBSCAN的改进RANSAC点云平面拟合算法

[J]. 湖南大学学报(自然科学版) , 2025 , 52 (2 ): 76 -87 .

[本文引用: 1]

YE J H LIN X M WU H B Improved RANSAC point cloud plane fitting algorithm based on DBSCAN

[J]. Journal of Hunan University (Natural Sciences) , 2025 , 52 (2 ): 76 -87 .

[本文引用: 1]

[18]

徐岩松 , 张爱军 , 杨萌 基于局部梯度统计的自适应各向异性扩散

[J]. 激光杂志 , 2023 , 44 (8 ): 60 -64 .

[本文引用: 1]

XU Y S ZHANG A J YANG M Adaptive anisotropic diffusion based on local gradient statistics

[J]. Laser Journal , 2023 , 44 (8 ): 60 -64 .

[本文引用: 1]

[19]

RUHELA R GUPTA B SINGH LAMBA S An efficient approach for texture smoothing by adaptive joint bilateral filtering

[J]. The Visual Computer , 2023 , 39 (5 ): 2035 -2049 .

[本文引用: 1]

[20]

WU Z R LIN D H TANG X O Deep Markov random field for image modeling

[C]//Computer Vision-ECCV 2016 . Cham : Springer , 2016 : 295 -312 .

[本文引用: 1]

[21]

万琴 , 朱晓林 , 陈国泉 , 等 分层联合双边滤波的深度图修复算法研究

[J]. 计算机工程与应用 , 2021 , 57 (6 ): 184 -190 .

[本文引用: 1]

WAN Q ZHU X L CHEN G Q et al Research on depth map restoration algorithm based on hierarchical joint bilateral filter

[J]. Computer Engineering and Applications , 2021 , 57 (6 ): 184 -190 .

[本文引用: 1]

[22]

LIANG H LI N ZHAO S R Salt and pepper noise removal method based on a detail-aware filter

[J]. Symmetry , 2021 , 13 (3 ): 515 .

[本文引用: 1]

传统抹灰与抹灰机器人的应用分析

1

2025

... 随着建筑智能化的发展,传统人工砌筑因效率低、质量不稳定等问题而难以满足现代施工要求[1 ] .泥浆涂抹作为砌筑施工的关键工序,其质量直接关系着建筑结构的性能.采用泥浆涂抹机器人可提升砌筑施工的自动化水平[2 ] ,但现场泥浆飞溅常常导致砖块涂抹面被遮挡,严重干扰机器人对砖块涂抹面的识别与定位,制约其作业精度与效率.因此,急需具有抗遮挡性能的识别与定位方法,来提升涂抹机器人在复杂工况下的实用性和工作稳定性. ...

传统抹灰与抹灰机器人的应用分析

1

2025

... 随着建筑智能化的发展,传统人工砌筑因效率低、质量不稳定等问题而难以满足现代施工要求[1 ] .泥浆涂抹作为砌筑施工的关键工序,其质量直接关系着建筑结构的性能.采用泥浆涂抹机器人可提升砌筑施工的自动化水平[2 ] ,但现场泥浆飞溅常常导致砖块涂抹面被遮挡,严重干扰机器人对砖块涂抹面的识别与定位,制约其作业精度与效率.因此,急需具有抗遮挡性能的识别与定位方法,来提升涂抹机器人在复杂工况下的实用性和工作稳定性. ...

可实现自动砌墙的建筑机器人设计

1

2011

... 随着建筑智能化的发展,传统人工砌筑因效率低、质量不稳定等问题而难以满足现代施工要求[1 ] .泥浆涂抹作为砌筑施工的关键工序,其质量直接关系着建筑结构的性能.采用泥浆涂抹机器人可提升砌筑施工的自动化水平[2 ] ,但现场泥浆飞溅常常导致砖块涂抹面被遮挡,严重干扰机器人对砖块涂抹面的识别与定位,制约其作业精度与效率.因此,急需具有抗遮挡性能的识别与定位方法,来提升涂抹机器人在复杂工况下的实用性和工作稳定性. ...

可实现自动砌墙的建筑机器人设计

1

2011

... 随着建筑智能化的发展,传统人工砌筑因效率低、质量不稳定等问题而难以满足现代施工要求[1 ] .泥浆涂抹作为砌筑施工的关键工序,其质量直接关系着建筑结构的性能.采用泥浆涂抹机器人可提升砌筑施工的自动化水平[2 ] ,但现场泥浆飞溅常常导致砖块涂抹面被遮挡,严重干扰机器人对砖块涂抹面的识别与定位,制约其作业精度与效率.因此,急需具有抗遮挡性能的识别与定位方法,来提升涂抹机器人在复杂工况下的实用性和工作稳定性. ...

Accurate pose estimation of the texture-less objects with known CAD models via point cloud matching

1

2023

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

基于双目视觉的掘进装备定位系统移站自主标定方法

1

2025

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

基于双目视觉的掘进装备定位系统移站自主标定方法

1

2025

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

改进K-means聚类算法的自适应Canny算子工件边缘检测

1

2022

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

改进K-means聚类算法的自适应Canny算子工件边缘检测

1

2022

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

High precision 3D reconstruction and target location based on the fusion of visual features and point cloud registration

1

2025

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

3D point cloud density-based segmentation for vine rows detection and localisation

1

2022

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

Segmenting beyond the bounding box for instance segmentation

1

2022

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

Enhanced deep learning model for apple detection, localization, and counting in complex orchards for robotic arm-based harvesting

1

2025

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

A vision based approach to localize waste objects and geometric features exaction for robotic manipulation

1

2023

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

SEMPose: a single end-to-end network for multi-object pose estimation

1

2025

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

Graduated non-convex feature-metric-based 6D object pose refinement via deep reinforcement learning

1

2025

... 目前,目标定位主要采用点云处理技术、2D图像与深度图像融合技术、端到端三维位姿估计方法和基于强化学习的方法.点云处理技术通过模型匹配[3 ] 、几何特征提取[4 ] 或欧式聚类[5 ] 等实现空间定位.如:Chen等[6 ] 基于结构光点云与CAD模型配准,实现了大目标定位;Biglia等[7 ] 通过提取冠层中心点和聚类识别,实现了葡萄行的精准检测.2D图像与深度图像融合技术借助深度学习模型完成实例分割[8 ] 及关键点提取,再结合相机内参数估算三维位置.如:Jin等[9 ] 利用YOLOv8n增强模型并结合深度信息,实现了苹果3D定位;Aarthi等[10 ] 利用Mask R-CNN模型实现了废物分割与抓取点提取.端到端三维位姿估计方法通过神经网络直接估计目标的姿态,避免了传统几何建模与特征匹配的步骤.如:Liu等[11 ] 设计了一种纹理-形状引导的端到端网络,实现了单模型、多物体姿态的实时估计.基于强化学习的方法是机器人通过学习主动观察策略,能够自适应调整视角或传感器姿态,以获取更准确的观测信息,从而提升位姿估计精度.如:Ni等[12 ] 提出了一种结合特征度量优化与深度强化学习的框架,实现了高精度、高效率的物体姿态估计.单一的点云处理技术过于依赖点云质量,不适用于目标被遮挡的场景.传统的2D图像与深度图像融合技术在深度信息缺失或受遮挡干扰的情况下易受到深度空洞、深度覆盖等问题的影响,导致位姿估计结果不稳定.而端到端位姿估计方法和强化学习策略虽然在一般的目标定位任务中展现了潜力,但在砖块涂抹面定位任务中,由于受泥浆遮挡导致的深度缺失、轮廓模糊和局部几何结构缺失等的影响,其性能仍受到明显限制. ...

Modeling the measurement accuracy for binocular stereo vision system

1

2025

... 此外,深度图像的质量是影响定位精度的关键因素[13 ] .复杂光照和物体遮挡等均会引发深度空洞、轮廓模糊等问题[14 ] ,导致点云质量下降.已有研究尝试从图像补全和深度引导等方面进行优化.如:Liu等[15 ] 构建了彩色-深度联合模型,来提升修复精度;Wang等[16 ] 利用三边约束进行稀疏表示,以改善深度边缘填充效果.常见的深度修复方法主要包括彩色-深度联合补全、深度梯度与边缘约束优化、学习型深度补全以及基于几何先验的补全方法.彩色-深度联合补全和深度梯度与边缘约束优化方法在一般场景中表现良好,但缺乏对规则几何轮廓的显式建模;学习型与几何型方法则在遮挡导致的结构缺失的情况下仍可能产生深度模糊或突变,因此也难以直接应用于泥浆遮挡下的涂抹面定位研究. ...

A novel holes filling method based on layered depth map and patch sparsity for complex-scene images

1

2021

... 此外,深度图像的质量是影响定位精度的关键因素[13 ] .复杂光照和物体遮挡等均会引发深度空洞、轮廓模糊等问题[14 ] ,导致点云质量下降.已有研究尝试从图像补全和深度引导等方面进行优化.如:Liu等[15 ] 构建了彩色-深度联合模型,来提升修复精度;Wang等[16 ] 利用三边约束进行稀疏表示,以改善深度边缘填充效果.常见的深度修复方法主要包括彩色-深度联合补全、深度梯度与边缘约束优化、学习型深度补全以及基于几何先验的补全方法.彩色-深度联合补全和深度梯度与边缘约束优化方法在一般场景中表现良好,但缺乏对规则几何轮廓的显式建模;学习型与几何型方法则在遮挡导致的结构缺失的情况下仍可能产生深度模糊或突变,因此也难以直接应用于泥浆遮挡下的涂抹面定位研究. ...

Robust color guided depth map restoration

1

2017

... 此外,深度图像的质量是影响定位精度的关键因素[13 ] .复杂光照和物体遮挡等均会引发深度空洞、轮廓模糊等问题[14 ] ,导致点云质量下降.已有研究尝试从图像补全和深度引导等方面进行优化.如:Liu等[15 ] 构建了彩色-深度联合模型,来提升修复精度;Wang等[16 ] 利用三边约束进行稀疏表示,以改善深度边缘填充效果.常见的深度修复方法主要包括彩色-深度联合补全、深度梯度与边缘约束优化、学习型深度补全以及基于几何先验的补全方法.彩色-深度联合补全和深度梯度与边缘约束优化方法在一般场景中表现良好,但缺乏对规则几何轮廓的显式建模;学习型与几何型方法则在遮挡导致的结构缺失的情况下仍可能产生深度模糊或突变,因此也难以直接应用于泥浆遮挡下的涂抹面定位研究. ...

Trilateral constrained sparse representation for Kinect depth hole filling

1

2015

... 此外,深度图像的质量是影响定位精度的关键因素[13 ] .复杂光照和物体遮挡等均会引发深度空洞、轮廓模糊等问题[14 ] ,导致点云质量下降.已有研究尝试从图像补全和深度引导等方面进行优化.如:Liu等[15 ] 构建了彩色-深度联合模型,来提升修复精度;Wang等[16 ] 利用三边约束进行稀疏表示,以改善深度边缘填充效果.常见的深度修复方法主要包括彩色-深度联合补全、深度梯度与边缘约束优化、学习型深度补全以及基于几何先验的补全方法.彩色-深度联合补全和深度梯度与边缘约束优化方法在一般场景中表现良好,但缺乏对规则几何轮廓的显式建模;学习型与几何型方法则在遮挡导致的结构缺失的情况下仍可能产生深度模糊或突变,因此也难以直接应用于泥浆遮挡下的涂抹面定位研究. ...

基于DBSCAN的改进RANSAC点云平面拟合算法

1

2025

... 为提取点云中涂抹面的平面参数,本研究引入一种点云密度加权的随机采样一致性(random sample consensus,RANSAC)平面拟合方法[17 ] .该方法将点云局部密度作为权重,在传统RANSAC框架下结合加权最小二乘优化,有效应对因相机倾斜拍摄造成的点云分布不均与噪声干扰问题. ...

基于DBSCAN的改进RANSAC点云平面拟合算法

1

2025

... 为提取点云中涂抹面的平面参数,本研究引入一种点云密度加权的随机采样一致性(random sample consensus,RANSAC)平面拟合方法[17 ] .该方法将点云局部密度作为权重,在传统RANSAC框架下结合加权最小二乘优化,有效应对因相机倾斜拍摄造成的点云分布不均与噪声干扰问题. ...

基于局部梯度统计的自适应各向异性扩散

1

2023

... 为全面验证本文方法在遮挡工况下的有效性,本研究将各向异性扩散(anisotropic diffusion, AD)[18 ] 、联合双边滤波(joint bilateral filter,JBF)[19 ] 、马尔可夫随机场(Markov random field,MRF)[20 ] 、分层双边滤波(hierarchical bilateral filter,HBF)[21 ] 以及噪声感知滤波函数(noise perception filter,NPF)[22 ] 等5种经典深度修复方法作为对照组,进行三轴定位误差和运行时间对比实验. ...

基于局部梯度统计的自适应各向异性扩散

1

2023

... 为全面验证本文方法在遮挡工况下的有效性,本研究将各向异性扩散(anisotropic diffusion, AD)[18 ] 、联合双边滤波(joint bilateral filter,JBF)[19 ] 、马尔可夫随机场(Markov random field,MRF)[20 ] 、分层双边滤波(hierarchical bilateral filter,HBF)[21 ] 以及噪声感知滤波函数(noise perception filter,NPF)[22 ] 等5种经典深度修复方法作为对照组,进行三轴定位误差和运行时间对比实验. ...

An efficient approach for texture smoothing by adaptive joint bilateral filtering

1

2023

... 为全面验证本文方法在遮挡工况下的有效性,本研究将各向异性扩散(anisotropic diffusion, AD)[18 ] 、联合双边滤波(joint bilateral filter,JBF)[19 ] 、马尔可夫随机场(Markov random field,MRF)[20 ] 、分层双边滤波(hierarchical bilateral filter,HBF)[21 ] 以及噪声感知滤波函数(noise perception filter,NPF)[22 ] 等5种经典深度修复方法作为对照组,进行三轴定位误差和运行时间对比实验. ...

Deep Markov random field for image modeling

1

2016

... 为全面验证本文方法在遮挡工况下的有效性,本研究将各向异性扩散(anisotropic diffusion, AD)[18 ] 、联合双边滤波(joint bilateral filter,JBF)[19 ] 、马尔可夫随机场(Markov random field,MRF)[20 ] 、分层双边滤波(hierarchical bilateral filter,HBF)[21 ] 以及噪声感知滤波函数(noise perception filter,NPF)[22 ] 等5种经典深度修复方法作为对照组,进行三轴定位误差和运行时间对比实验. ...

分层联合双边滤波的深度图修复算法研究

1

2021

... 为全面验证本文方法在遮挡工况下的有效性,本研究将各向异性扩散(anisotropic diffusion, AD)[18 ] 、联合双边滤波(joint bilateral filter,JBF)[19 ] 、马尔可夫随机场(Markov random field,MRF)[20 ] 、分层双边滤波(hierarchical bilateral filter,HBF)[21 ] 以及噪声感知滤波函数(noise perception filter,NPF)[22 ] 等5种经典深度修复方法作为对照组,进行三轴定位误差和运行时间对比实验. ...

分层联合双边滤波的深度图修复算法研究

1

2021

... 为全面验证本文方法在遮挡工况下的有效性,本研究将各向异性扩散(anisotropic diffusion, AD)[18 ] 、联合双边滤波(joint bilateral filter,JBF)[19 ] 、马尔可夫随机场(Markov random field,MRF)[20 ] 、分层双边滤波(hierarchical bilateral filter,HBF)[21 ] 以及噪声感知滤波函数(noise perception filter,NPF)[22 ] 等5种经典深度修复方法作为对照组,进行三轴定位误差和运行时间对比实验. ...

Salt and pepper noise removal method based on a detail-aware filter

1

2021

... 为全面验证本文方法在遮挡工况下的有效性,本研究将各向异性扩散(anisotropic diffusion, AD)[18 ] 、联合双边滤波(joint bilateral filter,JBF)[19 ] 、马尔可夫随机场(Markov random field,MRF)[20 ] 、分层双边滤波(hierarchical bilateral filter,HBF)[21 ] 以及噪声感知滤波函数(noise perception filter,NPF)[22 ] 等5种经典深度修复方法作为对照组,进行三轴定位误差和运行时间对比实验. ...