近年来,随着图卷积神经网络(graph convolutional network,GCN)[3]、图注意网络(graph attention network,GAT)[4]以及扩散卷积递归神经网络(diffusion convolutional recurrent neural network,DCRNN)[5]等图神经网络在处理图数据方面的显著进步,时空图神经网络逐渐应用于交通流量预测领域. 例如,Li等[5]将交通流建模为有向图上的扩散过程,采用双向图随机游走来建模空间依赖性,并利用递归神经网络(recurrent neural network,RNN)来捕捉时间依赖性. Zhao等[6]将GCN和门控循环单元(gated recurrent unit,GRU)组合起来,成功同时捕获了时空依赖关系. Yu等[7]设计了融合空间图卷积和时间序列的时空卷积模块,有效模拟了交通网络的连通性与全局性. Zuo等[8]提出的GCN-M模型结合图卷积网络和基于注意力的记忆网络,解决了交通数据中复杂的缺失值问题,并增强了对局部和全局模式的处理能力. Shin等[9]提出的渐进图卷积网络框架(PGCN),通过构建渐进邻接矩阵来捕捉空间相关性,处理复杂的时空相关性问题.

一些研究人员将注意力机制扩展到交通预测,用于动态地对不同时间步长的重要性进行建模. 例如,Yu等[10]提出注意时间图卷积网络(A3T-GCN),该模型在T-GCN的基础上,设计了一种注意力机制来分配不同时间步长的权重. Xu等[11]通过叠加空间Transformer和时间Transformer的方式,有效实现了时空信息的有效融合;Jiang等[12]引入空间自注意力模块,该模块结合了多种图掩蔽技术以捕捉局部地理信息和全局语义邻域,并专门设计了交通延迟感知特征转换模块,用于建模空间信息传播中的时间延迟. Wu等[13]提出分解式的架构,专门用于处理长期的时间依赖性问题,并引入自相关机制,旨在提高计算效率和数据利用效率. Bai等[14]引入新的编码器模块,旨在有效缓解处理长序列数据时常见的梯度爆炸问题. Ren等[15]将Transformer与GRU相结合,以捕捉历史交通数据中的长期时间模式.

尽管上述方法在探索交通道路网络的时空特征上取得了一定的成效,但仍然存在一些挑战:1)先前的研究大多倾向于使用独立的模块分别捕捉空间相关性和时间相关性,随后将两者结果加以融合. 这种处理策略未能将空间和时间作为统一的整体来考虑,因而难以有效捕获交通流中复杂的时空交互关系. 2)以往工作在空间相关性建模上普遍采用基于距离度量或者地理连接关系的预定义图来刻画路网节点间的空间依赖关系. 这种静态且固定不变的图结构无法充分反映实际交通流的动态关联性. 3)大多现有方法或模型往往只关注短期内的交通变化,而没有充分考虑中长期交通数据中存在的趋势和周期性模式.

为了应对上述挑战,本研究提出多时间尺度自适应图注意Transformer模型(multi-time scale adaptive graph atttention Transformer, MSAGAFormer). 创新点如下:1)为了更准确地处理复杂时空相关性,提出基于Transformer的交通流量预测模型. 该模型能够有效地捕获时间相关性和空间相关性. 2)为了克服预定义图的局限性,引入自适应图和节点相似度图,分别用于捕捉动态空间相关性和静态空间相关性. 此外,设计基于GAT的空间特征提取方法,以有效提取动静态的空间特征. 3)为了捕捉周期性特征,设计时空特征构建模块. 该模块由多时间尺度构建模块和时空特征聚合模块2部分组成. 多时间尺度构建模块整合了不同时间尺度的特征提取策略,以有效捕获多尺度时间特征. 时空特征聚合模块则是一种扩展至长时间序列的时间特征提取方法,能够在处理大量时间数据的同时,有效平衡数据冗余带来的精度下降风险.

1. 问题描述

交通流量预测任务是经典的时间序列预测任务. 在本研究中,使用基于最近、每日和每周周期长度为T的历史时间片作为输入序列. 具体而言,将3类输入序列融合为一个由

式中:

相关概念的定义如下.

定义1 交通网络. 使用无向图

定义2 交通流量矩阵. 交通网络

定义3 预定义邻接矩阵. 使用曼哈顿距离函数定义节点间的距离,并通过动态时间扭曲(DTW)计算每对节点的相关性,构建反映节点间静态空间相关性的预定义矩阵. 为了确保矩阵值的可比性,对矩阵进行归一化处理,并设定阈值为0.6. 当2个节点的相关性超过该阈值时,对应的矩阵元素值设为1;否则,设为0.

定义4 自适应邻接矩阵.通过节点嵌入向量的点积和Softmax归一化推断每对节点之间的空间依赖关系,并在训练过程中通过反向传播自动更新能够反映节点间动态空间相关性的自适应邻接矩阵. 与此同时,利用Gumbel-Sigmoid生成的二进制掩码确保自适应邻接矩阵的稀疏性.

2. MSAGAFormer架构

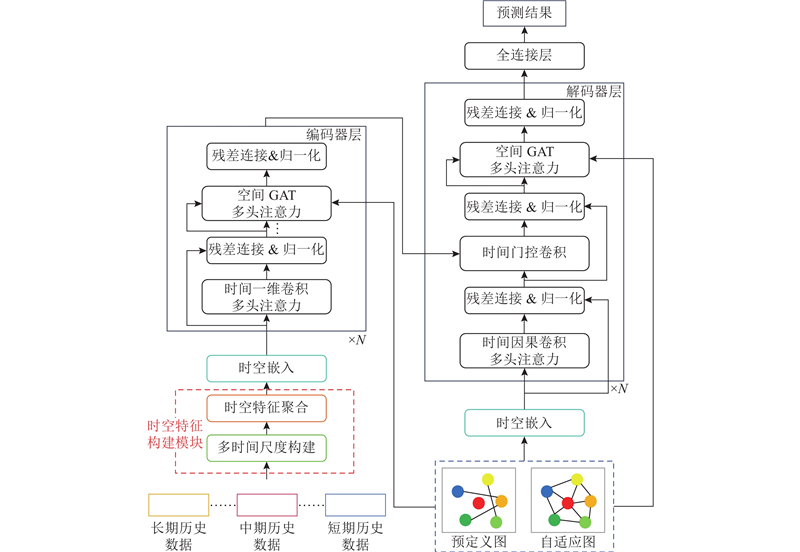

如图1所示,本研究提出的MSAGAFormer架构包含时空特征构建层、时空特征嵌入层及堆叠的编码器-解码器层. 时空特征构建层通过多时间尺度构建模块和时空特征聚合模块,分别整合不同时间尺度特征并处理长时间序列数据以平衡精度下降风险;时空特征嵌入层采用时空嵌入方法编码时空位置,提供丰富上下文信息;编码器和解码器层利用空间GAT多头注意力模块捕捉动静态空间特征,利用时间一维卷积多头注意力模块捕捉局部时间模式,利用时间因果卷积模块捕获长期时间相关性,从而全面理解时空数据中的复杂模式.

图 1

2.1. 时空特征构建模块

2.1.1. 多时间尺度构建模块

该方法将历史数据划分为短期、中期和长期,并融合这些多尺度数据以生成增强的时间序列作为后续模块的输入. 低尺度序列揭示局部变化趋势,对短期预测至关重要;中尺度序列捕捉趋势性变化,提取中期趋势特征;高尺度序列则反映周期性变化,有助于理解长期依赖. 通过串联3种尺度的序列[20],增强了对历史数据序列的表达能力. 此外,设置低尺度序列长度与相应的历史序列长度一致,中尺度序列长度和高尺度序列长度分别为低尺度序列长度的

2.1.2. 时空特征聚合模块

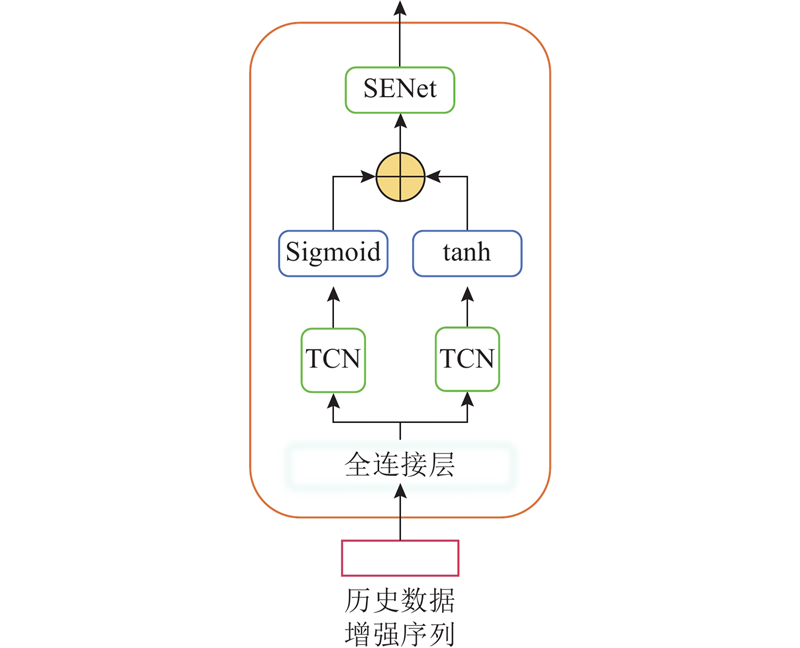

时空特征聚合模块旨在将由多时间尺度构建模块得到的历史数据增强序列压缩成较短的表现形式,从而使得模型能够在不增加计算复杂度的情况下考虑长期的时间模式. 其结构如图2所示. 具体来说,TCN通过多层膨胀卷积逐步将长时间序列的历史数据浓缩为较短的时间步表示,从而捕捉长期依赖关系而不增加计算复杂度. TCN首先处理最近的数据,随着层数加深,卷积间隔逐渐增大,覆盖更久远的历史信息,最终生成富含长期趋势信息的时间特征表示. 其表达式如下:

图 2

式中:

SENet评估每个节点的重要性,并据此调整特征权重,强化关键位置的信息. SENet从压缩后的时间特征中提取全局信息,通过2层全连接层的非线性变换计算各节点的重要性,然后根据重要性调整原始特征,形成优化后的空间特征表示

式中:

2.2. 时空编码

与RNN不同,Transformer缺乏显式的序列顺序,因此须引入位置编码来捕获输入序列的位置信息.

MSAGAFormer从短期、中期和长期历史数据中捕捉多尺度交通模式,使模型能全面理解交通模式的变化. 这种方法不再局限于单一时间尺度的数据,还增强了对不同周期交通模式的理解. 其次,通过正弦和余弦函数生成的位置编码,模型能够有效处理序列中不同时间点的相对距离和顺序关系. 具体表达式如下:

式中:d为特征维度的索引,范围为0~

利用图拉普拉斯矩阵的特征向量来编码节点的位置信息,不仅考虑直接连接关系,还捕捉更广泛的拓扑结构信息. 具体计算公式如下:

式中:

通过将时间特征、时间位置编码和空间位置编码进行线性组合,并引入可学习的投影矩阵,以确保模型不仅能有效捕捉时间序列中的动态演化规律,还能同时建模空间节点之间的静态与动态关联. 该设计显著增强了模型对复杂时空依赖关系的表达能力. 融合上述3类信息后所得到的统一时空表示

式中:

2.3. 编码器与解码器

通过编码器和解码器捕捉交通数据中复杂的时空相关性. 其中,编码器层由1个时间一维卷积多头注意力模块和1个空间GAT多头注意力模块组成. 解码器层包括1个因果卷积时间多头注意力模块、1个空间GAT多头注意力模块和1个时间门控卷积模块.

2.3.1. 时间特征提取

在编码器中,采用一维时间卷积捕捉交通数据中的局部趋势和复杂的时间依赖性. 这种方法通过参数共享提高了计算效率,减少了过拟合风险,并能同时提取时间特征和节点间的空间关系. 具体来说,输入的时空特征被分解为每个节点的时间序列,然后应用一维卷积生成增强特征表示,这些表示保留了原始序列的局部结构并提升了对时间变化的理解. 经过卷积处理的特征参与多头自注意力机制,帮助模型建模不同时间步之间的依赖关系.

解码器采用因果卷积确保预测仅依赖于当前及过去的时间步,避免泄露未来信息. 通过在前端填充零值,保持严格的因果顺序,从而更好地理解长期依赖而不引入未来偏差. 解码器接收来自编码器的输出序列,并通过因果卷积处理每一时间步. 随后,模型计算编码器输出与因果卷积多头注意力模块输出之间的关联,增强了对时间特征的理解. 最终,时间门控卷积模块有效融合局部和全局的时间依赖关系.

2.3.2. 时间门控卷积模块

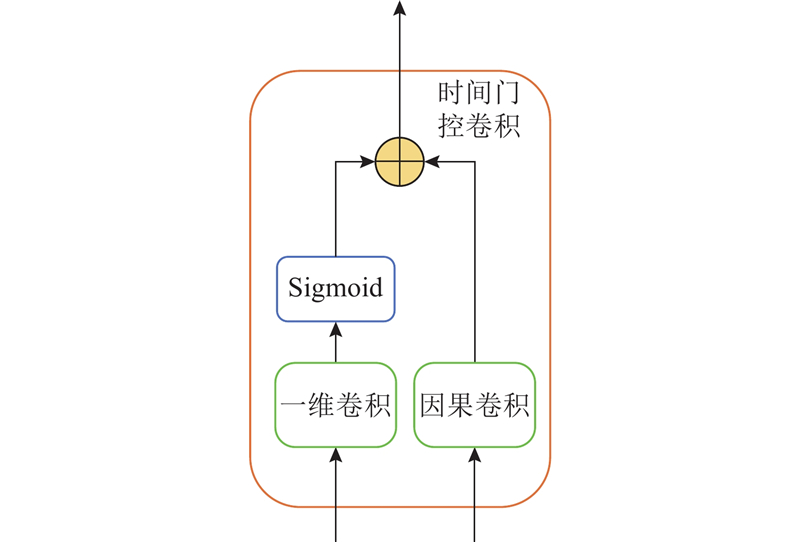

如图3所示,时间门控卷积模块旨在增强模型处理长时间序列数据的能力,通过结合一维卷积和因果卷积,确保在长序列处理中的稳定性和防止梯度爆炸或消失问题. 一维卷积捕捉局部时间模式,而因果卷积捕捉长期时间依赖性,确保预测仅基于过去信息. 这种组合使模型能够全面理解复杂的时间序列模式.

图 3

具体而言,首先,输入的时间特征表示分别为编码器的输出

2.3.3. 空间GAT多头注意力模块

选用GAT作为空间依赖的捕捉策略,因其通过引入注意力机制,能够基于邻居节点特征动态分配差异化权重. GAT利用多头注意力机制在多个特征子空间中独立处理注意力分布,这不仅减轻了模型过拟合倾向,还增强了学习稳定性. 编码器结合空间GAT多头注意力模块和自适应图邻接矩阵,评估节点间的动态空间相关性,不仅限于直接连接的节点,从而能捕捉远距离节点之间的潜在联系.

解码器的任务是基于编码器输出和部分已知未来信息逐步生成精确预测. 为了确保准确性,解码器关注当前和邻近节点的状态变化. 通过空间GAT多头注意力模块和预定义图邻接矩阵提取静态空间特征,并集中处理目标节点附近的动态变化. 这种设计有助于理解局部动态特性,减少计算复杂度,并有效捕捉局部模式.

3. 实验结果

3.1. 实验数据集与实验环境

为了验证本研究提出的方法,在美国加州数据集PEMS04和PEMS08上进行实验. PEMS数据集包含3种特征,即流量、速度和占有率. 这些数据集的相关信息如表1所示. 其中,ns为传感器数量,to为采样间隔. PEMS04是2018年1—2月旧金山湾区307个检测点收集到的交通数据;PEMS08是2018年7—8月圣贝纳迪诺170个检测点收集到的交通数据. 这些数据被整理成每5 min一条记录. 此外,采用标准归一化对数据进行处理,并按照6∶2∶2的比例随机划分训练集、验证集和测试集. 为了评估模型的泛化性能,生成多组不同的验证集,并在每组验证集上计算评价指标的平均值.

表 1 数据集描述

Tab.1

| 数据集 | ns | to/min | 时间戳 | 时间范围 |

| PEMS04 | 307 | 5 | 2018/01/01—2018/02/28 | |

| PEMS08 | 170 | 5 | 2018/07/01—2018/08/31 |

硬件平台如下:11th Gen Intel(R) Core(TM) i7-1195G7 @ 2.90GHz 2.92 GHz 处理器,NVIDIA GeForce MX450 GPU. 软件配置如下:Windows 10操作系统,Anaconda3资源管理,Pycharm IDE,Pytorch 2.4.0深度学习框架,Python语言开发.

3.2. 评价指标

采用2个评估指标以评估模型性能:均方根误差(RMSE)和平均绝对误差(MAE). 具体计算公式如下:

式中:

3.3. 实验结果对比与分析

3.3.1. 对比实验

为了验证所提模型的预测性能,选取以下7种基于深度学习的交通流量预测模型作为基线模型,并在PEMS04和PEMS08这2个数据集上进行对比实验.

1)STGCN[7]:通过结合空间域的图卷积网络和时域的一维卷积网络,构建完整的卷积模块结构,用于提取时空特征.

2)T-GCN[6]:利用GCN与GRU单元相结合,分别提取交通数据中的空间相关性与时间相关性.

3)DCRNN[5]:采用扩散卷积网络来学习交通流数据的空间信息,并使用序列到序列模型来捕获时间序列.

4)DMSTGCN[21]:高级的时空图卷积网络模型,专注于动态和多维度的时空数据处理.

5)Trendformer[22]:沿用Transformer的编码器-解码器结构,其中编码器结构对输入交通流进行编码以计算出平均趋势,而解码器则基于此趋势输出预测结果.

6) STTN[11]:构建空间Transformer与时间Transformer的神经网络架构,通过自注意力机制动态捕捉交通网络中节点间的空间依赖以及长期依赖关系.

7)ATST-GCN[23]:采用基于注意力的双向GRU提取时间依赖,并通过多层GAT卷积模块捕获空间依赖,同时整合天气和道路属性作为辅助信息.

如表2、3所示分别展示了在PEMS04和PEMS08数据集上,不同模型使用RMSE和MAE作为评价指标的对比结果. 其中,Tp为实际预测时长. 实验结果表明,尽管STGCN、T-GCN、DCRNN和DMSTGCN等时空图卷积模型同时考虑了时间相关性和空间相关性,但它们在处理长期时间依赖方面存在局限,且忽视了动态的时空相关性. 相比之下,MSAGAFormer通过集成GAT和Transformer网络,将时空特征整体建模,显著提升了对时空特征及长期依赖关系的捕捉能力,从而提高了预测精度. 虽然Trendformer、ATST-GCN和STTN设计了时空特征提取模块以综合捕获交通流的时空相关性,但这些方法未能充分利用中长期历史数据中的趋势性和周期性特征或多时间尺度特征. MSAGAFormer不仅关注中长期历史数据,还通过多时间尺度构建模块捕获多时间尺度特征,进一步提升了预测准确性. 此外,在短期(15 min)交通流量预测中,MSAGAFormer与STTN表现相当,但在中长期预测中MSAGAFormer表现出更优性能. 在2个数据集上,MSAGAFormer始终保持最低的RMSE和MAE,尤其在PEMS08数据集上的45 min和60 min预测中性能提升更为显著,显示出其在不同数据集上的稳定性和良好的适应性.

表 2 PEMS04数据集上不同模型的RMSE和MAE对比结果

Tab.2

| 模型 | Tp=15 min | Tp=30 min | Tp=45 min | Tp=60 min | |||||||

| RMSE | MAE | RMSE | MAE | RMSE | MAE | RMSE | MAE | ||||

| STGCN | 30.49 | 19.98 | 33.23 | 21.46 | 36.87 | 24.48 | 39.41 | 26.93 | |||

| T-GCN | 29.39 | 20.32 | 32.79 | 21.94 | 36.27 | 24.06 | 39.88 | 27.27 | |||

| DCRNN | 28.65 | 19.06 | 32.72 | 22.09 | 35.74 | 23.89 | 41.19 | 28.51 | |||

| DMSTGCN | 28.02 | 18.81 | 31.46 | 21.02 | 34.38 | 22.64 | 38.67 | 26.15 | |||

| Trendformer | 27.47 | 18.62 | 30.59 | 20.56 | 33.53 | 22.32 | 34.17 | 23.54 | |||

| STTN | 26.95 | 17.98 | 29.76 | 19.48 | 31.28 | 21.76 | 33.35 | 22.43 | |||

| ATST-GCN | 27.32 | 18.45 | 30.19 | 20.07 | 30.24 | 21.03 | 32.49 | 22.17 | |||

| MSAGAFormer | 25.78 | 16.33 | 27.51 | 17.42 | 27.13 | 17.94 | 28.89 | 18.76 | |||

表 3 PEMS08数据集上不同模型的RMSE和MAE对比结果

Tab.3

| 模型 | Tp=15 min | Tp=30 min | Tp=45 min | Tp=60 min | |||||||

| RMSE | MAE | RMSE | MAE | RMSE | MAE | RMSE | MAE | ||||

| STGCN | 26.98 | 19.77 | 29.47 | 21.52 | 32.87 | 24.14 | 34.59 | 25.97 | |||

| T-GCN | 25.34 | 20.22 | 28.74 | 22.41 | 33.05 | 25.32 | 35.15 | 27.64 | |||

| DCRNN | 24.46 | 17.93 | 27.59 | 20.37 | 31.49 | 23.78 | 32.92 | 25.13 | |||

| DMSTGCN | 24.01 | 17.58 | 26.89 | 19.84 | 29.34 | 22.08 | 31.73 | 24.68 | |||

| Trendformer | 23.71 | 17.33 | 26.15 | 19.54 | 28.84 | 21.85 | 30.58 | 24.06 | |||

| STTN | 22.78 | 16.95 | 25.48 | 19.16 | 27.38 | 20.92 | 29.04 | 22.87 | |||

| ATST-GCN | 23.58 | 17.26 | 25.58 | 19.28 | 27.16 | 20.79 | 28.78 | 22.67 | |||

| MSAGAFormer | 21.87 | 16.05 | 23.87 | 17.26 | 25.13 | 17.76 | 26.63 | 19.14 | |||

3.3.2. 消融实验

表 4 PEMS04数据集上不同变体的RMSE和MAE对比结果

Tab.4

| 模型 | Tp=15 min | Tp=30 min | Tp=45 min | Tp=60 min | |||||||

| RMSE | MAE | RMSE | MAE | RMSE | MAE | RMSE | MAE | ||||

| w/o MH | 26.76 | 18.12 | 30.14 | 20.34 | 36.25 | 23.05 | 36.17 | 26.77 | |||

| w/o LH | 28.67 | 19.78 | 31.66 | 21.31 | 29.43 | 19.32 | 30.43 | 19.71 | |||

| w/o LM | 33.32 | 27.03 | 28.32 | 18.76 | 29.12 | 19.45 | 35.41 | 25.88 | |||

| w/o adp | 27.01 | 17.68 | 28.63 | 18.59 | 29.89 | 19.69 | 30.83 | 20.89 | |||

| w/o dis | 27.38 | 18.12 | 28.96 | 18.96 | 30.12 | 20.43 | 31.25 | 21.54 | |||

| MSAGAFormer | 25.78 | 16.33 | 27.51 | 17.42 | 27.13 | 17.94 | 28.89 | 18.76 | |||

表 5 PEMS08数据集上不同变体的RMSE和MAE对比结果

Tab.5

| 模型 | Tp=15 min | Tp=30 min | Tp=45 min | Tp=60 min | |||||||

| RMSE | MAE | RMSE | MAE | RMSE | MAE | RMSE | MAE | ||||

| w/o MH | 22.96 | 16.78 | 25.61 | 19.32 | 29.25 | 20.45 | 34.73 | 26.33 | |||

| w/o LH | 24.08 | 17.58 | 24.26 | 18.06 | 27.13 | 19.08 | 31.93 | 22.14 | |||

| w/o LM | 29.72 | 20.47 | 26.34 | 19.86 | 28.71 | 19.43 | 27.65 | 20.42 | |||

| w/o adp | 23.73 | 16.97 | 24.58 | 18.75 | 27.16 | 19.14 | 30.69 | 20.04 | |||

| w/o dis | 27.38 | 18.12 | 28.96 | 18.96 | 30.12 | 20.43 | 31.25 | 21.54 | |||

| MSAGAFormer | 21.87 | 16.05 | 23.87 | 17.26 | 25.13 | 17.76 | 26.63 | 19.14 | |||

本研究去除时空构建模块中的多时间尺度特征,分别使用单一低时间尺度(w/o MH)、单一中时间尺度(w/o LH)和单一高时间尺度(w/o LM)进行交通流量预测,以探讨不同时间尺度对预测精度的影响. 实验结果表明,低时间尺度特征有助于捕捉瞬时变化,适用于短期预测;中时间尺度特征能够反映较长时间段内的趋势变化,适合中期预测;高时间尺度特征则擅长捕捉周期性和长期趋势,适用于长期预测. 这些结果验证了多时间尺度在提取不同类型时间特征上的重要性. 此外,本研究还评估了自适应图和预定义图的作用. 通过去除自适应图(w/o adp),仅使用传统的预定义图建模交通网络的空间相关性,以及去除预定义图(w/o dis),仅使用自适应图建模空间相关性. 实验结果表明,两者各自捕捉了不同的空间相关性. 自适应图能够动态反映节点之间的实时关联,捕捉动态的空间特征,这对于捕捉交通网络中的瞬时变化至关重要. 而预定义图提供了相对稳定的静态拓扑信息,有助于理解交通网络的基本结构关系. 通过观察这2组变体的实验结果,可以明显看出自适应图和预定义图对预测性能的重要影响.

综上所述,MSAGAFormer通过结合多时间尺度特征、自适应图以及预定义图,在所有预测时间段内保持了最佳性能,证明了这些组件在提升预测精度方面的互补作用,展示了其在处理复杂时空依赖关系上的优势.

3.3.3. 测试集可视化

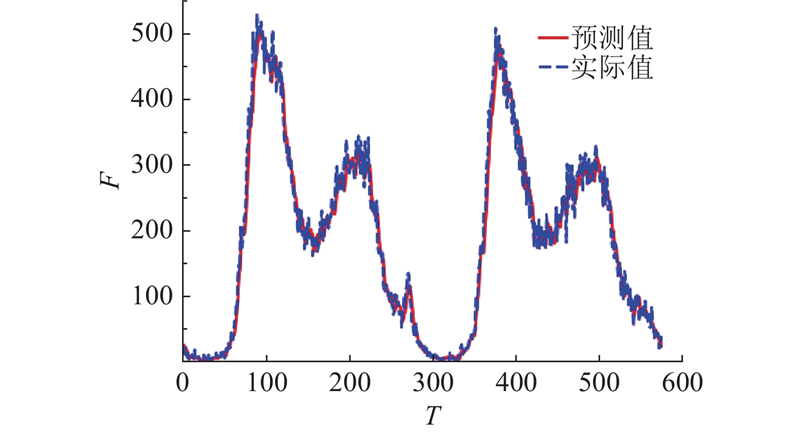

为了更直观地展示本研究所提模型在测试集上的预测表现,选择PEMS04数据集上第115号传感器作为可视化对象,展示MSAGAFormer在测试集上的预测结果与真实值的对比情况. 具体的可视化结果如图4所示. 其中,F为交通流量,T为时间段.

图 4

4. 结 语

提出新的多时间尺度自适应图注意Transformer(MSAGAFormer),并设计了时空特征构建模块. 在PEMS数据集上的实验验证表明,所提模型在预测交通流量上表现出显著的有效性,并且相较于现有的一些先进方法,在预测精度上实现了一定提升.

所提模型仍有较大的优化空间,包括:1) 尚未考虑交通事故信息、天气信息及节假日等外部因素,限制了复杂现实场景中的预测准确性;2) 模型性能高度依赖于历史数据的质量和完整性,数据缺失或异常值可能影响预测可靠性;3) 复杂的时空特征提取和多头注意力机制导致较高的计算资源需求,限制其在资源受限环境中的应用. 计划通过持续的研究与创新来克服上述挑战,从而使所提出的模型能够在实际应用场景中发挥更卓越的性能和更高的可靠性.

参考文献

A review on developments in evolutionary computation approaches for road traffic flow prediction

[J].DOI:10.1007/s11831-024-10189-1 [本文引用: 1]

A survey on traffic flow prediction and classification

[J].DOI:10.1016/j.iswa.2023.200268 [本文引用: 1]

Graph convolutional networks: a comprehensive review

[J].DOI:10.1186/s40649-019-0069-y [本文引用: 1]

Attention-based graph neural networks: a survey

[J].

T-GCN: a temporal graph convolutional network for traffic prediction

[J].DOI:10.1109/TITS.2019.2935152 [本文引用: 2]

Graph convolutional networks for traffic forecasting with missing values

[J].DOI:10.1007/s10618-022-00903-7 [本文引用: 1]

PGCN: progressive graph convolutional networks for spatial–temporal traffic forecasting

[J].DOI:10.1109/TITS.2024.3349565 [本文引用: 1]

GSTC-Unet: a U-shaped multi-scaled spatiotemporal graph convolutional network with channel self-attention mechanism for traffic flow forecasting

[J].DOI:10.1016/j.eswa.2023.120724 [本文引用: 1]

PDFormer: propagation delay-aware dynamic long-range transformer for traffic flow prediction

[J].DOI:10.1609/aaai.v37i4.25556 [本文引用: 1]

Autoformer: decomposition transformers with auto-correlation for long-term series forecasting

[J].

A3T-GCN: attention temporal graph convolutional network for traffic forecasting

[J].DOI:10.3390/ijgi10070485 [本文引用: 1]

Transformer-enhanced periodic temporal convolution network for long short-term traffic flow forecasting

[J].DOI:10.1016/j.eswa.2023.120203 [本文引用: 1]

Dynamic multi-scale spatial-temporal graph convolutional network for traffic flow prediction

[J].DOI:10.1016/j.knosys.2024.112586 [本文引用: 1]

MSGNet: learning multi-scale inter-series correlations for multivariate time series forecasting

[J].

LSTTN: a long-short term transformer-based spatiotemporal neural network for traffic flow forecasting

[J].DOI:10.1016/j.knosys.2024.111637

ST-MGAT: spatio-temporal multi-head graph attention network for Traffic prediction

[J].DOI:10.1016/j.physa.2022.127762 [本文引用: 1]

基于多时间尺度时空图网络的交通流量预测模型

[J].

Multi-time scale spatial-temporal graph neural network for traffic flow prediction

[J].

动态交通流量预测的时空注意力图卷积网络

[J].

Attention-based spatio-temporal graph convolutional network for dynamic traffic flow prediction

[J].