生物打印机在生物医疗中的重要性不断提高,其打印质量直接影响着打印结构的稳定性、细胞生长活性、功能实现以及后续应用. 因此,如何科学、精准地评估打印质量成为亟待解决的问题. 目前,研究主要集中在通过优化细胞悬液的组成和打印参数,并结合对其聚集性和稳定性的表征来评估生物打印质量. Ng等[5]提出,精确的图像分析技术可以应用于打印参数的优化和实时校正,从而实现高效的打印;Malekpour等[6]则从机器视觉的角度分析深度学习在优化生物打印系统中的潜力. 这些方法大多致力于打印工艺参数的优化、细胞球三维培养体系的生物学特性解析,以及基于深度学习的打印质量智能评估模型构建与验证,少有研究关注生物打印机打印质量的实时、自动化评估.

在生物打印机打印质量的评估中,传统方法大多依赖人工图像分析和三点画圆法来估算打印结果面积,以此间接评估打印效果. 这种方法操作简便,但耗时较多且劳动强度大,难以精确捕捉不规则的复杂轮廓,当细胞形态不规则时,方法误差较大. 同时,人工操作容易受到操作者经验的影响,从而降低评估结果的准确性和一致性.

近年来图像处理技术和深度学习算法的快速发展为生物打印机质量评估提供了新的思路和方法. 基于卷积神经网络(CNN)和目标检测算法的深度学习模型在医学影像处理、物体检测与分割等领域已取得显著成果[7]. 特别是YOLO系列模型,由于其在实时性和精度方面的优势,逐渐成为图像处理领域的热门选择[8-10]. YOLOv8-Seg作为YOLO系列的新一代模型,通过集成实例分割模块实现了检测-分割协同优化. 该架构创新性地在目标检测框架中融合像素级解析能力,既保持了实时高效的检测特性,又具备精确的形态学分析能力[11-12]. 因此,基于YOLOv8-Seg模型对打印产物进行轮廓检测[13],并通过后续算法计算轮廓面积、圆度这2个评估指标,能够显著提高打印质量评估的自动化程度和准确性.

本研究提出高效、客观、精准的生物打印机产物均一性评估方法. 该方法为基于YOLOv8-Seg的改进模型,能够自动识别打印结果的轮廓并计算其面积、圆度,实现生物打印机打印质量的快速、精准评估. 通过与传统方式进行对比,验证所提方法的准确性与优越性.

1. 实 验

1.1. 数据采集

图 1

图 1 补偿模式与双向补偿模式下打印的结果图

Fig.1 Printing results under unidirectional compensation mode and bidirectional compensation mode

通过BP4000型生物打印机打印3×3矩阵的细胞团矩阵,并截取上面6个细胞团为一张图片. 为了方便后续处理,在照片的右下角插入500 μm的标度尺,如图1所示.

1.2. 三点画圆法处理

图 2

图 2 三点画圆求最小拟合圆的示意图

Fig.2 Schematic of minimum fitting circle obtained by three-point circle method

1.3. 算法处理

1.3.1. YOLOv8-Seg 模型

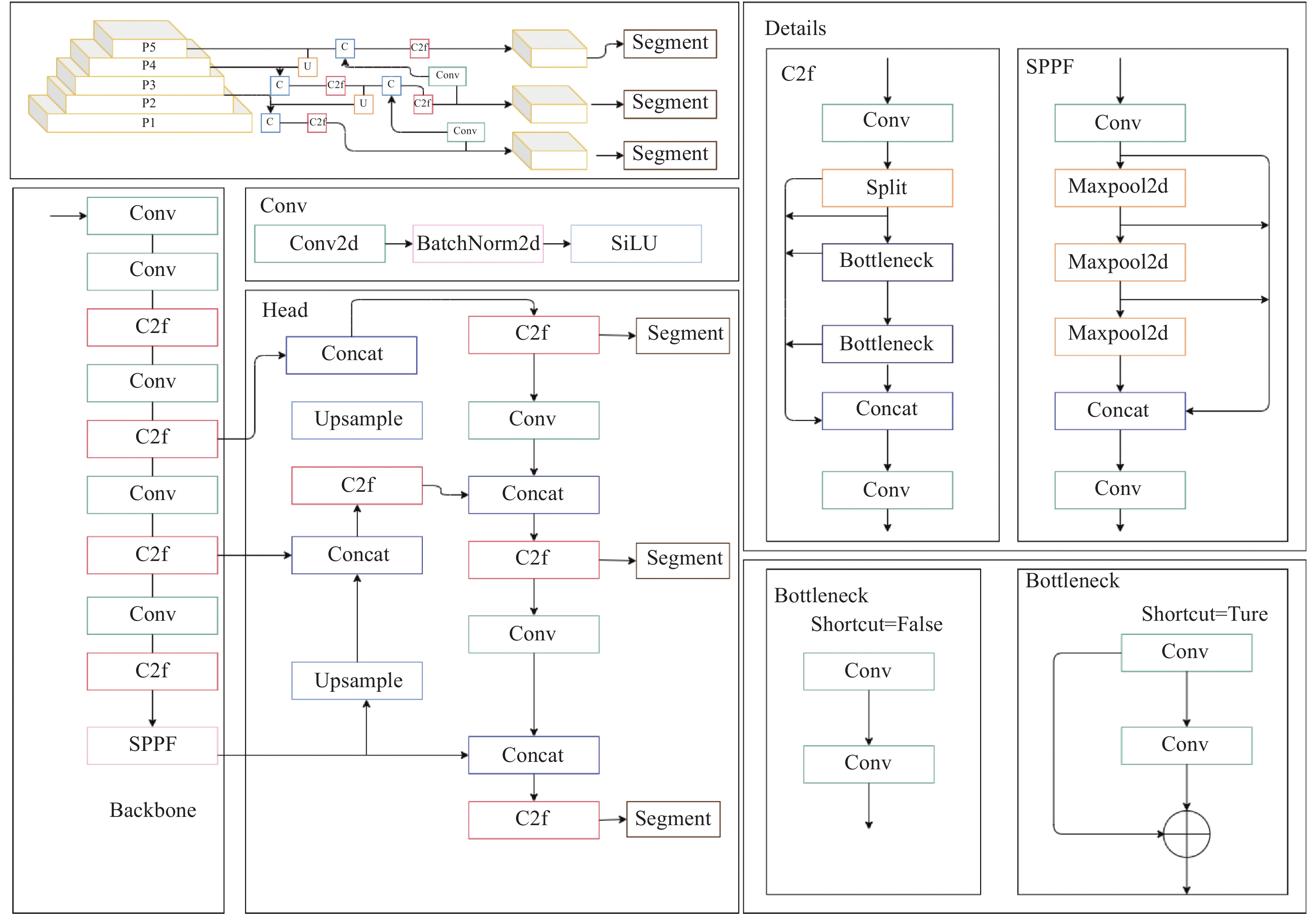

Ultralytics发布的YOLOv8模型在图像处理与检测领域展现了卓越的速度和精度. 相较于之前的YOLO版本,YOLOv8在多个方面进行了显著的优化和改进. 其主干网络设计灵感来源于YOLOv7的高效聚合网络(efficient layer aggregation networks, ELAN)结构,采用集成2个并行梯度流分支的基本卷积核C2f模块. 这一设计大大促使梯度信息流更具鲁棒性,增强了模型在复杂场景下的表现能力. 在YOLOv8中,空间金字塔池化融合(spatial pyramid pooling-fast,SPPF)模块的引入,使得模型能够有效地从不同尺度的图像中提取丰富的上下文信息. 在上采样阶段,传统的卷积结构被去除,取而代之的是C2f模块. 这一策略不仅提升了模型的计算效率,还优化了特征图的重建过程,从而进一步提高了检测精度. YOLOv8-Seg模型的结构如图3所示.

图 3

图 4

1.3.2. 模型训练和评价指标

训练所使用的GPU为RTX3060 16 G. 实验在windows系统上使用PyTorch 框架,编程语言为Python version 3.8. 为了适应所采数据集背景占比大、所要识别对象占比小的特点,经过一系列的测试,选择Adam作为YOLOv8-Seg模型的优化器. Adam优化器能够快速为每个参数计算独立的学习率并进行动态调节,能适应不同参数的更新需求. 设置学习率为

为了更好地评估所改进的YOLOv8-Seg模型的优越性,通过定位损失、分类损失以及分割损失评价来衡量预测值和真实值之间差异性的程度,并根据精度和召回率判断模型识别的性能.

定位损失用于计算模型预测边界框与真实边界框之间的差异,表达式如下:

式中:N为边框的数量,(xi, yi)为真实框的中心坐标,(

采用分类损失评估模型在目标分类方面的性能,计算所画框与对应分类是否正确. 分类损失越小,则分类越准确. 分类损失表达式如下:

式中:C为类别数量,yi,c为类别数量为c的样本i的真实标签,如果属于类别c则为1,否则为0; ŷi,c为样本i对类别c的预测概率.

采用分割损失衡量像素级分割任务中的性能,其通常包含二元交叉熵损失和多类别交叉熵损失,其中二元交叉熵损失适用于二分类分割任务,多类别交叉熵损失适用于多类别分割任务.

二元交叉熵损失表达式如下:

式中:yi为样本的真实标签,即像素或区域真实类别的情况;ŷi为模型预测的概率.

多类别交叉熵损失表达式如下:

如果须更加准确地得到模型损失的真实情况,可以将这3项损失函数合并到一起,计算总损失:

式中:λbox、λcls、λseg为超参数,用于调节各损失项的权重.

采用精确率衡量YOLOv8-Seg模型预测为正例中有多少是真正的正例,采用召回率衡量实际正例中有多少被模型正确预测为正例. 表达式分别如下:

式中:TP为真正例,FP为假正例,FN为假负例.

平均精度均值(mean average precision, mAP)为用精确率和召回率作为两轴作图后围成的面积.

2. 结果处理

2.1. 打印结果的语义分割模型

将事先处理好的带有标度尺的打印结果图像按比例平均分成5份,其中4份为训练集,1份为验证集. 采用改进的YOLOv8-Seg模型对训练集进行语义分割,为了验证本研究模型在数据集上的分割性能,使用模型的分割结果损失率、精确率、召回率和mAP进行性能评估[20].

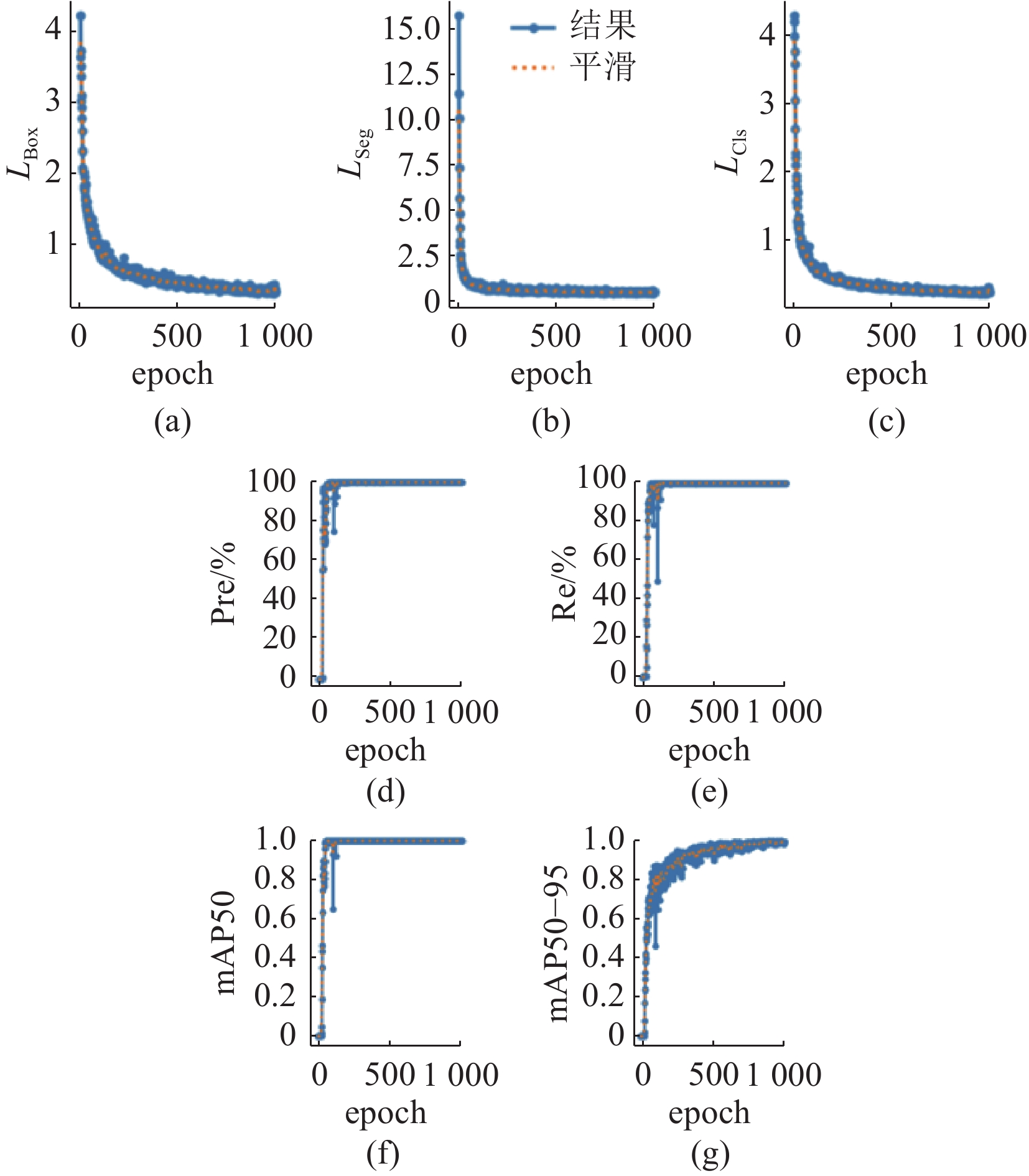

如图5所示,随着训练轮数的增加,该模型在训练集上的定位损失、分割损失和分类损失逐步下降,并且在训练轮数约

图 5

mAP能够全面衡量模型在各类目标识别任务中的预测效果,是判断模型综合能力的关键. 尤其是在不同的交并比(IoU)阈值下,mAP可以提供更加详细的预测准确度信息. 通常,mAP包括mAP50和mAP50−90这2个指标. mAP50是指在IoU阈值为0.5时,模型的精度;mAP50−90是计算IoU阈值在0.5~0.9范围内,模型的平均精度. 这2个指标的变化趋势能够直观地反映出模型的鲁棒性与精确性.

2.2. 算法预测轮廓准确性判定

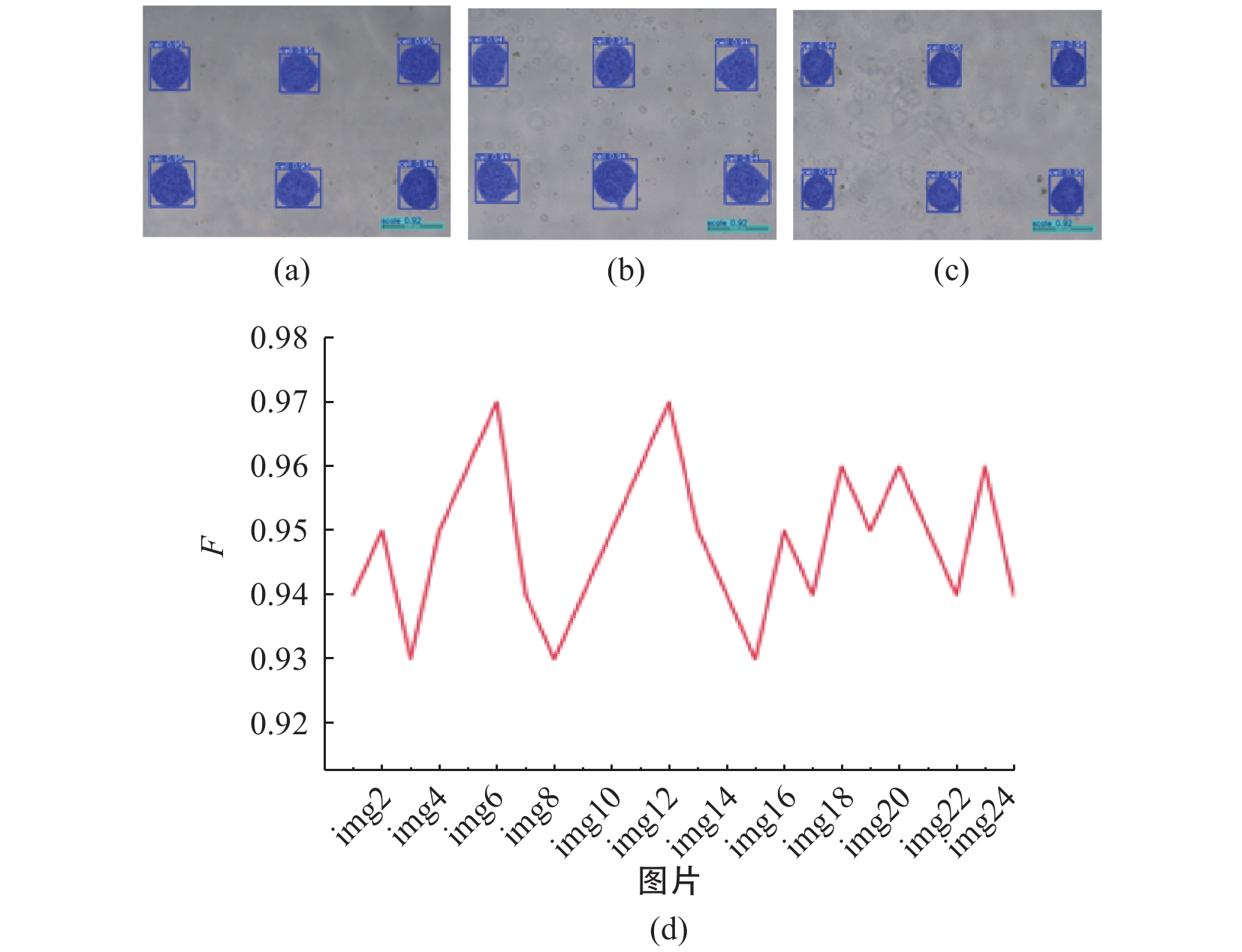

为了确保评估结果的系统性,将预测集中的不同图像依次命名为img1、img2、img3等,并把细胞集团从左到右、从上到下依次以数字1~6命名,如第1张图片的第1个细胞集团可以表示为img1-1. 如图6所示,预测集图片中轮廓识别的平均置信水平F几乎都高于0.94,识别准确性较高. 为了便于后续对于所识别轮廓面积进行自动识别求解,对训练集中的图片标度尺轮廓也进行了语义分割.

图 6

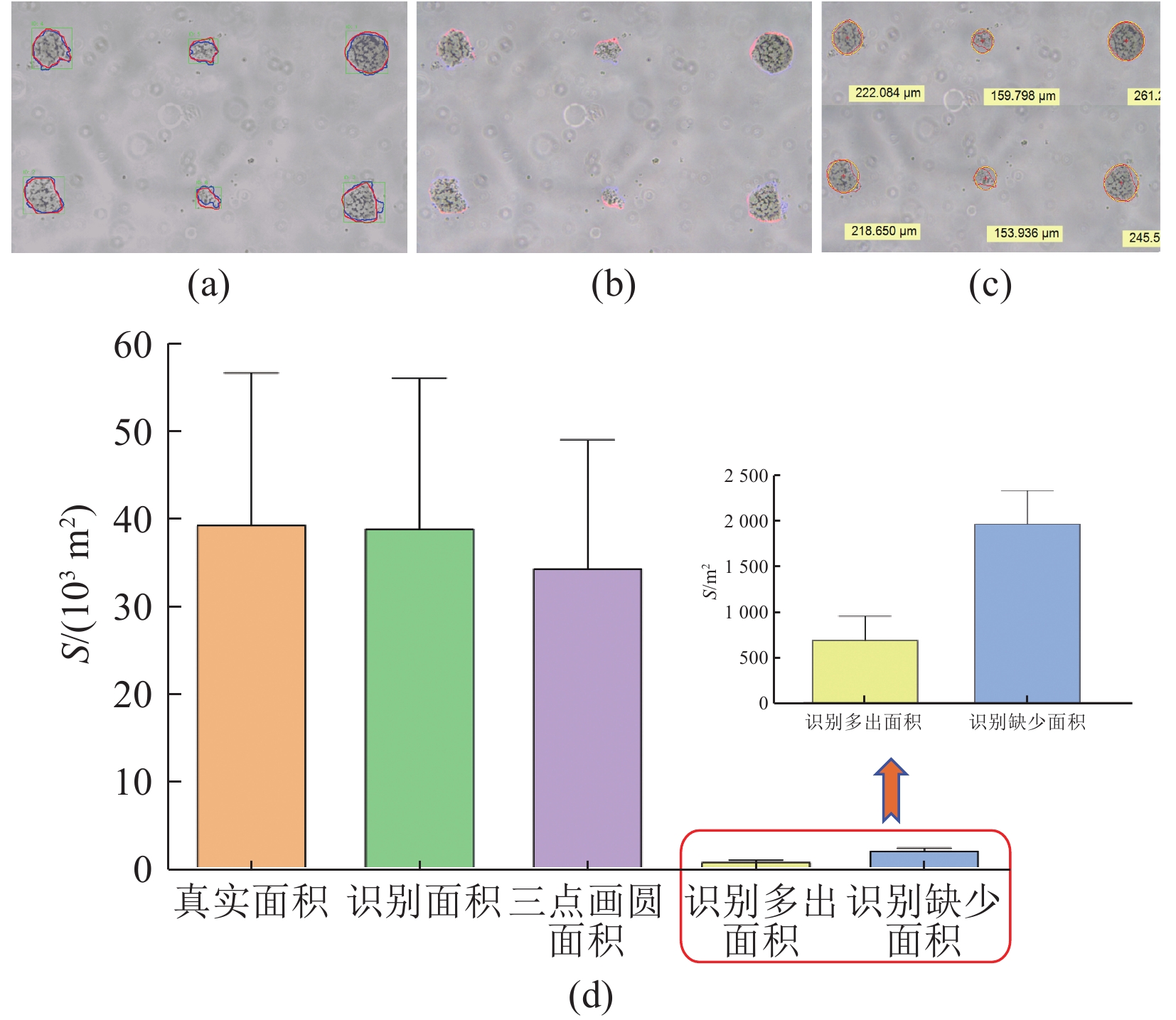

预测所得轮廓与实际手工圈画轮廓之间仍可能存在一定的差异. 通过手工圈画的方式画出打印结果轮廓,将该轮廓作为真实轮廓,其所围成的面积作为真实面积. 为了更加直观地评估模型在打印结果轮廓识别方面的表现,通过补偿打印模式和双向补偿模式采集不同的数据,并将真实轮廓分别与模型识别轮廓和三点画圆轮廓进行对比. 如1.2节所示,三点画圆轮廓与真实轮廓差异明显,因此,只将识别轮廓与真实轮廓进行对比,突出其差异性. 将2种轮廓的多出部分以及缺少部分通过掩码提取,再进行比较.

图 7

图 7 补偿打印模式轮廓对比差异显示图

Fig.7 Comparative contour deviation visualization of undirectional compensation printing mode

图 8

图 8 双向补偿打印模式轮廓对比差异显示图

Fig.8 Comparative contour deviation visualization of bidirectional compensation printing mode

为了更好地从数据上比较差异性,将所有图片中的细胞集团的真实面积、识别面积、三点画圆面积等通过算法计算出来,并统计数据计算平均值,如图7(d)、8(d)所示. 具体面积计算的方法为以预先放置的标度尺为参考,将图像中的像素长度转换为实际的物理长度. 自动识别图中每个封闭轮廓的图像像素面积,并利用转换关系将其转化为实际物理面积,从而自动识别并计算出轮廓的面积,最后再加入轮廓圆度识别功能. 从图像中可以看出,改进的YOLOv8-Seg模型所识别的打印结果轮廓与手工圈画的真实轮廓之间几乎没有差别,准确性较高. 反映出其在识别任务以及计算面积算法上的高度准确性,表明该模型在细节捕捉方面的优秀性能,可以应用于不同的使用环境[24-26],同时显示出三点画圆法所得轮廓面积与真实轮廓面积差异偏大.

2.3. 识别轮廓面积变异性系数CV与圆度分析

为了更加准确地评估打印效果的均一性,对识别轮廓面积的变异系数(coefficient of variation,CV)与圆度进行分析,以此两者为指标评价可以增加评估的准确性. 具体而言,对一组图片中算法提取的轮廓进行面积计算与圆度评价,并分析其面积的变异系数CV. 当打印结果轮廓的面积变异系数CV小于20%,且圆度大于0.65时,可以认为打印结果均一良好.

变异系数CV是一组数据的标准差与平均值的比值. 表达式如下:

式中:σ为标准差,µ 为平均值.

图 9

图 9 识别轮廓面积、圆度与变异系数图

Fig.9 Contour area, circularity, and coefficient of variation chart

3. 前景展望

生物打印机打印质量的均一性研究不仅在基础科学领域具有重要意义,更在未来的临床应用中拥有巨大的潜力. 随着组织工程与再生医学的快速发展,生物打印机所打印出来的细胞集团可以进一步培养成细胞球. 细胞球作为重要的三维细胞培养形式,在构建复杂组织结构、模拟生理环境方面表现出独特的优势. 生物打印机打印质量的均一性直接关系到其在下游应用中的生物功能稳定性和可靠性[27].

通过实时自动检测生物打印机的打印质量并以此调节打印参数从而提升打印技术的精确度和控制能力,可以在更大范围内实现高质量、标准化的细胞球生产. 这不仅为基础研究提供了更稳定的模型,也为个性化治疗和临床应用奠定了坚实的基础. 在未来,均一性的细胞球可能被用于构建个性化器官移植物、开发复杂疾病的体外模型,以及提高细胞治疗的有效性和安全性. 尤其在精准医疗时代,均一细胞球将成为推动疾病模型开发和药物筛选效率提升的重要工具,助力实现疾病治疗从“群体标准”向“个体定制”的转变.

4. 结 论

(1) 相较于传统人工通过三点画圆法,本研究采用改进的YOLOv8-Seg模型进行轮廓识别. 其在生物打印机的打印质量评估方面,具有显著的优势,可以较准确地识别出打印轮廓,并且节约大量人工手圈画轮廓的时间.

(2) 基于改进后的YOLOv8-Seg模型输出轮廓数据,再结合面积计算算法,实现目标轮廓面积的自动测量. 同时,增加对于轮廓与圆形相似度的计算,不再仅从轮廓面积评估打印结果的好坏,从而能更加有效地评估生物打印机的打印质量.

(3) 将改进YOLOv8-Seg模型识别出的轮廓与真实轮廓进行对比. 结果表明,改进YOLOv8-Seg模型不仅可以自动识别出打印结果轮廓,而且识别出的轮廓与真实轮廓的差异较小.

(4) 改进YOLOv8-Seg模型利用深度卷积神经网络和先进的目标检测技术,能够在复杂的图像中自动识别打印结果的准确轮廓. 同时配合面积计算算法,可以自动连贯地实现对于生物打印机打印结果的实时检测识别. 自动化程度高,识别计算准确,避免了人工手动测量的繁琐和误差,且具有更高的处理速度.

本研究只是后期评价,即评价后通过评价数据再去补充打印,使再打印结果更均一,并没有做到实时干预. 下一步计划实现实时并准确的干预.

参考文献

Advances in 3D Bioprinting

[J].

生物医疗领域三维打印的研究与应用

[J].DOI:10.3969/j.issn.2095-4344.0992 [本文引用: 1]

Review on three-dimensional printing in the biomedical field

[J].DOI:10.3969/j.issn.2095-4344.0992 [本文引用: 1]

3D bioprinting of cells, tissues and organs

[J].DOI:10.1038/s41598-020-70086-y [本文引用: 1]

Progress in 3D bioprinting technology for tissue/organ regenerative engineering

[J].DOI:10.1016/j.biomaterials.2019.119536 [本文引用: 1]

Deep learning for fabrication and maturation of 3D bioprinted tissues and organs

[J].

Printability and cell viability in extrusion-based bioprinting from experimental, computational, and machine learning views

[J].

A study of CNN and transfer learning in medical imaging: advantages, challenges, future scope

[J].DOI:10.3390/su15075930 [本文引用: 1]

A review of yolo algorithm developments

[J].DOI:10.1016/j.procs.2022.01.135 [本文引用: 1]

Object detection using YOLO: challenges, architectural successors, datasets and applications

[J].DOI:10.1007/s11042-022-13644-y

YOLO-v1 to YOLO-v8, the rise of YOLO and its complementary nature toward digital manufacturing and industrial defect detection

[J].DOI:10.3390/machines11070677 [本文引用: 1]

A brief survey on semantic segmentation with deep learning

[J].DOI:10.1016/j.neucom.2019.11.118 [本文引用: 1]

Review the state-of-the-art technologies of semantic segmentation based on deep learning

[J].

Edge detection algorithm of cancer image based on deep learning

[J].

Functionalizing bioinks for 3D bioprinting applications

[J].

基于热泡喷墨技术制备均匀细胞球的创新方法

[J].

Innovative method of manufacturing uniform cell spheroids based on thermal inkjet technology

[J].

Improvement of the YOLOv8 model in the optimization of the weed recognition algorithm in cotton field

[J].DOI:10.3390/plants13131843 [本文引用: 1]

Recent advances on image edge detection: a comprehensive review

[J].

Survey of image edge detection

[J].

A review of semantic segmentation using deep neural networks

[J].

Automated semantic segmentation of red blood cells for sickle cell disease

[J].

Automated construction site monitoring based on improved YOLOv8-seg instance segmentation algorithm

[J].

Improved YOLOv8-seg network for instance segmentation of healthy and diseased tomato plants in the growth stage

[J].

Rock-ring detection accuracy improvement in infrared satellite image with sub-pixel edge detection

[J].

LCA-YOLOv8-seg: an improved lightweight YOLOv8-seg for real-time pixel-level crack detection of dams and bridges

[J].

Performance analysis of rule-based classification and deep learning method for automatic road extraction

[J].