应用于4~5 mm窄坡口的超窄间隙焊接须先将特制焊剂带置于坡口两侧壁,再对电弧加以约束以抑制侧壁坡口电弧攀升,进而有效控制电弧在坡口的加热区域,使侧壁根部熔合良好,线能量低至0.6

已有研究通过电弧形态来分析焊接过程的稳定性,监测焊接过程,寻找最佳焊接参数[7-8]. 在熔化极气体保护焊中,电弧形态获取以视觉传感为主,电弧形态检测的方法可以分为2个类别:在线和离线. 在线检测方面,Li等[9]提出阈值分割的方法,在线检测旋转电弧窄间隙熔化极活性气体保护焊(metal active gas arc welding, MAG)电弧中心坐标和电弧面积以实时监测焊接状态;王聪等[10]提出水域分割的形态学处理方法,将在线提取的熔化极气体保护焊(gas metal arc welding, GMAW)电弧的轮廓信息反馈至工控机以调整焊接参数;Jamrozik等[11]使用感兴趣区域提取和阈值分割方法,结合简易相机标定,粗略提取手工电弧焊中电弧的长度,建立手工焊教学辅助系统. 离线检测方面,程世佳等[12]对电弧图像进行二值化、阈值分割和边缘提取后,获得电弧关键点的像素坐标,求得电弧面积和周长;Zhu等[13]通过ImageJ软件手动测量铝合金窄间隙GMAW焊接方法中电弧弧长和电弧翘度,分析焊缝熔深和焊缝侧壁熔深的关系. 以上研究都是利用传统的图像处理算法,检测速度最高只能达到10 帧/s,提取的形态特征有电弧弧长、轮廓和中心坐标等,很少有研究提取电弧的宽度. 在线同时检测电弧实际长和宽的研究较少,关于定量描述电弧的长和宽,Jamrozik等[11]所提标定方法的测量精度无法满足要求. 随着Faster R-CNN[14]、SDD[15]、YOLO系列[16-19]等目标检测网络的出现,采用检测锚框的高和宽分别表示电弧的长和宽来检测电弧形态的方法使电弧形态在线检测成为可能. 目标检测网络在实际工业问题中已经有广泛应用,郝琨等[20]通过改进Mobilenet-YOLOv3目标检测网络,实现水下生物检测;董红召等[21]在YOLOv5网络中添加角度预测分支,解决了再生物品分拣场景中旋转目标难检测的问题.

电弧是高速运动的对象,要求网络检测速度快且易部署在工业现场. 现有的目标检测网络结构复杂,精度和速度无法同时满足要求. 本研究在YOLOv5s网络的基础上提出超窄间隙焊接电弧形态在线检测网络YOLO-SEC主要工作如下:1) 建立超窄间隙电弧数据集LUT-Arc. 2) 设计AD-Shufflenet、LC3和Conv-Maxpool模块,使用单检测层推理结构,降低原网络的计算量和参数量,提高网络推理速度. 3) 使用k-means+算法聚类数据集的预设锚框,引入定位损失函数EIoU[22],提高检测锚框约束电弧的精准度. 4) 在预测框绘制函数中,引入单目线性相机标定算法,实现电弧尺寸的定量描述.

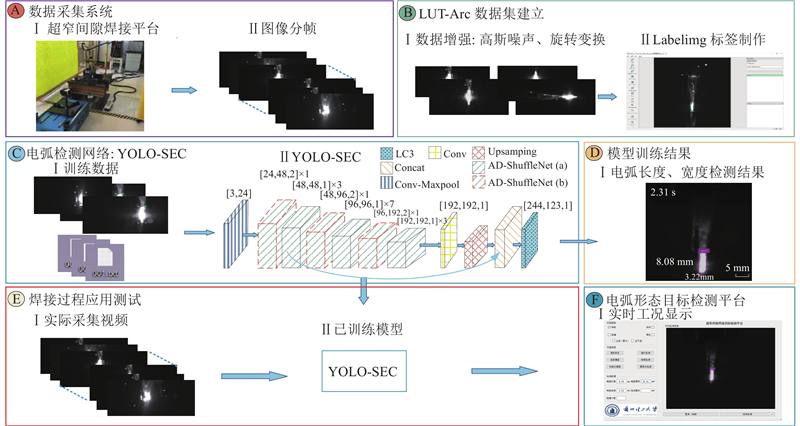

1. 系统流程

本研究通过目标检测网络检测锚框的高和宽代替电弧的长和宽,实现电弧形态的在线定量检测,检测网络的设计和训练是实现电弧形态准确检测的关键. 如图1所示,焊接电弧形态检测的流程为1)通过数据采集系统采集电弧视频,进行分帧、增强和标注处理,建立数据集;2)根据电弧图像特点,设计并训练YOLO-SEC;3)在电弧目标检测平台上运行YOLO-SEC,对新的电弧图像进行在线处理,实现在线检测.

图 1

2. 电弧图像获取和数据集构建

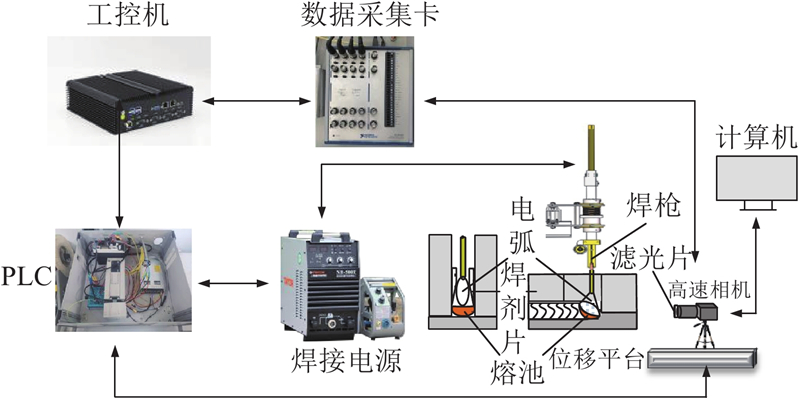

2.1. 数据采集平台

图像采集和现场实验在超窄间隙焊接平台上完成,焊接对象是长为20 cm的低碳钢试样. 焊接工艺参数如表1所示,其中bg为试样坡口宽度,

表 1 焊接实验的工艺参数

Tab.1

| 工况 | | | | |

| 1 | 5.0 | 22.5 | 57.1 | 8.0 |

| 2 | 5.0 | 23.0 | 52.6 | 8.0 |

图 2

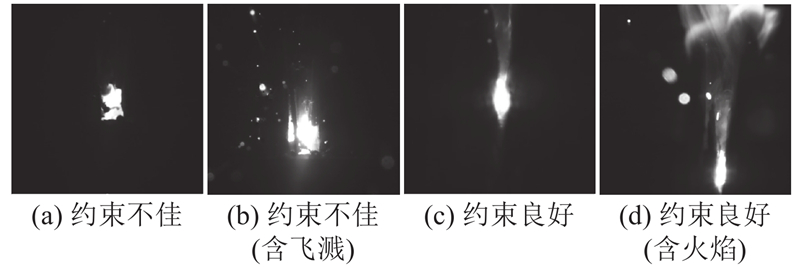

2.2. 超窄间隙焊接电弧数据集

图 3

表 2 LUT-Arc数据集焊接电弧类型构成

Tab.2

| 图片类型 | N | |

| 训练集 | 验证集 | |

| 约束良好 | 426 | 109 |

| 约束良好(含火焰) | 154 | 38 |

| 约束不佳 | 333 | 79 |

| 约束不佳(含飞溅) | 83 | 23 |

| 总计 | 996 | 249 |

3. YOLO-SEC电弧形态检测网络

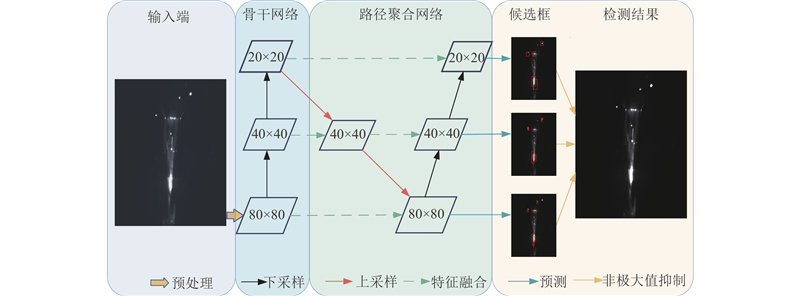

电弧形态在线定量检测的关键是检测网络对电弧定位的准确性和高效性. 将多目标检测网络YOLOv5s直接用于电弧形态检测任务,面临以下问题:网络的主干网络层数深、检测层数量多,计算量过剩,导致网络体积大,检测速度慢;电弧预测锚框定位精度低,锚框的宽和高以像素点表示,电弧的长、宽无法量化. 本研究在YOLOv5s网络(5.0版本)的基础上设计检测器,具体过程如下.

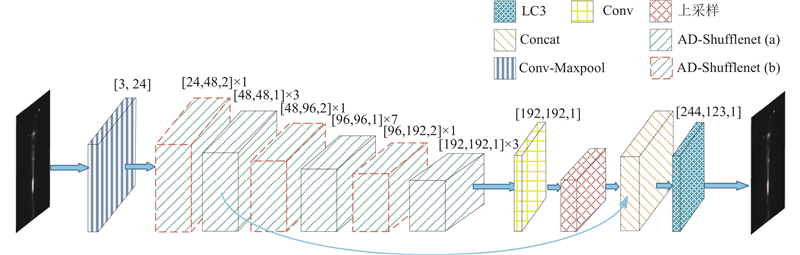

1) 通过设计3种轻量化模块Conv-Maxpool、AD-Shufflenet和LC3,分别替代骨干网络(Backbone)中的Focus模块、C3模块和颈网络(Neck)中的C3模块. 裁剪原网络的检测层,降低参数量,提高检测速度.

2) 提出k-means+算法对LUT-Arc数据集预设锚框重新聚类,引入定位损失函数EIoU. 在不影响网络体积及推理速度的情况下,提高电弧的定位精度.

3) 针对电弧长和宽无法量化的问题,将单目线性相机标定算法加入预测框绘制函数,在焊接前标定出真实点和像素点的对应关系.

3.1. YOLOv5s网络介绍

图 4

3.2. 网络结构的改进

3.2.1. LC3模块和Conv-Maxpool模块设计

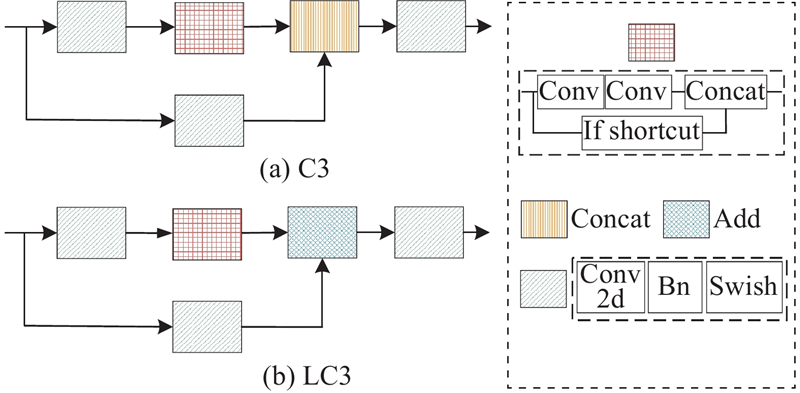

在YOLOv5s中,C3模块实现在骨干网络和颈网络中提取特征,如图5(a)所示,它有2条分支,分支1先通过卷积层(斜底纹方块)降低通道数量,再经过多个Bottleneck模块(竖底纹方块);分支2只经过卷积层降低通道数量. 将2个分支的输出进行Concat,再经过卷积层后输出. Concat是将2路特征图进行张量拼接,实现通道信息融合的操作,该操作虽然能够丰富语义特征,但会增加特征图的维度,增加计算量. 在颈网络中,输入特征图经主干网络完成特征提取,特征图语义趋于类似,因此使用Add操作代替Concat操作. Add操作是张量相加,不会扩充维度,比Concat操作更节省参数和计算量. 基于此,创建如图5(b)所示的LC3模块,替换颈网络中的C3模块,使网络轻量化.

图 5

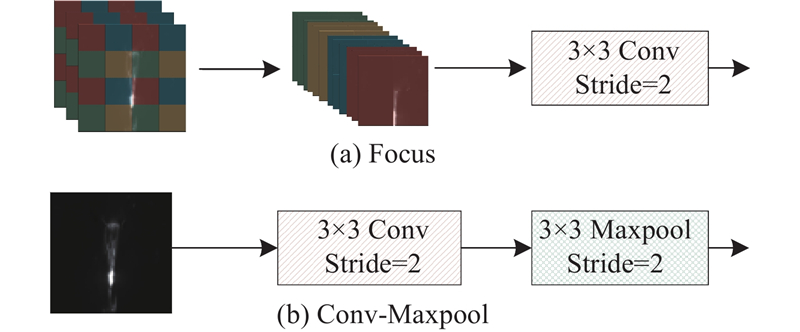

图 6

图 6 Focus模块和Conv-Maxpool模块的网络结构

Fig.6 Network structure of Focus module and Conv-Maxpool module

3.2.2. AD-Shufflenet主干网络设计

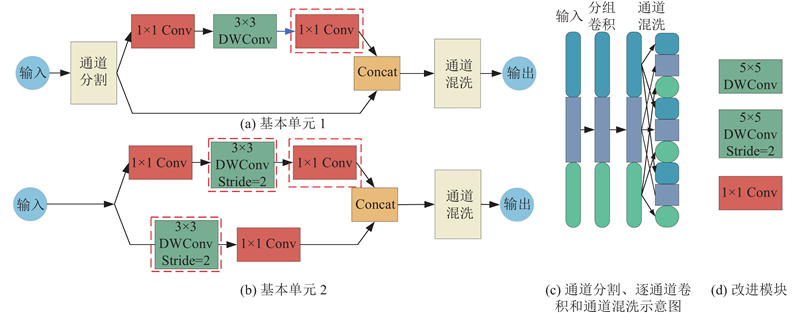

AD-Shufflenet模块由高性能神经网络Shufflenet V2[25]架构改进而来,用作新网络的主干模块. 如图7所示,Shufflenet v2包含2个基本单元,其中一个实现特征提取,是主干单元;另一个进行2倍下采样,提升通道数量,增加特征的丰富性. Shufflenet V2主要结构包括通道分割(channel split)、逐通道卷积(depthwise convolution, DWConv)和通道混洗(channel shuffle). 通道混洗包含分组卷积操作(group convolution, GConv) ,通道分割将输入特征的通道数一分为二,逐通道卷积是分组卷积的分组数等于通道数的特例. 分组卷积会大幅降低卷积层的参数量,假设输入的特征图大小为

图 7

图 7 Shufflenet V2模块和AD-Shufflenet V2模块的网络结构

Fig.7 Network structure of Shufflenet V2 module and AD-Shufflenet V2 module

分组卷积是将输入特征图分小组后按小组单独进行卷积计算(假设分组数为

对比式(1)和(2)可以看出,分组卷积将传统卷积的参数量压缩至原来的1/g. 由于分组卷积各小组彼此没有信息交流,通道混洗实现了跨小组的信息融合,增强了信息表达能力.

根据轻量级网络的设计准则“当网络的输出通道和输入通道相同时,计算机的内存占用最低”可以确定,在Shufflenet V2的2个基本单元中,逐通道卷积前后的

3.2.3. 单检测层设定和k-means+锚框聚类

基线网络共有3个检测层. 当输入的图像尺寸为

检测层设定完成后,须设定预设锚框(bboxes)的尺寸. YOLOv5s采用k-means算法聚类数据集得到预设锚框,并采用变异遗传算法在聚类过程中调整锚框. k-means算法用欧氏距离度量bboxes到每个簇的距离,较大边界框的尺寸误差比较小边界框的大. 为了提高聚类效率,优化k-means算法,提出k-means+算法. 为了使边界框交并比的大小与边界框尺寸无关,根据交并比的重叠度选取更优锚框

式中:

表 3 不同聚类算法的聚类效果对比

Tab.3

| 聚类算法 | 锚框尺寸 | | |

| k-means+遗传算法 | [11,28 28,11 20,22] | 0.831 | 1 |

| k-means | [11,29 29,12 19,21] | 0.828 | 1 |

| k-means+ | [11,27 28,11 20,22] | 0.831 | 1 |

3.3. 定位损失函数的改进

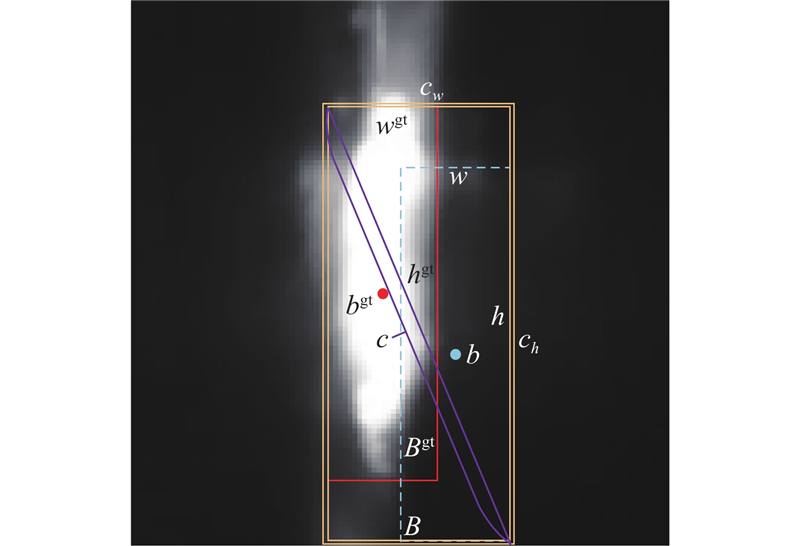

在电弧形态检测网络中,预测框准确度直接决定检测精度,在目标检测网络中,预测框准确度由定位损失函数决定. YOLOv5s采用CIoU[26]损失函数. CIoU考虑重叠面积、中心点距离和宽高,但无法准确描述真实框和预测框长宽之间的差异. EIoU优化CIoU,以边长损失代替长宽比损失项. 本研究使用EIoU作为YOLO-SEC的定位损失函数.

EIoU损失函数示意图如图8所示,实线框表示目标的真实框,

图 8

中心点损失

3.4. 预测框绘制函数的改进

YOLO-SEC的预测定位锚框由预测框绘制函数plot_one_box以像素为单位绘制并显示,定量检测的关键是得到电弧的实际尺寸. 本研究在plot_one_box中加入基于单目视觉的线性相机标定,该方法可以求出世界坐标系(电弧前平面)到图像坐标系(电弧像平面)转换的隐参数矩阵

1) 建立相机内外参数模型

式(7)为摄像机内参数矩阵,用于描述图像坐标

式(8)为摄像机外参数矩阵,描述摄像机坐标与世界坐标

2) 将标定板与焊丝共面,世界坐标系建立于标定板上,则

3) 基于harris亚像素角点提取方法搜索并识别角点,通过特征点的像素坐标与已知的世界坐标求解隐参数矩阵

4) 由式(10)和(11)得到特征点图像坐标系与世界坐标系之间的转换关系为

特征点的世界坐标为

5)将点

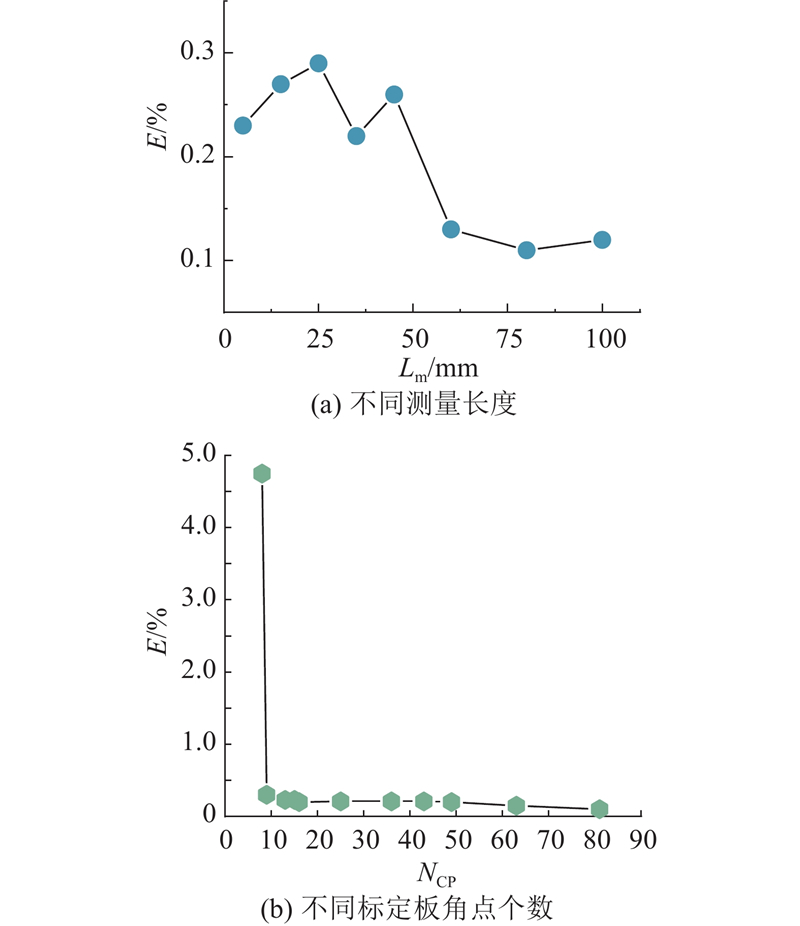

图 9

图 9 不同变量对标定方法性能影响的测试结果

Fig.9 Test results of effects for different variables on performance of calibration method

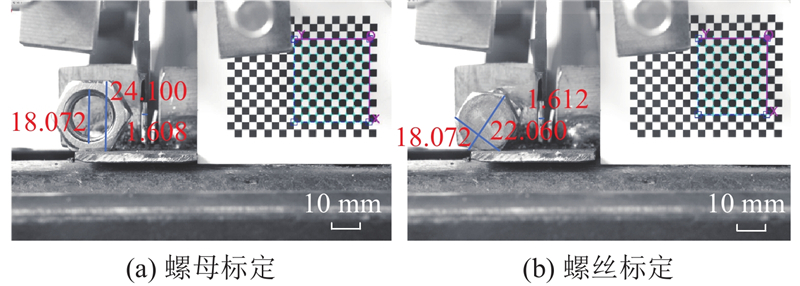

图 10

图 10 不同参照物实际标定图像

Fig.10 Actual calibration images of different reference objects

表 4 不同参照物实际测量结果

Tab.4

| 测量对象 | | | E/% | ||||||

| 1 | 2 | 3 | 4 | 5 | 6 | 7 | |||

| 螺丝内径 | 18.00 | 18.07 | 18.03 | 17.89 | 18.10 | 18.04 | 17.92 | 18.03 | 0.37 |

| 螺丝外径 | 24.00 | 24.10 | 23.93 | 23.89 | 24.09 | 24.04 | 24.18 | 23.94 | 0.39 |

| 螺母内径 | 20.00 | 19.85 | 19.91 | 20.07 | 20.04 | 20.11 | 20.16 | 19.97 | 0.46 |

| 螺母外径 | 22.00 | 22.06 | 22.07 | 22.15 | 21.92 | 21.96 | 22.03 | 22.03 | 0.30 |

| 焊丝直径 | 1.60 | 1.61 | 1.60 | 1.59 | 1.58 | 1.60 | 1.61 | 1.60 | 0.45 |

| 均值 | — | — | — | — | — | — | — | — | 0.39 |

YOLO-SEC的网络结构如图11所示. 骨干网络由Conv-Maxpool模块和16个AD-Shufflenet模块组成,实现特征提取. 颈网络由1个Conv模块、1个Upsamping模块和1个Concat模块组成,实现特征的聚合与拼接. LC3模块为电弧检测端,对图像特征进行预测,生成边界框和预测类别.

图 11

4. 实验和分析

4.1. 实验环境和评价指标

采用Pytorch-1.7.1深度学习框架,操作系统为Windows10,GPU为NVIDA RTX 1050,处理器为Intel(R) Core(TM) i5-9300H 2.40 GHz,对YOLO-SEC和对比网络进行训练和测试,训练过程中所有网络均不使用预训练模型. 图像的大小为

实验采用准确率P、召回率R、平均精度均值mAP0.5[28]作为网络精度的评价指标. 其中mAP0.5为所有类别AP的均值,通常作为评估精度的综合指标. 此外,本研究使用网络单张图片推理时间t、参数量

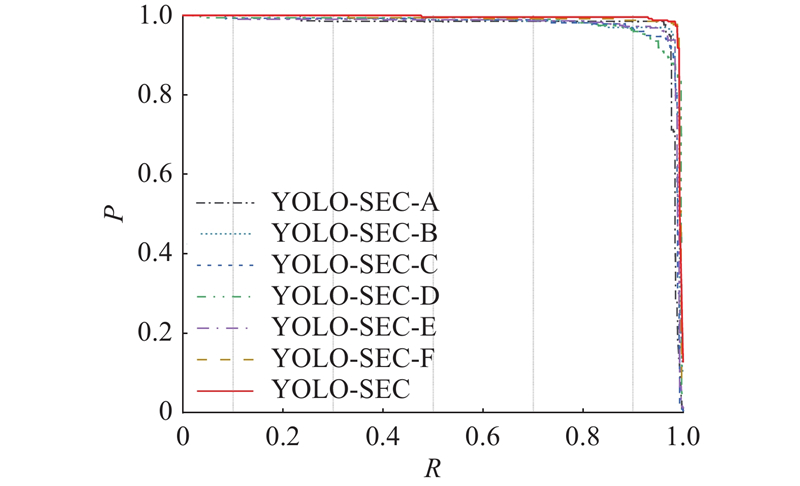

4.2. 消融实验

设计消融实验探究所提出的改进对网络性能的影响. 以YOLOv5s网络为基础,将Focus模块替换为Conv-Maxpool模块的网络称为YOLO-SEC-A;以YOLO-SEC-A为基础,将Shufflenet V2作为主干网络的网络称为YOLO-SEC-B;以YOLO-SEC-B为基础,将改进后的AD-Shufflenet模块作为主干网络的网络称为YOLO-SEC-C;在YOLO-SEC-C网络的基础上将颈网络中的C3模块替换为LC3模块,得到的网络称为YOLO-SEC-D;将YOLO-SEC-D网络的定位损失函数修改为EIoU,得到的网络称为YOLO-SEC-E;将YOLO-SEC-E的锚框用k-means+聚类方法重新聚类,并聚合第4个AD-Shufflenet模块输出的特征图信息的单检测层的网络称为YOLO-SEC-F;在YOLO-SEC-F的基础上,将聚合的特征图改为第2个AD-Shufflenet模块的输出得到的网络称为YOLO-SEC. 加入不同模块的电弧检测网络的P-R曲线和消融实验指标如表5和图12所示.

表 5 YOLO-SEC消融实验的检测指标对比

Tab.5

| 网络名称 | | FLOPs/109 | V/MB | P/% | R/% | mAP0.5/% | t/ms |

| YOLOv5s | 7.26 | 14.8 | 14.4 | 96.9 | 96.2 | 97.8 | 12.9 |

| YOLO-SEC-A | 7.03 | 14.6 | 14.0 | 96.4 | 96.2 | 97.4 | 12.4 |

| YOLO-SEC-B | 3.73 | 2.0 | 1.0 | 96.6 | 97.7 | 98.0 | 4.6 |

| YOLO-SEC-C | 3.13 | 1.9 | 0.8 | 95.8 | 97.3 | 98.1 | 4.2 |

| YOLO-SEC-D | 2.15 | 1.1 | 0.6 | 96.1 | 95.0 | 97.7 | 3.8 |

| YOLO-SEC-E | 2.15 | 1.1 | 0.7 | 96.1 | 96.2 | 98.1 | 4.2 |

| YOLO-SEC-F | 1.60 | 0.6 | 0.4 | 97.7 | 98.8 | 98.9 | 3.9 |

| YOLO-SEC | 1.60 | 0.6 | 0.4 | 97.7 | 98.5 | 99.2 | 3.1 |

图 12

图 12 不同电弧检测网络的准确率-召回率曲线

Fig.12 Precision-recall curves of different welding arc detection networks

对比YOLOv5s和YOLO-SEC-A的评估指标可知,Conv-Maxpool模块的引入,降低了网络的参数量和计算量,提高了推理速度,但传统卷积的应用导致mAP0.5从YOLOv5s的97.8%降低到YOLO-SEC-A的97.4%. 对比YOLO-SEC-B和YOLO-SEC-A的评估指标可知,主干网络中引入轻量化模块Shufflenet V2降低了参数量和网络体积,检测精度和推理速度均提高. 对比YOLO-SEC-B和YOLO-SEC-C的评估指标可知,AD-Shufflenet模块使网络更轻量,mAP0.5从98.0%提高至98.1%. 对比YOLO-SEC-C和YOLO-SEC-D的评估指标可知,引入LC3模块Add操作使网络轻量化,但由于特征图减少,导致mAP0.5从98.1%降低至97.7%. 对比YOLO-SEC-D和YOLO-SEC-E的评估指标可知,引入EIoU损失函数后mAP0.5从97.7%提高至98.1%. 对比YOLO-SEC-E和YOLO-SEC-F的评估指标可知,单检测层的设计降低了网络的参数量,提高了网络精度和检测速度. 对比YOLO-SEC-F和YOLO-SEC的评估指标可知,聚合第2个AD-Shufflenet模块输出的特征图信息,网络的精度和速度都是最佳的. 对比YOLO-SEC和原网络YOLOv5s的指标发现,网络精度指标准确率P、召回率R和mAP0.5相较YOLOv5s分别提高了0.8%、2.4%和1.4%;网络复杂度指标参数量

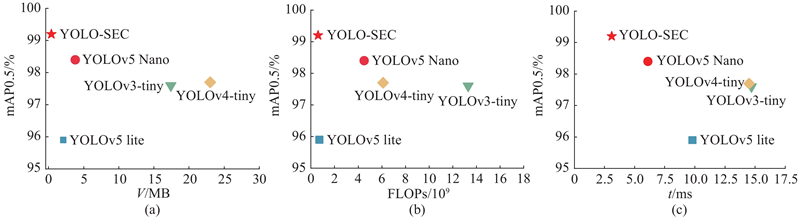

图 13

图 13 YOLO-SEC与4种轻量化网络检测指标对比

Fig.13 Comparison of comprehensive indicators for YOLO-SEC and four lightweight networks

4.3. 不同方法对比试验

表 6 不同目标检测网络的检测指标对比

Tab.6

| 网络名称 | | FLOPs/109 | V/MB | P/% | R/% | mAP0.5/% | t/ms |

| SDD | 23.75 | 59.5 | 90.7 | 94.5 | 95.20 | 95.85 | 25.0 |

| YOLOv3 | 61.94 | 156.3 | 18.8 | 94.8 | 98.50 | 98.90 | 125.0 |

| YOLOv4 | 64.36 | 60.50 | 277.7 | 85.6 | 91.57 | 91.70 | 27.8 |

| YOLOv3-tiny | 8.67 | 13.3 | 17.4 | 97.4 | 98.10 | 97.60 | 14.7 |

| YOLOv4-tiny | 6.95 | 6.1 | 23.0 | 95.9 | 98.33 | 97.70 | 14.5 |

| YOLOv5 lite | 0.80 | 8.7 | 2.1 | 93.4 | 95.50 | 95.90 | 9.8 |

| YOLOv5 Nano | 1.86 | 4.5 | 3.8 | 97.3 | 96.10 | 98.40 | 6.1 |

| YOLO-SEC | 1.60 | 0.6 | 0.4 | 97.7 | 98.50 | 99.20 | 3.1 |

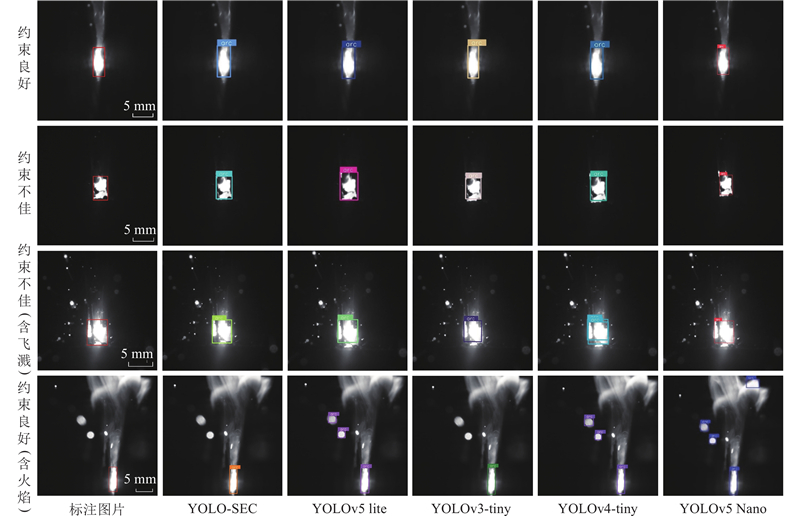

传统网络在检测速度上劣势明显,如图14所示为轻量化网络间的实际检测效果对比. 对于没有明显飞溅和火焰干扰的电弧图像,各种网络都能准确地定位电弧的位置,但是除了YOLO-SEC之外的其他网络对约束不佳(含飞溅)的电弧图像的识别都出现过度拟合的情况,YOLOv4-tiny检测出2个预测框,YOLOv5 lite对约束不佳电弧图像的识别出现欠拟合. 对于飞溅和火焰都比较明显的约束良好(含火焰)电弧图像,YOLOv5 lite、YOLOv4-tiny、YOLOv5 Nano都对飞溅产生误检,YOLOv5 Nano网络把火焰识别为电弧. 综合对比发现,在对比实验的所有网络中,只有YOLO-SEC对各种情况下电弧的识别和定位最准确,说明YOLO-SEC在电弧数据集LUT-Arc上的应用效果最优.

图 14

图 14 YOLO-SEC与4种轻量化网络的实际检测效果对比

Fig.14 Comparison of detection effect for YOLO-SEC and four lightweight networks

4.4. 实际检测效果

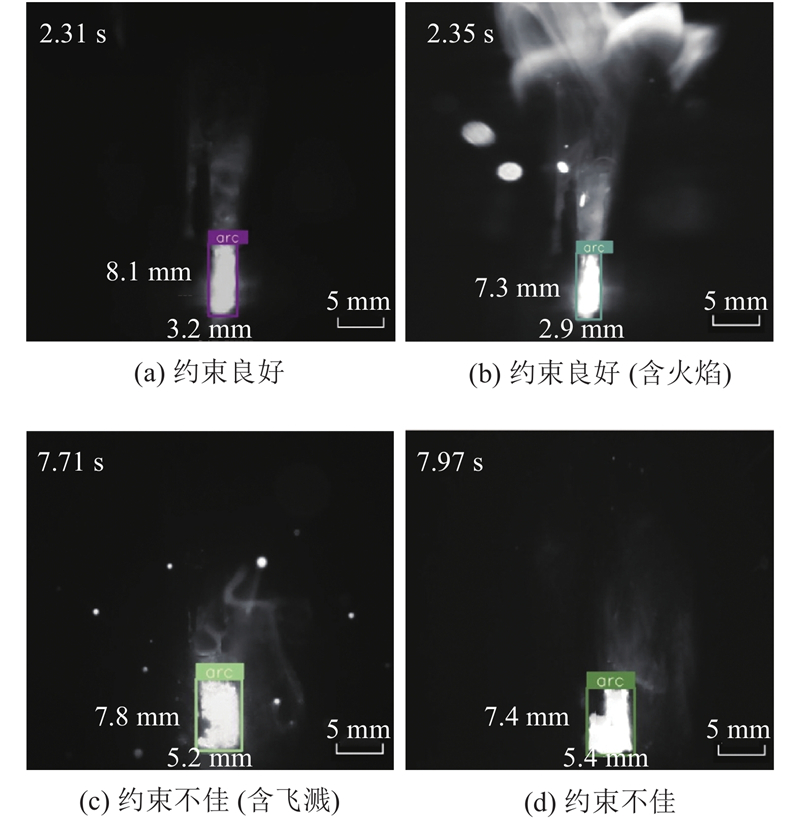

为了测试电弧形态的实际检测效果,在如图15所示的检测平台进行现场实验. 1)用单目线性相机标定方法标定相机相,标定结果为0.1 μm/pixel. 2)在坡口宽度为5.0 mm的试样上,按照表1所示的2种工况各进行一道焊接实验,以100 帧/s的采集速率分别采集2段时长为10 s的电弧视频,并在检测平台进行实时检测. 如图16所示,第一次焊接的第2.31 s,电弧约束正常,长度为8.1 mm,宽度为3.2 mm;第2.35 s,电弧约束良好(含火焰),长度为7.3 mm,宽度为2.9 mm. 第二次焊接的第7.71 s,电弧约束不佳(含飞溅),长度为7.8 mm,宽度为5.2 mm;第7.97 s电弧约束不佳,长度为7.4 mm,宽度为5.4 mm. 实验结果表明,YOLO-SEC实现了对不用类型的电弧精准的定位和检测.

图 15

图 16

图 16 4种焊接电弧的实际检测效果展示

Fig.16 Actual detection effect of four types of welding arcs

5. 结 语

本研究将深度学习目标检测网络应用在焊接电弧形态在线检测领域. 以YOLOv5s为基准网络,针对超窄间隙电弧检测任务的特点,对其网络结构、损失函数和锚框绘制函数进行针对性的改进,提出轻量化的电弧检测网络YOLO-SEC;建立电弧目标检测数据集LUT-Arc,实现电弧长和宽的在线定量检测,对电弧状态的监测有一定的指导意义. 与YOLOv5s网络相比,准确率、召回率、mAP0.5分别提高了0.8%、2.4%和1.4%;参数量、计算量FLOPs、网络体积分别降低了78%、96%和97%,网络的单张图片推理时间从12.9 ms提高到3.1 ms. 在未来的工作中,考虑将网络部署在嵌入式设备上,紧密结合焊接机理,探究电弧形态与焊接工况的关系,更好地指导焊接过程.

参考文献

焊接电弧行为特征和稳定性评价研究与进展

[J].

Research and progress on behavior characteristics and stability evaluation of welding arc

[J].

Research progress of low spatter CO2 welding technology

[J].DOI:10.1007/s00170-022-10504-9 [本文引用: 1]

超窄间隙焊接中送进式焊剂带约束电弧的加热特性

[J].

Heating characteristics of continuous feeding flux strips constrained arc in ultra-narrow gap welding

[J].

焊剂带约束电弧超窄间隙焊接的实现

[J].

Realization of ultra-narrow gap welding with flux strips constraining arc

[J].

超窄间隙焊接中焊剂片与电弧相 互作用机制分析

[J].

Interaction mechanism of flux band and arc in ultra-narrow gap welding

[J].

基于电弧声的超窄间隙焊接熔合状态识别

[J].

Fusion state recognition of ultra-narrow gap welding based on arc sound

[J].

Analysis of arc interference and welding stability in twin wire GMA welding

[J].DOI:10.1007/s00170-015-7225-9 [本文引用: 1]

Study on arc behavior and droplet transfer in twin-electrode TIG-MIG indirect arc welding

[J].DOI:10.1007/s00170-022-09131-1 [本文引用: 1]

A modified welding image feature extraction algorithm for rotating arc narrow gap MAG welding

[J].DOI:10.1108/IR-11-2014-0407 [本文引用: 1]

基于数字形态学的DE-GMAW电弧图像处理

[J].

DE-GMAW arc image processing based on mathematical morphology

[J].

Assessing MMA welding process stability using machine vision-based arc features tracking system

[J].

基于电弧图像的脉冲TIG焊电弧形态及特征温度演变规律

[J].

Arc shape variations and characteristic temperatures of pulsed TIG welding arcs based on observed arc images

[J].

Study on arc characteristics and their influences on weld bead geometry in narrow gap GMAW of 5083 Al-alloy

[J].DOI:10.1007/s00170-016-9563-7 [本文引用: 1]

Faster R-CNN: towards real-time object detection with region proposal networks

[J].DOI:10.1109/TPAMI.2016.2577031 [本文引用: 1]

基于改进Mobilenet-YOLOv3的轻量级水下生物检测算法

[J].

Lightweight underwater biological detection algorithm based on improved Mobilenet-YOLOv3

[J].

旋转框定位的多尺度再生物品目标检测算法

[J].

Multi-scale object detection algorithm for recycled objects based on rotating block positioning

[J].

Focal and efficient IOU loss for accurate bounding box regression

[J].DOI:10.1016/j.neucom.2022.07.042 [本文引用: 1]

基于单目视觉的平面测量

[J].

Plane measurement based on monocular vision

[J].

The pascal visual object classes (VOC) challenge

[J].DOI:10.1007/s11263-009-0275-4 [本文引用: 1]