在上述的跟踪及着陆研究中,仅依靠视觉来完成跟踪及降落,目前还存在一些问题. 1)大多数方法将相机固定于无人机下方,视野易丢失,导致“跟丢”现象;2)王日俊等[5, 7-8]提出的视觉算法运算量大,过度占用机载嵌入式系统资源;3)在着陆时,容易出现视野盲区,图像畸变严重,影响降落精度,而且着陆时会产生地面效应[10],加剧相机画面抖动. 针对上述问题,本文研究基于视觉和磁引导的组合导航技术,提出“随动视觉跟踪”,即摄像头随着跟踪目标的移动而智能调整自身朝向的控制策略. 提出在通过视觉跟踪完成常规跟踪后进行降落时利用电磁引导配合视觉导航的精确降落方法,搭建实验平台进行跟踪及着陆实验,验证了提出方法的正确性.

1. 无人机相对移动目标的位姿建模

将无人车作为移动目标,该模型可以描述如下:无人机实时识别无人车的方位并进行跟踪,在完成跟踪任务后可以精准着陆在无人车上. 无人机和无人车的相对位姿如图1所示.

图 1

建立地球坐标系(X0,Y0,Z0)、无人机坐标系(X1,Y1,Z1)、挂载于无人机上的相机坐标系(X2,Y2,Z2)、无人车坐标系(X3,Y3,Z3). 无人机沿自身坐标系

选取地球坐标系作为惯性系,无人机位姿可以描述为RUAV=[x1,y1,z1,0,0,

无人机相对无人车的位姿为

本文主要针对无人机对无人车跟踪及着陆问题,下文主要围绕位姿矩阵

2. 随动视觉跟踪算法研究

视觉跟踪主要采用Camshift跟踪算法[11]. Camshift是MeanShift算法的改进,称为连续自适应的算法. 该算法能够在被跟踪目标的形状、大小发生明显变化时,仍然能够准确地检测到跟踪目标,且算法的运行消耗时间少;当外界颜色丰富且和被跟踪目标的颜色接近时,将会导致跟踪窗口扩大,影响跟踪效果. 为了解决该问题,在无人车上设计合适的“信标”来抵抗外界的干扰. 用来获取图像信息的摄像机安装于具有两自由度的云台,使得摄像机能够根据跟踪过程中的实际情况实时调整自身倾角,防止被跟踪目标瞬时运动过快或无人机遭遇障碍物使无人机突然减速导致“跟丢”,即无人车超过了摄像机的成像范围. 这种根据跟踪过程中的实际情况实时调整摄像机倾角的技术,称为“随动视觉跟踪”.

2.1. 视觉信标设计

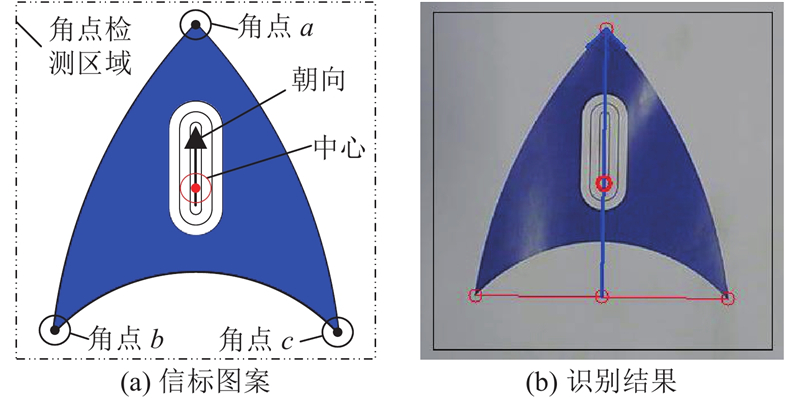

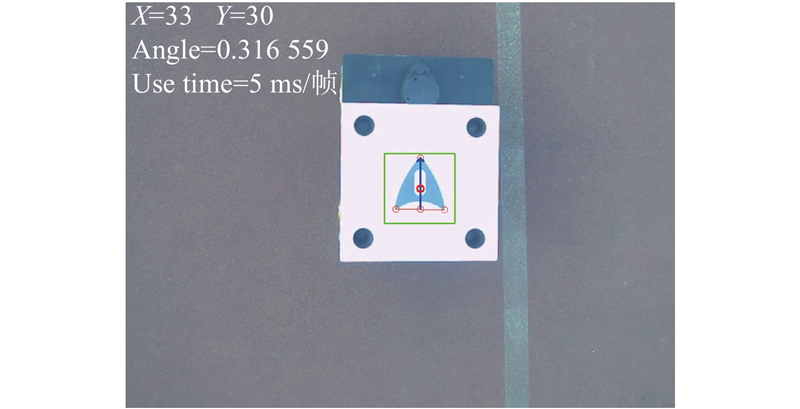

根据Camshift跟踪算法的特点,设计如图2(a)的信标. 该信标由蓝色(或其他)“圆润的”三角形图案组成,且内部设置有等距长圆形线条. 检测步骤如下:1)利用Camshift跟踪算法确定信标的位置,锁定跟踪窗口;2)对跟踪窗口进行适当扩大,得到角点检测区域,该区域小于信标外边界;3)在该区域内进行角点检测,通过检测到信标上的“圆润状”三角形的3个角点来确定无人车相对于无人机的方位. 具体方法如下:通过3个角点做三角形,取最短边并求中点,则从该中点指向另一个角点的向量为无人车在相机坐标系的朝向;通过3个角点所做的三角形的几何中心即为信标的中心. 角点检测确定无人机与无人车朝向相对夹角的示意图如图2(a)所示. 图中,箭头的朝向为相机坐标系下无人车朝向的方向向量. 在设计好信标后,开展实验验证. 可知,无人机在不同位置、角度均能够识别信标的位置以及确定信标的朝向,识别结果如图2(b)所示.

将信标图案粘贴于信标板上,用于对无人机的引导,安装示意图如图3所示.

图 2

图 3

2.2. 视觉定位下相对位姿解算

在视觉跟踪过程中,需要确定无人车和无人机的相对位置,才能进行下一步的运动控制. 为了方便分析,在跟踪过程中选取相机(云台)坐标系作为惯性系. 此时,相机坐标系下无人车的位姿可以表示为

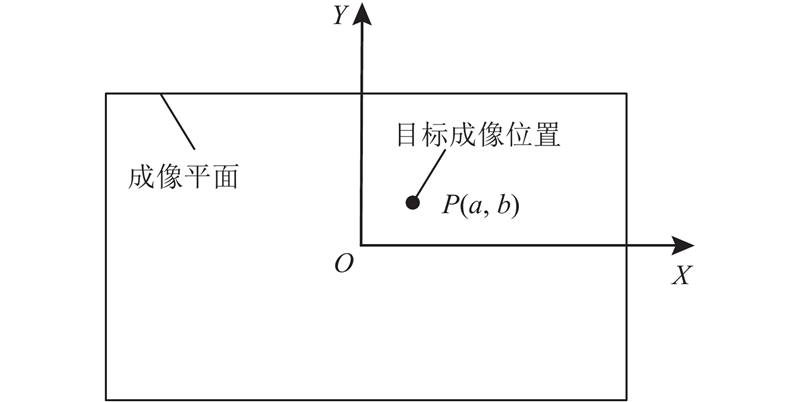

利用跟踪算法识别到无人车后,可以确定无人机在成像画面中的坐标及车头朝向. 相机成像平面如图4所示,选取成像画面中心为坐标原点,建立平面坐标系. 在图2的识别结果中,取信标中心为目标位置,记为

图 4

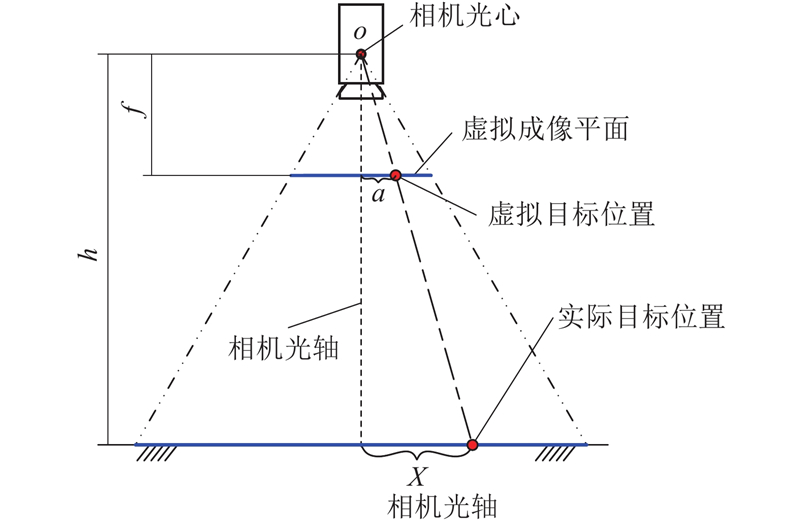

相机光心距离地面高度为

图 5

设无人车在相机坐标系下的坐标为

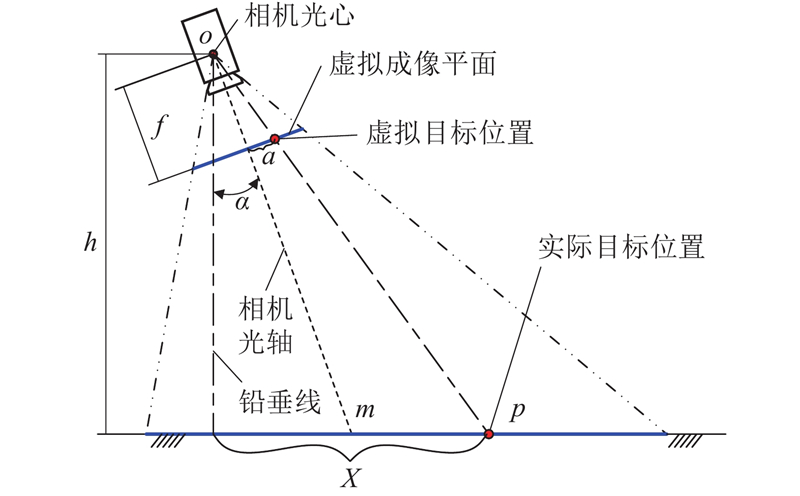

当相机存在一定倾角时,定义相机绕自身坐标系的

根据三角函数关系可得:

当相机绕自身坐标系的

无人机在无人车坐标系下的位姿为

式中:右边的所有变量均可由无人机机载传感器直接或间接得到,其中h由激光测距仪获得,α、β由搭载于云台系统的MPU6050惯性传感器获取角速度和加速度经过姿态解算[13]获得.

图 6

2.3. 随动视觉跟踪控制策略设计

在跟踪过程中,需要完成无人机的位置及航向控制. 位置控制可以将无人机和无人车理解为质点,航向控制是调整无人机和无人车的相对夹角.

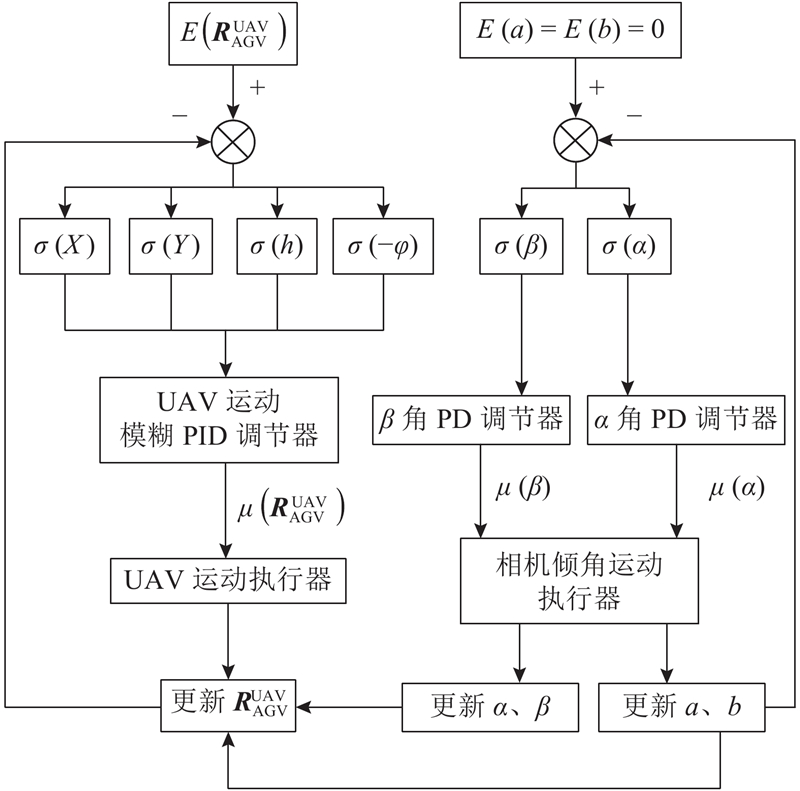

在跟踪过程中,被控对象有2个:无人机位姿和相机位姿. 两者是相互影响的,这增加了控制难度。为了解决该问题,对无人机位姿和相机位姿进行并行控制.

对无人机进行位姿控制,被控对象为位姿矩阵

图 7

3. 磁-视觉联合引导精准着陆

提出视觉和磁引导的联合引导方法. 当无人机收到降落指令后,通过视觉跟踪算法,调整自身位姿

参考系均选定为无人车,在不加说明的情况下,叙述的位置、角度均认为是相对于无人车的相对位置、角度.

3.1. 磁源和探磁元件布置

3.1.1. 磁源的设计

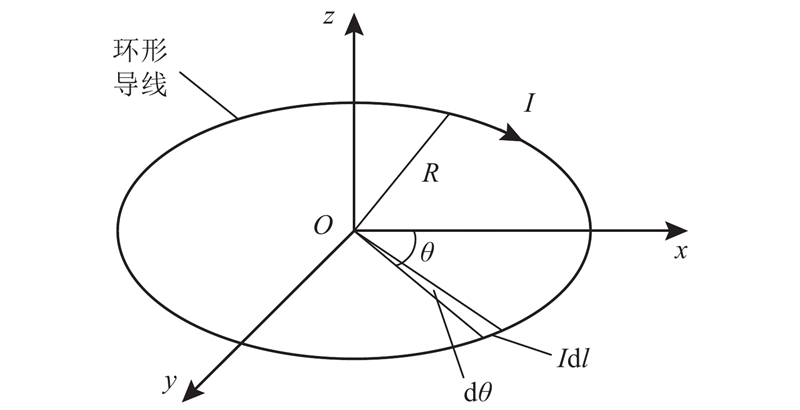

由于无人机在空中的姿态是不确定的,为了计算及布设的方便性,采用环形电流作为磁源,模型可以抽象为图8所示. 环形导线将铺设在无人车的起降平台上.

图 8

根据毕奥萨伐定律[14]可知,在该环形通电导线中,选取一小段电流元

式中:

在环形电流中,在

式中:

其中

3.1.2. 磁场检测及计算分析

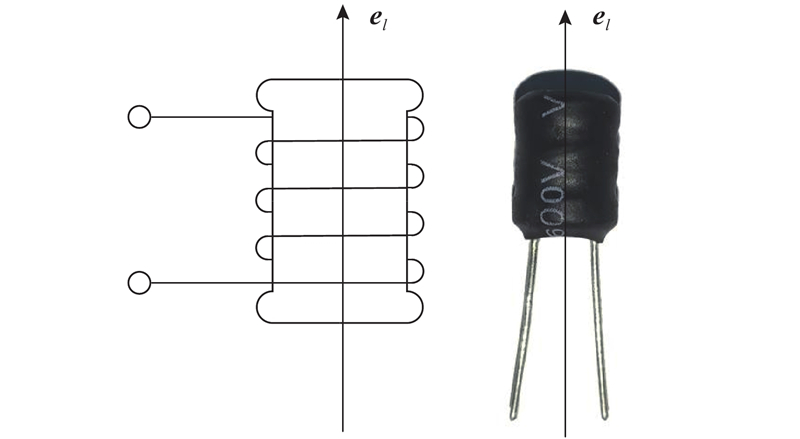

检测磁场须选取一种磁传感器,磁传感器较多使用霍尔传感器或工字电感[15]. 对于霍尔器件,当偏置电流

图 9

图 10

当电流发生跳变时,磁场跳变,电感产生感应电动势. 在

磁场变化率为

磁通量变化率为

式中:

式中:

在

式中:

根据式(16)可得感应电动势

式中:

其中

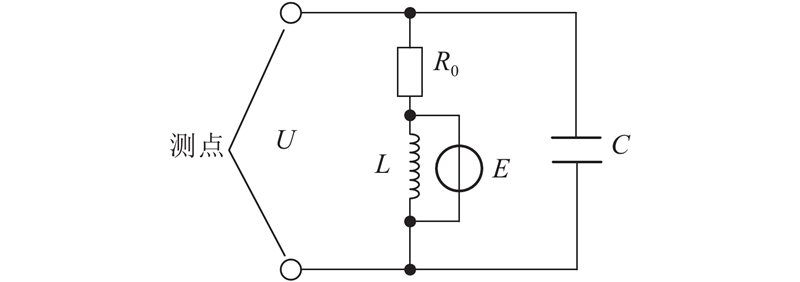

谐振电路原理图如图11所示.

图 11

计算感应电动势有效值. 记感应电动势有效值为

结合式(12),可得

分析式(20)可知,

计算谐振电路输出函数:设谐振电路电压(图11中测点处电压)为

根据并联谐振电路的特性可知,在一个周期内流经电感和电容的电流有效值相等. 记一个周期内流经电感

记电感内阻两端电压为

结合式(21)~(24),可得

对于式(25)的参数,在给定方波电流及周期、电感的物理参数、电感的空间坐标和朝向以及

3.1.3. 传感器的布置

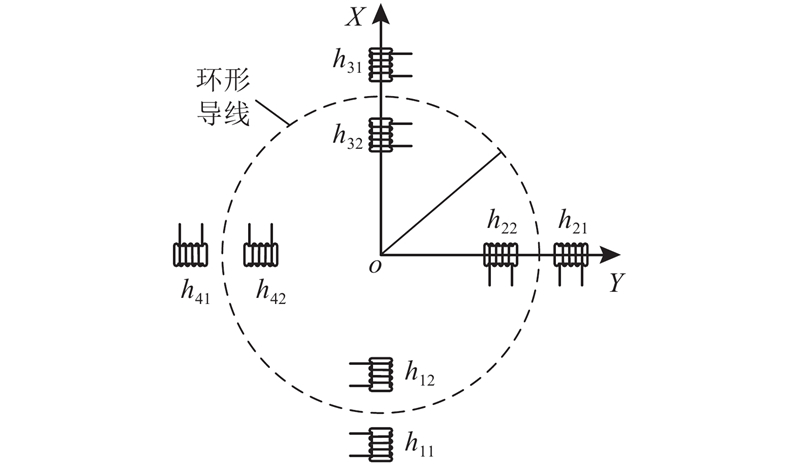

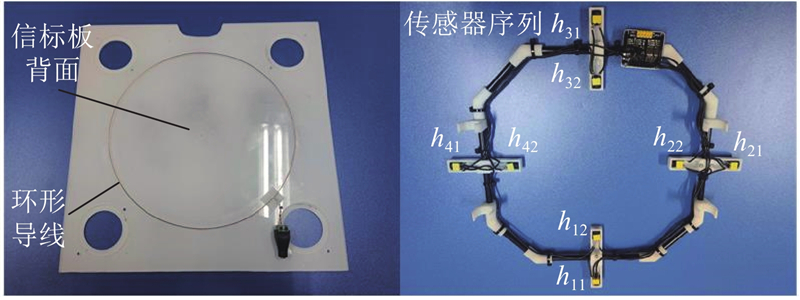

按照3.1.2节推导选取磁引导系统的各硬件参数后,将环形导线布置于无人车的信标板内,将电感安装在无人机上,探讨如何设置电感的数量和排布能够解算出无人机相对于无人车的位置. 按照图12的方式布置.

图 12

关于电感布置的推论如下:假设只有一个电感

图 13

图 14

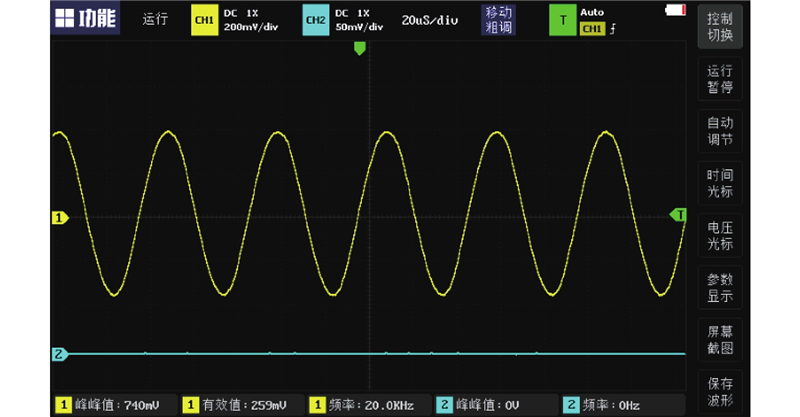

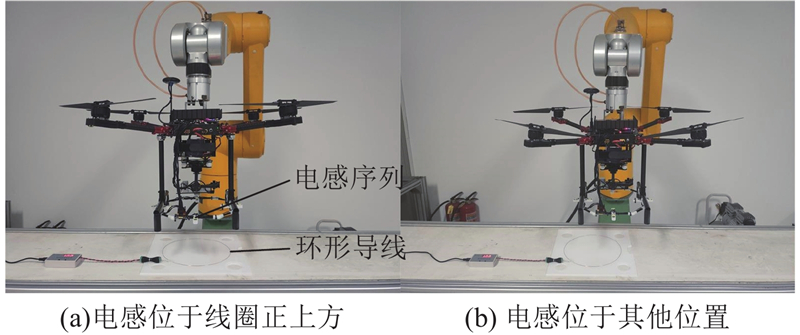

在环形线圈上通入200 mA的20 kHz的方波电流,搭建相应的探磁电路后,将电感置于线圈附近,用示波器测量电感两端电压,得到如图15所示的结果. 可以看出,通过LC谐振电路得到的信号值呈频率为20 kHz的标准正弦波;通过实验发现,当电感位于线圈的不同位置时,正弦波的振幅是不同的,结果符合式(25)推导的结果. 在对电感两端的电压进行放大滤波处理后,得到稳定的电压;通过数模转换器将电压转换成相应的数字量传到总控制系统中,可以对每组电感的电压进行分析和处理.

当无人机接近无人车时,电感将会检测到磁场信号,无人机在不同高度和位置下每个电感的信号值(电感两端的电压)是不同的. 通过8个电感的具体值,利用式(25)、(20)可以反推出无人机相对无人车的位置是可以实现的,但是十分复杂的,且考虑到硬件元器件的误差,对推算结果的取舍很困难. 通过3.1.1节推论证明可知,8个电感的信号值对应的无人机相对于无人车的位置是高度线性可分的,借助神经网络找出8个电感对应的相对位置关系.

图 15

3.1.4. 基于神经网络的相对位姿回归分析

若能找出8个电感信号值与无人机相对无人车的位置(即位姿矩阵

图 16

图 17

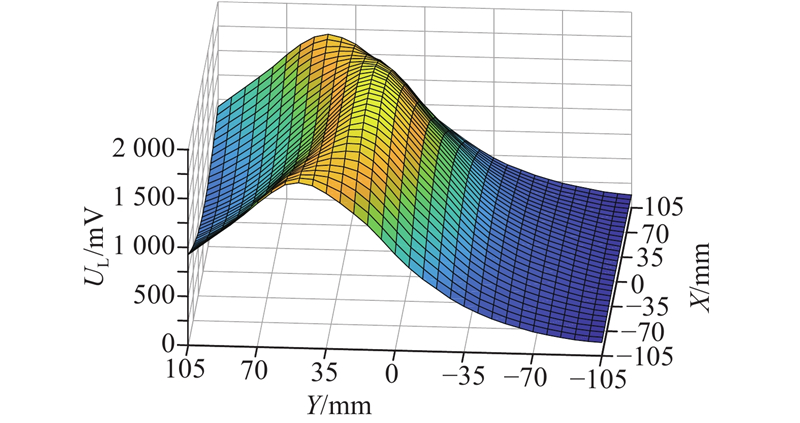

在数据采集完成后,取该距离线圈高度为225 mm的电感

图 18

观察电感信号值的波形发现,波形“山脊”处呈现一段圆弧,圆弧路径与线圈该处的导线重合;波形中“山脊”左侧呈“凹”函数,“山脊”右侧呈“凸”函数. 通过对线圈布置的分析可知,波形中“山脊”左侧图像对应电感位于线圈内侧,右侧图像位于线圈外侧. 对8个电感的信号值进行统计分析发现,每个电感的波形分布基本与图18类似. 根据这些特征,可以设计合理的神经网络结构,找出在不同高度下电感序列H的每个值所对应的无人机相对无人车的位置.

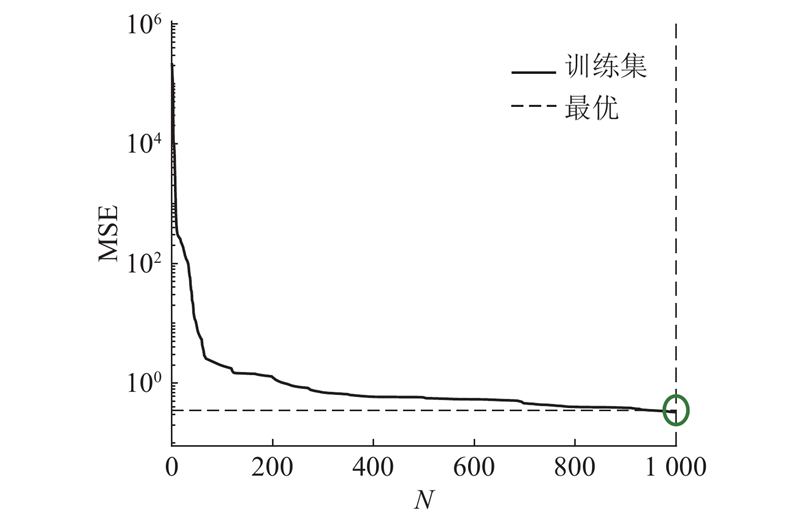

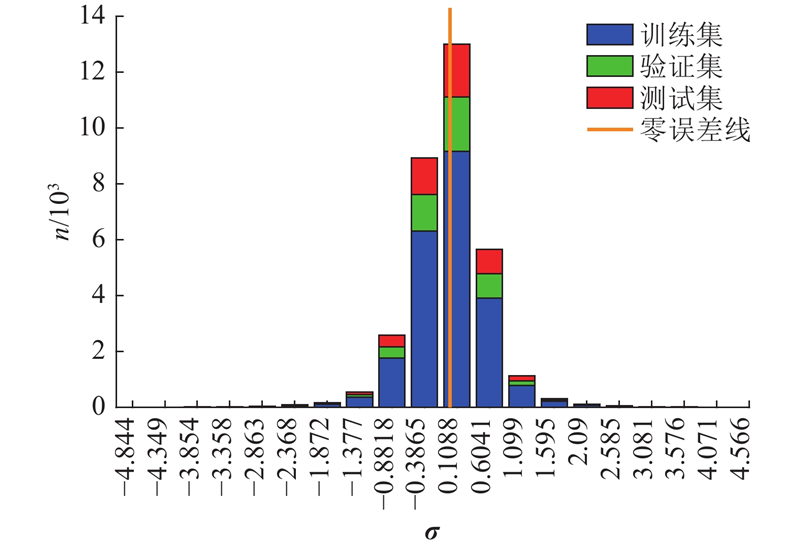

构建9输入、2输出的神经网络,训练得到电感序列H中所有电感信号值所蕴含的相对位置特征. 9输入包括电感序列H的8个电感信号值以及无人机与无人车上环形线圈的相对高度

图 19

图 20

3.2. 视觉-磁引导联合着陆

在磁引导过程中,需要视觉辅助,使得无人机和无人车的朝向保持一致. 在视觉跟踪过程中,无人机通过无人车上的视觉信标调整自身的朝向,虽然不太精确,但能够控制在一定误差范围内. 在进行着陆时,当无人机距离无人车很近时,信标已经超过相机成像区域,这时相机成像畸变大,定位精度低,可以切换到磁-视觉引导. 通过磁引导获取位姿矩阵

图 21

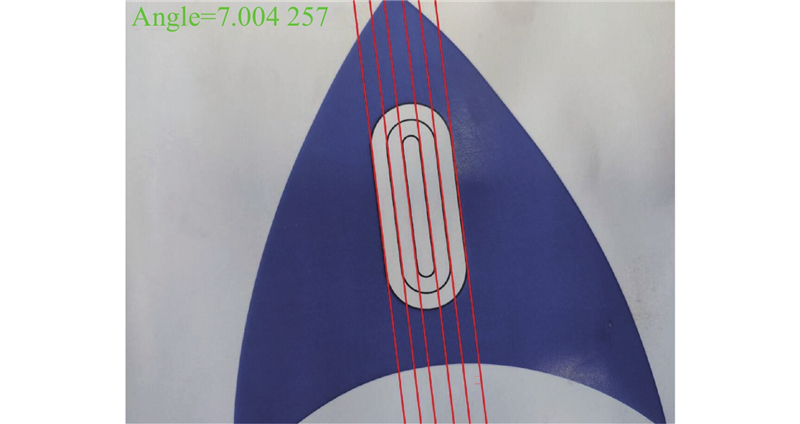

针对图21中检测到的线条特征,提出“星型窗格辅助分析法”,从线条特征中提取精确的无人机相对无人车的夹角,具体方法如下.

1)对检测到的6条线条(偶数),按对称关系分类成3对,如图21所示.

2)建立正方形星型窗格,如图22(a)所示. 窗格包含4条辅助线,窗格边长取成像画面宽度的1/3(根据成像可以进行调整).

图 22

图 22 星型窗格辅助分析法示意图

Fig.22 Schematic diagram of star window auxiliary analysis method

3)取任意一对线条进行分析,记辅助线1、2与线条对的交点为m、n、o、p,再连接线段mn和op的中点,即可得到一条方向线. 对其他两线条对作同样算法,得到2条方向线,取这3条方向线的均值作为最终方向线.

对于步骤3),当线条对与辅助线1、2无交点时,则选取辅助线3、4进行步骤3)相同的运算,示意图如图22(d)所示.

通过该方法解算得到,方向线能够很好地消除成像畸变、视角畸变带来的误差,解算图解如图22所示.

4)根据方向线,确定相对角度. 方向线上存在2个朝向. 在即将进入着陆程序前,记录当前时刻无人车相对于无人机的朝向PAU;进入着陆后,选取方向线2个朝向中与PAU成锐角的朝向,将该朝向作为无人车在无人机坐标系下新的方向向量

以下对星型窗格辅助分析法进行精度验证. 与验证磁引导精度的方式相同,将无人机固定在工业机械臂上(该机械臂腕关节转动精度为

表 1 星型窗格辅助分析法测试结果表

Tab.1

| A | A1 | A2 | A3 | Q |

| | | | | |

| | | | | |

| | | | | |

| | | | | |

| | | | | |

| | | | | |

| | | | | |

表1中,A为机械臂转过的角度,An为第n次解算的角度,Q为解算精度(误差范围). 分析Q的范围并综合机械臂本身的转角误差(

通过上述磁和视觉引导,可以获取在着陆时的无人机位姿矩阵. 将给定期望值与实际值比较,得到相应偏差,进行PID调节. 设定期望

4. 实验及结论

4.1. 实验平台的搭建

该实验主要用无人机和无人车,均为自研设备. 无人机为四旋翼布局,飞控系统是基于PIXHAWK开源飞控二次开发. 无人机搭载工控计算机,用于视觉算法以及神经网络算法运算. 无人机下方搭载自研设备-云台,用于调节相机倾角,还搭载部分传感器. 无人车搭载激光雷达、深度摄像头用于自身进行构建地图和路径规划,主要为无人机的跟踪实验提供基础. 无人车上设置内锥面的引导机构,允许无人机的着陆位置存在2.5 cm的误差,实验平台实物图如图23所示.

图 23

图 23 无人机和无人车实验平台实物图

Fig.23 Physical picture of VAV and AGV experimental platform

4.2. 视觉跟踪实验

跟踪实验分为以下2组. 第1组用于整体跟踪的效果验证,验证整体的位置跟踪精度和航向跟踪精度. 第2组主要验证“随动视觉跟踪”在无人车与无人机的相对速度过大时,能否解决跟踪的问题.

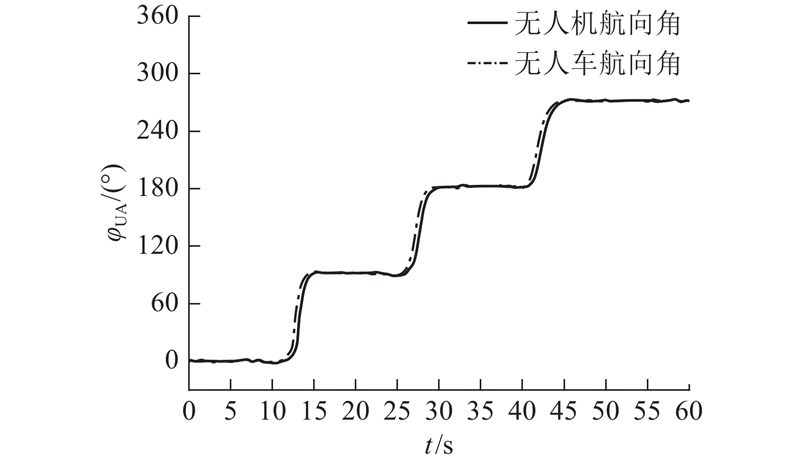

第1组实验. 使无人车以正方形路径匀速进行行进,无人机通过视觉跟踪无人车. 规定无人车的初始朝向航向角为0°,无人车沿逆时针转过的角度为正数,反之亦然. 无人车的航向角将经历从0°、90°、180°、270°的变化,在实际的实验过程中,通过机载采集及存储设备,采集两者的实时航向角并保存,变化曲线如图24所示.

图 24

图 24 矩形路线跟踪无人机航向角变化

Fig.24 Heading angle change of rectangular route following UAV

通过上述分析可知,在跟踪过程中,无人机对无人车的航向跟踪效果良好,直线行驶时稳态误差小于5°,航向跟踪的延后时间约为300 ms.

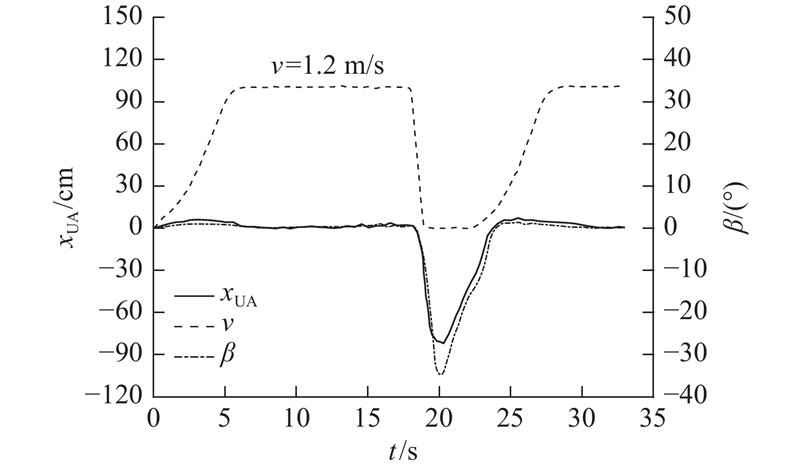

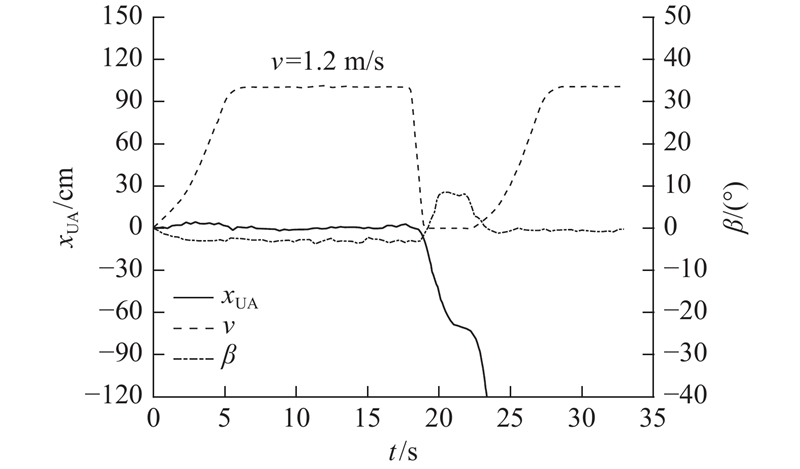

第2组实验. 这组实验主要验证“随动视觉跟踪”,用来解决在实际应用中无人车或无人机在正常工作过程中遇到障碍物,导致相对速度突然增大的情况. 具体的实验方法如下.

图 25

图 26

分析图25可知,无人车从零时刻开始加速,到6 s时达到最大速度,到18 s时突然刹车,此时两者的相对位置发生突变,“随动视觉跟踪”发挥作用,相机的俯仰角β立即调整(即向后方偏转,保证跟踪视野不被丢失);无人机根据相对位置误差调节飞行状态,相机相应地调节,逐步回到正常跟踪状态. 在该过程中,整个调节周期的耗时约为4 s,最大位置误差约为0.9 m,相机俯仰角变化最大约为27.5°.

该对比实验均是在限制无人机最大飞行速度下完成的,试验结果仅为了证明所提方法具备可行性,在实际应用中根据硬件参数的不同将获得不同的跟踪性能参数.

在2组实验中,无人机对视觉信标的识别及相对位姿解算结果如图27所示. 图中,X、Y为相对位置坐标;Angle为相对夹角;Use time为处理一帧图像消耗的时间,约为5 ms/帧.

跟踪实验的实地测试如图28所示.

图 27

图 28

4.3. 着陆实验

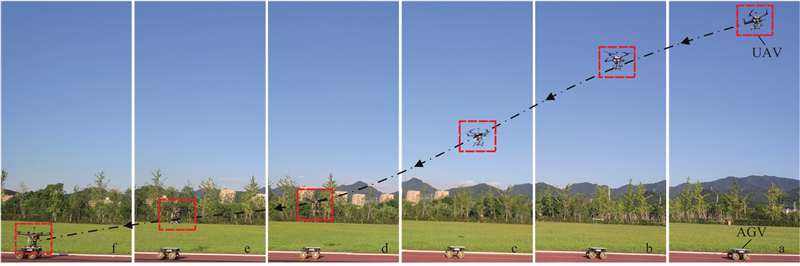

在正常跟踪过程中,给无人机发送着陆指令,观察无人机着陆是否成功及着陆过程的稳定性. 在实验中,对着陆过程拍摄视频,截取几个关键帧,如图29所示.

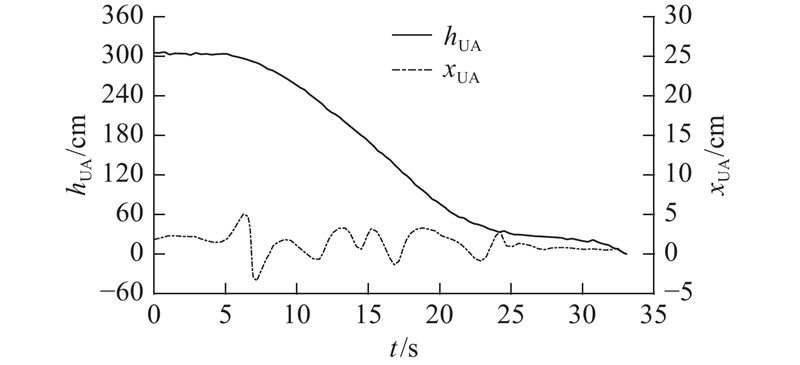

图 29

从跟踪到着陆过程中,实时采集无人机的相对高度和无人机与无人车之间的相对位置误差. 在进入磁引导之前,由视觉获取位置误差;进入磁引导后,由磁获取位置误差. 绘制的位姿变化图如图30所示. 当无人机相对高度低于30 cm时,进入磁引导环节;此时在高精度磁引导下,相对位置误差逐步减小并稳定,当相对位置误差稳定到小于2 cm时完成着陆.

图 30

图 30 磁引导下着陆过程位置变化

Fig.30 Attitude change during landing under magnetic guidance

为了证明着陆环节磁引导具备优越性,在相同环境下完成一组关闭磁引导的对比实验. 这时磁引导只作为测量无人机的相对位置误差,不参与控制环节的位置PID调节,记录实验过程数据,如图31所示. 可以发现,当无人机在30 cm的相对高度时,由于视觉定位的测量精度不高,始终不能稳定保持相对位置误差小于2 cm,达不到着陆要求,无法着陆.

图 31

图 31 无磁引导下着陆过程位置变化

Fig.31 Attitude changes during landing under non magnetic guidance

经过多次实验可知,在有磁引导下,不论是在无人车静止或者运动状态下,每次无人机在接收到着陆指令后均能够稳定着陆在无人车上,验证了在着陆过程中利用磁引导联合视觉辅助确定航向的方法的正确性和合理性.

5. 结 语

提出“随动视觉跟踪”及磁联合视觉引导的方式完成精准着陆,并提出相应的控制策略,通过实验验证了所提方法的正确性和可行性. 在跟踪过程中,无人机对视觉信标的识别速度可达5 ms/帧,该方法为实现超高速视觉跟踪提供了可能性;当无人机和被跟踪对象的相对速度(位置)发生突变时,“随动视觉跟踪”能够发挥良好作用,实时调整相机倾角,防止目标离开跟踪视野. 在着陆过程中,通过磁引导可以实现位置测量精度小于5 mm,利用“星型窗格辅助分析法”的视觉定位方法可以实现小于0.5°的角度测量精度. 在获取该精度下的位姿数据后,利用运动控制算法可以实现小于2 cm的着陆精度.

参考文献

无人机演变与发展研究综述

[J].

Review of UAV evolution and development

[J].

Robust back-stepping control based on integral sliding modes for tracking of quadrotors

[J].

Autonomous landing of a quadrotor on a moving platform

[J].

基于扰动观测器的多旋翼无人机机载云台模糊自适应跟踪控制

[J].

Fuzzy self-adjusting tracking control based on disturbance observer for airborne platform mounted on multi-rotor unmanned aerial vehicle

[J].

Hover Camera王孟秋: 超能创业者的“新”与“旧”

[J].

Hover Camera WANG Meng-qiu: "new" and "old" of super entrepreneurs

[J].

基于ADRC迭代学习控制的四旋翼无人机姿态控制

[J].

UAV attitude active disturbance rejection control based on iterative learning control

[J].

High-speed vision extraction based on the CamShift algorithm

[J].

基于针孔模型的双目视觉标定误差仿真分析

[J].DOI:10.3969/j.issn.1671-637X.2009.12.018 [本文引用: 1]

Calibration error simulating analysis of binocular vision based on pinhole camera model

[J].DOI:10.3969/j.issn.1671-637X.2009.12.018 [本文引用: 1]

UAV state estimation using adaptive complementary filters

[J].

极低频电磁辐射检测仪的传感器选择分析

[J].

Sensor selection and analysis of extremely-low-frequency electromagnetic radiation detector

[J].

并联谐振变换器的电路特性分析

[J].

Analysis of circuit characteristics of parallel resonant converter

[J].

基于BP神经网络算法的对流层湿延迟计算

[J].

Calculation of tropospheric wet delay based on BP neural network algorithm

[J].

The Canny edge detector revisited

[J].