刀具工作状态的精准评估对保障切削性能、提高生产效率有重要作用[3]. 刀具磨损状态评价常用的测量方法分为2个类别:直接测量和间接测量[4]. 直接测量法是指采用光学设备和机器视觉技术直接测量刀具,通过检测刀具几何尺寸或表面纹理的变化来判断刀具当前状态[5]. 传统计算机视觉作为常用的直接测量方法,主要依赖于手工设计的特征提取和传统的机器学习分类器进行图像处理和对象识别[6-7]. 随着识别任务的日益复杂化,传统计算机视觉方法难以满足实时性要求[8]. 与传统方法相比,深度学习引入端到端学习的概念,能够自动从大量训练样本中学习特征,数据处理和特征识别能力得到提升[9-10]. Wang等[11]利用深度学习网络Faster R-CNN模型实现磨损定位和机制识别. 间接测量法主要是通过分析与刀具磨损相关的在线测量信号(切削力、声发射、振动、主轴电流和声压等)来评估刀具磨损状态[12]. 这类方法比直接测量方法的成本低,对实际加工的适应性更强. 振动信号是刀具磨损评价常用的传感手段. 史丽晨等[13]提出基于振动信号的刀具磨损预测方法,通过DRSN-BiLSTM模型显著提高了预测精度. 在信号处理中,预测精度受噪声影响,为了提高有用信息的特征提取,研究学者尝试将信号特征转换为二维图像. 滕瑞等[14]提出基于格拉姆角场编码技术(Gramian angular field,GAF)和卷积神经网络的刀具磨损值在线监测方法,有效提高了监测精度和泛化性能.

在实际应用中,单一数据源难以全面捕捉刀具磨损的复杂特征. 图像数据能够直接反映刀具的磨损形态,但在实际加工过程中难以连续采集. 为了获得清晰、准确的磨损特征,图像拍摄通常在暂停加工或减速状态下进行,导致预测过程不连续和信息缺失,从而影响磨损评估的实时性和精确性[15]. 间接测量法能够在加工过程中提供与刀具磨损相关的动态交互信息,捕捉磨损状态的连续变化. 缺点是须预先建立信号与磨损状态之间的映射关系,且灵敏度易受到传递路径和测量点位置的影响[16]. 本研究1)提出融合直接测量和间接测量的刀具磨损评价方法. 在信号的连续监测过程中,结合历史时刻采集的刀具图像数据,以弥补单一数据源在特征捕捉上的局限性. 信号的动态监测提供连续的磨损变化信息,图像数据提供形态特征,两者结合使模型表征磨损状态的能力得到提升. 融合每次加工结束时更新的刀具图像数据,对信号监测结果进行校准,实现“准实时”的磨损状态评价. 2)构建多尺度深度融合网络模型(multi-scale deep integration, MSDI)以提升刀具磨损评估方法的评估准确性. 利用马尔可夫转移场(Markov transition field, MTF)技术,将一维信号转化为与刀具图像维度相匹配的高维数据,并与刀具图像融合. 通过多尺度深度融合网络模型对图像和信号特征进行深度结合,提升刀具磨损状态的识别精度和泛化能力.

1. 多源异构特征融合策略

1.1. 声音信号数据的高维映射

时间序列数据通过MTF转换为二维图像,以捕捉时间序列中的模式和结构特征. MTF的状态转移矩阵描述时间序列中的状态转换,马尔可夫性质(未来状态仅依赖当前状态)有效揭示时间序列的内在规律. MTF还能保留时间外的信息(不依赖时间先后顺序,但对理解序列特征至关重要的信息),在时间序列分析中有广泛应用[17]. MTF的二维化处理不仅丰富了时间序列的特征表达,还能够有效保留信号在时间维度上的状态转移信息,这些信息与其他图像数据深度融合增强了模型在多源数据融合中的特征学习能力.

为了准确提取信号特征,对原始信号进行归一化处理:

归一化后的信号

式中:

式中:

1.2. 特征融合

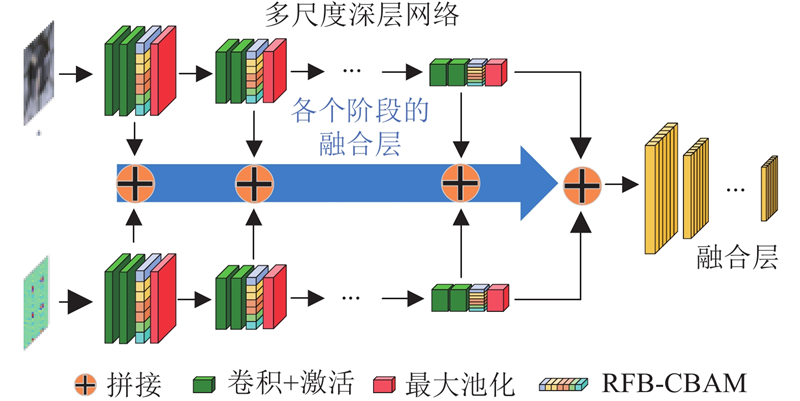

为了解决不同维度(一维信号与二维刀具磨损图像)传感信号特征提取与融合问题,本研究构建如图1所示的MSDI. MSDI采用二维卷积神经网络(2D CNN)处理数据,通过多阶段融合声信号和刀具磨损图片的特征实现深层次的网络融合. MSDI特征提取和融合的关键步骤如下. 1)输入数据通过卷积层

图 1

图 1 多尺度深度融合模型的网络结构

Fig.1 Network structure of multi-scale deep integration model

2)

3)将

式中:M为对声信号特征和图像特征在通道维度上进行拼接(concat)操作. 4)通过池化层

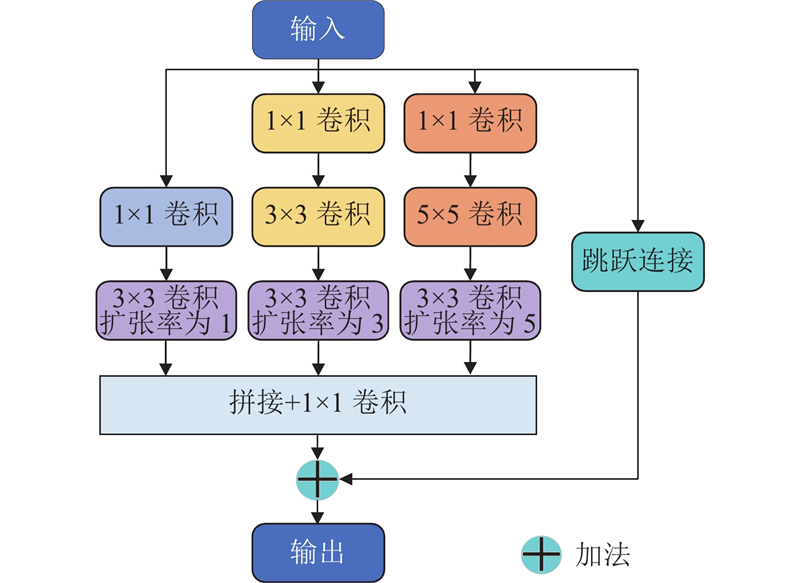

1.3. 感受野块

RFB通过扩展感受野(卷积核感知并提取特征的图像区域大小)增强捕获全局和局部信息的能力,在图像处理中应用广泛. RFB网络借鉴人眼在不同视觉场景下感受野的动态变化,采用不同扩张率的扩张卷积,扩展卷积核的感受范围,减少了最大池化操作导致的特征信息损失. 在如图2所示的RFB网络结构中,1)输入的级联特征图通过1×1卷积进行特征降维,以降低计算复杂度并减少冗余信息;2)网络通过不同尺寸的卷积核(如1×1和3×3非对称卷积)进行特征提取,增强特征表示;3)具有不同扩张率的稀疏卷积模拟多尺度感受野,捕获来自不同范围的特征,丰富特征表达的维度;4)特征图的拼接实现多尺度局部特征的融合.

图 2

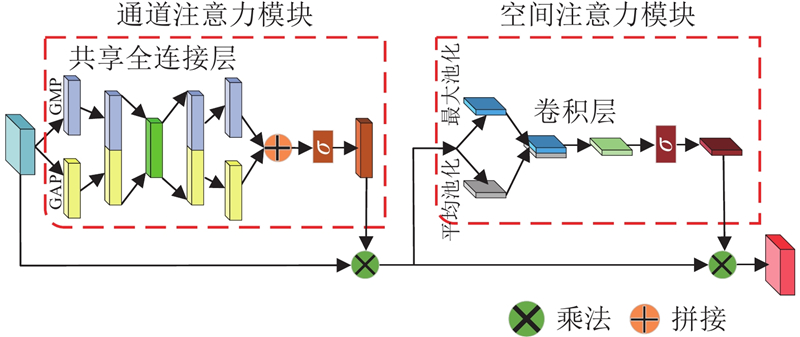

1.4. 卷积块注意力模块

为了提升卷积神经网络在关键区域特征提取中的自适应能力,引入如图3所示的CBAM,它由通道注意力模块(channel attention module, CAM)和空间注意力模块(spatial attention module, SAM)组成. 作为增强特征提取的模块,CBAM自适应地为特征图的每个通道和空间位置赋予权重,关注任务相关的关键信息,提升网络在不同任务中的表现. CAM通过全局平均池化(global average pooling,GAP)和全局最大池化(global max pooling,GMP)生成通道描述向量,再将描述向量输入共享的多层感知机MLP,由激活函数(如ReLU)进行非线性变换,由sigmoid函数生成通道注意力权重,用于对原始特征图的各通道进行加权:

图 3

式中:

式中:

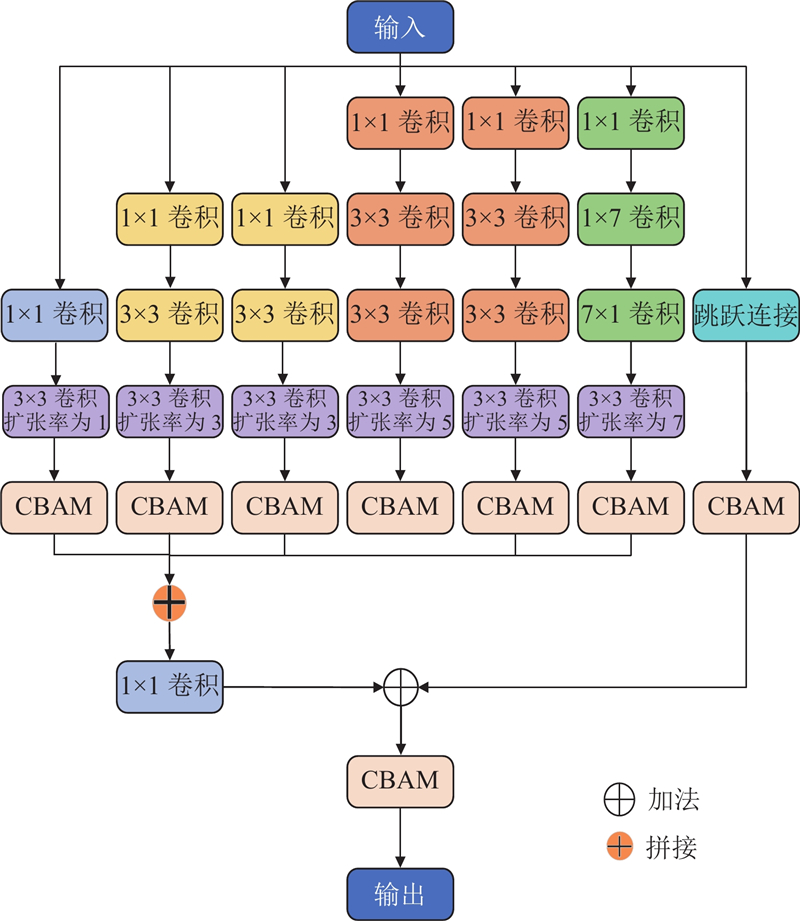

1.5. 感受野-卷积块注意力模块

为了提升模型对刀具图像和信号特征的提取和感知能力,本研究对RFB的网络结构进行改进. 如图4所示,将RFB的支路从3条扩展到6条,每条支路具有不同的感受野,以便捕捉输入特征图的多样化信息. 改进后的RFB在支路中引入1×1、3×3、5×5、7×1和1×7卷积核的组合,分别用于提取局部特征、不同尺度特征以及水平和垂直方向上的特征. 为了优化模型的参数量和计算成本,使用2个3×3卷积核代替5×5卷积核,使参数数量由25降至18个,计算量降低约28%;将7×7卷积核分解为7×1和1×7卷积核,权重参数数量降至14个,计算量降低约71%. 通过支路的并行设计,模型能够捕捉不同尺度下的特征,并在通道维度上进行拼接,实现多尺度特征的有效融合. 在刀具磨损图像和通过MTF处理后的声信号特征提取过程中,微小的纹理、形状、边缘信息以及时间序列中的状态变化对准确评估刀具磨损程度至关重要. 为了增强模型对这些关键特征的提取能力,在每条网络支路的末端引入CBAM,通过自适应调整特征图的通道和空间权重,使网络聚焦于关键特征区域.

图 4

图 4 改进感受野-卷积块注意力模块的网络结构

Fig.4 Network structure of improved receptive field-convolutional block attention module

2. 基于多尺度深度融合网络的刀具磨损状态评估模型

本研究针对动态铣削过程中刀具磨损鲁棒监测问题提出的刀具磨损模型分为3个部分:信号采集、多尺度特征提取与融合网络层构建、刀具磨损状态的识别与预测,具体步骤如下. 1)采集加工过程中的声信号和刀具图像数据. 使用MTF将声音信号转换为二维图像,设置图像分辨率为224像素×224像素. 2)通过多尺度深层次融合网络对步骤1)获取的多源数据进行特征提取. 3)融合步骤2)中得到的各阶段提取的特征. 4)通过RFB-CBAM网络深入挖掘特征,并将这些特征传递到下一层. RFB-CBAM网络通过不同尺寸的卷积核提取多尺度局部特征,利用CBAM增强特征的表达能力,进行不同卷积分支的特征图拼接,以实现多特征的融合. 5)构建全连接回归网络,对特征与刀具磨损值进行映射并预测刀具磨损值.

3. 铣削实验研究

3.1. 实验装置

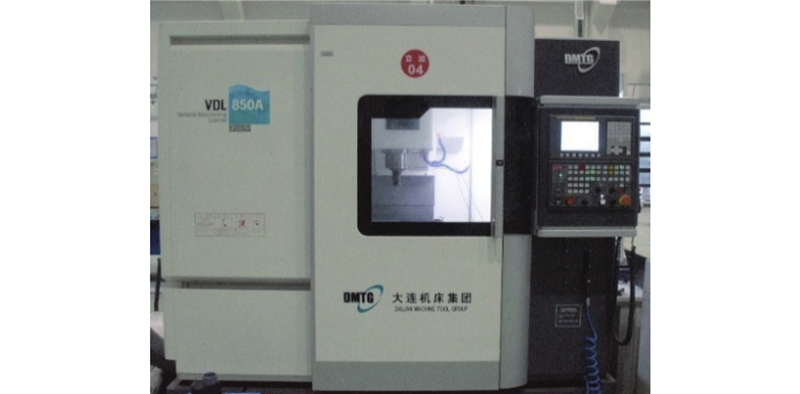

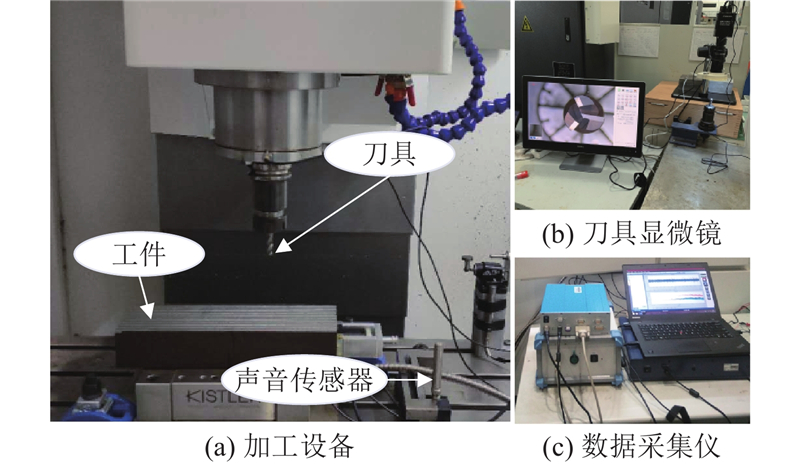

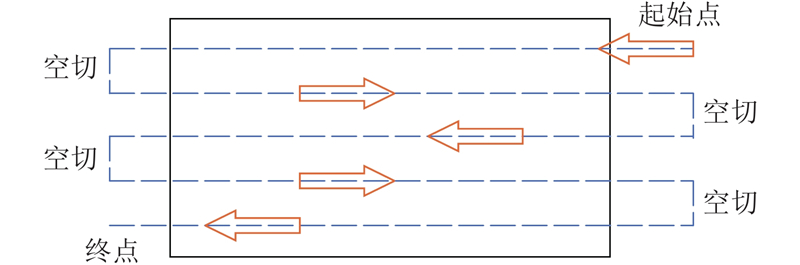

开展铣削实验,验证所提方法的有效性. 实验设备为三轴VDL850A立式加工中心(由中国大连机床集团生产),如图5所示. 实验用加工刀具:直径为10 mm、螺旋角为45°的三齿无涂层钨钢端铣刀. 实验工件选用45#钢,尺寸为300 mm×100 mm×80 mm. 如图6所示,使用声音传感器捕捉刀具与工件接触时产生的声音信号;数据采集系统选用亿恒ECON Avant(MI-7016)采集系统,采样频率设为12 kHz. 设置4组实验,铣削参数如表1所示,其中n为主轴转速,ap为切削深度,vf为进给速度,nm为铣削次数. 工件铣削以层为单位进行,每层工件表面铣削5条长槽,铣削路径如图7所示,在完成每层表面铣削加工后使用GP-300C刀具显微镜离线测量立铣刀的磨损值. 每组实验的刀具均从全新状态开始逐层铣削(间歇性停机并取下刀柄,测量刀具磨损状态),其中3组实验刀具铣削10层后停止实验,1组实验刀具铣削11层后停止实验.

图 5

图 6

图 7

表 1 铣削参数设置

Tab.1

| 组别 | n/(r·min−1) | ap/mm | vf/(mm·min−1) | nm |

| 1 | 0.6 | 500 | 10 | |

| 2 | 0.5 | 500 | 10 | |

| 3 | 0.5 | 400 | 11 | |

| 4 | 0.6 | 400 | 10 |

3.2. 数据集构建和网络训练

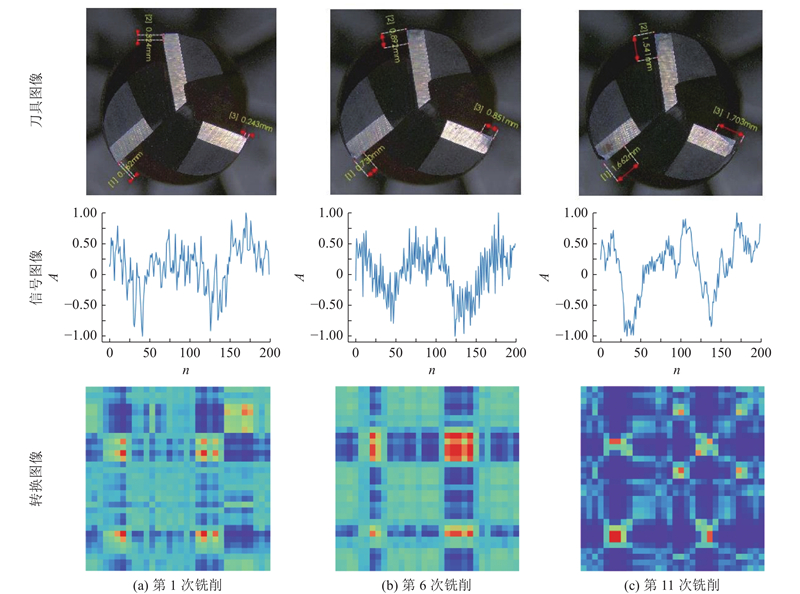

收集完成铣削实验的刀具磨损图像共41张. 如图8所示为第3组刀具在完成第1、第6、和第11次铣削工件表面后的磨损情况. 为了准确评估刀具磨损情况,选择三齿中磨损面积的最大值作为刀具磨损的评价指标. 为了降低计算复杂度,对原始图像(分辨率为

图 8

在模型训练阶段,为了防止欠拟合,选取4把刀具中第3条槽的加工信号数据进行训练和测试. 实验数据包含

3.3. 模型评估

在回归模型的性能评估中,平均绝对误差MAE、均方根误差RMSE和决定系数R2用于衡量模型预测值与实际值之间的差异,评估模型的预测精度与拟合效果.

式中:

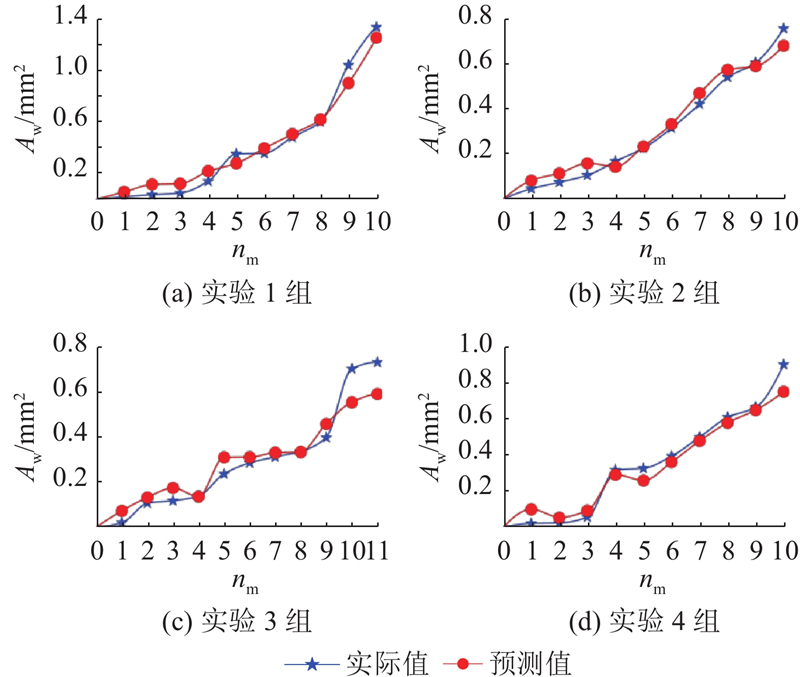

图 9

图 9 所提刀具磨损状态评估模型在4组铣削实验中的测试结果

Fig.9 Test results of proposed tool wear state evaluation model in four milling experiments

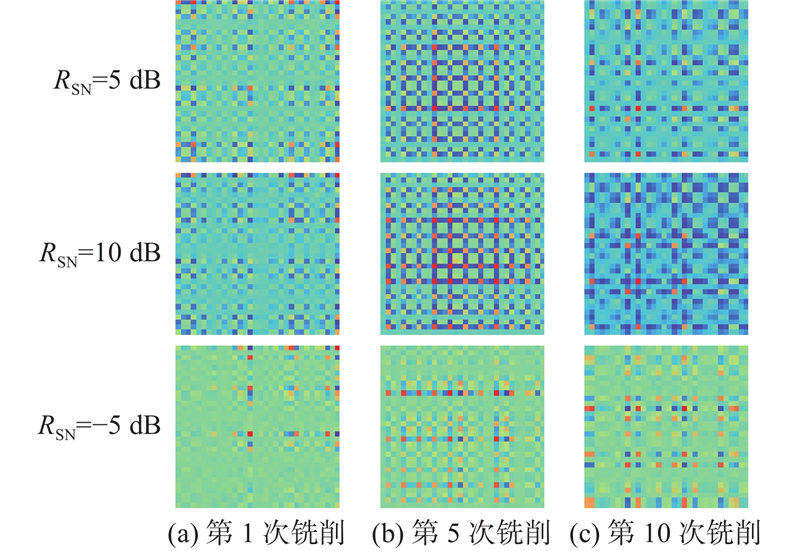

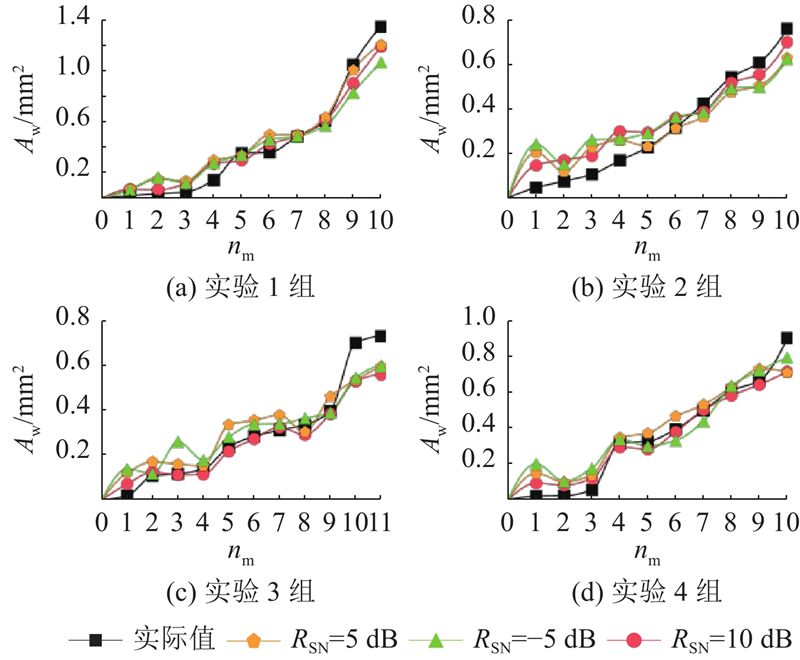

为了验证所提方法在噪声环境下对声音信号转换的适应性,设置信噪比RSN=−5、5、10 dB进行噪声模拟实验. 如图10所示为第3组实验刀具的原始信号及其在不同信噪比条件下的变化情况,对应的MTF转换图像如图11所示. 噪声模拟实验结果如图12所示. 可以看出,所提方法在4组铣削实验中均具有良好的预测性能. 在高信噪比(RSN=10 dB)条件下,各铣削参数下的预测曲线与实际磨损曲线吻合度较高,能够准确捕捉磨损趋势. 随着信噪比降低(RSN=−5、5 dB),噪声水平增大,预测曲线波动性略有提升,但整体趋势依然匹配实际值. 在图12(a)和图12(d)中,即便在RSN=−5 dB的条件下,预测结果依然能够反映磨损趋势. 由图12(b)和图12(c)可以看出,在较低信噪比条件下,模型能够稳定预测磨损状态,误差控制被在合理范围内. 尽管噪声的增加在一定程度上影响了预测精度,但所提方法在4组铣削实验和不同信噪比条件下均保持了较高的预测准确性,展示出在噪声干扰环境下的鲁棒性和适应性.

图 10

图 10 刀具在不同信噪比条件下的声信号图像

Fig.10 Acoustic signal images of tool under different signal-to-noise ratios

图 11

图 11 声信号的马尔可夫转移场转移图像

Fig.11 Markov transition field transformed images of acoustic signals

图 12

图 12 所提刀具磨损状态评估模型在4组铣削实验中的测试结果(不同信噪比条件下)

Fig.12 Test results of proposed tool wear state evaluation model in four milling experiments (under different signal-to-noise ratios)

4. 模型对比实验与性能分析

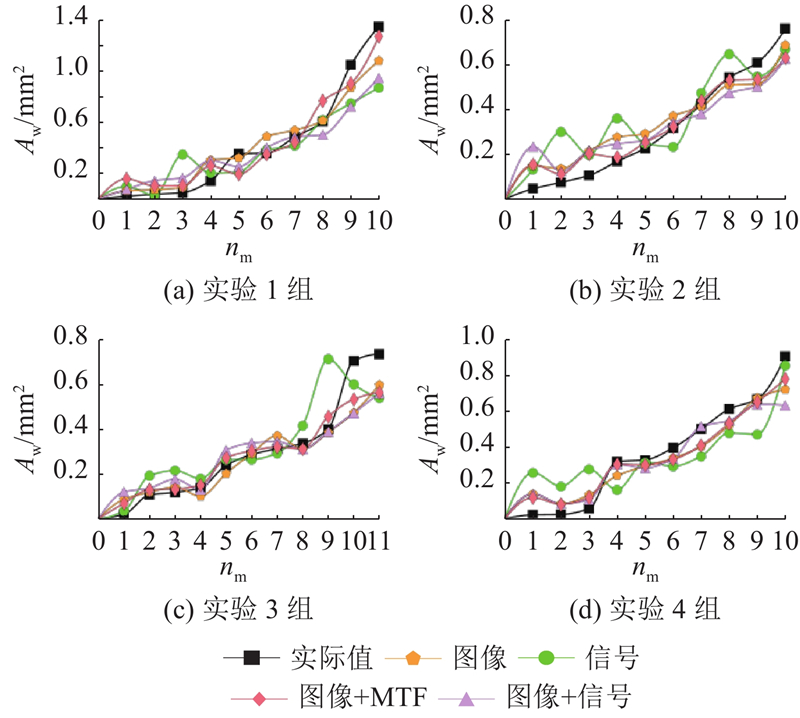

4.1. 不同组合方式输入对比

为了验证所提模型的性能,对单一传感信号及其组合进行对比分析. 由于本研究模型主要用于二维图像,不适用于一维信号,为了保证实验结果的准确性,对比实验均在以VGG16为主干的深层次融合网络模型中进行. 如图13所示为不同输入方式在刀具磨损预测任务中的实验结果,各输入方式在预测表现上存在差异,单一信号输入的预测表现波动较大. 在图13(c)和图13(d)中,信号输入曲线波动幅度较大. 尽管信号输入在整体趋势上能反映磨损变化,但在局部细节上误差较大,尤其是在图13(c)第9次铣削时,预测结果与实际值偏离较明显. 单一图像输入时,预测曲线与实际磨损值的变化趋势较为一致. 图像输入能够较好地捕捉刀具磨损的形态特征,图13(a)和图13(d)表明,图像输入的预测效果优于信号输入. 图像难以持续跟踪磨损状态,导致在磨损变化较快的区间(如实验2组的第5次铣削后),预测曲线呈现出阶梯式变化,反映了图像输入在时序特征捕捉上的局限性. 从实验结果看,简单的联合输入未能显著提升模型的预测效果. 在图13(a)和图13(d)中,这种联合输入的预测曲线波动较大,与实际值之间的偏差依然存在. 这表明,模型在特征融合过程中未能充分学习并利用信号与图像之间的复杂关联性,导致融合效果不理想. 当采用MTF特征后的信号与图像融合输入时,模型表现得到提升. MTF转换后的输入能够捕捉磨损变化,并显著降低预测误差. 结合如表2所示的量化指标,图13中不同输入方式的可视化差异进一步得到验证:单一信号输入的R2(

图 13

图 13 所提刀具磨损状态评估模型在4组铣削实验中的测试结果(不同输入方式条件下)

Fig.13 Test results of proposed tool wear state evaluation model in four milling experiments (under different inputs)

表 2 所提刀具磨损状态评估模型在4组铣削实验中的评估指标(不同输入方式条件下)

Tab.2

| 输入 | 实验1组 | 实验2组 | 实验3组 | 实验4组 | |||||||||||

| MAE | RMSE | R2 | MAE | RMSE | R2 | MAE | RMSE | R2 | MAE | RMSE | R2 | ||||

| 信号 | |||||||||||||||

| 图像 | |||||||||||||||

| 图像+信号 | |||||||||||||||

| 图像+MTF | |||||||||||||||

4.2. 不同网络对比

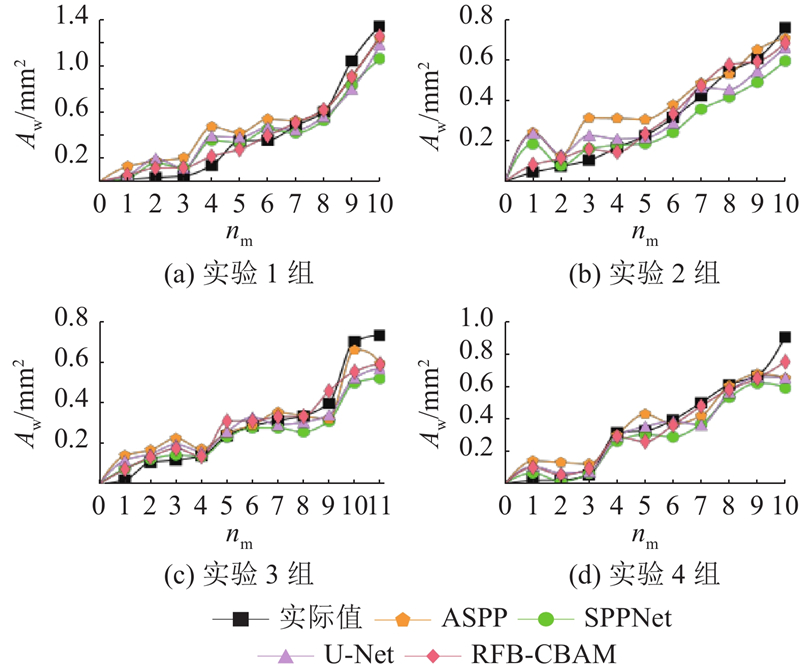

选取SPPNet、ASPP和U-Net等经典模型与RFB-CBAM进行性能对比分析,设置输入数据均为刀具图像与MTF转换后的声信号图像. 如图14和表3所示,不同模型在预测精度和稳定性方面存在差异. 整体来看,SPPNet和ASPP的预测效果相对较差,SPPNet在4组实验中MAE为

图 14

图 14 不同评估模型在4组铣削实验中的测试结果

Fig.14 Test results of different evaluation models in four milling experiments

表 3 不同评估模型在4组铣削实验中的评估指标

Tab.3

| 模型 | 实验1组 | 实验2组 | 实验3组 | 实验4组 | |||||||||||

| MAE | RMSE | R2 | MAE | RMSE | R2 | MAE | RMSE | R2 | MAE | RMSE | R2 | ||||

| SPPNet | |||||||||||||||

| ASPP | |||||||||||||||

| U-Net | |||||||||||||||

4.3. 不同信号转换方式对比

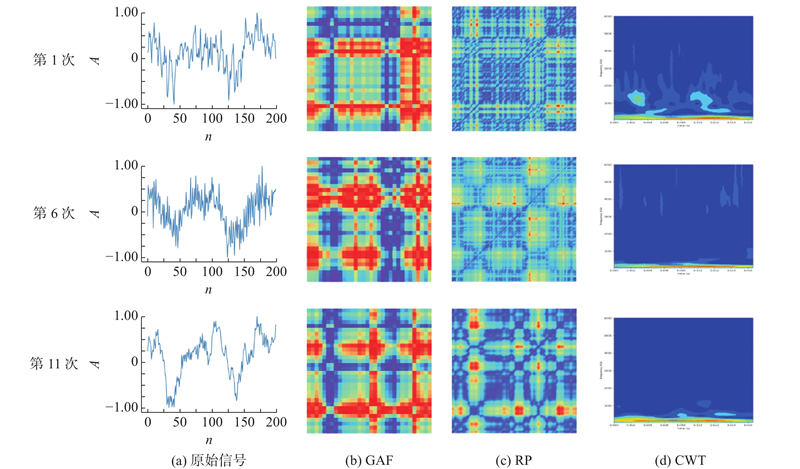

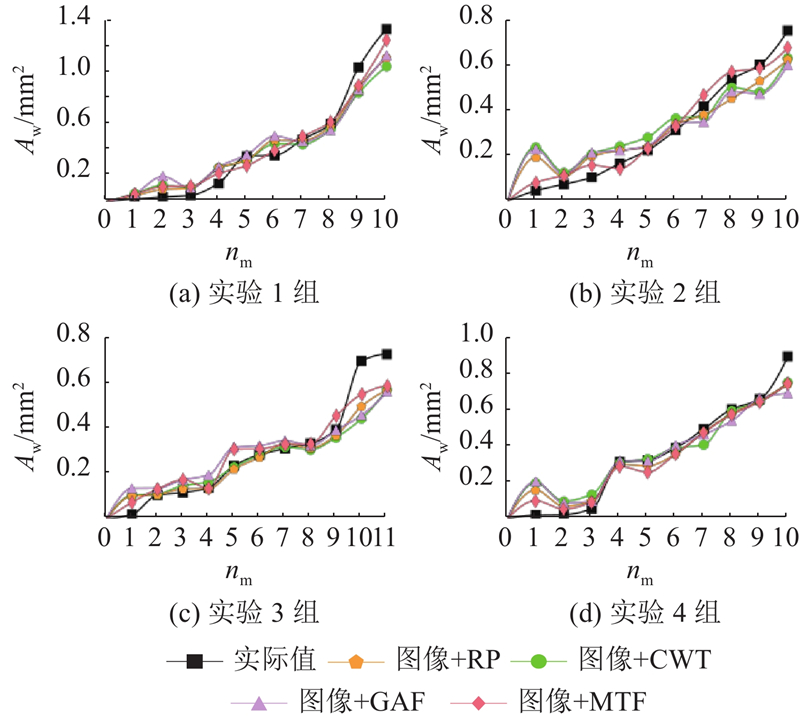

对MTF与GAF、递归图(recurrence plot, RP)和连续小波变换(continuous wavelet transform,CWT)等信号转换方式进行性能分析对比. 如图15所示为第3组实验刀具在第1次、第6次和第11次实验中GAF、RP和CWT的时间序列和图像. 从如图16所示的预测曲线能直观看到不同转换方法的拟合差异:GAF和CWT 在磨损变化剧烈的区间(如图16 (b)和图16 (c))预测曲线波动较大,即便是在图16(a)和图16(d)所示的整体及局部稳定变化区间,二者曲线也存在小幅波动,拟合一致性较弱. RP的预测曲线在图16(a)和图16(d)中整体平滑,但在局部变化迅速的时刻略显滞后,仅在磨损剧烈变化区间的表现比GAF、CWT更平稳. MTF的预测曲线在图16中保持平滑,且始终贴近实际磨损值,无明显波动或滞后. 结合如表4所示的量化指标来看,这种可视化差异进一步得到验证:GAF和CWT的R2均低于MTF,MAE与RMSE也相对更高;RP的MAE和RMSE相对较低,R2接近MTF,说明RP能较好揭示信号中的动态结构,但仍不及 MTF. 总体上,MTF在表4中的R2均超过0.9,且RMSE最低,结合图16的曲线表现可知,MTF能够有效捕捉时间序列中的状态变化,并通过与图像特征的深度融合使模型的时序特征学习能力提升.

图 15

图 15 声信号图像和3种信号转换方式转换的图像

Fig.15 Acoustic signal images and images transformed by three signal conversion methods

图 16

图 16 不同信号转换方式组成模型在4种铣削实验中的测试结果

Fig.16 Test results of models composed of different signal conversion methods in four milling experiments

表 4 不同信号转换方式组成模型在4种铣削实验中的评估指标

Tab.4

| 模型 | 实验1组 | 实验2组 | 实验3组 | 实验4组 | |||||||||||

| MAE | RMSE | R2 | MAE | RMSE | R2 | MAE | RMSE | R2 | MAE | RMSE | R2 | ||||

| 图像+CWT | |||||||||||||||

| 图像+RP | |||||||||||||||

| 图像+GAF | |||||||||||||||

5. 结 语

在制造过程中,可靠的刀具磨损监测是降低成本并提高生产效率的关键. 为了实现更准确的刀具磨损状态识别,本研究提出多源异构特征融合方法. 该方法以采集的原始信号和刀具磨损图像为输入,能够准确预测铣刀的磨损情况. 1)通过将一维信号转换为二维数据矩阵,利用MTF技术增强信号的时间维度信息,提升了训练数据的特征表示能力. 相较于传统的一维CNN模型,基于该方法训练的二维CNN模型表现出更好的预测性能. 2)提出刀具磨损图像识别的深度学习模型. 该模型基于RFB结构,通过增加多尺度的卷积核和引入CBAM,提取和关注刀具磨损图像中的重要特征. 由于实验时间和条件的限制,图像样本数量相对不足,本研究未在复杂动态环境(如切削液、切屑、光照变化等)以及突发情况(如崩刃)下进行验证. 未来研究将扩展实验范围,深入探讨方法在不同刀具磨损阶段和复杂工况下的表现.

参考文献

基于VMD-SSA-LSTM考虑刀具磨损的数控铣床切削功率预测模型研究

[J].

Research on CNC milling machine cutting power prediction model considering tool wear based on VMD-SSA-LSTM

[J].

Artificial intelligence systems for tool condition monitoring in machining: analysis and critical review

[J].DOI:10.1007/s10845-022-01923-2 [本文引用: 1]

递归特征消除与极端随机树在铣刀磨损监测中的研究

[J].

Application research on recursive feature elimination and extra trees in milling cutter wear monitoring

[J].

基于机器视觉的加工刀具磨损监测方法

[J].

Monitoring method for machining tool wear based on machine vision

[J].

Image super resolution by double dictionary learning and its application to tool wear monitoring in micro milling

[J].DOI:10.1016/j.ymssp.2023.110917 [本文引用: 1]

A machine vision method for measurement of machining tool wear

[J].DOI:10.1016/j.measurement.2021.109683 [本文引用: 1]

Online tool wear monitoring by super-resolution based machine vision

[J].DOI:10.1016/j.compind.2022.103782 [本文引用: 1]

Intelligent tool wear prediction based on Informer encoder and stacked bidirectional gated recurrent unit

[J].DOI:10.1016/j.rcim.2022.102368 [本文引用: 1]

Overview of behavior recognition based on deep learning

[J].DOI:10.1007/s10462-022-10210-8 [本文引用: 1]

采用改进CNN-BiLSTM模型的刀具磨损状态监测

[J].

Tool wear detection based on improved CNN-BiLSTM model

[J].

Intelligent prediction of wear location and mechanism using image identification based on improved Faster R-CNN model

[J].DOI:10.1016/j.triboint.2022.107466 [本文引用: 1]

In-process stochastic tool wear identification and its application to the improved cutting force modeling of micro milling

[J].DOI:10.1016/j.ymssp.2021.108233 [本文引用: 1]

基于DRSN-BiLSTM模型的刀具磨损预测方法研究

[J].

Tool wear prediction based on DRSN-BiLSTM model

[J].

基于图像编码技术和卷积神经网络的刀具磨损值在线监测方法

[J].

On-line monitoring method for tool wear based on image coding technology and convolutional neural network

[J].

刀具磨损状态的多步向前智能预测

[J].

Multi-step forward intelligent prediction of tool wear condition

[J].

刀具磨损自动识别及检测系统

[J].

Automatic recognition and detection system for cutter wear

[J].

Harnessing the power of CNNs for unevenly-sampled light-curves using Markov transition field

[J].DOI:10.1016/j.ascom.2021.100461 [本文引用: 1]