中国选煤行业已基本实现由传统机械化到智能化的过渡,常用的煤矸智能识别方法主要有红外法[6]、射线法[7]、多光谱法[8]和图像法[9]. 红外法根据主动红外热激励实现煤矸识别,介质的热激励会耗费大量时间,容易产生安全隐患[10]. 射线法根据煤矸对射线吸收能力的衰减程度识别煤矸,存在射线泄露的风险 [11]. 多光谱法根据反射光谱曲线因煤矸组成成分不同在相同波段的波形特征不同实现煤矸识别,容易受杂散光干扰,扫描速度较慢[12]. 图像法因具备操作方便、准确性高、适应性强等优点,在煤矸识别中逐渐成为研究热点[13]. 李娟莉等[14]通过在单步多框目标检测(single shot multibox detector, SSD)模型中引入深度可分离卷积和多分支卷积模块,提出基于DSR-SSD的煤矸快速识别模型,在减少参数量的同时提高了模型的检测精度和检测速度. Lv等[15]基于深度卷积神经网络(convolutional neural networks, CNN)设计级联检测网络,通过设置多通道特征融合层,优化神经网络的损失函数和分类器,有效提高了级联网络对煤矸的检测精度. 韦小龙等[16]通过在YOLOv7模型中引入跨阶段部分网络、递归特征金字塔和可切换卷积,提出基于CSPNet-YOLOv7的煤矸图像识别模型,较好平衡了模型的检测精度与检测速度. Xue等[17]通过对YOLOv3模型进行骨干特征提取网络轻量化、特征尺度缩减和非结构化剪枝,提出基于ResNet18-YOLO的煤矸检测模型,该模型在保持检测精度的同时具备更好的实时性和轻量性. 郜亚松等[18]在MobileNetV3模型的基础上采用卷积注意力模块(convolutional block attention module, CBAM),在训练过程中采用复杂图像增强技术,提出轻量级深度煤矸识别网络模型,实现了煤矸的精准识别. 徐志强等[19]基于CNN建立煤矸识别模型,通过模型剪枝操作提高了检测精度,降低了模型复杂度并节省了计算资源. Xin等[20]引入挤压激励网络(squeeze-and-excitation networks, SE)注意力机制[21]、三维扩张卷积和可变卷积网络(deformation convolutional networks, DCN),提出S3DD-YOLOv8煤矸检测模型,该模型能够在不同光照条件下有效检测煤矸. Wang等[22]提出具有多尺度目标语义特征表征能力的煤矸目标检测网络TSNet_DCG,通过在解码器中添加门控注意力机制和通道注意力机制(channel attention, CA),增强了模型的全局特征表征能力和检测效果. Cao等[23]以MobileNetV3-small为基本框架,通过采用三元组注意力机制模块和CeLU激活函数对模型特征提取部分进行重构,提出面向嵌入式设备的煤矸检测模型,在提高检测精度的同时降低了模型复杂程度.

本研究针对复杂相似背景下的煤矸视觉感知模型的精准识别及定位问题,提出煤矸目标检测模型(ECC-YOLO)来提升煤矸目标的检测精度与环境适应性,同时构建融合自适应中值滤波与梯度增强的煤矸边缘检测算法以实现矸石图像的精准分割与形心定位.

1. 研究方法

1.1. 煤矸识别分割定位方法概述

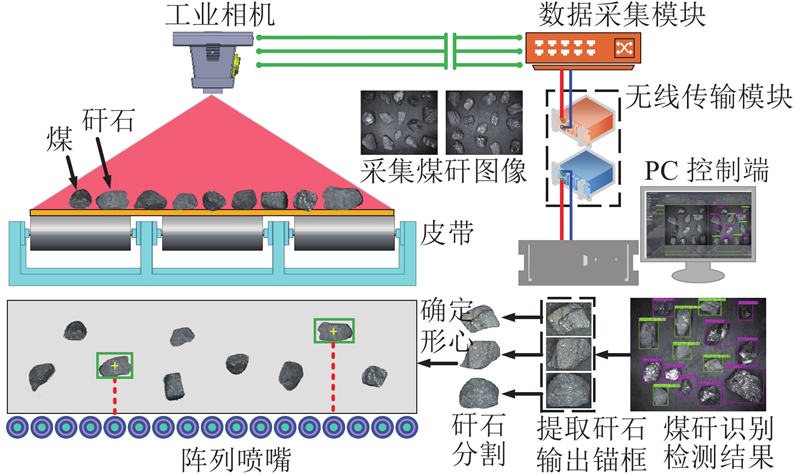

为了实现煤矸的精准高效分选,提出复杂相似背景下的煤矸识别分割定位技术,流程如图1所示. 1)通过实验室煤炭智能分选装备实时采集煤矸图像用以构建本研究所需数据集;2)将自制煤矸数据集中的训练集输入ECC-YOLO进行检测训练,完成对煤矸目标的实时检测;3)运用所建算法对提取出的单个矸石的锚框图像进行边缘提取,通过形态学操作获取最终矸石轮廓区域,得到矸石的实际形心位置. 煤矸的精准分离通过喷嘴吹射形心或采用外接矩形控制多喷嘴响应实现.

图 1

图 1 煤矸识别分割定位技术

Fig.1 Segmentation and positioning technology of coal and gangue identification

1.2. 煤矸目标检测模型

1.2.1. 高效多尺度挤压激励注意力机制

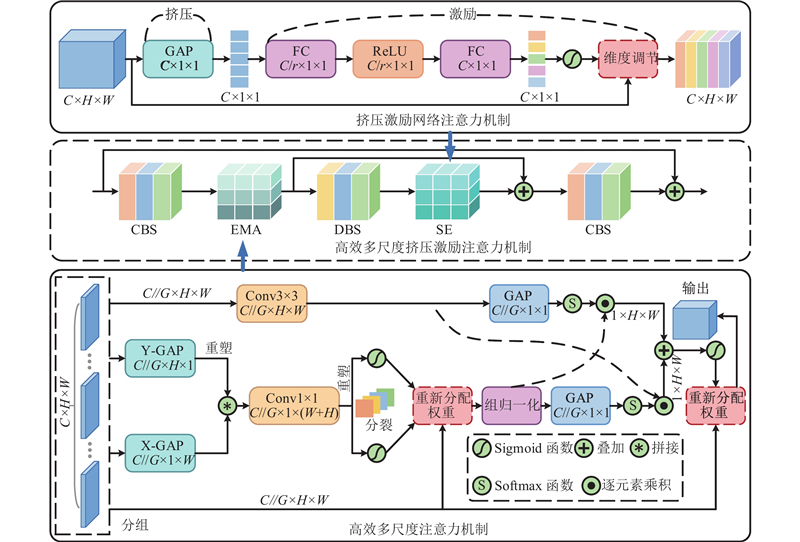

为了降低复杂相似背景对于煤矸识别的干扰,引导目标检测模型将目标感知区域聚焦于煤与矸石,设计如图2所示的高效多尺度挤压激励注意力机制(efficient multi-scale and squeeze-and-excitation attention module, ESAM). 图中,C、H、W分别为输入特征图的通道数、宽度和高度;C/r表示控制通道压缩的程度,r为缩减比率;C//G表示每组中的通道数,通过整除运算,确保均匀分组;G为分组数. ESAM的设计借鉴了倒残差移动模块(inverted residual mobile block,iRMB)[24]的思想,以倒残差模块(inverted residual block,iRB)[25]为底层模块进行扩展. iRB是在轻量化网络中使用的特征提取模块,通过结合深度可分离卷积来减少参数量和降低计算量. 在倒残差模块的基础上,ESAM在经过卷积归一激活层(convolution-batchnorm-silu, CBS)后添加高效多尺度注意力(efficient multi-scale attention,EMA)模块[26]以聚合不同尺度的上下文信息. 在EMA模块中,输入图像先进行分组,再通过不同分支进行处理:在1×1分支中分别沿X方向和Y方向对通道进行一维全局平均池化(global average pooling, GAP)操作,在3×3分支中通过3×3卷积捕获多尺度特征表示. 2个分支的输出特征采用Sigmoid函数和归一化操作进行调制,最终通过跨维度交互模块合并来捕获像素级的成对关系. 在深度可分离卷积归一激活层(depthwise batchnorm-silu, DBS)后添加SE注意力模块以提高特征判别能力,从而进一步提取煤矸目标的关键特征信息. 在SE注意力模块中,对每个通道C的输入特征采用挤压操作,通过全局平均池化实现对空间维度的压缩,从而捕获每个通道的全局特征;对挤压操作中聚集的特征信息采用激励操作,通过2个全连接层(fully connected layer,FC)构建通道间的相关性以提高特征的可辨别性;将Sigmoid函数生成的权重加权到每个通道的特征上,确保提高对信息特征的敏感性,并抑制非重要特征. 添加2条跳跃连接以权衡模型成本与准确性,跳跃连接可使模块直接从较低层次提取的特征中获取信息,减轻了梯度消失问题,也保留了更多的空间信息. ESAM结合了EMA模块和SE注意力机制的优势,在增强多尺度特征表达的同时更加关注煤矸自身的重要特征信息,从而提高模型的检测精度.

图 2

图 2 高效多尺度挤压激励注意力机制的整体网络结构

Fig.2 Overall network architecture of efficient multi-scale and squeeze-and-excitation attention module

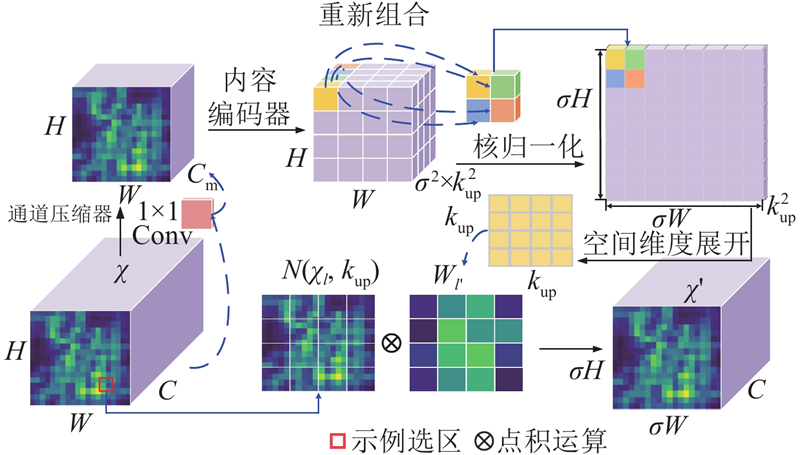

1.2.2. 内容感知特征重组模块

特征上采样是深度学习网络中的关键操作,它将特征图的空间尺寸恢复到原始输入尺寸,以增加特征图的分辨率. 原始YOLOv5算法特征融合网络上采样部分采用最近邻插值法,存在锯齿效应会影响图像的真实性和准确性,为此本研究采用内容感知特征重组(content-aware reassembly of features,CARAFE)模块[27]代替路径聚合网络中的最近邻插值. CARAFE模块具有较大的感受野,能够在不改变特征图尺寸的基础上增强分辨率和语义信息,从而提高模型对煤矸特征的检测精度,同时该模块的计算量较小,保持了轻量化的特性. 如图3所示,CARAFE模块分为核预测模块和内容感知重组模块. 在核预测模块中,尺寸为

图 3

图 3 内容感知特征重组模块的整体网络结构

Fig.3 Overall network architecture of content-aware reassembly of features module

1.2.3. 全卷积掩码自编码器网络

采用全卷积掩码自编码器网络(co-designing and scaling ConvNets with masked autoencoders, ConvNeXtV2)[28]替换YOLOv5s骨干部分末端的2个C3模块,以更好捕获煤矸图像中的关键信息,提高模型的泛化能力. ConvNeXtV2在纯卷积神经网络的基础上融合了自监督学习技术和架构改进,网络架构主要分为2个部分:1)将全卷积掩码自编码器(full convolutional masked autoencoders,FCMAE)框架添加到ConvNeXt架构中,使通道间的特征竞争能力增强;2)在维度扩展MLP层后添加全局响应归一化(global response normalization,GRN)层以提高模型训练稳定性,同时删除层缩放以简化模型结构,提高卷积神经网络在煤矸目标检测基准上的性能. FCMAE采用全卷积结构处理带有掩码的煤矸图像数据,避免了传统自编码器中使用的全连接层带来的计算复杂度和空间限制,保持了较高的计算效率;GRN层在卷积块中引入全局响应归一化层,增强了模型处理信息时的通道间竞争,提高了特征表达的质量以及模型的整体表现和泛化能力.

1.2.4. 所提煤矸目标检测模型结构

在多种工业化目标检测任务中,YOLO模型均具有突出表现,但在面向复杂相似背景下的煤矸目标检测时,模型的检测性能急剧下降. 本研究采用ESAM、CARAFE、ConvNeXtV2优化YOLOv5s算法,以提升模型的检测性能,所提模型的整体架构如图4所示. ECC-YOLO主要由输入端、骨干部分、颈部部分和检测头部4部分组成. 输入端采用Mosaic数据增强方法对煤矸图像进行随机缩放、裁剪与仿射变换等处理,目的是提升模型对目标尺度变化、视角变化和背景干扰等因素的鲁棒性. 骨干部分在每个C3模块的后面嵌入ESAM,将骨干部分后端的C3×9和C3×3模块替换为ConvNeXtV2,以实现对输入煤矸图像的特征提取,进行深层次的卷积操作,提取到的煤矸特征具有较高的语义信息. 颈部部分采用CARAFE替换路径聚合网络中的最近邻插值,有效利用低分辨率煤矸特征图像信息增强煤矸特征表达能力,从而提高模型对煤矸特征的检测精度. 检测头部3个检测层分别对应颈部3种不同尺寸的煤矸特征图,用于输出检测框的位置信息和分类信息,通过完全交并比损失函数(complete intersection over union, CIOU)与非极大值抑制算法(non-maximum suppression,NMS)筛选出最优检测框,得到最终检测结果.

图 4

图 4 所提煤矸目标检测模型的整体网络框架

Fig.4 Overall network framework of proposed coal and gangue target detection model

1.3. 煤矸轮廓检测模型

1.3.1. 自适应中值滤波算法

对矸石锚框图像降噪滤波的同时保持矸石轮廓边缘特征是精准定位矸石的重要前提. Canny算法主要采用高斯滤波降噪以降低伪边缘的识别,除高斯滤波外常用的滤波方法有双边滤波、均值滤波,这些方法去除常见噪声类型的效果较好,去除高概率噪声的效果不佳,且易模糊图像边缘. 本研究采用自适应中值滤波算法兼顾去噪作用与保护细节信息的效果. 自适应中值滤波算法能够根据图像中每个像素点的邻域信息动态地调整滤波窗口的大小,计算每个滤波窗口的像素最小值、最大值和中值,根据三者之间的差异判断当前像素是否处于噪声区域内. 如果当前像素处于噪声区域,使用邻域像素的中值代替原像素,反之不做处理,以实现对噪声的有效滤除.

1.3.2. 梯度增强

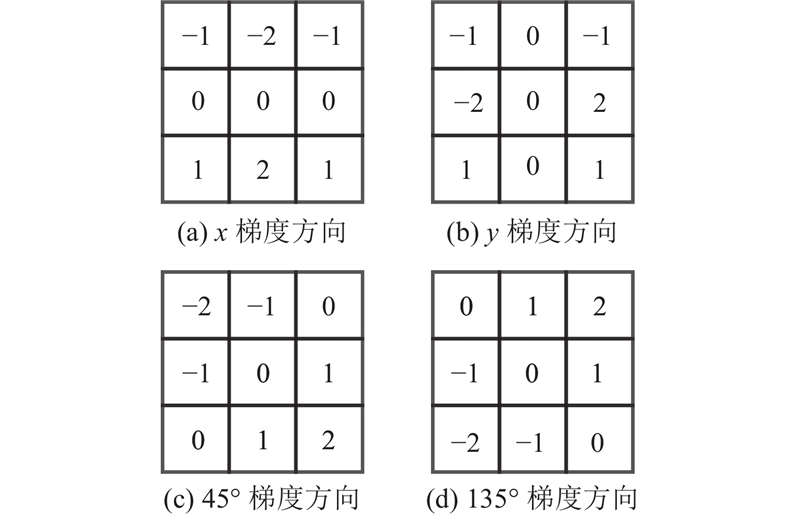

传统的梯度幅值通过计算2×2邻域内x方向与y方向的梯度增强图像梯度,由于矸石轮廓大多为椭圆弧形边缘,在斜分量上的响应占比较大,为了便于选取中心像素点,采用窗口为3×3的索贝尔(Sobel)算子替换原梯度计算方法,同时将梯度方向扩展为4个:x、y、45°和135°,Sobel算子梯度方向模板如图5所示. 通过Sobel算子梯度方向模板对滤波后的矸石图像进行卷积操作,得到4个方向的梯度幅值. 设

图 5

将45°和135°方向梯度值分别投影到x、y方向上,通过叠加运算得到增强后的x、y轴梯度值:

设

1.3.3. 自适应检测阈值算法

Canny算法在边缘连接时的高、低阈值主要通过人工选取确定,选取的阈值可能无法适应不同图像的特性;为了获得最佳的边缘检测效果,须多次测试不同的阈值组合,增加了调试的复杂性,不利于图像的高效处理. 自适应检测阈值算法根据图像的灰度直方图信息自动的确定高、低阈值. 灰度图像大小为

图像的类间方差的计算式为

当类间方差值最大时为最优阈值,计算式为

低阈值为

2. 实验与分析

2.1. 实验数据集

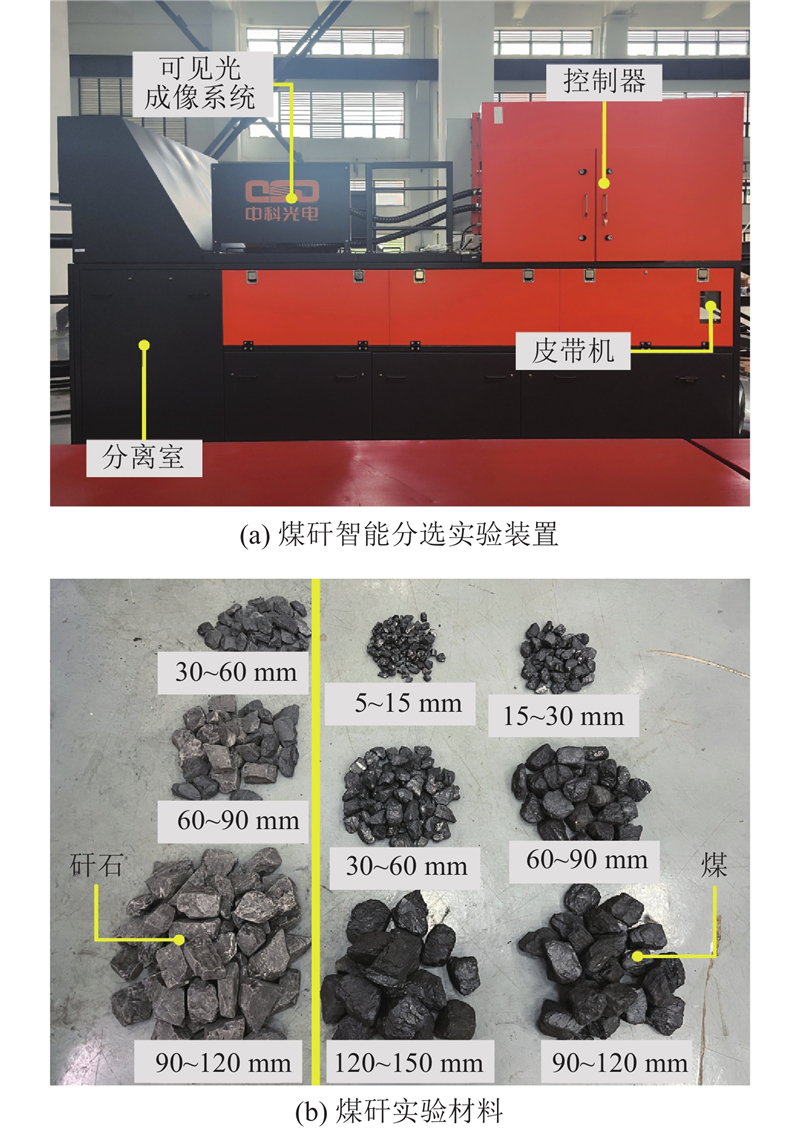

实验材料取自于安徽省淮南市张集煤矿,物料粒径分布为(5, 150)mm;实验装置为安徽理工大学与安徽中科光电色选机械有限公司联合研制的煤矸智能分选装备. 如图6所示,实验装置由可见光成像系统、光源控制器、皮带机、分离室和控制器组成. 在采集煤矸图像时,皮带机的初始速度设置为0.4 m/s,通过调节光源控制器将可见光成像系统区域光强调整在2 500(+20) lx,彩色CMOS工业面阵相机帧率为35 帧/s、分辨率为2 448×2 048,工况机与工业相机之间采用USB3.0接口通信,显示采集画面并保存图像. 为了保证采集煤矸图像的多样性,通过调节光源照度大小,煤和矸石摆放位置、大小、数量以及皮带机带速等组合方式最终采集煤矸图像1 634张.

图 6

图 6 煤矸智能分选实验装置及煤矸实验材料

Fig.6 Coal gangue intelligent sorting experimental device and coal gangue experimental material

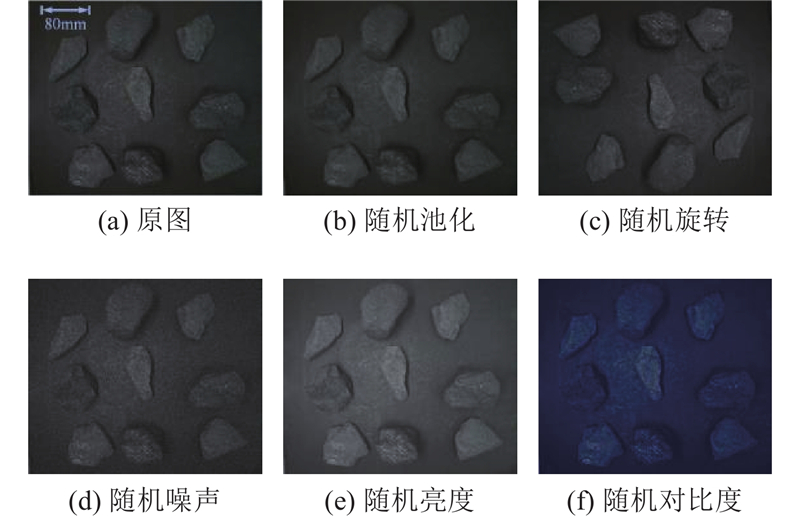

如图7所示,为了提高目标检测模型的检测性能与泛化能力,对采集到的煤矸图像数据进行扩充,通过ImgAug3.2数据增强软件对原始煤矸图像进行随机池化、随机旋转、随机噪声、随机亮度和随机对比度的操作. 扩充后的数据集由9 804张煤矸图像组成,包括原始图像1 634张和增强图像8 170张. 利用LabelImg图像标注软件对获取的8 170张图片进行手工标注(采用最小矩形框逐一框选每张图片上的煤矸图像),Coal和Gangue为检测目标的标签,将标注好的数据集保存为Pascal VOC格式的XML文件,按照8∶2的比例将数据集随机划分为训练集和验证集,分别用于模型的训练及测试.

图 7

图 7 煤矸图像数据集数据增强方式

Fig.7 Data enhancement approach for coal and gangue image dataset

2.2. 实验环境配置

基于AutoDL AI算力云服务器平台对所有算法进行训练及测试,中央处理器型号为Intel(R) Xeon(R) Platinum 8255c,图形处理器型号为NVIDIA GeForce RTX 3090,加速环境为CUDA11.3,语言环境为Python3.8,深度学习框架为PyTorch1.11.0. 设置图像输入尺寸为640×640像素,学习率初始值为0.01,训练批量大小为32,训练迭代轮次为300.

2.3. 实验评估指标

实验评估指标主要有参数数量

式中:

2.4. 实验结果分析

2.4.1. 注意力机制对比实验

为了验证ESAM的综合检测性能,在保持相同的训练环境情况下,在YOLOv5s模型骨干部分每个C3模块后面的相同位置处分别添加不同的注意力机制进行模型对比实验,结果如表1所示. 由表可知,+ESAM模型的平均精度均值最高,为87.7%. 分析原因,ESAM融合了EMA模块和SE注意力机制,使得层数最高为305,同时深度可分离卷积模块减少了模型的参数量与计算量,该模型的参数量较低,仅高于增加高效通道注意力机制(efficient channel attention, ECA)模型.

表 1 添加不同注意力机制的模型性能对比实验结果

Tab.1

| 模型 | AP/% | FLOPs/109 | F1 | mAP0.5/% | |||

| 煤 | 矸石 | ||||||

| +CBAM | 86.9 | 85.2 | 7.7 | 16.9 | 257 | 0.81 | 86.1 |

| +ECA | 86.1 | 84.9 | 7.0 | 15.8 | 229 | 0.82 | 85.5 |

| +CA | 88.0 | 86.0 | 8.1 | 17.4 | 253 | 0.82 | 87.0 |

| +SE | 87.3 | 85.7 | 7.7 | 16.3 | 237 | 0.82 | 86.5 |

| +ESAM | 88.4 | 87.1 | 7.4 | 17.2 | 305 | 0.83 | 87.7 |

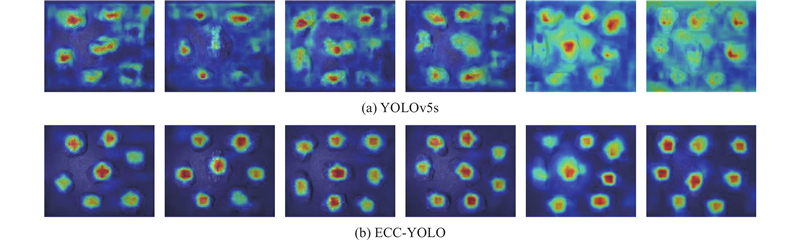

Grad-CAM是基于梯度的可视化方法,通过计算特征图的梯度生成热力图以直观展示模型对不同区域的关注程度. 如图8所示,采用Grad-CAM热力图对ESAM的有效性进行可视化分析. 颜色越深表示该区域给予的特征权重越大,颜色越浅表示该区域给予的特征权重越小. 可以看出,YOLOv5s模型赋予背景部分一定权重,检测结果容易出现误判,ECC-YOLO只关注煤矸区域的特征提取,较少关注背景部分.

图 8

图 8 基于不同煤矸目标检测模型生成的热力图对比

Fig.8 Comparison of heat maps generated based on different coal and gangue target detection models

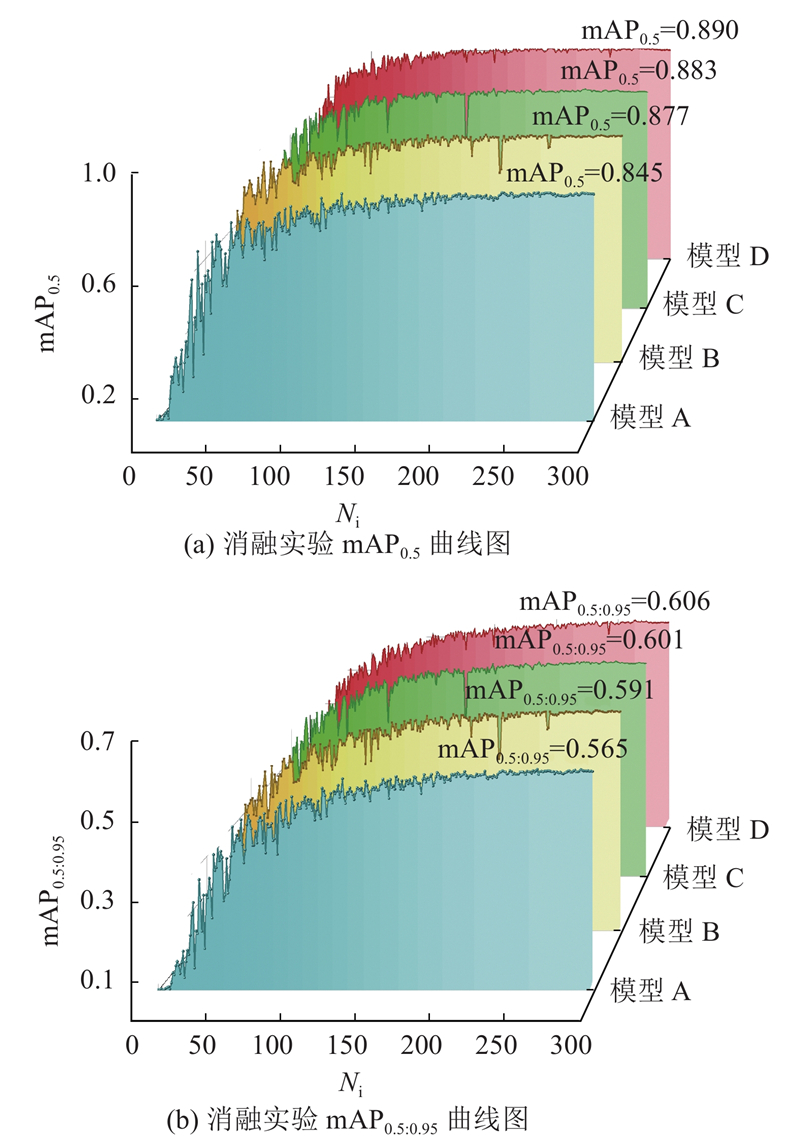

2.4.2. 目标检测模型消融实验

进行目标检测模型的模块消融实验,验证优化策略的有效性,实验结果如表2和图9所示,图中,Ni为迭代次数,模型A为未采取任何优化策略的YOLOv5s模型. 1)在模型A的基础上于骨干部分每个C3模块后面嵌入ESAM后,模型B的平均精度均值明显提升,在阈值为0.50时,平均精度均值由84.5%提升至87.7%,在阈值为0.50:0.95时,平均精度均值由56.5%提升至59.1%,精确率由84.4%提升至85.3%,召回率由76.8%提升至81.4%,表明ESAM可以有效增强模型的多尺度特征表达能力与聚焦目标重要特征,提升模型的检测精度. 2)在模型B的基础上于颈部部分采用CARAFE替换路径聚合网络中的最近邻插值后,模型C的平均精度均值得到提升,在阈值为0.5时,平均精度均值由87.7%提升至88.3%,在阈值为0.50:0.95时,平均精度均值由59.1%提升至60.1%,精确率由85.3%提升至87.2%,召回率由81.4%提升至81.8%,表明CARAFE可以实现模型计算效率与特征融合能力的同步提升. 3)在模型C的基础上采用ConvNeXtV2替换骨干部分末端的2个C3模块后,模型D的平均精度均值略微提升,在阈值为0.5时,平均精度均值由88.3%提升至89.0%,在阈值为0.50:0.95时,平均精度均值由60.1%提升至60.6%,精确率由87.2%提升至87.6%,召回率由81.8%提升至82.5%,表明ConvNeXtV2可以有效提升模型对目标多尺度特征的提取能力.

表 2 所提煤矸目标检测模型消融实验结果

Tab.2

| 编号 | ESAM | CARAEF | ConvNeXtV2 | AP/% | P/% | R/% | mAP0.5/% | F1 | |

| 煤 | 矸石 | ||||||||

| A | — | — | — | 85.4 | 83.6 | 84.4 | 76.8 | 84.5 | 0.80 |

| B | √ | — | — | 88.4 | 87.1 | 85.3 | 81.4 | 87.7 | 0.83 |

| C | √ | √ | — | 89.2 | 87.4 | 87.2 | 81.8 | 88.3 | 0.84 |

| D | √ | √ | √ | 89.8 | 88.2 | 87.6 | 82.5 | 89.0 | 0.84 |

图 9

图 9 所提煤矸目标检测模型消融实验平均精度均值曲线

Fig.9 Mean average precision curve for ablation experiments of proposed coal and gangue target detection model

2.4.3. 目标检测模型对比实验

为了验证ECC-YOLO的综合检测性能,基于同一煤矸数据集和网络模型训练环境,选取YOLOv5s、YOLOv7-tiny、YOLOv8s、SSD、DETR共5种检测模型与ECC-YOLO开展对比实验,结果如表3所示. 由表可知,ECC-YOLO的平均精度均值最高,比对比模型分别高出4.5、2.0、1.8、1.4与1.5个百分点. 在准确率和召回率方面,ECC-YOLO的表现最佳. 在参数量和运算量方面,SSD和DETR远高于其他4种检测模型,表明这2种模型复杂程度较高,难以高效部署于移动端或嵌入式系统中;在剩余4种检测模型中,ECC-YOLO高于YOLOv5s和YOLOv7-tiny,但低于YOLOv8s,说明相对适中的模型复杂程度能够在保持较高检测精度的同时不降低检测速度,更加适用于煤矸实时检测任务. 在检测速度方面,ECC-YOLO的检测速度为89.29 帧/s,高于YOLOv8s和DETR,低于YOLOv5s、YOLOv7-tiny和SSD,仍充分满足煤矸实时检测的需求. 综上所述,ECC-YOLO在平均检测精度、平均检测速度和模型复杂程度方面均表现良好,在参与对比的模型中综合检测性能最佳.

表 3 不同煤矸目标检测模型性能对比实验结果

Tab.3

| 模型 | P/% | R/% | F1 | FLOPs/109 | mAP0.5/% | v/(帧·s−1) | |

| YOLOv5s | 84.4 | 76.8 | 0.80 | 7.0 | 15.8 | 84.5 | 101.01 |

| YOLOv7-tiny | 86.3 | 78.7 | 0.82 | 6.0 | 13.2 | 87.0 | 109.90 |

| YOLOv8s | 84.6 | 79.6 | 0.82 | 11.1 | 28.6 | 87.2 | 75.76 |

| SSD | 84.1 | 80.3 | 0.82 | 23.7 | 60 | 87.6 | 90.15 |

| DETR | 67.2 | 80.1 | 0.77 | 36.7 | 114.2 | 87.5 | 30.96 |

| ECC-YOLO | 87.6 | 82.5 | 0.84 | 7.5 | 17.4 | 89.0 | 89.29 |

2.4.4. 目标检测模型检测结果分析

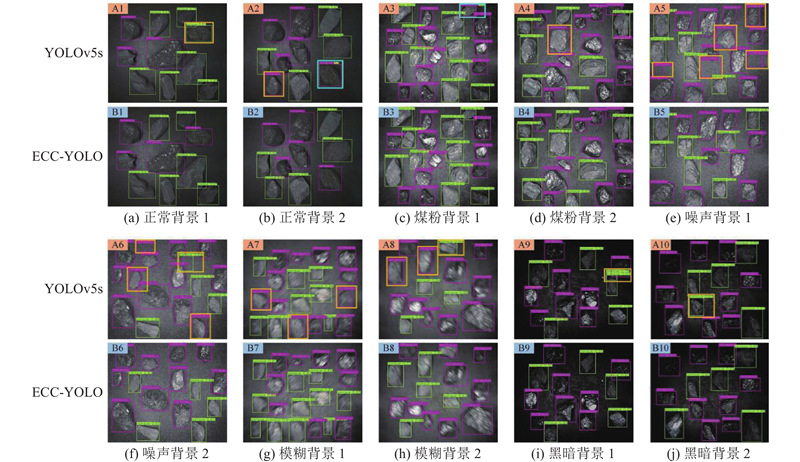

如图10所示,为了直观对比YOLOv5s与ECC-YOLO在煤矸图像上的检测效果,选取部分预测结果进行可视化分析. 可以看出,YOLOv5s在面对复杂相似背景下的煤矸识别时会出现误检和预测框不准确的现象,ECC-YOLO能够准确识别出煤和矸石,未出现误检和预测框不准确的现象. 结果表明,ECC-YOLO具有优良的检测效果.

图 10

图 10 不同背景图像下2种煤矸目标检测模型检测结果对比

Fig.10 Comparison of detection results for two coal and gangue target detection models under different background images

2.4.5. 不同轮廓检测方法对比

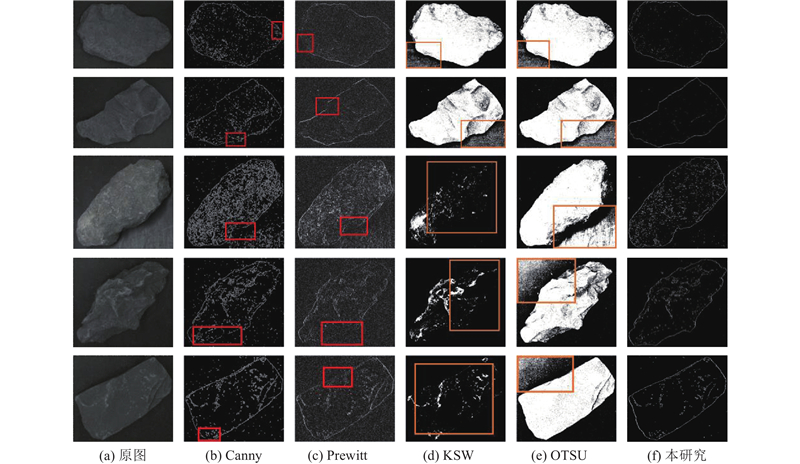

在进行煤矸分离时,喷嘴吹射矸石,煤经自由下落至前置运煤输送带上,矸石经喷嘴吹射至后置运矸输送带上,因此只需对ECC-YOLO识别出的矸石进行分割与定位. 本研究采用融合自适应中值滤波与梯度增强的煤矸边缘检测算法对提取的矸石锚框图像进行轮廓检测,将该算法检测效果与Canny边缘检测算法、Prewitt边缘检测算法[31]、最大熵阈值分割算法(KSW)[32]和大津算法(OTSU)的检测效果进行对比,结果如图11所示. 矸石图像分割属于复杂背景的分割问题,由于矸石内部存在灰度值的不均匀变化,造成前景与背景边界处灰度值的不稳定,矸石边缘难以检测和矸石部分图像信息丢失的问题. 由图可以看出,Canny和Prewitt提取边缘特征的完整性较差,部分边缘信息存在丢失现象;KSW和OTSU会丢失矸石的部分图像信息,因此难以采用阈值分割方法进行处理;本研究算法对于边缘提取的完整程度明显优于对比算法,能够将矸石图像部分微弱的边缘信息准确检测出来.

图 11

图 11 不同煤矸边缘检测方法检测效果对比

Fig.11 Comparison of detection effect of different coal and gangue edge detection methods

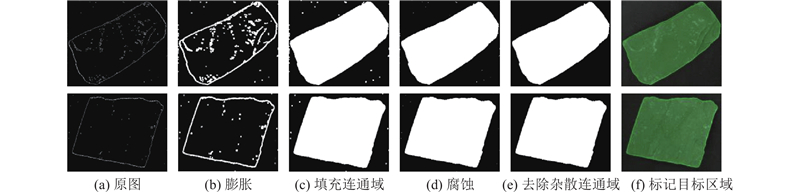

2.4.6. 矸石分割过程分析

在采用融合自适应中值滤波与梯度增强的煤矸边缘检测算法对提取出的矸石锚框图像进行轮廓检测后,须通过一系列形态学操作将最终的矸石轮廓区域分割出来,以便于后续对于矸石的精准定位. 如图12所示为矸石图像分割流程,1)将矸石边缘检测结果进行膨胀操作,以获取更完整的矸石轮廓;2)由于连通域中存在大量孔洞,将膨胀结果进行填充连通域操作,使矸石内部区域孔洞全部填充,矸石轮廓更加完整;3)为了去除轮廓区域附近较大面积的白色斑点,对填充连通域结果进行腐蚀操作;4)对腐蚀结果进行去除杂散连通域操作,以去除杂散边缘面积较小的连通域,保留像素面积最大的连通域. 经过上述操作后,将分割结果在原图上进行标记,发现原图上矸石的边缘与标记连通域的边缘几乎重合,表明分割效果良好.

图 12

图 12 矸石图像形态学操作分割流程

Fig.12 Segmentation process for morphological operation of gangue images

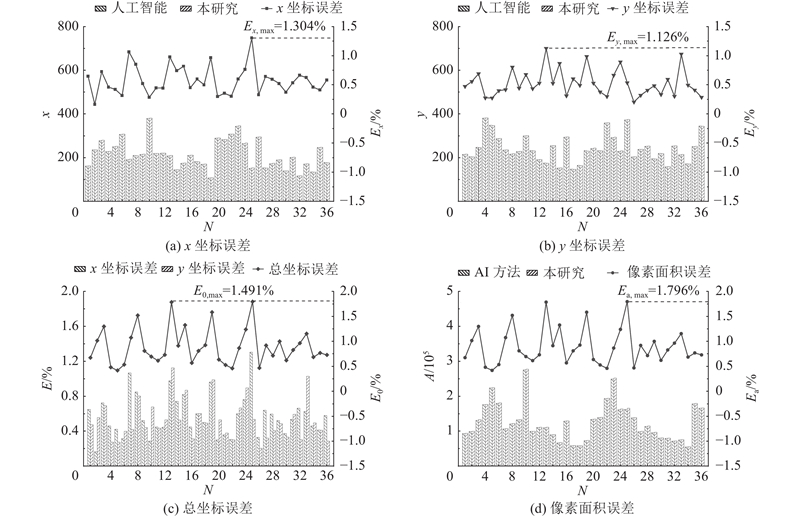

2.4.7. 矸石定位结果分析

获得分割后的完整矸石目标后,将融合自适应中值滤波与梯度增强的煤矸边缘检测算法的分割结果与Picwish图像分割助手集成的人工智能方法的分割结果进行对比. 分别采用本研究算法和人工智能分割算法得到矸石目标的像素面积和形心坐标. 以人工智能分割算法的结果为参考标准,分别得到轮廓像素面积误差与形心坐标误差,计算式分别为

式中:

图 13

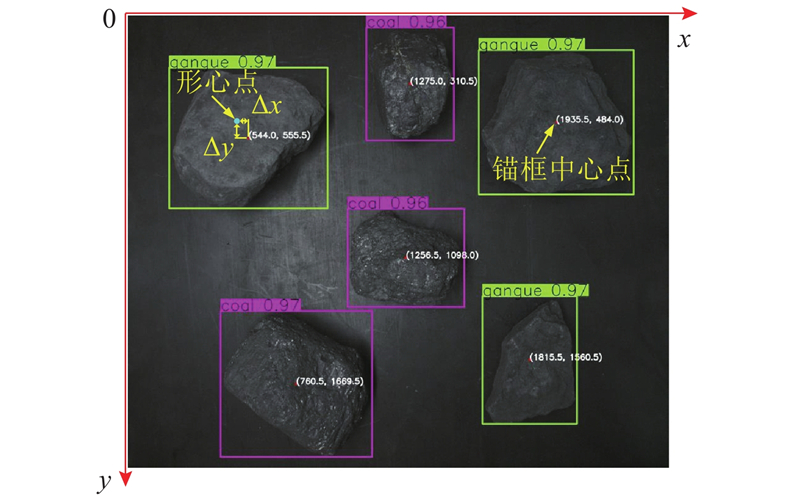

如图14所示,ECC-YOLO输出的检测煤矸图像显示了每个目标锚框的中心点,只需计算目标形心点对于锚框中心点的偏移量

图 14

图 14 检测图片位置特征示意图

Fig.14 Schematic diagram for positional characteristics of detected image

3. 结 论

(1)提出可适应复杂相似背景的煤矸目标检测模型ECC-YOLO,该模型在自制煤矸检测数据集中的平均精度均值为89.0%,精确率为87.6%,召回率为82.5%,平均检测速度为89.29帧/s,能够快速准确地识别煤和矸石,适用于煤矸实时检测任务.

(2)采用ESAM、CARAFE、ConvNeXtV2模块优化在原YOLOv5s模型,提升了检测模型的性能. 相比YOLOv5s、YOLOv7-tiny、YOLOv8s、SSD和DETR,ECC-YOLO在平均检测精度、平均检测速度和模型复杂程度方面表现良好,综合检测性能最佳.

(3)构建融合自适应中值滤波与梯度增强的煤矸边缘检测算法,对比Canny、Prewitt、KSW和OTSU算法,该算法的对于边缘提取的完整程度最佳. 该算法像素面积与形心坐标的最大误差率分别为1.491%和1.796%,对矸石具有较高的定位精度,能够实现精准的矸石图像分割和形心定位.

(4)在实际应用中,煤矸分选效率以及硬件设备成本对模型的速度和体积要求更加严格,未来计划开展轻量化算法研究以降低计算与储存成本,提高模型响应能力以适应实时性要求更高的应用场景.

参考文献

智慧矿山系统工程及关键技术研究与实践

[J].

System engineering and key technologies research and practice of smart mine

[J].

我国煤矿煤机智能技术与装备发展研究

[J].DOI:10.15302/J-SSCAE-2023.05.013 [本文引用: 1]

Development of intelligent technologies and machinery for coal mining in China’s underground coal mines

[J].DOI:10.15302/J-SSCAE-2023.05.013 [本文引用: 1]

空气重介质流化床中细粒煤的流化与分选特性

[J].

Bed fluidization characteristics and separating effect of fine coal in an air dense medium fluidized bed

[J].

低品质煤泥浮选过程强化研究进展及其思考

[J].

Recent advances and thinking in process intensification of low quality coal slime flotation

[J].

不同工况下可见-近红外光谱的煤矸识别研究

[J].

Study on coal and gangue recognition by vis-NIR spectroscopy under different working conditions

[J].

基于几何特征约束的煤矸DE-XRT精准识别方法

[J].

Accurate identification method of coal and gangue based on geometric feature constraints by DE-XRT

[J].

The study of coal gangue segmentation for location and shape predicts based on multispectral and improved Mask R-CNN

[J].DOI:10.1016/j.powtec.2022.117655 [本文引用: 1]

面向煤矸分拣机器人的煤矸识别定位系统研究

[J].

Research on coal gangue identification and positioning system based on coal-gangue sorting robot

[J].

模拟暗湿工况下煤矸混合体态势热敏图像精准辨识试验

[J].

Experiment on accurate identification of thermal image of coal-gangue mixture under a simulated dusky and wet condition

[J].

基于X射线图像和激光点云的煤矸识别方法

[J].

A coal-gangue recognition method based on X-ray image and laser point cloud

[J].

Detection of coal and gangue based on improved YOLOv5.1 which embedded scSE module

[J].DOI:10.1016/j.measurement.2021.110530 [本文引用: 1]

基于CFS-YOLO算法的复杂工况环境下煤矸图像识别方法

[J].

Image recognition method of coal gangue in complex working conditions based on CES-YOLO algorithm

[J].

基于深度学习轻量化的改进SSD煤矸快速分选模型

[J].

Improved SSD rapid separation model of coal gangue based on deep learning and light-weighting

[J].

Cascade network for detection of coal and gangue in the production context

[J].DOI:10.1016/j.powtec.2020.08.088 [本文引用: 1]

基于CSPNet-YOLOv7目标检测算法的煤矸图像识别模型

[J].DOI:10.12438/cst.2023-0546 [本文引用: 1]

Coal gangue image recognition model based on CSPNet-YOLOv7 target detection algorithm

[J].DOI:10.12438/cst.2023-0546 [本文引用: 1]

Research on lightweight YOLO coal gangue detection algorithm based on ResNet18 backbone feature network

[J].DOI:10.1016/j.iot.2023.100762 [本文引用: 1]

基于深度学习的煤矸石识别技术与实现

[J].DOI:10.3969/j.issn.0253-2336.2021.12.mtkxjs202112025 [本文引用: 1]

Coal and gangue recognition technology and implementation based on deep learning

[J].DOI:10.3969/j.issn.0253-2336.2021.12.mtkxjs202112025 [本文引用: 1]

煤矸智能分选的机器视觉识别方法与优化

[J].

Machine vision recognition method and optimization for intelligent separation of coal and gangue

[J].

A high accuracy detection method for coal and gangue with S3DD-YOLOv8

[J].DOI:10.1080/19392699.2024.2346173 [本文引用: 1]

A detection method for densely distributed coal and gangue with uneven particle based on DeepLabV3+

[J].DOI:10.1016/j.measurement.2024.114756 [本文引用: 1]

Research on efficient classification algorithm for coal and gangue based on improved MobileNetV3-small

[J].DOI:10.1080/19392699.2024.2353128 [本文引用: 1]

基于无人机遥感影像的水体提取方法

[J].

Water extraction from unmanned aerial vehicle remote sensing images

[J].

基于机器视觉的加工刀具磨损监测方法

[J].

Monitoring method for machining tool wear based on machine vision

[J].

Prewitt霍尔磁梯度张量系统结构设计

[J].

Structure design of Prewitt hall magnetic gradient tensor system

[J].

New result on maximum entropy threshold image segmentation based on P system

[J].DOI:10.1016/j.ijleo.2018.02.062 [本文引用: 1]