[18]

WOO S, PARK J, LEE J Y, et al. CBAM: convolutional block attention module [C]// Proceedings of the European Conference on Computer Vision . Munich: Springer Cham, 2018: 3−19.

[本文引用: 3]

[19]

JADERBERG M, SIMONYAN K, ZISSERMAN A, et al. Spatial transformer networks [C]// Proceedings of the 28th International Conference on Neural Information Processing Systems . Montreal: MIT Press, 2015: 2017−2025.

[本文引用: 1]

[20]

WANG Q, WU B, ZHU P, et al. ECA-Net: efficient channel attention for deep convolutional neural networks [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition . Seattle: IEEE, 2020: 11534−11542.

[本文引用: 1]

[21]

SELVARAJU R R, COGSWELL M, DAS A, et al. Grad-cam: visual explanations from deep networks via gradient-based localization [C]// Proceedings of the IEEE International Conference on Computer Vision . Venice: IEEE, 2017: 618−626.

[本文引用: 1]

[22]

BISWAS S, SINHA R. Lateralization of brain during EEG based covert speech classification [C]// 2018 15th IEEE India Council International Conference . Coimbatore: IEEE, 2018: 1−5.

[本文引用: 1]

[23]

LEE D Y, LEE M, LEE S W. Classification of imagined speech using Siamese neural network [C]// 2020 IEEE International Conference on Systems, Man, and Cybernetics . Toronto: IEEE, 2020: 2979−2984.

[本文引用: 1]

[24]

COONEY C, KORIK A, FOLLI R, et al Evaluation of hyperparameter optimization in machine and deep learning methods for decoding imagined speech EEG

[J]. Sensors , 2020 , 20 (16 ): 4629

DOI:10.3390/s20164629

[本文引用: 1]

[25]

DAGDEVIR E, TOKMAKCI M Determination of effective signal processing stages for brain computer interface on BCI competition IV data set 2b: a review study

[J]. IETE Journal of Research , 2023 , 69 (6 ): 3144 - 3155

DOI:10.1080/03772063.2021.1914204

[本文引用: 1]

[1]

NGUYEN C H, KARAVAS G K, ARTEMIADIS P Inferring imagined speech using EEG signals: a new approach using Riemannian manifold features

[J]. Journal of Neural Engineering , 2017 , 15 (1 ): 016002

[本文引用: 1]

[2]

ROYER A S, DOUD A J, ROSE M L EEG control of a virtual helicopter in 3-dimensional space using intelligent control strategies

[J]. IEEE Transactions on Neural Systems and Rehabilitation Engineering , 2010 , 18 (6 ): 581 - 589

DOI:10.1109/TNSRE.2010.2077654

[本文引用: 1]

[3]

BALAM V P, CHINARA S Statistical channel selection method for detecting drowsiness through single-channel EEG-based BCI system

[J]. IEEE Transactions on Instrumentation and Measurement , 2021 , 70 (7 ): 1 - 9

[本文引用: 1]

[4]

KHARE S K, BAJAJ V, SINHA G R Adaptive tunable Q wavelet transform-based emotion identification

[J]. IEEE Transactions on Instrumentation and Measurement , 2020 , 69 (12 ): 9609 - 9617

DOI:10.1109/TIM.2020.3006611

[本文引用: 1]

[5]

KAMBLE K S, SENGUPTA J Ensemble machine learning-based affective computing for emotion recognition using dual-decomposed EEG signals

[J]. IEEE Sensors Journal , 2021 , 22 (3 ): 2496 - 2507

[本文引用: 1]

[6]

WIERZGAŁA P, ZAPAŁA D, WOJCIK G M Most popular signal processing methods in motor-imagery BCI: a review and meta-analysis

[J]. Frontiers in Neuroinformatics , 2018 , 12 (11 ): 78

[本文引用: 1]

[7]

LEE S H, LEE M, LEE S W. EEG representations of spatial and temporal features in imagined speech and overt speech [C]// Pattern Recognition: 5th Asian Conference . Auckland: Springer International Publishing, 2020: 387−400.

[本文引用: 1]

[8]

刘艳鹏, 龚安民, 丁鹏, 等 基于言语想象的脑机交互关键技术

[J]. 生物医学工程学杂志 , 2022 , 39 (3 ): 596 - 611

DOI:10.7507/1001-5515.202107018

[本文引用: 1]

LIU Yanpeng, GONG Anmin, DING Peng, et al Key technology of brain-computer interaction based on speech imagery

[J]. Journal of Biomedical Engineering , 2022 , 39 (3 ): 596 - 611

DOI:10.7507/1001-5515.202107018

[本文引用: 1]

[9]

VAN DEN BERG B, VAN DONKELAAR S, ALIMARDANI M. Inner speech classification using EEG signals: a deep learning approach [C]// 2021 IEEE 2nd International Conference on Human-Machine Systems . Magdeburg: IEEE, 2021: 1−4.

[本文引用: 1]

[10]

RUSNAC A L, GRIGORE O CNN architectures and feature extraction methods for EEG imaginary speech recognition

[J]. Sensors , 2022 , 22 (13 ): 4679 - 4698

DOI:10.3390/s22134679

[本文引用: 1]

[11]

LEE D Y, LEE M, LEE S W Decoding imagined speech based on deep metric learning for intuitive BCI communication

[J]. IEEE Transactions on Neural Systems and Rehabilitation Engineering , 2021 , 29 (7 ): 1363 - 1374

[本文引用: 2]

[12]

CORETTO G A P, GAREIS I E, RUFINER H L. Open access database of EEG signals recorded during imagined speech [C]// 12th International Symposium on Medical Information Processing and Analysis . Munich: SPIE, 2017: 1016002.

[本文引用: 2]

[13]

CAO Y, OOSTENVELD R, ALDAY P M, et al Are alpha and beta oscillations spatially dissociated over the cortex in context-driven spoken-word production?

[J]. Psychophysiology , 2022 , 59 (6 ): e13999

DOI:10.1111/psyp.13999

[本文引用: 1]

[14]

WEI X, SUN T, ZHENG L, et al. Diagnosis of loose core fault in saturable reactor of thyristor valve based on vibration signal time-frequency analysis and CNN [C]// 5th International Conference on Energy Systems and Electrical Power . Changsha: Journal of Physics: Conference Series, 2023, 2584(1): 012079.

[本文引用: 1]

[15]

PODDER P, KHAN T Z, KHAN M H, et al Comparative performance analysis of hamming, hanning and blackman window

[J]. International Journal of Computer Applications , 2014 , 96 (18 ): 1 - 7

DOI:10.5120/16891-6927

[本文引用: 1]

[16]

SZEGEDY C, IOFFE S, VANHOUCKE V, et al. Inception-V4, inception-resnet and the impact of residual connections on learning [C]// Proceedings of the AAAI Conference on Artificial Intelligence . San Francisco: AAAI, 2017, 31(1): 4278−4284.

[本文引用: 3]

[17]

LUCERO C, BROOKSHIRE G, SAVA-SEGAL C, et al Unconscious number discrimination in the human visual system

[J]. Cerebral Cortex , 2020 , 30 (11 ): 5821 - 5829

DOI:10.1093/cercor/bhaa155

[本文引用: 1]

3

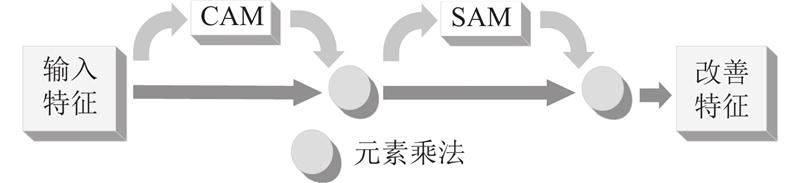

... Woo等[18 ] 提出一种新的卷积注意力模块CBAM,它包含2个连续的子模块:通道注意力模块(channel attention module,CAM)和空间注意力模块(spatial attention module,SAM). 如图4 所示显示了CBAM与CAM和SAM的总体关系. ...

... CBAM注意力结构[18 ] ...

... Attention structure of CBAM[18 ] ...

1

... 除了上述的CBAM注意力机制,常见的还有STN空间变换网络[19 ] ,它通过学习输入的形变,从而完成适合任务的预处理操作,是一种基于空间的注意力模块. 另一个流行的通道注意力机制ECANet[20 ] 的核心思想是在卷积操作中引入通道注意力机制,以捕捉不同通道之间的关系,从而提升特征表示的能力. ...

1

... 除了上述的CBAM注意力机制,常见的还有STN空间变换网络[19 ] ,它通过学习输入的形变,从而完成适合任务的预处理操作,是一种基于空间的注意力模块. 另一个流行的通道注意力机制ECANet[20 ] 的核心思想是在卷积操作中引入通道注意力机制,以捕捉不同通道之间的关系,从而提升特征表示的能力. ...

1

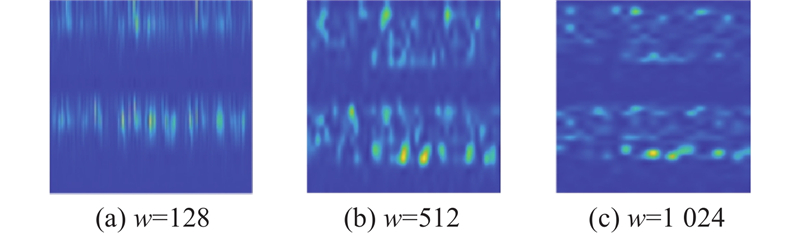

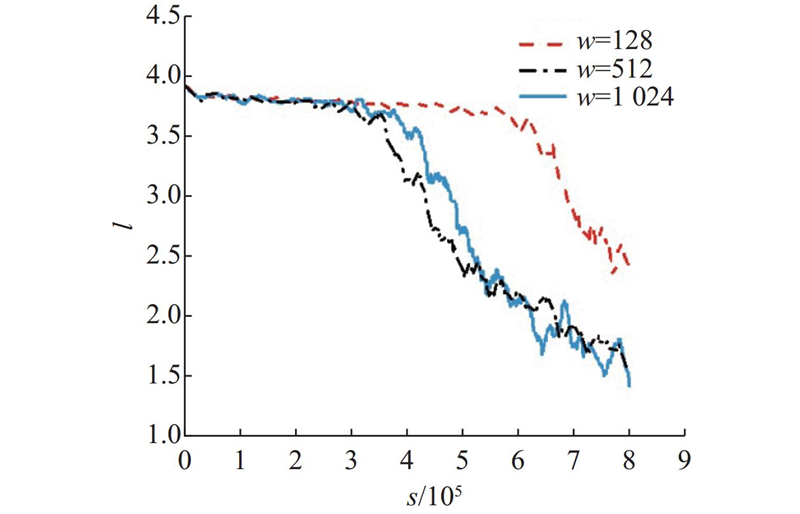

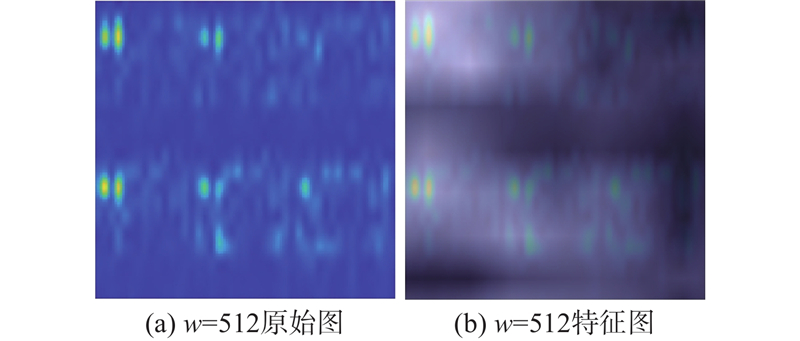

... 为了验证窗口长度选取的合理性,如图9 所示给出了使用Grad-CAM的特征可视化[21 ] 后的结果. 图9 (a)为用户想象“上”时的脑电信号经过STFT后的原始图像,图9 (b)为采用Grad-CAM方法提取的加权后的特征图在原始图像上叠加生成的图像. 由图可知特征定位准确明显,窗长选择合理. ...

1

... Comparison of classification accuracy of group EEG signals of imagined speech

Tab.2 网络模型 分类形式 A /%VMD-RWE+SVM with RBF kernel[22 ] 6分类 38.2 Siamese neural network framework[11 ] 6分类 44.1 end-to-end Siamese neural network[23 ] 6分类 31.4 Deep CNN[24 ] 6分类 28.4 VGG-16 6分类 46.3 本研究提出的融合CBAM的Inception-V4模型 6分类 52.2

3.5. 结合迁移学习的Inception-v4网络分类性能讨论 如表3 所示为使用迁移学习情况下的训练时间t t 和分类准确率A . “源域”一栏若为“无”表示未使用迁移学习,“使用网络”一栏若为“改Inception-V4”表示使用的网络是本研究提出的融合注意力机制后的Inception-V4模型. ...

1

... Comparison of classification accuracy of group EEG signals of imagined speech

Tab.2 网络模型 分类形式 A /%VMD-RWE+SVM with RBF kernel[22 ] 6分类 38.2 Siamese neural network framework[11 ] 6分类 44.1 end-to-end Siamese neural network[23 ] 6分类 31.4 Deep CNN[24 ] 6分类 28.4 VGG-16 6分类 46.3 本研究提出的融合CBAM的Inception-V4模型 6分类 52.2

3.5. 结合迁移学习的Inception-v4网络分类性能讨论 如表3 所示为使用迁移学习情况下的训练时间t t 和分类准确率A . “源域”一栏若为“无”表示未使用迁移学习,“使用网络”一栏若为“改Inception-V4”表示使用的网络是本研究提出的融合注意力机制后的Inception-V4模型. ...

Evaluation of hyperparameter optimization in machine and deep learning methods for decoding imagined speech EEG

1

2020

... Comparison of classification accuracy of group EEG signals of imagined speech

Tab.2 网络模型 分类形式 A /%VMD-RWE+SVM with RBF kernel[22 ] 6分类 38.2 Siamese neural network framework[11 ] 6分类 44.1 end-to-end Siamese neural network[23 ] 6分类 31.4 Deep CNN[24 ] 6分类 28.4 VGG-16 6分类 46.3 本研究提出的融合CBAM的Inception-V4模型 6分类 52.2

3.5. 结合迁移学习的Inception-v4网络分类性能讨论 如表3 所示为使用迁移学习情况下的训练时间t t 和分类准确率A . “源域”一栏若为“无”表示未使用迁移学习,“使用网络”一栏若为“改Inception-V4”表示使用的网络是本研究提出的融合注意力机制后的Inception-V4模型. ...

Determination of effective signal processing stages for brain computer interface on BCI competition IV data set 2b: a review study

1

2023

... Comparison of signal classification accuracy using transfer learning

Tab.3 编号 源域(已训练数据集) 目标域(要训练数据集) 使用网络 t t /hA /%1 无 Correto公开数据集 Inception-V4 168 48.1 2 ImageNet-1000 数据集 Correto公开数据集 Inception-V4 171 47.7 3 无 Correto公开数据集 改Inception-V4 172 52.2 4 BCI Competition IV-2b数据集[25 ] Correto公开数据集 改Inception-V4 69 51.8

ImageNet-1000 数据集中为实物图片,Correto公开数据集中为转换后的时频图,两者差异较大,因此对比编号1和2的实验结果可以得出,在图片类型相差较大的数据集之间使用迁移学习不能够有效缩短训练时间. 比较编号3和4的实验结果可知,在数据类型相似的数据集上使用迁移学习能够提高训练效率. 由表3 可以看出,采样类似的数据集进行迁移学习可有效提升训练效率. ...

Inferring imagined speech using EEG signals: a new approach using Riemannian manifold features

1

2017

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

EEG control of a virtual helicopter in 3-dimensional space using intelligent control strategies

1

2010

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

Statistical channel selection method for detecting drowsiness through single-channel EEG-based BCI system

1

2021

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

Adaptive tunable Q wavelet transform-based emotion identification

1

2020

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

Ensemble machine learning-based affective computing for emotion recognition using dual-decomposed EEG signals

1

2021

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

Most popular signal processing methods in motor-imagery BCI: a review and meta-analysis

1

2018

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

1

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

基于言语想象的脑机交互关键技术

1

2022

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

基于言语想象的脑机交互关键技术

1

2022

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

1

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

CNN architectures and feature extraction methods for EEG imaginary speech recognition

1

2022

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

Decoding imagined speech based on deep metric learning for intuitive BCI communication

2

2021

... 脑机接口(brain-computer interface,BCI)旨在提供一种与外界环境互动的沟通媒介[1 ] . 脑电图(electroencephalogram ,EEG)具有经济、便携、时间分辨率高等特点,在智能控制[2 ] 、疲劳检测[3 ] 、情绪识别[4 -5 ] 等领域具有广泛的应用. 目前,比较流行的BCI范式包括运动想象(motor imagery,MI)[6 ] 和语言想象(speech imagery,SI)[7 ] . SI是最新出现的BCI范式之一,它表示在不发出声音或清晰地做出面部动作的情况下想象单词发音的心理过程. 相比于其他的BCI范式,SI是最接近自然的一种沟通通路,因此成为当前的研究热点之一[8 ] . Van Den Berg等 [9 ] 提出基于EEGnet架构的二维卷积神经网络模型,该模型对单词进行4分类,具有29.7%的平均准确率. Rusnac等[10 ] 提出CNN模型,在7个音节与4个单词的群体语言想象脑电信号分类中实现了37.1%的平均准确率. Lee等[11 ] 提出基于瞬时频率和谱熵的Siamese神经网络框架,对群体语言想象脑电信号进行6分类,平均准确率为45.0%. 尽管针对群体语言想象脑电信号的分类准确率取得了较大进步,但离实际应用仍有一定距离,主要原因在于个体的脑电信号之间存在显著差异. ...

... Comparison of classification accuracy of group EEG signals of imagined speech

Tab.2 网络模型 分类形式 A /%VMD-RWE+SVM with RBF kernel[22 ] 6分类 38.2 Siamese neural network framework[11 ] 6分类 44.1 end-to-end Siamese neural network[23 ] 6分类 31.4 Deep CNN[24 ] 6分类 28.4 VGG-16 6分类 46.3 本研究提出的融合CBAM的Inception-V4模型 6分类 52.2

3.5. 结合迁移学习的Inception-v4网络分类性能讨论 如表3 所示为使用迁移学习情况下的训练时间t t 和分类准确率A . “源域”一栏若为“无”表示未使用迁移学习,“使用网络”一栏若为“改Inception-V4”表示使用的网络是本研究提出的融合注意力机制后的Inception-V4模型. ...

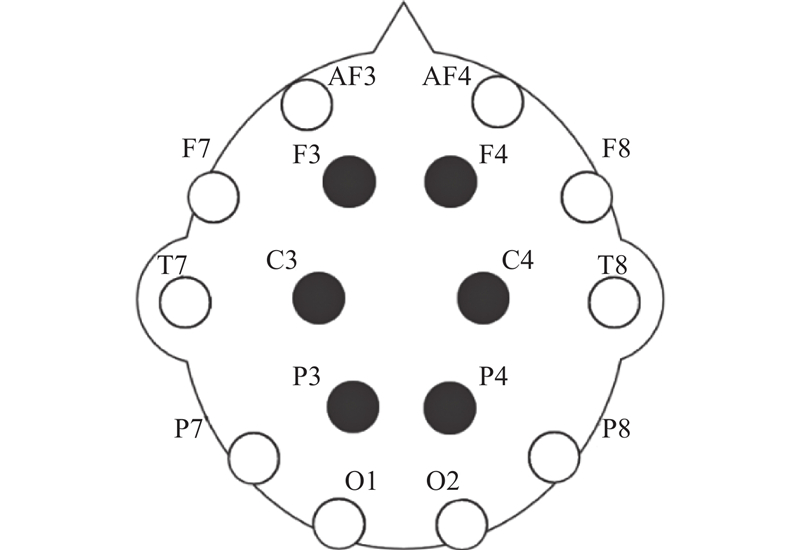

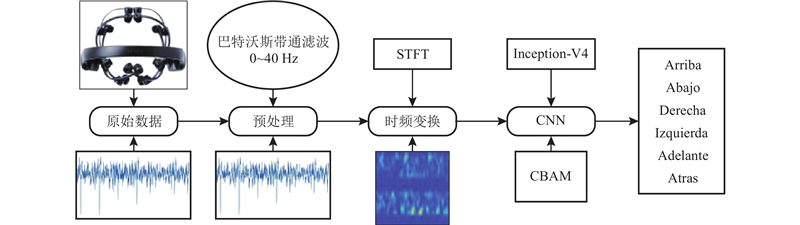

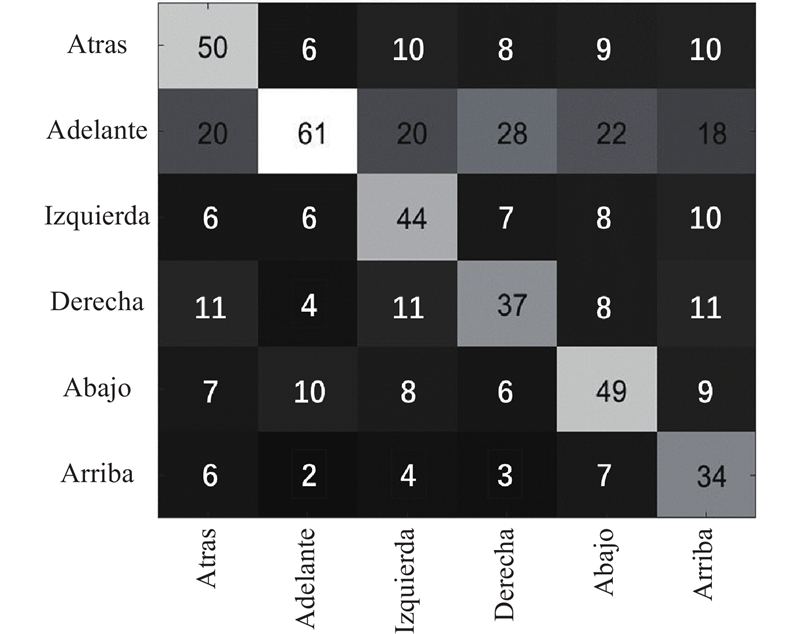

2

... 使用的数据集由Coretto[12 ] 记录,该数据集包含元音和单词想象发音过程中的脑电图信号. 该实验包含了6个西班牙单词,“arriba”、“abajo”、“derecha”、“izquierda”、“adelante” 和 “atras” (分别对应上、下、左、右、后、前6个中文单词). 研究对象包括15名健康的志愿者(7名女性和8名男性). ...

... 脑电信号是非常微弱的生物电信号,易受眨眼、吞咽、晃动等肌肉活动以及电源和声音的干扰. 由于采集设备自带陷波滤波器[12 ] ,而且数据集中的脑电信号已进行了去基线的操作,基线漂移问题已经被解决,因此当受试者想象说话时,大脑语言区域的α 和β 节律频段会出现明显振荡[13 ] . α 和β 节律频段为8~30 Hz,同时对语言想象的研究主要集中在EEG信号的40 Hz以下的频带中,因此采用0~40 Hz的巴特沃斯带通滤波器对原始脑电信号进行滤波. ...

Are alpha and beta oscillations spatially dissociated over the cortex in context-driven spoken-word production?

1

2022

... 脑电信号是非常微弱的生物电信号,易受眨眼、吞咽、晃动等肌肉活动以及电源和声音的干扰. 由于采集设备自带陷波滤波器[12 ] ,而且数据集中的脑电信号已进行了去基线的操作,基线漂移问题已经被解决,因此当受试者想象说话时,大脑语言区域的α 和β 节律频段会出现明显振荡[13 ] . α 和β 节律频段为8~30 Hz,同时对语言想象的研究主要集中在EEG信号的40 Hz以下的频带中,因此采用0~40 Hz的巴特沃斯带通滤波器对原始脑电信号进行滤波. ...

1

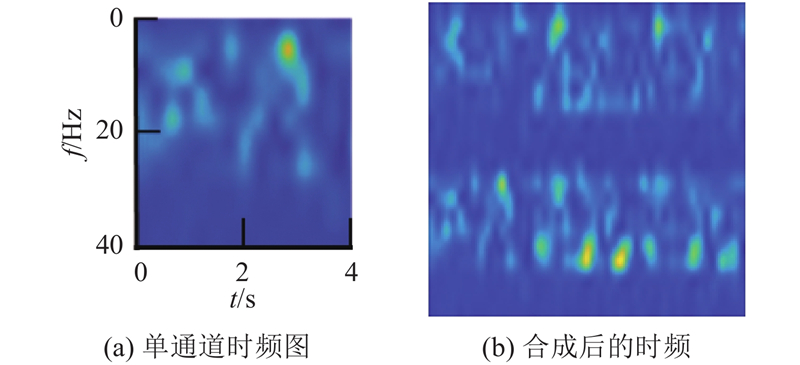

... 脑电信号是一维时域信号,难以直接用于信号分类. 为此,运用短时傅里叶变换(short-time Fourier transform,STFT)将每个通道采集的脑电信号转化为对应的时频图[14 ] . 设原始连续信号为s (τ ),给定一个时间长度较短的窗口,令其沿时间轴移动,则s (τ )的STFT定义如下: ...

Comparative performance analysis of hamming, hanning and blackman window

1

2014

... 选择具有较好的频率分辨率且能减少频谱泄露的Hamming窗函数[15 ] ,如图2 (a)所示显示了一个单通道脑电信号的时频图. 该图像原始大小为20$ \times $ 15 ,随后将其拉伸至299$ \times $ 299. 图中,t 为信号时间,f 为频率(0~40 Hz). ...

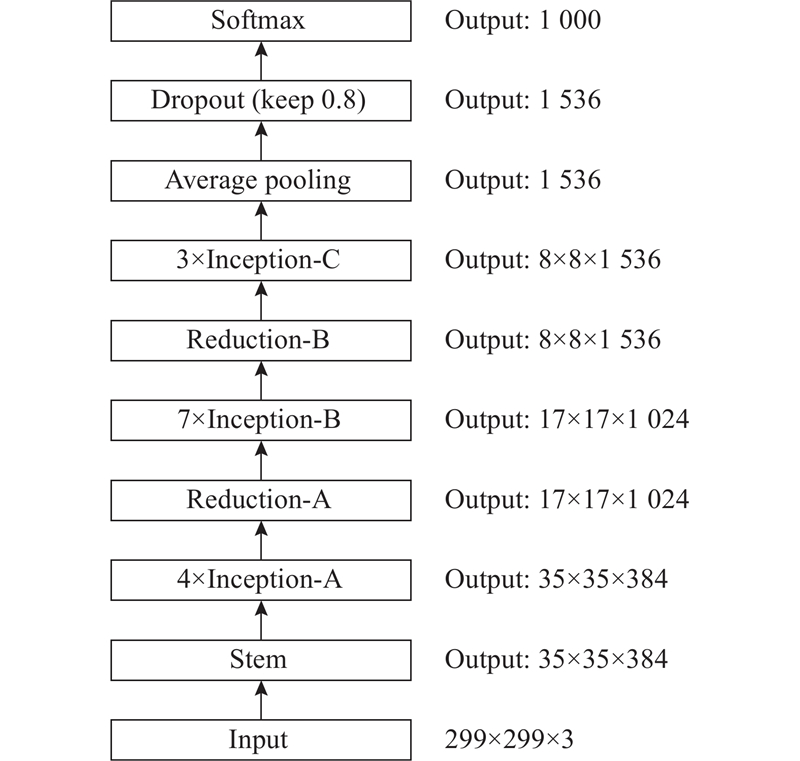

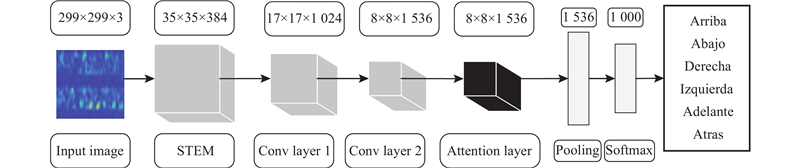

3

... 与VGG16、ResNet、LeNet等其他卷积神经网络相比,Inception-V4[16 ] 网络在2个隐藏层之间嵌入了多个卷积核,这种设计在减少参数量的同时有效提高了网络性能. Inception-V4网络包括Stem、Inception-A、Inception-B、Inception-C、Reduction-A、Reduction-B等关键模块,共有76层,如图3 所示. 其中,Stem模块能够快速降低分辨率,减少后续模块计算量;Inception模块用来学习图片特征;Reduction模块用来改变网络的宽度和高度. ...

... Inception-V4网络框架[16 ] ...

... Network framework of Inception-V4[16 ] ...

Unconscious number discrimination in the human visual system

1

2020

... 注意力在人类视觉系统中起着至关重要的作用[17 ] ,人类不会一次性处理所有的场景. 因此,注意力机制的核心思想是分别通过学习通道注意和空间注意来细化三维特征图,不仅可以告诉神经网络模型须关注的地方,还可以改善特征的表示、抵抗噪音干扰并专注于有效信息. ...