近年来,图像语义分割在医学诊断领域中的应用十分广泛,主要用于解决医学影像中边界模糊、精确度不高和分辨率低等问题. 医学图像分割技术不仅要求网络模型能够精准地分割出具体的病灶位置,细化病灶类别,有助于在临床中进行病理和定量评估,获得更准确的诊断结果与治疗计划[1].

传统的图像分割算法具有分割精度低和适应性差的弱点,基于卷积神经网络(convolutional neural networks,CNN)的深度学习分割算法能够表现出更高的分割精度和适应性,适用于对精度有极高要求的医学图像分割.

Unet虽然在图像分割领域取得了一定的成就,但由于医学图像数据集的不充分,使得Unet网络无法提取到丰富的上下文信息. 在以Unet为变体的更多新结构被提出[5],用以提取和保留更多的重要特征. 如李继凡等[6]提出基于Unet神经网络的多模态颈动脉血管分割;Duan等[7]设计轻量级的SegNet模型,该模型提出新的上采样方法,节省了内存空间,实现了更加高效的网络. 在Unet基础上提出的Unet++网络,使得图像分割技术实现了更大的突破. 该网络通过剪枝,可以加快提取不同层次的特征信息,应用深度监督(deep supervision)有效地解决了不同样本间自适应选取采样深度的问题[8],但存在模型参数量骤增的问题,会导致模型计算成本增大,需要消耗极大的GPU资源. 随着网络模型的不断加深,Tan等[9]引入深度可分离卷积的方法来降低模型的参数,提出基于ACU-Net网络的肿瘤图像分割方法. 基于Unet改进的网络不仅适用于医学图像,还被引入其他领域用于图像分割. Trebing等[10]提出用于降水临近预报的网络SmaAt-Unet,该网络在Unet的基础上加入注意力机制,采用depthwise-separable卷积取代传统的卷积用于. Cao等[11]提出改进的Res-Unet模型,用于高分辨率图像中的树种分类,实验结果表明,该网络可以有效地实现林木数种的分类. He等[12]提出用于遥感图像建筑物分割的一、二阶混合注意Unet. 赵小虎等[13]提出基于Inceptionv3的番茄病害图像分割算法,有效地提高了图像分割精度.

各类图像分割算法具有不同的应用特点,在医学领域具有重要的意义[14]. 本文根据目标几何全局信息的逐层特征融合,提出基于多级特征自适应融合的新型FR-Unet医学图像分割算法. 该模型具有轻量化的特点,能够应用于各种场景分割任务.

1. 本文算法

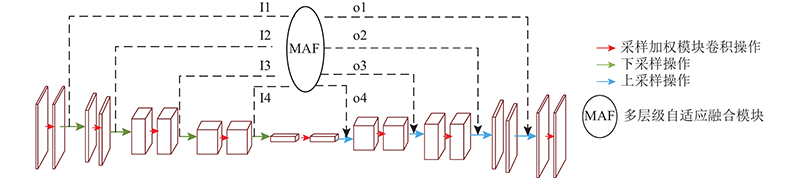

图 1

主要贡献如下.

1)设计非对称特征提取的采样加权模块(sampling weighting module),替代原始Unet的传统卷积层. 利用不同状态处理下的特征逐层输出进行融合来丰富语义信息,对图像空间信息和纹理结构赋以权重,使得每次采样后图像全局信息的对比度更准确,更具参考价值.

2)设计可插拔的多层级自适应融合模块(multi-level adaptive fusion module)来替代原始Unet的跳跃直连,着重要求各层分工明确,不同的非线性连接层主要负责不同的特征提取细节. 根据所处层级自适应融合关联性更强的几个相邻连接层的部分语义信息,提升网络训练过程中的稳定性和准确性,成功与采样部分实现解耦合,有效地避免了网络的盲目训练.

3)在整体结构上引入不同类型的深度可分离卷积,与原始Unet模型相比,在网络训练参数量上缩减了近5倍,提高了网络训练的速度.

2. 相关工作

2.1. 采样加权模块

图 2

图 2 非对称特征提取的采样加权模块结构图

Fig.2 Structure of sampling weighting module for asymmetric feature extraction

图 3

1)主干提取部分. 引入深度可分离卷积层(depthwise convolution,DepthConv),替换单一卷积层Conv+BN+Relu. 常规卷积层的卷积核作用于所有depth方向,DepthConv卷积层不会考虑同一位置、不同Channel上数据之间的关联,内部使用1×1的卷积核数量控制深度,因此能够解决网络训练参数量过大的问题. 每次经过设计好的FR-Conv(1,1)非对称模块,能够有效地避免特征提取过程中感受野单一,导致上下文信息提取不合适的问题.

2)特征融合部分. 在经过深度可分离卷积层后,将未经过Relu线性处理的分支部分,与经过Relu线性处理的主干提取部分进行融合输出. 虽然Relu层能够增强网络的非线性,但训练过程中容易出现梯度为负值时置零的情况;融合后的结构可以有效地缓解图像中出现的高低频特征噪声.

3)注意力机制部分. 将特征分别进行全局最大池化(GlobalMaxPooling,GMP)和全局平均池化(GlobalAveragePooling,GAP),将得到的2个一维向量相加并归一化处理后,增强了每次特征提取时的局部区域信息对比度,改善了采样效果.

2.2. 多层级自适应融合模块

原始的Unet模型在每一次上采样的过程中都会通过跳跃直连和裁剪的方式,加入来自对应收缩路径的特征图. 该方式虽然简单有效,但是存在很明显的缺陷:整体网络过于依赖下采样过程中提取的特征. 一旦下采样特征提取不准确,简单的直连方式导致后续的分割效果不理想. 若在直连过程中简单地利用多尺度模块或注意力机制模块,虽然对最终分割结果有一定的正面效果,但是没有充分利用相邻层的特征信息. 为了解决上述问题,设计多层级自适应融合模块. 设计的模块满足以下特性.

1)非线性跳跃连接层所在的层级不同,关注到的特征信息不同. 越靠近上层采样的连接层,携带越多的是图像的细节纹理信息,如目标的边缘和轮廓;越靠近下层采样的连接层,感受野变大,获取到了更多的深层语义信息和全局信息,可以明确目标在图像中的具体位置. 处于中间层位置的连接层,携带的图像特征虽然不是很清晰,但较全面,通过与相邻层的连接,丰富了对应高层或低层的特征信息.

2)下采样过程中会丢失大量的特征信息且不可逆,但是通过引入多层级自适应融合模块,在一定程度上弥补了丢失的信息,使得整体网络降低了对下采样特征提取的要求,实现了跳跃连接层与下采样部分的解耦性.

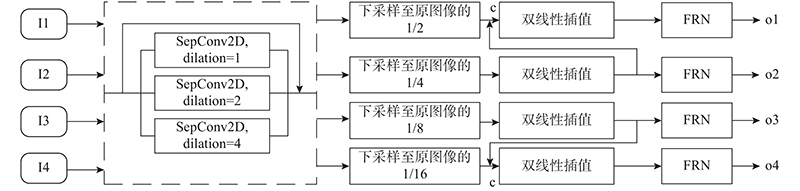

基于以上理念,多层级自适应融合模块的设计如图4所示. 该模块整体结构的设计大致分为以下4个部分.

图 4

图 4 多层级自适应融合模块的结构图

Fig.4 Structure diagram of multi-level adaptive fusion module

1)与传统Conv卷积层不同的是,采用不同空洞率(dilaterate,对应图4的dilation)的深度可分离空洞卷积(separate convolution, SepConv2D),在SepConv2D上使用相同的3×3小感受野,但获得了5×5、9×9感受野的提取效果. 虽然与传统卷积层相比,空洞卷积可能需要有更多的连续内存空间开辟以及设备上能够有更高的硬件支持,但在几乎不影响精度甚至是可以提升的情况下,内部利用网络的稀疏性,避免了单纯增加网络深度会导致训练变缓慢及参数量很大的问题. 引入一次输入层跳跃直连,避免这个过程中信息可能会出现丢失的问题.

2)在经过了空洞卷积层操作之后,不同跳跃连接层均对图像进行不同比例的下采样和双线性插值上采样操作. 其中,层级越高,需要下采样的倍数越高,但是相对原始图像来说,目的是所关注的底层位置特征信息越多. 反之,则关注更多的是高层局部特征信息. 上采样利用双线性插值来避免图像质量损失过大的问题. 该结构类似于FCN网络结构,在消除图像噪声方面有一定的改善.

3)引入自适应残差连接模块. 在没有该部分的时候,以上设计的跳跃连接层虽然带来了比原始跳跃直连更好的处理效果,但受制于下采样加权模块一旦效果不理想引发的高度耦合问题. 在下采样过程中,每层经过空洞卷积特征提取后,均通过非线性跳跃连接,使得最浅层和最深层的特征分别与信息最相近的相邻连接层进行有目的的图像样本融合后,传输给对应的上采样层. 在上采样的过程中,每一层均在不同程度上关注了图像的全局信息,实现了与下采样加权模块的解耦合,降低了训练效果对下采样层的依赖性. 多层级自适应融合模块作为可插拔模块,可以迁移到其他的网络中进行使用.

4)引入FRN[16]层,替换BN层. 与传统的Conv+BN+Relu模块不同的是,FRN层没有直接使用Relu函数作为激活函数,在Relu的基础上引入可学习的阈值,避免了模型在Relu函数出现零值时导致模型训练效果不佳的问题. 与采样加权模块相比,自适应模块部分引入不同卷积率的空洞卷积,使得该模块的参数量明显增大. 当batch size过大时,在网络训练的过程中会加剧内存的消耗,导致训练效果不佳. FRN层相较于BN层而言,可以极大程度地消除模型在训练过程中对batch size的依赖性. 在该模块上引入FRN层,虽然在精度上无法带来明显的提升,但在一定程度上平衡了软硬件的资源消耗引发的问题.

3. 实验方法和结果

3.1. 数据集和图像预处理

为了验证提出模型的有效性,分别在3种不同类型的数据集上进行相关的实验.

数据集1:ISBI challenge dataset. 数据集1是ISBI挑战赛中用于分割电子显微镜堆栈中的神经元结构的数据集. 训练数据共包含30张果蝇的电镜图,分辨率均为512×512. 数据集中,黑色表示细胞膜,白色表示细胞. 将数据集一共划分为3个部分:训练集、验证集和测试集.

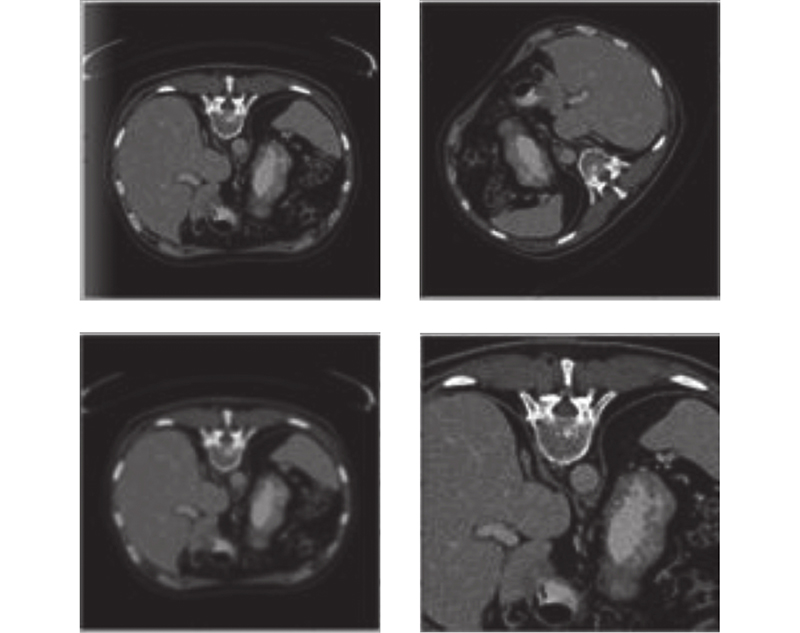

数据集2:The Liver dataset. 数据集2为400个人的肝脏CT图像,图像和分割掩码的分辨率均为512×512,肝脏在形状、大小和位置上均存在差异. 肝脏的形状在不同情况下有很大的不同,肝脏与胃肠道、胃等附近组织非常相似. 为了生成较准确的分割掩码,放射学专家手工绘制了所有图像的肝轮廓横切切片.

数据集3:Lesion boundary segmentation. 数据集3选自ISIC收集的大量皮肤镜图,由2 594张皮肤癌患筛查的样本图像组成. 所有图像均标注了Ground Truth的二值Mask,指出了原发皮肤损伤的位置. 为了方便测试,随机选取一定量的各种类型的皮肤癌患样本. 经过预处理后,将数据集分为3个部分:训练集、验证集和测试集.

图像预处理的主要目的是消除图像中无关的信息,恢复有用真实的信息,增强有关信息的可检测性,最大限度地简化数据,改善数据集不充足的情况. 通过对数据集进行随机旋转、高斯模糊、缩放和中心裁剪等操作,增加训练集的数量. 数据集预处理中的示例如图5所示.

图 5

3.2. 评价指标

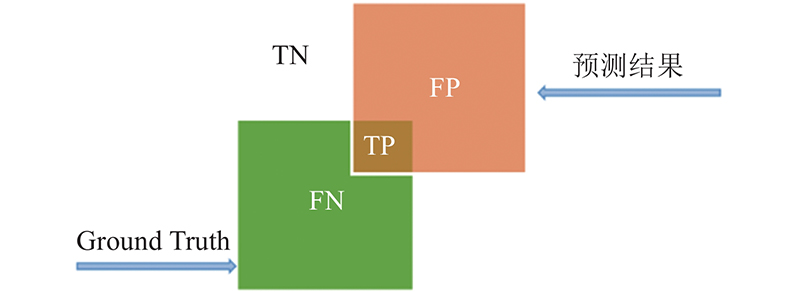

图6中,Ground Truth为人工标记得到的真值图. 根据预测结果与真值图的结合,可以将每个像素分为被预测为正样本但预测是假的(FP)、被预测为正样本且预测是真的(TP)、被预测为负样本但预测是假的(FN)和被预测为负样本但预测是真的(TN)4种情况.

图 6

为了评估模型的性能,采用以下4个指标:Dice系数、召回率、精度、IOU.Dice系数通常用于计算2个样本的相似度,为0~1.0,分割结果的Dice系数理论期望值为1,如下所示:

IOU分数是对象类别分割的标准性能度量,IOU测量给出在该组图像中存在的对象预测区和Ground Truth区域之间的相似性,即模型产生的目标区域和原来标记区域的交并比,如下所示:

式中:P为查准率,R为查全率.

小目标图像分割是指图像中往往只存在1个或2个目标,目标像素比例较小,使得网络训练较困难. 为了解决该问题,通常使用设计合理的损失函数. 医学图像分割常用的指标Dice Loss是基于区域的损失函数,在正负样本不平衡的场景下虽然可以提升性能,但容易出现训练不稳定、极端情况下梯度饱和的现象. 与Dice损耗不同的是,交叉熵损耗是基于分布的损失函数,它会对不平衡分割任务进行重新加权. 采用由Dice损耗和交叉熵损耗组成的联合损耗,完成所有的分割任务. 损失函数为

式中:λ为交叉熵损失和Dice损失之间的权衡系数,将

式中:N为总样本数;si为样本i预测为正类的概率;gi为真实值(取值为0或1),若第i个样本为正类,则对应位置的gi取值为1,否则为0. 为了公平比较,本文实验中的所有分割任务均使用相同的损失函数.

3.3. 模型参数量的对比

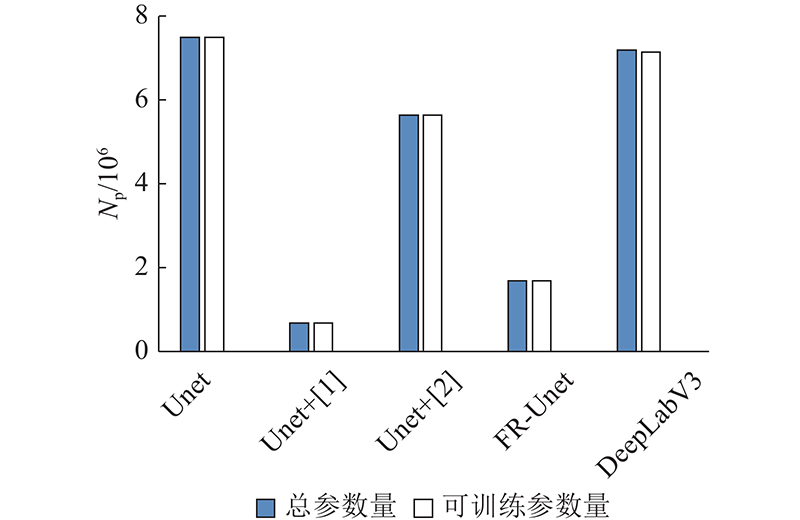

分别对原始Unet结构、具备融合特性的经典网络DeepLabV3及提出的FR-Unet网络,进行相同输入环境条件下模型参数训练量的对比. 其中,Unet+[1]指将本文设计的采样加权模块替换原始Unet网络的特征提取部分. Unet+[2]指将本文设计的多层级自适应融合模块替换原始Unet网络的跳跃连接部分. 如图7所示,本文设计的模块与原始模型相比,均在一定程度上提升了网络的性能,整体构建的FR-Unet模型由于引入不同结构的深度可分离卷积,在网络参数量Np上较原始模型和DeepLabV3缩减了将近4.4倍.

图 7

3.4. 实验数据对比

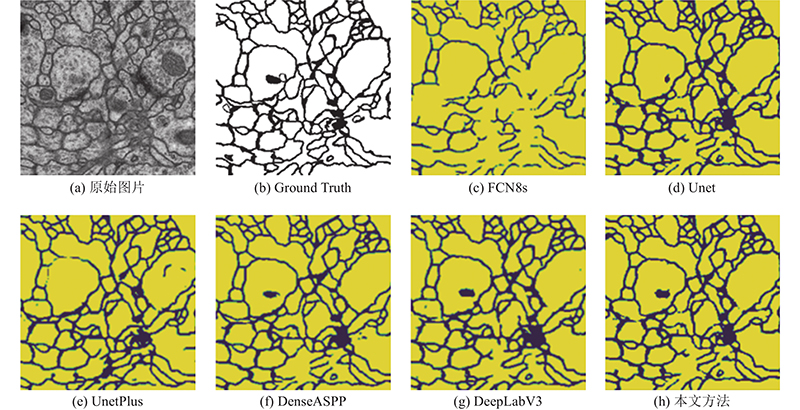

数据集1上的数据对比结果如表1所示. FCN和Unet的模型表现相对较差. 传统模型中的UnetPlus、DenseASPP和DeepLabV3,在该数据集上的各项指标均有明显的提升,尤其是DeepLabv3网络. 相比之下,UnetPlus在L指标上比DenseASPP和DeepLabV3模型差. 在Unet模型的基础上,当使用设计好的各个单一模块分别替换原有基础模块进行训练时,各项指标均有明显的改善,但在L指标上较UnetPlus没有明显的降低. 将设计好的各模块都融入到Unet模型后,即FR-Unet,解决了L指标迭代下降不明显的问题. 在IOU和L指标上的表现优于传统模型中的DeepLabV3,分别为0.989 8和0.000 1. 在Dice和P指标上略低于后者,达到0.988 2和0.999 2. 数据集1(ISBI challenge dataset)上的实际分割效果如图8所示,FCN8s和Unet模型由于缺乏有效的上下文语义信息,导致分割结果不佳. UnetPlus、DenseASPP、DeepLabV3等模型虽然在极大程度上提取到了样本的语义信息,但在分割精度上差于本文提出的FR-Unet模型.

表 1 动物细胞分割任务对比试验和消融研究结果

Tab.1

| 方法 | IOU | Dice | L | P | tr/ms |

| FCN | 0.7421 | 0.8320 | 0.0661 | 0.8751 | 67 |

| Unet | 0.8705 | 0.9207 | 0.0637 | 0.9187 | 74 |

| UnetPlus | 0.9858 | 0.9879 | 0.0020 | 0.9891 | 141 |

| DenseASPP | 0.9862 | 0.9898 | 0.0003 | 0.9999 | 588 |

| DeepLabV3 | 0.9874 | 0.9898 | 0.0002 | 0.9999 | 626 |

| Base(Unet) | 0.8705 | 0.9207 | 0.0637 | 0.9187 | 74 |

| Base+采样加权模块 | 0.9584 | 0.9786 | 0.0334 | 0.9467 | 64 |

| Base+多层级自适应融合模块 | 0.9650 | 0.9647 | 0.0398 | 0.9374 | 509 |

| 本文方法 | 0.9898 | 0.9882 | 0.0001 | 0.9992 | 288 |

图 8

图 8 数据集1在不同算法上的分割对比图

Fig.8 Comparison chart of segmentation of dataset 1 on different algorithms

数据集2上的数据对比结果如表2所示,DeepLabV3模型在各项指标上的表现优于其他给定的传统模型,在该数据集上有明显的指标优势. 当对Unet基础模型加以不同的单一模块时,各项指标都相较于之前有明显改善. 对于最终的FR-Unet模型,在IOU上的评价指标值略低于DeepLabV3,差值小于0.5%. 在Dice、L和P等指标上均优于其他模型,在数据上有明显优势.

表 2 肝脏分割任务对比试验和消融研究结果

Tab.2

| 方法 | IOU | Dice | L | P | tr/ms |

| FCN | 0.7834 | 0.8473 | 0.0611 | 0.8679 | 65 |

| Unet | 0.8388 | 0.8667 | 0.0634 | 0.8786 | 76 |

| UnetPlus | 0.9041 | 0.9163 | 0.0502 | 0.8994 | 149 |

| DenseASPP | 0.9072 | 0.9474 | 0.0405 | 0.9267 | 592 |

| DeepLabV3 | 0.9541 | 0.9513 | 0.0378 | 0.9451 | 631 |

| Base(Unet) | 0.8388 | 0.8667 | 0.0634 | 0.8786 | 76 |

| Base+采样加权模块 | 0.9127 | 0.9479 | 0.0527 | 0.9114 | 60 |

| Base+多层级自适应融合模块 | 0.9433 | 0.9487 | 0.0401 | 0.9421 | 510 |

| 本文方法 | 0.9437 | 0.9623 | 0.0279 | 0.9536 | 289 |

数据集2上的实际分割效果如图9所示,对于复杂的医学样本,上述的传统网络模型在分割表现上均不是很理想. 主要原因是模型没有充分地提取有效的上下文语义信息,伴随的干扰噪声信息过多.

图 9

图 9 数据集2在不同算法上的分割对比图

Fig.9 Comparison chart of segmentation of dataset 2 on different algorithms

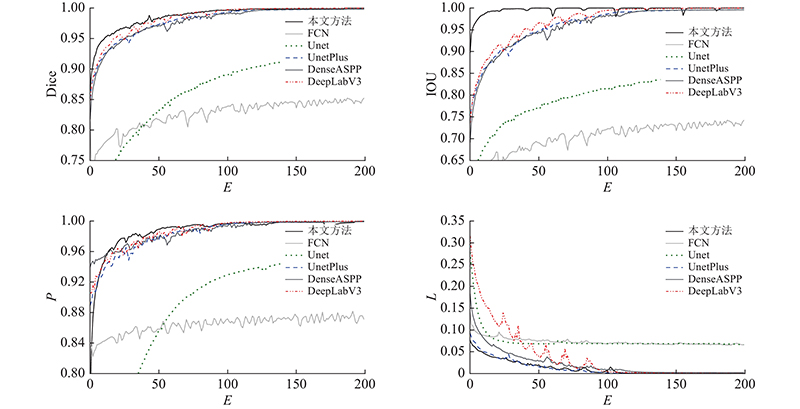

利用设计的FR-Unet模型,解决了传统模型出现的问题,提升了网络分割的精度,改善了实际分割图的分割结果. 在病变区域不确定的皮肤癌数据集上进行不同网络模型的训练,各项评价指标的对比曲线结果如图10所示. 图中,E为训练轮次. 结果表明,FR-Unet模型针对各个指标的曲线图均优于其他模型,模型的稳定性较高. 与DeepLabV3不同的是,本文模型在几乎不降低分割精度的情况下,轻量化了网络,提升了训练速度.

图 10

图 10 不同分割算法的客观评价指标图

Fig.10 Graph of objective evaluation indexes of different segmentation algorithms

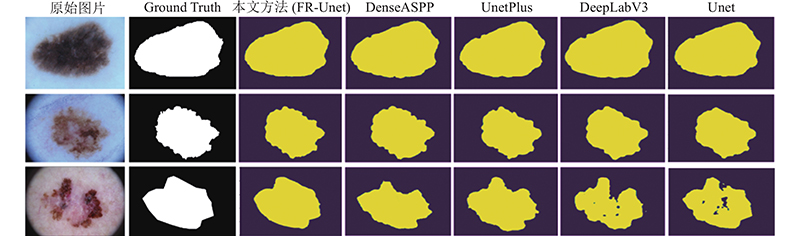

不同的模型对于数据集3的分割测试结果如图11所示. 结果表明,对于皮肤癌患部位较明显的区域及病变区域较集中的情况,不同模型的分割效果都较理想. 在癌患症状的部位较分散或者病变区域对比度不明显的复杂情况下,FR-Unet模型的分割效果显著优于其他模型.

图 11

图 11 数据集3在不同算法上的分割对比图

Fig.11 Comparison chart of segmentation of dataset 3 on different algorithms

4. 结 语

针对医学图像对比度低、病变区域复杂、边界模糊、数据集小样本和难以训练等问题,本文提出基于多级特征自适应融合的深度学习模型FR-Unet. 在采样过程中引入设计好的采样加权模块,自主选择聚焦位置,产生更具分辨率的特征表示. 引入设计的多层级自适应融合模块,根据层级融合不同采样率的图像特征,减少网络的盲目训练,提高了收敛速度,实现了对采样加权模块的解耦合,提升了网络的稳定性. FR-Unet模型在ISBI challenge dataset、The Liver dataset、Lesion boundary segmentation数据集上进行评估,实现了较高的分割精度. 在实际应用中,带标签的样本要耗费大量的人工成本,引入无监督、半监督或弱监督的分割方法是进一步的研究方向.

参考文献

深度学习在医学影像中的应用研究进展

[J].

Research advances in the application of deep learning in medical imaging

[J].

Deep learning for cardiac image segmentation: a review

[J].DOI:10.3389/fcvm.2020.00025 [本文引用: 1]

基于U-Net神经网络的多模态MR颈动脉血管成像的分割方法研究

[J].

Study on segmentation method of multimodal MR carotid angiography based on U-Net neural network

[J].

Field rice panicle segmentation based on deep full convolutional neural network

[J].

Multimodal magnetic resonance image brain tumor segmentation based on ACU-net network

[J].DOI:10.1109/ACCESS.2021.3052514 [本文引用: 1]

SmaAt-U-net: precipitation nowcasting using a small attention-U-net architecture

[J].

An improved Res-UNet model for tree species classification using airborne high-resolution images

[J].DOI:10.3390/rs12071128 [本文引用: 1]

Hybrid first and second order attention U-net for building segmentation in remote sensing images

[J].

基于改进U-Net网络的多尺度番茄病害分割算法

[J].DOI:10.3778/j.issn.1002-8331.2105-0201 [本文引用: 1]

Multiscale tomato disease segmentation algorithm based on improved U-Net network

[J].DOI:10.3778/j.issn.1002-8331.2105-0201 [本文引用: 1]

U-Net网络医学图像分割应用综述

[J].

A review of U-Net network medical image segmentation applications

[J].

Image segmentation using deep learning: a survey

[J].

一种基于SSD与FRN相结合的密集连接行人检测算法

[J].

A densely connected pedestrian detection algorithm based on the combination of SSD and FRN

[J].

Ultrasound image segmentation method for thyroid nodules using ASPP fusion features

[J].DOI:10.1109/ACCESS.2020.3022249 [本文引用: 1]