[1]

谭建荣, 张树有, 陆国栋. 图学基础教程[M]. 北京: 高等教育出版社, 2006.

[本文引用: 1]

[2]

费少梅, 陆国栋, 顾大强 时空融合知行耦合的机械大类课程教学新范式探索实践

[J]. 高等工程教育研究 , 2017 , (6 ): 76 - 80

[本文引用: 1]

FEI Shao-mei, LU Guo-dong, GU Da-qiang Exploration and practice of a new teaching paradigm of mechanical courses based on the integration of time and space, knowledge and practice

[J]. Research on Higher Engineering Education , 2017 , (6 ): 76 - 80

[本文引用: 1]

[3]

SANCHEZ J, MONZON N, AGUSTIN S An analysis and implementation of the Harris corner detector

[J]. Image Processing On Line , 2018 , 8 : 305 - 328

DOI:10.5201/ipol.2018.229

[本文引用: 1]

[4]

冯毅雄, 李康杰, 高一聪, 等 面向视觉伺服的工业机器人轮廓曲线角点识别

[J]. 浙江大学学报:工学版 , 2020 , 54 (8 ): 6 - 13

FENG Yi-xiong, LI Kang-jie, GAO Yi-cong, et al Corner recognition of industrial robot contour curve for visual servo

[J]. Journal of Zhejiang University: Engineering Science , 2020 , 54 (8 ): 6 - 13

[5]

冯毅雄, 李康杰, 高一聪, 等 基于特征与形貌重构的轴件表面缺陷检测方法

[J]. 浙江大学学报:工学版 , 2020 , 54 (3 ): 427 - 434

[本文引用: 1]

FENG Yi-xiong, LI Kang-jie, GAO Yi-cong, et al The method of surface defect detection of shaft parts based on feature and morphology reconstruction

[J]. Journal of Zhejiang University: Engineering Science , 2020 , 54 (3 ): 427 - 434

[本文引用: 1]

[6]

KYEONG K, KIM H Classification of mixed-type defect patterns in wafer bin maps using convolutional neural networks

[J]. IEEE Transactions on Semiconductor Manufacturing , 2018 , 31 (3 ): 395 - 402

DOI:10.1109/TSM.2018.2841416

[本文引用: 1]

[7]

LEE H, KIM Y, KIM C O A deep learning model for robust wafer fault monitoring with sensor measurement noise

[J]. IEEE Transactions on Semiconductor Manufacturing , 2017 , 30 (2 ): 23 - 31

[8]

SUDHA S, VIDHYALAKSHMI M, PAVITHRA K, et al. An automatic classification method for environment: Friendly waste segregation using deep learning [C]// 2016 IEEE Technological Innovations in ICT for Agriculture and Rural Development (TIAR) . Chennai: IEEE, 2016: 65-70.

[本文引用: 1]

[9]

DELATTE D M, CRITES S T, GUTTENBERG N, et al Segmentation convolutional neural networks for automatic crater detection on Mars

[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing , 2019 , 12 (8 ): 2944 - 2957

DOI:10.1109/JSTARS.2019.2918302

[本文引用: 1]

[10]

JIN Y, HE F, LIU S, et al. Small scale crater detection based on deep learning with multi-temporal samples of high-resolution images [C]// 2019 10th International Workshop on the Analysis of Multitemporal Remote Sensing Images . Shanghai: IEEE, 2019: 1-4.

[本文引用: 1]

[11]

PALESTRA G, PETTINICCHIO A. Improved performance in facial expression recognition using 32 geometric features [C]∥International Conference on Image Analysis and Processing . Genova: ICIAR, 2015: 518-528.

[本文引用: 1]

[12]

ZHANG Z, JAISWAL P, RAI R FeatureNet: machining feature recognition based on 3D convolution neural network

[J]. Computer-Aided Design , 2018 , 101 : 12 - 22

DOI:10.1016/j.cad.2018.03.006

[本文引用: 1]

[13]

NATARAJAN V, HUNG T Y, VAIKUNDAM S, et al. Convolutional networks for voting-based anomaly classification in metal surface inspection [C]// IEEE International Conference on Industrial Technology . Toronto: IEEE, 2017.

[本文引用: 1]

[14]

魏域君. 顾及几何与拓扑特征的深度学习遥感影像道路提取[D]. 武汉: 武汉大学, 2020.

[本文引用: 1]

WEI Yu-jun. Road extraction from remote sensed imagery based on deep learning considering geometric and topological properties [D]. Wuhan: Wuhan University, 2020.

[本文引用: 1]

[15]

韩丽, 朴京钰, 兰鹏燕, 等 结构感知深度学习的三维形状分类方法

[J]. 计算机辅助设计与图形学学报 , 2021 , 33 (1 ): 29 - 38

DOI:10.3724/SP.J.1089.2021.18280

[本文引用: 1]

HAN Li, PIAO Jing-yu, LAN Peng-yan, et al 3D shape classification method based on shape-aware deep learning

[J]. Journal of Computer-Aided Design and Computer Graphics , 2021 , 33 (1 ): 29 - 38

DOI:10.3724/SP.J.1089.2021.18280

[本文引用: 1]

[16]

李军军, 曹建农, 朱莹莹, 等 高分辨率遥感影像建筑区域局部几何特征提取

[J]. 遥感学报 , 2020 , 24 (3 ): 233 - 244

[本文引用: 1]

LI Jun-jun, CAO Jian-nong, ZHU Ying-ying, et al Built-up area detection from high resolution remote sensing images using geometric features

[J]. Journal of Remote Sensing , 2020 , 24 (3 ): 233 - 244

[本文引用: 1]

[17]

SONG R, XIAO Z, LIN J, et al CIES: cloud-based intelligent evaluation service for video homework using CNN-LSTM network

[J]. Journal of Cloud Computing , 2020 , 9 (1 ): 1 - 9

[本文引用: 1]

[18]

LIN J, ZHAO Y, LIU C, et al Abnormal video homework automatic detection system

[J]. Journal of Ambient Intelligence and Humanized Computing , 2021 , 12 (12 ): 10529 - 10537

DOI:10.1007/s12652-020-02860-9

[本文引用: 1]

[19]

JING S, SANTOS O C, BOTICARIO J G, et al. Automatic grading of short answers for MOOC via semi-supervised document clustering [C]// International Conference on Educational Data Mining . Madrid: EDM, 2015: 554-555.

[本文引用: 1]

[20]

张旻. 智能图像识别在初中几何自动阅卷中的应用研究[D]. 北京: 北京工业大学, 2019.

[本文引用: 1]

ZHANG Min. Research of application for intelligent image recognition in junior high school geometry automatic marking[D]. Beijing: Beijing University of Technology, 2019.

[本文引用: 1]

[21]

李万秋. 机械基础类客观题及图形改判题阅卷系统的关键技术研究[D]. 广州: 华南理工大学, 2019.

[本文引用: 1]

LI Wan-qiu. Study on key techniques of marking system for objective questions and figure correction questions in basic mechanical courses[D]. Guangzhou: South China University of Technology, 2019.

[本文引用: 1]

[22]

沈银燕. 基于网络的建筑CAD考试系统的设计与实现[D]. 杭州: 浙江工业大学, 2009.

SHEN Yin-yan. The design and implementation of the examination system of architectural CAD based on web [D]. Hangzhou: Zhejiang University of Technology, 2009.

[23]

易琳. CAD教学中考试及自动评卷系统的研究[D]. 成都: 电子科技大学, 2007.

[本文引用: 1]

YI Lin. The research on the system of examination and automatic marking in cad teaching [D]. Chengdu: University of Electronic Science and Technology of China, 2007.

[本文引用: 1]

[24]

CANNY J A computational approach to edge detection

[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence , 1986 , 8 (6 ): 679 - 698

[本文引用: 1]

[25]

OTSU N A threshold selection method from gray-level histograms

[J]. IEEE Transactions on Systems Man and Cybernetics , 2007 , 9 (1 ): 62 - 66

[本文引用: 1]

[26]

HUANG G, LIU Z, VAN D M, et al. Densely connected convolutional networks [C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition . Honolulu: IEEE, 2017: 4700-4708.

[本文引用: 1]

[27]

SIMONYAN K, ZISSERMAN A Very deep convolutional networks for large-scale image recognition

[J]. Computer Science , 2014 , 34 (2 ): 1409 - 1422

[本文引用: 1]

[28]

HE K, ZHANG X, REN S, et al. Deep residual learning for image recognition [C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition . Las Vegas: [s. n.], 2016: 770-778.

[本文引用: 1]

1

... 机械图样是机械产品的生产依据,标准化制图是保证产品图样正确、完整、统一的重要基础,对产品设计、制造和检验三者之间信息传递有重要意义[1 ] . 机械制图中字体、线型、可见性、图面布局等问题,导致识图错误,影响产品的生产质量. 机械制图包括手工仪器制图和计算机辅助CAD制图. 虽然计算机辅助CAD制图已经在机械制图过程中广泛应用,但手工仪器制图作为工程技术人员必须要掌握的机械制图的基本技能,是计算机辅助设计的重要基础. 针对机械图样几何特征种类多、线条线型易混淆、人工制图风格多样的特点,传统的人工校阅模式,不但工作强度大,而且校对效率低,存在误检、漏检严重的情况[2 ] . ...

时空融合知行耦合的机械大类课程教学新范式探索实践

1

2017

... 机械图样是机械产品的生产依据,标准化制图是保证产品图样正确、完整、统一的重要基础,对产品设计、制造和检验三者之间信息传递有重要意义[1 ] . 机械制图中字体、线型、可见性、图面布局等问题,导致识图错误,影响产品的生产质量. 机械制图包括手工仪器制图和计算机辅助CAD制图. 虽然计算机辅助CAD制图已经在机械制图过程中广泛应用,但手工仪器制图作为工程技术人员必须要掌握的机械制图的基本技能,是计算机辅助设计的重要基础. 针对机械图样几何特征种类多、线条线型易混淆、人工制图风格多样的特点,传统的人工校阅模式,不但工作强度大,而且校对效率低,存在误检、漏检严重的情况[2 ] . ...

时空融合知行耦合的机械大类课程教学新范式探索实践

1

2017

... 机械图样是机械产品的生产依据,标准化制图是保证产品图样正确、完整、统一的重要基础,对产品设计、制造和检验三者之间信息传递有重要意义[1 ] . 机械制图中字体、线型、可见性、图面布局等问题,导致识图错误,影响产品的生产质量. 机械制图包括手工仪器制图和计算机辅助CAD制图. 虽然计算机辅助CAD制图已经在机械制图过程中广泛应用,但手工仪器制图作为工程技术人员必须要掌握的机械制图的基本技能,是计算机辅助设计的重要基础. 针对机械图样几何特征种类多、线条线型易混淆、人工制图风格多样的特点,传统的人工校阅模式,不但工作强度大,而且校对效率低,存在误检、漏检严重的情况[2 ] . ...

An analysis and implementation of the Harris corner detector

1

2018

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

面向视觉伺服的工业机器人轮廓曲线角点识别

0

2020

面向视觉伺服的工业机器人轮廓曲线角点识别

0

2020

基于特征与形貌重构的轴件表面缺陷检测方法

1

2020

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

基于特征与形貌重构的轴件表面缺陷检测方法

1

2020

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

Classification of mixed-type defect patterns in wafer bin maps using convolutional neural networks

1

2018

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

A deep learning model for robust wafer fault monitoring with sensor measurement noise

0

2017

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

Segmentation convolutional neural networks for automatic crater detection on Mars

1

2019

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

FeatureNet: machining feature recognition based on 3D convolution neural network

1

2018

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

结构感知深度学习的三维形状分类方法

1

2021

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

结构感知深度学习的三维形状分类方法

1

2021

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

高分辨率遥感影像建筑区域局部几何特征提取

1

2020

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

高分辨率遥感影像建筑区域局部几何特征提取

1

2020

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

CIES: cloud-based intelligent evaluation service for video homework using CNN-LSTM network

1

2020

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

Abnormal video homework automatic detection system

1

2021

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

1

... 近年来,基于机器学习的几何特征提取[3 -5 ] 与自动评阅技术[6 -8 ] 引起了学术界和工业界的广泛关注. 在基于机器学习的几何特征提取技术方面,Delatte等[9 ] 提出基于Crater U-Net新型卷积神经网络方法,用于空间对象的几何特征提取与识别. Jin等[10 ] 提出基于深度神经网络的高分辨率图像中小规模几何特征自动检测方法,通过使用多时间样本提取技术,有效地提高了识别准确率. Palestra等[11 ] 提出基于特征组合的几何特征提取方法,将线性特征、多边形特性、椭圆特征和斜率特征组合作为识别分类特征,使用纹理特征减少了角度、尺度变化的干扰. Zhang等[12 ] 提出新型的深度三维卷积神经网络(there dimension-convolutional neural networks, 3D-CNN)框架,从CAD模型的几何特征中识别出加工特征. Natarajan等[13 ] 将多投票机制应用于卷积神经网络的特征提取模型,有效消除了模型的过拟合. 魏域君[14 ] 提出基于几何特征的影像中心线和边线提取算法,并根据提取的几何特征生成结构拓扑. 韩丽等[15 ] 提出基于联合学习三维模型的几何结构和空间结构感知的特征提取方法,对于复杂拓扑结构、大尺度几何形变的三维形状具有较高稳定性和较高的分类精度. 李军军等[16 ] 提出基于多尺度Gabor变换和感知聚类的自适应局部几何不变特征检测方法. 在基于机器学习的自动评阅技术方面,Song等[17 ] 提出基于网络云架构的长短期记忆卷积神经网络(convolutional neural networks-long short-term memory, CNN-LSTM)网络,对作业进行正误判别. Lin等[18 ] 提出异常视频作业自动检测系统,实现对异常视频作业的自动检测和反馈,提高了作业评分效率. Jing[19 ] 提出基于非负半监督文档聚类的智能评阅方法,设计了针对短答案的自动评分方法,实现了MOOC作业的自动评分. 张旻[20 ] 提出基于卷积神经网络的手绘几何图形识别算法,实现了初中几何主观题中复杂几何图形的高效识别. 李万秋等[21 -23 ] 通过将CAD图像预处理成图形数据,实现了自动评阅. ...

A computational approach to edge detection

1

1986

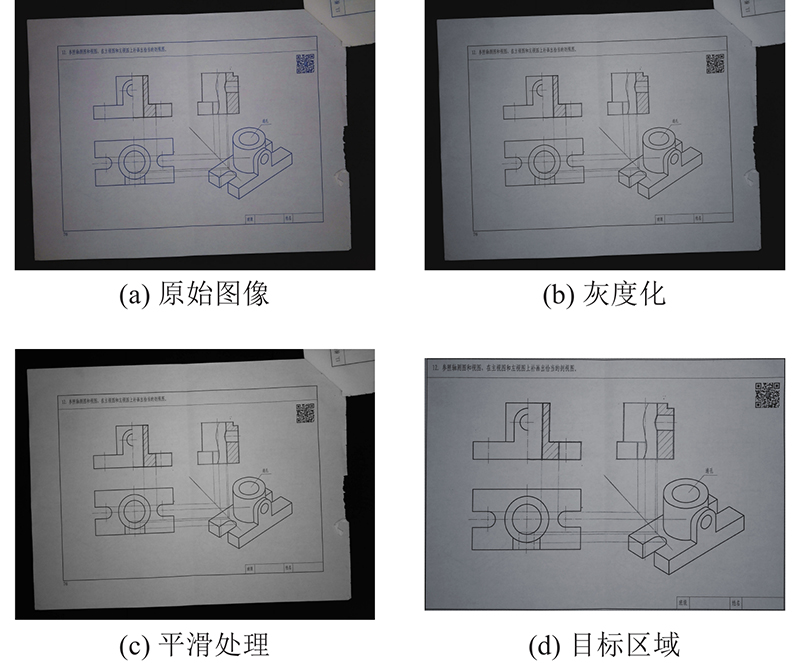

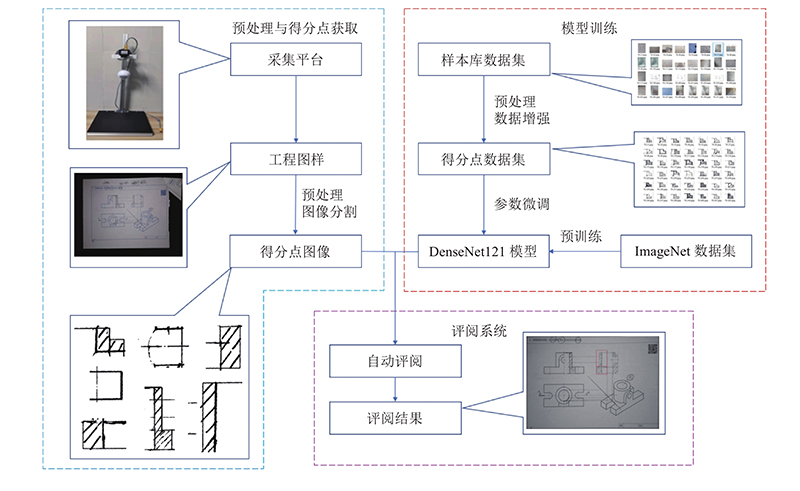

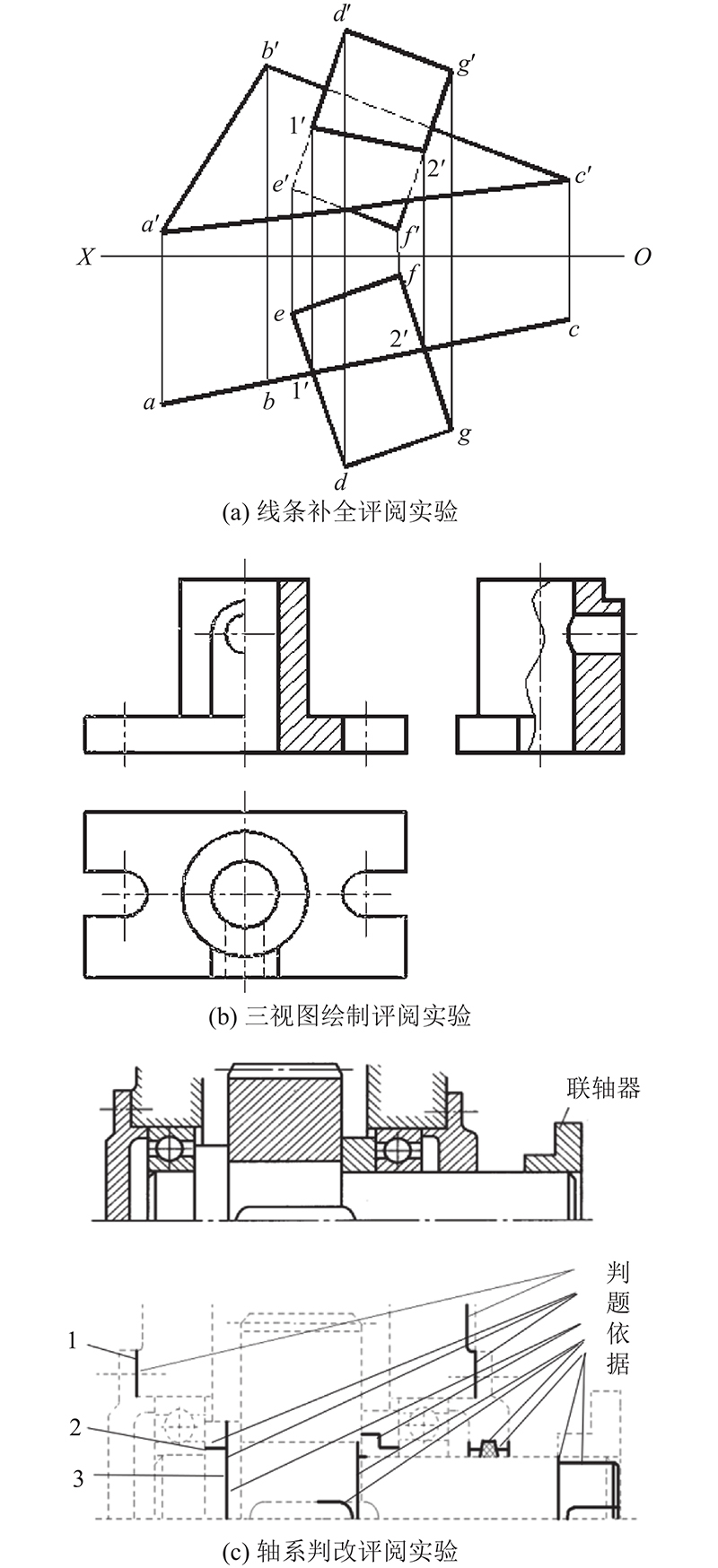

... 机械制图的评阅须考虑几何特征,对图像的颜色信息不敏感,因此先将图像进行灰度变换得到灰度图像,减少后续操作的计算量. 同时,增强图像的对比度,减少不同颜色线型间的差异,原始图像和灰度处理后的结果如图1 (a)、(b)所示. 由于初始图像中包含噪声干扰,如多余笔画、橡皮擦痕迹,须对图像进行平滑滤波处理. 使用高斯滤波进行处理可以有效消除噪声,并保护线条边缘信息,滤波处理后的结果如图1 (c)所示. 在拍摄时纸张相对镜头的摆放位置不固定,导致同一图案在图像上的坐标位置不同,须进行图像校正. 使用定位点进行图像校正是最常见的方法,但纸质作业没有定位点,无法采用该方法进行定位. 考虑到机械制图时存在矩形外框,因此可以通过寻找矩形边框的方法实现定位校正. 通过Canny算子[24 ] 进行图像边缘提取,提取出所有的连通域,并舍弃面积小于阈值的区域,剩余区域中面积最小的就是目标区域. 在获得目标区域的角点坐标之后进行仿射变换,完成图像校正,并将目标区域调整为固定大小,保证同一机械图样内得分点目标区域坐标相同. 经过目标区域提取并经过仿射变换处理后的图像如图1 (d)所示. ...

A threshold selection method from gray-level histograms

1

2007

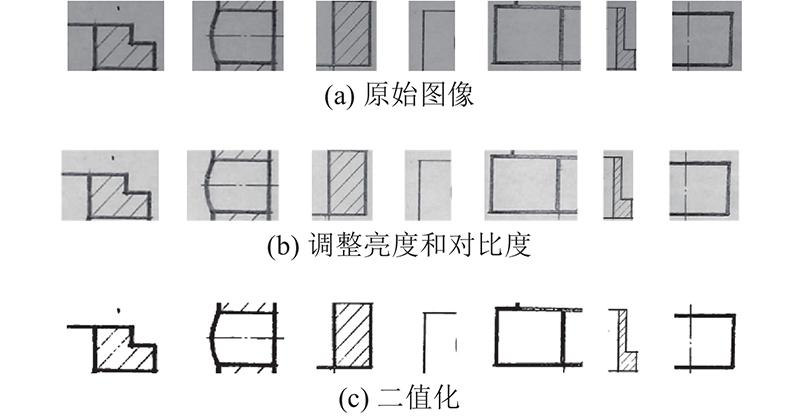

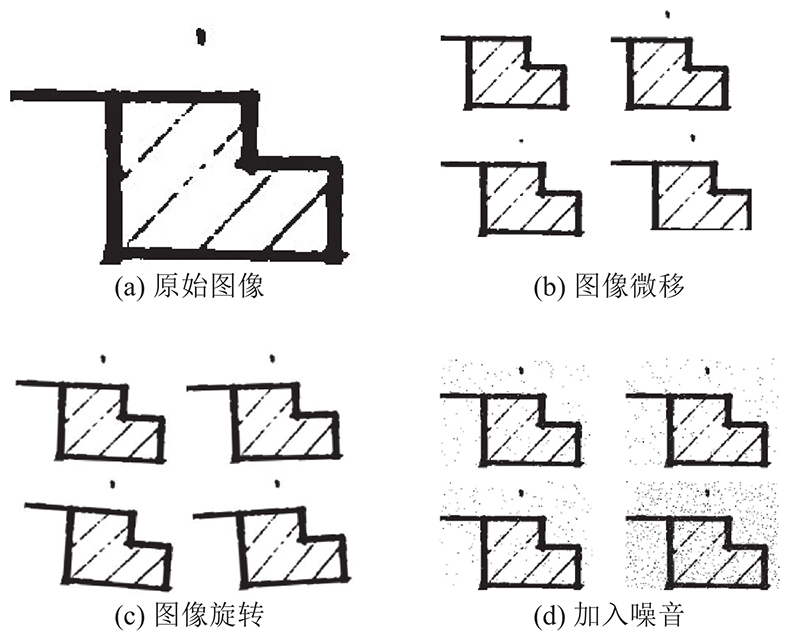

... 纸质材料较薄,在获取图像时会不可避免地保留作业背面的信息. 由于纸张两侧图案的亮度具有明显的差异,可以通过阈值分割的方法将正面的图案提取出来. 通过阈值分割将图像二值化处理,不仅能减少拍照时光照不均匀的干扰,去除多余线条,还能减小图片的大小,加速后期的网络训练. 先根据得分点区域坐标将目标分割提取,如图3 (a)所示,再调整亮度和对比度,减少补光灯造成的纸张中心区域亮度更高带来的干扰,调整后如图3 (b)所示,最后使用最大类间方差法[25 ] 将得分点图像进行二值化处理,得到仅包含目标线条的二值图像,二值化处理后如图3 (c)所示. ...

1

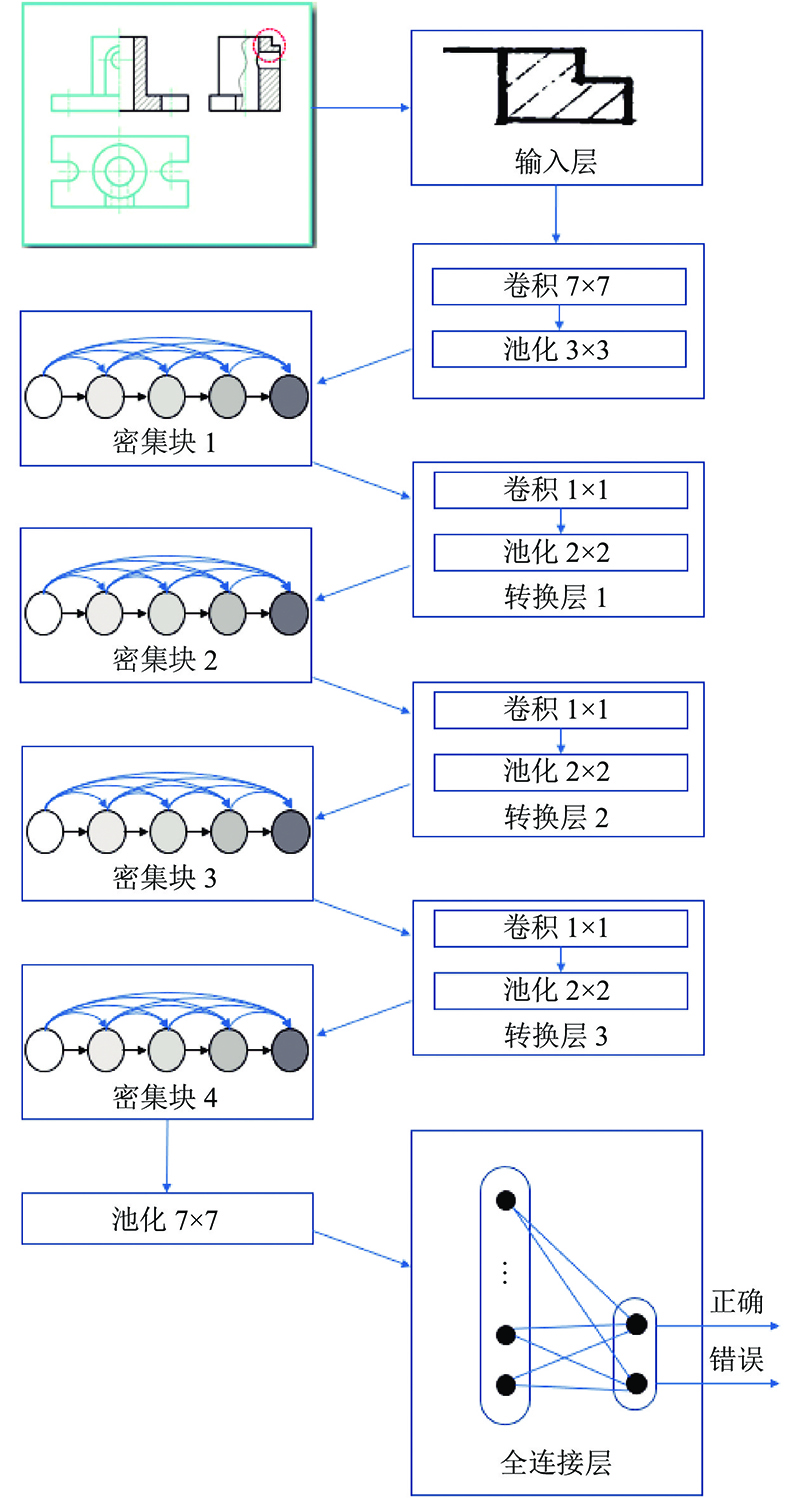

... 本研究采用121层的DenseNet121模型[26 ] ,如图5 所示,模型第1层采用7×7卷积,并采取3×3的池化以降低特征维度. DenseNet121模型包含4个密集块,各密集块内部包含由1×1 的卷积和3×3的卷积构成的卷积层,数目依次为6、12、24、16. 在相邻密集块之间,是由1×1 的卷积层和2×2 的池化层构成的转换层. 最后经过全连接层,将得分点分为正确与错误2类,实现得分点的识别. 该网络任意2层之间直接连接,即每一层的输入都是前面所有层输出的总和,而该层所学习的特征图也会被直接作为输入传递给其后面所有层,这种连接结构可以实现特征重用,从而缓解网络层数增多引起的梯度消失的问题,并且每一层只学习非常少的特征图,极大地减少了参数量并提高了学习效率. ...

Very deep convolutional networks for large-scale image recognition

1

2014

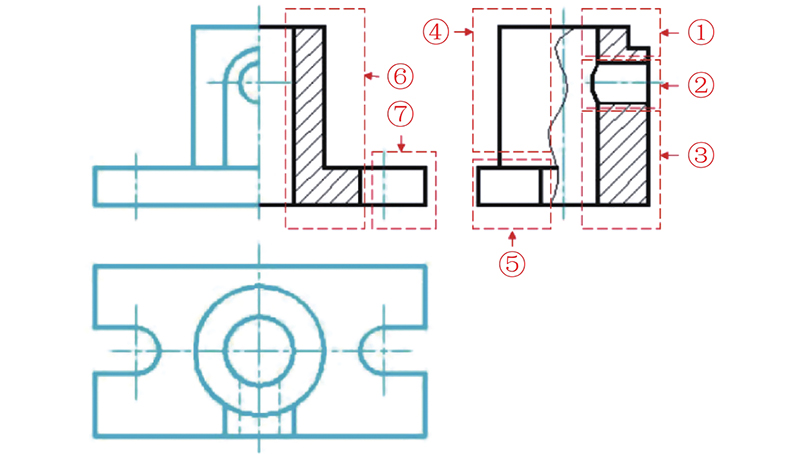

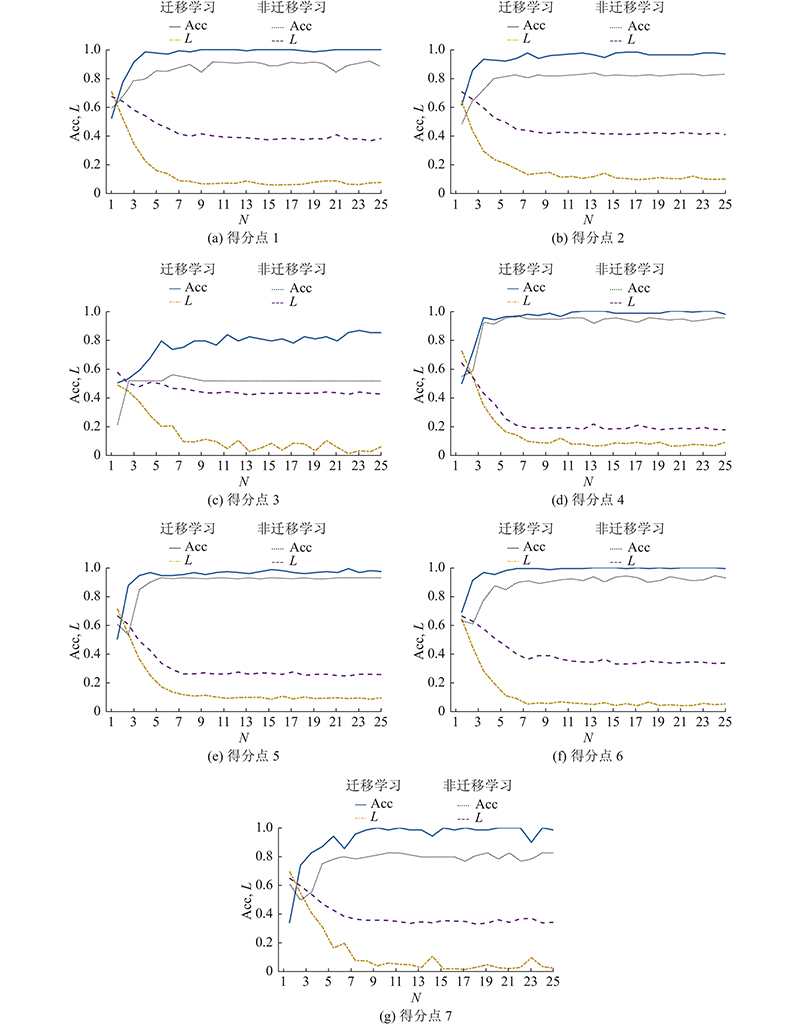

... 为了验证所提方法的有效性,对图2 中7个得分点进行训练,每组分为80个原始训练集和150个原始训练集,分别选用DenseNet网络(无迁移学习)、VGG [27 ] (使用迁移学习)、ResNet [28 ] (使用迁移学习)和DenseNet(使用迁移学习)网络进行训练. 使用150组训练集对DenseNet网络进行训练,DenseNet网络(无迁移学习)和DenseNet网络(使用迁移学习)的损失值和准确率变化如图7 所示. 图中,N 为迭代次数,Acc为训练准确率,L 为损失值. 经过不断训练,模型准确率逐渐提高,损失值逐渐下降,并逐渐趋于稳定. 除了得分点3外,应用迁移学习在充分训练后都能获得97%以上的准确率. 算法识别结果对比准确率结果如表1 所示. 表中,n tra 为训练样本数量. ...

1

... 为了验证所提方法的有效性,对图2 中7个得分点进行训练,每组分为80个原始训练集和150个原始训练集,分别选用DenseNet网络(无迁移学习)、VGG [27 ] (使用迁移学习)、ResNet [28 ] (使用迁移学习)和DenseNet(使用迁移学习)网络进行训练. 使用150组训练集对DenseNet网络进行训练,DenseNet网络(无迁移学习)和DenseNet网络(使用迁移学习)的损失值和准确率变化如图7 所示. 图中,N 为迭代次数,Acc为训练准确率,L 为损失值. 经过不断训练,模型准确率逐渐提高,损失值逐渐下降,并逐渐趋于稳定. 除了得分点3外,应用迁移学习在充分训练后都能获得97%以上的准确率. 算法识别结果对比准确率结果如表1 所示. 表中,n tra 为训练样本数量. ...