[1]

中国南方电网有限责任公司. 架空输电线路机巡技术[M]. 北京: 中国电力出版社, 2019: 1–3.

[本文引用: 1]

[2]

吕鹏程. 电力线视频监控方法研究与软件设计[D]. 杭州: 浙江大学, 2018: 1-4.

[本文引用: 1]

LV Peng-cheng. Video surveillance methods research and software design for power line [D]. Hangzhou: Zhejiang University, 2018: 1–4.

[本文引用: 1]

[3]

孙实超, 肖潇, 李栋, 等 利用参数关联性的输电线检测方法

[J]. 广西大学学报:自然科学版 , 2015 , 40 (6 ): 1461 - 1468

URL

[本文引用: 2]

SUN Shi-chao, XIAO Xiao, LI Dong, et al Power transmission line detection utilizing the relationship between the parame-ters

[J]. Journal of Guangxi University: Natural Science Edition , 2015 , 40 (6 ): 1461 - 1468

URL

[本文引用: 2]

[4]

YANG G, ZHAO D, CHANG W, et al, Detection for power transmission line in low-resolution aerial image [C]// 2017 IEEE International Conference on Robotics and Biomimetics . Macau: IEEE, 2017: 1406–1411.

[本文引用: 1]

[5]

周封, 任贵新. 基于颜色空间变量的输电线图像分类及特征提取[J]. 电力系统保护与控制, 2018, 46(5): 89-98.

[本文引用: 1]

ZHOU Feng, REN Gui-xin. Image classification and feature extraction of transmission line based on color space variable [J]. Power System Protection and Control , 2018, 46(5): 89-98.

[本文引用: 1]

[6]

张晓. 无人机输电线巡检图像识别方法研究[D]. 哈尔滨: 哈尔滨理工大学, 2019: 1-27.

ZHANG Xiao. Research on image recognition method of UAV transmission line inspection [D]. Harbin: Harbin University of Science and Technology, 2019: 1-27.

[7]

ZHAO L, WANG X, YAO H, et al Power line extraction from aerial images using object-based Markov random field with anisotropic weighted penalty

[J]. IEEE Access , 2019 , 7 : 125333 - 125356

DOI:10.1109/ACCESS.2019.2939025

[本文引用: 1]

[8]

PAN C, CAO X B, WU D. Power line detection via back-ground noise removal [C]// 2016 IEEE Global Conference on Signal and Information Processing . Washington DC: IEEE, 2016: 871-875.

[本文引用: 2]

[9]

LEE S J, YUN J P, CHOI H, et al. Weakly supervised learning with convolutional neural networks for power line loca-lization [C]// 2017 IEEE Symposium Series on Computational Intelligence . Honolulu: IEEE, 2017: 1–8.

[本文引用: 1]

[10]

YETGIN Ö E, BENLIGIRAY B, GEREK Ö N Power line recognition from aerial images with deep learning

[J]. IEEE Transactions on Aerospace and Electronic Systems , 2019 , 55 (5 ): 2241 - 2252

DOI:10.1109/TAES.2018.2883879

[11]

LI Y, PAN C, CAO X, et al Power line detection by pyramidal patch classification

[J]. IEEE Transactions on Emerging Topics in Computational Intelligence , 2018 , 3 (6 ): 416 - 426

URL

[12]

CHOI H, KOO G, KIM B J, et al Weakly supervised power line detection algorithm using a recursive noisy label update with refined broken line segments

[J]. Expert Systems with Applications , 2020 , 165 : 113895

URL

[本文引用: 2]

[13]

SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition [DB/OL]. (2014-12-04) [2020-01-10]. https://arxiv.org/pdf/1409.1556.pdf.

[本文引用: 1]

[14]

ZHAO H, SHI J, QI X, et al. Pyramid scene parsing network [C]// 2017 IEEE Conference on Computer Vision and Pattern Recognition . Honolulu: IEEE, 2017: 6230–6239.

[本文引用: 1]

[15]

CHEN L, PAPANDREOU G, KOKKINOS I, et al DeepLab: semantic image segmentation with deep convolutional nets, atrous convolution, and fully connected CRFs

[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence , 2018 , 40 (4 ): 834 - 848

DOI:10.1109/TPAMI.2017.2699184

[本文引用: 1]

[16]

LAINA I, RUPPRECHT C, BELAGIANNIS V, et al. Deeper depth prediction with fully convolutional residual networks [C]// 2016 Fourth International Conference on 3D Vision . Palo Alto: IEEE, 2016 : 239–248.

[本文引用: 1]

[17]

HE K, ZHANG X, REN S, et al. Deep residual learning for image recognition [C]// 2016 IEEE Conference on Computer Vision and Pattern Recognition . Las Vegas: IEEE, 2016: 770–778.

[本文引用: 2]

[18]

RONNEBERGER O, FISCHER P, BROX T. U-Net: con-volutional networks for biomedical image segmentation [DB/OL]. (2015-05-18) [2020-01-10]. https://arxiv.org/pdf/1505.04597.pdf.

[本文引用: 1]

[19]

CHEN S, WANG B, TAN X, et al Embedding attention and residual network for accurate salient object detection

[J]. IEEE Transactions on Cybernetics , 2020 , 50 (5 ): 2050 - 2062

DOI:10.1109/TCYB.2018.2879859

[本文引用: 1]

[20]

PANG Y, ZHAO X, ZHANG L, et al. Multi-scale interactive network for salient object detection [C]// 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Seattle: IEEE, 2020: 9410–9419.

[本文引用: 1]

[21]

BOJARSKI M, CHOROMANSKA A, CHOROMANSKI K, et al. VisualBackProp: efficient visualization of CNNs for autonomous driving [C]// 2018 IEEE International Conference on Robotics and Automation. Brisbane: IEEE, 2018: 4701–4708.

[本文引用: 1]

[22]

CHENG M, ZHANG G, MITRA N J, et al Global contrast based salient region detection

[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence , 2015 , 37 (3 ): 569 - 582

DOI:10.1109/TPAMI.2014.2345401

[本文引用: 1]

1

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

1

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

1

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

利用参数关联性的输电线检测方法

2

2015

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

... [3 ]提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

利用参数关联性的输电线检测方法

2

2015

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

... [3 ]提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

1

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

1

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

1

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

Power line extraction from aerial images using object-based Markov random field with anisotropic weighted penalty

1

2019

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

2

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

... [8 ]用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

1

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

Power line recognition from aerial images with deep learning

0

2019

Power line detection by pyramidal patch classification

0

2018

Weakly supervised power line detection algorithm using a recursive noisy label update with refined broken line segments

2

2020

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

... [12 ]利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

1

... 实现无人机视觉系统对架空输电线检测的高精度和实时性,不仅可引导机器自主巡线、采集巡检数据,还能作为避障预警依据,确保安全飞行[1 -2 ] . 基于可见光图像的电力线检测方法主要分为2类:1)基于传统特征的检测方法[3 -7 ] ,2)基于深度学习的方法[8 -12 ] . 现有方法已取得较多的研究成果,但检测精度仍不能满足实用要求.传统方法主要基于图像边缘特征,根据电力线簇的直线和平行特性,从候选边缘中筛选目标线段再拟合出结果:孙实超等[3 ] 提出参数关联法,先后用Hessian变换、Hough变换提取边缘像素、筛选出直线,再经坐标转换筛选参数满足正弦关系的平行电力线. Yang等[4 ] 经区域增长滤波消除候选边缘中的背景噪声,再用期望极大化拟合电力线. 周封等[5 ] 联合RGB、灰度值属性对图像分类,提出3种滤波和自适应分段直方图均衡法对图像预处理,用Canny提取边缘,经Hough、形态学闭运算拟合目标. 这些方法依赖直线性和平行性,不适用于电力线簇交叉的实际场景,且处理步骤多、运算耗时,不能满足实时要求. 深度学习方法是电力线簇检测的主流. PAN等[8 ] 用7层二分类神经网络,从边缘特征中识别出含电力线子区域,用梯度渐进概率霍夫变换提取目标. LEE等[9 ] 鉴于VGG19[13 ] 结构简洁,在分类任务上性能良好,通过滑窗从图像提取子区域输入VGG19,若子区域被判为含电力线,则将网络中间层输出和末端输出逐元素相乘,再用高斯核掩膜抑制四周响应、强化中心区域,作为检测结果. CHOI等[12 ] 利用反向传播可视化网络提取电力线特征作为FCN目标检测网络的标定图,对FCN的检测结果使用LSC法拟合电力线. 上述基于深度学习的电力线检测方法的精度不高,均未解决在复杂背景下输出图像虚假断点多的问题. ...

1

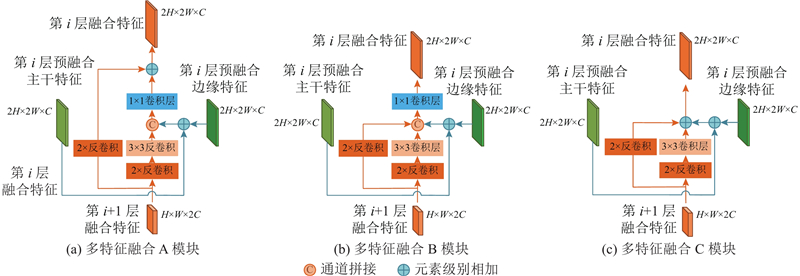

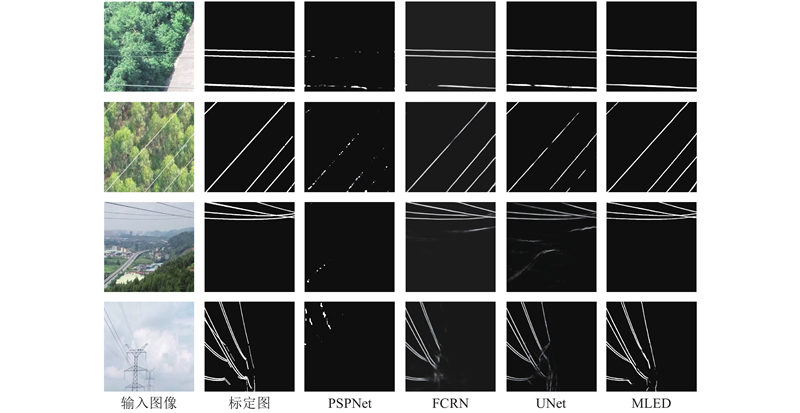

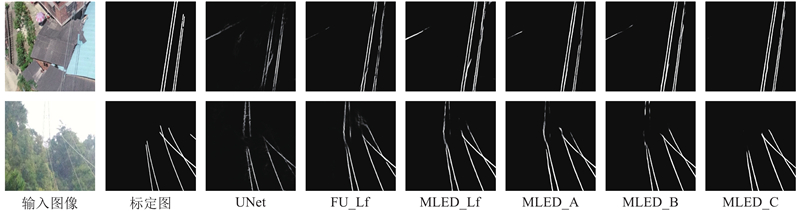

... 电力线检测本质上可视为语义分割领域的研究子方向,主流语义分割方法包括:PSPNet (pyramid scene parsing network) [14 ] 、DeepLab[15 ] 分别提出空间金字塔池化层、多尺度空洞卷积,联合多尺度局部信息和全局信息. FCRN (fully convolutional residual network) [16 ] 利用残差模块[17 ] 设计反向映射块,提高输出分辨率. UNet[18 ] 依据高、低层特征互补特性(前后者分别含语义信息、细节信息)[19 -20 ] ,提出跳跃连接结构结合2种特征. 主流语义分割方法提高电力线检测精度,但仍未解决输出图像虚假断点多的问题. 电力线虚假断点产生的根源在于没有充分利用电力线簇的空间连续性特征. 为此,应设计专门的网络结构,对电力线的连续线型特征进行多尺度强化提取. 电力线的线型特征包括3种:主干特征(含内部纹理、颜色信息)、边缘特征(含结构信息)和融合特征. 本研究提出端到端的多线型特征增强网络(multiple linear-feature enhanced detector,MLED),使用双路卷积结构提取电力线的 3 种线型多尺度特征,并经过含残差连接、尺度变换、元素级处理的多特征融合模块实现逐步融合,充分提取连续线型对象的全局上下文信息. 将所提网络在广西南宁片区的架空输电线巡检可见光图像数据集上进行实验与分析. ...

DeepLab: semantic image segmentation with deep convolutional nets, atrous convolution, and fully connected CRFs

1

2018

... 电力线检测本质上可视为语义分割领域的研究子方向,主流语义分割方法包括:PSPNet (pyramid scene parsing network) [14 ] 、DeepLab[15 ] 分别提出空间金字塔池化层、多尺度空洞卷积,联合多尺度局部信息和全局信息. FCRN (fully convolutional residual network) [16 ] 利用残差模块[17 ] 设计反向映射块,提高输出分辨率. UNet[18 ] 依据高、低层特征互补特性(前后者分别含语义信息、细节信息)[19 -20 ] ,提出跳跃连接结构结合2种特征. 主流语义分割方法提高电力线检测精度,但仍未解决输出图像虚假断点多的问题. 电力线虚假断点产生的根源在于没有充分利用电力线簇的空间连续性特征. 为此,应设计专门的网络结构,对电力线的连续线型特征进行多尺度强化提取. 电力线的线型特征包括3种:主干特征(含内部纹理、颜色信息)、边缘特征(含结构信息)和融合特征. 本研究提出端到端的多线型特征增强网络(multiple linear-feature enhanced detector,MLED),使用双路卷积结构提取电力线的 3 种线型多尺度特征,并经过含残差连接、尺度变换、元素级处理的多特征融合模块实现逐步融合,充分提取连续线型对象的全局上下文信息. 将所提网络在广西南宁片区的架空输电线巡检可见光图像数据集上进行实验与分析. ...

1

... 电力线检测本质上可视为语义分割领域的研究子方向,主流语义分割方法包括:PSPNet (pyramid scene parsing network) [14 ] 、DeepLab[15 ] 分别提出空间金字塔池化层、多尺度空洞卷积,联合多尺度局部信息和全局信息. FCRN (fully convolutional residual network) [16 ] 利用残差模块[17 ] 设计反向映射块,提高输出分辨率. UNet[18 ] 依据高、低层特征互补特性(前后者分别含语义信息、细节信息)[19 -20 ] ,提出跳跃连接结构结合2种特征. 主流语义分割方法提高电力线检测精度,但仍未解决输出图像虚假断点多的问题. 电力线虚假断点产生的根源在于没有充分利用电力线簇的空间连续性特征. 为此,应设计专门的网络结构,对电力线的连续线型特征进行多尺度强化提取. 电力线的线型特征包括3种:主干特征(含内部纹理、颜色信息)、边缘特征(含结构信息)和融合特征. 本研究提出端到端的多线型特征增强网络(multiple linear-feature enhanced detector,MLED),使用双路卷积结构提取电力线的 3 种线型多尺度特征,并经过含残差连接、尺度变换、元素级处理的多特征融合模块实现逐步融合,充分提取连续线型对象的全局上下文信息. 将所提网络在广西南宁片区的架空输电线巡检可见光图像数据集上进行实验与分析. ...

2

... 电力线检测本质上可视为语义分割领域的研究子方向,主流语义分割方法包括:PSPNet (pyramid scene parsing network) [14 ] 、DeepLab[15 ] 分别提出空间金字塔池化层、多尺度空洞卷积,联合多尺度局部信息和全局信息. FCRN (fully convolutional residual network) [16 ] 利用残差模块[17 ] 设计反向映射块,提高输出分辨率. UNet[18 ] 依据高、低层特征互补特性(前后者分别含语义信息、细节信息)[19 -20 ] ,提出跳跃连接结构结合2种特征. 主流语义分割方法提高电力线检测精度,但仍未解决输出图像虚假断点多的问题. 电力线虚假断点产生的根源在于没有充分利用电力线簇的空间连续性特征. 为此,应设计专门的网络结构,对电力线的连续线型特征进行多尺度强化提取. 电力线的线型特征包括3种:主干特征(含内部纹理、颜色信息)、边缘特征(含结构信息)和融合特征. 本研究提出端到端的多线型特征增强网络(multiple linear-feature enhanced detector,MLED),使用双路卷积结构提取电力线的 3 种线型多尺度特征,并经过含残差连接、尺度变换、元素级处理的多特征融合模块实现逐步融合,充分提取连续线型对象的全局上下文信息. 将所提网络在广西南宁片区的架空输电线巡检可见光图像数据集上进行实验与分析. ...

... PSPNet用空间金字塔池化层(SPP)替代残差卷积网络[17 ] 的全连接层,将网络提取的高层特征 $ {{\boldsymbol{O}}}_{\mathrm{m}\mathrm{a}\mathrm{i}\mathrm{n}} $

1

... 电力线检测本质上可视为语义分割领域的研究子方向,主流语义分割方法包括:PSPNet (pyramid scene parsing network) [14 ] 、DeepLab[15 ] 分别提出空间金字塔池化层、多尺度空洞卷积,联合多尺度局部信息和全局信息. FCRN (fully convolutional residual network) [16 ] 利用残差模块[17 ] 设计反向映射块,提高输出分辨率. UNet[18 ] 依据高、低层特征互补特性(前后者分别含语义信息、细节信息)[19 -20 ] ,提出跳跃连接结构结合2种特征. 主流语义分割方法提高电力线检测精度,但仍未解决输出图像虚假断点多的问题. 电力线虚假断点产生的根源在于没有充分利用电力线簇的空间连续性特征. 为此,应设计专门的网络结构,对电力线的连续线型特征进行多尺度强化提取. 电力线的线型特征包括3种:主干特征(含内部纹理、颜色信息)、边缘特征(含结构信息)和融合特征. 本研究提出端到端的多线型特征增强网络(multiple linear-feature enhanced detector,MLED),使用双路卷积结构提取电力线的 3 种线型多尺度特征,并经过含残差连接、尺度变换、元素级处理的多特征融合模块实现逐步融合,充分提取连续线型对象的全局上下文信息. 将所提网络在广西南宁片区的架空输电线巡检可见光图像数据集上进行实验与分析. ...

Embedding attention and residual network for accurate salient object detection

1

2020

... 电力线检测本质上可视为语义分割领域的研究子方向,主流语义分割方法包括:PSPNet (pyramid scene parsing network) [14 ] 、DeepLab[15 ] 分别提出空间金字塔池化层、多尺度空洞卷积,联合多尺度局部信息和全局信息. FCRN (fully convolutional residual network) [16 ] 利用残差模块[17 ] 设计反向映射块,提高输出分辨率. UNet[18 ] 依据高、低层特征互补特性(前后者分别含语义信息、细节信息)[19 -20 ] ,提出跳跃连接结构结合2种特征. 主流语义分割方法提高电力线检测精度,但仍未解决输出图像虚假断点多的问题. 电力线虚假断点产生的根源在于没有充分利用电力线簇的空间连续性特征. 为此,应设计专门的网络结构,对电力线的连续线型特征进行多尺度强化提取. 电力线的线型特征包括3种:主干特征(含内部纹理、颜色信息)、边缘特征(含结构信息)和融合特征. 本研究提出端到端的多线型特征增强网络(multiple linear-feature enhanced detector,MLED),使用双路卷积结构提取电力线的 3 种线型多尺度特征,并经过含残差连接、尺度变换、元素级处理的多特征融合模块实现逐步融合,充分提取连续线型对象的全局上下文信息. 将所提网络在广西南宁片区的架空输电线巡检可见光图像数据集上进行实验与分析. ...

1

... 电力线检测本质上可视为语义分割领域的研究子方向,主流语义分割方法包括:PSPNet (pyramid scene parsing network) [14 ] 、DeepLab[15 ] 分别提出空间金字塔池化层、多尺度空洞卷积,联合多尺度局部信息和全局信息. FCRN (fully convolutional residual network) [16 ] 利用残差模块[17 ] 设计反向映射块,提高输出分辨率. UNet[18 ] 依据高、低层特征互补特性(前后者分别含语义信息、细节信息)[19 -20 ] ,提出跳跃连接结构结合2种特征. 主流语义分割方法提高电力线检测精度,但仍未解决输出图像虚假断点多的问题. 电力线虚假断点产生的根源在于没有充分利用电力线簇的空间连续性特征. 为此,应设计专门的网络结构,对电力线的连续线型特征进行多尺度强化提取. 电力线的线型特征包括3种:主干特征(含内部纹理、颜色信息)、边缘特征(含结构信息)和融合特征. 本研究提出端到端的多线型特征增强网络(multiple linear-feature enhanced detector,MLED),使用双路卷积结构提取电力线的 3 种线型多尺度特征,并经过含残差连接、尺度变换、元素级处理的多特征融合模块实现逐步融合,充分提取连续线型对象的全局上下文信息. 将所提网络在广西南宁片区的架空输电线巡检可见光图像数据集上进行实验与分析. ...

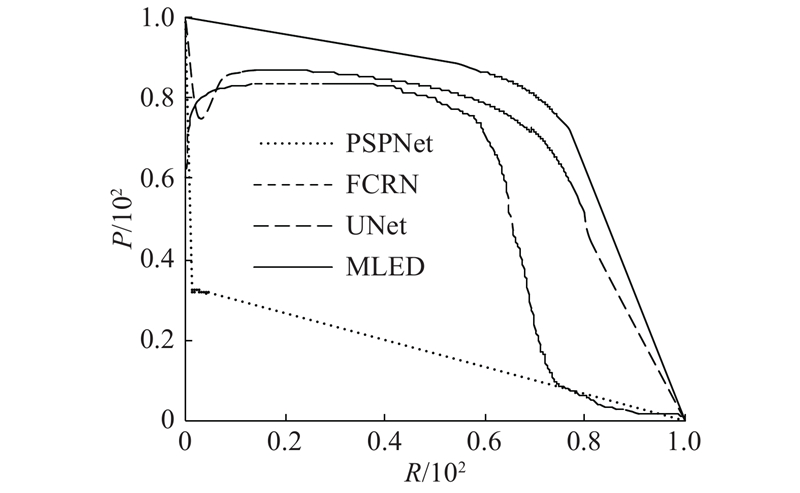

1

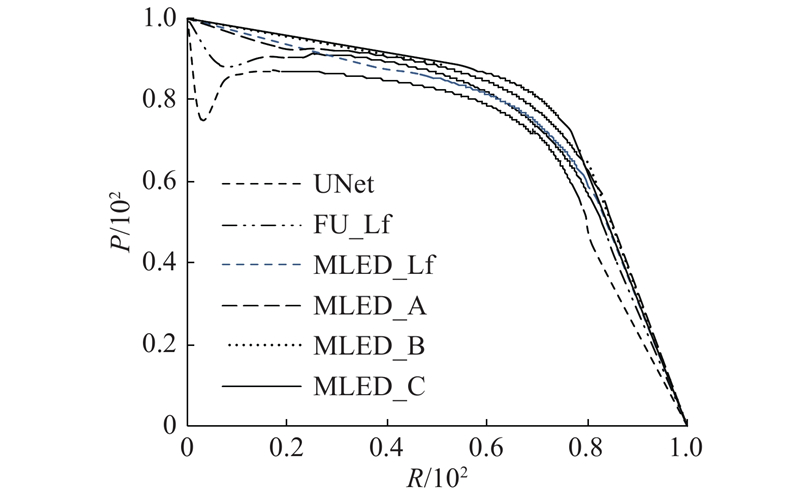

... 式中: $ P $ $ R $ $ {\;\beta }^{2}=0.3 $ $ P $ $ R $ [22 ] . F-Measure越大,表明网络检测精度越高. ...

Global contrast based salient region detection

1

2015

... 式中: $ {{\boldsymbol{O}}}_{*} $ $ {{\boldsymbol{O}}}_{\mathrm{l}\mathrm{a}\mathrm{b}} $ $ O_*^{ij} $ $ O_{{\rm{lab}}}^{ij} $ $ {{\boldsymbol{O}}_*} $ $ {{\boldsymbol{O}}_{{\rm{lab}}}} $ ij 个元素.随着网络加深,特征分辨率成倍下降,对预测结果有效的信息减少[21 ] ,令PSPNet无法靠高层特征的上下文信息检测像素占比小的目标(如电力线). 由于聚合特征直接被放大8倍进一步丢失信息,导致PSPNet在检测电力线时漏检严重,难以收敛. 同时,损失函数仅考虑深层网络,忽略了引导浅层网络学习特征细节. ...