[2]

SAHU P, GUPTA N, SHARMA N A survey on underwater image enhancement techniques

[J]. International Journal of Computer Applications , 2014 , 87 (13 ): 19 - 23

[本文引用: 1]

[3]

STANKIEWICZ P, TAN Y T, KOBILAROV M Adaptive sampling with an autonomous underwater vehicle in static marine environments

[J]. Journal of Field Robotics , 2021 , 38 (4 ): 572 - 597

DOI:10.1002/rob.22005

[本文引用: 1]

[4]

阳凡林, 暴景阳, 胡兴树. 水下地形测量 [M]. 武汉: 武汉大学出版社, 2017.

[本文引用: 1]

[5]

陈卫忠, 李长俊, 曾灿军, 等 大型水下盾构隧道结构健康监测系统的构建与应用

[J]. 岩石力学与工程学报 , 2018 , 37 (1 ): 1 - 13

DOI:10.13722/j.cnki.jrme.2017.0327

[本文引用: 1]

CHEN Weizhong, LI Changjun, ZENG Canjun, et al Establishment and application of structural health monitoring system for large shield tunnel

[J]. Chinese Journal of Rock Mechanics and Engineering , 2018 , 37 (1 ): 1 - 13

DOI:10.13722/j.cnki.jrme.2017.0327

[本文引用: 1]

[6]

HE K, SUN J, TANG X. Single image haze removal using dark channel prior [C]// IEEE Conference on Computer Vision and Pattern Recognition . Miami. IEEE, 2009: 1956–1963.

[本文引用: 4]

[7]

周辉奎, 章立, 胡素娟 改进直方图匹配和自适应均衡的水下图像增强

[J]. 红外技术 , 2024 , 46 (5 ): 532 - 538

[本文引用: 4]

ZHOU Huikui, ZHANG Li, HU Sujuan Underwater image enhancement based on improved histogram matching and adaptive equalization

[J]. Infrared Technology , 2024 , 46 (5 ): 532 - 538

[本文引用: 4]

[8]

弭永发, 迟明善, 张强, 等 基于颜色校正与改进的CLAHE多尺度融合水下图像增强

[J]. 无线电工程 , 2024 , 54 (6 ): 1470 - 1480

DOI:10.3969/j.issn.1003-3106.2024.06.016

[本文引用: 4]

MI Yongfa, CHI Mingshan, ZHANG Qiang, et al Underwater image enhancement based on color correction and improved CLAHE multi-scale fusion

[J]. Radio Engineering , 2024 , 54 (6 ): 1470 - 1480

DOI:10.3969/j.issn.1003-3106.2024.06.016

[本文引用: 4]

[10]

PAN J, DUAN Z, DUAN J, et al LUIE: learnable physical model-guided underwater image enhancement with bi-directional unsupervised domain adaptation

[J]. Neurocomputing , 2024 , 602 : 128286

DOI:10.1016/j.neucom.2024.128286

[本文引用: 1]

[12]

DREWS P L J, NASCIMENTO E R, BOTELHO S S C, et al Underwater depth estimation and image restoration based on single images

[J]. IEEE Computer Graphics and Applications , 2016 , 36 (2 ): 24 - 35

DOI:10.1109/MCG.2016.26

[本文引用: 1]

[13]

LI J, SKINNER K A, EUSTICE R M, et al WaterGAN: unsupervised generative network to enable real-time color correction of monocular underwater images

[J]. IEEE Robotics and Automation Letters , 2018 , 3 (1 ): 387 - 394

DOI:10.1109/lra.2017.2730363

[本文引用: 1]

[14]

ZHU J Y, PARK T, ISOLA P, et al. Unpaired image-to-image translation using cycle-consistent adversarial networks [C]// Proceedings of the IEEE International Conference on Computer Vision . Venice: IEEE, 2017: 2242–2251.

[本文引用: 1]

[15]

雍子叶, 郭继昌, 李重仪 融入注意力机制的弱监督水下图像增强算法

[J]. 浙江大学学报: 工学版 , 2021 , 55 (3 ): 555 - 562,570

DOI:10.3785/j.issn.1008-973X.2021.03.016

[本文引用: 1]

YONG Ziye, GUO Jichang, LI Chongyi Weakly supervised underwater image enhancement algorithm incorporating attention mechanism

[J]. Journal of Zhejiang University: Engineering Science , 2021 , 55 (3 ): 555 - 562,570

DOI:10.3785/j.issn.1008-973X.2021.03.016

[本文引用: 1]

[17]

丛晓峰, 桂杰, 章军 基于视觉Transformer的多损失融合水下图像增强网络

[J]. 智能科学与技术学报 , 2022 , 4 (4 ): 522 - 532

[本文引用: 1]

CONG Xiaofeng, GUI Jie, ZHANG Jun Underwater image enhancement network based on visual Transformer with multiple loss functions fusion

[J]. Chinese Journal of Intelligent Science and Technology , 2022 , 4 (4 ): 522 - 532

[本文引用: 1]

[18]

PENG L, ZHU C, BIAN L. U-shape transformer forUnderwater image enhancement [C]// Computer Vision – ECCV 2022 Workshops . Cham: Springer, 2023: 290–307.

[本文引用: 5]

[19]

ZHOU S, CHEN D, PAN J, et al. Adapt or perish: adaptive sparse transformer with attentive feature refinement for image restoration [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition . Seattle: IEEE, 2024: 2952–2963.

[本文引用: 1]

[20]

YANG J, LI C, DAI X, et al. Focal modulation networks [C]// Advances in Neural Information Processing Systems . [S. l.]: NeurIPS, 2022: 4203−4217.

[本文引用: 1]

[21]

CHEN J, KAO S H, HE H, et al. Run, don’t walk: chasing higher FLOPS for faster neural networks [C]// IEEE/CVF Conference on Computer Vision and Pattern Recognition . Vancouver: IEEE, 2023: 12021–12031.

[本文引用: 1]

[22]

ANDREW G, ZHU M Efficient convolutional neural networks for mobile vision applications

[J]. Mobile Networks and Applications , 2017 , 10 (2 ): 151

[本文引用: 1]

[23]

WANG Q, WU B, ZHU P, et al. ECA-net: efficient channel attention for deep convolutional neural networks [C]// IEEE/CVF Conference on Computer Vision and Pattern Recognition . Seattle: IEEE, 2020: 11531−11539.

[本文引用: 1]

[24]

LI C, GUO C, REN W, et al. An underwater image enhancement benchmark dataset and beyond [J]. IEEE Transactions on Image Processing , 2019.

[本文引用: 1]

[25]

LI C, ANWAR S, HOU J, et al Underwater image enhancement via medium transmission-guided multi-color space embedding

[J]. IEEE Transactions on Image Processing , 2021 , 30 : 4985 - 5000

DOI:10.1109/TIP.2021.3076367

[本文引用: 3]

[26]

REN T, XU H, JIANG G, et al Reinforced swin-convs transformer for simultaneous underwater sensing scene image enhancement and super-resolution

[J]. IEEE Transactions on Geoscience and Remote Sensing , 2022 , 60 : 4209616

DOI:10.1109/tgrs.2022.3205061

[本文引用: 3]

[27]

ZHANG W, ZHOU L, ZHUANG P, et al Underwater image enhancement via weighted wavelet visual perception fusion

[J]. IEEE Transactions on Circuits and Systems for Video Technology , 2024 , 34 (4 ): 2469 - 2483

DOI:10.1109/TCSVT.2023.3299314

[本文引用: 3]

[28]

KHAN M R, MISHRA P, MEHTA N, et al. Spectroformer: multi-domain query cascaded transformer network for underwater image enhancement [C]// IEEE/CVF Winter Conference on Applications of Computer Vision . Waikoloa: IEEE, 2024: 1443–1452.

[本文引用: 3]

[29]

YANG M, SOWMYA A An underwater color image quality evaluation metric

[J]. IEEE Transactions on Image Processing , 2015 , 24 (12 ): 6062 - 6071

DOI:10.1109/TIP.2015.2491020

[本文引用: 1]

[30]

PANETTA K, GAO C, AGAIAN S Human-visual-system-inspired underwater image quality measures

[J]. IEEE Journal of Oceanic Engineering , 2015 , 41 (3 ): 541 - 551

DOI:10.1109/joe.2015.2469915

[本文引用: 1]

An in-depth survey of underwater image enhancement and restoration

1

2019

... 水下图像成像技术[1 -2 ] 是探索水下环境的关键技术,被广泛应用于海洋探测[3 ] 、水下地形测绘[4 ] 、水下结构监测[5 ] 等. 水下光的传播衰减、散射和水中溶解的悬浮物等因素干扰,会导致水下图像质量退化,水下图像增强能有效克服图像质量退化问题,已逐渐成为研究热点. 因此,开展水下图像增强方法研究具有重要的科学意义和应用价值. ...

A survey on underwater image enhancement techniques

1

2014

... 水下图像成像技术[1 -2 ] 是探索水下环境的关键技术,被广泛应用于海洋探测[3 ] 、水下地形测绘[4 ] 、水下结构监测[5 ] 等. 水下光的传播衰减、散射和水中溶解的悬浮物等因素干扰,会导致水下图像质量退化,水下图像增强能有效克服图像质量退化问题,已逐渐成为研究热点. 因此,开展水下图像增强方法研究具有重要的科学意义和应用价值. ...

Adaptive sampling with an autonomous underwater vehicle in static marine environments

1

2021

... 水下图像成像技术[1 -2 ] 是探索水下环境的关键技术,被广泛应用于海洋探测[3 ] 、水下地形测绘[4 ] 、水下结构监测[5 ] 等. 水下光的传播衰减、散射和水中溶解的悬浮物等因素干扰,会导致水下图像质量退化,水下图像增强能有效克服图像质量退化问题,已逐渐成为研究热点. 因此,开展水下图像增强方法研究具有重要的科学意义和应用价值. ...

1

... 水下图像成像技术[1 -2 ] 是探索水下环境的关键技术,被广泛应用于海洋探测[3 ] 、水下地形测绘[4 ] 、水下结构监测[5 ] 等. 水下光的传播衰减、散射和水中溶解的悬浮物等因素干扰,会导致水下图像质量退化,水下图像增强能有效克服图像质量退化问题,已逐渐成为研究热点. 因此,开展水下图像增强方法研究具有重要的科学意义和应用价值. ...

大型水下盾构隧道结构健康监测系统的构建与应用

1

2018

... 水下图像成像技术[1 -2 ] 是探索水下环境的关键技术,被广泛应用于海洋探测[3 ] 、水下地形测绘[4 ] 、水下结构监测[5 ] 等. 水下光的传播衰减、散射和水中溶解的悬浮物等因素干扰,会导致水下图像质量退化,水下图像增强能有效克服图像质量退化问题,已逐渐成为研究热点. 因此,开展水下图像增强方法研究具有重要的科学意义和应用价值. ...

大型水下盾构隧道结构健康监测系统的构建与应用

1

2018

... 水下图像成像技术[1 -2 ] 是探索水下环境的关键技术,被广泛应用于海洋探测[3 ] 、水下地形测绘[4 ] 、水下结构监测[5 ] 等. 水下光的传播衰减、散射和水中溶解的悬浮物等因素干扰,会导致水下图像质量退化,水下图像增强能有效克服图像质量退化问题,已逐渐成为研究热点. 因此,开展水下图像增强方法研究具有重要的科学意义和应用价值. ...

4

... 水下图像增强技术可分为基于传统与深度学习方法2类. 其中传统方法又可细分为基于视觉先验与物理模型2种. 基于视觉先验法是通过提升像素值改善视觉质量. 如He等[6 ] 提出暗通道先验法去除图像雾化;周辉奎等[7 ] 通过直方图均衡化(histogram equalization, HE)重新分配灰度级别,增强图像的整体对比度;弭永发等[8 -9 ] 提出对比度有限自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)的方法,有效抑制过度增强时的噪声问题. 视觉先验法易造成图像细节信息丢失、过度增强和边缘模糊等问题,且需要设置的参数较多,结果也会对参数较为敏感. 基于物理模型法是基于假设模型,通过估计参数反演图像质量退化过程,从而获取退化前的图像. Pan等[10 ] 提出可学习的物理模型引导水下图像增强方法,通过双向无监督域适应技术来提升水下图像质量. Zhang等[11 ] 提出基于多尺度Retinex模型的水下图像增强方法,可有效抑制图像增强过程中的光晕现象. Drews等[12 ] 基于光传播物理模型,采用统计先验来恢复图像的视觉质量. 然而在复杂动态水下环境中,模型假设并不一定合理. 此外,多参数估计也增加了方法的不确定性. ...

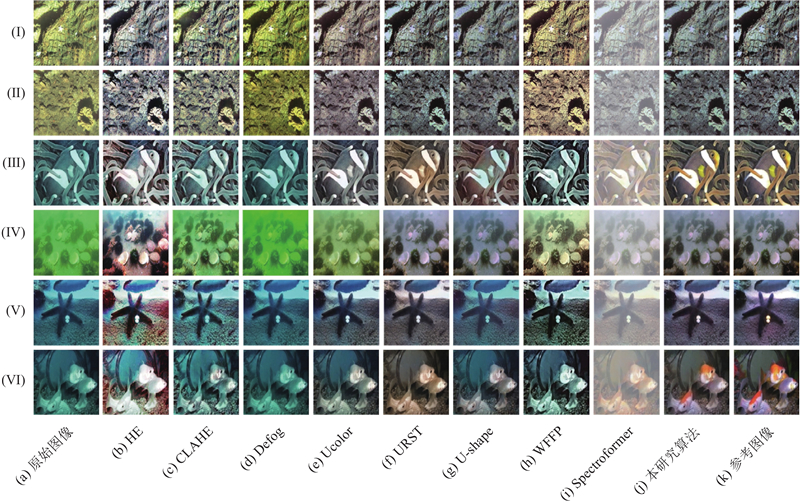

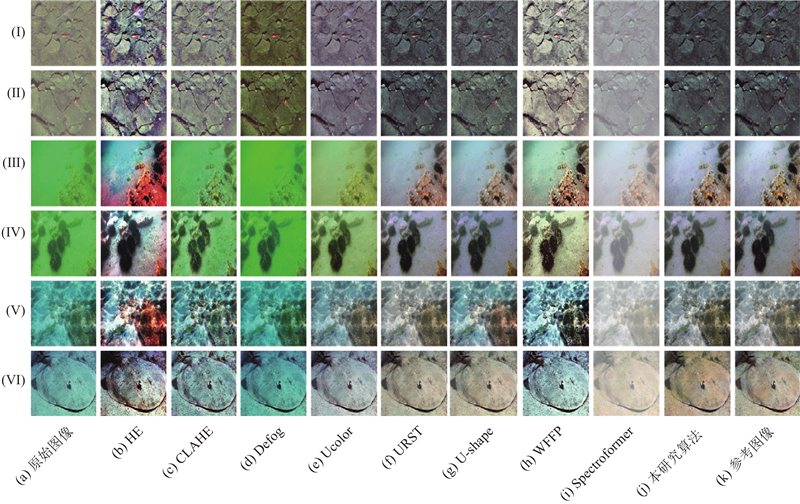

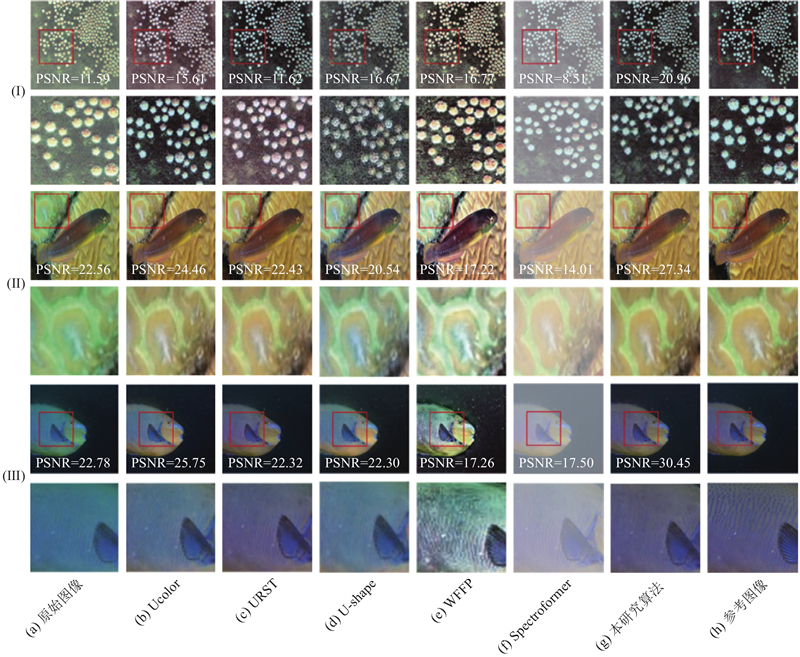

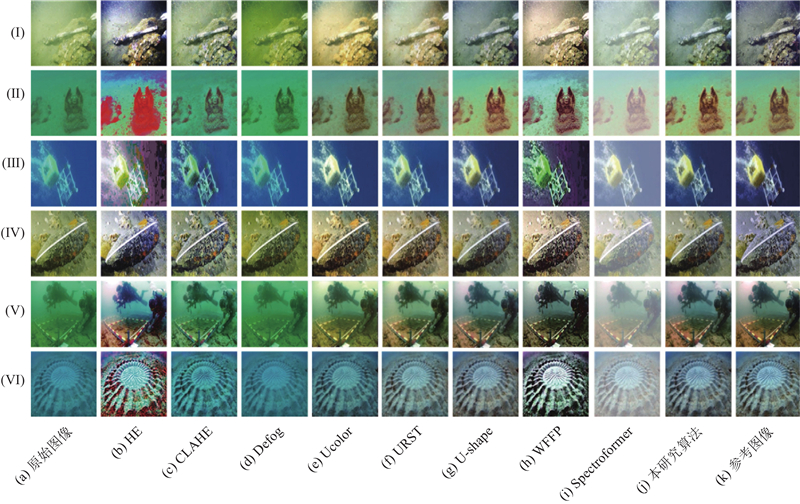

... 主观评价是水下图像质量评估中不可或缺的一部分,依赖于人类视觉系统的感知特性与认知判断. 为了系统评估不同增强方法对不同水下图像的增强效果,实验选取3种传统图像增强算法(直方图均衡化HE[7 ] 、自适应直方图均衡化CLAHE[8 ] 、去雾算法Defog[6 ] )以及5种基于深度学习的水下图像增强算法(Ucolor[25 ] 、URST[26 ] 、U-Shpae[18 ] 、WFFP[27 ] 和Spectroformer[28 ] ). 将复杂水下场景(见图5 )和简单水下场景(见图6 )按色偏类型分组进行可视化对比,以便更全面地验证模型性能. 传统算法HE和CLAHE能够在一定程度上提升图像的全局对比度,但在增强过程中易引起局部区域过饱和,导致增强图像色彩失真严重,如图5 (Ⅰ)~(Ⅵ)所示;Defog算法避免了传统算法的过曝问题,但其增强效果存在局限性,未能解决水下图像的光谱偏移问题,且在处理复杂纹理图像时出现特征退化现象,表现为图5 (Ⅴ)~(Ⅵ)中生物纹理细节的严重缺失. 相较于传统图像增强算法,基于深度学习的水下图像增强算法在图像色偏校正方面表现出显著优势. Ucolor算法针对水下图像的色彩失衡问题进行了校正,相比于传统算法,有效提升了图像的色彩饱和度和对比度,但Ucolor对图像的增强效果有限,存在色彩失真现象,如图5 (Ⅳ)~(Ⅵ)中图像边缘产生非物理光晕伪影. 在绿色场景下,如图5 (Ⅲ)~(Ⅳ)所示,仅本研究算法和URST算法实现了绿色色偏的精准校正,有效恢复了水下图像的颜色信息. Ucolor算法因局部对比度过高,导致绿色信息突出且不自然,U-Shape算法则同时存在色偏残留与纹理丢失问题. 在蓝色低照度场景下,如图5 (Ⅴ)~(Ⅵ),Ucolor、U-Shape和WFFP均未能完成水下图像的蓝色色偏,仅对原始水下图像做了低水平增强,图像增强效果不理想. URST算法虽完成了对图5 (Ⅴ)中区域主要目标的颜色恢复但在低照度场景下,如图5 (Ⅵ),URST算法对蓝绿色偏的校正效果较差. Septroformer算法虽然基本上完成了图像色彩校正,但主观视觉效果较差,对图像可视的增强效果并不明显. 本研究算法在跨场景测试中最大限度地恢复了图像的真实色彩,展现出更为稳定和优越的性能,与参考图像对比表明,本研究算法基本实现了主要色彩和细节的恢复,且未出现过度增强问题,其视觉效果最接近真值图像. ...

... Objective evaluation metrics of image quality for various algorithms on LSUI

Tab.1 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1609.682 17.491 0.864 6.887 4.117 0.542 HE[7 ] 2558.828 14.931 0.751 7.141 4.308 0.604 CLAHE[8 ] 1502.201 17.008 0.843 7.208 4.337 0.565 DEFOG[6 ] 2511.267 15.608 0.869 6.925 4.325 0.553 Ucolor[25 ] 352.193 22.911 0.898 7.234 4.389 0.562 URST[26 ] 394.476 22.705 0.905 7.321 4.177 0.585 U-Shape[18 ] 334.992 24.293 0.881 7.284 4.418 0.571 WFFP[27 ] 968.713 18.271 0.735 6.792 4.201 0.601 Spectroformer[28 ] 774.806 19.388 0.640 6.314 3.9596 0.552 本研究算法 253.558 25.421 0.893 7.488 4.461 0.592

本研究算法与各算法在UIEB数据集上的评估结果如表2 所示. 本研究算法在均方误差MSE上较次优的U-shape降低了40.3%,反映了本研究算法在像素级保真度和噪声抑制上具有优势;相应地,在峰值信噪比PSNR指标上亦居于首位,表明其增强后的图像具有最高的信噪比和整体质量;在结构相似性SSIM指标上,本研究算法与WWFP算法共同取得了最优结果;在水下场景视觉感知特性方面,本研究算法的UIQM取得了最优值;虽然在信息熵Entropy和水下色彩感知指标中,本研究算法未达到最优值,但其结果处于合理且具有竞争力的区间. 综合增强图像的主观视觉感受,本研究算法的综合性能优于所列对比算法,充分验证了本研究算法具有良好的泛化性和鲁棒性. ...

... Objective evaluation metrics of image quality for various algorithms on UIEB

Tab.2 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1751.358 17.253 0.754 6.894 3.967 0.539 HE[7 ] 1868.491 16.621 0.737 7.167 4.294 0.664 CLAHE[8 ] 1216.226 18.194 0.713 7.319 4.424 0.567 DEFOG[6 ] 2730.896 15.243 0.709 6.841 4.231 0.553 Ucolor[25 ] 868.585 20.151 0.748 7.368 4.211 0.608 URST[26 ] 864.725 20.178 0.769 7.415 4.359 0.584 U-Shape[18 ] 734.626 20.881 0.709 7.262 4.397 0.578 WFFP[27 ] 828.485 18.949 0.791 7.749 4.213 0.609 Spectroformer[28 ] 1546.455 16.235 0.684 6.552 3.723 0.521 本研究算法 438.480 21.711 0.792 7.301 4.443 0.579

2.5. 消融实验 为了证明特征细化模块和注意力增强重构模块在水下图像增强网络中的作用,在保证其他实验条件相同的情况下,消融实验通过对比不同模块的增益效果,验证算法的有效性. 消融实验设置如下:1)在基准模型中引入特征细化增强模块;2)在基准模型中引入注意力增强重构模块. 消融实验对比图像如图9 所示,基准模型在增强水下图像时,虽然能够改善部分的视觉效果,但在颜色对比度、细节恢复度和纹理清晰度方面仍存在不足,在黄色鱼场景下(见图9 (Ⅰ)区域),经过基准模型增强的图像,整体亮度有所提升,但鱼的轮廓和背景珊瑚的细节仍然较为模糊,颜色饱和度较低. 在引入特征细化模块后,图像的色彩对比度和细节表现得到显著提升,在水下珊瑚场景中(见图9 (Ⅱ)区域),经过特征细化模块处理的图像,纹理表现更加清晰. 注意力增强重构模块的引入使得图像整体质量进一步提升,不仅改善了颜色饱和度,而且显著增强了图像中纹理的清晰度,图像细节更丰富. 本研究算法融合特征细化模块和注意力增强重构模块,在所有测试场景中均取得了最佳视觉效果,增强结果图像最接近参考图像. 表明本研究算法在水下图像增强任务中具有最好的主观视觉表现. ...

改进直方图匹配和自适应均衡的水下图像增强

4

2024

... 水下图像增强技术可分为基于传统与深度学习方法2类. 其中传统方法又可细分为基于视觉先验与物理模型2种. 基于视觉先验法是通过提升像素值改善视觉质量. 如He等[6 ] 提出暗通道先验法去除图像雾化;周辉奎等[7 ] 通过直方图均衡化(histogram equalization, HE)重新分配灰度级别,增强图像的整体对比度;弭永发等[8 -9 ] 提出对比度有限自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)的方法,有效抑制过度增强时的噪声问题. 视觉先验法易造成图像细节信息丢失、过度增强和边缘模糊等问题,且需要设置的参数较多,结果也会对参数较为敏感. 基于物理模型法是基于假设模型,通过估计参数反演图像质量退化过程,从而获取退化前的图像. Pan等[10 ] 提出可学习的物理模型引导水下图像增强方法,通过双向无监督域适应技术来提升水下图像质量. Zhang等[11 ] 提出基于多尺度Retinex模型的水下图像增强方法,可有效抑制图像增强过程中的光晕现象. Drews等[12 ] 基于光传播物理模型,采用统计先验来恢复图像的视觉质量. 然而在复杂动态水下环境中,模型假设并不一定合理. 此外,多参数估计也增加了方法的不确定性. ...

... 主观评价是水下图像质量评估中不可或缺的一部分,依赖于人类视觉系统的感知特性与认知判断. 为了系统评估不同增强方法对不同水下图像的增强效果,实验选取3种传统图像增强算法(直方图均衡化HE[7 ] 、自适应直方图均衡化CLAHE[8 ] 、去雾算法Defog[6 ] )以及5种基于深度学习的水下图像增强算法(Ucolor[25 ] 、URST[26 ] 、U-Shpae[18 ] 、WFFP[27 ] 和Spectroformer[28 ] ). 将复杂水下场景(见图5 )和简单水下场景(见图6 )按色偏类型分组进行可视化对比,以便更全面地验证模型性能. 传统算法HE和CLAHE能够在一定程度上提升图像的全局对比度,但在增强过程中易引起局部区域过饱和,导致增强图像色彩失真严重,如图5 (Ⅰ)~(Ⅵ)所示;Defog算法避免了传统算法的过曝问题,但其增强效果存在局限性,未能解决水下图像的光谱偏移问题,且在处理复杂纹理图像时出现特征退化现象,表现为图5 (Ⅴ)~(Ⅵ)中生物纹理细节的严重缺失. 相较于传统图像增强算法,基于深度学习的水下图像增强算法在图像色偏校正方面表现出显著优势. Ucolor算法针对水下图像的色彩失衡问题进行了校正,相比于传统算法,有效提升了图像的色彩饱和度和对比度,但Ucolor对图像的增强效果有限,存在色彩失真现象,如图5 (Ⅳ)~(Ⅵ)中图像边缘产生非物理光晕伪影. 在绿色场景下,如图5 (Ⅲ)~(Ⅳ)所示,仅本研究算法和URST算法实现了绿色色偏的精准校正,有效恢复了水下图像的颜色信息. Ucolor算法因局部对比度过高,导致绿色信息突出且不自然,U-Shape算法则同时存在色偏残留与纹理丢失问题. 在蓝色低照度场景下,如图5 (Ⅴ)~(Ⅵ),Ucolor、U-Shape和WFFP均未能完成水下图像的蓝色色偏,仅对原始水下图像做了低水平增强,图像增强效果不理想. URST算法虽完成了对图5 (Ⅴ)中区域主要目标的颜色恢复但在低照度场景下,如图5 (Ⅵ),URST算法对蓝绿色偏的校正效果较差. Septroformer算法虽然基本上完成了图像色彩校正,但主观视觉效果较差,对图像可视的增强效果并不明显. 本研究算法在跨场景测试中最大限度地恢复了图像的真实色彩,展现出更为稳定和优越的性能,与参考图像对比表明,本研究算法基本实现了主要色彩和细节的恢复,且未出现过度增强问题,其视觉效果最接近真值图像. ...

... Objective evaluation metrics of image quality for various algorithms on LSUI

Tab.1 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1609.682 17.491 0.864 6.887 4.117 0.542 HE[7 ] 2558.828 14.931 0.751 7.141 4.308 0.604 CLAHE[8 ] 1502.201 17.008 0.843 7.208 4.337 0.565 DEFOG[6 ] 2511.267 15.608 0.869 6.925 4.325 0.553 Ucolor[25 ] 352.193 22.911 0.898 7.234 4.389 0.562 URST[26 ] 394.476 22.705 0.905 7.321 4.177 0.585 U-Shape[18 ] 334.992 24.293 0.881 7.284 4.418 0.571 WFFP[27 ] 968.713 18.271 0.735 6.792 4.201 0.601 Spectroformer[28 ] 774.806 19.388 0.640 6.314 3.9596 0.552 本研究算法 253.558 25.421 0.893 7.488 4.461 0.592

本研究算法与各算法在UIEB数据集上的评估结果如表2 所示. 本研究算法在均方误差MSE上较次优的U-shape降低了40.3%,反映了本研究算法在像素级保真度和噪声抑制上具有优势;相应地,在峰值信噪比PSNR指标上亦居于首位,表明其增强后的图像具有最高的信噪比和整体质量;在结构相似性SSIM指标上,本研究算法与WWFP算法共同取得了最优结果;在水下场景视觉感知特性方面,本研究算法的UIQM取得了最优值;虽然在信息熵Entropy和水下色彩感知指标中,本研究算法未达到最优值,但其结果处于合理且具有竞争力的区间. 综合增强图像的主观视觉感受,本研究算法的综合性能优于所列对比算法,充分验证了本研究算法具有良好的泛化性和鲁棒性. ...

... Objective evaluation metrics of image quality for various algorithms on UIEB

Tab.2 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1751.358 17.253 0.754 6.894 3.967 0.539 HE[7 ] 1868.491 16.621 0.737 7.167 4.294 0.664 CLAHE[8 ] 1216.226 18.194 0.713 7.319 4.424 0.567 DEFOG[6 ] 2730.896 15.243 0.709 6.841 4.231 0.553 Ucolor[25 ] 868.585 20.151 0.748 7.368 4.211 0.608 URST[26 ] 864.725 20.178 0.769 7.415 4.359 0.584 U-Shape[18 ] 734.626 20.881 0.709 7.262 4.397 0.578 WFFP[27 ] 828.485 18.949 0.791 7.749 4.213 0.609 Spectroformer[28 ] 1546.455 16.235 0.684 6.552 3.723 0.521 本研究算法 438.480 21.711 0.792 7.301 4.443 0.579

2.5. 消融实验 为了证明特征细化模块和注意力增强重构模块在水下图像增强网络中的作用,在保证其他实验条件相同的情况下,消融实验通过对比不同模块的增益效果,验证算法的有效性. 消融实验设置如下:1)在基准模型中引入特征细化增强模块;2)在基准模型中引入注意力增强重构模块. 消融实验对比图像如图9 所示,基准模型在增强水下图像时,虽然能够改善部分的视觉效果,但在颜色对比度、细节恢复度和纹理清晰度方面仍存在不足,在黄色鱼场景下(见图9 (Ⅰ)区域),经过基准模型增强的图像,整体亮度有所提升,但鱼的轮廓和背景珊瑚的细节仍然较为模糊,颜色饱和度较低. 在引入特征细化模块后,图像的色彩对比度和细节表现得到显著提升,在水下珊瑚场景中(见图9 (Ⅱ)区域),经过特征细化模块处理的图像,纹理表现更加清晰. 注意力增强重构模块的引入使得图像整体质量进一步提升,不仅改善了颜色饱和度,而且显著增强了图像中纹理的清晰度,图像细节更丰富. 本研究算法融合特征细化模块和注意力增强重构模块,在所有测试场景中均取得了最佳视觉效果,增强结果图像最接近参考图像. 表明本研究算法在水下图像增强任务中具有最好的主观视觉表现. ...

改进直方图匹配和自适应均衡的水下图像增强

4

2024

... 水下图像增强技术可分为基于传统与深度学习方法2类. 其中传统方法又可细分为基于视觉先验与物理模型2种. 基于视觉先验法是通过提升像素值改善视觉质量. 如He等[6 ] 提出暗通道先验法去除图像雾化;周辉奎等[7 ] 通过直方图均衡化(histogram equalization, HE)重新分配灰度级别,增强图像的整体对比度;弭永发等[8 -9 ] 提出对比度有限自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)的方法,有效抑制过度增强时的噪声问题. 视觉先验法易造成图像细节信息丢失、过度增强和边缘模糊等问题,且需要设置的参数较多,结果也会对参数较为敏感. 基于物理模型法是基于假设模型,通过估计参数反演图像质量退化过程,从而获取退化前的图像. Pan等[10 ] 提出可学习的物理模型引导水下图像增强方法,通过双向无监督域适应技术来提升水下图像质量. Zhang等[11 ] 提出基于多尺度Retinex模型的水下图像增强方法,可有效抑制图像增强过程中的光晕现象. Drews等[12 ] 基于光传播物理模型,采用统计先验来恢复图像的视觉质量. 然而在复杂动态水下环境中,模型假设并不一定合理. 此外,多参数估计也增加了方法的不确定性. ...

... 主观评价是水下图像质量评估中不可或缺的一部分,依赖于人类视觉系统的感知特性与认知判断. 为了系统评估不同增强方法对不同水下图像的增强效果,实验选取3种传统图像增强算法(直方图均衡化HE[7 ] 、自适应直方图均衡化CLAHE[8 ] 、去雾算法Defog[6 ] )以及5种基于深度学习的水下图像增强算法(Ucolor[25 ] 、URST[26 ] 、U-Shpae[18 ] 、WFFP[27 ] 和Spectroformer[28 ] ). 将复杂水下场景(见图5 )和简单水下场景(见图6 )按色偏类型分组进行可视化对比,以便更全面地验证模型性能. 传统算法HE和CLAHE能够在一定程度上提升图像的全局对比度,但在增强过程中易引起局部区域过饱和,导致增强图像色彩失真严重,如图5 (Ⅰ)~(Ⅵ)所示;Defog算法避免了传统算法的过曝问题,但其增强效果存在局限性,未能解决水下图像的光谱偏移问题,且在处理复杂纹理图像时出现特征退化现象,表现为图5 (Ⅴ)~(Ⅵ)中生物纹理细节的严重缺失. 相较于传统图像增强算法,基于深度学习的水下图像增强算法在图像色偏校正方面表现出显著优势. Ucolor算法针对水下图像的色彩失衡问题进行了校正,相比于传统算法,有效提升了图像的色彩饱和度和对比度,但Ucolor对图像的增强效果有限,存在色彩失真现象,如图5 (Ⅳ)~(Ⅵ)中图像边缘产生非物理光晕伪影. 在绿色场景下,如图5 (Ⅲ)~(Ⅳ)所示,仅本研究算法和URST算法实现了绿色色偏的精准校正,有效恢复了水下图像的颜色信息. Ucolor算法因局部对比度过高,导致绿色信息突出且不自然,U-Shape算法则同时存在色偏残留与纹理丢失问题. 在蓝色低照度场景下,如图5 (Ⅴ)~(Ⅵ),Ucolor、U-Shape和WFFP均未能完成水下图像的蓝色色偏,仅对原始水下图像做了低水平增强,图像增强效果不理想. URST算法虽完成了对图5 (Ⅴ)中区域主要目标的颜色恢复但在低照度场景下,如图5 (Ⅵ),URST算法对蓝绿色偏的校正效果较差. Septroformer算法虽然基本上完成了图像色彩校正,但主观视觉效果较差,对图像可视的增强效果并不明显. 本研究算法在跨场景测试中最大限度地恢复了图像的真实色彩,展现出更为稳定和优越的性能,与参考图像对比表明,本研究算法基本实现了主要色彩和细节的恢复,且未出现过度增强问题,其视觉效果最接近真值图像. ...

... Objective evaluation metrics of image quality for various algorithms on LSUI

Tab.1 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1609.682 17.491 0.864 6.887 4.117 0.542 HE[7 ] 2558.828 14.931 0.751 7.141 4.308 0.604 CLAHE[8 ] 1502.201 17.008 0.843 7.208 4.337 0.565 DEFOG[6 ] 2511.267 15.608 0.869 6.925 4.325 0.553 Ucolor[25 ] 352.193 22.911 0.898 7.234 4.389 0.562 URST[26 ] 394.476 22.705 0.905 7.321 4.177 0.585 U-Shape[18 ] 334.992 24.293 0.881 7.284 4.418 0.571 WFFP[27 ] 968.713 18.271 0.735 6.792 4.201 0.601 Spectroformer[28 ] 774.806 19.388 0.640 6.314 3.9596 0.552 本研究算法 253.558 25.421 0.893 7.488 4.461 0.592

本研究算法与各算法在UIEB数据集上的评估结果如表2 所示. 本研究算法在均方误差MSE上较次优的U-shape降低了40.3%,反映了本研究算法在像素级保真度和噪声抑制上具有优势;相应地,在峰值信噪比PSNR指标上亦居于首位,表明其增强后的图像具有最高的信噪比和整体质量;在结构相似性SSIM指标上,本研究算法与WWFP算法共同取得了最优结果;在水下场景视觉感知特性方面,本研究算法的UIQM取得了最优值;虽然在信息熵Entropy和水下色彩感知指标中,本研究算法未达到最优值,但其结果处于合理且具有竞争力的区间. 综合增强图像的主观视觉感受,本研究算法的综合性能优于所列对比算法,充分验证了本研究算法具有良好的泛化性和鲁棒性. ...

... Objective evaluation metrics of image quality for various algorithms on UIEB

Tab.2 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1751.358 17.253 0.754 6.894 3.967 0.539 HE[7 ] 1868.491 16.621 0.737 7.167 4.294 0.664 CLAHE[8 ] 1216.226 18.194 0.713 7.319 4.424 0.567 DEFOG[6 ] 2730.896 15.243 0.709 6.841 4.231 0.553 Ucolor[25 ] 868.585 20.151 0.748 7.368 4.211 0.608 URST[26 ] 864.725 20.178 0.769 7.415 4.359 0.584 U-Shape[18 ] 734.626 20.881 0.709 7.262 4.397 0.578 WFFP[27 ] 828.485 18.949 0.791 7.749 4.213 0.609 Spectroformer[28 ] 1546.455 16.235 0.684 6.552 3.723 0.521 本研究算法 438.480 21.711 0.792 7.301 4.443 0.579

2.5. 消融实验 为了证明特征细化模块和注意力增强重构模块在水下图像增强网络中的作用,在保证其他实验条件相同的情况下,消融实验通过对比不同模块的增益效果,验证算法的有效性. 消融实验设置如下:1)在基准模型中引入特征细化增强模块;2)在基准模型中引入注意力增强重构模块. 消融实验对比图像如图9 所示,基准模型在增强水下图像时,虽然能够改善部分的视觉效果,但在颜色对比度、细节恢复度和纹理清晰度方面仍存在不足,在黄色鱼场景下(见图9 (Ⅰ)区域),经过基准模型增强的图像,整体亮度有所提升,但鱼的轮廓和背景珊瑚的细节仍然较为模糊,颜色饱和度较低. 在引入特征细化模块后,图像的色彩对比度和细节表现得到显著提升,在水下珊瑚场景中(见图9 (Ⅱ)区域),经过特征细化模块处理的图像,纹理表现更加清晰. 注意力增强重构模块的引入使得图像整体质量进一步提升,不仅改善了颜色饱和度,而且显著增强了图像中纹理的清晰度,图像细节更丰富. 本研究算法融合特征细化模块和注意力增强重构模块,在所有测试场景中均取得了最佳视觉效果,增强结果图像最接近参考图像. 表明本研究算法在水下图像增强任务中具有最好的主观视觉表现. ...

基于颜色校正与改进的CLAHE多尺度融合水下图像增强

4

2024

... 水下图像增强技术可分为基于传统与深度学习方法2类. 其中传统方法又可细分为基于视觉先验与物理模型2种. 基于视觉先验法是通过提升像素值改善视觉质量. 如He等[6 ] 提出暗通道先验法去除图像雾化;周辉奎等[7 ] 通过直方图均衡化(histogram equalization, HE)重新分配灰度级别,增强图像的整体对比度;弭永发等[8 -9 ] 提出对比度有限自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)的方法,有效抑制过度增强时的噪声问题. 视觉先验法易造成图像细节信息丢失、过度增强和边缘模糊等问题,且需要设置的参数较多,结果也会对参数较为敏感. 基于物理模型法是基于假设模型,通过估计参数反演图像质量退化过程,从而获取退化前的图像. Pan等[10 ] 提出可学习的物理模型引导水下图像增强方法,通过双向无监督域适应技术来提升水下图像质量. Zhang等[11 ] 提出基于多尺度Retinex模型的水下图像增强方法,可有效抑制图像增强过程中的光晕现象. Drews等[12 ] 基于光传播物理模型,采用统计先验来恢复图像的视觉质量. 然而在复杂动态水下环境中,模型假设并不一定合理. 此外,多参数估计也增加了方法的不确定性. ...

... 主观评价是水下图像质量评估中不可或缺的一部分,依赖于人类视觉系统的感知特性与认知判断. 为了系统评估不同增强方法对不同水下图像的增强效果,实验选取3种传统图像增强算法(直方图均衡化HE[7 ] 、自适应直方图均衡化CLAHE[8 ] 、去雾算法Defog[6 ] )以及5种基于深度学习的水下图像增强算法(Ucolor[25 ] 、URST[26 ] 、U-Shpae[18 ] 、WFFP[27 ] 和Spectroformer[28 ] ). 将复杂水下场景(见图5 )和简单水下场景(见图6 )按色偏类型分组进行可视化对比,以便更全面地验证模型性能. 传统算法HE和CLAHE能够在一定程度上提升图像的全局对比度,但在增强过程中易引起局部区域过饱和,导致增强图像色彩失真严重,如图5 (Ⅰ)~(Ⅵ)所示;Defog算法避免了传统算法的过曝问题,但其增强效果存在局限性,未能解决水下图像的光谱偏移问题,且在处理复杂纹理图像时出现特征退化现象,表现为图5 (Ⅴ)~(Ⅵ)中生物纹理细节的严重缺失. 相较于传统图像增强算法,基于深度学习的水下图像增强算法在图像色偏校正方面表现出显著优势. Ucolor算法针对水下图像的色彩失衡问题进行了校正,相比于传统算法,有效提升了图像的色彩饱和度和对比度,但Ucolor对图像的增强效果有限,存在色彩失真现象,如图5 (Ⅳ)~(Ⅵ)中图像边缘产生非物理光晕伪影. 在绿色场景下,如图5 (Ⅲ)~(Ⅳ)所示,仅本研究算法和URST算法实现了绿色色偏的精准校正,有效恢复了水下图像的颜色信息. Ucolor算法因局部对比度过高,导致绿色信息突出且不自然,U-Shape算法则同时存在色偏残留与纹理丢失问题. 在蓝色低照度场景下,如图5 (Ⅴ)~(Ⅵ),Ucolor、U-Shape和WFFP均未能完成水下图像的蓝色色偏,仅对原始水下图像做了低水平增强,图像增强效果不理想. URST算法虽完成了对图5 (Ⅴ)中区域主要目标的颜色恢复但在低照度场景下,如图5 (Ⅵ),URST算法对蓝绿色偏的校正效果较差. Septroformer算法虽然基本上完成了图像色彩校正,但主观视觉效果较差,对图像可视的增强效果并不明显. 本研究算法在跨场景测试中最大限度地恢复了图像的真实色彩,展现出更为稳定和优越的性能,与参考图像对比表明,本研究算法基本实现了主要色彩和细节的恢复,且未出现过度增强问题,其视觉效果最接近真值图像. ...

... Objective evaluation metrics of image quality for various algorithms on LSUI

Tab.1 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1609.682 17.491 0.864 6.887 4.117 0.542 HE[7 ] 2558.828 14.931 0.751 7.141 4.308 0.604 CLAHE[8 ] 1502.201 17.008 0.843 7.208 4.337 0.565 DEFOG[6 ] 2511.267 15.608 0.869 6.925 4.325 0.553 Ucolor[25 ] 352.193 22.911 0.898 7.234 4.389 0.562 URST[26 ] 394.476 22.705 0.905 7.321 4.177 0.585 U-Shape[18 ] 334.992 24.293 0.881 7.284 4.418 0.571 WFFP[27 ] 968.713 18.271 0.735 6.792 4.201 0.601 Spectroformer[28 ] 774.806 19.388 0.640 6.314 3.9596 0.552 本研究算法 253.558 25.421 0.893 7.488 4.461 0.592

本研究算法与各算法在UIEB数据集上的评估结果如表2 所示. 本研究算法在均方误差MSE上较次优的U-shape降低了40.3%,反映了本研究算法在像素级保真度和噪声抑制上具有优势;相应地,在峰值信噪比PSNR指标上亦居于首位,表明其增强后的图像具有最高的信噪比和整体质量;在结构相似性SSIM指标上,本研究算法与WWFP算法共同取得了最优结果;在水下场景视觉感知特性方面,本研究算法的UIQM取得了最优值;虽然在信息熵Entropy和水下色彩感知指标中,本研究算法未达到最优值,但其结果处于合理且具有竞争力的区间. 综合增强图像的主观视觉感受,本研究算法的综合性能优于所列对比算法,充分验证了本研究算法具有良好的泛化性和鲁棒性. ...

... Objective evaluation metrics of image quality for various algorithms on UIEB

Tab.2 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1751.358 17.253 0.754 6.894 3.967 0.539 HE[7 ] 1868.491 16.621 0.737 7.167 4.294 0.664 CLAHE[8 ] 1216.226 18.194 0.713 7.319 4.424 0.567 DEFOG[6 ] 2730.896 15.243 0.709 6.841 4.231 0.553 Ucolor[25 ] 868.585 20.151 0.748 7.368 4.211 0.608 URST[26 ] 864.725 20.178 0.769 7.415 4.359 0.584 U-Shape[18 ] 734.626 20.881 0.709 7.262 4.397 0.578 WFFP[27 ] 828.485 18.949 0.791 7.749 4.213 0.609 Spectroformer[28 ] 1546.455 16.235 0.684 6.552 3.723 0.521 本研究算法 438.480 21.711 0.792 7.301 4.443 0.579

2.5. 消融实验 为了证明特征细化模块和注意力增强重构模块在水下图像增强网络中的作用,在保证其他实验条件相同的情况下,消融实验通过对比不同模块的增益效果,验证算法的有效性. 消融实验设置如下:1)在基准模型中引入特征细化增强模块;2)在基准模型中引入注意力增强重构模块. 消融实验对比图像如图9 所示,基准模型在增强水下图像时,虽然能够改善部分的视觉效果,但在颜色对比度、细节恢复度和纹理清晰度方面仍存在不足,在黄色鱼场景下(见图9 (Ⅰ)区域),经过基准模型增强的图像,整体亮度有所提升,但鱼的轮廓和背景珊瑚的细节仍然较为模糊,颜色饱和度较低. 在引入特征细化模块后,图像的色彩对比度和细节表现得到显著提升,在水下珊瑚场景中(见图9 (Ⅱ)区域),经过特征细化模块处理的图像,纹理表现更加清晰. 注意力增强重构模块的引入使得图像整体质量进一步提升,不仅改善了颜色饱和度,而且显著增强了图像中纹理的清晰度,图像细节更丰富. 本研究算法融合特征细化模块和注意力增强重构模块,在所有测试场景中均取得了最佳视觉效果,增强结果图像最接近参考图像. 表明本研究算法在水下图像增强任务中具有最好的主观视觉表现. ...

基于颜色校正与改进的CLAHE多尺度融合水下图像增强

4

2024

... 水下图像增强技术可分为基于传统与深度学习方法2类. 其中传统方法又可细分为基于视觉先验与物理模型2种. 基于视觉先验法是通过提升像素值改善视觉质量. 如He等[6 ] 提出暗通道先验法去除图像雾化;周辉奎等[7 ] 通过直方图均衡化(histogram equalization, HE)重新分配灰度级别,增强图像的整体对比度;弭永发等[8 -9 ] 提出对比度有限自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)的方法,有效抑制过度增强时的噪声问题. 视觉先验法易造成图像细节信息丢失、过度增强和边缘模糊等问题,且需要设置的参数较多,结果也会对参数较为敏感. 基于物理模型法是基于假设模型,通过估计参数反演图像质量退化过程,从而获取退化前的图像. Pan等[10 ] 提出可学习的物理模型引导水下图像增强方法,通过双向无监督域适应技术来提升水下图像质量. Zhang等[11 ] 提出基于多尺度Retinex模型的水下图像增强方法,可有效抑制图像增强过程中的光晕现象. Drews等[12 ] 基于光传播物理模型,采用统计先验来恢复图像的视觉质量. 然而在复杂动态水下环境中,模型假设并不一定合理. 此外,多参数估计也增加了方法的不确定性. ...

... 主观评价是水下图像质量评估中不可或缺的一部分,依赖于人类视觉系统的感知特性与认知判断. 为了系统评估不同增强方法对不同水下图像的增强效果,实验选取3种传统图像增强算法(直方图均衡化HE[7 ] 、自适应直方图均衡化CLAHE[8 ] 、去雾算法Defog[6 ] )以及5种基于深度学习的水下图像增强算法(Ucolor[25 ] 、URST[26 ] 、U-Shpae[18 ] 、WFFP[27 ] 和Spectroformer[28 ] ). 将复杂水下场景(见图5 )和简单水下场景(见图6 )按色偏类型分组进行可视化对比,以便更全面地验证模型性能. 传统算法HE和CLAHE能够在一定程度上提升图像的全局对比度,但在增强过程中易引起局部区域过饱和,导致增强图像色彩失真严重,如图5 (Ⅰ)~(Ⅵ)所示;Defog算法避免了传统算法的过曝问题,但其增强效果存在局限性,未能解决水下图像的光谱偏移问题,且在处理复杂纹理图像时出现特征退化现象,表现为图5 (Ⅴ)~(Ⅵ)中生物纹理细节的严重缺失. 相较于传统图像增强算法,基于深度学习的水下图像增强算法在图像色偏校正方面表现出显著优势. Ucolor算法针对水下图像的色彩失衡问题进行了校正,相比于传统算法,有效提升了图像的色彩饱和度和对比度,但Ucolor对图像的增强效果有限,存在色彩失真现象,如图5 (Ⅳ)~(Ⅵ)中图像边缘产生非物理光晕伪影. 在绿色场景下,如图5 (Ⅲ)~(Ⅳ)所示,仅本研究算法和URST算法实现了绿色色偏的精准校正,有效恢复了水下图像的颜色信息. Ucolor算法因局部对比度过高,导致绿色信息突出且不自然,U-Shape算法则同时存在色偏残留与纹理丢失问题. 在蓝色低照度场景下,如图5 (Ⅴ)~(Ⅵ),Ucolor、U-Shape和WFFP均未能完成水下图像的蓝色色偏,仅对原始水下图像做了低水平增强,图像增强效果不理想. URST算法虽完成了对图5 (Ⅴ)中区域主要目标的颜色恢复但在低照度场景下,如图5 (Ⅵ),URST算法对蓝绿色偏的校正效果较差. Septroformer算法虽然基本上完成了图像色彩校正,但主观视觉效果较差,对图像可视的增强效果并不明显. 本研究算法在跨场景测试中最大限度地恢复了图像的真实色彩,展现出更为稳定和优越的性能,与参考图像对比表明,本研究算法基本实现了主要色彩和细节的恢复,且未出现过度增强问题,其视觉效果最接近真值图像. ...

... Objective evaluation metrics of image quality for various algorithms on LSUI

Tab.1 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1609.682 17.491 0.864 6.887 4.117 0.542 HE[7 ] 2558.828 14.931 0.751 7.141 4.308 0.604 CLAHE[8 ] 1502.201 17.008 0.843 7.208 4.337 0.565 DEFOG[6 ] 2511.267 15.608 0.869 6.925 4.325 0.553 Ucolor[25 ] 352.193 22.911 0.898 7.234 4.389 0.562 URST[26 ] 394.476 22.705 0.905 7.321 4.177 0.585 U-Shape[18 ] 334.992 24.293 0.881 7.284 4.418 0.571 WFFP[27 ] 968.713 18.271 0.735 6.792 4.201 0.601 Spectroformer[28 ] 774.806 19.388 0.640 6.314 3.9596 0.552 本研究算法 253.558 25.421 0.893 7.488 4.461 0.592

本研究算法与各算法在UIEB数据集上的评估结果如表2 所示. 本研究算法在均方误差MSE上较次优的U-shape降低了40.3%,反映了本研究算法在像素级保真度和噪声抑制上具有优势;相应地,在峰值信噪比PSNR指标上亦居于首位,表明其增强后的图像具有最高的信噪比和整体质量;在结构相似性SSIM指标上,本研究算法与WWFP算法共同取得了最优结果;在水下场景视觉感知特性方面,本研究算法的UIQM取得了最优值;虽然在信息熵Entropy和水下色彩感知指标中,本研究算法未达到最优值,但其结果处于合理且具有竞争力的区间. 综合增强图像的主观视觉感受,本研究算法的综合性能优于所列对比算法,充分验证了本研究算法具有良好的泛化性和鲁棒性. ...

... Objective evaluation metrics of image quality for various algorithms on UIEB

Tab.2 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1751.358 17.253 0.754 6.894 3.967 0.539 HE[7 ] 1868.491 16.621 0.737 7.167 4.294 0.664 CLAHE[8 ] 1216.226 18.194 0.713 7.319 4.424 0.567 DEFOG[6 ] 2730.896 15.243 0.709 6.841 4.231 0.553 Ucolor[25 ] 868.585 20.151 0.748 7.368 4.211 0.608 URST[26 ] 864.725 20.178 0.769 7.415 4.359 0.584 U-Shape[18 ] 734.626 20.881 0.709 7.262 4.397 0.578 WFFP[27 ] 828.485 18.949 0.791 7.749 4.213 0.609 Spectroformer[28 ] 1546.455 16.235 0.684 6.552 3.723 0.521 本研究算法 438.480 21.711 0.792 7.301 4.443 0.579

2.5. 消融实验 为了证明特征细化模块和注意力增强重构模块在水下图像增强网络中的作用,在保证其他实验条件相同的情况下,消融实验通过对比不同模块的增益效果,验证算法的有效性. 消融实验设置如下:1)在基准模型中引入特征细化增强模块;2)在基准模型中引入注意力增强重构模块. 消融实验对比图像如图9 所示,基准模型在增强水下图像时,虽然能够改善部分的视觉效果,但在颜色对比度、细节恢复度和纹理清晰度方面仍存在不足,在黄色鱼场景下(见图9 (Ⅰ)区域),经过基准模型增强的图像,整体亮度有所提升,但鱼的轮廓和背景珊瑚的细节仍然较为模糊,颜色饱和度较低. 在引入特征细化模块后,图像的色彩对比度和细节表现得到显著提升,在水下珊瑚场景中(见图9 (Ⅱ)区域),经过特征细化模块处理的图像,纹理表现更加清晰. 注意力增强重构模块的引入使得图像整体质量进一步提升,不仅改善了颜色饱和度,而且显著增强了图像中纹理的清晰度,图像细节更丰富. 本研究算法融合特征细化模块和注意力增强重构模块,在所有测试场景中均取得了最佳视觉效果,增强结果图像最接近参考图像. 表明本研究算法在水下图像增强任务中具有最好的主观视觉表现. ...

基于衰减补偿与反转CLAHE的水下图像增强算法

1

2023

... 水下图像增强技术可分为基于传统与深度学习方法2类. 其中传统方法又可细分为基于视觉先验与物理模型2种. 基于视觉先验法是通过提升像素值改善视觉质量. 如He等[6 ] 提出暗通道先验法去除图像雾化;周辉奎等[7 ] 通过直方图均衡化(histogram equalization, HE)重新分配灰度级别,增强图像的整体对比度;弭永发等[8 -9 ] 提出对比度有限自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)的方法,有效抑制过度增强时的噪声问题. 视觉先验法易造成图像细节信息丢失、过度增强和边缘模糊等问题,且需要设置的参数较多,结果也会对参数较为敏感. 基于物理模型法是基于假设模型,通过估计参数反演图像质量退化过程,从而获取退化前的图像. Pan等[10 ] 提出可学习的物理模型引导水下图像增强方法,通过双向无监督域适应技术来提升水下图像质量. Zhang等[11 ] 提出基于多尺度Retinex模型的水下图像增强方法,可有效抑制图像增强过程中的光晕现象. Drews等[12 ] 基于光传播物理模型,采用统计先验来恢复图像的视觉质量. 然而在复杂动态水下环境中,模型假设并不一定合理. 此外,多参数估计也增加了方法的不确定性. ...

基于衰减补偿与反转CLAHE的水下图像增强算法

1

2023

... 水下图像增强技术可分为基于传统与深度学习方法2类. 其中传统方法又可细分为基于视觉先验与物理模型2种. 基于视觉先验法是通过提升像素值改善视觉质量. 如He等[6 ] 提出暗通道先验法去除图像雾化;周辉奎等[7 ] 通过直方图均衡化(histogram equalization, HE)重新分配灰度级别,增强图像的整体对比度;弭永发等[8 -9 ] 提出对比度有限自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)的方法,有效抑制过度增强时的噪声问题. 视觉先验法易造成图像细节信息丢失、过度增强和边缘模糊等问题,且需要设置的参数较多,结果也会对参数较为敏感. 基于物理模型法是基于假设模型,通过估计参数反演图像质量退化过程,从而获取退化前的图像. Pan等[10 ] 提出可学习的物理模型引导水下图像增强方法,通过双向无监督域适应技术来提升水下图像质量. Zhang等[11 ] 提出基于多尺度Retinex模型的水下图像增强方法,可有效抑制图像增强过程中的光晕现象. Drews等[12 ] 基于光传播物理模型,采用统计先验来恢复图像的视觉质量. 然而在复杂动态水下环境中,模型假设并不一定合理. 此外,多参数估计也增加了方法的不确定性. ...

LUIE: learnable physical model-guided underwater image enhancement with bi-directional unsupervised domain adaptation

1

2024

... 水下图像增强技术可分为基于传统与深度学习方法2类. 其中传统方法又可细分为基于视觉先验与物理模型2种. 基于视觉先验法是通过提升像素值改善视觉质量. 如He等[6 ] 提出暗通道先验法去除图像雾化;周辉奎等[7 ] 通过直方图均衡化(histogram equalization, HE)重新分配灰度级别,增强图像的整体对比度;弭永发等[8 -9 ] 提出对比度有限自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)的方法,有效抑制过度增强时的噪声问题. 视觉先验法易造成图像细节信息丢失、过度增强和边缘模糊等问题,且需要设置的参数较多,结果也会对参数较为敏感. 基于物理模型法是基于假设模型,通过估计参数反演图像质量退化过程,从而获取退化前的图像. Pan等[10 ] 提出可学习的物理模型引导水下图像增强方法,通过双向无监督域适应技术来提升水下图像质量. Zhang等[11 ] 提出基于多尺度Retinex模型的水下图像增强方法,可有效抑制图像增强过程中的光晕现象. Drews等[12 ] 基于光传播物理模型,采用统计先验来恢复图像的视觉质量. 然而在复杂动态水下环境中,模型假设并不一定合理. 此外,多参数估计也增加了方法的不确定性. ...

Underwater image enhancement via extended multi-scale Retinex

1

2017

... 水下图像增强技术可分为基于传统与深度学习方法2类. 其中传统方法又可细分为基于视觉先验与物理模型2种. 基于视觉先验法是通过提升像素值改善视觉质量. 如He等[6 ] 提出暗通道先验法去除图像雾化;周辉奎等[7 ] 通过直方图均衡化(histogram equalization, HE)重新分配灰度级别,增强图像的整体对比度;弭永发等[8 -9 ] 提出对比度有限自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)的方法,有效抑制过度增强时的噪声问题. 视觉先验法易造成图像细节信息丢失、过度增强和边缘模糊等问题,且需要设置的参数较多,结果也会对参数较为敏感. 基于物理模型法是基于假设模型,通过估计参数反演图像质量退化过程,从而获取退化前的图像. Pan等[10 ] 提出可学习的物理模型引导水下图像增强方法,通过双向无监督域适应技术来提升水下图像质量. Zhang等[11 ] 提出基于多尺度Retinex模型的水下图像增强方法,可有效抑制图像增强过程中的光晕现象. Drews等[12 ] 基于光传播物理模型,采用统计先验来恢复图像的视觉质量. 然而在复杂动态水下环境中,模型假设并不一定合理. 此外,多参数估计也增加了方法的不确定性. ...

Underwater depth estimation and image restoration based on single images

1

2016

... 水下图像增强技术可分为基于传统与深度学习方法2类. 其中传统方法又可细分为基于视觉先验与物理模型2种. 基于视觉先验法是通过提升像素值改善视觉质量. 如He等[6 ] 提出暗通道先验法去除图像雾化;周辉奎等[7 ] 通过直方图均衡化(histogram equalization, HE)重新分配灰度级别,增强图像的整体对比度;弭永发等[8 -9 ] 提出对比度有限自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)的方法,有效抑制过度增强时的噪声问题. 视觉先验法易造成图像细节信息丢失、过度增强和边缘模糊等问题,且需要设置的参数较多,结果也会对参数较为敏感. 基于物理模型法是基于假设模型,通过估计参数反演图像质量退化过程,从而获取退化前的图像. Pan等[10 ] 提出可学习的物理模型引导水下图像增强方法,通过双向无监督域适应技术来提升水下图像质量. Zhang等[11 ] 提出基于多尺度Retinex模型的水下图像增强方法,可有效抑制图像增强过程中的光晕现象. Drews等[12 ] 基于光传播物理模型,采用统计先验来恢复图像的视觉质量. 然而在复杂动态水下环境中,模型假设并不一定合理. 此外,多参数估计也增加了方法的不确定性. ...

WaterGAN: unsupervised generative network to enable real-time color correction of monocular underwater images

1

2018

... 基于深度学习的方法利用深度网络自动学习水下图像特征,并构建水下图像与增强图像之间的映射关系,从而实现水下图像增强任务. 现有方法可分为基于生成对抗网络(generative adversarial network, GAN)与基于端到端网络(end to end network) 2种类型. 在基于GAN的方法中,Li等[13 ] 采用GAN生成浑浊的水下图像,并利用此图像训练构建水下图像增强模型. Zhu等[14 ] 提出基于CycleGAN水下图像增强模型. 此类方法对生成器生成质量较为依赖,通常会导致增强图像对比度不足. 在基于端到端网络的方法中,郭继昌团队提出融合注意力机制的弱监督增强网络[15 ] 和融合逆透射率图的水下图像增强网络[16 ] ,并通过主观和客观评价指标,在多种数据集场景下分析了其方法的有效性. 针对水中光的吸收和散射现象而导致的颜色失真和对比度降低,丛晓峰等[17 ] 提出基于视觉的多损失融合Transformer网络. Peng等[18 ] 提出U-shape Transformer网络,有效消除水下图像颜色伪影和透射缺陷. 然而,当Transformer网络对于不相关区域分配的注意力权重不合适时,可能会严重影响模型的性能. ...

1

... 基于深度学习的方法利用深度网络自动学习水下图像特征,并构建水下图像与增强图像之间的映射关系,从而实现水下图像增强任务. 现有方法可分为基于生成对抗网络(generative adversarial network, GAN)与基于端到端网络(end to end network) 2种类型. 在基于GAN的方法中,Li等[13 ] 采用GAN生成浑浊的水下图像,并利用此图像训练构建水下图像增强模型. Zhu等[14 ] 提出基于CycleGAN水下图像增强模型. 此类方法对生成器生成质量较为依赖,通常会导致增强图像对比度不足. 在基于端到端网络的方法中,郭继昌团队提出融合注意力机制的弱监督增强网络[15 ] 和融合逆透射率图的水下图像增强网络[16 ] ,并通过主观和客观评价指标,在多种数据集场景下分析了其方法的有效性. 针对水中光的吸收和散射现象而导致的颜色失真和对比度降低,丛晓峰等[17 ] 提出基于视觉的多损失融合Transformer网络. Peng等[18 ] 提出U-shape Transformer网络,有效消除水下图像颜色伪影和透射缺陷. 然而,当Transformer网络对于不相关区域分配的注意力权重不合适时,可能会严重影响模型的性能. ...

融入注意力机制的弱监督水下图像增强算法

1

2021

... 基于深度学习的方法利用深度网络自动学习水下图像特征,并构建水下图像与增强图像之间的映射关系,从而实现水下图像增强任务. 现有方法可分为基于生成对抗网络(generative adversarial network, GAN)与基于端到端网络(end to end network) 2种类型. 在基于GAN的方法中,Li等[13 ] 采用GAN生成浑浊的水下图像,并利用此图像训练构建水下图像增强模型. Zhu等[14 ] 提出基于CycleGAN水下图像增强模型. 此类方法对生成器生成质量较为依赖,通常会导致增强图像对比度不足. 在基于端到端网络的方法中,郭继昌团队提出融合注意力机制的弱监督增强网络[15 ] 和融合逆透射率图的水下图像增强网络[16 ] ,并通过主观和客观评价指标,在多种数据集场景下分析了其方法的有效性. 针对水中光的吸收和散射现象而导致的颜色失真和对比度降低,丛晓峰等[17 ] 提出基于视觉的多损失融合Transformer网络. Peng等[18 ] 提出U-shape Transformer网络,有效消除水下图像颜色伪影和透射缺陷. 然而,当Transformer网络对于不相关区域分配的注意力权重不合适时,可能会严重影响模型的性能. ...

融入注意力机制的弱监督水下图像增强算法

1

2021

... 基于深度学习的方法利用深度网络自动学习水下图像特征,并构建水下图像与增强图像之间的映射关系,从而实现水下图像增强任务. 现有方法可分为基于生成对抗网络(generative adversarial network, GAN)与基于端到端网络(end to end network) 2种类型. 在基于GAN的方法中,Li等[13 ] 采用GAN生成浑浊的水下图像,并利用此图像训练构建水下图像增强模型. Zhu等[14 ] 提出基于CycleGAN水下图像增强模型. 此类方法对生成器生成质量较为依赖,通常会导致增强图像对比度不足. 在基于端到端网络的方法中,郭继昌团队提出融合注意力机制的弱监督增强网络[15 ] 和融合逆透射率图的水下图像增强网络[16 ] ,并通过主观和客观评价指标,在多种数据集场景下分析了其方法的有效性. 针对水中光的吸收和散射现象而导致的颜色失真和对比度降低,丛晓峰等[17 ] 提出基于视觉的多损失融合Transformer网络. Peng等[18 ] 提出U-shape Transformer网络,有效消除水下图像颜色伪影和透射缺陷. 然而,当Transformer网络对于不相关区域分配的注意力权重不合适时,可能会严重影响模型的性能. ...

基于融合逆透射率图的水下图像增强算法

1

2023

... 基于深度学习的方法利用深度网络自动学习水下图像特征,并构建水下图像与增强图像之间的映射关系,从而实现水下图像增强任务. 现有方法可分为基于生成对抗网络(generative adversarial network, GAN)与基于端到端网络(end to end network) 2种类型. 在基于GAN的方法中,Li等[13 ] 采用GAN生成浑浊的水下图像,并利用此图像训练构建水下图像增强模型. Zhu等[14 ] 提出基于CycleGAN水下图像增强模型. 此类方法对生成器生成质量较为依赖,通常会导致增强图像对比度不足. 在基于端到端网络的方法中,郭继昌团队提出融合注意力机制的弱监督增强网络[15 ] 和融合逆透射率图的水下图像增强网络[16 ] ,并通过主观和客观评价指标,在多种数据集场景下分析了其方法的有效性. 针对水中光的吸收和散射现象而导致的颜色失真和对比度降低,丛晓峰等[17 ] 提出基于视觉的多损失融合Transformer网络. Peng等[18 ] 提出U-shape Transformer网络,有效消除水下图像颜色伪影和透射缺陷. 然而,当Transformer网络对于不相关区域分配的注意力权重不合适时,可能会严重影响模型的性能. ...

基于融合逆透射率图的水下图像增强算法

1

2023

... 基于深度学习的方法利用深度网络自动学习水下图像特征,并构建水下图像与增强图像之间的映射关系,从而实现水下图像增强任务. 现有方法可分为基于生成对抗网络(generative adversarial network, GAN)与基于端到端网络(end to end network) 2种类型. 在基于GAN的方法中,Li等[13 ] 采用GAN生成浑浊的水下图像,并利用此图像训练构建水下图像增强模型. Zhu等[14 ] 提出基于CycleGAN水下图像增强模型. 此类方法对生成器生成质量较为依赖,通常会导致增强图像对比度不足. 在基于端到端网络的方法中,郭继昌团队提出融合注意力机制的弱监督增强网络[15 ] 和融合逆透射率图的水下图像增强网络[16 ] ,并通过主观和客观评价指标,在多种数据集场景下分析了其方法的有效性. 针对水中光的吸收和散射现象而导致的颜色失真和对比度降低,丛晓峰等[17 ] 提出基于视觉的多损失融合Transformer网络. Peng等[18 ] 提出U-shape Transformer网络,有效消除水下图像颜色伪影和透射缺陷. 然而,当Transformer网络对于不相关区域分配的注意力权重不合适时,可能会严重影响模型的性能. ...

基于视觉Transformer的多损失融合水下图像增强网络

1

2022

... 基于深度学习的方法利用深度网络自动学习水下图像特征,并构建水下图像与增强图像之间的映射关系,从而实现水下图像增强任务. 现有方法可分为基于生成对抗网络(generative adversarial network, GAN)与基于端到端网络(end to end network) 2种类型. 在基于GAN的方法中,Li等[13 ] 采用GAN生成浑浊的水下图像,并利用此图像训练构建水下图像增强模型. Zhu等[14 ] 提出基于CycleGAN水下图像增强模型. 此类方法对生成器生成质量较为依赖,通常会导致增强图像对比度不足. 在基于端到端网络的方法中,郭继昌团队提出融合注意力机制的弱监督增强网络[15 ] 和融合逆透射率图的水下图像增强网络[16 ] ,并通过主观和客观评价指标,在多种数据集场景下分析了其方法的有效性. 针对水中光的吸收和散射现象而导致的颜色失真和对比度降低,丛晓峰等[17 ] 提出基于视觉的多损失融合Transformer网络. Peng等[18 ] 提出U-shape Transformer网络,有效消除水下图像颜色伪影和透射缺陷. 然而,当Transformer网络对于不相关区域分配的注意力权重不合适时,可能会严重影响模型的性能. ...

基于视觉Transformer的多损失融合水下图像增强网络

1

2022

... 基于深度学习的方法利用深度网络自动学习水下图像特征,并构建水下图像与增强图像之间的映射关系,从而实现水下图像增强任务. 现有方法可分为基于生成对抗网络(generative adversarial network, GAN)与基于端到端网络(end to end network) 2种类型. 在基于GAN的方法中,Li等[13 ] 采用GAN生成浑浊的水下图像,并利用此图像训练构建水下图像增强模型. Zhu等[14 ] 提出基于CycleGAN水下图像增强模型. 此类方法对生成器生成质量较为依赖,通常会导致增强图像对比度不足. 在基于端到端网络的方法中,郭继昌团队提出融合注意力机制的弱监督增强网络[15 ] 和融合逆透射率图的水下图像增强网络[16 ] ,并通过主观和客观评价指标,在多种数据集场景下分析了其方法的有效性. 针对水中光的吸收和散射现象而导致的颜色失真和对比度降低,丛晓峰等[17 ] 提出基于视觉的多损失融合Transformer网络. Peng等[18 ] 提出U-shape Transformer网络,有效消除水下图像颜色伪影和透射缺陷. 然而,当Transformer网络对于不相关区域分配的注意力权重不合适时,可能会严重影响模型的性能. ...

5

... 基于深度学习的方法利用深度网络自动学习水下图像特征,并构建水下图像与增强图像之间的映射关系,从而实现水下图像增强任务. 现有方法可分为基于生成对抗网络(generative adversarial network, GAN)与基于端到端网络(end to end network) 2种类型. 在基于GAN的方法中,Li等[13 ] 采用GAN生成浑浊的水下图像,并利用此图像训练构建水下图像增强模型. Zhu等[14 ] 提出基于CycleGAN水下图像增强模型. 此类方法对生成器生成质量较为依赖,通常会导致增强图像对比度不足. 在基于端到端网络的方法中,郭继昌团队提出融合注意力机制的弱监督增强网络[15 ] 和融合逆透射率图的水下图像增强网络[16 ] ,并通过主观和客观评价指标,在多种数据集场景下分析了其方法的有效性. 针对水中光的吸收和散射现象而导致的颜色失真和对比度降低,丛晓峰等[17 ] 提出基于视觉的多损失融合Transformer网络. Peng等[18 ] 提出U-shape Transformer网络,有效消除水下图像颜色伪影和透射缺陷. 然而,当Transformer网络对于不相关区域分配的注意力权重不合适时,可能会严重影响模型的性能. ...

... 大规模水下图像数据集[18 ] (large scale underwater image dataset,LSUI)包含4279 个真实水下图像组,每组图像由原始图像和清晰参考图像组成. 在数据质量方面,LSUI提供了比现有同类数据集更高质量的参考图像,能有效评估水下图像增强算法的性能. 实验随机选取LSUI数据集中不同场景的3879 张水下图像作为训练集,剩余的400张水下图像作为测试集. ...

... 主观评价是水下图像质量评估中不可或缺的一部分,依赖于人类视觉系统的感知特性与认知判断. 为了系统评估不同增强方法对不同水下图像的增强效果,实验选取3种传统图像增强算法(直方图均衡化HE[7 ] 、自适应直方图均衡化CLAHE[8 ] 、去雾算法Defog[6 ] )以及5种基于深度学习的水下图像增强算法(Ucolor[25 ] 、URST[26 ] 、U-Shpae[18 ] 、WFFP[27 ] 和Spectroformer[28 ] ). 将复杂水下场景(见图5 )和简单水下场景(见图6 )按色偏类型分组进行可视化对比,以便更全面地验证模型性能. 传统算法HE和CLAHE能够在一定程度上提升图像的全局对比度,但在增强过程中易引起局部区域过饱和,导致增强图像色彩失真严重,如图5 (Ⅰ)~(Ⅵ)所示;Defog算法避免了传统算法的过曝问题,但其增强效果存在局限性,未能解决水下图像的光谱偏移问题,且在处理复杂纹理图像时出现特征退化现象,表现为图5 (Ⅴ)~(Ⅵ)中生物纹理细节的严重缺失. 相较于传统图像增强算法,基于深度学习的水下图像增强算法在图像色偏校正方面表现出显著优势. Ucolor算法针对水下图像的色彩失衡问题进行了校正,相比于传统算法,有效提升了图像的色彩饱和度和对比度,但Ucolor对图像的增强效果有限,存在色彩失真现象,如图5 (Ⅳ)~(Ⅵ)中图像边缘产生非物理光晕伪影. 在绿色场景下,如图5 (Ⅲ)~(Ⅳ)所示,仅本研究算法和URST算法实现了绿色色偏的精准校正,有效恢复了水下图像的颜色信息. Ucolor算法因局部对比度过高,导致绿色信息突出且不自然,U-Shape算法则同时存在色偏残留与纹理丢失问题. 在蓝色低照度场景下,如图5 (Ⅴ)~(Ⅵ),Ucolor、U-Shape和WFFP均未能完成水下图像的蓝色色偏,仅对原始水下图像做了低水平增强,图像增强效果不理想. URST算法虽完成了对图5 (Ⅴ)中区域主要目标的颜色恢复但在低照度场景下,如图5 (Ⅵ),URST算法对蓝绿色偏的校正效果较差. Septroformer算法虽然基本上完成了图像色彩校正,但主观视觉效果较差,对图像可视的增强效果并不明显. 本研究算法在跨场景测试中最大限度地恢复了图像的真实色彩,展现出更为稳定和优越的性能,与参考图像对比表明,本研究算法基本实现了主要色彩和细节的恢复,且未出现过度增强问题,其视觉效果最接近真值图像. ...

... Objective evaluation metrics of image quality for various algorithms on LSUI

Tab.1 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1609.682 17.491 0.864 6.887 4.117 0.542 HE[7 ] 2558.828 14.931 0.751 7.141 4.308 0.604 CLAHE[8 ] 1502.201 17.008 0.843 7.208 4.337 0.565 DEFOG[6 ] 2511.267 15.608 0.869 6.925 4.325 0.553 Ucolor[25 ] 352.193 22.911 0.898 7.234 4.389 0.562 URST[26 ] 394.476 22.705 0.905 7.321 4.177 0.585 U-Shape[18 ] 334.992 24.293 0.881 7.284 4.418 0.571 WFFP[27 ] 968.713 18.271 0.735 6.792 4.201 0.601 Spectroformer[28 ] 774.806 19.388 0.640 6.314 3.9596 0.552 本研究算法 253.558 25.421 0.893 7.488 4.461 0.592

本研究算法与各算法在UIEB数据集上的评估结果如表2 所示. 本研究算法在均方误差MSE上较次优的U-shape降低了40.3%,反映了本研究算法在像素级保真度和噪声抑制上具有优势;相应地,在峰值信噪比PSNR指标上亦居于首位,表明其增强后的图像具有最高的信噪比和整体质量;在结构相似性SSIM指标上,本研究算法与WWFP算法共同取得了最优结果;在水下场景视觉感知特性方面,本研究算法的UIQM取得了最优值;虽然在信息熵Entropy和水下色彩感知指标中,本研究算法未达到最优值,但其结果处于合理且具有竞争力的区间. 综合增强图像的主观视觉感受,本研究算法的综合性能优于所列对比算法,充分验证了本研究算法具有良好的泛化性和鲁棒性. ...

... Objective evaluation metrics of image quality for various algorithms on UIEB

Tab.2 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1751.358 17.253 0.754 6.894 3.967 0.539 HE[7 ] 1868.491 16.621 0.737 7.167 4.294 0.664 CLAHE[8 ] 1216.226 18.194 0.713 7.319 4.424 0.567 DEFOG[6 ] 2730.896 15.243 0.709 6.841 4.231 0.553 Ucolor[25 ] 868.585 20.151 0.748 7.368 4.211 0.608 URST[26 ] 864.725 20.178 0.769 7.415 4.359 0.584 U-Shape[18 ] 734.626 20.881 0.709 7.262 4.397 0.578 WFFP[27 ] 828.485 18.949 0.791 7.749 4.213 0.609 Spectroformer[28 ] 1546.455 16.235 0.684 6.552 3.723 0.521 本研究算法 438.480 21.711 0.792 7.301 4.443 0.579

2.5. 消融实验 为了证明特征细化模块和注意力增强重构模块在水下图像增强网络中的作用,在保证其他实验条件相同的情况下,消融实验通过对比不同模块的增益效果,验证算法的有效性. 消融实验设置如下:1)在基准模型中引入特征细化增强模块;2)在基准模型中引入注意力增强重构模块. 消融实验对比图像如图9 所示,基准模型在增强水下图像时,虽然能够改善部分的视觉效果,但在颜色对比度、细节恢复度和纹理清晰度方面仍存在不足,在黄色鱼场景下(见图9 (Ⅰ)区域),经过基准模型增强的图像,整体亮度有所提升,但鱼的轮廓和背景珊瑚的细节仍然较为模糊,颜色饱和度较低. 在引入特征细化模块后,图像的色彩对比度和细节表现得到显著提升,在水下珊瑚场景中(见图9 (Ⅱ)区域),经过特征细化模块处理的图像,纹理表现更加清晰. 注意力增强重构模块的引入使得图像整体质量进一步提升,不仅改善了颜色饱和度,而且显著增强了图像中纹理的清晰度,图像细节更丰富. 本研究算法融合特征细化模块和注意力增强重构模块,在所有测试场景中均取得了最佳视觉效果,增强结果图像最接近参考图像. 表明本研究算法在水下图像增强任务中具有最好的主观视觉表现. ...

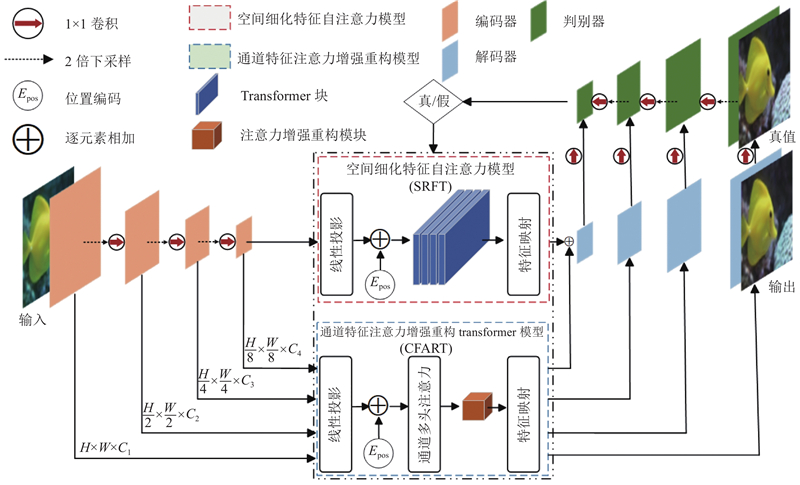

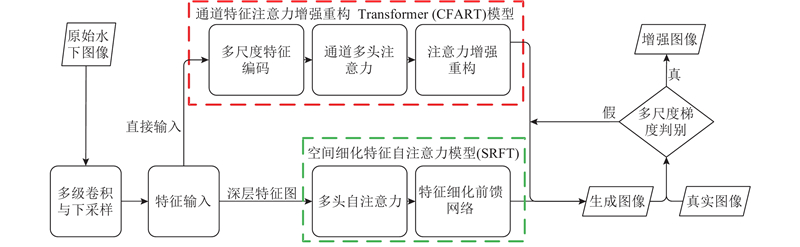

1

... 水下图像存在色彩伪影和细节模糊问题,若直接采用Transformer网络进行增强,往往会因密集注意力机制[19 ] 对特征全局关系的计算,导致对水下图像不相关区域部分的注意力权重分配不合理,从而降低水下图像增强效果. 本研究提出基于特征细化与注意力增强重构的水下图像增强算法,该网络的整体结构如图1 所示. 针对Transformer网络中产生的特征冗余问题,设计SRFT与CFART模块构建特征优化和注意力增强协同框架,减少特征冗余,降低噪声,实现水下图像的增强. 针对传统前馈网络中深层Transformer编码的全局语义特征存在通道冗余的问题,SRFT模块将特征细化模块嵌入前馈网络,通过“增强-抑制”双阶段通道精炼策略,先增强高价值通道特征,再采用门控机制减少特征冗余,有效降低噪声干扰. 针对传统重构层中特征映射缺陷,CFART模块将高效通道注意力(efficient channel attention, ECA)融入特征重构模块. 通过局部跨通道卷积实现非降维加权,在保留原有通道结构的前提下,对多尺度特征进行细粒度筛选. CFART中的重构模块通过强化纹理与色彩受损通道的响应权重,使重构特征在色偏校正和细节恢复方面表现更优,同时弥补了传统线性映射的粗粒度缺陷,使解码端获取的特征更聚焦,从而显著提高水下图像增强效果. ...

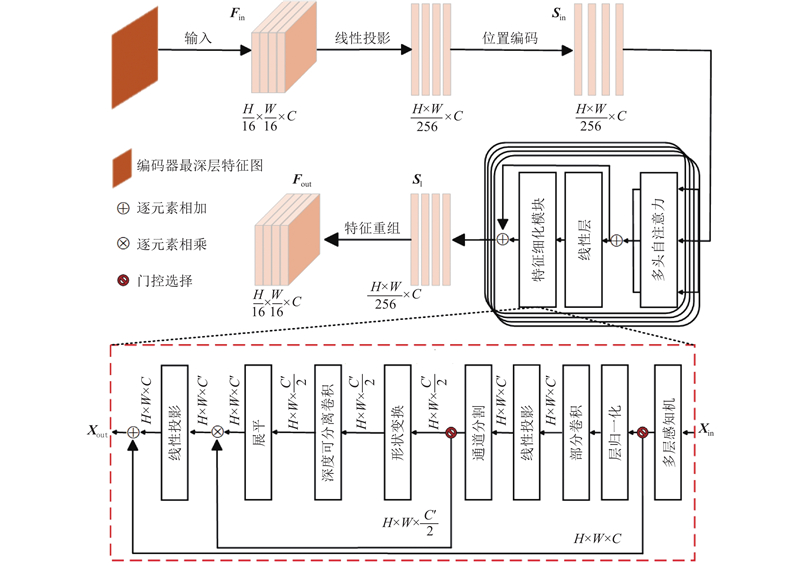

1

... 3) 特征细化前馈网络RFFN. 在每个Transformer块中,将MHA输出送入至特征细化前馈网络模块,对增强后的特征进行非线性映射,以增强模型的表达能力. 不同于FocalNet[20 ] 直接在输入层应用空间门控,RFFN将处理过程解耦为2个顺序阶段. ...

1

... (a)特征细化前馈模块对输入特征图$ {\boldsymbol{X}}_{\mathrm{in}} $ [21 ] 引入固有的通道稀疏性先验来增强局部特征信息,在减少计算量的同时保留关键通道信息,并引入非线性激活函数增强特征区分性,使网络能够先聚焦于放大关键特征信息. 该过程可以表示为 ...

Efficient convolutional neural networks for mobile vision applications

1

2017

... (b)通过数据依赖的门控抑制冗余信息,将增强后的特征$ \boldsymbol{X}' $ $ {\boldsymbol{X}}_{1} $ $ {\boldsymbol{X}}_{2} $ $ {\boldsymbol{X}}_{1} $ $ {\boldsymbol{X}}_{2} $ $ {\boldsymbol{X}}_{2} $ $ \mathrm{DWConv} $ [22 ] 提取轻量级局部空间特征,为门控信号注入局部空间上下文信息,生成门控权重;然后将增强后的特征$ {\boldsymbol{X}}_{1} $ $ {\boldsymbol{X}}_{\mathrm{r}} $

1

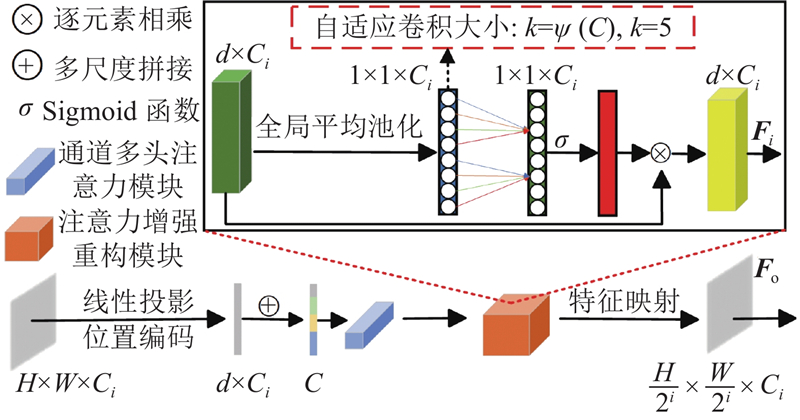

... 为了增强对衰减严重的颜色通道的关注,引入通道特征注意力增强重构模块替代原始生成器编解码架构的残差连接. 采用通道多头自注意力机制和多尺度特征融合来更精确地处理不同通道之间非均匀衰减的问题,并将ECA[23 ] 嵌入到重构层中形成注意力增强重构模块,通过ECA的局部跨通道交互来提高模块对受水下环境影响严重的特征通道的关注,增强特征表达能力,从而抑制噪声,提升水下图像增强质量. ECA的自适应交互范围也使得模块能更好地适应不同条件下的图像特征,增强模型对水下不同场景的泛化能力. CFART模块结构如图3 所示. ...

1

... 水下图像增强基准[24 ] (underwater image enhancement benchmark, UIEB)包含890组具有相应参考图像的真实水下图像,UIEB数据集在场景、光照条件和图像质量等方面更加丰富多样,能够提供更全面的测试环境. 实验随机选取UIEB数据集中不同场景的800张水下图像作为训练集,剩余的90张水下图像作为测试集. ...

Underwater image enhancement via medium transmission-guided multi-color space embedding

3

2021

... 主观评价是水下图像质量评估中不可或缺的一部分,依赖于人类视觉系统的感知特性与认知判断. 为了系统评估不同增强方法对不同水下图像的增强效果,实验选取3种传统图像增强算法(直方图均衡化HE[7 ] 、自适应直方图均衡化CLAHE[8 ] 、去雾算法Defog[6 ] )以及5种基于深度学习的水下图像增强算法(Ucolor[25 ] 、URST[26 ] 、U-Shpae[18 ] 、WFFP[27 ] 和Spectroformer[28 ] ). 将复杂水下场景(见图5 )和简单水下场景(见图6 )按色偏类型分组进行可视化对比,以便更全面地验证模型性能. 传统算法HE和CLAHE能够在一定程度上提升图像的全局对比度,但在增强过程中易引起局部区域过饱和,导致增强图像色彩失真严重,如图5 (Ⅰ)~(Ⅵ)所示;Defog算法避免了传统算法的过曝问题,但其增强效果存在局限性,未能解决水下图像的光谱偏移问题,且在处理复杂纹理图像时出现特征退化现象,表现为图5 (Ⅴ)~(Ⅵ)中生物纹理细节的严重缺失. 相较于传统图像增强算法,基于深度学习的水下图像增强算法在图像色偏校正方面表现出显著优势. Ucolor算法针对水下图像的色彩失衡问题进行了校正,相比于传统算法,有效提升了图像的色彩饱和度和对比度,但Ucolor对图像的增强效果有限,存在色彩失真现象,如图5 (Ⅳ)~(Ⅵ)中图像边缘产生非物理光晕伪影. 在绿色场景下,如图5 (Ⅲ)~(Ⅳ)所示,仅本研究算法和URST算法实现了绿色色偏的精准校正,有效恢复了水下图像的颜色信息. Ucolor算法因局部对比度过高,导致绿色信息突出且不自然,U-Shape算法则同时存在色偏残留与纹理丢失问题. 在蓝色低照度场景下,如图5 (Ⅴ)~(Ⅵ),Ucolor、U-Shape和WFFP均未能完成水下图像的蓝色色偏,仅对原始水下图像做了低水平增强,图像增强效果不理想. URST算法虽完成了对图5 (Ⅴ)中区域主要目标的颜色恢复但在低照度场景下,如图5 (Ⅵ),URST算法对蓝绿色偏的校正效果较差. Septroformer算法虽然基本上完成了图像色彩校正,但主观视觉效果较差,对图像可视的增强效果并不明显. 本研究算法在跨场景测试中最大限度地恢复了图像的真实色彩,展现出更为稳定和优越的性能,与参考图像对比表明,本研究算法基本实现了主要色彩和细节的恢复,且未出现过度增强问题,其视觉效果最接近真值图像. ...

... Objective evaluation metrics of image quality for various algorithms on LSUI

Tab.1 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1609.682 17.491 0.864 6.887 4.117 0.542 HE[7 ] 2558.828 14.931 0.751 7.141 4.308 0.604 CLAHE[8 ] 1502.201 17.008 0.843 7.208 4.337 0.565 DEFOG[6 ] 2511.267 15.608 0.869 6.925 4.325 0.553 Ucolor[25 ] 352.193 22.911 0.898 7.234 4.389 0.562 URST[26 ] 394.476 22.705 0.905 7.321 4.177 0.585 U-Shape[18 ] 334.992 24.293 0.881 7.284 4.418 0.571 WFFP[27 ] 968.713 18.271 0.735 6.792 4.201 0.601 Spectroformer[28 ] 774.806 19.388 0.640 6.314 3.9596 0.552 本研究算法 253.558 25.421 0.893 7.488 4.461 0.592

本研究算法与各算法在UIEB数据集上的评估结果如表2 所示. 本研究算法在均方误差MSE上较次优的U-shape降低了40.3%,反映了本研究算法在像素级保真度和噪声抑制上具有优势;相应地,在峰值信噪比PSNR指标上亦居于首位,表明其增强后的图像具有最高的信噪比和整体质量;在结构相似性SSIM指标上,本研究算法与WWFP算法共同取得了最优结果;在水下场景视觉感知特性方面,本研究算法的UIQM取得了最优值;虽然在信息熵Entropy和水下色彩感知指标中,本研究算法未达到最优值,但其结果处于合理且具有竞争力的区间. 综合增强图像的主观视觉感受,本研究算法的综合性能优于所列对比算法,充分验证了本研究算法具有良好的泛化性和鲁棒性. ...

... Objective evaluation metrics of image quality for various algorithms on UIEB

Tab.2 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1751.358 17.253 0.754 6.894 3.967 0.539 HE[7 ] 1868.491 16.621 0.737 7.167 4.294 0.664 CLAHE[8 ] 1216.226 18.194 0.713 7.319 4.424 0.567 DEFOG[6 ] 2730.896 15.243 0.709 6.841 4.231 0.553 Ucolor[25 ] 868.585 20.151 0.748 7.368 4.211 0.608 URST[26 ] 864.725 20.178 0.769 7.415 4.359 0.584 U-Shape[18 ] 734.626 20.881 0.709 7.262 4.397 0.578 WFFP[27 ] 828.485 18.949 0.791 7.749 4.213 0.609 Spectroformer[28 ] 1546.455 16.235 0.684 6.552 3.723 0.521 本研究算法 438.480 21.711 0.792 7.301 4.443 0.579

2.5. 消融实验 为了证明特征细化模块和注意力增强重构模块在水下图像增强网络中的作用,在保证其他实验条件相同的情况下,消融实验通过对比不同模块的增益效果,验证算法的有效性. 消融实验设置如下:1)在基准模型中引入特征细化增强模块;2)在基准模型中引入注意力增强重构模块. 消融实验对比图像如图9 所示,基准模型在增强水下图像时,虽然能够改善部分的视觉效果,但在颜色对比度、细节恢复度和纹理清晰度方面仍存在不足,在黄色鱼场景下(见图9 (Ⅰ)区域),经过基准模型增强的图像,整体亮度有所提升,但鱼的轮廓和背景珊瑚的细节仍然较为模糊,颜色饱和度较低. 在引入特征细化模块后,图像的色彩对比度和细节表现得到显著提升,在水下珊瑚场景中(见图9 (Ⅱ)区域),经过特征细化模块处理的图像,纹理表现更加清晰. 注意力增强重构模块的引入使得图像整体质量进一步提升,不仅改善了颜色饱和度,而且显著增强了图像中纹理的清晰度,图像细节更丰富. 本研究算法融合特征细化模块和注意力增强重构模块,在所有测试场景中均取得了最佳视觉效果,增强结果图像最接近参考图像. 表明本研究算法在水下图像增强任务中具有最好的主观视觉表现. ...

Reinforced swin-convs transformer for simultaneous underwater sensing scene image enhancement and super-resolution

3

2022

... 主观评价是水下图像质量评估中不可或缺的一部分,依赖于人类视觉系统的感知特性与认知判断. 为了系统评估不同增强方法对不同水下图像的增强效果,实验选取3种传统图像增强算法(直方图均衡化HE[7 ] 、自适应直方图均衡化CLAHE[8 ] 、去雾算法Defog[6 ] )以及5种基于深度学习的水下图像增强算法(Ucolor[25 ] 、URST[26 ] 、U-Shpae[18 ] 、WFFP[27 ] 和Spectroformer[28 ] ). 将复杂水下场景(见图5 )和简单水下场景(见图6 )按色偏类型分组进行可视化对比,以便更全面地验证模型性能. 传统算法HE和CLAHE能够在一定程度上提升图像的全局对比度,但在增强过程中易引起局部区域过饱和,导致增强图像色彩失真严重,如图5 (Ⅰ)~(Ⅵ)所示;Defog算法避免了传统算法的过曝问题,但其增强效果存在局限性,未能解决水下图像的光谱偏移问题,且在处理复杂纹理图像时出现特征退化现象,表现为图5 (Ⅴ)~(Ⅵ)中生物纹理细节的严重缺失. 相较于传统图像增强算法,基于深度学习的水下图像增强算法在图像色偏校正方面表现出显著优势. Ucolor算法针对水下图像的色彩失衡问题进行了校正,相比于传统算法,有效提升了图像的色彩饱和度和对比度,但Ucolor对图像的增强效果有限,存在色彩失真现象,如图5 (Ⅳ)~(Ⅵ)中图像边缘产生非物理光晕伪影. 在绿色场景下,如图5 (Ⅲ)~(Ⅳ)所示,仅本研究算法和URST算法实现了绿色色偏的精准校正,有效恢复了水下图像的颜色信息. Ucolor算法因局部对比度过高,导致绿色信息突出且不自然,U-Shape算法则同时存在色偏残留与纹理丢失问题. 在蓝色低照度场景下,如图5 (Ⅴ)~(Ⅵ),Ucolor、U-Shape和WFFP均未能完成水下图像的蓝色色偏,仅对原始水下图像做了低水平增强,图像增强效果不理想. URST算法虽完成了对图5 (Ⅴ)中区域主要目标的颜色恢复但在低照度场景下,如图5 (Ⅵ),URST算法对蓝绿色偏的校正效果较差. Septroformer算法虽然基本上完成了图像色彩校正,但主观视觉效果较差,对图像可视的增强效果并不明显. 本研究算法在跨场景测试中最大限度地恢复了图像的真实色彩,展现出更为稳定和优越的性能,与参考图像对比表明,本研究算法基本实现了主要色彩和细节的恢复,且未出现过度增强问题,其视觉效果最接近真值图像. ...

... Objective evaluation metrics of image quality for various algorithms on LSUI

Tab.1 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1609.682 17.491 0.864 6.887 4.117 0.542 HE[7 ] 2558.828 14.931 0.751 7.141 4.308 0.604 CLAHE[8 ] 1502.201 17.008 0.843 7.208 4.337 0.565 DEFOG[6 ] 2511.267 15.608 0.869 6.925 4.325 0.553 Ucolor[25 ] 352.193 22.911 0.898 7.234 4.389 0.562 URST[26 ] 394.476 22.705 0.905 7.321 4.177 0.585 U-Shape[18 ] 334.992 24.293 0.881 7.284 4.418 0.571 WFFP[27 ] 968.713 18.271 0.735 6.792 4.201 0.601 Spectroformer[28 ] 774.806 19.388 0.640 6.314 3.9596 0.552 本研究算法 253.558 25.421 0.893 7.488 4.461 0.592

本研究算法与各算法在UIEB数据集上的评估结果如表2 所示. 本研究算法在均方误差MSE上较次优的U-shape降低了40.3%,反映了本研究算法在像素级保真度和噪声抑制上具有优势;相应地,在峰值信噪比PSNR指标上亦居于首位,表明其增强后的图像具有最高的信噪比和整体质量;在结构相似性SSIM指标上,本研究算法与WWFP算法共同取得了最优结果;在水下场景视觉感知特性方面,本研究算法的UIQM取得了最优值;虽然在信息熵Entropy和水下色彩感知指标中,本研究算法未达到最优值,但其结果处于合理且具有竞争力的区间. 综合增强图像的主观视觉感受,本研究算法的综合性能优于所列对比算法,充分验证了本研究算法具有良好的泛化性和鲁棒性. ...

... Objective evaluation metrics of image quality for various algorithms on UIEB

Tab.2 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1751.358 17.253 0.754 6.894 3.967 0.539 HE[7 ] 1868.491 16.621 0.737 7.167 4.294 0.664 CLAHE[8 ] 1216.226 18.194 0.713 7.319 4.424 0.567 DEFOG[6 ] 2730.896 15.243 0.709 6.841 4.231 0.553 Ucolor[25 ] 868.585 20.151 0.748 7.368 4.211 0.608 URST[26 ] 864.725 20.178 0.769 7.415 4.359 0.584 U-Shape[18 ] 734.626 20.881 0.709 7.262 4.397 0.578 WFFP[27 ] 828.485 18.949 0.791 7.749 4.213 0.609 Spectroformer[28 ] 1546.455 16.235 0.684 6.552 3.723 0.521 本研究算法 438.480 21.711 0.792 7.301 4.443 0.579

2.5. 消融实验 为了证明特征细化模块和注意力增强重构模块在水下图像增强网络中的作用,在保证其他实验条件相同的情况下,消融实验通过对比不同模块的增益效果,验证算法的有效性. 消融实验设置如下:1)在基准模型中引入特征细化增强模块;2)在基准模型中引入注意力增强重构模块. 消融实验对比图像如图9 所示,基准模型在增强水下图像时,虽然能够改善部分的视觉效果,但在颜色对比度、细节恢复度和纹理清晰度方面仍存在不足,在黄色鱼场景下(见图9 (Ⅰ)区域),经过基准模型增强的图像,整体亮度有所提升,但鱼的轮廓和背景珊瑚的细节仍然较为模糊,颜色饱和度较低. 在引入特征细化模块后,图像的色彩对比度和细节表现得到显著提升,在水下珊瑚场景中(见图9 (Ⅱ)区域),经过特征细化模块处理的图像,纹理表现更加清晰. 注意力增强重构模块的引入使得图像整体质量进一步提升,不仅改善了颜色饱和度,而且显著增强了图像中纹理的清晰度,图像细节更丰富. 本研究算法融合特征细化模块和注意力增强重构模块,在所有测试场景中均取得了最佳视觉效果,增强结果图像最接近参考图像. 表明本研究算法在水下图像增强任务中具有最好的主观视觉表现. ...

Underwater image enhancement via weighted wavelet visual perception fusion

3

2024

... 主观评价是水下图像质量评估中不可或缺的一部分,依赖于人类视觉系统的感知特性与认知判断. 为了系统评估不同增强方法对不同水下图像的增强效果,实验选取3种传统图像增强算法(直方图均衡化HE[7 ] 、自适应直方图均衡化CLAHE[8 ] 、去雾算法Defog[6 ] )以及5种基于深度学习的水下图像增强算法(Ucolor[25 ] 、URST[26 ] 、U-Shpae[18 ] 、WFFP[27 ] 和Spectroformer[28 ] ). 将复杂水下场景(见图5 )和简单水下场景(见图6 )按色偏类型分组进行可视化对比,以便更全面地验证模型性能. 传统算法HE和CLAHE能够在一定程度上提升图像的全局对比度,但在增强过程中易引起局部区域过饱和,导致增强图像色彩失真严重,如图5 (Ⅰ)~(Ⅵ)所示;Defog算法避免了传统算法的过曝问题,但其增强效果存在局限性,未能解决水下图像的光谱偏移问题,且在处理复杂纹理图像时出现特征退化现象,表现为图5 (Ⅴ)~(Ⅵ)中生物纹理细节的严重缺失. 相较于传统图像增强算法,基于深度学习的水下图像增强算法在图像色偏校正方面表现出显著优势. Ucolor算法针对水下图像的色彩失衡问题进行了校正,相比于传统算法,有效提升了图像的色彩饱和度和对比度,但Ucolor对图像的增强效果有限,存在色彩失真现象,如图5 (Ⅳ)~(Ⅵ)中图像边缘产生非物理光晕伪影. 在绿色场景下,如图5 (Ⅲ)~(Ⅳ)所示,仅本研究算法和URST算法实现了绿色色偏的精准校正,有效恢复了水下图像的颜色信息. Ucolor算法因局部对比度过高,导致绿色信息突出且不自然,U-Shape算法则同时存在色偏残留与纹理丢失问题. 在蓝色低照度场景下,如图5 (Ⅴ)~(Ⅵ),Ucolor、U-Shape和WFFP均未能完成水下图像的蓝色色偏,仅对原始水下图像做了低水平增强,图像增强效果不理想. URST算法虽完成了对图5 (Ⅴ)中区域主要目标的颜色恢复但在低照度场景下,如图5 (Ⅵ),URST算法对蓝绿色偏的校正效果较差. Septroformer算法虽然基本上完成了图像色彩校正,但主观视觉效果较差,对图像可视的增强效果并不明显. 本研究算法在跨场景测试中最大限度地恢复了图像的真实色彩,展现出更为稳定和优越的性能,与参考图像对比表明,本研究算法基本实现了主要色彩和细节的恢复,且未出现过度增强问题,其视觉效果最接近真值图像. ...

... Objective evaluation metrics of image quality for various algorithms on LSUI

Tab.1 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1609.682 17.491 0.864 6.887 4.117 0.542 HE[7 ] 2558.828 14.931 0.751 7.141 4.308 0.604 CLAHE[8 ] 1502.201 17.008 0.843 7.208 4.337 0.565 DEFOG[6 ] 2511.267 15.608 0.869 6.925 4.325 0.553 Ucolor[25 ] 352.193 22.911 0.898 7.234 4.389 0.562 URST[26 ] 394.476 22.705 0.905 7.321 4.177 0.585 U-Shape[18 ] 334.992 24.293 0.881 7.284 4.418 0.571 WFFP[27 ] 968.713 18.271 0.735 6.792 4.201 0.601 Spectroformer[28 ] 774.806 19.388 0.640 6.314 3.9596 0.552 本研究算法 253.558 25.421 0.893 7.488 4.461 0.592

本研究算法与各算法在UIEB数据集上的评估结果如表2 所示. 本研究算法在均方误差MSE上较次优的U-shape降低了40.3%,反映了本研究算法在像素级保真度和噪声抑制上具有优势;相应地,在峰值信噪比PSNR指标上亦居于首位,表明其增强后的图像具有最高的信噪比和整体质量;在结构相似性SSIM指标上,本研究算法与WWFP算法共同取得了最优结果;在水下场景视觉感知特性方面,本研究算法的UIQM取得了最优值;虽然在信息熵Entropy和水下色彩感知指标中,本研究算法未达到最优值,但其结果处于合理且具有竞争力的区间. 综合增强图像的主观视觉感受,本研究算法的综合性能优于所列对比算法,充分验证了本研究算法具有良好的泛化性和鲁棒性. ...

... Objective evaluation metrics of image quality for various algorithms on UIEB

Tab.2 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1751.358 17.253 0.754 6.894 3.967 0.539 HE[7 ] 1868.491 16.621 0.737 7.167 4.294 0.664 CLAHE[8 ] 1216.226 18.194 0.713 7.319 4.424 0.567 DEFOG[6 ] 2730.896 15.243 0.709 6.841 4.231 0.553 Ucolor[25 ] 868.585 20.151 0.748 7.368 4.211 0.608 URST[26 ] 864.725 20.178 0.769 7.415 4.359 0.584 U-Shape[18 ] 734.626 20.881 0.709 7.262 4.397 0.578 WFFP[27 ] 828.485 18.949 0.791 7.749 4.213 0.609 Spectroformer[28 ] 1546.455 16.235 0.684 6.552 3.723 0.521 本研究算法 438.480 21.711 0.792 7.301 4.443 0.579

2.5. 消融实验 为了证明特征细化模块和注意力增强重构模块在水下图像增强网络中的作用,在保证其他实验条件相同的情况下,消融实验通过对比不同模块的增益效果,验证算法的有效性. 消融实验设置如下:1)在基准模型中引入特征细化增强模块;2)在基准模型中引入注意力增强重构模块. 消融实验对比图像如图9 所示,基准模型在增强水下图像时,虽然能够改善部分的视觉效果,但在颜色对比度、细节恢复度和纹理清晰度方面仍存在不足,在黄色鱼场景下(见图9 (Ⅰ)区域),经过基准模型增强的图像,整体亮度有所提升,但鱼的轮廓和背景珊瑚的细节仍然较为模糊,颜色饱和度较低. 在引入特征细化模块后,图像的色彩对比度和细节表现得到显著提升,在水下珊瑚场景中(见图9 (Ⅱ)区域),经过特征细化模块处理的图像,纹理表现更加清晰. 注意力增强重构模块的引入使得图像整体质量进一步提升,不仅改善了颜色饱和度,而且显著增强了图像中纹理的清晰度,图像细节更丰富. 本研究算法融合特征细化模块和注意力增强重构模块,在所有测试场景中均取得了最佳视觉效果,增强结果图像最接近参考图像. 表明本研究算法在水下图像增强任务中具有最好的主观视觉表现. ...

3

... 主观评价是水下图像质量评估中不可或缺的一部分,依赖于人类视觉系统的感知特性与认知判断. 为了系统评估不同增强方法对不同水下图像的增强效果,实验选取3种传统图像增强算法(直方图均衡化HE[7 ] 、自适应直方图均衡化CLAHE[8 ] 、去雾算法Defog[6 ] )以及5种基于深度学习的水下图像增强算法(Ucolor[25 ] 、URST[26 ] 、U-Shpae[18 ] 、WFFP[27 ] 和Spectroformer[28 ] ). 将复杂水下场景(见图5 )和简单水下场景(见图6 )按色偏类型分组进行可视化对比,以便更全面地验证模型性能. 传统算法HE和CLAHE能够在一定程度上提升图像的全局对比度,但在增强过程中易引起局部区域过饱和,导致增强图像色彩失真严重,如图5 (Ⅰ)~(Ⅵ)所示;Defog算法避免了传统算法的过曝问题,但其增强效果存在局限性,未能解决水下图像的光谱偏移问题,且在处理复杂纹理图像时出现特征退化现象,表现为图5 (Ⅴ)~(Ⅵ)中生物纹理细节的严重缺失. 相较于传统图像增强算法,基于深度学习的水下图像增强算法在图像色偏校正方面表现出显著优势. Ucolor算法针对水下图像的色彩失衡问题进行了校正,相比于传统算法,有效提升了图像的色彩饱和度和对比度,但Ucolor对图像的增强效果有限,存在色彩失真现象,如图5 (Ⅳ)~(Ⅵ)中图像边缘产生非物理光晕伪影. 在绿色场景下,如图5 (Ⅲ)~(Ⅳ)所示,仅本研究算法和URST算法实现了绿色色偏的精准校正,有效恢复了水下图像的颜色信息. Ucolor算法因局部对比度过高,导致绿色信息突出且不自然,U-Shape算法则同时存在色偏残留与纹理丢失问题. 在蓝色低照度场景下,如图5 (Ⅴ)~(Ⅵ),Ucolor、U-Shape和WFFP均未能完成水下图像的蓝色色偏,仅对原始水下图像做了低水平增强,图像增强效果不理想. URST算法虽完成了对图5 (Ⅴ)中区域主要目标的颜色恢复但在低照度场景下,如图5 (Ⅵ),URST算法对蓝绿色偏的校正效果较差. Septroformer算法虽然基本上完成了图像色彩校正,但主观视觉效果较差,对图像可视的增强效果并不明显. 本研究算法在跨场景测试中最大限度地恢复了图像的真实色彩,展现出更为稳定和优越的性能,与参考图像对比表明,本研究算法基本实现了主要色彩和细节的恢复,且未出现过度增强问题,其视觉效果最接近真值图像. ...

... Objective evaluation metrics of image quality for various algorithms on LSUI

Tab.1 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1609.682 17.491 0.864 6.887 4.117 0.542 HE[7 ] 2558.828 14.931 0.751 7.141 4.308 0.604 CLAHE[8 ] 1502.201 17.008 0.843 7.208 4.337 0.565 DEFOG[6 ] 2511.267 15.608 0.869 6.925 4.325 0.553 Ucolor[25 ] 352.193 22.911 0.898 7.234 4.389 0.562 URST[26 ] 394.476 22.705 0.905 7.321 4.177 0.585 U-Shape[18 ] 334.992 24.293 0.881 7.284 4.418 0.571 WFFP[27 ] 968.713 18.271 0.735 6.792 4.201 0.601 Spectroformer[28 ] 774.806 19.388 0.640 6.314 3.9596 0.552 本研究算法 253.558 25.421 0.893 7.488 4.461 0.592

本研究算法与各算法在UIEB数据集上的评估结果如表2 所示. 本研究算法在均方误差MSE上较次优的U-shape降低了40.3%,反映了本研究算法在像素级保真度和噪声抑制上具有优势;相应地,在峰值信噪比PSNR指标上亦居于首位,表明其增强后的图像具有最高的信噪比和整体质量;在结构相似性SSIM指标上,本研究算法与WWFP算法共同取得了最优结果;在水下场景视觉感知特性方面,本研究算法的UIQM取得了最优值;虽然在信息熵Entropy和水下色彩感知指标中,本研究算法未达到最优值,但其结果处于合理且具有竞争力的区间. 综合增强图像的主观视觉感受,本研究算法的综合性能优于所列对比算法,充分验证了本研究算法具有良好的泛化性和鲁棒性. ...

... Objective evaluation metrics of image quality for various algorithms on UIEB

Tab.2 算法 MSE↓ PSNR↑ SSIM↑ Entropy UIQM↑ UCIQE↑ 原始图像 1751.358 17.253 0.754 6.894 3.967 0.539 HE[7 ] 1868.491 16.621 0.737 7.167 4.294 0.664 CLAHE[8 ] 1216.226 18.194 0.713 7.319 4.424 0.567 DEFOG[6 ] 2730.896 15.243 0.709 6.841 4.231 0.553 Ucolor[25 ] 868.585 20.151 0.748 7.368 4.211 0.608 URST[26 ] 864.725 20.178 0.769 7.415 4.359 0.584 U-Shape[18 ] 734.626 20.881 0.709 7.262 4.397 0.578 WFFP[27 ] 828.485 18.949 0.791 7.749 4.213 0.609 Spectroformer[28 ] 1546.455 16.235 0.684 6.552 3.723 0.521 本研究算法 438.480 21.711 0.792 7.301 4.443 0.579

2.5. 消融实验 为了证明特征细化模块和注意力增强重构模块在水下图像增强网络中的作用,在保证其他实验条件相同的情况下,消融实验通过对比不同模块的增益效果,验证算法的有效性. 消融实验设置如下:1)在基准模型中引入特征细化增强模块;2)在基准模型中引入注意力增强重构模块. 消融实验对比图像如图9 所示,基准模型在增强水下图像时,虽然能够改善部分的视觉效果,但在颜色对比度、细节恢复度和纹理清晰度方面仍存在不足,在黄色鱼场景下(见图9 (Ⅰ)区域),经过基准模型增强的图像,整体亮度有所提升,但鱼的轮廓和背景珊瑚的细节仍然较为模糊,颜色饱和度较低. 在引入特征细化模块后,图像的色彩对比度和细节表现得到显著提升,在水下珊瑚场景中(见图9 (Ⅱ)区域),经过特征细化模块处理的图像,纹理表现更加清晰. 注意力增强重构模块的引入使得图像整体质量进一步提升,不仅改善了颜色饱和度,而且显著增强了图像中纹理的清晰度,图像细节更丰富. 本研究算法融合特征细化模块和注意力增强重构模块,在所有测试场景中均取得了最佳视觉效果,增强结果图像最接近参考图像. 表明本研究算法在水下图像增强任务中具有最好的主观视觉表现. ...

An underwater color image quality evaluation metric

1

2015

... 图像质量评价指标是评估处理算法好坏的重要指标,为了评估图像的增强效果,采用6种水下图像客观评价指标:均方误差(mean square error,MSE)、峰值信噪比(peak signal-to-noise ratio,PSNR)、结构相似性(structural similarity,SSIM)、水下图像质量指标(underwater image quality measure,UIQM)[29 ] 、水下图像质量评估指标(underwater color image quality evaluation,UCIQE)[30 ] 和图像信息熵(Entropy). ...

Human-visual-system-inspired underwater image quality measures

1

2015

... 图像质量评价指标是评估处理算法好坏的重要指标,为了评估图像的增强效果,采用6种水下图像客观评价指标:均方误差(mean square error,MSE)、峰值信噪比(peak signal-to-noise ratio,PSNR)、结构相似性(structural similarity,SSIM)、水下图像质量指标(underwater image quality measure,UIQM)[29 ] 、水下图像质量评估指标(underwater color image quality evaluation,UCIQE)[30 ] 和图像信息熵(Entropy). ...