[1]

GOODFELLOW I J, POUGETABADIE J, MIRZA M, et al Generative adversarial nets

[J]. Advances in Neural Information Processing Systems , 2014 , 27 : 2672 - 2680

[本文引用: 2]

[2]

KARRAS T, LAINE S, AILA T. A style-based generator architecture for generative adversarial networks [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Los Angeles: IEEE, 2019: 4401-4410.

[本文引用: 1]

[3]

ISOLA P, ZHU J Y, ZHOU T, et al. Image-to-image translation with conditional adversarial networks [C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Honolulu: IEEE, 2017: 5967-5976.

[本文引用: 5]

[4]

PARK T, LIU M Y, WANG T C, et al. Semantic image synthesis with spatially-adaptive normalization [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Long Beach: IEEE, 2019: 2332-2341.

[本文引用: 1]

[5]

ZHU J Y, PARK T, ISOLA P, et al. Unpaired image-to-image translation using cycle-consistent adversarial networks [C]// Proceedings of the IEEE International Conference on Computer Vision. Venice: IEEE, 2017: 2223-2232.

[本文引用: 5]

[6]

JOHNSON J, ALAHI A, LFF. Perceptual losses for real-time style transfer and super-resolution [C]// Proceedings of the European Conference on Computer Vision. Cham: Springer, 2016: 694-711.

[本文引用: 1]

[7]

ZHAO Z, MA X. A compensation method of two-stage image generation for human-ai collaborated in-situ fashion design in augmented reality environment [C]// IEEE International Conference on Artificial Intelligence and Virtual Reality (AIVR). Taiwan: IEEE, 2018: 76-83.

[本文引用: 1]

[8]

YU C, HU Y, CHEN Y, et al. Personalized fashion design [C]// Proceedings of the IEEE/CVF International Conference on Computer Vision. Seoul: IEEE, 2019: 9045-9054.

[本文引用: 2]

[9]

HAN Y, YANG S, WANG W, et al. From design draft to real attire: unaligned fashion image translation [C]// Proceedings of the 28th ACM International Conference on Multimedia. Seattle: ACM, 2020: 1533-1541.

[本文引用: 1]

[10]

WANG T C, LIU M Y, ZHU J Y, et al. High-resolution image synthesis and semantic manipulation with conditional GANs [C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Salt Lake City: IEEE, 2018: 8798-8807.

[本文引用: 1]

[12]

KIM T, CHA M, KIM H, et al. Learning to discover cross-domain relations with generative adversarial networks [C]// Proceedings of the International Conference on Machine Learning. Belgium: PMLR, 2017: 1857-1865.

[本文引用: 4]

[13]

CHOI Y, CHOI M, KIM M, et al. Stargan: unified generative adversarial networks for multi-domain image-to-image translation [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Seattle: IEEE, 2018: 8789-8797.

[本文引用: 1]

[14]

XU Y, XIE S, WU W, et al. Maximum Spatial perturbation consistency for unpaired image-to-image translation [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition . New Orleans: IEEE, 2022: 18311-18320.

[本文引用: 1]

[15]

LIU B, SONG K, ZHU Y, et al. Sketch-to-art: synthesizing stylized art images from sketches [C]// Proceedings of the Asian Conference on Computer Vision. Cham: Springer, 2020: 207-222.

[本文引用: 1]

[16]

CHOI Y, UH Y, YOO J, et al. StarGANv2: diverse image synthesis for multiple domains [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Seattle: IEEE, 2020: 8185-8194.

[本文引用: 1]

[17]

RICHARDSON E, ALALUF Y, PATASHNIK O, et al. Encoding in style: a stylegan encoder for image-to-image translation [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition . Nashville: IEEE, 2021: 2287-2296.

[本文引用: 1]

[18]

ZHANG P, ZHANG B, CHEN D, et al. Cross-domain correspondence learning for exemplar-based image translation [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Seattle: IEEE, 2020: 5142-5152.

[本文引用: 4]

[19]

ZHOU X, ZHANG B, ZHANG T, et al. Cocosnet v2: Full-resolution correspondence learning for image translation [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Nashville: IEEE, 2021: 11460-11470.

[本文引用: 3]

[20]

VASILEVA M I, PLUMMER B A, DUSAD K, et al. Learning type-aware embeddings for fashion compatibility [C]// Proceedings of the European Conference on Computer Vision (ECCV). Cham: Springer, 2018: 390-405.

[本文引用: 2]

[21]

HAN X, WU Z, JIANG Y G, et al. Learning fashion compatibility with bidirectional lstms [C]// Proceedings of the 25th ACM International Conference on Multimedia. Mountain View: ACM, 2017: 1078–1086.

[本文引用: 1]

[22]

TAUTKUTE I, TRZCIŃSKI T, SKORUPA A P, et al Deepstyle: multimodal search engine for fashion and interior design

[J]. IEEE Access , 2019 , 7 : 84613 - 84628

DOI:10.1109/ACCESS.2019.2923552

[23]

MCAULEY J, TARGETT C, SHI Q, et al. Image-based recommendations on styles and substitutes [C]// Proceedings of the 38th International ACM SIGIR Conference on Research and Development in Information Retrieval. Santiago: ACM, 2015: 43-52.

[24]

VEIT A, KOVACS B, BELL S, et al. Learning visual clothing style with heterogeneous dyadic co-occurrences [C]// Proceedings of the IEEE International Conference on Computer Vision. Santiago: IEEE, 2015: 4642-4650.

[25]

LIN Y L, TRAN S, DAVIS L S. Fashion outfit complementary item retrieval [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Seattle: IEEE, 2020: 3308-3316.

[本文引用: 2]

[26]

LIU L, ZHANG H, ZHOU D Clothing generation by multi-modal embedding: a compatibility matrix-regularized GAN model

[J]. Image and Vision Computing , 2021 , 107 : 104097

DOI:10.1016/j.imavis.2021.104097

[本文引用: 1]

[27]

DONG X, SONG X, ZHENG N, et al TryonCM2: try-on-enhanced fashion compatibility modeling framework

[J]. IEEE Transactions on Neural Networks and Learning Systems , 2022 , 1 - 12

[本文引用: 1]

[28]

WANG Y, WEI Y, QIAN X, et al Sketch-guided scenery image outpainting

[J]. IEEE Transactions on Image Processing , 2021 , 30 : 2643 - 2655

DOI:10.1109/TIP.2021.3054477

[本文引用: 1]

[29]

NGUYEN T, LE T, VU H, et al. Dual discriminator generative adversarial nets [EB/OL]. [2017-09-12]. https://arxiv.org/pdf/1709.03831.pdf.

[本文引用: 1]

[30]

SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition [EB/OL]. [2015-04-10]. https://arxiv.org/pdf/1409.1556.pdf.

[本文引用: 1]

[31]

XIE S, TU Z. Holistically-nested edge detection [C]// Proceedings of the IEEE International Conference on Computer Vision . Santiago: IEEE, 2015: 1395-1403.

[本文引用: 1]

[32]

SONG X, FENG F, LIU J, et al. Neurostylist: Neural compatibility modeling for clothing matching [C]// Proceedings of the 25th ACM International Conference on Multimedia. Mountain View: ACM, 2017: 753-761.

[本文引用: 1]

[33]

CANNY J A computational approach to edge detection

[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence , 1986 , 8 (6 ): 679 - 698

[本文引用: 1]

[34]

KINGMA D P, BA J. Adam: a method for stochastic optimization [EB/OL]. (2017-01-30)[2023-4-18]. http://orxiv.org/pdf/1412.6980.pdf.

[本文引用: 1]

[35]

HEUSEL M, RAMSAUER H, UNTERTHINER T, et al. Gans trained by a two time-scale update rule converge to a local nash equilibrium [C]// Advances in Neural Information Processing Systems. Long Beach: CA, 2017: 6626-6637.

[本文引用: 1]

[36]

SALIMANS T, GOODFELLOW I, ZAREMBA W, et al. Improved techniques for training gans [C]// Advances in Neural Information Processing Systems. Barcelona: CA, 2016: 2226-2234.

[本文引用: 1]

[37]

WANG Z, BOVIK A C, SHEIKH H R, et al Image quality assessment: from error visibility to structural similarity

[J]. IEEE Transactions on Image Processing , 2004 , 13 (4 ): 600 - 612

DOI:10.1109/TIP.2003.819861

[本文引用: 1]

[38]

SZEGEDY C, VANHOUCKE V, IOFFE S, et al. Rethinking the inception architecture for computer vision [C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas: IEEE, 2016: 2818-2826.

[本文引用: 1]

[39]

TANGO K, KATSURAI M, MAKI H, et al Anime-to-real clothing: cosplay costume generation via image-to-image translation

[J]. Multimedia Tools and Applications , 2022 , 81 : 29505 - 29523

DOI:10.1007/s11042-022-12576-x

[本文引用: 3]

Generative adversarial nets

2

2014

... 自生成对抗网络[1 ] 提出以来,图像生成的研究取得重大进步,不仅可以从随机噪声生成人脸、汽车、风景等高质量的逼真图像[2 -4 ] ,还在图像到图像翻译的研究上取得显著的成果[5 -6 ] .目前在时尚领域已经有许多相关的应用,如虚拟试妆、虚拟试衣、时尚搭配、时装生成等. Zhao等[7 ] 设计一个基于Pix2Pix的在线服装设计系统,在第1阶段输入服装关键点,生成一个中间态的补偿;在第2阶段结合草图生成一个粗糙的服装设计图像. 该方法的缺点在于用户并不能控制设计图的风格,而且还要对生成的设计图进一步修改完善. Yu等[8 ] 提出一种基于用户风格偏好的生成对抗网络(generative adversarial nets, GAN)模型,考虑到服装兼容性,输入用户查询上衣(下装)来生成符合用户品味的下装(上衣),但是用户不能控制生成服装的种类和细节. Han等[9 ] 提出从设计稿到真实时尚单品的翻译网络(design draft to real fashion item translation network, R2Dnet),将具备丰富纹理与颜色信息的设计图合成为真实的服装图像,有效解决未对齐的设计图和真实服装之间的翻译问题,但是绘制精细的服装设计图需要一定的绘画基础,该方法对普通用户并不友好. ...

... 引入感知损失和风格损失[1 ] .使用预先训练好的VGG16[30 ] 分别计算生成服装和真实服装的激活特征图,然后计算两者之间的 $ {L}_{1} $

1

... 自生成对抗网络[1 ] 提出以来,图像生成的研究取得重大进步,不仅可以从随机噪声生成人脸、汽车、风景等高质量的逼真图像[2 -4 ] ,还在图像到图像翻译的研究上取得显著的成果[5 -6 ] .目前在时尚领域已经有许多相关的应用,如虚拟试妆、虚拟试衣、时尚搭配、时装生成等. Zhao等[7 ] 设计一个基于Pix2Pix的在线服装设计系统,在第1阶段输入服装关键点,生成一个中间态的补偿;在第2阶段结合草图生成一个粗糙的服装设计图像. 该方法的缺点在于用户并不能控制设计图的风格,而且还要对生成的设计图进一步修改完善. Yu等[8 ] 提出一种基于用户风格偏好的生成对抗网络(generative adversarial nets, GAN)模型,考虑到服装兼容性,输入用户查询上衣(下装)来生成符合用户品味的下装(上衣),但是用户不能控制生成服装的种类和细节. Han等[9 ] 提出从设计稿到真实时尚单品的翻译网络(design draft to real fashion item translation network, R2Dnet),将具备丰富纹理与颜色信息的设计图合成为真实的服装图像,有效解决未对齐的设计图和真实服装之间的翻译问题,但是绘制精细的服装设计图需要一定的绘画基础,该方法对普通用户并不友好. ...

5

... 经典的图像翻译方法将图像翻译至对称图像域中,对称指的是翻译前后的图像结构保持一致,是转换图像的表征形式. Isola等[3 ] 首先提出有监督的基于条件GAN的图像到图像转换方法Pix2Pix,把U-Net网络和PatchGAN作为生成器和判别器,使用对抗损失和L1损失来训练网络,可以实现语义图-图像、卫星地图-平面地图等对称图像之间的翻译. Wang等[10 ] 在Pix2Pix的基础上,进一步提出Pix2PixHD,利用多尺度生成器、多尺度判别器以及新的特征匹配损失函数来生成高清图像. 常佳等[11 ] 针对图像翻译中生成图像的轮廓、纹理等特征丢失问题,通过增加反卷积跳跃连接的次数,在一定程度上增强特征的表达能力. 为了突破数据集的局限性,CycleGAN[5 ] 、DiscoGAN[12 ] 和StarGAN[13 ] 等方法被相继提出,利用循环一致性损失,实现非对称图像之间的翻译. 当源域和目标域之间存在显著空间变化时,上述方法会导致内容失真,因此XU等[14 ] 提出最大空间扰动一致性(maximum spatial perturbation consistency, MSPC),强制空间扰动函数T 和平移算子G ,以对齐各种复杂的空间变化. 这类方法的生成图像风格受限于训练数据并且不可控制,因此应用范围较为有限. ...

... 优化真实性判别器的损失函数使得生成的服装看起来更加的真实,对于时尚服装合成的任务来说,还希望生成的服装和真实服装尽可能的一致. $ {L}_{1} $ $ {L}_{2} $ 3 ]表明,对于GAN的训练,比起 $ {L}_{2} $ ${L}_{1}$ $ {L}_{1} $

... 为了验证本研究方法的有效性,与传统图像翻译方法Pix2Pix[3 ] 、CycleGAN[5 ] 和DiscoGAN[12 ] ,基于示例的图像翻译方法CocosNet[18 ] 和CocosNet v2[19 ] ,服装图像翻译方法Anime2Clothing[39 ] 进行定量比较. 为了保证对比实验的公平,对于Pix2Pix、CycleGAN、DiscoGAN和Anime2Clothing的输入为参考服装和草稿图像级联. ...

... Comparison of three indicators of generated images of different methods

Tab.1 方法 SSIM FID IS Pix2Pix [3 ] 0.795 3 50.237 2 4.719 7 CycleGA N[5 ] 0.546 2 72.322 1 4.228 5 DiscoGAN [12 ] 0.652 5 51.029 5 4.699 9 CocosNet [18 ] 0.654 1 38.001 8 4.384 1 CocosNet v 2[19] 0.765 9 23.462 4 4.502 6 Anime2Clothing [39 ] 0.637 4 52.329 3 4.854 3 w/o CSC Block 0.719 2 22.406 4 4.878 7 Ours 0.794 0 20.202 3 4.930 7

消融实验: 为了验证CSC模块的有效性,使用简单的跳跃连接来代替CSC,在相同的条件下进行实验,结果如表1 中倒数第2行所示,可以看出CSC提升了网络在3个指标上的表现,尤其是SSIM,原因在于草图中的结构特征在网络传播过程中得到了强化. ...

... User study on authenticity and compatibility

Tab.2 方法 真实性 得分 兼容性 得分 方法 真实性 得分 兼容性 得分 Pix2Pix[3 ] 5.44 5.61 CocosNet v2[19 ] 17.56 17.25 CycleGAN[5 ] 8.94 9.67 Anime2Clothing[39 ] 20.00 19.11 DiscoGAN[12 ] 11.19 12.81 Ours 22.08 21.00 CocosNet[18 ] 14.78 14.56 — — —

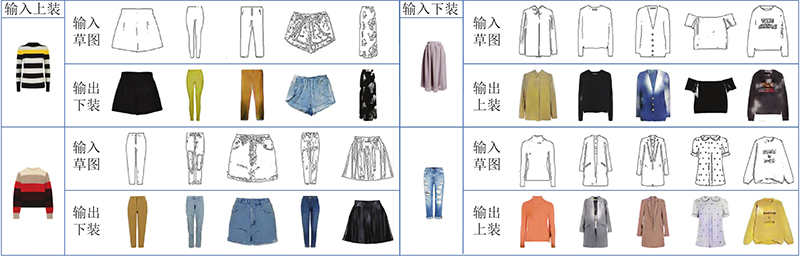

定性实验1: 图4 显示各个方法的定性实验结果. 从2、3、5行可以看出,对于纹理简单和颜色单一的服装,所提方法和其他方法生成的视觉结果相当. 从4、7、8行可以看出,对于草图较复杂的服装而言,所提方法比其它方法的纹理和细节更真实. 在服装的外形上,所提方法比CycleGAN和DiscoGAN更贴近草图. 在服装细节上,所提方法比其他方法的视觉伪影更少, 原因在于草图编码特征与生成器之间的条件跳跃连接使得草图的纹理细节被较好地保留了下来. 与此同时,生成图像与相应的真实服装在整体上更加的相似,与参考服装在视觉风格上也更加兼容. 由于在生成器中逐步的上采样过程使得生成的图像可以平缓的增长分辨率,保证了最终图像的质量,使得与真实图像十分接近. 生成器是在从参考图像提取高级特征的基础上进行生成的,很好地继承了参考图像的风格特征,而且单独应用了一个兼容性判别器,保证了更好的兼容效果. ...

1

... 自生成对抗网络[1 ] 提出以来,图像生成的研究取得重大进步,不仅可以从随机噪声生成人脸、汽车、风景等高质量的逼真图像[2 -4 ] ,还在图像到图像翻译的研究上取得显著的成果[5 -6 ] .目前在时尚领域已经有许多相关的应用,如虚拟试妆、虚拟试衣、时尚搭配、时装生成等. Zhao等[7 ] 设计一个基于Pix2Pix的在线服装设计系统,在第1阶段输入服装关键点,生成一个中间态的补偿;在第2阶段结合草图生成一个粗糙的服装设计图像. 该方法的缺点在于用户并不能控制设计图的风格,而且还要对生成的设计图进一步修改完善. Yu等[8 ] 提出一种基于用户风格偏好的生成对抗网络(generative adversarial nets, GAN)模型,考虑到服装兼容性,输入用户查询上衣(下装)来生成符合用户品味的下装(上衣),但是用户不能控制生成服装的种类和细节. Han等[9 ] 提出从设计稿到真实时尚单品的翻译网络(design draft to real fashion item translation network, R2Dnet),将具备丰富纹理与颜色信息的设计图合成为真实的服装图像,有效解决未对齐的设计图和真实服装之间的翻译问题,但是绘制精细的服装设计图需要一定的绘画基础,该方法对普通用户并不友好. ...

5

... 自生成对抗网络[1 ] 提出以来,图像生成的研究取得重大进步,不仅可以从随机噪声生成人脸、汽车、风景等高质量的逼真图像[2 -4 ] ,还在图像到图像翻译的研究上取得显著的成果[5 -6 ] .目前在时尚领域已经有许多相关的应用,如虚拟试妆、虚拟试衣、时尚搭配、时装生成等. Zhao等[7 ] 设计一个基于Pix2Pix的在线服装设计系统,在第1阶段输入服装关键点,生成一个中间态的补偿;在第2阶段结合草图生成一个粗糙的服装设计图像. 该方法的缺点在于用户并不能控制设计图的风格,而且还要对生成的设计图进一步修改完善. Yu等[8 ] 提出一种基于用户风格偏好的生成对抗网络(generative adversarial nets, GAN)模型,考虑到服装兼容性,输入用户查询上衣(下装)来生成符合用户品味的下装(上衣),但是用户不能控制生成服装的种类和细节. Han等[9 ] 提出从设计稿到真实时尚单品的翻译网络(design draft to real fashion item translation network, R2Dnet),将具备丰富纹理与颜色信息的设计图合成为真实的服装图像,有效解决未对齐的设计图和真实服装之间的翻译问题,但是绘制精细的服装设计图需要一定的绘画基础,该方法对普通用户并不友好. ...

... 经典的图像翻译方法将图像翻译至对称图像域中,对称指的是翻译前后的图像结构保持一致,是转换图像的表征形式. Isola等[3 ] 首先提出有监督的基于条件GAN的图像到图像转换方法Pix2Pix,把U-Net网络和PatchGAN作为生成器和判别器,使用对抗损失和L1损失来训练网络,可以实现语义图-图像、卫星地图-平面地图等对称图像之间的翻译. Wang等[10 ] 在Pix2Pix的基础上,进一步提出Pix2PixHD,利用多尺度生成器、多尺度判别器以及新的特征匹配损失函数来生成高清图像. 常佳等[11 ] 针对图像翻译中生成图像的轮廓、纹理等特征丢失问题,通过增加反卷积跳跃连接的次数,在一定程度上增强特征的表达能力. 为了突破数据集的局限性,CycleGAN[5 ] 、DiscoGAN[12 ] 和StarGAN[13 ] 等方法被相继提出,利用循环一致性损失,实现非对称图像之间的翻译. 当源域和目标域之间存在显著空间变化时,上述方法会导致内容失真,因此XU等[14 ] 提出最大空间扰动一致性(maximum spatial perturbation consistency, MSPC),强制空间扰动函数T 和平移算子G ,以对齐各种复杂的空间变化. 这类方法的生成图像风格受限于训练数据并且不可控制,因此应用范围较为有限. ...

... 为了验证本研究方法的有效性,与传统图像翻译方法Pix2Pix[3 ] 、CycleGAN[5 ] 和DiscoGAN[12 ] ,基于示例的图像翻译方法CocosNet[18 ] 和CocosNet v2[19 ] ,服装图像翻译方法Anime2Clothing[39 ] 进行定量比较. 为了保证对比实验的公平,对于Pix2Pix、CycleGAN、DiscoGAN和Anime2Clothing的输入为参考服装和草稿图像级联. ...

... Comparison of three indicators of generated images of different methods

Tab.1 方法 SSIM FID IS Pix2Pix [3 ] 0.795 3 50.237 2 4.719 7 CycleGA N[5 ] 0.546 2 72.322 1 4.228 5 DiscoGAN [12 ] 0.652 5 51.029 5 4.699 9 CocosNet [18 ] 0.654 1 38.001 8 4.384 1 CocosNet v 2[19] 0.765 9 23.462 4 4.502 6 Anime2Clothing [39 ] 0.637 4 52.329 3 4.854 3 w/o CSC Block 0.719 2 22.406 4 4.878 7 Ours 0.794 0 20.202 3 4.930 7

消融实验: 为了验证CSC模块的有效性,使用简单的跳跃连接来代替CSC,在相同的条件下进行实验,结果如表1 中倒数第2行所示,可以看出CSC提升了网络在3个指标上的表现,尤其是SSIM,原因在于草图中的结构特征在网络传播过程中得到了强化. ...

... User study on authenticity and compatibility

Tab.2 方法 真实性 得分 兼容性 得分 方法 真实性 得分 兼容性 得分 Pix2Pix[3 ] 5.44 5.61 CocosNet v2[19 ] 17.56 17.25 CycleGAN[5 ] 8.94 9.67 Anime2Clothing[39 ] 20.00 19.11 DiscoGAN[12 ] 11.19 12.81 Ours 22.08 21.00 CocosNet[18 ] 14.78 14.56 — — —

定性实验1: 图4 显示各个方法的定性实验结果. 从2、3、5行可以看出,对于纹理简单和颜色单一的服装,所提方法和其他方法生成的视觉结果相当. 从4、7、8行可以看出,对于草图较复杂的服装而言,所提方法比其它方法的纹理和细节更真实. 在服装的外形上,所提方法比CycleGAN和DiscoGAN更贴近草图. 在服装细节上,所提方法比其他方法的视觉伪影更少, 原因在于草图编码特征与生成器之间的条件跳跃连接使得草图的纹理细节被较好地保留了下来. 与此同时,生成图像与相应的真实服装在整体上更加的相似,与参考服装在视觉风格上也更加兼容. 由于在生成器中逐步的上采样过程使得生成的图像可以平缓的增长分辨率,保证了最终图像的质量,使得与真实图像十分接近. 生成器是在从参考图像提取高级特征的基础上进行生成的,很好地继承了参考图像的风格特征,而且单独应用了一个兼容性判别器,保证了更好的兼容效果. ...

1

... 自生成对抗网络[1 ] 提出以来,图像生成的研究取得重大进步,不仅可以从随机噪声生成人脸、汽车、风景等高质量的逼真图像[2 -4 ] ,还在图像到图像翻译的研究上取得显著的成果[5 -6 ] .目前在时尚领域已经有许多相关的应用,如虚拟试妆、虚拟试衣、时尚搭配、时装生成等. Zhao等[7 ] 设计一个基于Pix2Pix的在线服装设计系统,在第1阶段输入服装关键点,生成一个中间态的补偿;在第2阶段结合草图生成一个粗糙的服装设计图像. 该方法的缺点在于用户并不能控制设计图的风格,而且还要对生成的设计图进一步修改完善. Yu等[8 ] 提出一种基于用户风格偏好的生成对抗网络(generative adversarial nets, GAN)模型,考虑到服装兼容性,输入用户查询上衣(下装)来生成符合用户品味的下装(上衣),但是用户不能控制生成服装的种类和细节. Han等[9 ] 提出从设计稿到真实时尚单品的翻译网络(design draft to real fashion item translation network, R2Dnet),将具备丰富纹理与颜色信息的设计图合成为真实的服装图像,有效解决未对齐的设计图和真实服装之间的翻译问题,但是绘制精细的服装设计图需要一定的绘画基础,该方法对普通用户并不友好. ...

1

... 自生成对抗网络[1 ] 提出以来,图像生成的研究取得重大进步,不仅可以从随机噪声生成人脸、汽车、风景等高质量的逼真图像[2 -4 ] ,还在图像到图像翻译的研究上取得显著的成果[5 -6 ] .目前在时尚领域已经有许多相关的应用,如虚拟试妆、虚拟试衣、时尚搭配、时装生成等. Zhao等[7 ] 设计一个基于Pix2Pix的在线服装设计系统,在第1阶段输入服装关键点,生成一个中间态的补偿;在第2阶段结合草图生成一个粗糙的服装设计图像. 该方法的缺点在于用户并不能控制设计图的风格,而且还要对生成的设计图进一步修改完善. Yu等[8 ] 提出一种基于用户风格偏好的生成对抗网络(generative adversarial nets, GAN)模型,考虑到服装兼容性,输入用户查询上衣(下装)来生成符合用户品味的下装(上衣),但是用户不能控制生成服装的种类和细节. Han等[9 ] 提出从设计稿到真实时尚单品的翻译网络(design draft to real fashion item translation network, R2Dnet),将具备丰富纹理与颜色信息的设计图合成为真实的服装图像,有效解决未对齐的设计图和真实服装之间的翻译问题,但是绘制精细的服装设计图需要一定的绘画基础,该方法对普通用户并不友好. ...

2

... 自生成对抗网络[1 ] 提出以来,图像生成的研究取得重大进步,不仅可以从随机噪声生成人脸、汽车、风景等高质量的逼真图像[2 -4 ] ,还在图像到图像翻译的研究上取得显著的成果[5 -6 ] .目前在时尚领域已经有许多相关的应用,如虚拟试妆、虚拟试衣、时尚搭配、时装生成等. Zhao等[7 ] 设计一个基于Pix2Pix的在线服装设计系统,在第1阶段输入服装关键点,生成一个中间态的补偿;在第2阶段结合草图生成一个粗糙的服装设计图像. 该方法的缺点在于用户并不能控制设计图的风格,而且还要对生成的设计图进一步修改完善. Yu等[8 ] 提出一种基于用户风格偏好的生成对抗网络(generative adversarial nets, GAN)模型,考虑到服装兼容性,输入用户查询上衣(下装)来生成符合用户品味的下装(上衣),但是用户不能控制生成服装的种类和细节. Han等[9 ] 提出从设计稿到真实时尚单品的翻译网络(design draft to real fashion item translation network, R2Dnet),将具备丰富纹理与颜色信息的设计图合成为真实的服装图像,有效解决未对齐的设计图和真实服装之间的翻译问题,但是绘制精细的服装设计图需要一定的绘画基础,该方法对普通用户并不友好. ...

... 研究人员[20 -25 ] 探索各种方式来对时尚服装之间的兼容性建模. Vasileva等[20 ] 提出学习类型感知嵌入以进行兼容性预测. Han等[21 ] 将一整套服装视为一个有序序列,训练一个双向LSTM模型,以在前一件服装的基础上,顺序预测下一件服装. Lin等[25 ] 提出一种基于类别且只依赖于项目类别的注意选择机制,该机制能够进行可伸缩的索引和搜索套装中缺失的服饰,并提出一个新的装备排名损失函数,提高兼容性预测和检索的准确性. 上述的研究工作都集中于对已存在的时尚服装项目之间的兼容性关系进行建模. Yu等[8 ] 从历史数据(如购买记录)中获取的特征向量来表示用户偏好,生成基于用户偏好的个性化服装设计,该方法是从历史数据来表示用户个性化的操作,具备高复杂性和弱时效性. Liu等[26 ] 提出相容矩阵正则化生成对抗网络(compatibility matrix regularized gan, CMR-GAN),对于用户提供的描述条件做兼容性服装的推荐. 与传统的推荐系统不同,CMRGAN进行基于多模态嵌入和兼容性学习的时尚生成研究. 从给定输入的服装图像生成兼容服装,而不是在候选集合中检索兼容服装图像. 在训练过程中,不仅需要输入与对应服装兼容的服装图像,还要输入与之不兼容的服装图像,训练成本较高. DONG等[27 ] 提出兼容性穿搭框架TryonCM2,采用双向长短期记忆网络(LSTM)来捕捉试穿外观中的上下文结构,将时尚单品交互中的时尚兼容性与试穿外观相结合,作为最终的兼容性穿搭. LSTM的计算量较大,不易于训练,在本研究提出的兼容性服装生成任务中,只需要考虑与参考服装之间的兼容性而不需要考虑时尚单品序列组合. ...

1

... 自生成对抗网络[1 ] 提出以来,图像生成的研究取得重大进步,不仅可以从随机噪声生成人脸、汽车、风景等高质量的逼真图像[2 -4 ] ,还在图像到图像翻译的研究上取得显著的成果[5 -6 ] .目前在时尚领域已经有许多相关的应用,如虚拟试妆、虚拟试衣、时尚搭配、时装生成等. Zhao等[7 ] 设计一个基于Pix2Pix的在线服装设计系统,在第1阶段输入服装关键点,生成一个中间态的补偿;在第2阶段结合草图生成一个粗糙的服装设计图像. 该方法的缺点在于用户并不能控制设计图的风格,而且还要对生成的设计图进一步修改完善. Yu等[8 ] 提出一种基于用户风格偏好的生成对抗网络(generative adversarial nets, GAN)模型,考虑到服装兼容性,输入用户查询上衣(下装)来生成符合用户品味的下装(上衣),但是用户不能控制生成服装的种类和细节. Han等[9 ] 提出从设计稿到真实时尚单品的翻译网络(design draft to real fashion item translation network, R2Dnet),将具备丰富纹理与颜色信息的设计图合成为真实的服装图像,有效解决未对齐的设计图和真实服装之间的翻译问题,但是绘制精细的服装设计图需要一定的绘画基础,该方法对普通用户并不友好. ...

1

... 经典的图像翻译方法将图像翻译至对称图像域中,对称指的是翻译前后的图像结构保持一致,是转换图像的表征形式. Isola等[3 ] 首先提出有监督的基于条件GAN的图像到图像转换方法Pix2Pix,把U-Net网络和PatchGAN作为生成器和判别器,使用对抗损失和L1损失来训练网络,可以实现语义图-图像、卫星地图-平面地图等对称图像之间的翻译. Wang等[10 ] 在Pix2Pix的基础上,进一步提出Pix2PixHD,利用多尺度生成器、多尺度判别器以及新的特征匹配损失函数来生成高清图像. 常佳等[11 ] 针对图像翻译中生成图像的轮廓、纹理等特征丢失问题,通过增加反卷积跳跃连接的次数,在一定程度上增强特征的表达能力. 为了突破数据集的局限性,CycleGAN[5 ] 、DiscoGAN[12 ] 和StarGAN[13 ] 等方法被相继提出,利用循环一致性损失,实现非对称图像之间的翻译. 当源域和目标域之间存在显著空间变化时,上述方法会导致内容失真,因此XU等[14 ] 提出最大空间扰动一致性(maximum spatial perturbation consistency, MSPC),强制空间扰动函数T 和平移算子G ,以对齐各种复杂的空间变化. 这类方法的生成图像风格受限于训练数据并且不可控制,因此应用范围较为有限. ...

基于改进的U-Net生成对抗网络的图像翻译算法

1

2020

... 经典的图像翻译方法将图像翻译至对称图像域中,对称指的是翻译前后的图像结构保持一致,是转换图像的表征形式. Isola等[3 ] 首先提出有监督的基于条件GAN的图像到图像转换方法Pix2Pix,把U-Net网络和PatchGAN作为生成器和判别器,使用对抗损失和L1损失来训练网络,可以实现语义图-图像、卫星地图-平面地图等对称图像之间的翻译. Wang等[10 ] 在Pix2Pix的基础上,进一步提出Pix2PixHD,利用多尺度生成器、多尺度判别器以及新的特征匹配损失函数来生成高清图像. 常佳等[11 ] 针对图像翻译中生成图像的轮廓、纹理等特征丢失问题,通过增加反卷积跳跃连接的次数,在一定程度上增强特征的表达能力. 为了突破数据集的局限性,CycleGAN[5 ] 、DiscoGAN[12 ] 和StarGAN[13 ] 等方法被相继提出,利用循环一致性损失,实现非对称图像之间的翻译. 当源域和目标域之间存在显著空间变化时,上述方法会导致内容失真,因此XU等[14 ] 提出最大空间扰动一致性(maximum spatial perturbation consistency, MSPC),强制空间扰动函数T 和平移算子G ,以对齐各种复杂的空间变化. 这类方法的生成图像风格受限于训练数据并且不可控制,因此应用范围较为有限. ...

基于改进的U-Net生成对抗网络的图像翻译算法

1

2020

... 经典的图像翻译方法将图像翻译至对称图像域中,对称指的是翻译前后的图像结构保持一致,是转换图像的表征形式. Isola等[3 ] 首先提出有监督的基于条件GAN的图像到图像转换方法Pix2Pix,把U-Net网络和PatchGAN作为生成器和判别器,使用对抗损失和L1损失来训练网络,可以实现语义图-图像、卫星地图-平面地图等对称图像之间的翻译. Wang等[10 ] 在Pix2Pix的基础上,进一步提出Pix2PixHD,利用多尺度生成器、多尺度判别器以及新的特征匹配损失函数来生成高清图像. 常佳等[11 ] 针对图像翻译中生成图像的轮廓、纹理等特征丢失问题,通过增加反卷积跳跃连接的次数,在一定程度上增强特征的表达能力. 为了突破数据集的局限性,CycleGAN[5 ] 、DiscoGAN[12 ] 和StarGAN[13 ] 等方法被相继提出,利用循环一致性损失,实现非对称图像之间的翻译. 当源域和目标域之间存在显著空间变化时,上述方法会导致内容失真,因此XU等[14 ] 提出最大空间扰动一致性(maximum spatial perturbation consistency, MSPC),强制空间扰动函数T 和平移算子G ,以对齐各种复杂的空间变化. 这类方法的生成图像风格受限于训练数据并且不可控制,因此应用范围较为有限. ...

4

... 经典的图像翻译方法将图像翻译至对称图像域中,对称指的是翻译前后的图像结构保持一致,是转换图像的表征形式. Isola等[3 ] 首先提出有监督的基于条件GAN的图像到图像转换方法Pix2Pix,把U-Net网络和PatchGAN作为生成器和判别器,使用对抗损失和L1损失来训练网络,可以实现语义图-图像、卫星地图-平面地图等对称图像之间的翻译. Wang等[10 ] 在Pix2Pix的基础上,进一步提出Pix2PixHD,利用多尺度生成器、多尺度判别器以及新的特征匹配损失函数来生成高清图像. 常佳等[11 ] 针对图像翻译中生成图像的轮廓、纹理等特征丢失问题,通过增加反卷积跳跃连接的次数,在一定程度上增强特征的表达能力. 为了突破数据集的局限性,CycleGAN[5 ] 、DiscoGAN[12 ] 和StarGAN[13 ] 等方法被相继提出,利用循环一致性损失,实现非对称图像之间的翻译. 当源域和目标域之间存在显著空间变化时,上述方法会导致内容失真,因此XU等[14 ] 提出最大空间扰动一致性(maximum spatial perturbation consistency, MSPC),强制空间扰动函数T 和平移算子G ,以对齐各种复杂的空间变化. 这类方法的生成图像风格受限于训练数据并且不可控制,因此应用范围较为有限. ...

... 为了验证本研究方法的有效性,与传统图像翻译方法Pix2Pix[3 ] 、CycleGAN[5 ] 和DiscoGAN[12 ] ,基于示例的图像翻译方法CocosNet[18 ] 和CocosNet v2[19 ] ,服装图像翻译方法Anime2Clothing[39 ] 进行定量比较. 为了保证对比实验的公平,对于Pix2Pix、CycleGAN、DiscoGAN和Anime2Clothing的输入为参考服装和草稿图像级联. ...

... Comparison of three indicators of generated images of different methods

Tab.1 方法 SSIM FID IS Pix2Pix [3 ] 0.795 3 50.237 2 4.719 7 CycleGA N[5 ] 0.546 2 72.322 1 4.228 5 DiscoGAN [12 ] 0.652 5 51.029 5 4.699 9 CocosNet [18 ] 0.654 1 38.001 8 4.384 1 CocosNet v 2[19] 0.765 9 23.462 4 4.502 6 Anime2Clothing [39 ] 0.637 4 52.329 3 4.854 3 w/o CSC Block 0.719 2 22.406 4 4.878 7 Ours 0.794 0 20.202 3 4.930 7

消融实验: 为了验证CSC模块的有效性,使用简单的跳跃连接来代替CSC,在相同的条件下进行实验,结果如表1 中倒数第2行所示,可以看出CSC提升了网络在3个指标上的表现,尤其是SSIM,原因在于草图中的结构特征在网络传播过程中得到了强化. ...

... User study on authenticity and compatibility

Tab.2 方法 真实性 得分 兼容性 得分 方法 真实性 得分 兼容性 得分 Pix2Pix[3 ] 5.44 5.61 CocosNet v2[19 ] 17.56 17.25 CycleGAN[5 ] 8.94 9.67 Anime2Clothing[39 ] 20.00 19.11 DiscoGAN[12 ] 11.19 12.81 Ours 22.08 21.00 CocosNet[18 ] 14.78 14.56 — — —

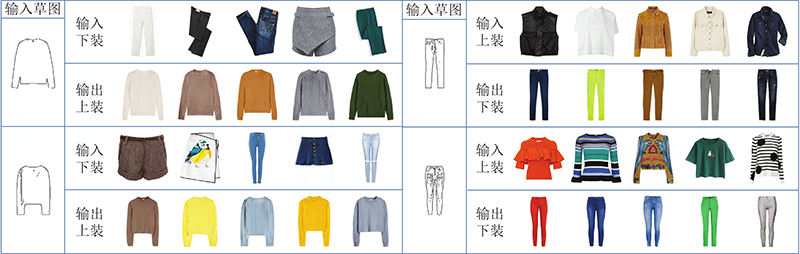

定性实验1: 图4 显示各个方法的定性实验结果. 从2、3、5行可以看出,对于纹理简单和颜色单一的服装,所提方法和其他方法生成的视觉结果相当. 从4、7、8行可以看出,对于草图较复杂的服装而言,所提方法比其它方法的纹理和细节更真实. 在服装的外形上,所提方法比CycleGAN和DiscoGAN更贴近草图. 在服装细节上,所提方法比其他方法的视觉伪影更少, 原因在于草图编码特征与生成器之间的条件跳跃连接使得草图的纹理细节被较好地保留了下来. 与此同时,生成图像与相应的真实服装在整体上更加的相似,与参考服装在视觉风格上也更加兼容. 由于在生成器中逐步的上采样过程使得生成的图像可以平缓的增长分辨率,保证了最终图像的质量,使得与真实图像十分接近. 生成器是在从参考图像提取高级特征的基础上进行生成的,很好地继承了参考图像的风格特征,而且单独应用了一个兼容性判别器,保证了更好的兼容效果. ...

1

... 经典的图像翻译方法将图像翻译至对称图像域中,对称指的是翻译前后的图像结构保持一致,是转换图像的表征形式. Isola等[3 ] 首先提出有监督的基于条件GAN的图像到图像转换方法Pix2Pix,把U-Net网络和PatchGAN作为生成器和判别器,使用对抗损失和L1损失来训练网络,可以实现语义图-图像、卫星地图-平面地图等对称图像之间的翻译. Wang等[10 ] 在Pix2Pix的基础上,进一步提出Pix2PixHD,利用多尺度生成器、多尺度判别器以及新的特征匹配损失函数来生成高清图像. 常佳等[11 ] 针对图像翻译中生成图像的轮廓、纹理等特征丢失问题,通过增加反卷积跳跃连接的次数,在一定程度上增强特征的表达能力. 为了突破数据集的局限性,CycleGAN[5 ] 、DiscoGAN[12 ] 和StarGAN[13 ] 等方法被相继提出,利用循环一致性损失,实现非对称图像之间的翻译. 当源域和目标域之间存在显著空间变化时,上述方法会导致内容失真,因此XU等[14 ] 提出最大空间扰动一致性(maximum spatial perturbation consistency, MSPC),强制空间扰动函数T 和平移算子G ,以对齐各种复杂的空间变化. 这类方法的生成图像风格受限于训练数据并且不可控制,因此应用范围较为有限. ...

1

... 经典的图像翻译方法将图像翻译至对称图像域中,对称指的是翻译前后的图像结构保持一致,是转换图像的表征形式. Isola等[3 ] 首先提出有监督的基于条件GAN的图像到图像转换方法Pix2Pix,把U-Net网络和PatchGAN作为生成器和判别器,使用对抗损失和L1损失来训练网络,可以实现语义图-图像、卫星地图-平面地图等对称图像之间的翻译. Wang等[10 ] 在Pix2Pix的基础上,进一步提出Pix2PixHD,利用多尺度生成器、多尺度判别器以及新的特征匹配损失函数来生成高清图像. 常佳等[11 ] 针对图像翻译中生成图像的轮廓、纹理等特征丢失问题,通过增加反卷积跳跃连接的次数,在一定程度上增强特征的表达能力. 为了突破数据集的局限性,CycleGAN[5 ] 、DiscoGAN[12 ] 和StarGAN[13 ] 等方法被相继提出,利用循环一致性损失,实现非对称图像之间的翻译. 当源域和目标域之间存在显著空间变化时,上述方法会导致内容失真,因此XU等[14 ] 提出最大空间扰动一致性(maximum spatial perturbation consistency, MSPC),强制空间扰动函数T 和平移算子G ,以对齐各种复杂的空间变化. 这类方法的生成图像风格受限于训练数据并且不可控制,因此应用范围较为有限. ...

1

... 另一类研究着眼于生成图像的风格和多样性问题. Liu等[15 ] 在基于草图的艺术风格翻译中,引入双遮罩机制,根据素描直接塑造特征图以保证草图内容,并且设计功能图转换,保证与参考图像的风格一致. 为了实现生成图像的多样性以及生成对抗网络在多个域上的可扩展性. Choi等[16 ] 在StarGAN的基础上提出StarGANv2,包含映射网络和样式编码器. 映射网络学习将随机高斯噪声转换为风格代码. 从给定的参考图像中,编码器则学习提取风格代码,可以把一张图像翻译为不同的风格,也可以翻译到多个域中. Richardson等[17 ] 提出pSp图像翻译框架,把图像通过编码器映射到一个扩展的潜在空间中,不要求输入图像在StyleGAN域中进行特征表示,可以处理各种任务. Zhang等[18 ] 提出基于示例的图像翻译方法CocosNet,该方法以包含风格的示例作为颜色及纹理的指导. 在非对称的翻译中,利用跨域对齐网络在中间域上找到输入图像和示例的匹配关系,再利用多层卷积和扭曲的示例图像逐步生成高质量的目标域图像. Zhou等[19 ] 提出CoCosNetv2,通过门控循环单元(gated recurrent unit, GRU)辅助的Patch Match方法生成高分辨率图像. 这些方法并不适用于处理具有较大跨域结构变化的兼容性图像生成任务. ...

1

... 另一类研究着眼于生成图像的风格和多样性问题. Liu等[15 ] 在基于草图的艺术风格翻译中,引入双遮罩机制,根据素描直接塑造特征图以保证草图内容,并且设计功能图转换,保证与参考图像的风格一致. 为了实现生成图像的多样性以及生成对抗网络在多个域上的可扩展性. Choi等[16 ] 在StarGAN的基础上提出StarGANv2,包含映射网络和样式编码器. 映射网络学习将随机高斯噪声转换为风格代码. 从给定的参考图像中,编码器则学习提取风格代码,可以把一张图像翻译为不同的风格,也可以翻译到多个域中. Richardson等[17 ] 提出pSp图像翻译框架,把图像通过编码器映射到一个扩展的潜在空间中,不要求输入图像在StyleGAN域中进行特征表示,可以处理各种任务. Zhang等[18 ] 提出基于示例的图像翻译方法CocosNet,该方法以包含风格的示例作为颜色及纹理的指导. 在非对称的翻译中,利用跨域对齐网络在中间域上找到输入图像和示例的匹配关系,再利用多层卷积和扭曲的示例图像逐步生成高质量的目标域图像. Zhou等[19 ] 提出CoCosNetv2,通过门控循环单元(gated recurrent unit, GRU)辅助的Patch Match方法生成高分辨率图像. 这些方法并不适用于处理具有较大跨域结构变化的兼容性图像生成任务. ...

1

... 另一类研究着眼于生成图像的风格和多样性问题. Liu等[15 ] 在基于草图的艺术风格翻译中,引入双遮罩机制,根据素描直接塑造特征图以保证草图内容,并且设计功能图转换,保证与参考图像的风格一致. 为了实现生成图像的多样性以及生成对抗网络在多个域上的可扩展性. Choi等[16 ] 在StarGAN的基础上提出StarGANv2,包含映射网络和样式编码器. 映射网络学习将随机高斯噪声转换为风格代码. 从给定的参考图像中,编码器则学习提取风格代码,可以把一张图像翻译为不同的风格,也可以翻译到多个域中. Richardson等[17 ] 提出pSp图像翻译框架,把图像通过编码器映射到一个扩展的潜在空间中,不要求输入图像在StyleGAN域中进行特征表示,可以处理各种任务. Zhang等[18 ] 提出基于示例的图像翻译方法CocosNet,该方法以包含风格的示例作为颜色及纹理的指导. 在非对称的翻译中,利用跨域对齐网络在中间域上找到输入图像和示例的匹配关系,再利用多层卷积和扭曲的示例图像逐步生成高质量的目标域图像. Zhou等[19 ] 提出CoCosNetv2,通过门控循环单元(gated recurrent unit, GRU)辅助的Patch Match方法生成高分辨率图像. 这些方法并不适用于处理具有较大跨域结构变化的兼容性图像生成任务. ...

4

... 另一类研究着眼于生成图像的风格和多样性问题. Liu等[15 ] 在基于草图的艺术风格翻译中,引入双遮罩机制,根据素描直接塑造特征图以保证草图内容,并且设计功能图转换,保证与参考图像的风格一致. 为了实现生成图像的多样性以及生成对抗网络在多个域上的可扩展性. Choi等[16 ] 在StarGAN的基础上提出StarGANv2,包含映射网络和样式编码器. 映射网络学习将随机高斯噪声转换为风格代码. 从给定的参考图像中,编码器则学习提取风格代码,可以把一张图像翻译为不同的风格,也可以翻译到多个域中. Richardson等[17 ] 提出pSp图像翻译框架,把图像通过编码器映射到一个扩展的潜在空间中,不要求输入图像在StyleGAN域中进行特征表示,可以处理各种任务. Zhang等[18 ] 提出基于示例的图像翻译方法CocosNet,该方法以包含风格的示例作为颜色及纹理的指导. 在非对称的翻译中,利用跨域对齐网络在中间域上找到输入图像和示例的匹配关系,再利用多层卷积和扭曲的示例图像逐步生成高质量的目标域图像. Zhou等[19 ] 提出CoCosNetv2,通过门控循环单元(gated recurrent unit, GRU)辅助的Patch Match方法生成高分辨率图像. 这些方法并不适用于处理具有较大跨域结构变化的兼容性图像生成任务. ...

... 为了验证本研究方法的有效性,与传统图像翻译方法Pix2Pix[3 ] 、CycleGAN[5 ] 和DiscoGAN[12 ] ,基于示例的图像翻译方法CocosNet[18 ] 和CocosNet v2[19 ] ,服装图像翻译方法Anime2Clothing[39 ] 进行定量比较. 为了保证对比实验的公平,对于Pix2Pix、CycleGAN、DiscoGAN和Anime2Clothing的输入为参考服装和草稿图像级联. ...

... Comparison of three indicators of generated images of different methods

Tab.1 方法 SSIM FID IS Pix2Pix [3 ] 0.795 3 50.237 2 4.719 7 CycleGA N[5 ] 0.546 2 72.322 1 4.228 5 DiscoGAN [12 ] 0.652 5 51.029 5 4.699 9 CocosNet [18 ] 0.654 1 38.001 8 4.384 1 CocosNet v 2[19] 0.765 9 23.462 4 4.502 6 Anime2Clothing [39 ] 0.637 4 52.329 3 4.854 3 w/o CSC Block 0.719 2 22.406 4 4.878 7 Ours 0.794 0 20.202 3 4.930 7

消融实验: 为了验证CSC模块的有效性,使用简单的跳跃连接来代替CSC,在相同的条件下进行实验,结果如表1 中倒数第2行所示,可以看出CSC提升了网络在3个指标上的表现,尤其是SSIM,原因在于草图中的结构特征在网络传播过程中得到了强化. ...

... User study on authenticity and compatibility

Tab.2 方法 真实性 得分 兼容性 得分 方法 真实性 得分 兼容性 得分 Pix2Pix[3 ] 5.44 5.61 CocosNet v2[19 ] 17.56 17.25 CycleGAN[5 ] 8.94 9.67 Anime2Clothing[39 ] 20.00 19.11 DiscoGAN[12 ] 11.19 12.81 Ours 22.08 21.00 CocosNet[18 ] 14.78 14.56 — — —

定性实验1: 图4 显示各个方法的定性实验结果. 从2、3、5行可以看出,对于纹理简单和颜色单一的服装,所提方法和其他方法生成的视觉结果相当. 从4、7、8行可以看出,对于草图较复杂的服装而言,所提方法比其它方法的纹理和细节更真实. 在服装的外形上,所提方法比CycleGAN和DiscoGAN更贴近草图. 在服装细节上,所提方法比其他方法的视觉伪影更少, 原因在于草图编码特征与生成器之间的条件跳跃连接使得草图的纹理细节被较好地保留了下来. 与此同时,生成图像与相应的真实服装在整体上更加的相似,与参考服装在视觉风格上也更加兼容. 由于在生成器中逐步的上采样过程使得生成的图像可以平缓的增长分辨率,保证了最终图像的质量,使得与真实图像十分接近. 生成器是在从参考图像提取高级特征的基础上进行生成的,很好地继承了参考图像的风格特征,而且单独应用了一个兼容性判别器,保证了更好的兼容效果. ...

3

... 另一类研究着眼于生成图像的风格和多样性问题. Liu等[15 ] 在基于草图的艺术风格翻译中,引入双遮罩机制,根据素描直接塑造特征图以保证草图内容,并且设计功能图转换,保证与参考图像的风格一致. 为了实现生成图像的多样性以及生成对抗网络在多个域上的可扩展性. Choi等[16 ] 在StarGAN的基础上提出StarGANv2,包含映射网络和样式编码器. 映射网络学习将随机高斯噪声转换为风格代码. 从给定的参考图像中,编码器则学习提取风格代码,可以把一张图像翻译为不同的风格,也可以翻译到多个域中. Richardson等[17 ] 提出pSp图像翻译框架,把图像通过编码器映射到一个扩展的潜在空间中,不要求输入图像在StyleGAN域中进行特征表示,可以处理各种任务. Zhang等[18 ] 提出基于示例的图像翻译方法CocosNet,该方法以包含风格的示例作为颜色及纹理的指导. 在非对称的翻译中,利用跨域对齐网络在中间域上找到输入图像和示例的匹配关系,再利用多层卷积和扭曲的示例图像逐步生成高质量的目标域图像. Zhou等[19 ] 提出CoCosNetv2,通过门控循环单元(gated recurrent unit, GRU)辅助的Patch Match方法生成高分辨率图像. 这些方法并不适用于处理具有较大跨域结构变化的兼容性图像生成任务. ...

... 为了验证本研究方法的有效性,与传统图像翻译方法Pix2Pix[3 ] 、CycleGAN[5 ] 和DiscoGAN[12 ] ,基于示例的图像翻译方法CocosNet[18 ] 和CocosNet v2[19 ] ,服装图像翻译方法Anime2Clothing[39 ] 进行定量比较. 为了保证对比实验的公平,对于Pix2Pix、CycleGAN、DiscoGAN和Anime2Clothing的输入为参考服装和草稿图像级联. ...

... User study on authenticity and compatibility

Tab.2 方法 真实性 得分 兼容性 得分 方法 真实性 得分 兼容性 得分 Pix2Pix[3 ] 5.44 5.61 CocosNet v2[19 ] 17.56 17.25 CycleGAN[5 ] 8.94 9.67 Anime2Clothing[39 ] 20.00 19.11 DiscoGAN[12 ] 11.19 12.81 Ours 22.08 21.00 CocosNet[18 ] 14.78 14.56 — — —

定性实验1: 图4 显示各个方法的定性实验结果. 从2、3、5行可以看出,对于纹理简单和颜色单一的服装,所提方法和其他方法生成的视觉结果相当. 从4、7、8行可以看出,对于草图较复杂的服装而言,所提方法比其它方法的纹理和细节更真实. 在服装的外形上,所提方法比CycleGAN和DiscoGAN更贴近草图. 在服装细节上,所提方法比其他方法的视觉伪影更少, 原因在于草图编码特征与生成器之间的条件跳跃连接使得草图的纹理细节被较好地保留了下来. 与此同时,生成图像与相应的真实服装在整体上更加的相似,与参考服装在视觉风格上也更加兼容. 由于在生成器中逐步的上采样过程使得生成的图像可以平缓的增长分辨率,保证了最终图像的质量,使得与真实图像十分接近. 生成器是在从参考图像提取高级特征的基础上进行生成的,很好地继承了参考图像的风格特征,而且单独应用了一个兼容性判别器,保证了更好的兼容效果. ...

2

... 研究人员[20 -25 ] 探索各种方式来对时尚服装之间的兼容性建模. Vasileva等[20 ] 提出学习类型感知嵌入以进行兼容性预测. Han等[21 ] 将一整套服装视为一个有序序列,训练一个双向LSTM模型,以在前一件服装的基础上,顺序预测下一件服装. Lin等[25 ] 提出一种基于类别且只依赖于项目类别的注意选择机制,该机制能够进行可伸缩的索引和搜索套装中缺失的服饰,并提出一个新的装备排名损失函数,提高兼容性预测和检索的准确性. 上述的研究工作都集中于对已存在的时尚服装项目之间的兼容性关系进行建模. Yu等[8 ] 从历史数据(如购买记录)中获取的特征向量来表示用户偏好,生成基于用户偏好的个性化服装设计,该方法是从历史数据来表示用户个性化的操作,具备高复杂性和弱时效性. Liu等[26 ] 提出相容矩阵正则化生成对抗网络(compatibility matrix regularized gan, CMR-GAN),对于用户提供的描述条件做兼容性服装的推荐. 与传统的推荐系统不同,CMRGAN进行基于多模态嵌入和兼容性学习的时尚生成研究. 从给定输入的服装图像生成兼容服装,而不是在候选集合中检索兼容服装图像. 在训练过程中,不仅需要输入与对应服装兼容的服装图像,还要输入与之不兼容的服装图像,训练成本较高. DONG等[27 ] 提出兼容性穿搭框架TryonCM2,采用双向长短期记忆网络(LSTM)来捕捉试穿外观中的上下文结构,将时尚单品交互中的时尚兼容性与试穿外观相结合,作为最终的兼容性穿搭. LSTM的计算量较大,不易于训练,在本研究提出的兼容性服装生成任务中,只需要考虑与参考服装之间的兼容性而不需要考虑时尚单品序列组合. ...

... [20 ]提出学习类型感知嵌入以进行兼容性预测. Han等[21 ] 将一整套服装视为一个有序序列,训练一个双向LSTM模型,以在前一件服装的基础上,顺序预测下一件服装. Lin等[25 ] 提出一种基于类别且只依赖于项目类别的注意选择机制,该机制能够进行可伸缩的索引和搜索套装中缺失的服饰,并提出一个新的装备排名损失函数,提高兼容性预测和检索的准确性. 上述的研究工作都集中于对已存在的时尚服装项目之间的兼容性关系进行建模. Yu等[8 ] 从历史数据(如购买记录)中获取的特征向量来表示用户偏好,生成基于用户偏好的个性化服装设计,该方法是从历史数据来表示用户个性化的操作,具备高复杂性和弱时效性. Liu等[26 ] 提出相容矩阵正则化生成对抗网络(compatibility matrix regularized gan, CMR-GAN),对于用户提供的描述条件做兼容性服装的推荐. 与传统的推荐系统不同,CMRGAN进行基于多模态嵌入和兼容性学习的时尚生成研究. 从给定输入的服装图像生成兼容服装,而不是在候选集合中检索兼容服装图像. 在训练过程中,不仅需要输入与对应服装兼容的服装图像,还要输入与之不兼容的服装图像,训练成本较高. DONG等[27 ] 提出兼容性穿搭框架TryonCM2,采用双向长短期记忆网络(LSTM)来捕捉试穿外观中的上下文结构,将时尚单品交互中的时尚兼容性与试穿外观相结合,作为最终的兼容性穿搭. LSTM的计算量较大,不易于训练,在本研究提出的兼容性服装生成任务中,只需要考虑与参考服装之间的兼容性而不需要考虑时尚单品序列组合. ...

1

... 研究人员[20 -25 ] 探索各种方式来对时尚服装之间的兼容性建模. Vasileva等[20 ] 提出学习类型感知嵌入以进行兼容性预测. Han等[21 ] 将一整套服装视为一个有序序列,训练一个双向LSTM模型,以在前一件服装的基础上,顺序预测下一件服装. Lin等[25 ] 提出一种基于类别且只依赖于项目类别的注意选择机制,该机制能够进行可伸缩的索引和搜索套装中缺失的服饰,并提出一个新的装备排名损失函数,提高兼容性预测和检索的准确性. 上述的研究工作都集中于对已存在的时尚服装项目之间的兼容性关系进行建模. Yu等[8 ] 从历史数据(如购买记录)中获取的特征向量来表示用户偏好,生成基于用户偏好的个性化服装设计,该方法是从历史数据来表示用户个性化的操作,具备高复杂性和弱时效性. Liu等[26 ] 提出相容矩阵正则化生成对抗网络(compatibility matrix regularized gan, CMR-GAN),对于用户提供的描述条件做兼容性服装的推荐. 与传统的推荐系统不同,CMRGAN进行基于多模态嵌入和兼容性学习的时尚生成研究. 从给定输入的服装图像生成兼容服装,而不是在候选集合中检索兼容服装图像. 在训练过程中,不仅需要输入与对应服装兼容的服装图像,还要输入与之不兼容的服装图像,训练成本较高. DONG等[27 ] 提出兼容性穿搭框架TryonCM2,采用双向长短期记忆网络(LSTM)来捕捉试穿外观中的上下文结构,将时尚单品交互中的时尚兼容性与试穿外观相结合,作为最终的兼容性穿搭. LSTM的计算量较大,不易于训练,在本研究提出的兼容性服装生成任务中,只需要考虑与参考服装之间的兼容性而不需要考虑时尚单品序列组合. ...

Deepstyle: multimodal search engine for fashion and interior design

0

2019

2

... 研究人员[20 -25 ] 探索各种方式来对时尚服装之间的兼容性建模. Vasileva等[20 ] 提出学习类型感知嵌入以进行兼容性预测. Han等[21 ] 将一整套服装视为一个有序序列,训练一个双向LSTM模型,以在前一件服装的基础上,顺序预测下一件服装. Lin等[25 ] 提出一种基于类别且只依赖于项目类别的注意选择机制,该机制能够进行可伸缩的索引和搜索套装中缺失的服饰,并提出一个新的装备排名损失函数,提高兼容性预测和检索的准确性. 上述的研究工作都集中于对已存在的时尚服装项目之间的兼容性关系进行建模. Yu等[8 ] 从历史数据(如购买记录)中获取的特征向量来表示用户偏好,生成基于用户偏好的个性化服装设计,该方法是从历史数据来表示用户个性化的操作,具备高复杂性和弱时效性. Liu等[26 ] 提出相容矩阵正则化生成对抗网络(compatibility matrix regularized gan, CMR-GAN),对于用户提供的描述条件做兼容性服装的推荐. 与传统的推荐系统不同,CMRGAN进行基于多模态嵌入和兼容性学习的时尚生成研究. 从给定输入的服装图像生成兼容服装,而不是在候选集合中检索兼容服装图像. 在训练过程中,不仅需要输入与对应服装兼容的服装图像,还要输入与之不兼容的服装图像,训练成本较高. DONG等[27 ] 提出兼容性穿搭框架TryonCM2,采用双向长短期记忆网络(LSTM)来捕捉试穿外观中的上下文结构,将时尚单品交互中的时尚兼容性与试穿外观相结合,作为最终的兼容性穿搭. LSTM的计算量较大,不易于训练,在本研究提出的兼容性服装生成任务中,只需要考虑与参考服装之间的兼容性而不需要考虑时尚单品序列组合. ...

... [25 ]提出一种基于类别且只依赖于项目类别的注意选择机制,该机制能够进行可伸缩的索引和搜索套装中缺失的服饰,并提出一个新的装备排名损失函数,提高兼容性预测和检索的准确性. 上述的研究工作都集中于对已存在的时尚服装项目之间的兼容性关系进行建模. Yu等[8 ] 从历史数据(如购买记录)中获取的特征向量来表示用户偏好,生成基于用户偏好的个性化服装设计,该方法是从历史数据来表示用户个性化的操作,具备高复杂性和弱时效性. Liu等[26 ] 提出相容矩阵正则化生成对抗网络(compatibility matrix regularized gan, CMR-GAN),对于用户提供的描述条件做兼容性服装的推荐. 与传统的推荐系统不同,CMRGAN进行基于多模态嵌入和兼容性学习的时尚生成研究. 从给定输入的服装图像生成兼容服装,而不是在候选集合中检索兼容服装图像. 在训练过程中,不仅需要输入与对应服装兼容的服装图像,还要输入与之不兼容的服装图像,训练成本较高. DONG等[27 ] 提出兼容性穿搭框架TryonCM2,采用双向长短期记忆网络(LSTM)来捕捉试穿外观中的上下文结构,将时尚单品交互中的时尚兼容性与试穿外观相结合,作为最终的兼容性穿搭. LSTM的计算量较大,不易于训练,在本研究提出的兼容性服装生成任务中,只需要考虑与参考服装之间的兼容性而不需要考虑时尚单品序列组合. ...

Clothing generation by multi-modal embedding: a compatibility matrix-regularized GAN model

1

2021

... 研究人员[20 -25 ] 探索各种方式来对时尚服装之间的兼容性建模. Vasileva等[20 ] 提出学习类型感知嵌入以进行兼容性预测. Han等[21 ] 将一整套服装视为一个有序序列,训练一个双向LSTM模型,以在前一件服装的基础上,顺序预测下一件服装. Lin等[25 ] 提出一种基于类别且只依赖于项目类别的注意选择机制,该机制能够进行可伸缩的索引和搜索套装中缺失的服饰,并提出一个新的装备排名损失函数,提高兼容性预测和检索的准确性. 上述的研究工作都集中于对已存在的时尚服装项目之间的兼容性关系进行建模. Yu等[8 ] 从历史数据(如购买记录)中获取的特征向量来表示用户偏好,生成基于用户偏好的个性化服装设计,该方法是从历史数据来表示用户个性化的操作,具备高复杂性和弱时效性. Liu等[26 ] 提出相容矩阵正则化生成对抗网络(compatibility matrix regularized gan, CMR-GAN),对于用户提供的描述条件做兼容性服装的推荐. 与传统的推荐系统不同,CMRGAN进行基于多模态嵌入和兼容性学习的时尚生成研究. 从给定输入的服装图像生成兼容服装,而不是在候选集合中检索兼容服装图像. 在训练过程中,不仅需要输入与对应服装兼容的服装图像,还要输入与之不兼容的服装图像,训练成本较高. DONG等[27 ] 提出兼容性穿搭框架TryonCM2,采用双向长短期记忆网络(LSTM)来捕捉试穿外观中的上下文结构,将时尚单品交互中的时尚兼容性与试穿外观相结合,作为最终的兼容性穿搭. LSTM的计算量较大,不易于训练,在本研究提出的兼容性服装生成任务中,只需要考虑与参考服装之间的兼容性而不需要考虑时尚单品序列组合. ...

TryonCM2: try-on-enhanced fashion compatibility modeling framework

1

2022

... 研究人员[20 -25 ] 探索各种方式来对时尚服装之间的兼容性建模. Vasileva等[20 ] 提出学习类型感知嵌入以进行兼容性预测. Han等[21 ] 将一整套服装视为一个有序序列,训练一个双向LSTM模型,以在前一件服装的基础上,顺序预测下一件服装. Lin等[25 ] 提出一种基于类别且只依赖于项目类别的注意选择机制,该机制能够进行可伸缩的索引和搜索套装中缺失的服饰,并提出一个新的装备排名损失函数,提高兼容性预测和检索的准确性. 上述的研究工作都集中于对已存在的时尚服装项目之间的兼容性关系进行建模. Yu等[8 ] 从历史数据(如购买记录)中获取的特征向量来表示用户偏好,生成基于用户偏好的个性化服装设计,该方法是从历史数据来表示用户个性化的操作,具备高复杂性和弱时效性. Liu等[26 ] 提出相容矩阵正则化生成对抗网络(compatibility matrix regularized gan, CMR-GAN),对于用户提供的描述条件做兼容性服装的推荐. 与传统的推荐系统不同,CMRGAN进行基于多模态嵌入和兼容性学习的时尚生成研究. 从给定输入的服装图像生成兼容服装,而不是在候选集合中检索兼容服装图像. 在训练过程中,不仅需要输入与对应服装兼容的服装图像,还要输入与之不兼容的服装图像,训练成本较高. DONG等[27 ] 提出兼容性穿搭框架TryonCM2,采用双向长短期记忆网络(LSTM)来捕捉试穿外观中的上下文结构,将时尚单品交互中的时尚兼容性与试穿外观相结合,作为最终的兼容性穿搭. LSTM的计算量较大,不易于训练,在本研究提出的兼容性服装生成任务中,只需要考虑与参考服装之间的兼容性而不需要考虑时尚单品序列组合. ...

Sketch-guided scenery image outpainting

1

2021

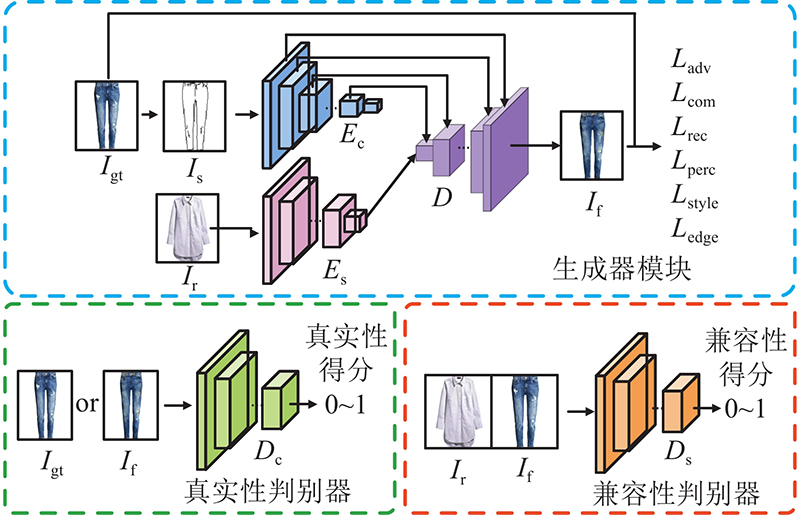

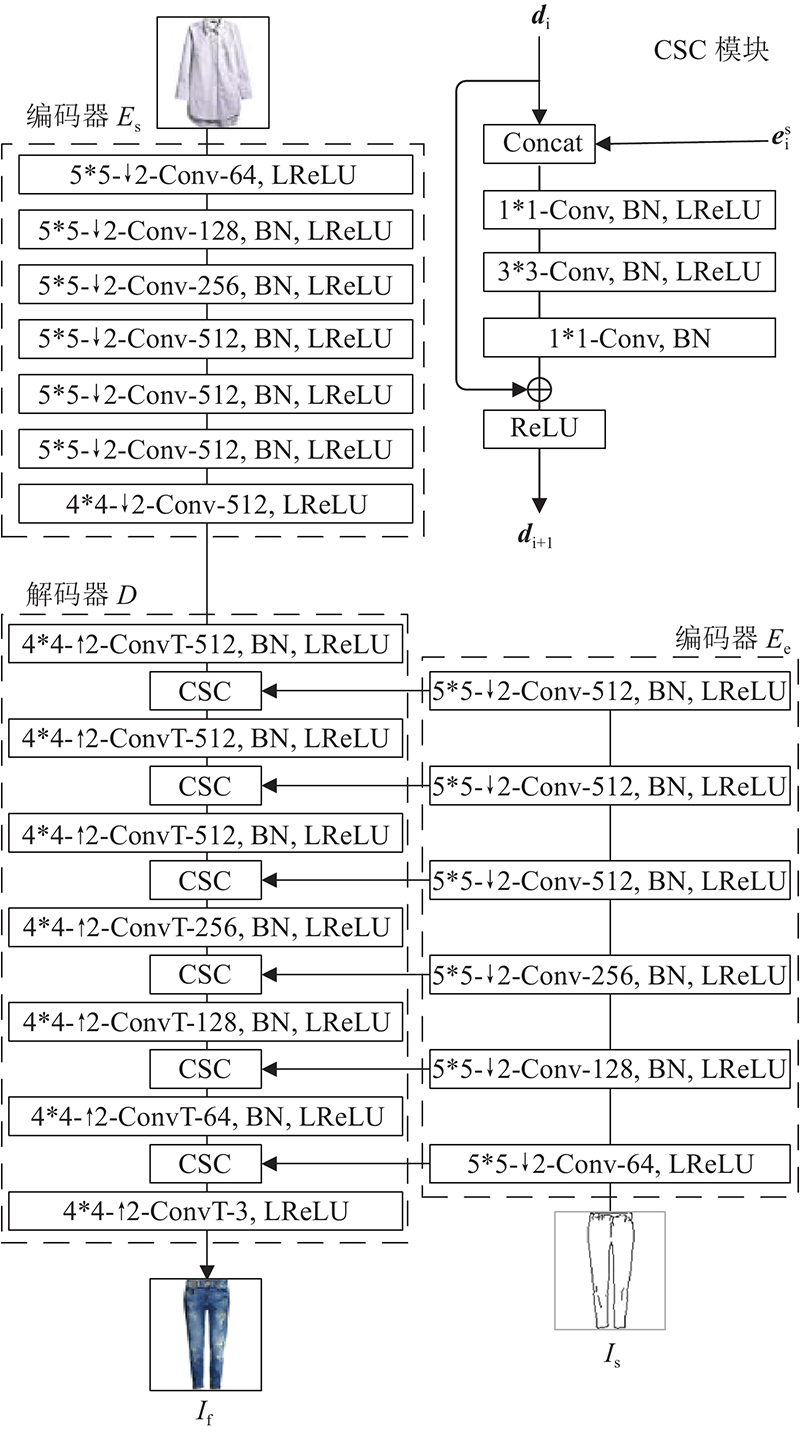

... 本研究提出的兼容性服装生成任务是指在给定参考服装 $ {I}_{\mathrm{r}} $ $ {I}_{\mathrm{s}} $ $ {I}_{\mathrm{f}} $ . 需要满足3个要求:1)真实性. 生成服装在视觉效果上逼真;2)一致性. 生成服装的形状和细节应当忠于草图的描述;3)兼容性. 生成服装应当与输入的参考服装互相兼容. 真实性保证所生成图像带给用户的参考价值;一致性则保证用户对生成图像轮廓需求的满足,应尽量的接近草图所涵盖的视觉轮廓需求; 兼容性不仅满足用户对生成服装风格的需求,也使得生成服装与参考服装形成较为和谐的视觉搭配效果,更具有应用价值. 所提方法分别使用真实性判别器、条件跳跃连接 (conditional skip connection,CSC)[28 ] 模块和兼容性判别器来满足这3个要求. ...

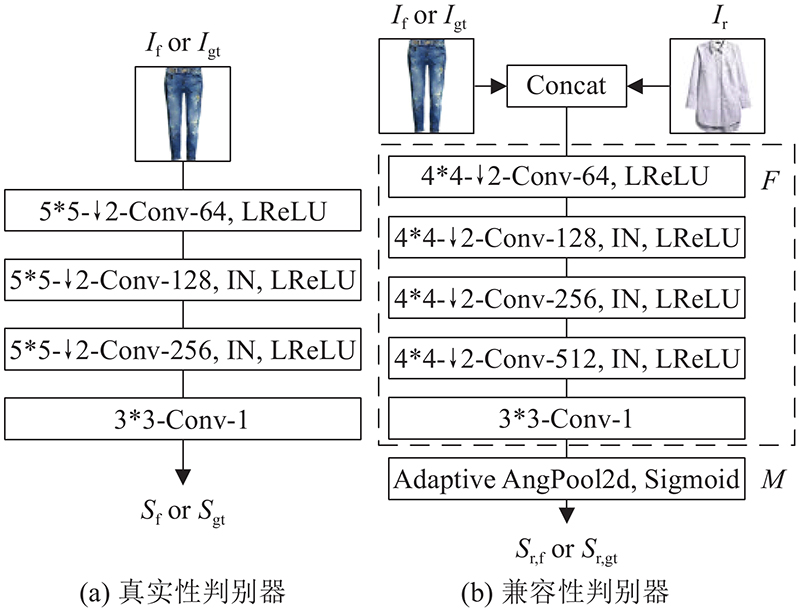

1

... 此前研究[29 ] 表明,使用多个判别器可以减轻GAN训练中的模型崩溃问题. 本研究的任务需要同时满足真实性和兼容性的要求. 基于以上观察,设计了2个判别器:真实性判别器( $ {D}_{\mathrm{a}\mathrm{d}\mathrm{v}} $ ) 和兼容性判别器( $ {D}_{\mathrm{c}\mathrm{o}\mathrm{m}} $ ). ...

1

... 引入感知损失和风格损失[1 ] .使用预先训练好的VGG16[30 ] 分别计算生成服装和真实服装的激活特征图,然后计算两者之间的 $ {L}_{1} $

1

... 式中: $ \mathrm{H}\mathrm{E}\mathrm{D}(·) $ [31 ] .模型的整体损失函数如下所示: ...

1

... FashionVC数据集是由Song等[32 ] 在Polyvore网站上,收集时尚专家创建的成对服装构建而成,包含14 871件上衣和13 663件下裤,混合搭配获得20 726套成对服装. 其中2 000套服装作为测试数据集,其余为训练数据,图像的分辨率为128×128.服装草图使用Canny边缘检测算法[33 ] 获得,检测得到的草图内部线条有些凌乱. 考虑到这个方法面向的是普通用户,而不是专业的服装设计师,因此这些在可以接受的范围内. ...

A computational approach to edge detection

1

1986

... FashionVC数据集是由Song等[32 ] 在Polyvore网站上,收集时尚专家创建的成对服装构建而成,包含14 871件上衣和13 663件下裤,混合搭配获得20 726套成对服装. 其中2 000套服装作为测试数据集,其余为训练数据,图像的分辨率为128×128.服装草图使用Canny边缘检测算法[33 ] 获得,检测得到的草图内部线条有些凌乱. 考虑到这个方法面向的是普通用户,而不是专业的服装设计师,因此这些在可以接受的范围内. ...

1

... 实验的硬件配置为一块NVIDIA GTX 2080Ti显卡,软件配置为Ubuntu18.04系统、Pytorch深度学习框架. 生成器和判别器均使用Adam优化器[34 ] 进行优化,学习率设为0.000 2,损失函数的权重参数 $ \lambda_{1} $ $\lambda_{2} $ $\lambda_{3} $ $\lambda_{4} $ $ \lambda_{5} $

1

... 实验选择3个指标用于评估所提出的方法,分别是输入延迟(fréchet inception distance, FID)[35 ] 、Inception指标(inception score, IS)[36 ] 和结构相似性指标(structural similarity index, SSIM Index)[37 ] . FID用于测量生成图像的深度特征分布与真实图像的深度特征分布之间的偏差,使用Inception-V3网络[38 ] 提取2 048 d特征,然后计算统计距离来评估生成模型. FID值越小代表2个图像分布越接近. IS是基于生成图像的分类分布和每个类的平均概率之间的KL散度来定义的,用来衡量生成图像质量和多样性. KL散度是2个分布之间距离的度量,KL散度越大,即IS值越大,生成模型的效果越好. SSIM结构相似性也是一种全参考的图像质量评价指标,它分别从亮度、对比度和结构3个方面度量2幅图像的相似性. SSIM值越大越好,最大达到1.0. ...

1

... 实验选择3个指标用于评估所提出的方法,分别是输入延迟(fréchet inception distance, FID)[35 ] 、Inception指标(inception score, IS)[36 ] 和结构相似性指标(structural similarity index, SSIM Index)[37 ] . FID用于测量生成图像的深度特征分布与真实图像的深度特征分布之间的偏差,使用Inception-V3网络[38 ] 提取2 048 d特征,然后计算统计距离来评估生成模型. FID值越小代表2个图像分布越接近. IS是基于生成图像的分类分布和每个类的平均概率之间的KL散度来定义的,用来衡量生成图像质量和多样性. KL散度是2个分布之间距离的度量,KL散度越大,即IS值越大,生成模型的效果越好. SSIM结构相似性也是一种全参考的图像质量评价指标,它分别从亮度、对比度和结构3个方面度量2幅图像的相似性. SSIM值越大越好,最大达到1.0. ...

Image quality assessment: from error visibility to structural similarity

1

2004

... 实验选择3个指标用于评估所提出的方法,分别是输入延迟(fréchet inception distance, FID)[35 ] 、Inception指标(inception score, IS)[36 ] 和结构相似性指标(structural similarity index, SSIM Index)[37 ] . FID用于测量生成图像的深度特征分布与真实图像的深度特征分布之间的偏差,使用Inception-V3网络[38 ] 提取2 048 d特征,然后计算统计距离来评估生成模型. FID值越小代表2个图像分布越接近. IS是基于生成图像的分类分布和每个类的平均概率之间的KL散度来定义的,用来衡量生成图像质量和多样性. KL散度是2个分布之间距离的度量,KL散度越大,即IS值越大,生成模型的效果越好. SSIM结构相似性也是一种全参考的图像质量评价指标,它分别从亮度、对比度和结构3个方面度量2幅图像的相似性. SSIM值越大越好,最大达到1.0. ...

1

... 实验选择3个指标用于评估所提出的方法,分别是输入延迟(fréchet inception distance, FID)[35 ] 、Inception指标(inception score, IS)[36 ] 和结构相似性指标(structural similarity index, SSIM Index)[37 ] . FID用于测量生成图像的深度特征分布与真实图像的深度特征分布之间的偏差,使用Inception-V3网络[38 ] 提取2 048 d特征,然后计算统计距离来评估生成模型. FID值越小代表2个图像分布越接近. IS是基于生成图像的分类分布和每个类的平均概率之间的KL散度来定义的,用来衡量生成图像质量和多样性. KL散度是2个分布之间距离的度量,KL散度越大,即IS值越大,生成模型的效果越好. SSIM结构相似性也是一种全参考的图像质量评价指标,它分别从亮度、对比度和结构3个方面度量2幅图像的相似性. SSIM值越大越好,最大达到1.0. ...

Anime-to-real clothing: cosplay costume generation via image-to-image translation

3

2022

... 为了验证本研究方法的有效性,与传统图像翻译方法Pix2Pix[3 ] 、CycleGAN[5 ] 和DiscoGAN[12 ] ,基于示例的图像翻译方法CocosNet[18 ] 和CocosNet v2[19 ] ,服装图像翻译方法Anime2Clothing[39 ] 进行定量比较. 为了保证对比实验的公平,对于Pix2Pix、CycleGAN、DiscoGAN和Anime2Clothing的输入为参考服装和草稿图像级联. ...

... Comparison of three indicators of generated images of different methods

Tab.1 方法 SSIM FID IS Pix2Pix [3 ] 0.795 3 50.237 2 4.719 7 CycleGA N[5 ] 0.546 2 72.322 1 4.228 5 DiscoGAN [12 ] 0.652 5 51.029 5 4.699 9 CocosNet [18 ] 0.654 1 38.001 8 4.384 1 CocosNet v 2[19] 0.765 9 23.462 4 4.502 6 Anime2Clothing [39 ] 0.637 4 52.329 3 4.854 3 w/o CSC Block 0.719 2 22.406 4 4.878 7 Ours 0.794 0 20.202 3 4.930 7

消融实验: 为了验证CSC模块的有效性,使用简单的跳跃连接来代替CSC,在相同的条件下进行实验,结果如表1 中倒数第2行所示,可以看出CSC提升了网络在3个指标上的表现,尤其是SSIM,原因在于草图中的结构特征在网络传播过程中得到了强化. ...

... User study on authenticity and compatibility

Tab.2 方法 真实性 得分 兼容性 得分 方法 真实性 得分 兼容性 得分 Pix2Pix[3 ] 5.44 5.61 CocosNet v2[19 ] 17.56 17.25 CycleGAN[5 ] 8.94 9.67 Anime2Clothing[39 ] 20.00 19.11 DiscoGAN[12 ] 11.19 12.81 Ours 22.08 21.00 CocosNet[18 ] 14.78 14.56 — — —

定性实验1: 图4 显示各个方法的定性实验结果. 从2、3、5行可以看出,对于纹理简单和颜色单一的服装,所提方法和其他方法生成的视觉结果相当. 从4、7、8行可以看出,对于草图较复杂的服装而言,所提方法比其它方法的纹理和细节更真实. 在服装的外形上,所提方法比CycleGAN和DiscoGAN更贴近草图. 在服装细节上,所提方法比其他方法的视觉伪影更少, 原因在于草图编码特征与生成器之间的条件跳跃连接使得草图的纹理细节被较好地保留了下来. 与此同时,生成图像与相应的真实服装在整体上更加的相似,与参考服装在视觉风格上也更加兼容. 由于在生成器中逐步的上采样过程使得生成的图像可以平缓的增长分辨率,保证了最终图像的质量,使得与真实图像十分接近. 生成器是在从参考图像提取高级特征的基础上进行生成的,很好地继承了参考图像的风格特征,而且单独应用了一个兼容性判别器,保证了更好的兼容效果. ...