基于图像的轨道定位,本质上是图像目标检测问题. 传统目标检测算法流程包括:区域选择、特征提取以及分类器分类. 例如,刘甲甲等[7]利用轨道图像先验信息定位扣件区域,提取边缘梯度特征和宏观纹理特征用于扣件状态检测,但定位方式依赖扣件的特殊位置关系,且提取的手工设计特征鲁棒性有待提升,对其他轨道设备定位的借鉴意义不大. 李志等[8]先对整幅图像进行Laplacian边缘检测后,再对二值图像采用区域扫描统计法定位轨枕区域,但该方法易受光照强度的影响且抗干扰性弱. 随着深度学习技术的不断发展,一系列基于深度卷积神经网络的目标检测算法被提出,其中深度卷积神经网络能够对所要识别的目标进行自主学习,自动提取适合于具体场景的特征,并完善自身模型,整个过程无需人工干预[9-10]. 但在采用深度卷积神经网络模型方法识别轨道定位点时,受线路复杂环境、定位点图片样本数量很少、算法训练不够充分等因素的影响,检测结果存在误报问题,无法满足地铁轨道定位精度的需要,因此需要增加辅助手段以区分模型检测结果中的定位点图像和误报点图像.

1. 目标检测

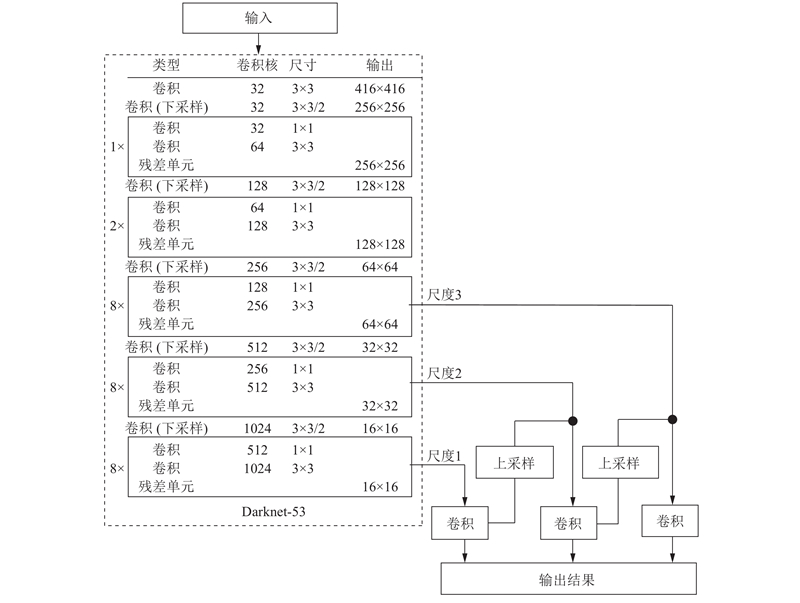

目前应用较为广泛且基于深度学习的目标检测算法有Mask R-CNN(region-convolutional neural network)[16]、Fast R-CNN[17]、Faster R-CNN[18]、SSD(single shot multiboxdetector)[19]、Darknet-53[20]等,其中Darknet-53算法凭借又快又准的检测性能被广大学者密切关注. 2018年,Redmon等[20]在深度学习框架Darknet-19基础上提出深度卷积神经网络Darknet-53. Darknet-53引入残差网络(residual network,ResNet)中的残差单元(residual unit),成功避免了网络层数加深而造成的梯度消失的问题. 该网络包括52个卷积层和1个全连接层,故命名为Darknet-53,其训练模型的检测结果以检测目标类别和目标所在图片位置(框选目标)的方式呈现具体的检测流程如图1所示. Darknet-53模型利用步长为2的卷积核对输入图片进行5次下采样,在检测目标时借鉴SSD的思想,即分别在最后3次下采样输出的3个尺度特征图上预测,这3个尺度特征图对应图中的尺度3、尺度2以及尺度1,尺度大小排列为尺度3>尺度2>尺度1. 小尺度特征图可提供丰富的语义信息,感受视野大,可用来检测大目标;大尺度特征图提供更细粒度信息,感受视野小,可用于检测小目标. Darknet-53通过上采样实现3个不同尺度特征图之间的特征融合. 最终模型对大、小目标都能够进行检测.

图 1

2. 基于目标图像FCM算法的地铁定位点匹配及误报排除

2.1. 传统FCM算法介绍

FCM算法是利用隶属度函数确定每个样本点属于某个聚类的程度的模糊聚类算法. 该算法的核心是通过优化目标函数获得每个数据点相对聚类中心的隶属度.

设置样本集X={x1,x2,···,xk,···,xn},其中xk为行向量,k=1,2,···,n. FCM算法先把X分成c(2≤c≤n)个模糊组,然后求出每组的聚类中心V={v1,v2,···,vi,···,vc},其中vi为行向量,i=1,2,···,c,并使得非相似指标的目标函数达到最小值. 记隶属度矩阵U=(uik)c×n,其中uik表示第k个样本xk属于第i类的隶属度,经过归一化处理后满足以下的约束条件:

该算法默认使用欧几里德距离作为样本xk与各聚类中心vi的非相似性指标,其目标函数的定义如下:

式中:dik为第k个样本与第i个聚类中心之间的欧几里德距离,

为了获得样本集最佳的模糊划分,可使用拉格朗日乘法求取该目标函数的最小值. 先根据式(1)、(2)及(3)所示的约束条件,构造拉格朗日函数如下:

式中:

依据以上2个必要条件,FCM算法可按下列步骤进行简单的迭代计算,确定聚类中心vi和隶属度矩阵U:1)设定模数组数目c,加权指数m,最大迭代次数T以及阈值ε;2)初始化U,使其满足式(1)~(3)中的约束条件;3)根据式(6)计算出c个vi,i=1,2,···,c;4)用式(4)计算目标函数. 如果相对上次目标函数值的改变量小于阈值ε或最大迭代次数超过T,则算法停止;5)根据式(7)计算新的U,并令t=t+1,返回步骤3)继续执行.

2.2. 基于ReliefF算法的特征加权FCM

设置输入:样本维数l,最邻近样本个数s,样本抽样次数g. 设置输出:样本特征的权重值矩阵W=[w1,w2,···,wj,···,wl]. ReliefF算法的步骤如下:1)从训练样本集X中随机抽取一个样本R,从和R同类的样本集中找出s个最近邻样本[23](记为集合A),从每个与R不同类的样本集中各找出s个最近邻样本(分别记为集合B1,B2,···,Bi,···,Bc−1);2)更新每个特征的权重值,规则为如果R和A中某个最近邻样本在某个特征上的距离小于R与Bi中某个最近邻样本在相应特征上的距离,则表明该特征对区分同类和不同类的最近邻样本是有益的,需增加该特征的权重;反之,则无益,需降低该特征的权重;3)重复执行步骤1)~2)g次,求得样本各维特征的权重值,即W=[w1,w2,···,wj,···,wl]. 特征的权重越大,说明该特征的分类能力就越强;反之,则越弱. ReliefF算法的运行时间是随着样本的抽样次数g和样本特征维数l的增加而线性增加的.

在获得样本各特征的权重值后,对欧几里德距离公式进行加权处理,并修改式(4)得到新目标函数:

式中:符号“.×”表示数组乘,即同维数组的对应元素相乘. 结合式(1)~(3)所示的约束条件,运用拉格朗日乘法重新求取新目标函数的最小值. 最终求得使式(8)达到最小值的必要条件为

改进FCM算法的迭代过程与传统FCM算法迭代步骤1)~5)基本一致,不同的是步骤4)中的式(4)须替换为式(8),步骤5)中的式(7)须替换为式(8).

2.3. 轨道定位点匹配及误报排除流程

本研究所讲的轨道定位点指轨道路径上具有独立特征的物体,比如一排电绕组、轨枕上的数字标号及电缆护套等,每一张轨道定位点图片规定只选取2个最具区分性的特征物体. 设置Darknet-53算法目标数量阈值为2,滤除特征物体数量不为2的轨道巡检图片. 定位算法匹配模型将只含有2个特征物体的轨道巡检图片用于定位点匹配.

轨道定位点检测流程如图2所示,包括:1)由安装在列车底部的智能轨道巡检系统中高速工业相机对道床区域高清成像,传入基于Darknet-53的图像识别模型中进行实时检测;2)判断该张图片中的特征物体目标框数是否等于2,只获取含有2个目标框的图片,提取目标框的相关信息(指图像样本的6维特征量);3)把该组实测数据加入样本数据库中,使用改进FCM算法对样本数据库聚类分析. 每一类别定位点都应该通过相关程序设计给定一个绝对位置信息;4)通过判断该组实测数据被分类别,读取该类别对应的绝对位置信息,完成对列车当前里程信息的校准.

图 2

3. 实验结果与分析

3.1. 轨道图片特征量获取

轨道图片均取自广州某地铁的智能轨道巡检系统. 该系统采用的高速工业相机参数如下. 图像传感器:CMOS;分辨率:2048 pixels×1024 pixels;曝光时间:0.02~1000 ms;最高帧率:223 fps.

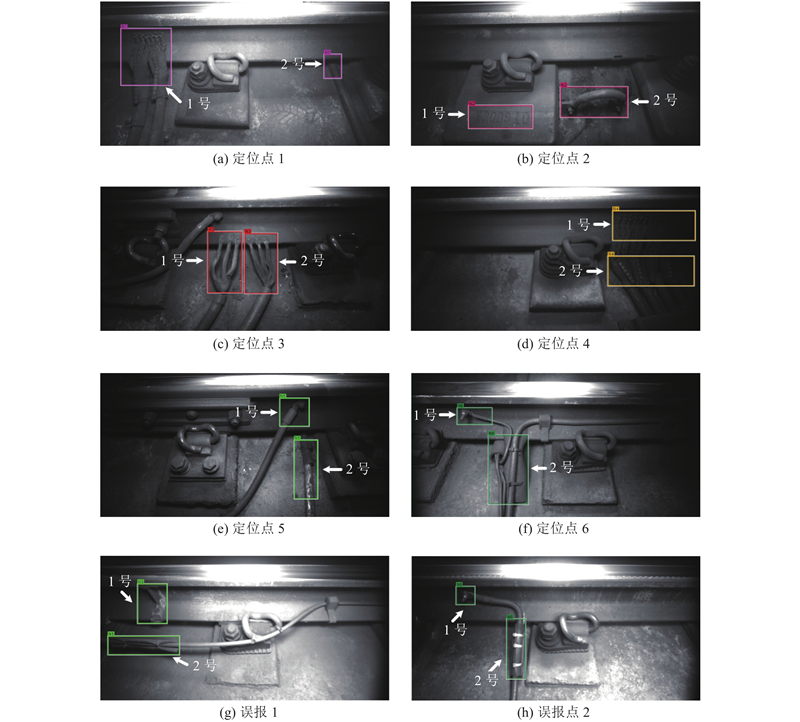

基于Darknet-53的图像识别模型检测结果呈现形式. 本研究从该模型的检测结果中筛选出6类定位点图片和2类误报点图片,如图3所示. 其中每类定位点图片10张,每类误报点图片6张,总共收集72张图片.

图 3

FCM算法只能对数据进行处理分析,因此本研究采用MATLAB图像处理工具箱获取图片中每个目标框的信息,具体包括2个框的中心间距的相对位置(x, y)、长宽比L1、长宽比L2、面积S1以及面积S2,共6维特征数据,其中数字1代表每张图片中的第1个框,2则表示相应的第2个框. 总共获取72组样本数据,其中有60组定位点样本数据,12组误报点样本数据. 如表1所示,8组标准特征量分别对应8类位置类型,1~6类分别表示定位点1~6;7~8类分别表示误报点1、2.

表 1 标准8组特征样本数据

Tab.1

| 样本类别 | x | y | L1 | L2 | S1 | S2 |

| 1 | 1 322 | 59 | 0.888 3 | 0.892 2 | 150 792 | 37 128 |

| 2 | 654 | −108 | 2.848 1 | 2.233 6 | 71 100 | 102 292 |

| 3 | 252 | 20 | 0.518 3 | 0.582 1 | 98 536 | 94 068 |

| 4 | 14 | −305 | 2.837 8 | 2.824 1 | 139 860 | 131 760 |

| 5 | 71 | 396 | 0.970 9 | 0.410 1 | 41 200 | 77 252 |

| 6 | 249 | 379 | 1.985 5 | 0.590 2 | 37 812 | 140 544 |

| 7 | 72 | −432 | 0.597 2 | 3.571 4 | 49 536 | 70 000 |

| 8 | 365 | 90 | 0.973 3 | 0.291 1 | 21 900 | 52 824 |

计算x、y、L1、L2、S1、S2在8个位置类型上的极差,分别为1 308、828、2.329 8、3.280 3、128 892和103 416,极差数据较大且不同位置类型间的特征数据差异显著,因此所选择的这6维特征可作为不同位置类型间的区分特征.

为了消除不同特征指标之间量纲的影响,对获取的所有样本数据必须先进行归一化处理,即:

式中:xij为第i个样本下的第j维特征值,xj_min为第j维特征值在所有样本中的最小值,xj_max为第j维特征值在所有样本中的最大值.

3.2. 计算各特征量权重

表 2 各特征平均权重值

Tab.2

| x | y | L1 | L2 | S1 | S2 |

| 0.241 1 | 0.291 0 | 0.286 5 | 0.254 5 | 0.260 4 | 0.225 1 |

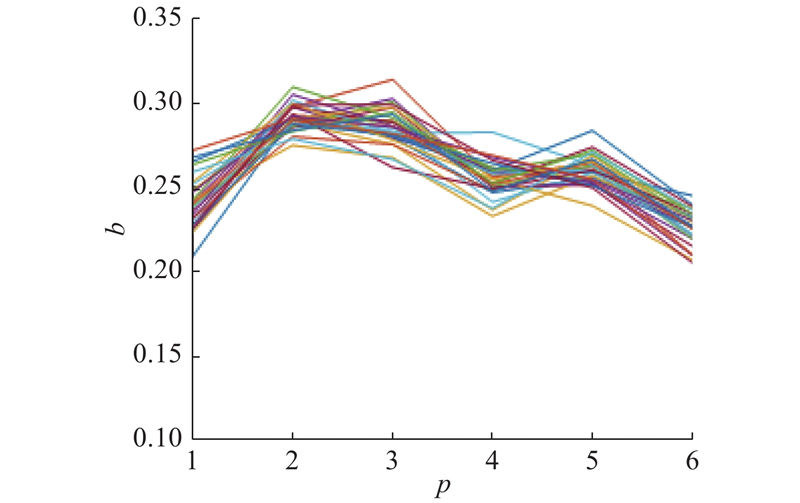

图 4

由表2可知,特征量y和L1对应的平均权重值最大,即对区分定位点与误报点是最有益的,特征量S2对应的平均权重值最小,即对区分定位点与误报点的帮助最小.

3.3. 算法改进的聚类效果比较

图 5

式中:n为参与聚类的样本总数量,ni为第i个聚类组(或簇)中所有的样本个数,nij为第i个聚类组中属于第j类的样本数. 2) RI指标

式中:n为参与聚类的样本总数量,a为同一类的2个样本被正确分类的总对数;b为不同类的2个样本被正确区分的总对数. 一般而言,2个指标的值越大,表明聚类算法的性能越好,且0≤CA≤1,0≤RI≤1.

表 3 FCM算法31~40号与61~66号样本对应的隶属度

Tab.3

| 样本类别 | u31 | u32 | u33 | u34 | u35 | u36 | u37 | u38 | u39 | u40 | u61 | u62 | u63 | u64 | u65 | u66 |

| 1 | 0.000 8 | 0.001 2 | 0.000 3 | 0.001 0 | 0.002 4 | 0.001 7 | 0.001 5 | 0.001 9 | 0.000 2 | 0.000 6 | 0.155 2 | 0.148 3 | 0.155 0 | 0.148 0 | 0.149 5 | 0.151 1 |

| 2 | 0.001 4 | 0.001 9 | 0.000 5 | 0.001 7 | 0.004 1 | 0.003 0 | 0.002 4 | 0.003 1 | 0.000 3 | 0.001 0 | 0.148 7 | 0.152 7 | 0.152 2 | 0.149 7 | 0.149 7 | 0.148 7 |

| 3 | 0.000 8 | 0.001 2 | 0.000 3 | 0.001 0 | 0.002 4 | 0.001 7 | 0.001 4 | 0.001 9 | 0.000 2 | 0.000 6 | 0.224 3 | 0.227 0 | 0.235 9 | 0.214 4 | 0.217 9 | 0.215 5 |

| 4 | 0.001 1 | 0.001 6 | 0.000 4 | 0.001 3 | 0.003 3 | 0.002 2 | 0.001 8 | 0.002 5 | 0.000 2 | 0.000 7 | 0.127 4 | 0.130 2 | 0.130 3 | 0.128 0 | 0.129 3 | 0.127 3 |

| 5 | 0.096 1 | 0.094 8 | 0.058 6 | 0.152 9 | 0.193 8 | 0.716 1 | 0.255 8 | 0.258 2 | 0.030 7 | 0.920 9 | 0.083 1 | 0.083 5 | 0.078 4 | 0.088 1 | 0.086 2 | 0.086 8 |

| 6 | 0.003 1 | 0.004 7 | 0.001 2 | 0.003 7 | 0.008 9 | 0.005 6 | 0.005 7 | 0.007 7 | 0.000 6 | 0.001 9 | 0.104 4 | 0.103 4 | 0.099 8 | 0.107 9 | 0.106 7 | 0.107 4 |

| 7 | 0.895 8 | 0.893 6 | 0.938 3 | 0.837 4 | 0.783 0 | 0.268 1 | 0.730 0 | 0.722 8 | 0.967 8 | 0.073 7 | 0.076 8 | 0.076 9 | 0.072 5 | 0.081 1 | 0.079 5 | 0.080 1 |

| 8 | 0.000 8 | 0.001 1 | 0.000 3 | 0.001 0 | 0.002 2 | 0.001 7 | 0.001 4 | 0.001 9 | 0.000 2 | 0.000 6 | 0.080 3 | 0.078 1 | 0.075 9 | 0.082 7 | 0.081 3 | 0.083 0 |

表 4 2种FCM算法实验对比结果

Tab.4

| 算法 | CA/% | RI |

| FCM | 91.67 | 0.97 |

| 改进的FCM | 100.00 | 1.00 |

3.4. 轨道定位点识别对比实验

不同的聚类算法适用于不同类型的数据,为了验证FCM算法相较于其他聚类算法更适用于本研究的范畴,采用目前较为主流的K-means算法和层次聚类法进行对比实验. 测试集仍采用已获取的72组样本数据,实验结果如表5所示.

表 5 不同聚类算法的实验对比结果

Tab.5

| 聚类算法 | CA/% | RI |

| K-means算法 | 77.78 | 0.93 |

| 层次聚类法 | 91.67 | 0.89 |

4. 结 语

基于图像目标检测,本研究提出了一种改进的FCM算法. 该算法能够提取目标的有效特征量,度量不同特征量的权重;结合隶属度函数,构建了轨道定位点匹配模型. 将该算法与FCM算法、K-means算法以及层次聚类法进行对比,结果表明改进的FCM算法的模型匹配准确度更高. 在研究过程中引入ReliefF算法,这是度量出目标特征权重的关键,也是其优于FCM算法的原因.

虽然提出的算法其模型匹配性能优于其他对比算法,可以解决轨道定位点误报问题,但是距离实时性工程仍有差距,如何在不降低算法性能的前提下减少计算量、提高运行速度,将是下一步的研究重点.

参考文献

现代轨道交通工程科技前沿与挑战

[J].

The frontier and challenge of modern rail transit engineering science and technology

[J].

基于计算机视觉的车载轨道巡检系统研制

[J].

Development of vehicle track inspection system based on computer vision

[J].

铁路钢轨缺陷伤损巡检与监测技术综述

[J].

Review of inspection and monitoring technology for rail defects

[J].

RFID技术在列车高精度定位中的应用

[J].

Application of RFID technology in high-precision positioning of trains

[J].

城市轨道交通列车绝对定位系统比较

[J].

Comparison of absolute positioning system of urban rail transit trains

[J].

基于计算机视觉的轨道扣件缺陷自动检测算法研究

[J].

Research on automatic detection algorithm of rail fastener defects based on computer vision

[J].

基于图像处理的铁路轨枕分割方法研究

[J].

Research on railway sleeper segmentation method based on image processing

[J].

面向实时应用的深度学习研究综述

[J].

A review of deep learning for real-time applications

[J].

基于深度学习的铁道塞钉自动检测算法

[J].

Automatic detection algorithm of railway plug nails based on deep learning

[J].

基于FCM的煤矿突水激光诱导荧光光谱分析

[J].

Analysis of laser-induced fluorescence spectrum of coal mine water inrush based on FCM

[J].

FCM结合IEC三比值法诊断变压器故障

[J].

FCM combined with IEC three ratio method for transformer fault diagnosis

[J].

基于改进的半监督FCM算法的高光谱遥感影像分类

[J].

Hyperspectral remote sensing image classification based on improved semi supervised FCM algorithm

[J].

特征加权和优化划分的模糊C均值聚类算法

[J].

Fuzzy C-Means clustering algorithm for feature weighting and optimal partition

[J].

Faster R-CNN: towards real-time object detection with region proposal networks

[J].

基于ReliefF算法与遗传算法的肌电信号特征选择

[J].

Feature selection of EMG signal based on ReliefF algorithm and Genetic algorithm

[J].

基于ReliefF剪枝的多标记分类算法

[J].

Multi marker classification algorithm based on ReliefF pruning

[J].

等. 一种基于PCA和ReliefF的特征选择方法

[J].

A feature selection method based on PCA and ReliefF

[J].