显著失真(most apparent distortion,MAD)[10]方法融合了图像高低失真程度不同的视觉特性;特征相似度(feature similarity,FSIM)[11]方法联合了视觉相位一致性和图像梯度特征;视觉显著(visual saliency index,VSI)[12]方法联合了视觉显著感知模型和图像梯度特征;局部相关准则(local correlation metric,LCM)[13]提取了图像多视觉通道的本征特征信息;内在推导机制(internal generative mechanism,IGM)[14]基于大脑的自由能量场理论,通过信息感知最大化算法评价图像质量. 上述方法都考虑了图像的视觉多通道显著感知特性,并且联合了多种互补的图像特征进行质量评价,提高了部分评价指标的水平. 但是上述方法仍然存在一些问题,主要体现在:1)视觉特征处理仍有待进一步完善,例如,如何对图像的各视觉通道信息进行更深层次处理,使之更接近于人眼的主观判断;2)图像多特征联合的融合算法不尽合理,例如,一些方法采用了局部相乘的融合算法,而没有考虑人眼视觉对于不同图像特征评价处理的差异性[11-13],因此这些方法的评价结果难以兼顾各项指标水平的提升;3)人眼的视觉多通道主观特性对于不同的图像特征和不同的客观评价算法具有不同的主、客观映射关系,但现有方法均采用了统一的对比度敏感函数进行融合,实验结果表明,这种融合评价策略并没有显著改善评价结果的性能[4-5, 7, 10].

针对上述不足,本研究提出一种融合图像特征的深度感知处理和神经网络预测(deep perception processing and neural network prediction,DPPNNP)评价方法. DPPNNP方法首先提取图像的有效视觉梯度特征显著图,然后分别基于直方图统计和奇异值分解互补评价算法对各视觉通道的梯度信息进行二次深度处理,并将图像梯度特征、多通道视觉梯度特征以及二次深度信息处理的互补视觉特征从内到外逐层地进行深度自适应融合. 最后,DPPNNP方法通过构建BP神经网络图像质量视觉多通道融合预测模型克服视觉多通道主观感知特性对于不同特征和不同算法的差异不确定性.

1. 融合图像特征的深度感知处理和神经网络预测评价方法原理

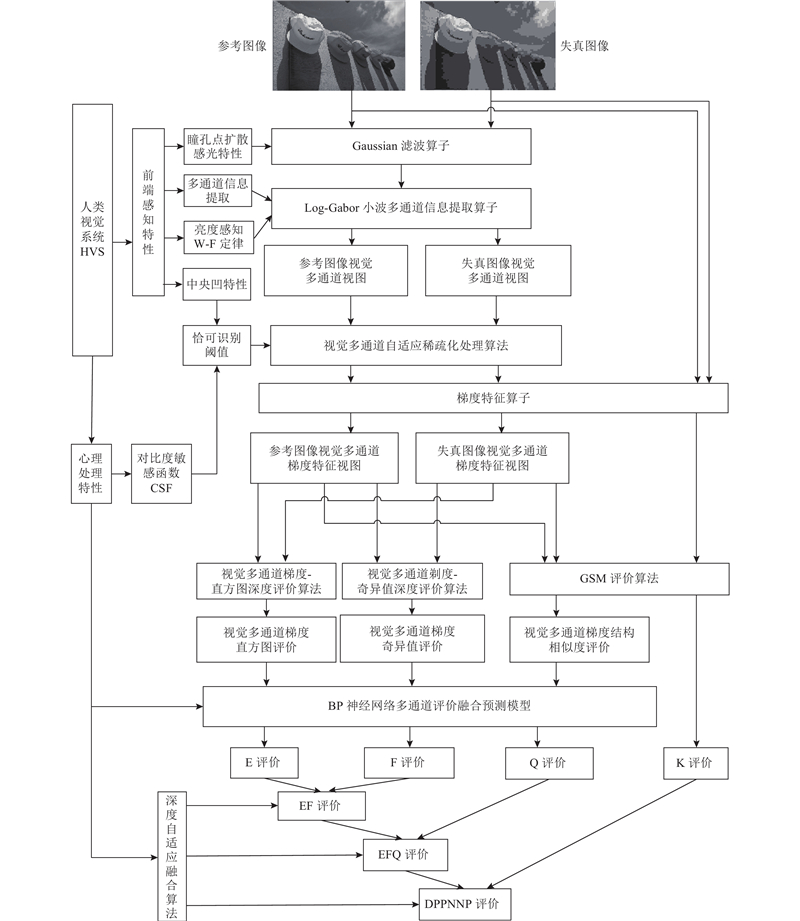

DPPNNP方法原理可用图1描述,主要包括:1)基于高斯核卷积算法[11-12]对原始图像进行滤波处理;2)采用Log-Gabor小波[10-11]对图像进行处理,分别获得参考图像的多通道视图

图 1

图 1 融合图像特征的深度感知处理和神经网络预测(DPPNNP)方法原理图

Fig.1 Schematic diagram of deep perception processing and neural network prediction (DPPNNP) method with fusion of image features

2. 深度视觉信息特征处理及评价算法

2.1. 视觉多通道自适应恰可识别阈值

实践表明,人眼视觉对于图像亮度的感知具有一定的局限性,可以用恰可识别失真(just noticeable distortion,JND)阈值来描述该特性,即人眼识别不出低于该值的图像亮度. 已有文献研究了对比度敏感特性、亮度感知非线性以及空域掩盖效应等,并相应地提出了变换域的JND计算模型,但这些模型都具有各自的局限性[15-16]. 本研究基于图像的梯度特征信息进行质量评价,就是考虑到图像边缘轮廓隐藏的噪声相对较少,对该区域进行JND阈值处理往往能够获得较好的效果. 文献[14]首次考虑了视觉心理的作用机制,提出了基于自由能量准则(free energy principle,FEP)的结构自相似性JND模型,该模型基于信息最大化的自回归方程将图像分解为有序内容和无序内容两部分,分别提取这两部分的JND阈值并将其融合,获得最终的阈值TJND[14]如下:

式中:

图像经过Log-Gabor小波多通道分解后,考虑到人眼视觉的对比度敏感特性,本研究将TJND改进如下:

式中:

式中:

2.2. 视觉多通道梯度特征信息深度处理评价算法

梯度特征较好地反映了图像信息的空间结构分布,梯度特征相似度评价[19]和视觉多通道梯度特征相似度评价[16]均能有效地捕捉图像的边缘轮廓和纹理细节的失真信息. 然而,梯度视图相对于自然图像具有空域信息变化更为剧烈的趋势,常常会加剧视觉掩盖效应,并且梯度特征不能有效反映图像的连片块状内部失真. 实验结果表明,梯度特征相似度和视觉梯度特征相似度对于JPEG类型失真图像的评价性能均出现了明显下降. 作为互补,直方图特征可以准确地统计图像的像素信息,而奇异分解特征值则能有效地提取图像的能量信息,两者对于JPEG类型失真图像的评价均具有较好的性能[16, 20],因此,本研究将两者结合起来,并对失真图像的视觉多通道梯度特征进行二次深度信息评价处理.

2.2.1. 基于直方图评价的深度视觉梯度信息处理

式中:

视觉通道

式中:

其中,

2.2.2. 基于奇异值分解评价的深度视觉梯度信息处理

式中:

其中,

以

2.2.3. 多层深度视觉信息特征评价结果的自适应融合

基于回归函数从内层到外层逐层地融合各层评价,最终获得失真图像质量的评价结果,融合第3层E评价和F评价,获得EF评价结果:

式中:

融合第2层EF评价和Q评价,获得EFQ评价结果:

式中:

融合第1层EFQ评价和K评价,最终获得失真图像质量的客观评价结果:

式中:

表 2 提出的DPPNNP与其他方法在LIVE数据库上的评价结果比较

Tab.2

| 失真类型参数设置 | 指标 | MSSIM | IFC | VIF | GSM | FSIM | VSI | SVD | IGM | MAD | DPPNNP |

| JPEG2000 | RMSE | 4.414 2 | 4.696 1 | 4.714 8 | 4.179 3 | 4.408 6 | 5.496 8 | 4.445 8 | 3.310 5 | 3.059 1 | 3.873 1 |

| PLCC | 0.983 3 | 0.981 1 | 0.980 9 | 0.985 1 | 0.983 4 | 0.974 0 | 0.983 1 | 0.990 7 | 0.992 0 | 0.987 2 | |

| SROCC | 0.984 5 | 0.964 1 | 0.978 7 | 0.986 9 | 0.988 4 | 0.969 8 | 0.981 4 | 0.986 6 | 0.987 1 | 0.984 1 | |

| JPEG | RMSE | 3.600 4 | 3.251 14 | 2.802 7 | 3.909 6 | 3.861 5 | 3.941 4 | 3.419 4 | 2.336 6 | 4.532 8 | 1.936 9 |

| PLCC | 0.989 3 | 0.991 3 | 0.993 6 | 0.987 4 | 0.987 7 | 0.987 2 | 0.990 4 | 0.995 5 | 0.983 0 | 0.996 9 | |

| SROCC | 0.977 9 | 0.953 8 | 0.965 0 | 0.965 0 | 0.980 1 | 0.954 1 | 0.953 6 | 0.976 0 | 0.967 1 | 0.975 8 | |

| WN | RMSE | 2.866 7 | 3.078 6 | 4.131 3 | 3.307 9 | 3.933 6 | 3.335 2 | 2.374 2 | 1.659 0 | 3.124 3 | 1.260 6 |

| PLCC | 0.992 8 | 0.991 7 | 0.985 1 | 0.990 5 | 0.986 5 | 0.990 3 | 0.995 1 | 0.997 6 | 0.991 5 | 0.998 6 | |

| SROCC | 0.984 7 | 0.957 7 | 0.966 6 | 0.987 9 | 0.976 9 | 0.974 7 | 0.994 0 | 0.994 5 | 0.991 3 | 0.993 3 | |

| Gblur | RMSE | 5.454 9 | 3.859 5 | 7.503 8 | 5.505 4 | 4.566 3 | 5.523 8 | 6.776 2 | 3.629 6 | 3.893 0 | 3.135 4 |

| PLCC | 0.976 3 | 0.988 2 | 0.954 6 | 0.975 8 | 0.983 4 | 0.975 7 | 0.963 1 | 0.989 6 | 0.988 0 | 0.992 2 | |

| SROCC | 0.989 2 | 0.969 0 | 0.933 4 | 0.987 9 | 0.991 6 | 0.967 9 | 0.963 5 | 0.988 8 | 0.987 7 | 0.987 7 | |

| Fastfading | RMSE | 4.818 3 | 5.117 4 | 4.125 8 | 5.078 8 | 5.258 1 | 5.553 9 | 6.184 3 | 5.086 5 | 4.192 0 | 2.838 3 |

| PLCC | 0.979 7 | 0.977 1 | 0.985 2 | 0.977 5 | 0.975 8 | 0.973 0 | 0.966 4 | 0.977 4 | 0.984 7 | 0.993 6 | |

| SROCC | 0.984 1 | 0.957 0 | 0.969 5 | 0.982 7 | 0.981 5 | 0.964 4 | 0.969 9 | 0.972 0 | 0.985 0 | 0.990 7 | |

| 失真类型总和 | RMSE | 6.231 9 | 5.371 8 | 7.469 2 | 6.103 1 | 5.784 3 | 6.597 9 | 6.279 0 | 4.722 0 | 5.517 2 | 4.132 4 |

| PLCC | 0.967 3 | 0.975 8 | 0.952 6 | 0.968 6 | 0.971 9 | 0.963 2 | 0.966 8 | 00.981 3 | 0.974 4 | 0.987 5 | |

| SROCC | 0.965 1 | 0.955 2 | 0.920 6 | 0.971 8 | 0.977 8 | 0.949 1 | 0.967 2 | 0.974 1 | 0.977 3 | 0.981 5 |

3. 视觉多通道BP神经网络图像质量预测模型

人类视觉系统(human visual system,HVS)能够以不同角度、不同分辨率的多通道系统提取图像的不同层次信息,在图像质量评价(image quality assessment,IQA)研究领域中,国际视频质量专家组(video quality experts group,VQEG)统一用对比度敏感函数(contrast sensitivity function,CSF)来表示HVS的这种特性. 然而,较多的实验表明,对于同一帧失真图像的同一层次特征,不同IAQ方法往往具有不同的评价指标水平,并且随着图像失真类型的不同,即使同一IQA方法也具有不同的评价性能,因此,统一使用CSF函数,降低了各种IQA方法的性能. 目前,关于上述问题的研究,无论是在理论上还是在实验上,IQA领域都缺乏有效成果.

近些年来,随着研究的深入,神经系统已经在信号处理、模式识别等多个人工智能领域取得了非凡的成就. 其中,反向传播BP神经网络技术在图像处理领域获得了重要的应用. 理论上,一个3层以上的BP神经网能够以任意精度逼近一个非线性函数,并且对外界激励具有自适应学习的能力,从而具备了非常强大的分类识别能力,BP的出现解决了神经网络发展史上的非线性分类难题. 基于BP神经网在图像处理领域优越的分类识别能力,本研究将BP神经网用于解决CSF函数面临的难题,提出BP神经网络图像质量视觉多通道融合预测模型,该模型原理如图2所示. 该模型基于不同类型失真图像和不同IQA评价算法分别进行训练和测试,将数据库中的失真图像数量对半分配,一半作为训练集,一半作为测试集.

图 2

图 2 BP神经网络多通道评价融合预测模型

Fig.2 Predicting model of multi-channel assessment pooling based on BP neural network

根据经验,该模型设置为3层BP网络,输入层神经元数量等于视觉多通道数量

4. 实验结果分析

4.1. BP神经网络图像质量预测结果分析

实验在VQEG提供的LIVE(database release2)数据库进行,该数据提供了参考图像、5类主要失真图像以及不同失真程度图像的差别均值主观分(difference mean opinion score,DMOS)等较为完整的数据集. 本部分实验针对LIVE数据库的一半测试集失真图像,测试所提BP神经网络图像质量模型和CSF函数融合模型在E、F和Q三种评价方法上的评价指标,并对各项测试的指标水平进行比较,结果如表1所示. 性能测试选用VQEG建议的RMSE、PLCC和SROCC指标,这3个指标均反映了图像质量客观评价方法和人眼主观测试结果的关系. 其中,RMSE表示主客观结果之间的误差,RMSE值越大说明客观方法性能越差,而PLCC和SROCC则反映了主客观结果之间的相关性系数,PLCC和SROCC值越大,说明客观方法性能越好. 本研究所提BP模型获在E、F和Q三种评价方法上,对于5种不同的图像失真类型,其RMSE、PLCC和SROCC指标水平均较高,且大幅度领先于CSF函数融合的评价结果. CSF函数融合仅仅针对F和Q两种评价方法,在其中某一类型失真图像评价上和BP预测模型具有持平的指标水平. 表1的实验结果表明:BP神经预测网络在视觉多通道图像质量评价方面具有非常理想的效果.

表 1 BP神经网络预测结果和CSF融合结果比较

Tab.1

| 失真类型 | 指标 | E | F | Q | |||||

| BP模型 | CSF函数 | BP模型 | CSF函数 | BP模型 | CSF函数 | ||||

| JPEG2000 | RMSE | 5.260 7 | 11.617 2 | 4.554 0 | 5.308 6 | 4.063 1 | 4.362 6 | ||

| PLCC | 0.976 2 | 0.878 0 | 0.982 2 | 0.975 8 | 0.985 9 | 0.983 7 | |||

| SROCC | 0.960 9 | 0.611 0 | 0.972 7 | 0.967 9 | 0.983 3 | 0.986 3 | |||

| JPEG | RMSE | 3.304 9 | 9.356 4 | 2.893 8 | 3.495 9 | 3.567 8 | 3.544 2 | ||

| PLCC | 0.991 0 | 0.926 5 | 0.993 1 | 0.990 0 | 0.986 7 | 0.989 7 | |||

| SROCC | 0.952 5 | 0.736 9 | 0.964 5 | 0.931 0 | 0.977 2 | 0.976 0 | |||

| WN | RMSE | 3.366 2 | 10.333 7 | 3.349 8 | 3.295 3 | 1.331 4 | 2.427 7 | ||

| PLCC | 0.990 1 | 0.902 6 | 0.990 2 | 0.990 5 | 0.998 5 | 0.994 9 | |||

| SROCC | 0.975 1 | 0.683 9 | 0.986 0 | 0.983 5 | 0.992 8 | 0.993 2 | |||

| gblur | RMSE | 6.173 2 | 6.982 4 | 5.527 6 | 5.513 4 | 3.013 2 | 5.196 6 | ||

| PLCC | 0.969 5 | 0.960 8 | 0.975 6 | 0.975 8 | 0.992 8 | 0.978 5 | |||

| SROCC | 0.953 1 | 0.958 3 | 0.983 4 | 0.975 8 | 0.988 0 | 0.987 7 | |||

| Fastfading | RMSE | 6.916 8 | 11.155 8 | 6.241 0 | 7.739 9 | 3.731 1 | 6.591 0 | ||

| PLCC | 0.957 8 | 0.886 0 | 0.965 8 | 0.946 8 | 0.987 9 | 0.961 7 | |||

| SROCC | 0.931 8 | 0.741 2 | 0.960 7 | 0.923 2 | 0.986 3 | 0.956 6 | |||

4.2. DPPNNP方法结果分析

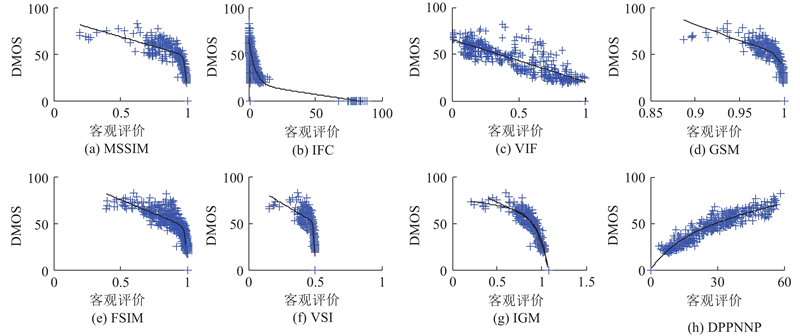

实验比较了DPPNNP方法和其他主流视觉感知方法的性能,LIVE(database release2)数据库下的结果如表2所示. 表中方法大体分为3类,包括了最近的研究成果. 第一类是基于图像视觉特征处理或视觉显著模型的评价方法,例如多尺度结构相似度(multiscale structural similarity, MSSIM)[24]、梯度相似度GSM)、特征结构相似度(FSIM)和视觉显著(VSI);第二类是基于图像视觉信息处理的评价方法,结果信息保真度(information fidelity criterion, IFC)[25]和视觉信息保真度(visual information fideliy, VIF)[26];第三类是基于视觉大脑内推机制和处理算法融合的评价方法,例如IGM和显著失真(MAD). 从表2的实验结果可知:1)各种方法的RMSE和PLCC指标对于WN和JPEG两类失真图像的评价保持了较高的水平(RMSE<3.933 6,PLCC>0.986 5),但是SROCC指标水平有待提高(SROCC>0.953 6). 2)对于其他失真类型图像的评价,不同方法的各项指标水平相对互有高低. 其中,IGM和MAD方法在JPEG2000和gblur两类失真评价上具有一定的优势,但问题是评价性能不稳定,例如,MAD在JPEG和fastfading两类失真评价上,各项指标水平均出现了大幅的下降;同样,IGM方法对于不同类型失真评价,其各项指标水平均变动较大. IGM和MAD方法的稳定性较低说明将视觉大脑的最新研究成果用于图像质量评价,其理论依据和建模算法都有待进一步的深入研究. 3)结合视觉特征处理的评价方法,对于不同图像失真类型都具有相对稳定的评价性能,例如MSSIM、FSIM、VSI和IFC等,但问题是其各项指标水平都有待提高,主要是因为该类方法对视觉特征的处理不够深入,采用的主观刺激-响应模型过于单一. 4)整体上,在不对图像失真类型进行区分或者图像失真机理不明确的情况下,多重视觉特征融合方法(例如:FSIM)或视觉特性与视觉心理互补方法(例如:IGM,IFC,MAD)部分评价指标具有一定的优势,但距离人眼主观测试结果仍有较大的误差.表2的结果反映出所提DPPNNP方法的优点:1)DPPNNP方法对于图像不同失真类型的评价,各项指标均具有非常高的水平(RMSE<3.873 1,PLCC>0.987 2,SROCC>0.975 8),且明显超越了上述3种方法. 2)DPPNNP方法的评价性能相对稳定,没有出现由于图像失真类型不同而造成指标水平明显下降的现象. 相对于IGM和MAD类方法所采用的尚不确定的视觉心理推导模型,DPPNNP借助了BP神经网络强大的推导分析能力和非线性数值逼近能力,从而能更有效地模拟视觉心理的复杂作用机制. 3)针对现有视觉特征处理评价方法指标水平不高的问题,DPPNNP方法不仅采用了深度视觉特征处理算法E评价和F评价,而且自适应地融合了多重视觉感知的特征评价结果. 综上,所提DPPNNP方法不仅克服了现有方法的各种缺陷,而且整体评价性能(RMSE=4.132 4,PLCC=0.987 5,SROCC=0.981 5)也明显超越了现有方法.

为进一步验证DPPNNP方法的性能,增加CSIQ和tid2013两个数据库的整体实验,结果如表3所示. 可知VSI和DPPNNP方法的RMSE、PLCC和SROCC指标水平总体上大幅领先于其他方法,而DPPNNP方法在CSIQ数据库上的3个指标水平全面优于VSI方法,在tid2013数据库上仅SROCC指标水平低于VSI方法,但仍优于其他方法.

表 3 所提DPPNNP与其他方法在CSIQ和tid2013数据库的评价结果比较

Tab.3

| 数据库名称及参数设置 | 指标 | MSSIM | IFC | VIF | GSM | FSIM | VSI | SVD | IGM | MAD | DPPNNP |

| CSIQ | RMSE | 0.118 0 | 0.179 9 | 0.142 4 | 0.172 1 | 0.110 1 | 0.099 0 | 0.170 7 | 0.099 6 | 0.084 1 | 0.071 8 |

| PLCC | 0.879 0 | 0.738 9 | 0.845 9 | 0.764 6 | 0.911 1 | 0.928 7 | 0.768 9 | 0.928 7 | 0.949 2 | 0.963 2 | |

| SROCC | 0.913 0 | 0.767 6 | 0.922 1 | 0.908 9 | 0.928 9 | 0.945 3 | 0.753 0 | 0.941 1 | 0.937 2 | 0.958 8 | |

| tid2013 | RMSE | 0.766 9 | 1.217 1 | 0.974 9 | 0.971 7 | 0.710 8 | 0.678 1 | 0.933 0 | 0.692 8 | 0.704 2 | 0.636 0 |

| PLCC | 0.782 3 | 0.150 5 | 0.610 7 | 0.802 4 | 0.816 5 | 0.834 6 | 0.652 5 | 0.826 6 | 0.820 3 | 0.856 2 | |

| SROCC | 0.788 8 | 0.513 9 | 0.609 5 | 0.796 6 | 0.796 8 | 0.889 0 | 0.632 7 | 0.802 6 | 0.750 7 | 0.802 9 |

图 3

4.3. 算法时间复杂度测试

为了比较各种图像质量客观评价算法的计算复杂度,表4列出了各种算法基于tid2013数据库的整体评价时间t. 硬件基于 i7-7500U CPU@2.70 GHz与8 G内存的L470便携式PC,软件基于Windows10与MATLAB R2014a. 基于时间复杂度的考虑,用于比较的算法基本可以分为图像特征处理(MSSIM、SVD)、视觉特征处理(VSI、FSIM、MAD)、图像信息处理(IFC、VIF)和视觉神经处理(IGM、DPPNNP)四类. 受限于目前对于人类视觉系统原理认知上的不足,视觉神经处理类算法一直是该领域的一个研究难点,所提DPPNNP算法的运行时间为211 27 s,同类IGM算法的运行时间为39 194 s,DPPNNP算法比IGM算法节省了54%的时间资源。综合考虑各项评价指标水平,认为DPPNNP算法的性能优于IGM算法.

表 4 不同图像质量评价方法的时间复杂度测试结果比较

Tab.4

| 评价方法 | t/s | 评价方法 | t/s | |

| MSSIM | 171 | IFC | 2 020 | |

| SVD | 238 | VIF | 2 083 | |

| VSI | 484 | IGM | 39 194 | |

| FSIM | 653 | DPPNNP | 21 127 | |

| MAD | 3 128 | — | — |

5. 结 语

针对目前视觉特征感知处理和视觉心理推导在图像质量评价研究领域中存在的问题,通过将BP神经网络融入视觉系统,提出了一种视觉特征深度自适应融合的图像质量评价方法. 为了充分挖掘图像特征评价的有效性,所提方法利用了视觉感知中的确定特性,基于直方图统计和奇异值分解互补评价算法对各视觉通道的梯度信息进行了二次深度处理. 针对视觉多通道主观感知对于不同特征客观评价算法的差异不确定性,所提方法构建了BP神经网络图像质量视觉多通道融合模型,将不同视觉特征评价算法的各个通道评价结果输入神经网络并进行有监督的学习训练,BP神经网的融合预测输出有效地提高了各种算法的各项评价指标水平. 在客观评价过程中,所提方法将图像梯度特征、图像多通道视觉梯度特征以及二次深度信息处理的互补视觉特征从内到外逐层地进行了自适应融合. 实验结果表明,相对现有方法,所提方法的各项评价指标水平均具有较大的优势,而且对于不同类型失真图像的评价,各项评价指标都保持了较高的稳定水平.

参考文献

Image retargeting quality assessment based on content deformation measurement

[J].

Full reference quality assessment for image retargeting based on natural scene statistics modeling and bi-directional saliency similarity

[J].

Objective quality assessment of image retargeting by incorporating fidelity measures and inconsistency detection

[J].

Multiple-level feature-based measure for retargeted image quality

[J].DOI:10.1109/TIP.2017.2761556 [本文引用: 1]

视觉稀疏化多通道多特征自适应的图像评价

[J].DOI:10.3969/j.issn.0254-3087.2016.03.025 [本文引用: 2]

Image quality assessment based on adaptive sparse visual multi-channel and multi-feature pooling

[J].DOI:10.3969/j.issn.0254-3087.2016.03.025 [本文引用: 2]

SpEED-QA: patial efficient entropic differencing for image and video quality

[J].DOI:10.1109/LSP.2017.2726542 [本文引用: 1]

Gradient direction for screen content image quality assessment

[J].DOI:10.1109/LSP.2016.2599294 [本文引用: 1]

Deep convolutional neural models for picture-quality prediction: challenges and solutions to data-driven image quality assessment

[J].

Massive online crowdsourced study of subjective and objective picture quality

[J].DOI:10.1109/TIP.2015.2500021 [本文引用: 1]

Most apparent distortion: full-reference image quality assessment and the role of strategy

[J].

FSIM: a feature similarity index for image quality assessment

[J].DOI:10.1109/TIP.2011.2109730 [本文引用: 5]

VSI: a visual saliency-induced index for perceptual image quality assessment

[J].DOI:10.1109/TIP.2014.2346028 [本文引用: 2]

Full-reference image quality assessment using statistical local correlation

[J].DOI:10.1049/el.2013.3365 [本文引用: 2]

Perceptual quality metric with internal generative mechanism

[J].DOI:10.1109/TIP.2012.2214048 [本文引用: 4]

基于视觉显著失真度的图像质量自适应评价方法

[J].

Image quality self-adaptive assessment based on visual salience distortion

[J].

视觉多通道梯度与低阶矩自适应图像评价

[J].DOI:10.3969/j.issn.0254-3087.2015.11.017 [本文引用: 3]

Adaptive image quality assessment based on visual multi-channel gradient and low order moment

[J].DOI:10.3969/j.issn.0254-3087.2015.11.017 [本文引用: 3]

Image quality assessment: from error visibility to structural similarity

[J].DOI:10.1109/TIP.2003.819861 [本文引用: 1]

Foveation scalable video coding with automatic fixation selection

[J].DOI:10.1109/TIP.2003.809015 [本文引用: 2]

Image quality assessment based on gradient similarity

[J].DOI:10.1109/TIP.2011.2175935 [本文引用: 1]

Image quality assessment based on multiscale geometric analysis

[J].DOI:10.1109/TIP.2009.2018014 [本文引用: 5]

深度视觉特征与策略互补融合的图像质量评价

[J].

Image quality assessment based on complementary pooling of deeply visual feature and strategy

[J].

An SVD-based grayscale image quality measure for local and global assessment

[J].DOI:10.1109/TIP.2005.860605 [本文引用: 1]

Image quality assessment using an SVD-based structural projection

[J].DOI:10.1016/j.image.2014.01.007 [本文引用: 1]

An information fidelity criterion for image quality assessment using natural scene statistics

[J].DOI:10.1109/TIP.2005.859389 [本文引用: 1]

Image information and visual quality

[J].DOI:10.1109/TIP.2005.859378 [本文引用: 1]