本文链接 :https://www.zjujournals.com/gcsjxb/CN/10.3785/j.issn.1006-754X.2025.04.109

3D打印混凝土技术是一种结合3D打印技术与商品混凝土领域技术的新型混凝土施工技术[1 ] ,通过自下而上层层堆积混凝土而成型。在实际建筑施工过程中,混凝土结构在多重因素影响下会出现变形、裂纹和孔隙等缺陷[2 ] ,造成宏观和微观上的不连续性,严重制约了其大规模的工业化生产与应用。其中,孔隙为最常见的缺陷,亟须开展相关检测方法研究[3 -4 ] 。

目前,3D打印混凝土孔隙检测以人工接触式检测为主,利用物理仪器和化学手段进行辅助,但人工检测具有较大的随机性、主观性和一定的安全隐患,且物理仪器及化学材料价格不菲,对混凝土强度和检测时间要求较高,实际操作时易导致检测结果不够准确。为实现混凝土孔隙的智能化检测,国内外学者利用具有“智慧之眼”之称的机器视觉技术开展了大量研究[2 ] 。王超等[5 ] 利用传统图像处理算法实现了对岩石孔隙结构的连续定量分析。马宗方等[6 ] 设计了一种基于层间信息熵和双阈值优化的打印构件精细分割算法,实现了对3D打印混凝土构件的分层检测和精细分割,但在实际检测过程中,该算法需人工计算对应的分割阈值,且检测结果易受外界环境干扰,自动化、智能化程度不足。

针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] 。现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法。上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势。Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性。Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象。Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测。Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题。Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率。Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤。Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快。综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究。

为此,本文拟基于YOLO算法提出一种轻量级的3D打印混凝土界面孔隙检测方法。首先,利用传统图像处理算法对3D打印混凝土界面孔隙图像进行预处理,以构建孔隙检测所需的数据集;然后,利用所提出的方法实现3D打印过程中混凝土界面孔隙缺陷的高效准确检测,便于后续修正处理,从而提高混凝土打印结构的稳定性和安全性,旨在进一步促进3D打印混凝土技术的发展与应用。

1 3D 打印混凝土界面孔隙检测方法

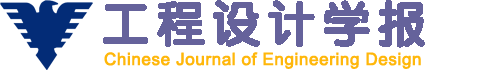

根据3D打印混凝土界面孔隙检测的特点,在算法的选择及改进过程中均以检测精度和效率为主要考虑因素,本文从以下几个方面展开:1)构建3D打印混凝土界面孔隙图像数据集,针对特征提取阶段易丢失小目标特征信息的问题,对锚框计算方法进行优化,以生成更适合界面孔隙目标检测的锚框,从而降低孔隙漏检率;2)针对主流目标检测网络规模庞大、参数多及硬件要求高的问题,引入轻量化ShuffleNetv2网络[25 ] 来进行特征提取,在减少参数量的同时提升检测速度,以实现在混凝土3D打印设备中的快速部署;3)在特征提取网络中融合极化自注意力(polarized self-attention, PSA)机制[26 ] ,通过计算数据样本之间的位置关系来避免大维度空间中出现梯度消失或爆炸的问题,并在保持高分辨率的同时增强对孔隙有效特征的关注度,以提升检测精度。本文所提出的3D打印混凝土界面孔隙检测方法的网络结构如图1 所示。

图1

图1

3D 打印混凝土界面孔隙检测方法的网络结构

Fig.1

Network structure of 3D printed concrete interface pore detection method

1.1 锚框计算方法优化

3D打印混凝土技术具有独特的成型特点,在打印时易出现界面孔隙分布不均和尺寸大小不一的问题。在目标检测中,常用的锚框计算方法为K- means聚类算法,在COCO(common objects in context)数据集上利用该算法进行聚类来确定锚框大小[27 ] 。COCO数据集以大中型目标为主,故在特征提取阶段易丢失小目标特征信息,而本文建立的3D打印混凝土界面孔隙图像数据集包含大量小目标,若直接使用K- means聚类算法确定锚框大小,则会导致检测方法无法准确检测较小孔隙或漏检。鉴于K- means++聚类算法能够自动确定聚类数量并增强检测框对小目标的关注度,本文使用K- means++聚类算法来确定孔隙图像数据集中目标样本的锚框大小,以确保对小孔隙目标的准确检测,在一定程度上降低检测误差。

首先,从所有的孔隙标注框数据χ D ( x ) P ( x )

P ( x ) = D 2 ( x ) ∑ x ∈ χ D 2 ( x ) (1)

最后,选择最大概率所对应的孔隙标注框作为下一个聚类中心:孔隙标注框距离当前聚类中心越远,则被选中的概率越高。重复上述过程,直至获得K 个聚类中心,即K 个孔隙标注框。

1.2 特征提取网络轻量化

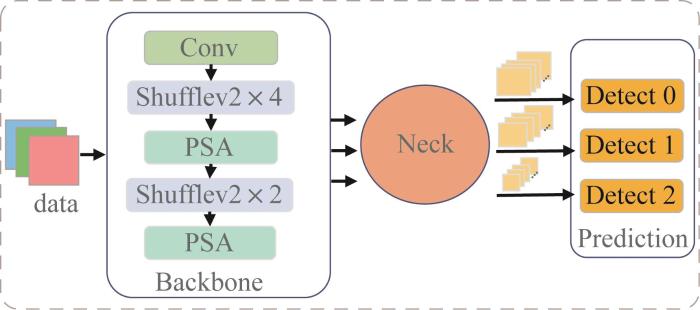

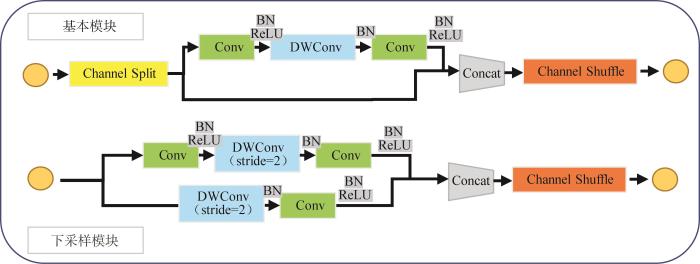

现有的基于深度学习的主流目标检测网络的规模一般较为庞大,且涉及参数多,对硬件要求高,难以直接快速部署在3D打印设备上。为了实现快速检测,本文引入轻量级的ShuffleNetv2网络,作为3D打印混凝土界面孔隙特征提取网络,在减少参数量的同时提升检测速度[9 ] 。同时,ShuffleNetv2网络支持多尺度的特征金字塔结构,可以更好地结合多尺度特征融合方法来提升检测小目标的能力,从而提高检测精度。ShuffleNetv2网络的结构如图2 所示。孔隙图像经特征提取网络提取后的不同尺寸特征图如图3 所示。

图2

图2

ShuffleNetv2 网络结构

Fig.2

ShuffleNetv2 network structure

图3

图3

不同尺寸的孔隙特征图

Fig.3

Pore feature maps with different dimensions

1.2.1 通道分离及重排

通道分离操作是指将包含多个通道的特征映射成多个子集或分支,通过在神经网络的不同部分进行不同操作来帮助检测网络学习不同类型的特征,并将不同特征连接以生成更丰富的特征表示。

设输入特征图I ∈ R H × W × C R H 、W 、C 分别表示特征图的高度、宽度和通道数),按通道数的一半对输入特征图进行分割,将通道分为2组,每组包含C / 2 I

I = [ A 1 , A 2 , A 3 , ⋯ , A C / 2 , B 1 , B 2 , B 3 , ⋯ , B C / 2 ] (2)

式中: A i B i i =1, 2,…, C /2)分别表示A组和B组内的第i 个通道。

通道重排操作是指通过将每个子特征图的前半部分通道与后半部分通道进行交叉连接来增加通道间的交互和信息传递,从而提高检测性能。在完成通道分离后,提取对应的通道并分别进行逐通道卷积、池化和归一化等操作,并将各组的计算结果按通道重新组合,使得A组与B组的通道交替按顺序连接,以形成新的子特征图O A O B

O A = [ A 1 , A C / 4 + 1 , A 2 , A C / 4 + 2 , A 3 , A C / 4 + 3 , ⋯ , A C / 2 , A C / 4 ] (3)

O B = [ B 1 , B C / 4 + 1 , B 2 , B C / 4 + 2 , B 3 , B C / 4 + 3 , ⋯ , B C / 2 , B C / 4 ] (4)

将所有重排后的子特征图按通道维度进行连接,得到最终的输出特征图O I O ∈ R H × W × C

1.2.2 逐通道卷积

逐通道卷积是指使用1×1的卷积核对输入特征图的每个通道进行独立的卷积计算,即每个通道均存在独立的卷积核。在3D打印混凝土界面孔隙检测方法的轻量化设计中,使用逐通道卷积可在有效减少计算量和参数量的同时保持所提取特征的表达能力。

设输入的子特征图尺寸为H 1 × W 1 × C 1 H 1 、W 1 和C 1 分别表示子特征图的高度、宽度和通道数),卷积核的尺寸为1 × 1 × T

H 1 × W 1 × C 1 → ( H 1 × W 1 ) × C 1 (5)

1 × 1 × T → T × 1 (6)

然后,对展开后的输入特征图矩阵和卷积核矩阵进行逐元素卷积计算。设输出特征图中的某个位置为( h , w , c )

( h , w , c ) = ∑ i = 0 c - 1 ∑ j = 0 c - 1 I n p u t ( h , w , i ) * K e r n e l ( i , c ) (7)

式中:I n p u t ( h , w , i ) ( h , w ) i K e r n e l ( i , c ) i c

逐元素卷积计算得到的结果为列向量,将列向量重新转换为输入特征图的尺寸,可表示为:

( H 1 × W 1 ) × 1 → H 1 × W 1 × 1 (8)

最后,按通道维度重组所有子特征图,先将每个子特征图的相同通道位置堆叠在一起,再依次堆叠其他通道位置,以此得到最终的输出特征图,其尺寸为H 1 × W 1 × C 1

由图3 可以看出,在特征提取过程中,通过加深网络层数的方式对输入数据进行排列、组合和卷积等操作,可使孔隙图像信息得到有效处理。与经典YOLOv5s模型相比,使用轻量化ShuffleNetv2网络后,模型的总计算量可降低至YOLOv5s的1/3左右,有效地提高了检测效率。

1.3 PSA 机制模块融合

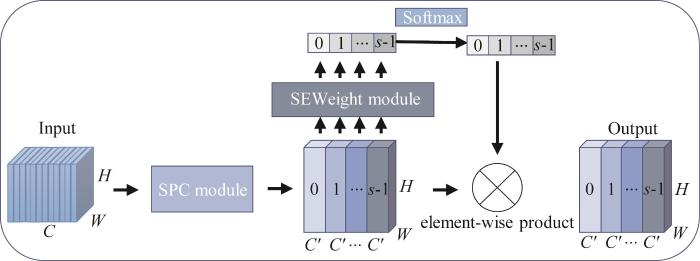

为提高本文所提出方法的孔隙检测能力,在特征提取网络中融合PSA机制模块,即针对不同重要程度的特征采用不同的加权方式,以实现对孔隙目标的聚焦。同时,采用PSA机制,可在处理混凝土界面孔隙图像数据时引入位置信息来改进检测模型的建模能力,以更好地捕获数据点之间的关系。PSA机制模块的结构如图4 所示。

图4

图4

PSA 机制模块结构

Fig.4

PSA mechanism module structure

在利用轻量化特征提取网络提取不同尺度的特征后,通过添加位置嵌入的方式将位置信息编码到输入数据中,使得每个数据点同时包含数据特征和位置信息。设输入序列的长度为N ,每个位置的特征表示为 x i Q i K i V i

Q i = W q × x i + b q (9)

K i = W k × x i + b k (10)

V i = W v × x i + b v (11)

式中:W q b q W k b k W v b v

然后,引入位置注意力分数,通过计算每个数据点与其他数据点之间的注意力分数来衡量数据点之间的相关性。其中,注意力权重计算包含位置权重计算,通过将查询向量和键向量进行点积并适当缩放点积,以避免在大维度空间中出现梯度消失或爆炸的问题,随后加上注意力偏置,并使用Softmax函数计算得到注意力权重,计算式如下:

a i j = S o f t m a x ( Q i ⋅ K i T ) / d k + b a (12)

式中:a i j i j d k b a

对注意力权重与值向量进行加权求和,得到最终的自注意力表示,公式如下:

c i = ∑ i a i j V i (13)

最后,计算最终的输出特征向量,将位置权重的加权和与输出权重矩阵相乘后再与输出偏置向量相加,公式如下:

y i = W o × c i + b o (14)

式中: y i i W o 表示输出权重矩阵, b o 表示输出偏置向量。

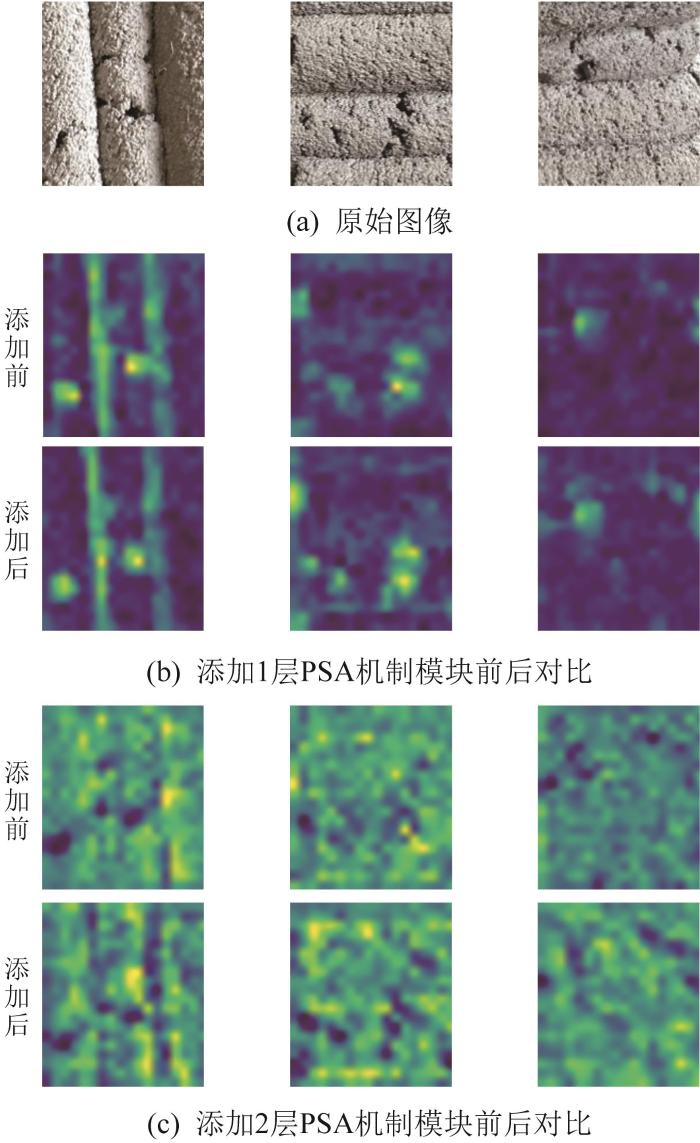

融合PSA机制模块前后所提取的孔隙特征图对比如图5 所示。由图5 可以看出,在融合PSA机制模块后,特征提取网络对孔隙图像中的无关背景信息和待测目标信息作不同关注度处理。对比图5 (b)与图5 (a)可知,添加1层PSA机制模块后,在增强图像目标区域的同时弱化了不相关的背景区域,进一步提升了对孔隙目标的特征表达能力,并增加了对融合PSA机制模块前未注意到的孔隙目标特征的关注度,有效地提高了网络的特征提取能力。对比图5 (c)与图5 (a)和图5 (b)可知,添加2层PSA机制模块后,网络的特征提取能力进一步加强,能够关注到添加1层PSA机制模块后所忽略的孔隙目标并对其进行信息增强,实现了在检测精度得到有效提升的同时降低漏检率。

图5

图5

融合PSA 机制模块前后的孔隙特征图对比

Fig.5

Comparison of pore feature maps before and after fusing PSA mechanism module

1.4 多尺度特征融合检测

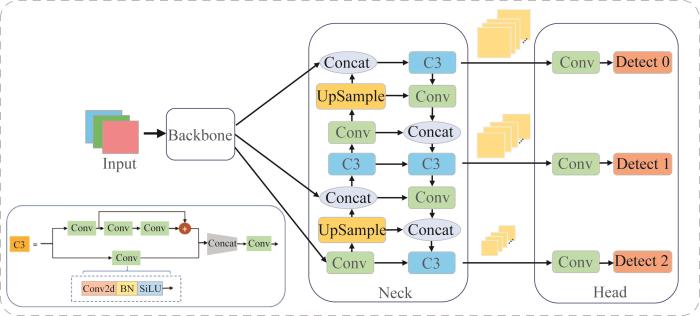

为使检测网络更加灵活地应对不同大小和比例的孔隙目标,在特征提取网络与检测网络头部之间引入一种自底向上和自顶向下的特征融合方法——PANet(path aggregation network,路径聚合网络)[28 ] ,用于融合多尺度的特征图,以确保每个特征图都包含不同尺寸目标的信息。结合YOLOv5s模型中的C3模块来增加网络的深度和感受野,以提高特征提取的能力。C3模块由多个Conv(convolution,卷积)模块组成,Conv模块用于对特征图进行升维或降维处理,包括卷积、归一化和非线性等操作,其采用残差结构,可将输入与输出相加,有效避免了梯度消失的问题。最终C3模块的两路结果联合后输入卷积核大小为1×1的Conv模块,以将通道数调整为输入时的通道数。多尺度特征融合检测的网络结构如图6 所示。

图6

图6

多尺度特征融合检测的网络结构

Fig.6

Network structure for multi-scale feature fusion detection

由图6 可知,该检测网络中的Neck部分先通过多个卷积层提取底层特征,并将其转换为高维特征表示,然后从高层特征图开始通过上采样来提高分辨率,并将其转换为相同维度的特征表示,最后采用多种路径聚合操作将不同层次的特征图(包括自底向上的特征和自顶向下的特征)聚合在一起,生成具有多尺度信息的特征金字塔。

R i , j = ∑ z = 1 p S i , j ( z ) • H i , j ( z ) , V i , j ( z ) (15)

S i , j ( z ) = σ W s ( z ) * H i , j ( z ) , V i , j ( z )

H i , j ( z ) = W h ( z ) * X i , j V i , j ( z ) = W v ( z ) * X i , j

式中:R i , j H i , j ( z ) V i , j ( z ) ( i , j ) W h ( z ) W v ( z ) W s ( z ) X i , j ( i , j ) σ

将多尺度特征融合结果输入检测头,并输出最终检测结果,包括界面孔隙的边界框坐标、类别置信度和类别标签。3种尺寸的特征图对应3个检测头,每个检测头分别负责不同尺寸的孔隙目标检测。

2 实验与分析

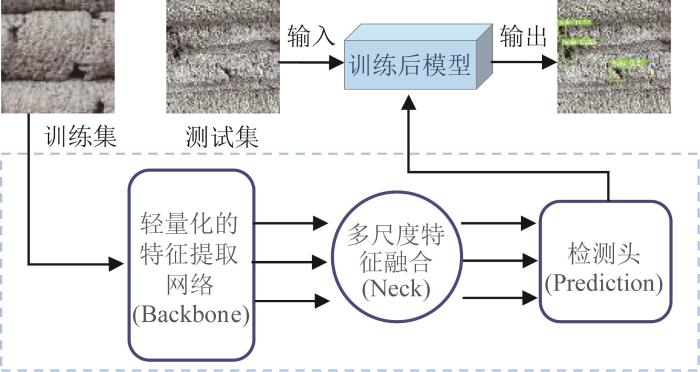

在3D打印混凝土界面孔隙检测实验中,使用精确率P 、召回率R 、平均精度均值(mean average precision, mAP)和F 1 得分等指标对算法进行性能评估。本文所提出方法的检测流程如图7 所示。首先,将实际采集到的3D打印混凝土界面孔隙图像的分辨率调整为(512×512)像素,并针对孔隙目标优化锚框;然后,将制作好的部分数据集输入所设计的检测模型进行训练,完成训练后输出训练权重;最后,利用测试集对训练好的模型进行验证。

图7

图7

3D 打印混凝土界面孔隙检测流程

Fig.7

3D printed concrete interface pore detection process

2.1 孔隙图像数据集

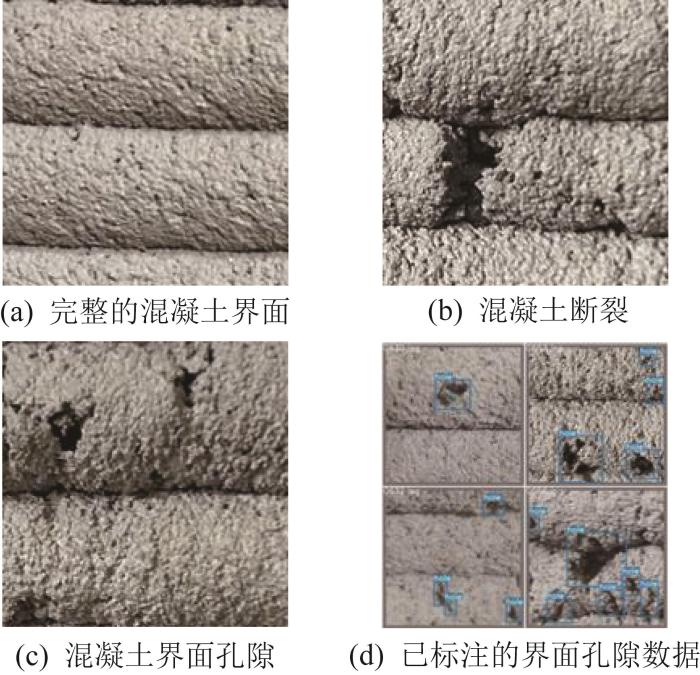

采用双目相机拍摄实际3D打印混凝土构件获得孔隙图像。为了确保孔隙图像数据集在模型训练时具有较好的适应性,在采集孔隙图像时多次改变拍摄角度,以从多个不同形状的3D打印混凝土构件上采集数据,并通过人工筛选去除重复率高的数据以及因打印设备遮挡而未完整采集的冗余数据。然后,对筛选后的孔隙图像进行数据增强,包括旋转、裁剪及分割等操作,并对图像进行人工标注,将标注后的孔隙图像数据随机划分为训练集和测试集,分别用于训练和测试3D打印混凝土界面孔隙检测模型。最终获得的数据集包含1 500张孔隙图像,按7∶3的比例划分训练集与测试集,图像分辨率均为(512×512)像素。部分孔隙图像数据如图8 所示。

图8

图8

3D 打印混凝土构件界面孔隙图像

Fig.8

Interface pore images of 3D printed concrete component

2.2 实验环境

本文实验在Ubuntu的操作平台中开展,具体实验环境配置如表1 所示。参数设定如下:训练总轮数为300,每一轮分为125个批次,每个批次所选取的孔隙图像数量为8张;置信度阈值为0.001;孔隙预测框与真实框的交并比为0.6。

2.3 实验结果与分析

2.3.1 锚框优化对比实验

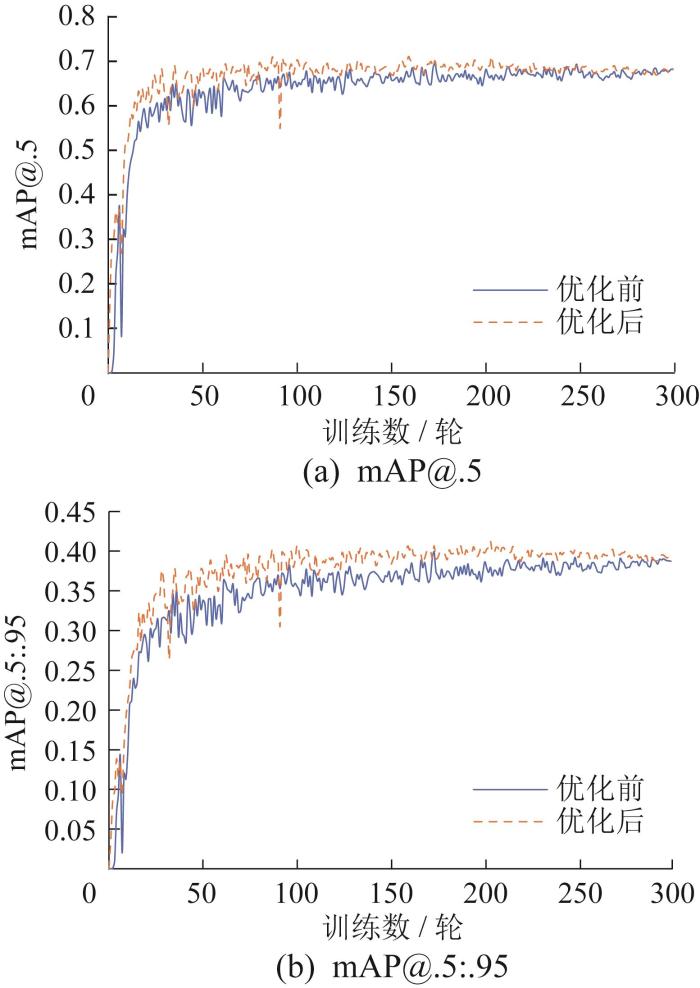

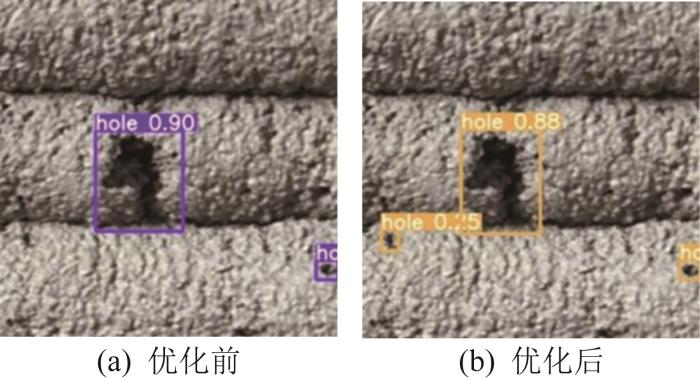

为分析使用K- means++聚类算法优化锚框对3D打印混凝土界面孔隙检测方法性能的影响,将K- means聚类算法与K- means++聚类算法分别应用到3D打印混凝土界面孔隙检测模型中进行对比,结果如表2 所示。表中:mAP@.5表示交并比设为0.50时的mAP;mAP@.5:.95表示交并比取不同阈值时(0.50~0.95,步长为0.05)的平均mAP。从表2 中可以发现,与K- means聚类算法相比,采用K- means++聚类算法重新计算锚框大小后检测模型的精度和效率均有所提升,其中P 值增长最为显著,增长了5.1%。由此说明,通过K- means++聚类算法可得到更合适样本目标的锚框大小,使得检测模型能够识别出更多的目标,整体性能得到提升。锚框优化前后检测模型的mPA可视化结果以及孔隙检测结果分别如图9 和图10 所示。由图10 可直观看出,在实际检测过程中,孔隙的漏检现象得到了一定程度的改善。

图9

图9

锚框优化前后的mAP 对比

Fig.9

Comparison of mPA before and after anchor box optimization

图10

图10

锚框优化前后的孔隙检测结果对比

Fig.10

Comparison of pore detection results before and after anchor box optimization

2.3.2 注意力机制对比实验

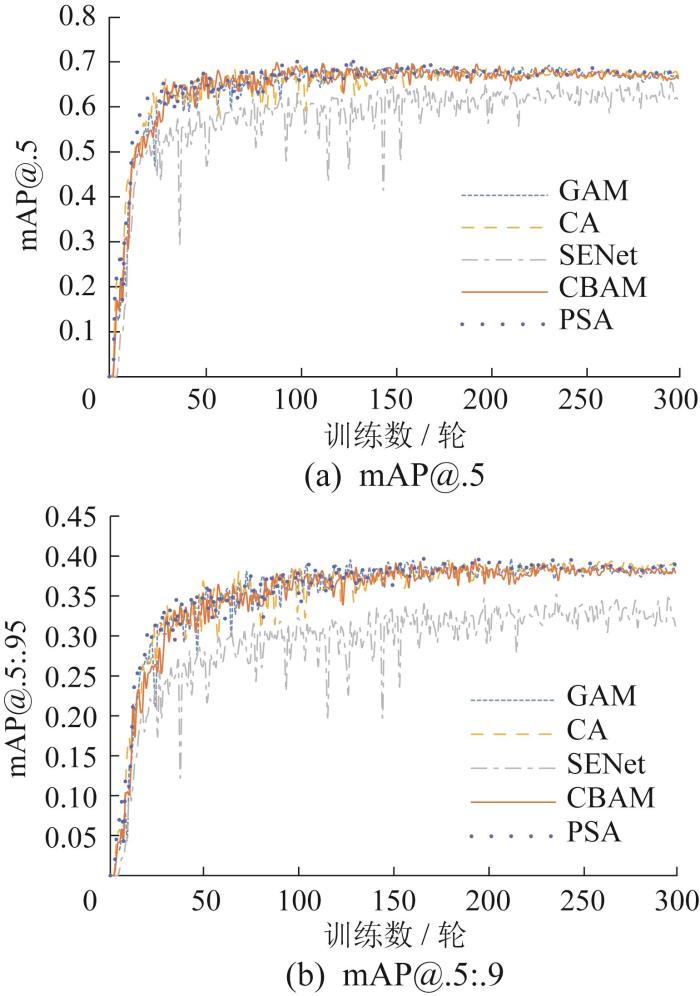

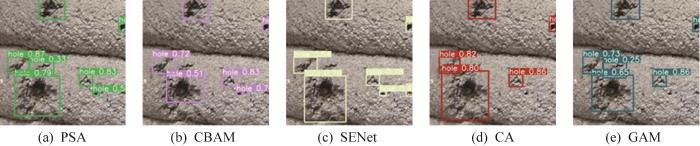

为验证所引入的PSA机制的优越性,在实验过程中将PSA与CBAM[29 ] 、SENet(squeeze and excitation networks,挤压激励网络)[30 ] 、CA(coordinate attention,坐标注意力)[31 ] 和GAM(global attention mechanism,全局注意力机制)[32 ] 等目前热门的注意力机制应用于3D打印混凝土界面孔隙检测模型后进行训练与测试,并对比融合不同注意力机制后检测模型的精度、召回率、mAP和F 1 得分等指标,结果如表3 所示,其中mAP的可视化结果如图11 所示。融合不同注意力机制的孔隙检测结果如图12 所示。

图11

图11

融合不同注意力机制的mAP 对比

Fig.11

Comparison of mPA with integrating different attention mechanisms

图12

图12

融合不同注意力机制的孔隙检测结果对比

Fig.12

Comparison of pore detection results with integrating different attention mechanisms

从表3 中可以看出,融合PSA与SENet的检测模型的F 1 得分远高于融合其他注意力机制的模型,但SENet网络很深,会额外增加大量参数,影响检测速度,这与本文所需的轻量化相悖。由图11 可以看出,融合PSA的检测模型在经过多轮训练后,其多个性能指标的数值略高于融合其他注意力机制的模型,而融合SENet的检测模型的性能指标远低于融合其他注意力机制的模型,且存在振幅较大的现象。由图12 可直观看出,相较于融合其他注意力机制的检测结果,融合PSA的孔隙检测准确率最高,且在孔隙分布密集区域检测中具有最佳表现。通过对比可知,PSA机制更适用于本文所提出的检测方法。

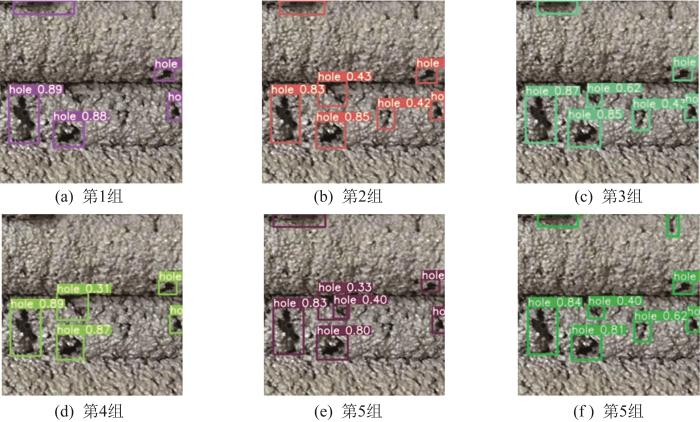

2.3.3 消融实验

为了更加直观地验证各个模块对检测结果的影响,本文进行了消融实验,共6组,每组实验对应一种模块组合,实验结果如表4 所示。其中:“√”表示使用这种模块,“×”表示不使用这种模块。

由表4 可知,第2组仅使用了锚框优化方法,使得检测模型的各项性能指标均明显提高,其中mAP@.5提高了2.5%,F 1 得分提高了3.3%;第3组使用轻量化ShuffleNetv2网络代替原有的C3模块进行特征提取,使得检测效率及精度大幅提升,其中F 1 得分提高了4.8%;第4组是在特征提取网络中融合了PSA机制模块,在增加孔隙关注度的同时提升了检测精度;第5组同时使用锚框优化方法和ShuffleNetv2网络,使得检测精度得到显著提升;第6组使用了所有模块,使得检测模型的性能达到最优,相比于原始模型,mAP@.5提高了11.4%,mAP@.5:.95提高了4.7%,F 1 得分提高了7.6%。综上所述,本文所提出的孔隙检测方法的精度和稳定性均较高。

为了进一步验证消融实验结果的可信度及本文所提出的孔隙检测方法的可行性,选取部分未参与过训练及测试的孔隙图像进行验证。各组对应的孔隙检测结果如图13 所示。从图13 中可以看出,只有第6组检测出右上角的裂缝,其余5组均存在不同程度的漏检。

图13

图13

各组消融实验对应的孔隙检测结果对比

Fig.13

Comparison of pore detection results corresponding to ablation experiments in each group

2.3.4 综合对比实验

为进一步验证本文所提出的检测方法(为方便比较和说明,下文简称Lite-3DPC)的优势,选取多种经典的目标检测算法进行综合对比实验,同时为了验证用轻量化ShuffleNetv2网络提取特征的有效性,还与其他轻量化网络GhostNet[33 ] 、MobileNetv3[34 ] 进行了对比,结果如表5 所示。由表5 可知,与经典的YOLOv5s算法相比,Lite-3DPC的多项性能指标均有所提升,尽管检测速度有所下降,但其检测精度远超前者;相较于YOLOv7与其他算法,Lite-3DPC的检测速度和精度均有较好表现,ShuffleNetv2网络在保证一定检测精度的同时可使检测速度达到最佳。

为验证本文所提出的检测方法的轻量化效果,采用参数量和浮点运算次数进行对比,可视化结果如图14 所示。由图14 可知,YOLOv7所需的计算资源最多,与本文轻量化要求不符;ShuffleNetv2具有最少的参数量和计算量,轻量化程度最佳,其次是Lite-3DPC,但Lite-3DPC的参数量仅高1.7×105 个,浮点运算数仅多2.0×108 次。同时,Lite-3DPC与其他算法相比,YOLOv5s的浮点运算次数多了约3倍,YOLOv7甚至多了18倍,但其检测精度远不如Lite-3DPC。由此可知,Lite-3DPC可在保证检测精度的同时不会因引入过多参数而影响检测速度,使得检测模型的规模较小,所需的计算资源较少,适合快速部署于嵌入式设备,以实现实际3D打印过程中的混凝土界面孔隙检测。综上,本文方法的检测效果优于多种经典的目标检测算法,在保持高效检测的情况下,可有效减少3D打印混凝土界面孔隙检测过程中的漏检情况。

图14

图14

不同算法的计算资源对比

Fig.14

Comparison of computing resources for different algorithms

3 结束语

1)本文提出了一种轻量级的3D打印混凝土界面孔隙智能检测方法。该方法基于现有YOLO算法的优势,结合轻量化ShuffleNetv2网络进行特征提取并融合了PSA机制,在减少模型参数量的同时增加了对小尺寸孔隙目标的关注度。同时,针对小尺寸孔隙检测效果不够理想的问题,对锚框计算方法进行了优化。经实验验证,本文所提出的方法具有较好的检测性能。

2)受实验样本数量的限制,本文方法的检测精度有限。随着后期打印实验及样本的扩增,本文方法的检测精度将得到进一步提高。未来,将针对所提出的检测方法进行深入研究与优化,并通过将其部署于混凝土3D打印设备来验证其在实际应用中的检测效果和可行性,旨在为提高3D打印混凝土建筑的力学性能提供参考。

参考文献

View Option

[1]

张大旺 , 王栋民 3D打印混凝土材料及混凝土建筑技术进展

[J]. 硅酸盐通报 , 2015 , 34 (6 ): 1583 -1588 .

[本文引用: 1]

ZHANG D W WANG D M Progress of 3D print of concrete materials and concrete construction technology

[J]. Bulletin of the Chinese Ceramic Society , 2015 , 34 (6 ): 1583 -1588 .

[本文引用: 1]

[2]

陈权要 , 周燕 , 周诚 混凝土3D打印的机器视觉检测研究现状与展望

[J]. 土木建筑工程信息技术 , 2023 , 15 (5 ): 1 -8 .

[本文引用: 2]

CHEN Q Y ZHOU Y ZHOU C The research status and prospect of machine vision inspection for 3D concrete printing

[J]. Journal of Information Technology in Civil Engineering and Architecture , 2023 , 15 (5 ): 1 -8 .

[本文引用: 2]

[3]

杨敏 , 来猛刚 , 窦艳宁 , 等 混凝土3D打印质量影响因素及控制方法

[J]. 混凝土与水泥制品 , 2021 (4 ): 11 -16 .

[本文引用: 1]

YANG M LAI M G DOU Y N et al Influencing factors and control measures of concrete 3D printing quality

[J]. China Concrete and Cement Products , 2021 (4 ): 11 -16 .

[本文引用: 1]

[4]

[本文引用: 1]

LIU H W LIU C BAI G L et al Experimental study on mechanical properties of 3D printed coarse aggregate concrete based on the pore structure defects

[J]. China Civil Engineering Journal , 2022 , 55 (12 ): 54 -64 .

DOI:10.1016/j.addma.2022.102843

[本文引用: 1]

[5]

王超 , 王川婴 , 王益腾 , 等 基于孔壁光学图像的岩石孔隙结构识别与分析方法研究

[J]. 岩石力学与工程学报 , 2021 , 40 (9 ): 1894 -1901 .

[本文引用: 1]

WANG C WANG C Y WANG Y T et al Research on identification and analysis method of rock pore structure based on optical images of borehole walls

[J]. Chinese Journal of Rock Mechanics and Engineering , 2021 , 40 (9 ): 1894 -1901 .

[本文引用: 1]

[6]

马宗方 , 杨兴伟 , 宋琳 , 等 基于层间信息熵的混凝土3D打印构件精细分割

[J]. 激光与光电子学进展 , 2022 , 59 (4 ): 101 -108 .

[本文引用: 1]

MA Z F YANG X W SONG L et al Fine segmentation of concrete 3D-printed elements based on information entropy between layers

[J]. Laser & Optoelectronics Progress , 2022 , 59 (4 ): 101 -108 .

[本文引用: 1]

[7]

陈雁 , 李祉呈 , 程超 , 等 FLU-net: 用于表征页岩储层微观孔隙的深度全卷积网络

[J]. 海洋地质前沿 , 2021 , 37 (8 ): 34 -43 .

[本文引用: 1]

CHEN Y LI Z C CHENG C et al FLU-net: a deep fully convolutional neural network for shale reservoir micro-pore characterization

[J]. Marine Geology Frontiers , 2021 , 37 (8 ): 34 -43 .

[本文引用: 1]

[8]

REN Y P HUANG J S HONG Z Y et al Image-based concrete crack detection in tunnels using deep fully convolutional networks

[J]. Construction and Building Materials , 2020 , 234 : 117367 .

[9]

LIANG H LEE S C SEO S UAV-based low altitude remote sensing for concrete bridge multi-category damage automatic detection system

[J]. Drones , 2023 , 7 (6 ): 386 .

[本文引用: 1]

[10]

苗新法 , 刘宝莲 , 李晓琴 , 等 改进YOLOv5s的铁轨裂纹目标检测算法

[J]. 计算机工程与应用 , 2024 , 60 (12 ): 216 -224 .

MIAO X F LIU B L LI X Q et al Improved YOLOv5s railway crack target detection algorithm

[J]. Computer Engineering and Applications , 2024 , 60 (12 ): 216 -224 .

[11]

ZHANG S H YANG H K YANG C H et al Edge device detection of tea leaves with one bud and two leaves based on ShuffleNetv2-YOLOv5-lite-E

[J]. Agronomy , 2023 , 13 (2 ): 577 .

[12]

WANG X F WU Z W JIA M et al Lightweight SM-YOLOv5 tomato fruit detection algorithm for plant factory

[J]. Sensors , 2023 , 23 (6 ): 3336 .

[13]

CAO M L FU H ZHU J Y et al Lightweight tea bud recognition network integrating GhostNet and YOLOv5

[J]. Mathematical Biosciences and Engineering , 2022 , 19 (12 ): 12897 -12914 .

[14]

ZHANG Y SUN Y P WANG Z et al YOLOv7-RAR for urban vehicle detection

[J]. Sensors , 2023 , 23 (4 ): 1801 .

[本文引用: 1]

[15]

REN S Q HE K M GIRSHICK R et al Faster R-CNN: towards real-time object detection with region proposal networks

[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence , 2017 , 39 (6 ): 1137 -1149 .

[本文引用: 1]

[16]

REDMON J DIVVALA S GIRSHICK R et al You only look once: unified, real-time object detection

[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition . Las Vegas, NV, Jun . 27 -30 , 2016 .

[本文引用: 1]

[17]

LIU W ANGUELOV D ERHAN D et al SSD: single shot MultiBox detector

[M]//Lecture Notes in Computer Science . Cham : Springer , 2016 : 21 -37 .

[本文引用: 1]

[18]

YAN J H ZHOU Z ZHOU D J et al Underwater object detection algorithm based on attention mechanism and cross-stage partial fast spatial pyramidal pooling

[J]. Frontiers in Marine Science , 2022 , 9 : 1056300 .

[本文引用: 1]

[19]

GAO G LEE S H Design and implementation of fire detection system using new model mixing

[J]. International Journal of Advanced Culture Technology , 2021 , 9 (4 ): 260 -267 .

[本文引用: 1]

[20]

JIANG K L XIE T Y YAN R et al An attention mechanism-improved YOLOv7 object detection algorithm for hemp duck count estimation

[J]. Agriculture , 2022 , 12 (10 ): 1659 .

[本文引用: 1]

[21]

ZHENG J F WU H ZHANG H et al Insulator-defect detection algorithm based on improved YOLOv7

[J]. Sensors , 2022 , 22 (22 ): 8801 .

[本文引用: 1]

[22]

TENG S LIU Z C LI X D Improved YOLOv3-based bridge surface defect detection by combining high-and low-resolution feature images

[J]. Buildings , 2022 , 12 (8 ): 1225 .

[本文引用: 1]

[23]

ZHANG Y X HUANG J CAI F H On bridge surface crack detection based on an improved YOLOv3 algorithm

[J]. IFAC-PapersOnLine , 2020 , 53 (2 ): 8205 -8210 .

[本文引用: 1]

[24]

WU P R LIU A R FU J Y et al Autonomous surface crack identification of concrete structures based on an improved one-stage object detection algorithm

[J]. Engineering Structures , 2022 , 272 : 114962 .

[本文引用: 1]

[25]

MA N N ZHANG X Y ZHENG H T et al ShuffleNet V2: practical guidelines for efficient CNN architecture design

[C]//European Conference on Computer Vision . Munich, Sep . 8 -14 , 2018 .

[本文引用: 1]

[26]

LIU H J LIU F Q FAN X Y et al Polarized self-attention: towards high-quality pixel-wise regression

[EB/OL]. (2021-07-08 ) [2024-01-20 ]. .

URL

[本文引用: 1]

[27]

YANG R J LI W F SHANG X N et al KPE-YOLOv5: an improved small target detection algorithm based on YOLOv5

[J]. Electronics , 2023 , 12 (4 ): 817 .

[本文引用: 1]

[28]

LIU S QI L QIN H F et al Path aggregation network for instance segmentation

[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition . Salt Lake City, UT, Jun . 18 -23 , 2018 .

[本文引用: 1]

[29]

WOO S , PARK J LEE J Y et al CBAM: convolutional block attention module

[C]//European Conference on Computer Vision . Munich, Sep . 8 -14 , 2018 .

[本文引用: 1]

[30]

HU J SHEN L SUN G Squeeze-and-excitation networks

[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition . Salt Lake City, UT, Jun . 18 -23 , 2018 .

[本文引用: 1]

[31]

HOU Q B ZHOU D Q FENG J S Coordinate attention for efficient mobile network design

[C]//2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition . Nashville, TN, Jun . 20 -25 , 2021 .

[本文引用: 1]

[32]

LIU Y C SHAO Z R HOFFMANN N Global attention mechanism: retain information to enhance channel-spatial interactions

[EB/OL]. (2021-12-10 ) [2024-01-20 ]. .

URL

[本文引用: 1]

[33]

HAN K WANG Y H TIAN Q et al GhostNet: more features from cheap operations

[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition . Seattle, WA, Jun . 13 -19 , 2020 .

[本文引用: 1]

[34]

HOWARD A SANDLER M CHEN B et al Searching for MobileNetv3

[C]//2019 IEEE/CVF International Conference on Computer Vision. Seoul, Oct. 27-Nov . 2 , 2019 .

[本文引用: 1]

3D打印混凝土材料及混凝土建筑技术进展

1

2015

... 3D打印混凝土技术是一种结合3D打印技术与商品混凝土领域技术的新型混凝土施工技术[1 ] ,通过自下而上层层堆积混凝土而成型.在实际建筑施工过程中,混凝土结构在多重因素影响下会出现变形、裂纹和孔隙等缺陷[2 ] ,造成宏观和微观上的不连续性,严重制约了其大规模的工业化生产与应用.其中,孔隙为最常见的缺陷,亟须开展相关检测方法研究[3 -4 ] . ...

3D打印混凝土材料及混凝土建筑技术进展

1

2015

... 3D打印混凝土技术是一种结合3D打印技术与商品混凝土领域技术的新型混凝土施工技术[1 ] ,通过自下而上层层堆积混凝土而成型.在实际建筑施工过程中,混凝土结构在多重因素影响下会出现变形、裂纹和孔隙等缺陷[2 ] ,造成宏观和微观上的不连续性,严重制约了其大规模的工业化生产与应用.其中,孔隙为最常见的缺陷,亟须开展相关检测方法研究[3 -4 ] . ...

混凝土3D打印的机器视觉检测研究现状与展望

2

2023

... 3D打印混凝土技术是一种结合3D打印技术与商品混凝土领域技术的新型混凝土施工技术[1 ] ,通过自下而上层层堆积混凝土而成型.在实际建筑施工过程中,混凝土结构在多重因素影响下会出现变形、裂纹和孔隙等缺陷[2 ] ,造成宏观和微观上的不连续性,严重制约了其大规模的工业化生产与应用.其中,孔隙为最常见的缺陷,亟须开展相关检测方法研究[3 -4 ] . ...

... 目前,3D打印混凝土孔隙检测以人工接触式检测为主,利用物理仪器和化学手段进行辅助,但人工检测具有较大的随机性、主观性和一定的安全隐患,且物理仪器及化学材料价格不菲,对混凝土强度和检测时间要求较高,实际操作时易导致检测结果不够准确.为实现混凝土孔隙的智能化检测,国内外学者利用具有“智慧之眼”之称的机器视觉技术开展了大量研究[2 ] .王超等[5 ] 利用传统图像处理算法实现了对岩石孔隙结构的连续定量分析.马宗方等[6 ] 设计了一种基于层间信息熵和双阈值优化的打印构件精细分割算法,实现了对3D打印混凝土构件的分层检测和精细分割,但在实际检测过程中,该算法需人工计算对应的分割阈值,且检测结果易受外界环境干扰,自动化、智能化程度不足. ...

混凝土3D打印的机器视觉检测研究现状与展望

2

2023

... 3D打印混凝土技术是一种结合3D打印技术与商品混凝土领域技术的新型混凝土施工技术[1 ] ,通过自下而上层层堆积混凝土而成型.在实际建筑施工过程中,混凝土结构在多重因素影响下会出现变形、裂纹和孔隙等缺陷[2 ] ,造成宏观和微观上的不连续性,严重制约了其大规模的工业化生产与应用.其中,孔隙为最常见的缺陷,亟须开展相关检测方法研究[3 -4 ] . ...

... 目前,3D打印混凝土孔隙检测以人工接触式检测为主,利用物理仪器和化学手段进行辅助,但人工检测具有较大的随机性、主观性和一定的安全隐患,且物理仪器及化学材料价格不菲,对混凝土强度和检测时间要求较高,实际操作时易导致检测结果不够准确.为实现混凝土孔隙的智能化检测,国内外学者利用具有“智慧之眼”之称的机器视觉技术开展了大量研究[2 ] .王超等[5 ] 利用传统图像处理算法实现了对岩石孔隙结构的连续定量分析.马宗方等[6 ] 设计了一种基于层间信息熵和双阈值优化的打印构件精细分割算法,实现了对3D打印混凝土构件的分层检测和精细分割,但在实际检测过程中,该算法需人工计算对应的分割阈值,且检测结果易受外界环境干扰,自动化、智能化程度不足. ...

混凝土3D打印质量影响因素及控制方法

1

2021

... 3D打印混凝土技术是一种结合3D打印技术与商品混凝土领域技术的新型混凝土施工技术[1 ] ,通过自下而上层层堆积混凝土而成型.在实际建筑施工过程中,混凝土结构在多重因素影响下会出现变形、裂纹和孔隙等缺陷[2 ] ,造成宏观和微观上的不连续性,严重制约了其大规模的工业化生产与应用.其中,孔隙为最常见的缺陷,亟须开展相关检测方法研究[3 -4 ] . ...

混凝土3D打印质量影响因素及控制方法

1

2021

... 3D打印混凝土技术是一种结合3D打印技术与商品混凝土领域技术的新型混凝土施工技术[1 ] ,通过自下而上层层堆积混凝土而成型.在实际建筑施工过程中,混凝土结构在多重因素影响下会出现变形、裂纹和孔隙等缺陷[2 ] ,造成宏观和微观上的不连续性,严重制约了其大规模的工业化生产与应用.其中,孔隙为最常见的缺陷,亟须开展相关检测方法研究[3 -4 ] . ...

基于孔结构缺陷的3D打印粗骨料混凝土力学性能试验研究

1

2022

... 3D打印混凝土技术是一种结合3D打印技术与商品混凝土领域技术的新型混凝土施工技术[1 ] ,通过自下而上层层堆积混凝土而成型.在实际建筑施工过程中,混凝土结构在多重因素影响下会出现变形、裂纹和孔隙等缺陷[2 ] ,造成宏观和微观上的不连续性,严重制约了其大规模的工业化生产与应用.其中,孔隙为最常见的缺陷,亟须开展相关检测方法研究[3 -4 ] . ...

基于孔结构缺陷的3D打印粗骨料混凝土力学性能试验研究

1

2022

... 3D打印混凝土技术是一种结合3D打印技术与商品混凝土领域技术的新型混凝土施工技术[1 ] ,通过自下而上层层堆积混凝土而成型.在实际建筑施工过程中,混凝土结构在多重因素影响下会出现变形、裂纹和孔隙等缺陷[2 ] ,造成宏观和微观上的不连续性,严重制约了其大规模的工业化生产与应用.其中,孔隙为最常见的缺陷,亟须开展相关检测方法研究[3 -4 ] . ...

基于孔壁光学图像的岩石孔隙结构识别与分析方法研究

1

2021

... 目前,3D打印混凝土孔隙检测以人工接触式检测为主,利用物理仪器和化学手段进行辅助,但人工检测具有较大的随机性、主观性和一定的安全隐患,且物理仪器及化学材料价格不菲,对混凝土强度和检测时间要求较高,实际操作时易导致检测结果不够准确.为实现混凝土孔隙的智能化检测,国内外学者利用具有“智慧之眼”之称的机器视觉技术开展了大量研究[2 ] .王超等[5 ] 利用传统图像处理算法实现了对岩石孔隙结构的连续定量分析.马宗方等[6 ] 设计了一种基于层间信息熵和双阈值优化的打印构件精细分割算法,实现了对3D打印混凝土构件的分层检测和精细分割,但在实际检测过程中,该算法需人工计算对应的分割阈值,且检测结果易受外界环境干扰,自动化、智能化程度不足. ...

基于孔壁光学图像的岩石孔隙结构识别与分析方法研究

1

2021

... 目前,3D打印混凝土孔隙检测以人工接触式检测为主,利用物理仪器和化学手段进行辅助,但人工检测具有较大的随机性、主观性和一定的安全隐患,且物理仪器及化学材料价格不菲,对混凝土强度和检测时间要求较高,实际操作时易导致检测结果不够准确.为实现混凝土孔隙的智能化检测,国内外学者利用具有“智慧之眼”之称的机器视觉技术开展了大量研究[2 ] .王超等[5 ] 利用传统图像处理算法实现了对岩石孔隙结构的连续定量分析.马宗方等[6 ] 设计了一种基于层间信息熵和双阈值优化的打印构件精细分割算法,实现了对3D打印混凝土构件的分层检测和精细分割,但在实际检测过程中,该算法需人工计算对应的分割阈值,且检测结果易受外界环境干扰,自动化、智能化程度不足. ...

基于层间信息熵的混凝土3D打印构件精细分割

1

2022

... 目前,3D打印混凝土孔隙检测以人工接触式检测为主,利用物理仪器和化学手段进行辅助,但人工检测具有较大的随机性、主观性和一定的安全隐患,且物理仪器及化学材料价格不菲,对混凝土强度和检测时间要求较高,实际操作时易导致检测结果不够准确.为实现混凝土孔隙的智能化检测,国内外学者利用具有“智慧之眼”之称的机器视觉技术开展了大量研究[2 ] .王超等[5 ] 利用传统图像处理算法实现了对岩石孔隙结构的连续定量分析.马宗方等[6 ] 设计了一种基于层间信息熵和双阈值优化的打印构件精细分割算法,实现了对3D打印混凝土构件的分层检测和精细分割,但在实际检测过程中,该算法需人工计算对应的分割阈值,且检测结果易受外界环境干扰,自动化、智能化程度不足. ...

基于层间信息熵的混凝土3D打印构件精细分割

1

2022

... 目前,3D打印混凝土孔隙检测以人工接触式检测为主,利用物理仪器和化学手段进行辅助,但人工检测具有较大的随机性、主观性和一定的安全隐患,且物理仪器及化学材料价格不菲,对混凝土强度和检测时间要求较高,实际操作时易导致检测结果不够准确.为实现混凝土孔隙的智能化检测,国内外学者利用具有“智慧之眼”之称的机器视觉技术开展了大量研究[2 ] .王超等[5 ] 利用传统图像处理算法实现了对岩石孔隙结构的连续定量分析.马宗方等[6 ] 设计了一种基于层间信息熵和双阈值优化的打印构件精细分割算法,实现了对3D打印混凝土构件的分层检测和精细分割,但在实际检测过程中,该算法需人工计算对应的分割阈值,且检测结果易受外界环境干扰,自动化、智能化程度不足. ...

FLU-net: 用于表征页岩储层微观孔隙的深度全卷积网络

1

2021

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

FLU-net: 用于表征页岩储层微观孔隙的深度全卷积网络

1

2021

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

Image-based concrete crack detection in tunnels using deep fully convolutional networks

0

2020

UAV-based low altitude remote sensing for concrete bridge multi-category damage automatic detection system

1

2023

... 现有的基于深度学习的主流目标检测网络的规模一般较为庞大,且涉及参数多,对硬件要求高,难以直接快速部署在3D打印设备上.为了实现快速检测,本文引入轻量级的ShuffleNetv2网络,作为3D打印混凝土界面孔隙特征提取网络,在减少参数量的同时提升检测速度[9 ] .同时,ShuffleNetv2网络支持多尺度的特征金字塔结构,可以更好地结合多尺度特征融合方法来提升检测小目标的能力,从而提高检测精度.ShuffleNetv2网络的结构如图2 所示.孔隙图像经特征提取网络提取后的不同尺寸特征图如图3 所示. ...

改进YOLOv5s的铁轨裂纹目标检测算法

0

2024

改进YOLOv5s的铁轨裂纹目标检测算法

0

2024

Edge device detection of tea leaves with one bud and two leaves based on ShuffleNetv2-YOLOv5-lite-E

0

2023

Lightweight SM-YOLOv5 tomato fruit detection algorithm for plant factory

0

2023

Lightweight tea bud recognition network integrating GhostNet and YOLOv5

0

2022

YOLOv7-RAR for urban vehicle detection

1

2023

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

Faster R-CNN: towards real-time object detection with region proposal networks

1

2017

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

You only look once: unified, real-time object detection

1

2016

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

SSD: single shot MultiBox detector

1

2016

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

Underwater object detection algorithm based on attention mechanism and cross-stage partial fast spatial pyramidal pooling

1

2022

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

Design and implementation of fire detection system using new model mixing

1

2021

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

An attention mechanism-improved YOLOv7 object detection algorithm for hemp duck count estimation

1

2022

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

Insulator-defect detection algorithm based on improved YOLOv7

1

2022

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

Improved YOLOv3-based bridge surface defect detection by combining high-and low-resolution feature images

1

2022

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

On bridge surface crack detection based on an improved YOLOv3 algorithm

1

2020

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

Autonomous surface crack identification of concrete structures based on an improved one-stage object detection algorithm

1

2022

... 针对传统图像处理算法检测时存在泛化性能不强、鲁棒性差且计算资源耗费量大的问题,众多学者通过引入具有多层次特征抽象归纳与知识发现能力的深度学习算法,开展目标检测技术研究并取得了一定成果[7 -14 ] .现阶段,基于深度学习的目标检测算法主要分为以Faster RCNN(region convolutional neural networks,区域卷积神经网络)[15 ] 为代表的两阶段检测算法和以YOLO[16 ] 、SSD(single shot multibox detector,单次多边框检测器)[17 ] 为代表的一阶段检测算法.上述算法均利用自动抽取的方式来提取样本中的隐藏特征,具有速度快、精度高的分类和预测优势.Yan等[18 ] 为解决模糊目标和小目标检测精度低的问题,通过融合跨阶段部分快速空间金字塔池化模块,提出了改进的YOLOv7模型,有效地提高了检测精度和实时性.Gao等[19 ] 利用YOLOv5和DeepSort的混合模型开展目标检测,改善了检测结果易出现假阳性的现象.Jiang等[20 ] 在YOLOv7算法的基础上引入多个CBAM(convolutional block attention module,卷积块注意力模块),用于增强网络的特征提取能力,以实现密集目标的实时检测.Zheng等[21 ] 通过优化锚框算法来生成更合适的目标检测框,并添加了坐标注意力机制和HorBlock模块,在增强有效特征的同时削弱无效特征,并使用SIoU(shape intersection over union,形状交并比)和焦点损失函数来加速模型收敛,以解决正负样本不平衡的问题.Teng等[22 ] 提出了一种基于改进YOLOv3的桥面缺陷检测网络,结合迁移学习和数据增强技术对YOLOv3进行改进,与YOLOv2和Faster RCNN相比,改进后的YOLOv3具有较高的检测效率.Zhang等[23 ] 结合YOLOv3、MobileNets和CBAM来检测桥梁表面损伤.Wu等[24 ] 在YOLOv4的基础上引入了修剪技术和Evo-Norm-S0结构,该改进算法能识别多种类型的混凝土损伤,与SSD300、YOLOv3和YOLO X-L算法相比,其检测精度更高且计算速度更快.综上所述,以YOLO为基础的改进算法在检测精度、速度和实时性方面具有很大优势,且具有较好的检测稳定性,但该类算法在3D打印混凝土界面孔隙检测领域尚未得到深入研究. ...

ShuffleNet V2: practical guidelines for efficient CNN architecture design

1

2018

... 根据3D打印混凝土界面孔隙检测的特点,在算法的选择及改进过程中均以检测精度和效率为主要考虑因素,本文从以下几个方面展开:1)构建3D打印混凝土界面孔隙图像数据集,针对特征提取阶段易丢失小目标特征信息的问题,对锚框计算方法进行优化,以生成更适合界面孔隙目标检测的锚框,从而降低孔隙漏检率;2)针对主流目标检测网络规模庞大、参数多及硬件要求高的问题,引入轻量化ShuffleNetv2网络[25 ] 来进行特征提取,在减少参数量的同时提升检测速度,以实现在混凝土3D打印设备中的快速部署;3)在特征提取网络中融合极化自注意力(polarized self-attention, PSA)机制[26 ] ,通过计算数据样本之间的位置关系来避免大维度空间中出现梯度消失或爆炸的问题,并在保持高分辨率的同时增强对孔隙有效特征的关注度,以提升检测精度.本文所提出的3D打印混凝土界面孔隙检测方法的网络结构如图1 所示. ...

Polarized self-attention: towards high-quality pixel-wise regression

1

... 根据3D打印混凝土界面孔隙检测的特点,在算法的选择及改进过程中均以检测精度和效率为主要考虑因素,本文从以下几个方面展开:1)构建3D打印混凝土界面孔隙图像数据集,针对特征提取阶段易丢失小目标特征信息的问题,对锚框计算方法进行优化,以生成更适合界面孔隙目标检测的锚框,从而降低孔隙漏检率;2)针对主流目标检测网络规模庞大、参数多及硬件要求高的问题,引入轻量化ShuffleNetv2网络[25 ] 来进行特征提取,在减少参数量的同时提升检测速度,以实现在混凝土3D打印设备中的快速部署;3)在特征提取网络中融合极化自注意力(polarized self-attention, PSA)机制[26 ] ,通过计算数据样本之间的位置关系来避免大维度空间中出现梯度消失或爆炸的问题,并在保持高分辨率的同时增强对孔隙有效特征的关注度,以提升检测精度.本文所提出的3D打印混凝土界面孔隙检测方法的网络结构如图1 所示. ...

KPE-YOLOv5: an improved small target detection algorithm based on YOLOv5

1

2023

... 3D打印混凝土技术具有独特的成型特点,在打印时易出现界面孔隙分布不均和尺寸大小不一的问题.在目标检测中,常用的锚框计算方法为K- means聚类算法,在COCO(common objects in context)数据集上利用该算法进行聚类来确定锚框大小[27 ] .COCO数据集以大中型目标为主,故在特征提取阶段易丢失小目标特征信息,而本文建立的3D打印混凝土界面孔隙图像数据集包含大量小目标,若直接使用K- means聚类算法确定锚框大小,则会导致检测方法无法准确检测较小孔隙或漏检.鉴于K- means++聚类算法能够自动确定聚类数量并增强检测框对小目标的关注度,本文使用K- means++聚类算法来确定孔隙图像数据集中目标样本的锚框大小,以确保对小孔隙目标的准确检测,在一定程度上降低检测误差. ...

Path aggregation network for instance segmentation

1

2018

... 为使检测网络更加灵活地应对不同大小和比例的孔隙目标,在特征提取网络与检测网络头部之间引入一种自底向上和自顶向下的特征融合方法——PANet(path aggregation network,路径聚合网络)[28 ] ,用于融合多尺度的特征图,以确保每个特征图都包含不同尺寸目标的信息.结合YOLOv5s模型中的C3模块来增加网络的深度和感受野,以提高特征提取的能力.C3模块由多个Conv(convolution,卷积)模块组成,Conv模块用于对特征图进行升维或降维处理,包括卷积、归一化和非线性等操作,其采用残差结构,可将输入与输出相加,有效避免了梯度消失的问题.最终C3模块的两路结果联合后输入卷积核大小为1×1的Conv模块,以将通道数调整为输入时的通道数.多尺度特征融合检测的网络结构如图6 所示. ...

CBAM: convolutional block attention module

1

2018

... 为验证所引入的PSA机制的优越性,在实验过程中将PSA与CBAM[29 ] 、SENet(squeeze and excitation networks,挤压激励网络)[30 ] 、CA(coordinate attention,坐标注意力)[31 ] 和GAM(global attention mechanism,全局注意力机制)[32 ] 等目前热门的注意力机制应用于3D打印混凝土界面孔隙检测模型后进行训练与测试,并对比融合不同注意力机制后检测模型的精度、召回率、mAP和F 1 得分等指标,结果如表3 所示,其中mAP的可视化结果如图11 所示.融合不同注意力机制的孔隙检测结果如图12 所示. ...

Squeeze-and-excitation networks

1

2018

... 为验证所引入的PSA机制的优越性,在实验过程中将PSA与CBAM[29 ] 、SENet(squeeze and excitation networks,挤压激励网络)[30 ] 、CA(coordinate attention,坐标注意力)[31 ] 和GAM(global attention mechanism,全局注意力机制)[32 ] 等目前热门的注意力机制应用于3D打印混凝土界面孔隙检测模型后进行训练与测试,并对比融合不同注意力机制后检测模型的精度、召回率、mAP和F 1 得分等指标,结果如表3 所示,其中mAP的可视化结果如图11 所示.融合不同注意力机制的孔隙检测结果如图12 所示. ...

Coordinate attention for efficient mobile network design

1

2021

... 为验证所引入的PSA机制的优越性,在实验过程中将PSA与CBAM[29 ] 、SENet(squeeze and excitation networks,挤压激励网络)[30 ] 、CA(coordinate attention,坐标注意力)[31 ] 和GAM(global attention mechanism,全局注意力机制)[32 ] 等目前热门的注意力机制应用于3D打印混凝土界面孔隙检测模型后进行训练与测试,并对比融合不同注意力机制后检测模型的精度、召回率、mAP和F 1 得分等指标,结果如表3 所示,其中mAP的可视化结果如图11 所示.融合不同注意力机制的孔隙检测结果如图12 所示. ...

Global attention mechanism: retain information to enhance channel-spatial interactions

1

... 为验证所引入的PSA机制的优越性,在实验过程中将PSA与CBAM[29 ] 、SENet(squeeze and excitation networks,挤压激励网络)[30 ] 、CA(coordinate attention,坐标注意力)[31 ] 和GAM(global attention mechanism,全局注意力机制)[32 ] 等目前热门的注意力机制应用于3D打印混凝土界面孔隙检测模型后进行训练与测试,并对比融合不同注意力机制后检测模型的精度、召回率、mAP和F 1 得分等指标,结果如表3 所示,其中mAP的可视化结果如图11 所示.融合不同注意力机制的孔隙检测结果如图12 所示. ...

GhostNet: more features from cheap operations

1

2020

... 为进一步验证本文所提出的检测方法(为方便比较和说明,下文简称Lite-3DPC)的优势,选取多种经典的目标检测算法进行综合对比实验,同时为了验证用轻量化ShuffleNetv2网络提取特征的有效性,还与其他轻量化网络GhostNet[33 ] 、MobileNetv3[34 ] 进行了对比,结果如表5 所示.由表5 可知,与经典的YOLOv5s算法相比,Lite-3DPC的多项性能指标均有所提升,尽管检测速度有所下降,但其检测精度远超前者;相较于YOLOv7与其他算法,Lite-3DPC的检测速度和精度均有较好表现,ShuffleNetv2网络在保证一定检测精度的同时可使检测速度达到最佳. ...

Searching for MobileNetv3

1

2

... 为进一步验证本文所提出的检测方法(为方便比较和说明,下文简称Lite-3DPC)的优势,选取多种经典的目标检测算法进行综合对比实验,同时为了验证用轻量化ShuffleNetv2网络提取特征的有效性,还与其他轻量化网络GhostNet[33 ] 、MobileNetv3[34 ] 进行了对比,结果如表5 所示.由表5 可知,与经典的YOLOv5s算法相比,Lite-3DPC的多项性能指标均有所提升,尽管检测速度有所下降,但其检测精度远超前者;相较于YOLOv7与其他算法,Lite-3DPC的检测速度和精度均有较好表现,ShuffleNetv2网络在保证一定检测精度的同时可使检测速度达到最佳. ...