变电站主配网关键设备运行状态的检测与分析是电网运行维护的重要工作之一。随着国内特别是经济发展前沿城市用电量的快速增加,变电站分布愈加复杂。变电站数量的快速上升导致设备检修人员严重短缺,且变电站设备故障率较高,元器件更换成本极高[1 ] 。在这种背景下,无人巡检机器人成为电力智能故障诊断系统的重要组成部分,有效地减少了人力需求,提高了检测效率。巡检机器人配备多模态图像传感器,可捕捉电力设备运行状态下的可见光图像和红外图像;同时,可在机器人拍摄死角位置增加人工手持式设备,以完善对整个变电站主配网设备的全面监测[2 ] 。上述基于计算机视觉的自动化故障识别系统大多采用多模态图像传感器和图像配准、识别等图像处理技术,并由计算机处理数据以形成反馈。

多模态图像配准作为图像融合、目标检测等技术应用的关键前提,是实现电力设备高精度和高鲁棒性检测的重要基础[3 ] 。多模态图像配准是通过使用某种算法与评估标准,将同一场景中不同分辨率、视角下的一幅或多幅图像(或局部)最优映射到目标图像上。可见光图像具有丰富的细节纹理信息,而红外图像不受光照影响,其低对比度、低信噪比特性能够减少外界环境干扰对图像非均匀性的影响。因此,对电力设备的可见光图像与红外图像进行配准,可以丰富单幅图像中温度、结构等语义信息,为后续图像融合、图像识别等技术的应用奠定基础。

可见光图像与红外图像的成像原理差异较大,导致传统单模态图像配准方法的效果较差。此外,2种图像之间存在不同比例的相对平移、旋转和缩放,导致配准难度较大。目前,可见光图像与红外图像的配准方法主要包括基于区域、基于特征和基于深度学习三类[4 ] 。

基于区域的配准方法以参考图像为基础,通过极大化置信度指标来搜索待配准图像的最佳选择,同时将相似度作为待配准图像之间的相关性指标,并通过类似傅里叶变换在空间域或频域中展开。在空间域中,以互相关、互信息为代表的相关性在当下运用较多。Yang等[5 ] 在不同光谱图像配准中引入归一化互相关思想,对不同模态的2幅图像对应块的相似性进行了计算。在频域中,基于傅里叶变换对多模态图像进行类相关计算,并通过比较边缘表示下频域内的互相关性来进行配准是应用较多的方法之一。

基于特征的配准方法是一种通过定义损失作为相似度并不断迭代优化损失来寻找特征匹配最优解的方法。常用的图像特征包括区域、边缘和角点等。通过将多模态图像特征进行像素级的展开并进行语义表示,转化为数学计算关系后基于相似度判断准则定义图像之间的匹配关系[6 ] 。常用的特征表示信息包括特征描述符、特征向量和区域灰度值等。根据相同采集点位下多模态图像特征表示信息的不同特性,选取合适的几何变换关系即可实现最佳配准。

基于深度学习的配准方法通过深度网络模型对可见光图像与红外图像进行统一模态映射,以将其集中在一个新的置信度空间内,并利用神经网络对输入的多模态图像进行特征提取与相似度检测,以实现图像的配准。在配准过程中,定义损失函数并在神经网络训练中不断迭代,以改善多模态图像之间的映射关系,最终得到最优的配准结果[7 ] 。

以上3种配准方法在过去几年内得到了广泛的关注和应用,但电力设备的可见光图像与红外图像配准仍存在巨大挑战:第一,图像分辨率不同导致图像像素块之间的特征映射关系存在差异,造成匹配点不准确;第二,受环境条件变化的影响,可见光图像中可能存在相邻区域灰度差异较大的情况,导致特征点匹配过程中相似度差异较大[8 ] ;第三,巡检机器人不同拍摄视角导致的主方向定位误差会对图像配准造成不同程度的影响。

为解决上述问题,本文使用一种基于电力设备边缘点特征不变性的配准方法来进行可见光图像与红外图像的配准。首先,基于Canny边缘检测算法对电力设备的可见光图像与红外图像进行边缘划分,并通过设置阈值确定区域关键边缘特征;然后,基于尺度不变特征变换(scale invariant feature transform, SIFT)算法构建边缘特征关键点描述符并进行双边特征描述符匹配,通过计算最佳匹配点与次佳匹配点的距离,以去除明显错误的匹配,从而实现可见光图像与红外图像的配准。最后,通过变电站主网一次设备可见光图像与红外图像的配准应用来验证本文所提出方法的有效性。

1 可见光图像与红外图像的边缘特征检测

边缘检测是图像处理、分析领域的重要环节。图像边缘是指图像局部区域亮度显著变化的部分,该区域的灰度剖面可看作是一个阶跃,即从一个灰度值很小的缓冲区域急剧变化到另一个灰度相差较大的区域。传统的边缘检测算子,如Roberts、Sobel、Prewitt、Kirsch和Laplacian等算子,均是基于梯度方向导数的卷积算子,对噪声的高敏感性导致其在处理实际图像尤其是高噪声图像时效果并不理想[9 ] 。1986年,Canny提出了边缘检测算子的三大准则(单边缘响应准则、信噪比准则和定位精度准则)并提出了Canny边缘检测算法[10 ] 。

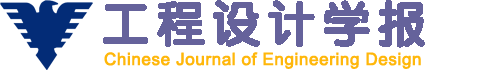

Canny边缘检测算法不仅能快速找到图像中真实的边缘位置,还能准确地区分边缘与噪声,具备较低的检测错误率。此外,Canny边缘检测算法可将边缘定位在一个像素点上,而非像其他算法一样将边缘模糊成线条或区域,这对于本文所研究的电力场景具有较高的适应性。基于此,本文将使用Canny边缘检测算法对变电站主配网关键设备的显著边缘特征进行检测。具有对应关系的变电站主网一次设备的可见光图像与红外图像如图1 所示。

图1

图1

变电站主网一次设备的可见光图像与红外图像

Fig.1

Visible image and infrared image of primary equipment of substation main network

1.1 基于高斯滤波器的图像平滑处理

通常情况下,边缘检测的目的是在保留原始图像属性的同时显著减小图像的数据规模[11 ] 。Canny边缘检测是一种采用多级边缘检测技术的算法,旨在通过高斯滤波器对多模态图像进行区域平滑处理,以达到最佳的边缘检测效果。该方法通过计算信噪比与定位精度的最优乘积来捕捉图像中最为显著的边缘特征。

高斯滤波器是一种线性平滑滤波器,利用高斯函数弱化图像噪声并柔化细节。高斯滤波器的卷积核为二维高斯函数的离散近似。在图像处理领域,二维高斯函数可定义为:

G x , y , σ = 1 2 π σ 2 e x p - x 2 + y 2 2 σ 2 (1)

式中:G x , y , σ x , y σ σ σ

∇ G = ∂ G / ∂ x ∂ G / ∂ y (2)

将∇ G

∂ G ∂ x = k x e x p - x 2 2 σ 2 e x p - y 2 2 σ 2 = h 1 x h 2 y (3)

∂ G ∂ y = k y e x p - y 2 2 σ 2 e x p - x 2 2 σ 2 = h 1 y h 2 x (4)

式中:k h 1 x h 1 y x y h 2 x h 2 y x y

1.2 梯度幅值和梯度方向的计算

在完成对原始多模态图像的编码后,为确保图像中电力设备边缘特征序列中每一条信息的长度均相同,对数据进行特征缩放。

Canny边缘检测算法采用2×2邻域一阶偏导的有限差分方法,来计算平滑处理后边缘特征序列中各像素点的梯度幅值和梯度方向。其中,像素点x , y x y

P x x , y = I x , y + 1 - I x , y + I x + 1 , y + 1 - I x + 1 , y 2 (5)

P y x , y = I x , y - I x + 1 , y + I x , y + 1 - I x + 1 , y + 1 2 (6)

式中:P x x , y P y x , y x y I x , y x , y

运用将直角坐标转换为极坐标的坐标变换公式,对多模态图像中的像素点进行梯度幅值和梯度方向的计算。其中,梯度幅值M x , y

M x , y = P x 2 x , y + P y 2 x , y (7)

θ x , y = a r c t a n P y x , y / P x x , y (8)

1.3 非极大值抑制

在获得了多模态图像中像素点的梯度幅值和梯度方向后,为实现对图像边缘的精确定位,需要对梯度幅值M x , y

本文采用(3×3)像素的局部邻域,将该邻域的360°区域均匀地分为12个方向的子邻域。对梯度幅值阵列中的所有像素点进行梯度幅值的插值,即在每个像素点处,与沿其梯度方向的2个梯度幅值进行插值比较。以局部邻域的中心像素点为基准,将12个方向的子邻域表示为δ x , y δ x , y N x , y

N x , y = N M S M x , y , δ x , y (9)

1.4 基于双阈值的图像边缘确定

在完成非极大值抑制后,当前获取的边缘图像内已存在图像的强边缘,但仍可能存在一些由真实图像或图像噪音产生的虚边缘。因此,通过设置双阈值与当前边缘像素点的梯度幅值进行比较,以判断边缘属性。若当前边缘像素点的梯度幅值大于或等于高阈值,则将当前边缘像素点标记为强边缘并保留;若当前边缘像素点的梯度幅值介于高阈值与低阈值之间,则将当前边缘像素点标记为虚边缘且同样保留;若当前边缘像素点的梯度幅值小于或等于低阈值,则抑制当前边缘像素点,即需要舍弃。对于保留的虚边缘,通过判断虚边缘与强边缘是否连接来确定虚边缘最终是否需要保留。若虚边缘与强边缘连接,则将此虚边缘视作强边缘处理,否则视作虚边缘并进行抑制。

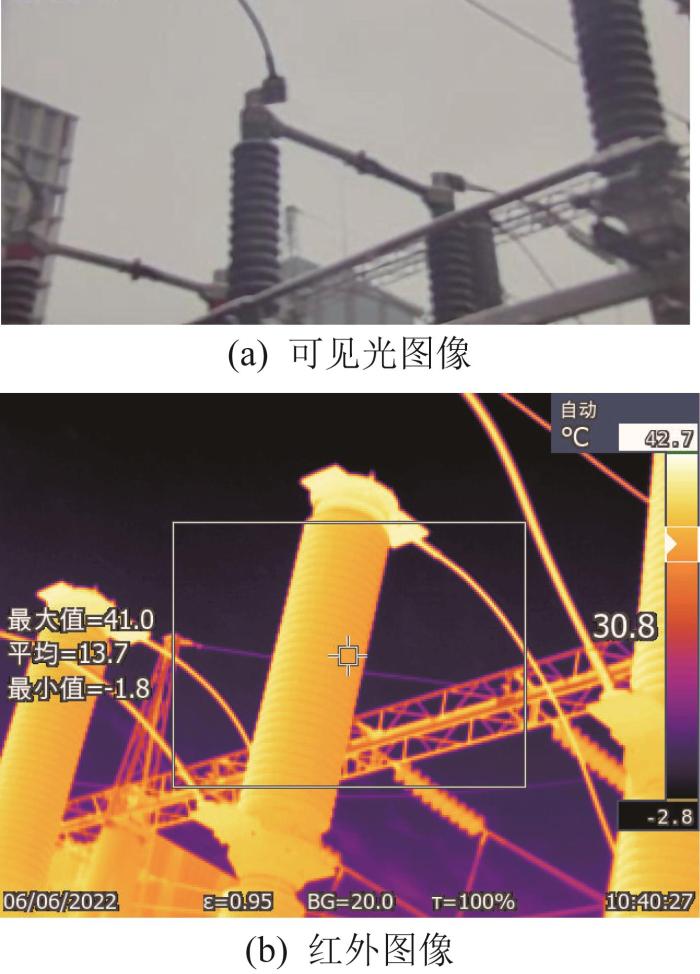

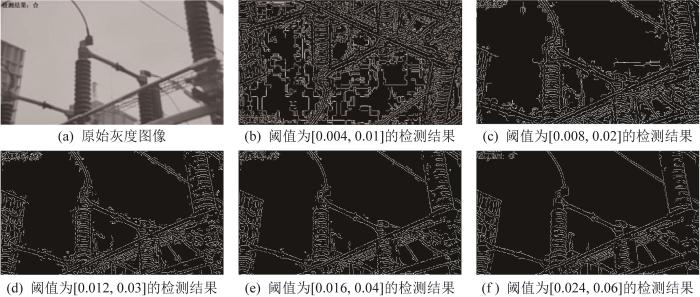

具体而言,对经过非极大值抑制和梯度直方图分类的边缘图像N x , y ∂ l ∂ h C l x , y C h x , y C h x , y C l x , y C h x , y 图2 和图3 所示。

图2

图2

基于不同阈值的可见光图像边缘检测结果

Fig.2

Edge detection results of visible image based on different thresholds

图3

图3

基于不同阈值的红外图像边缘检测结果

Fig.3

Edge detection results of infrared image based on different thresholds

由图2 和图3 结果可知,基于不同阈值的图像边缘检测结果存在较大差异,选择局部关键特征保留较为清晰且噪声较少的边缘检测结果,即阈值为0.024 , 0.06

2 基于SIFT 的多模态图像配准

SIFT算法在计算机视觉领域扮演着不可或缺的角色,其独特之处在于全面性和通用性[12 ] 。首先,SIFT算法能够在多尺度下提取特征,这说明其可兼顾物体的微小细节和整体结构。无论物体是处于图像中的近处还是远处位置,利用SIFT算法均能捕捉到关键特征。其次,SIFT算法具备多方向性,能够应对物体在图像中因旋转角度不同而导致的映射关系识别困难的情况,故其具有强大的目标识别和图像匹配能力[13 ] 。最后,SIFT算法还能够处理光照变化所导致的图像特征异常表示问题,这意味着在不同光照条件下SIFT算法均能正确地匹配特征点,不易受光照变化的干扰。

SIFT算法的优势不仅在于其特征提取能力,还在于其独有的特征描述方法。SIFT特征向量包含特征点周围区域的关键信息,这可使特征点之间的匹配更为精确,减少了误匹配的可能性。除了适用于处理静态图像外,SIFT算法还适用于动态场景中的图像处理,这可为物体跟踪和三维重建提供可靠的理论基础[14 ] 。此外,SIFT算法在机器视觉和自动驾驶等领域也发挥着关键作用,为实现自主导航和环境感知提供了重要支持。综上所述,SIFT算法不仅具有优异的特征提取和描述能力,还适用于各种复杂环境,可为基于视觉识别的图像处理提供坚实的基础。

2.1 面向多模态图像的尺度空间构建

尺度空间构建的主要思路是利用不同尺度下的高斯模糊来模拟图像中不同大小的特征,并通过计算高斯差分来寻找局部极值点,这些局部极值点通常对应图像中的关键点。随后,通过进一步处理来提取关键点的描述符,实现尺度不变性和旋转不变性[15 ] 。

在完成对多模态图像的Canny边缘检测后,通过对边缘特征显著的图像进行多次高斯模糊来构建不同尺度下的高斯金字塔,高斯金字塔的每一层构成一个尺度,保证了SIFT算法对于不同大小的特征具有尺度不变性。其中,高斯模糊是通过高斯函数和卷积图像来构建的。将尺度空间定义为二维高斯函数G x , y , σ F x , y

L x , y , σ = G x , y , σ * F x , y (10)

高斯差分函数表示不同尺度下的图像差异,计算高斯金字塔中每相邻2层图像的差分,得到差分图像,可表示为:

D o G x , y , σ = G x , y , b σ - G x , y , σ (11)

高斯金字塔是通过不断下采样生成的,每一层均包含上一层的下采样图像,即:

S m a l l e r I m a g e x , y , σ = O r g i n a l I m a g e 2 x , 2 y , σ (12)

式中:S m a l l e r I m a g e x , y , σ O r g i n a l I m a g e x , y , σ

完成高斯金字塔的构建后,利用高斯差分函数建立高斯差分金字塔,用于检测多模态图像中的关键点。

2.2 图像边缘特征关键点检测

利用式(11)计算得到不同尺度下的高斯差分图像D o G x , y , σ

D o G x , y , σ > D o G x - 1 , y , σ a n d D o G x , y , σ > D o G x + 1 , y , σ (13)

D o G x , y , σ > D o G x , y - 1 , σ a n d D o G x , y , σ > D o G x , y + 1 , σ (14)

D o G x , y , σ > D o G x , y , σ - 1 a n d D o G x , y , σ > D o G x , y , σ + 1 (15)

为了准确定位关键点,须对初始关键点进行亚像素级别的精确定位,使用式(1)来近似关键点周围的图像区域并形成拟合模型,拟合模型的极值点即为关键点的精确位置。

在确定关键点的位置之后,利用Hessian矩阵来计算关键点的稳定性或误差。Hessian矩阵包含拟合模型的二阶导数信息,其特征值体现关键点周围的局部图像结构。若Hessian矩阵的特征值比较接近,则说明图像区域比较均匀,关键点位置比较稳定。Hessian矩阵H x , y

H x , y = D x x x , y D x y x , y D x y x , y D y y x , y (16)

式中:D x x x , y D x y x , y D y y x , y

2.3 图像边缘特征关键点主方向分配

在完成多模态图像边缘特征关键点的准确检测后,根据关键点处的梯度信息定义其主方向。首先,在关键点周围的局部图像区域内计算梯度信息,通常使用Sobel等算子来计算关键点周围局部邻域内每个像素点的梯度幅值和梯度方向。随后,按照梯度方向将关键点周围的像素点分布到一个方向直方图中,直方图通常被分成36个或更多的方向区间,以覆盖360°的方向范围[13 ,16 ] 。本文选择具有最大梯度幅值的方向作为关键点的主方向,即对应方向直方图中的最大峰值。

关键点主方向分配的主要目的是尽量避免多模态图像角度差异所导致的边缘特征关键点映射关系混乱的情况,以保证SIFT算法能够在不同旋转角度下正确匹配关键点,强化了多模态图像边缘特征的旋转不变性,从而提高特征匹配的准确性。这一步骤使得SIFT算法在复杂场景和不同视角下仍能够可靠地识别相同的边缘特征关键点。

2.4 图像边缘特征关键点描述符构建

在关键点周围确定以关键点为中心的圆形关键区域,并计算区域内每个像素点的梯度幅值和梯度方向。这些关键区域内的梯度信息用于构建包含梯度方向和梯度幅值直方图的特征向量,特征向量的维度通常为128维[17 ] 。

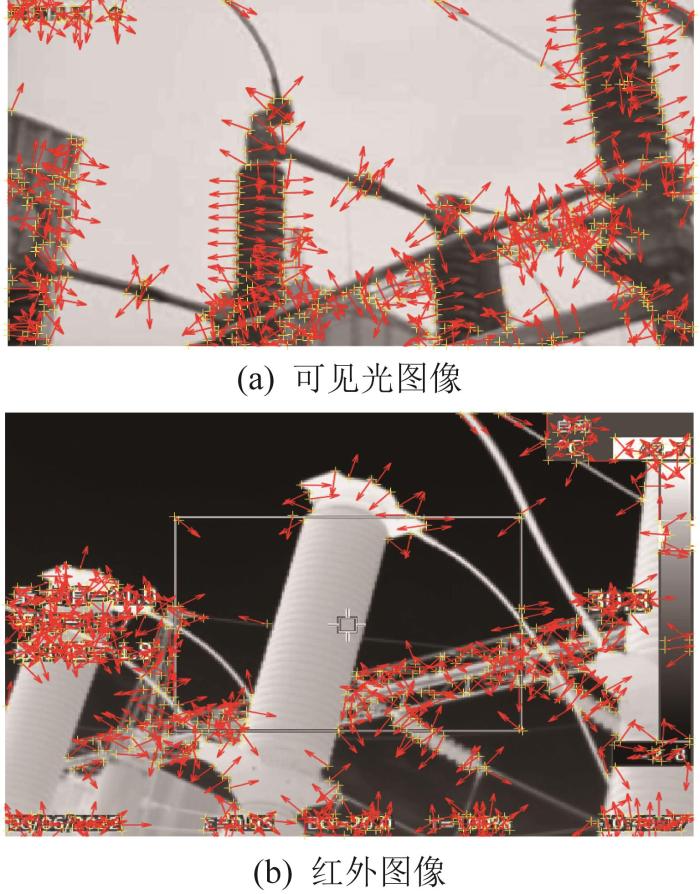

将特征向量中的梯度方向进行方向加权计算,以确保特征描述的旋转不变性。本文通过将每个梯度方向分配到最近的主方向来实现梯度方向向主方向的旋转操作,形成多模态图像边缘特征关键点的描述符,增加了特征的鲁棒性。同时,对特征向量进行归一化处理,以保证特征向量不受尺度变化的影响。此外,为了降低计算和存储成本,对特征向量进行排序并保留前N 个最大值。根据经验,通常取N =8[18 ] 。变电站主网一次设备可见光图像与红外图像中边缘特征关键点描述符的分布情况如图4 所示。

图4

图4

可见光图像与红外图像边缘特征关键点描述符的分布情况

Fig.4

Distribution of edge feature keypoint descriptors for visible image and infrared image

2.5 图像边缘特征关键点匹配

关键点匹配的目标是找到多模态图像之间具有相似特征的关键点对,通过梯度图像对齐策略使关键点在不同尺度、旋转和光照条件下仍能具有较高的匹配鲁棒性[19 ] 。

对多模态图像之间的所有关键点进行逐点比较并计算关键点之间的距离,将其作为多模态图像之间相似性的评价指标。本文采用欧式距离,其计算式如下:

D V i , V v = ∑ V i w - V v w 2 (17)

式中:D V i , V v 为 V i V v 分别 为 w 为

在完成所有关键点对距离的计算后,找到距离最小的一对关键点,即为最佳匹配点,可表示为:

B e s t M a t c h : a r g m i n D V i , V v (18)

在某些情况下,最佳匹配点可能不够可靠,将其距离与次佳匹配点的距离进行比较,若两者间的差异较大,则证明最佳匹配点的映射关系是可靠的。该过程通过计算最佳匹配点与次佳匹配点之间的距离比R 来实现,若两者的距离比R < 0.8 ,则说明最佳匹配点可接受[20 -21 ] 。

R = D V i b , V v b D V i s , V v s (19)

式中:V i b V i s V v b V v s

3 实验验证

本文实验在Windows11操作系统上开展,GPU(graphics processing unit,图像处理器)为NVIDIA GeForce RTX 3060。使用MATLAB软件搭建实验环境。电力设备多模态图像数据来自国网浙江省电力有限公司杭州供电公司下属祥符变电站的可见光图像与红外图像数据库。其中,可见光图像与红外图像存在分辨率、视角条件上的差异。下文将针对不同条件下的多模态图像进行配准测试,以验证所提出配准算法的有效性。

3.1 图像配准算法的评价指标

配准算法的鲁棒性是影响其应用性能的重要因素。在本文中,以可重复性作为配准算法性能的评价指标。将可重复性r 定义为在可见光图像与红外图像中同时检测到的边缘特征关键点数量与仅在可见光图像中检测到的边缘特征关键点数量的比值,计算式如下:

r = p | p ∈ Y v ⋂ Y i p | p ∈ Y v (20)

式中:Y v 、Y i 分别为可见光图像与对应红外图像中边缘特征关键点的集合。

均方根误差(root mean square error, RMSE)是评估配准算法准确性的重要指标,其值越小,表示多模态图像的配准效果越好。RMSE的定义如下:

E R M S = 1 n ∑ h = 1 n x i h - x v h 2 + y i h - y v h 2 (21)

式中:E R M S x i h y i h x v h y v h n

正确匹配率R c R r

R c = N c N a l l × 100 % (22)

R r = N c N m i n × 100 % (23)

式中:N c N a l l 为 N m i n

为验证本文配准算法的有效性,与快速鲁棒特征(speed up robust feature, SURF)算法和曲率尺度空间(curvature scale space, CSS)算法进行对比。选择不同视角下具有不同分辨率的红外图像与可见光图像进行配准并对比不同配准算法的准确性。其中,红外图像的分辨率为(640× 480 )像素,可见光图像的分辨率为(840× 424 )像素。

3.2 实验结果

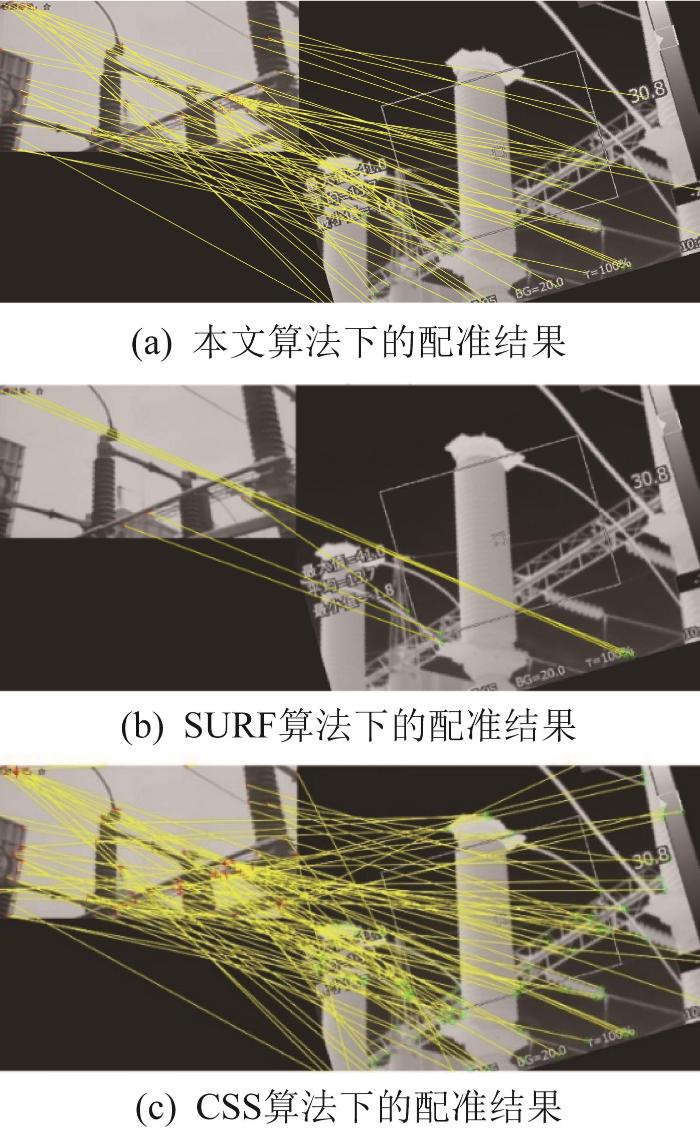

对不同视角下具有不同分辨率的可见光图像与红外图像的边缘特征关键点描述符进行双边匹配,不同算法下的配准结果如图5 所示。

图5

图5

不同算法下可见光图像与红外图像的配准结果

Fig.5

Registration results of visible image and infrared image under different algorithms

观察图5 结果可知,对于不同视角、分辨率条件下可见光图像与红外图像的配准,基于本文算法的关键点匹配数量最多且正确匹配率最高,即配准结果最佳;基于SURF算法的关键点匹配数量极少,特征覆盖率较低;而基于CSS算法的关键点错误匹配数量较多,存在大量错误匹配和冗余匹配。为进一步验证本文算法的优越性,基于同一位置的可见光图像与红外图像的配准结果进行统计分析,计算不同算法的评价指标并进行比较,结果如表1 所示。

由表1 可知,相较于SURF和CSS算法,本文算法在4个指标上均具有较大提升,即其准确率和鲁棒性更高。相较于SURF算法,本文算法的r E R M S R c R r r E R M S R c R r

4 结 论

本文利用Canny边缘检测算法和SIFT算法相结合的方式,使用一种具有尺度不变性的多层次边缘特征关键点描述符作为匹配依据,对不同视角、分辨率条件下的多模态图像进行双边匹配,研究方法及结果如下。

1)通过设置不同的阈值,确定了Canny边缘检测算法下最适用于变电站主配网关键设备多模态图像的边缘检测阈值,并提取了精确的边缘特征。

2)基于SIFT算法分别提取了可见光图像与红外图像的边缘特征关键点描述符,保证多模态图像在不同分辨率、视角条件下的尺度空间不变性,并根据边缘特征关键点描述符的主方向进行双边匹配,实现了多源异构多模态图像的准确配准。

3)通过多模态图像配准实验以及与传统SURF算法和CSS算法的对比分析,验证了本文算法的有效性和优越性。

未来,笔者将对多模态图像双边匹配条件进行优化,并应用含更多影响因素的复杂场景进行测试,以进一步验证本文所提出的配准方法的可行性与有效性。同时,对可见光图像与红外图像进行进一步融合,结合图像丰富的表面纹理信息和热辐射信息进行更深层次的研究与验证。

参考文献

View Option

[1]

郭佳琛 , 刘延峰 , 马捷 , 等 红外与可见光图像配准技术分析

[J]. 信息技术与信息化 , 2023 (6 ): 52 -55 .

[本文引用: 1]

GUO J C LIU Y F MA J et al Analysis of infrared and visible light image registration technology

[J]. Information Technology and Informatization , 2023 (6 ): 52 -55 .

[本文引用: 1]

[2]

王宁 , 周铭 , 杜庆磊 一种红外可见光图像融合及其目标识别方法

[J]. 空军预警学院学报 , 2019 , 33 (5 ): 328 -332 .

[本文引用: 1]

WANG N ZHOU M DU Q L A method for infrared visible image fusion and target recognition

[J]. Journal of Air Force Early Warning Academy , 2019 , 33 (5 ): 328 -332 .

[本文引用: 1]

[4]

周美琪 , 高陈强 , 木松 , 等 基于模态转换的红外与可见光图像配准方法

[J]. 计算机工程与设计 , 2020 , 41 (10 ): 2862 -2866 .

[本文引用: 1]

ZHOU M Q GAO C Q MU S et al Infrared and visible image registration based on modal transformation

[J]. Computer Engineering and Design , 2020 , 41 (10 ): 2862 -2866 .

[本文引用: 1]

[5]

YANG Z W SHEN G R WANG W et al Spatial-spectral cross correlation for reliable multispectral image registration

[C]//2009 IEEE Applied Imagery Pattern Recognition Workshop . Washington, DC, Oct . 14 -16 , 2009 .

[本文引用: 1]

[6]

WANG C C ZANG Y S ZHOU D M et al An interactive deep model combined with Retinex for low-light visible and infrared image fusion

[J]. Neural Computing and Applications , 2023 , 35 (16 ): 11733 -11751 .

[本文引用: 1]

[7]

HU Z H JING Y G WU G Q Decision-level fusion detection method of visible and infrared images under low light conditions

[J]. EURASIP Journal on Advances in Signal Processing , 2023 , 2023 (1 ): 38 .

[本文引用: 1]

[9]

LOWE D G Distinctive image features from scale-invariant keypoints

[J]. International Journal of Computer Vision , 2004 , 60 (2 ): 91 -110 .

[本文引用: 1]

[11]

易图明 , 王先全 , 袁威 , 等 基于导向滤波和小波变换的红外可见光图像融合改进算法研究

[J]. 现代信息科技 , 2023 , 7 (6 ): 41 -45 .

[本文引用: 1]

YI T M WANG X Q YUAN W et al Research on improved infrared visible light image fusion algorithm based on guided filtering and wavelet transform

[J]. Modern Information Technology , 2023 , 7 (6 ): 41 -45 .

[本文引用: 1]

[12]

李晖晖 , 郑平 , 杨宁 , 等 基于SIFT特征和角度相对距离的图像配准算法

[J]. 西北工业大学学报 , 2017 , 35 (2 ): 280 -285 .

[本文引用: 1]

LI H H ZHENG P YANG N et al Relative angle distance for image registration based on SIFT feature

[J]. Journal of Northwestern Polytechnical University , 2017 , 35 (2 ): 280 -285 .

[本文引用: 1]

[13]

SHREYAMSHA KUMAR B K Image fusion based on pixel significance using cross bilateral filter

[J]. Signal, Image and Video Processing , 2015 , 9 (5 ): 1193 -1204 .

[本文引用: 2]

[14]

YIN W X HE K J XU D et al Adaptive low light visual enhancement and high-significant target detection for infrared and visible image fusion

[J]. The Visual Computer , 2023 , 39 (12 ): 6723 -6742 .

[本文引用: 1]

[15]

ZHANG X C Benchmarking and comparing multi-exposure image fusion algorithms

[J]. Information Fusion , 2021 , 74 : 111 -131 .

[本文引用: 1]

[16]

JIANG Q LIU Y D YAN Y J et al A contour angle orientation for power equipment infrared and visible image registration

[J]. IEEE Transactions on Power Delivery , 2021 , 36 (4 ): 2559 -2569 .

[本文引用: 1]

[17]

KANTARCI A EKENEL H K Thermal to visible face recognition using deep autoencoders

[C]//International Conference of the Biometrics Special Interest Group . Darmstadt, Sep . 18 -19 , 2019 .

[本文引用: 1]

[18]

杨勇 , 刘家祥 , 黄淑英 , 等 卷积自编码融合网络的红外可见光图像融合

[J]. 小型微型计算机系统 , 2019 , 40 (12 ): 2673 -2680 .

[本文引用: 1]

YANG Y LIU J X HUANG S Y et al Convolutional auto-encoding fusion network for infrared and visible image fusion

[J]. Journal of Chinese Computer Systems , 2019 , 40 (12 ): 2673 -2680 .

[本文引用: 1]

[19]

ZENG Q ADU J H LIU J X et al Real-time adaptive visible and infrared image registration based on morphological gradient and C_SIFT

[J]. Journal of Real-Time Image Processing , 2020 , 17 : 1103 -1115 .

[本文引用: 1]

[20]

AMIN-NAJI M AGHAGOLZADEH A Multi-focus image fusion in DCT domain using variance and energy of Laplacian and correlation coefficient for visual sensor networks

[J]. Journal of AI and Data Mining , 2018 , 6 (2 ): 233 -250 .

[本文引用: 1]

[21]

罗银辉 , 王星怡 , 吴岳洲 基于残差密集网络的红外与可见光图像配准

[J]. 计算机时代 , 2022 (12 ): 66 -69 .

[本文引用: 1]

LUO Y H WANG X Y WU Y Z Infrared and visible image registration based on residual dense network

[J]. Computer Era , 2022 (12 ): 66 -69 .

[本文引用: 1]

红外与可见光图像配准技术分析

1

2023

... 变电站主配网关键设备运行状态的检测与分析是电网运行维护的重要工作之一.随着国内特别是经济发展前沿城市用电量的快速增加,变电站分布愈加复杂.变电站数量的快速上升导致设备检修人员严重短缺,且变电站设备故障率较高,元器件更换成本极高[1 ] .在这种背景下,无人巡检机器人成为电力智能故障诊断系统的重要组成部分,有效地减少了人力需求,提高了检测效率.巡检机器人配备多模态图像传感器,可捕捉电力设备运行状态下的可见光图像和红外图像;同时,可在机器人拍摄死角位置增加人工手持式设备,以完善对整个变电站主配网设备的全面监测[2 ] .上述基于计算机视觉的自动化故障识别系统大多采用多模态图像传感器和图像配准、识别等图像处理技术,并由计算机处理数据以形成反馈. ...

红外与可见光图像配准技术分析

1

2023

... 变电站主配网关键设备运行状态的检测与分析是电网运行维护的重要工作之一.随着国内特别是经济发展前沿城市用电量的快速增加,变电站分布愈加复杂.变电站数量的快速上升导致设备检修人员严重短缺,且变电站设备故障率较高,元器件更换成本极高[1 ] .在这种背景下,无人巡检机器人成为电力智能故障诊断系统的重要组成部分,有效地减少了人力需求,提高了检测效率.巡检机器人配备多模态图像传感器,可捕捉电力设备运行状态下的可见光图像和红外图像;同时,可在机器人拍摄死角位置增加人工手持式设备,以完善对整个变电站主配网设备的全面监测[2 ] .上述基于计算机视觉的自动化故障识别系统大多采用多模态图像传感器和图像配准、识别等图像处理技术,并由计算机处理数据以形成反馈. ...

一种红外可见光图像融合及其目标识别方法

1

2019

... 变电站主配网关键设备运行状态的检测与分析是电网运行维护的重要工作之一.随着国内特别是经济发展前沿城市用电量的快速增加,变电站分布愈加复杂.变电站数量的快速上升导致设备检修人员严重短缺,且变电站设备故障率较高,元器件更换成本极高[1 ] .在这种背景下,无人巡检机器人成为电力智能故障诊断系统的重要组成部分,有效地减少了人力需求,提高了检测效率.巡检机器人配备多模态图像传感器,可捕捉电力设备运行状态下的可见光图像和红外图像;同时,可在机器人拍摄死角位置增加人工手持式设备,以完善对整个变电站主配网设备的全面监测[2 ] .上述基于计算机视觉的自动化故障识别系统大多采用多模态图像传感器和图像配准、识别等图像处理技术,并由计算机处理数据以形成反馈. ...

一种红外可见光图像融合及其目标识别方法

1

2019

... 变电站主配网关键设备运行状态的检测与分析是电网运行维护的重要工作之一.随着国内特别是经济发展前沿城市用电量的快速增加,变电站分布愈加复杂.变电站数量的快速上升导致设备检修人员严重短缺,且变电站设备故障率较高,元器件更换成本极高[1 ] .在这种背景下,无人巡检机器人成为电力智能故障诊断系统的重要组成部分,有效地减少了人力需求,提高了检测效率.巡检机器人配备多模态图像传感器,可捕捉电力设备运行状态下的可见光图像和红外图像;同时,可在机器人拍摄死角位置增加人工手持式设备,以完善对整个变电站主配网设备的全面监测[2 ] .上述基于计算机视觉的自动化故障识别系统大多采用多模态图像传感器和图像配准、识别等图像处理技术,并由计算机处理数据以形成反馈. ...

红外与可见光图像配准技术研究综述

1

2022

... 多模态图像配准作为图像融合、目标检测等技术应用的关键前提,是实现电力设备高精度和高鲁棒性检测的重要基础[3 ] .多模态图像配准是通过使用某种算法与评估标准,将同一场景中不同分辨率、视角下的一幅或多幅图像(或局部)最优映射到目标图像上.可见光图像具有丰富的细节纹理信息,而红外图像不受光照影响,其低对比度、低信噪比特性能够减少外界环境干扰对图像非均匀性的影响.因此,对电力设备的可见光图像与红外图像进行配准,可以丰富单幅图像中温度、结构等语义信息,为后续图像融合、图像识别等技术的应用奠定基础. ...

红外与可见光图像配准技术研究综述

1

2022

... 多模态图像配准作为图像融合、目标检测等技术应用的关键前提,是实现电力设备高精度和高鲁棒性检测的重要基础[3 ] .多模态图像配准是通过使用某种算法与评估标准,将同一场景中不同分辨率、视角下的一幅或多幅图像(或局部)最优映射到目标图像上.可见光图像具有丰富的细节纹理信息,而红外图像不受光照影响,其低对比度、低信噪比特性能够减少外界环境干扰对图像非均匀性的影响.因此,对电力设备的可见光图像与红外图像进行配准,可以丰富单幅图像中温度、结构等语义信息,为后续图像融合、图像识别等技术的应用奠定基础. ...

基于模态转换的红外与可见光图像配准方法

1

2020

... 可见光图像与红外图像的成像原理差异较大,导致传统单模态图像配准方法的效果较差.此外,2种图像之间存在不同比例的相对平移、旋转和缩放,导致配准难度较大.目前,可见光图像与红外图像的配准方法主要包括基于区域、基于特征和基于深度学习三类[4 ] . ...

基于模态转换的红外与可见光图像配准方法

1

2020

... 可见光图像与红外图像的成像原理差异较大,导致传统单模态图像配准方法的效果较差.此外,2种图像之间存在不同比例的相对平移、旋转和缩放,导致配准难度较大.目前,可见光图像与红外图像的配准方法主要包括基于区域、基于特征和基于深度学习三类[4 ] . ...

Spatial-spectral cross correlation for reliable multispectral image registration

1

2009

... 基于区域的配准方法以参考图像为基础,通过极大化置信度指标来搜索待配准图像的最佳选择,同时将相似度作为待配准图像之间的相关性指标,并通过类似傅里叶变换在空间域或频域中展开.在空间域中,以互相关、互信息为代表的相关性在当下运用较多.Yang等[5 ] 在不同光谱图像配准中引入归一化互相关思想,对不同模态的2幅图像对应块的相似性进行了计算.在频域中,基于傅里叶变换对多模态图像进行类相关计算,并通过比较边缘表示下频域内的互相关性来进行配准是应用较多的方法之一. ...

An interactive deep model combined with Retinex for low-light visible and infrared image fusion

1

2023

... 基于特征的配准方法是一种通过定义损失作为相似度并不断迭代优化损失来寻找特征匹配最优解的方法.常用的图像特征包括区域、边缘和角点等.通过将多模态图像特征进行像素级的展开并进行语义表示,转化为数学计算关系后基于相似度判断准则定义图像之间的匹配关系[6 ] .常用的特征表示信息包括特征描述符、特征向量和区域灰度值等.根据相同采集点位下多模态图像特征表示信息的不同特性,选取合适的几何变换关系即可实现最佳配准. ...

Decision-level fusion detection method of visible and infrared images under low light conditions

1

2023

... 基于深度学习的配准方法通过深度网络模型对可见光图像与红外图像进行统一模态映射,以将其集中在一个新的置信度空间内,并利用神经网络对输入的多模态图像进行特征提取与相似度检测,以实现图像的配准.在配准过程中,定义损失函数并在神经网络训练中不断迭代,以改善多模态图像之间的映射关系,最终得到最优的配准结果[7 ] . ...

结合SIFT算法的视频场景突变检测

1

2016

... 以上3种配准方法在过去几年内得到了广泛的关注和应用,但电力设备的可见光图像与红外图像配准仍存在巨大挑战:第一,图像分辨率不同导致图像像素块之间的特征映射关系存在差异,造成匹配点不准确;第二,受环境条件变化的影响,可见光图像中可能存在相邻区域灰度差异较大的情况,导致特征点匹配过程中相似度差异较大[8 ] ;第三,巡检机器人不同拍摄视角导致的主方向定位误差会对图像配准造成不同程度的影响. ...

结合SIFT算法的视频场景突变检测

1

2016

... 以上3种配准方法在过去几年内得到了广泛的关注和应用,但电力设备的可见光图像与红外图像配准仍存在巨大挑战:第一,图像分辨率不同导致图像像素块之间的特征映射关系存在差异,造成匹配点不准确;第二,受环境条件变化的影响,可见光图像中可能存在相邻区域灰度差异较大的情况,导致特征点匹配过程中相似度差异较大[8 ] ;第三,巡检机器人不同拍摄视角导致的主方向定位误差会对图像配准造成不同程度的影响. ...

Distinctive image features from scale-invariant keypoints

1

2004

... 边缘检测是图像处理、分析领域的重要环节.图像边缘是指图像局部区域亮度显著变化的部分,该区域的灰度剖面可看作是一个阶跃,即从一个灰度值很小的缓冲区域急剧变化到另一个灰度相差较大的区域.传统的边缘检测算子,如Roberts、Sobel、Prewitt、Kirsch和Laplacian等算子,均是基于梯度方向导数的卷积算子,对噪声的高敏感性导致其在处理实际图像尤其是高噪声图像时效果并不理想[9 ] .1986年,Canny提出了边缘检测算子的三大准则(单边缘响应准则、信噪比准则和定位精度准则)并提出了Canny边缘检测算法[10 ] . ...

一种基于Canny理论的自适应边缘检测方法

1

2004

... 边缘检测是图像处理、分析领域的重要环节.图像边缘是指图像局部区域亮度显著变化的部分,该区域的灰度剖面可看作是一个阶跃,即从一个灰度值很小的缓冲区域急剧变化到另一个灰度相差较大的区域.传统的边缘检测算子,如Roberts、Sobel、Prewitt、Kirsch和Laplacian等算子,均是基于梯度方向导数的卷积算子,对噪声的高敏感性导致其在处理实际图像尤其是高噪声图像时效果并不理想[9 ] .1986年,Canny提出了边缘检测算子的三大准则(单边缘响应准则、信噪比准则和定位精度准则)并提出了Canny边缘检测算法[10 ] . ...

一种基于Canny理论的自适应边缘检测方法

1

2004

... 边缘检测是图像处理、分析领域的重要环节.图像边缘是指图像局部区域亮度显著变化的部分,该区域的灰度剖面可看作是一个阶跃,即从一个灰度值很小的缓冲区域急剧变化到另一个灰度相差较大的区域.传统的边缘检测算子,如Roberts、Sobel、Prewitt、Kirsch和Laplacian等算子,均是基于梯度方向导数的卷积算子,对噪声的高敏感性导致其在处理实际图像尤其是高噪声图像时效果并不理想[9 ] .1986年,Canny提出了边缘检测算子的三大准则(单边缘响应准则、信噪比准则和定位精度准则)并提出了Canny边缘检测算法[10 ] . ...

基于导向滤波和小波变换的红外可见光图像融合改进算法研究

1

2023

... 通常情况下,边缘检测的目的是在保留原始图像属性的同时显著减小图像的数据规模[11 ] .Canny边缘检测是一种采用多级边缘检测技术的算法,旨在通过高斯滤波器对多模态图像进行区域平滑处理,以达到最佳的边缘检测效果.该方法通过计算信噪比与定位精度的最优乘积来捕捉图像中最为显著的边缘特征. ...

基于导向滤波和小波变换的红外可见光图像融合改进算法研究

1

2023

... 通常情况下,边缘检测的目的是在保留原始图像属性的同时显著减小图像的数据规模[11 ] .Canny边缘检测是一种采用多级边缘检测技术的算法,旨在通过高斯滤波器对多模态图像进行区域平滑处理,以达到最佳的边缘检测效果.该方法通过计算信噪比与定位精度的最优乘积来捕捉图像中最为显著的边缘特征. ...

基于SIFT特征和角度相对距离的图像配准算法

1

2017

... SIFT算法在计算机视觉领域扮演着不可或缺的角色,其独特之处在于全面性和通用性[12 ] .首先,SIFT算法能够在多尺度下提取特征,这说明其可兼顾物体的微小细节和整体结构.无论物体是处于图像中的近处还是远处位置,利用SIFT算法均能捕捉到关键特征.其次,SIFT算法具备多方向性,能够应对物体在图像中因旋转角度不同而导致的映射关系识别困难的情况,故其具有强大的目标识别和图像匹配能力[13 ] .最后,SIFT算法还能够处理光照变化所导致的图像特征异常表示问题,这意味着在不同光照条件下SIFT算法均能正确地匹配特征点,不易受光照变化的干扰. ...

基于SIFT特征和角度相对距离的图像配准算法

1

2017

... SIFT算法在计算机视觉领域扮演着不可或缺的角色,其独特之处在于全面性和通用性[12 ] .首先,SIFT算法能够在多尺度下提取特征,这说明其可兼顾物体的微小细节和整体结构.无论物体是处于图像中的近处还是远处位置,利用SIFT算法均能捕捉到关键特征.其次,SIFT算法具备多方向性,能够应对物体在图像中因旋转角度不同而导致的映射关系识别困难的情况,故其具有强大的目标识别和图像匹配能力[13 ] .最后,SIFT算法还能够处理光照变化所导致的图像特征异常表示问题,这意味着在不同光照条件下SIFT算法均能正确地匹配特征点,不易受光照变化的干扰. ...

Image fusion based on pixel significance using cross bilateral filter

2

2015

... SIFT算法在计算机视觉领域扮演着不可或缺的角色,其独特之处在于全面性和通用性[12 ] .首先,SIFT算法能够在多尺度下提取特征,这说明其可兼顾物体的微小细节和整体结构.无论物体是处于图像中的近处还是远处位置,利用SIFT算法均能捕捉到关键特征.其次,SIFT算法具备多方向性,能够应对物体在图像中因旋转角度不同而导致的映射关系识别困难的情况,故其具有强大的目标识别和图像匹配能力[13 ] .最后,SIFT算法还能够处理光照变化所导致的图像特征异常表示问题,这意味着在不同光照条件下SIFT算法均能正确地匹配特征点,不易受光照变化的干扰. ...

... 在完成多模态图像边缘特征关键点的准确检测后,根据关键点处的梯度信息定义其主方向.首先,在关键点周围的局部图像区域内计算梯度信息,通常使用Sobel等算子来计算关键点周围局部邻域内每个像素点的梯度幅值和梯度方向.随后,按照梯度方向将关键点周围的像素点分布到一个方向直方图中,直方图通常被分成36个或更多的方向区间,以覆盖360°的方向范围[13 ,16 ] .本文选择具有最大梯度幅值的方向作为关键点的主方向,即对应方向直方图中的最大峰值. ...

Adaptive low light visual enhancement and high-significant target detection for infrared and visible image fusion

1

2023

... SIFT算法的优势不仅在于其特征提取能力,还在于其独有的特征描述方法.SIFT特征向量包含特征点周围区域的关键信息,这可使特征点之间的匹配更为精确,减少了误匹配的可能性.除了适用于处理静态图像外,SIFT算法还适用于动态场景中的图像处理,这可为物体跟踪和三维重建提供可靠的理论基础[14 ] .此外,SIFT算法在机器视觉和自动驾驶等领域也发挥着关键作用,为实现自主导航和环境感知提供了重要支持.综上所述,SIFT算法不仅具有优异的特征提取和描述能力,还适用于各种复杂环境,可为基于视觉识别的图像处理提供坚实的基础. ...

Benchmarking and comparing multi-exposure image fusion algorithms

1

2021

... 尺度空间构建的主要思路是利用不同尺度下的高斯模糊来模拟图像中不同大小的特征,并通过计算高斯差分来寻找局部极值点,这些局部极值点通常对应图像中的关键点.随后,通过进一步处理来提取关键点的描述符,实现尺度不变性和旋转不变性[15 ] . ...

A contour angle orientation for power equipment infrared and visible image registration

1

2021

... 在完成多模态图像边缘特征关键点的准确检测后,根据关键点处的梯度信息定义其主方向.首先,在关键点周围的局部图像区域内计算梯度信息,通常使用Sobel等算子来计算关键点周围局部邻域内每个像素点的梯度幅值和梯度方向.随后,按照梯度方向将关键点周围的像素点分布到一个方向直方图中,直方图通常被分成36个或更多的方向区间,以覆盖360°的方向范围[13 ,16 ] .本文选择具有最大梯度幅值的方向作为关键点的主方向,即对应方向直方图中的最大峰值. ...

Thermal to visible face recognition using deep autoencoders

1

2019

... 在关键点周围确定以关键点为中心的圆形关键区域,并计算区域内每个像素点的梯度幅值和梯度方向.这些关键区域内的梯度信息用于构建包含梯度方向和梯度幅值直方图的特征向量,特征向量的维度通常为128维[17 ] . ...

卷积自编码融合网络的红外可见光图像融合

1

2019

... 将特征向量中的梯度方向进行方向加权计算,以确保特征描述的旋转不变性.本文通过将每个梯度方向分配到最近的主方向来实现梯度方向向主方向的旋转操作,形成多模态图像边缘特征关键点的描述符,增加了特征的鲁棒性.同时,对特征向量进行归一化处理,以保证特征向量不受尺度变化的影响.此外,为了降低计算和存储成本,对特征向量进行排序并保留前N 个最大值.根据经验,通常取N =8[18 ] .变电站主网一次设备可见光图像与红外图像中边缘特征关键点描述符的分布情况如图4 所示. ...

卷积自编码融合网络的红外可见光图像融合

1

2019

... 将特征向量中的梯度方向进行方向加权计算,以确保特征描述的旋转不变性.本文通过将每个梯度方向分配到最近的主方向来实现梯度方向向主方向的旋转操作,形成多模态图像边缘特征关键点的描述符,增加了特征的鲁棒性.同时,对特征向量进行归一化处理,以保证特征向量不受尺度变化的影响.此外,为了降低计算和存储成本,对特征向量进行排序并保留前N 个最大值.根据经验,通常取N =8[18 ] .变电站主网一次设备可见光图像与红外图像中边缘特征关键点描述符的分布情况如图4 所示. ...

Real-time adaptive visible and infrared image registration based on morphological gradient and C_SIFT

1

2020

... 关键点匹配的目标是找到多模态图像之间具有相似特征的关键点对,通过梯度图像对齐策略使关键点在不同尺度、旋转和光照条件下仍能具有较高的匹配鲁棒性[19 ] . ...

Multi-focus image fusion in DCT domain using variance and energy of Laplacian and correlation coefficient for visual sensor networks

1

2018

... 在某些情况下,最佳匹配点可能不够可靠,将其距离与次佳匹配点的距离进行比较,若两者间的差异较大,则证明最佳匹配点的映射关系是可靠的.该过程通过计算最佳匹配点与次佳匹配点之间的距离比R 来实现,若两者的距离比R < 0.8 ,则说明最佳匹配点可接受[20 -21 ] . ...

基于残差密集网络的红外与可见光图像配准

1

2022

... 在某些情况下,最佳匹配点可能不够可靠,将其距离与次佳匹配点的距离进行比较,若两者间的差异较大,则证明最佳匹配点的映射关系是可靠的.该过程通过计算最佳匹配点与次佳匹配点之间的距离比R 来实现,若两者的距离比R < 0.8 ,则说明最佳匹配点可接受[20 -21 ] . ...

基于残差密集网络的红外与可见光图像配准

1

2022

... 在某些情况下,最佳匹配点可能不够可靠,将其距离与次佳匹配点的距离进行比较,若两者间的差异较大,则证明最佳匹配点的映射关系是可靠的.该过程通过计算最佳匹配点与次佳匹配点之间的距离比R 来实现,若两者的距离比R < 0.8 ,则说明最佳匹配点可接受[20 -21 ] . ...