2. 西北工业大学 工业设计研究所, 陕西 西安 710072

2. Institute of Industrial Design, Northwestern Polytechnical University, Xi'an 710072, China

人通过五官获取外界信息,其中视线具有自然性、直接性和双向性等特点,因此大约有80%的信息是通过眼睛获得的.人机界面是人与机器互相传递信息的媒介,它的布局设计直接关系到人机关系的合理性与人机交互的效率.传统的人机界面布局评价通常通过问卷调查、用户访谈、观察、专家评估等手段,这些方法大多通过调查对象的主观回忆来重构人机交互的思维活动,受经验、文化、背景、偏好、认知差异等个体因素影响,在调查结果的客观性方面存在一定的缺陷.眼动追踪技术可以在人机交互的过程中检测到人的实时眼球运动,不仅采样精确,而且不会对被试者行为产生干扰.通过跟踪被试者在观察人机界面时的视线运动轨迹等指标,为评价人机界面布局提供客观的、可量化的交互进行中的数据.

视觉的注视与大脑的认知活动密切相关[1].眼动追踪技术早期应用于视觉行为与认知活动的心理学领域,研究认知加工的心理机制[2].目前应用越来越广泛,涉及网页测试、广告评估、人机交互研究、产品可用性评估等多个领域[3].刘青等[4]采用眼动跟踪技术评估了轻轨站台界面可用性.李珍等[5]通过眼动追踪获取产品用户需求.戚彬等[6]将眼动追踪技术运用于产品形态仿生设计.Manhartsberger和Zellhofer[7]提出将眼动追踪技术用于可用性测试,尤其是对于商业广告,扫视路径和热点图等可以直观获取用户感兴趣的区域.pakov和Miniotas[8]研究了通过热点图实现眼动追踪数据可视化的方法.Wooding[9]提出了三维热点图的绘制方法.Goldberg和Kotval[10]通过眼动追踪实验评价了预先设计的优劣两种人机界面,比较了眼睛运动位置、扫视路径、注视时间等参数,结果表明优秀的界面设计可提高搜索效率.可见,眼动追踪实验会产生大量的眼动数据,如注视时间、注视频率等单项指标的统计分析结果;或者将眼动数据以可视化的方式直观呈现,如眼动轨迹图、热点图等辅助评价布局方案.因此,人机界面布局的眼动评价指标具有定量和定性的混合特性,而且部分指标具有模糊性和不确定性.

由于眼动追踪实验不能得出综合评价结果,因此,本文借鉴求解多属性决策问题的方法,基于Vague集理论,提出一种人机界面布局眼动追踪评价的新方法.Vague集同时考虑了隶属度、非隶属度和犹豫度三方面信息[11],符合人的思维特性,能充分表达评价者的决策意图.分析眼动信息,提取注视轨迹、注视点数量、注视时间和瞳孔直径四项眼动指标构建人机界面布局评价指标体系.通过Vague集分别表征定性和定量指标,建立Vague集决策矩阵.基于多属性决策理论中的优劣点法,根据各人机界面布局方案定性与定量指标值到最优点和最劣点的距离对其进行排序.最后,以石油钻机司钻控制台人机界面布局设计方案的眼动追踪评价为例证明了所提方法的有效性,该方法能为人机界面布局评价提供可靠的数据支持,避免主观因素对评价的影响.

1 Vague集基本理论令U是讨论对象的空间(论域),其中的任意一个元素用x表示,即U={x1,x2,…,xn}.用一个真隶属函数tv和一个假隶属函数fv表示U中的一个Vague集V[12],即tv:U→[0,1],fv:U→[0,1],其中,tv(x)是从支持x的证据所导出的隶属度下界,fv(x)是从反对x的证据所导出的否定隶属度下界,且,tv(x)+fv(x)≤1.这2个界构成了[0,1]的一个子区间tv(x),1-fv(x),称为x在V中的Vague值.πv(x)=1-tv(x)-fv(x),称为x关于V的犹豫度,是x不确定性的度量,0≤πv(x)≤1.当tv(x)+fv(x)=1,即πv(x)=0时,V退化为普通模糊集.

对于Vague集V,当U是连续的时候,记作

| $V = \int\limits_U {\left[ {{t_v}\left( x \right),1 - {f_v}\left( x \right)} \right]/x,x \in U,} $ | (1) |

当U是离散的时候,记作

| $V = \sum\limits_{i = 1}^n {\left[ {{t_v}\left( {{x_i}} \right),1 - {f_v}\left( {{x_i}} \right)} \right]/{x_i}} ,{x_i} \in U.$ | (2) |

眼动的基本形式有注视、眼跳和追随运动三种[13].这3种眼睛运动形式都是为了将要注意的刺激物成像于中央区域,以便形成清晰的图像,眼动的最终目的在于选择信息.眼动追踪是指通过眼动追踪监视器记录眼睛的运动和在可视点上最活跃的区域,通过度量凝视点或者测量眼球运动过程实现对眼球运动的追踪.

通过测量眼睛注视点的位置,眼动追踪实验会产生大量的数据,主要有注视点、注视点数量、注视时间、注视次数、瞳孔直径、眼跳时间、眨眼时间、眨眼次数、眨眼频率等,这些数据有各自的适用范围.在观察人机界面时,眼动的目的在于捕捉和加工视觉信息.因此,选择注视轨迹、注视点数量、注视时间和瞳孔直径四项指标进行分析.

1) 注视轨迹.

被试者在实验设定的时间内观察人机界面图片,记录注视点位置、注视停留时间和位置移动顺序,按顺序描绘注视点形成视线轨迹.注视轨迹反映了被试者的注视点在人机界面兴趣区之间的转换,如果注视点形成的路径与人的视觉逻辑一致,说明人机界面布局合理.

2) 注视点数量.

人机界面某个区域的注视点数量反映了被试者对该区域的关注程度.在一定的任务时间内,注视点越多,表明被试者需要花费越多的注意力与精力搜索人机界面信息.注视点数量与搜索效率成反比,如果注视点数量越多,则搜索效率越低,说明人机界面布局不合理.

3) 注视时间.

注视时间反映了被试者从人机界面提取信息的难度.如果被试者对人机界面某个区域的凝视时间越长,说明对该区域的信息获取困难,信息提取的效率越低,同时间接说明人机界面布局不甚合理.

4) 瞳孔直径.

瞳孔直径是感知视觉负荷变化的敏感指标,反映了被试者的脑力负荷与心理状态.随着人机界面信息量的增大或被试者紧张程度的提高,瞳孔扩大;当任务难度增加或被试者到达一定疲劳程度之后,瞳孔缩小.瞳孔直径大小与人机界面反映的信息量成正比.

基于以上分析,设有m个待评价的人机界面布局方案,记为集合H={H1,H2,…,Hm},有n个眼动评价指标,记为集合P={P1,P2,…,Pn},每个方案在每个评价指标下的评价值记为aij(i=1,2,…,m;j=1,2,…,n),建立如下评价矩阵:

| $A = \left[ {\begin{array}{*{20}{c}} {{a_{11}}}&{{a_{12}}}& \cdots &{{a_{1n}}}\\ {{a_{21}}}&{{a_{22}}}& \cdots &{{a_{2n}}}\\ \vdots & \vdots &{}& \vdots \\ {{a_{m1}}}&{{a_{m2}}}& \cdots &{{a_{mm}}} \end{array}} \right],$ | (3) |

式中aij是不确定语言或者精确数值.

3 基于Vague集TOPSIS法的眼动追踪评价 3.1 定性指标的Vague值表示“注视轨迹”指标通过视觉轨迹与视觉逻辑的匹配情况反映布局的优劣,评价者对该项指标只能定性评价,用模糊性语言“较好”、“较差”等描述,这些模糊语言需要转换为具体的数据进行评价对比.Vague集不仅能将不确定性的评价语言转化为模糊数,而且还能有效处理评价者的犹豫度.

评价者采用“不确定语言(犹豫度)”的形式评价人机界面布局[14],即Lij(πij),其中,Lij(0≤Lij≤1)表示不确定语言标度值,πij(0≤πij≤1)表示评价者对评价结果的犹豫度.预先定义不确定语言为5级标度:{0.9(很好),0.7(好),0.5(一般),0.3(差),0.1(很差)}.通过式(4)将不确定语言信息转化为Vague数,具体如表 1所示.

| 不确定语言 | Vague数 | α,β的值 |

| 很好(VG) | 0.9-α×π,0.9+β×π | α=1,β=0 |

| 好(G) | 0.7-α×π,0.7+β×π | α=0.5,β=0.5 |

| 一般(M) | 0.5-α×π,0.5+β×π | α=0.5,β=0.5 |

| 差(P) | 0.3-α×π,0.3+β×π | α=0.5,β=0.5 |

| 很差(VP) | 0.1-α×π,0.1+β×π | α=0,β=1 |

| ${v_{ij}} = \left[ {{t_{ij}},1 - {f_{ij}}} \right] = \left[ {{L_{ij}} - \alpha {\pi _{ij}},{L_{ij}} + \beta {\pi _{ij}}} \right],$ | (4) |

式中,α和β表示犹豫度水平,α≥0,β≥0,α+β=1.

例如,VG(0.1)表示评价者根据“注视轨迹”对于人机界面布局的评价为非常好,犹豫度为0.1,根据表 1可得到对应的Vague数[0.9-1×0.1,0.9+0×0.1]=[0.8,0.9].

3.2 定量指标的Vague值表示“注视点数量”、“注视时间”与“瞳孔直径”三项定量指标由眼动仪配套软件统计分析后以实数的形式给出.这些数据需要进行规范化处理,利用优属度计算方法将其转化为在[0,1]中的Vague值形式[15].

对于“注视点数量”与“注视时间”成本型(越小越好)的评价指标,其相对优属度表示为

| ${\gamma _{ij}} = \left\{ \begin{array}{l} 1 - {a_{ij}}/{a_{j\max }},\;\;\;\;{a_{j\min }} = 0,\\ {a_{j\min }}/{a_{ij}},\;\;\;\;\;\;\;\;\;{a_{j\min }} \ne 0. \end{array} \right.$ | (5) |

对于“瞳孔直径”效益型(越大越好)的评价指标,其相对优属度表示为

| ${\gamma _{ij}} = {a_{ij}}/{a_{j\max }}.$ | (6) |

通过式(5)和式(6)将评价矩阵A转换为目标优属矩阵γ=[γij]m×n.

然后,确定评价者能够接受的满意度的下界λU和能够接受的不满意度的上界λL,根据矩阵γ分别求出各人机界面布局方案的支持指标集S、反对指标集O和中立指标集N.

Si={aj∈a|γij≥λU}(i=1,2,…,m;j=1,2,…,n)为第i个人机界面布局方案的支持指标集,表示对于第j个评价指标是支持第i个方案的.

Oi={aj∈a|γij≤λL}(i=1,2,…,m;j=1,2,…,n)为第i个人机界面布局方案的反对指标集,表示对于第j个评价指标是反对第i个方案的.

Ni={aj∈a|λL≤γij≤λU(i=1,2,…,m;j=1,2,…,n)为第i个人机界面布局方案的中立指标集,表示第j个评价指标对第i个方案是既不支持也不反对的.

设评价指标权重ω=ω1,ω2,…,ωn,对于每个评价指标Pj,方案Hi满足评价者要求的程度可通过式(7)用Vague数表示.

| ${v_i} = \left[ {{t_i},1 - {f_i}} \right] = \left[ {\frac{{\sum\limits_{j \in {\eta _1}} {{\omega _j}{\gamma _{ij}}} }}{{\sum\limits_{j = 1}^n {{\omega _j}{\gamma _{ij}}} }},1 - \frac{{\sum\limits_{j \in {\eta _2}} {{\omega _j}{\gamma _{ij}}} }}{{\sum\limits_{j = 1}^n {{\omega _j}{\gamma _{ij}}} }}} \right],$ | (7) |

式中:η1={j|aj∈Si,η2={j|aj∈Oi;i=1,2,…,m;j=1,2,…,n.

3.3 构建Vague集评价矩阵评价指标由定性指标和定量指标组成,记为C={C1,C2},Vague集评价矩阵表示为

| $D = \left[ {\begin{array}{*{20}{c}} {\left( {{C_1},\left[ {{t_{11}},1 - {f_{11}}} \right]} \right)}&{\left( {{C_2},\left[ {{t_{12,}}1 - {f_{12}}} \right]} \right)}\\ {\left( {{C_1},\left[ {{t_{21}},1 - {f_{21}}} \right]} \right)}&{\left( {{C_2},\left[ {{t_{22,}}1 - {f_{22}}} \right]} \right)}\\ \vdots & \vdots \\ {\left( {{C_1},\left[ {{t_{m1}},1 - {f_{m1}}} \right]} \right)}&{\left( {{C_2},\left[ {{t_{m2,}}1 - {f_{m2}}} \right]} \right)} \end{array}} \right],$ | (8) |

式中,tij表示布局方案满足评价指标的程度,fij表示布局方案不满足评价指标的程度.

3.4 基于TOPSIS法的眼动追踪评价各评价指标用Vague集表示,包含了肯定、否定和犹豫的信息,符合评价者的思维习惯,通过客观描述来处理人机界面布局评价中的不确定信息.基于TOPSIS法的眼动追踪评价思路是:先选定一个正理想值和负理想值,然后计算每个布局方案到理想方案的接近度[16].接近度值越大,对应的布局方案越好.

对一组Vague数X(i=1,2,…,m),确定正理想值X+和负理想值X-:

| $\left. \begin{array}{l} {X^ + } = \left[ {\mathop {\max \;\;{t_i},}\limits_{i = 1,2, \cdots ,m} 1 - \mathop {\max \;\;{f_i}}\limits_{i = 1,2, \cdots ,m} } \right],\\ {X^ - } = \left[ {\mathop {\max \;\;{t_i},}\limits_{i = 1,2, \cdots ,m} 1 - \mathop {\max \;\;{f_i}}\limits_{i = 1,2, \cdots ,m} } \right]. \end{array} \right\}$ | (9) |

X+和X-是Vague数,其与理想值之间的距离可通过Vague集距离公式计算.每个布局方案中Xi与X+的距离di+、每个布局方案中Xi与X-的距离di-如下所示:

| $\begin{array}{ccccc} d_i^ + = d\left( {{X_i},{X^ + }} \right) = \\ \;\;\;\;\;\;\;\sum\limits_{j = 1}^2 {{\omega _j}} \cdot \sqrt {{{\left( {{t_{ij}} - {t^ + }} \right)}^2} + {{\left( {{f_{ij}} - {f^ + }} \right)}^2}} , \end{array}$ | (10) |

| $\begin{array}{ccccc} d_i^ - = d\left( {{X_i},{X^ - }} \right) = \\ \;\;\;\;\;\;\;\;\;\sum\limits_{j = 1}^2 {{\omega _j}} \cdot \sqrt {{{\left( {{t_{ij}} - {t^ - }} \right)}^2} + {{\left( {{f_{ij}} - {f^ - }} \right)}^2}} . \end{array}$ | (11) |

计算每个布局方案定性与定量指标值到理想值的相对贴近指数:

| ${\mu _i} = \frac{{d_i^ - }}{{d_i^ + + d_i^ - }}.$ | (12) |

根据优劣点法的思想,若Xi越接近X+并远离X-,则说明其隶属度越大而非隶属度越小,即:μi值越大,说明人机界面布局方案i越好.据此可对人机界面布局方案进行优劣排序.

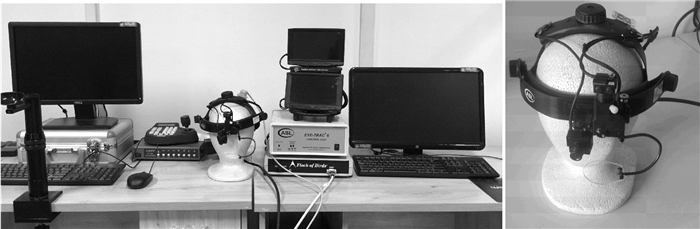

4 实例分析以石油钻机司钻控制台人机界面布局方案评价为例,进行眼动分析实验.实验设备采用美国应用科学实验室(Applied Science Laboratory,ASL)开发的头盔式眼动仪,如图 1所示. ASL眼动追踪系统跟踪频率为60 Hz,系统采用亮/暗瞳孔技术,通过红外线对受试瞳孔位置进行追踪确定其空间位置,并与呈现的图片或视频进行叠加,确定受试者的注视区域与时间.

|

| 图 1 ASL EYE-TRAC 6眼动仪 Fig. 1 ASL EYE-TRAC 6 eye tracker |

实验的被试者是工业设计在校研究生,参与测试的总人数为10人,男女比例为1∶1,视力和色觉均正常.首先,被试者听取主试者对实验的说明,了解实验要求和目的.其次,将被试者下巴放在托架上,佩戴头盔,识别瞳孔,调节瞳孔位于监视器中心,并将头盔固定.然后,在正式实验开始前,进行眼动实验校准测试.最后,打开实验样本,开始正式实验.

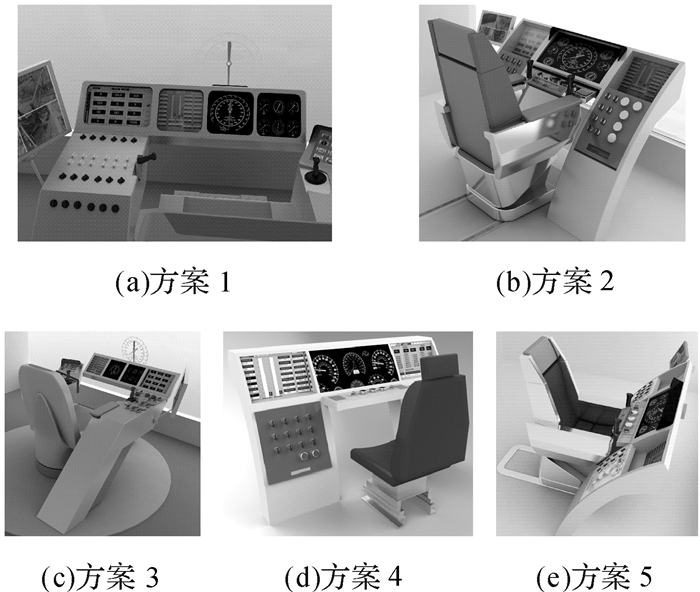

E-prime程序控制实验中样本图片播放时间和间隔时间,ASL EYE-TRAC 6眼动仪采集被试者观察人机界面布局图片时的注视点运动,ASL RESULTS软件分析得出被试者注视点运动轨迹、注视时间等参数.实验记录了被试者观察5个布局方案的过程(见图 2),跟踪眼球运动得到了如表 2所示的实验数据.此外,以方案2为例,根据这些数据绘制出如图 3所示的眼动图像,能够清晰直观地反映被试者的兴趣所在.图中圆点代表被试者视线停留时间,视线停留表明被试者正在获取信息,圆点半径大小代表注视时间长短,直线代表注视点转移路径.

|

| 图 2 人机界面布局方案 Fig. 2 The layout scheme of human-machine interface |

| Xi | 方案 | 注视轨迹 | 注视点数量1)/个 | 注视时间/s | 瞳孔直径/像素 |

| 注:1)注视点数量为所有被试者注视点数量的均值. | |||||

| X1 | 1 | M(0.2) | 33.800 | 7.791 | 69.835 |

| X 2 | 2 | VG(0.2) | 28.600 | 7.126 | 73.596 |

| X 3 | 3 | VG(0.1) | 32.700 | 7.790 | 77.310 |

| X 4 | 4 | G(0.3) | 31.200 | 8.525 | 78.430 |

| X 5 | 5 | M(0.1) | 35.500 | 8.592 | 77.511 |

|

| 图 3 注视轨迹图 Fig. 3 The scan path duration and length |

1) 根据注视轨迹图,使用不确定语言值评价“注视轨迹”指标,评价结果见表 2.然后根据式(4)将不确定语言值转化表示为Vague数.

v1=(C1,[0.40,0.60]),

v2=(C1,[0.70,0.90]),

v3=(C1,[0.80,0.90]),

v4=(C1,[0.55,0.85]),

v5=(C1,[0.45,0.55]).

2) 根据式(5)和式(6)将“注视点数量”、“注视时间”与“瞳孔直径”三项定量指标数据转化为目标优属矩阵,

| $\gamma = \left[ {\begin{array}{*{20}{c}} {0.846}&{0.915}&{0.890}\\ {1.000}&{1.000}&{0.938}\\ {0.875}&{0.915}&{0.986}\\ {0.917}&{0.836}&{1.000}\\ {0.806}&{0.829}&{0.988} \end{array}} \right].$ |

确定满意度下界λU=0.9和不满意度上界λL=0.85,找出各布局方案的支持指标集、反对指标集和中立指标集.

S1=a2,O1=a1,N1=a3;

S2=a1,a2,a3,O2=Φ,N2=Φ;

S3=a2,a3,O3=Φ,N3=a1;

S4={a1,a3},O4=a2,N4=Φ;

S5={a3},O5={a1,a2},N5=Φ.

确定3个指标权重ω={0,4,0.4,0.2},从而根据式(7)计算出5个方案的Vague估计值.

v1=(C2,[0.415,0.617]),

v2=(C2,[1.000,1.000]),

v3=(C2,[0.617,1.000]),

v4=(C2,[0.629,0.629]),

v5=(C2,[0.232,0.232]).

3)构建Vague集评价矩阵.

| $D = \left[ {\begin{array}{*{20}{c}} {\left( {{C_1},\left[ {0.40,0.60} \right]} \right)}&{\left( {{C_2},\left[ {0.415,0.617} \right]} \right)}\\ {\left( {{C_1},\left[ {0.70,0.90} \right]} \right)}&{\left( {{C_2},\left[ {1.000,1.000} \right]} \right)}\\ {\left( {{C_1},\left[ {0.80,0.90} \right]} \right)}&{\left( {{C_2},\left[ {0.617,1.000} \right]} \right)}\\ {\left( {{C_1},\left[ {0.55,0.85} \right]} \right)}&{\left( {{C_2},\left[ {0.629,0.629} \right]} \right)}\\ {\left( {{C_1},\left[ {0.45,0.55} \right]} \right)}&{\left( {{C_2},\left[ {0.232,0.232} \right]} \right)} \end{array}} \right].$ |

4) 确定方案集的正理想值X+和负理想值X-.

X+={(C1,[0.80,0.90]),(C2,[1.000,1.000])},

X-={(C1,[0.40,0.55]),(C2,[0.232,0.232])}.

5) 确定定性指标权重为0.4,定量指标权重为0.6.根据式(10)和式(11)计算每个布局方案Xi与X+,X-的距离di+,di-.

d1+=0.620,d2+=0.040,d3+=0.230,d4+=0.417,d5+=0.850;

d1-=0.276,d2-=0.836,d3-=0.728,d4-=0.471,d5-=0.020.

6) 根据式(12)计算每个布局方案中Xi到理想值的接近度.

μ1=0.308,μ2=0.954,μ3=0.760,μ4=0.530,μ5=0.023.

根据贴近度值大小排序,即可得到人机界面布局方案优劣排序:X2>X3>X4>X1>X5.因此说明综合考虑4项指标,方案2符合人的视觉习惯且观察效率较高,是最优的布局方案,后续详细设计应以方案2的布局形式作为参考依据.

5 结 论信息加工在很大程度上依赖于视觉.本文通过眼动追踪实验测量与统计被试者观察实验样本时的眼动特征,构建了眼动追踪评价指标体系,以注视时间、视觉轨迹等反映视觉搜索效率的眼动数据评价人机界面布局优劣.针对评价指标的模糊性与不确定性,为了进一步量化眼动数据,本文利用Vague集表达模糊信息的优势,结合多属性决策的思想,提出了基于Vague集TOPSIS法的人机界面布局眼动追踪评价方法,可为每一个布局方案给出一个综合评价值,为方案评价提供客观、可靠的数据支撑.算例表明本文方法考虑了评价者的主观性与犹豫度,在人机界面布局评价中有较强的实用性,能有效避免主观评价偏差.在实际应用中,可根据不同评价对象,提取不同的眼动评价指标,运用本文所提方法计算出综合评价值.

| [1] | 程时伟,孙凌云.眼动数据可视化综述[J].计算机辅助设计与图形学学报,2014,26(5):698-707. CHENG Shi-wei,SUN Ling-yun.A survey on visualization for eye tracking data[J].Journal of Computer-Aided Design & Computer Graphics,2014,26(5):698-707. |

| Cited By in Cnki (4) | Click to display the text | |

| [2] | HYRSKYKARI A.Utilizing eye movements:overcoming inaccuracy while tracking the focus of attention during reading[J].Computers in Human Behavior,2006,22(4):657-671. |

| Click to display the text | |

| [3] | 曾宇静,张彤,陈宜.视线追踪技术在网页可用性评估中的应用[J].人类工效学,2012,18(3):83-86. ZENG Yu-jing,ZHANG Tong,CHEN Yi.The application of eye-tracking technology in web usability evaluation[J].Chinese Journal of Ergonomics,2012,18(3):83-86. |

| Cited By in Cnki (5) | |

| [4] | 刘青,薛澄岐,HOEHN F.基于眼动跟踪技术的界面可用性评估[J].东南大学学报(自然科学版),2010,40(2):331-334. LIU Qing,XUE Cheng-qi,HOEHN F.Interface usability evaluation based on eye-tracking technology[J].Journal of Southeast University(Natural Science Edition),2010,40(2):331-334. |

| Cited By in Cnki (26) | Click to display the text | |

| [5] | 李珍,苟秉宸,初建杰,等.一种基于眼动追踪的产品用户需求获取方法[J].计算机工程与应用,2015,51(9):233-237. LI Zhen,GOU Bing-chen,CHU Jian-jie,et al.Way of getting user requirements based on eye tracking technology[J].Computer Engineering and Applications,2015,51(9):233-237. |

| Cited By in Cnki (1) | Click to display the text | |

| [6] | 戚彬,余隋怀,王淼,等.基于眼动跟踪实验的产品形态仿生设计研究[J].机械设计,2014,31(6):125-128. QI Bin,YU Sui-huai,WANG Miao,et al.Study on product form bionic design based on eye tracking experiment[J].Journal of Machine Design,2014,31(6):125-128. |

| Cited By in Cnki (3) | Click to display the text | |

| [7] | MANHARTSBERGER M,ZELLHOFER N.Eye tracking in usability research:what users really see[J].Usability Symposium,2005,198:141-152. |

| Click to display the text | |

| [8] | ŠPAKOV O,MINIOTAS D.Visualization of eye gaze data using heat maps[J].Electronics and Electrical Engineering,2007,74(2):55-58. |

| Click to display the text | |

| [9] | WOODING D S.Fixation maps:quantifying eye-movement traces[C]//Proceedings of the Symposium on Eye Tracking Research and Applications.New York,March 25-27,2002:31-36. |

| [10] | GOLDBERG J H,KOTVAL X P.Computer interface evaluation using eye movements:methods and constructs[J].International Journal of Industrial Ergonomics,1999,24(6):631-645. |

| Click to display the text | |

| [11] | CHEN S M,TAN J M.Handling multi-criteria fuzzy decision making problems based on vague set theory[J].Fuzzy Set and Systems,1994,67(2):163-172. |

| Click to display the text | |

| [12] | GAU W,BUEHRER D.Vague sets[J].IEEE Transactions on Systems Man And Cybernetics,1993,23(2):610-614. |

| Click to display the text | |

| [13] | 赵新灿,左洪福,任勇军.眼动仪与视线跟踪技术综述[J].计算机工程与应用,2006(12):118-120. ZHAO Xin-can,ZUO Hong-fu,REN Yong-jun.A review of eye tracker and eye tracking techniques[J].Computer Engineering and Applications,2006(12):118-120. |

| Cited By in Cnki (146) | Click to display the text | |

| [14] | GENG X L,CHU X N,ZHANG Z F.A new integrated design concept evaluation approach based on Vague sets[J].Expert Systems with Applications,2010,37(9):6629-6638. |

| Click to display the text | |

| [15] | 王珏,刘三阳,张杰.基于Vague集的模糊多目标决策方法[J].系统工程理论与实践,2005(2):119-122. WANG Jue,LIU San-yang,ZHANG Jie.Fuzzy multiple objectives decision making based on Vague sets[J].Systems Engineering—theory & Practice,2005(2):119-122. |

| Cited By in Cnki | Click to display the text | |

| [16] | 耿涛,卢广山,张安.基于Vague集的空中目标威胁评估群决策方法[J].系统工程与电子技术,2011,33(12):2686-2690. GENG Tao,LU Guang-shan,ZHANG An.Group decision-making method for air target threat assessment based on Vague sets[J].Systems Engineering and Electronics,2011,33(12):2686-2690. |

| Cited By in Cnki (14) | Click to display the text |