链接预测可用于发现网络中丢失的数据信息[1],识别构建的虚假链接和预测网络演进[2-3],例如犯罪网络中缺失关系的发现,社交网络的朋友推荐[4-6]等,在国防、生物[7]和社交等领域中具有重要的研究和应用价值,已经成为面向大数据[8]挖掘的社会网络研究热点.

Liben-Nowell等[9]针对节点邻近性质和路径提出了基于网络拓扑结构的相似性方法,模型结构单一,无法发现节点对在网络中的深层拓扑关系,难以适用于稀疏网络.Hasan等[10]将链接预测作为有监督的分类问题,基于节点属性和网络拓扑结构分类,人工提取的特征冗余且扩展性差.Leskovec等[11]在真实社交网络中应用监督学习检测边的正负类型,将特征分为基于节点度和共邻对节点连接的正负作用2类,但特征信息有限,导致分类效果不佳.Zhou等[12]基于共邻资源分布提出局部相似性度量的链接预测方法,仅从浅层评估2个节点的相似性,未考虑特定共邻及其相互关系对链接预测影响.Schlichtkrull等[13]通过关系图卷积(R-GCN)处理知识库完成任务(链接预测和实体分类),针对特定网络对边加标签,算法扩展性较差.Grover等[14]在KDD′16中提出了将网络结构序列化并学习节点向量表示,通过简单二元操作节点对向量提取潜在链接特征,分类训练实现链接预测,局限于2个节点个体在全局拓扑下的表示,未考虑节点间局部拓扑的作用.

由于社会网络中的节点真实属性信息很难获得,不同网络的节点属性类别也有一定差异,基于节点属性的预测方法具有一定局限性.本文旨在研究更稳定、普适的基于网络拓扑结构的链接预测方法.文献[14]中的node2vec是全局网络中的节点表示,缺乏局部结构信息,本文研究基于共邻关系的链接局部结构序列化,并用node2vec全局节点向量表达得到用于分类模型的链接矩阵表示;鉴于卷积神经网络(convolution neural network, CNN)在文本分类[15-17]中可提取句子中词与词之间的语义关系,类比于网络中链接序列的节点间的隐含拓扑关系,采用CNN多尺寸卷积窗口提取序列中共邻与节点对间多层次隐含关系,建立分类模型实现节点可连接的预测.

1 网络拓扑序列化 1.1 节点向量表示DeepWalk[18]与node2vec[14]均结合随机游走实现了网络拓扑结构的序列化,并学习节点的连续特征表示,其中node2vec通过灵活的邻居采样实现了节点更丰富的特征表示.

在网络G=(V, E)中,特定节点可由其上下文,即节点邻居,进行表示,故节点特征学习的目标是最大化所采样的节点邻居的对数概率:

| $ \mathop {\max }\limits_f \sum\limits_{u \in V} {{\rm{log}}\;{\rm{Pr}}({N_{\rm{S}}}\left( u \right)|f\left( u \right)).} $ | (1) |

式中:V为节点集合,E为边集合,f:V→ Rd表示节点到特征空间的映射,f(u)为节点u的d维特征表示,NS(u)⊂V为邻居采样策略所定义的节点u∈V的网络邻居.

node2vec的节点邻居采样策略是通过二阶马尔科夫链模拟偏向随机游走过程,搜索节点一阶邻居和多阶同构邻居实现节点邻居采样的多样化.

node2vec算法步骤如下:

1) 对网络G中任一源节点进行l步的偏向随机游走,得到1个游走节点序列walk,每一步游走节点的选择是基于上1个游走节点t与当前停留节点v的邻居x之间最短路径Dtx大小,所确定的可调游走概率πvx;

2) 循环多次遍历网络G中节点,执行步骤1),得到丰富的全局节点序列集walks;

3) 将游走的节点序列集walks输入到word2vec的skip-gram模型进行训练,最后输出网络G中所有节点的d维特征向量Qi=[q1, q2, q3, …, qd].

1.2 链接序列化表示Newman[19]表明合作网络中2个节点间的共邻数目与其可连接的概率正相关.Liben-Nowell等[9, 20]发现共邻数目越多,节点间存在连接的可能性就越大,因此共邻特征可以从结构上预测节点连接.不同于Grover等[14]用2个节点间的简单组合表示潜在链接,本文用节点间共邻扩展表示潜在链接.

共邻CNuv定义为

| $ {\rm{C}}{{\rm{N}}_{uv}} = N(u) \cap N(v). $ | (2) |

式中:N(u)和N(v)分别表示节点u及v的邻接点集合.

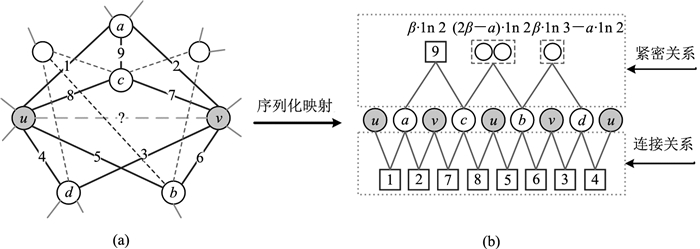

1.2.1 节点间共邻紧密度Liben-Nowell等[9, 19-20]仅考虑共邻个体对节点产生连接的诱导作用,忽略了共邻间连接紧密度的影响.本文认为网络结构中紧密度大的2个共邻对节点产生连接的促进作用更强,如图 1中共邻(a与c)比共邻(a与d)组合更有助于预测未连节点对(u, v)的连接.

|

图 1 节点u和v的局部网络拓扑序列化映射 Fig. 1 Serialized mapping of node u and v in local network topology |

本文定义未连节点对(u, v)的任意2个共邻间的紧密度D(i, j)为

| $ \begin{array}{l} D(i, j) =-\alpha \cdot{\rm{ln}}\;{l_{ij}} + \beta \cdot{\rm{ln}}|{\rm{C}}{{\rm{N}}_{ij}}| = \\ \left\{ \begin{array}{l} \beta \cdot{\rm{ln}}|{\rm{C}}{{\rm{N}}_{ij}}|, \left( {i, j} \right) \in E;\\ -\alpha \cdot{\rm{ln}}\;2 + \beta \cdot{\rm{ln}}|{\rm{C}}{{\rm{N}}_{ij}}|, \left( {i, j} \right) \notin E. \end{array} \right. \end{array} $ | (3) |

其中i, j∈CNuv,lij表示i和j间的最短路径长度,α和β为权重因子,-α·ln lij表示共邻间紧密度大小D(i, j)与其最短路径lij呈反比,β·ln|CNij|表示共邻间紧密度与其共邻数目|CNij|呈正比关系.

共邻直接相连时紧密度最小值Dmin(i, j|(i, j)∈E)应大于相互不连接时紧密度最大值Dmax(i, j|(i, j)∉E),即

| $ \begin{array}{l} {D_{{\rm{min}}}}\left( {i, j|\left( {i, j} \right) \in E} \right) > {D_{{\rm{max}}}}(i, j|\left( {i, j} \right) \notin E)\\ \Rightarrow \beta \cdot{\rm{ln}}\;2 >-\alpha \cdot{\rm{ln}}\;2 + \beta \cdot{\rm{ln}}(|V|-2). \end{array} $ | (4) |

可得权重因子α和β的关系为

| $ a > \beta \cdot \frac{{\ln (\left| V \right|/2)-1}}{{\ln \;2}}. $ | (5) |

基于节点间共邻关系将潜在链接的局部拓扑结构(图 1(a))序列化映射为节点对(u, v)与共邻序列{a, c, b, d}交叉组合形成的有序节点序列{u, a, v, c, u, b, v, d, u},如图 1(b)所示.其中共邻序列{a, c, b, d}是对无序共邻集CNuv依据连接紧密度重排得到,共邻重排算法设计如下:

1) 初始化未连节点对(ui, vi)的其中一个共邻eij为重排共邻序列的首节点项,并为重排基准项;

2) 遍历剩余未排共邻,判断是否有与基准共邻eij的最短路径为1的节点项;若有则将其排在eij后面,并作为下一基准项,返回2);若无则继续步骤3);

3) 查找基准项eij与剩余未排共邻中有最大共邻数的那个共邻,排在eij后,并作为下一基准项,返回步骤2).

4) 重复步骤2)和3),直到全部共邻重排结束.

1.2.3 链接矩阵表示通过1.1节的节点特征向量Qi=[q1, q2, q3, …, qd]表达链接序列中每个节点,得到网络中任意潜在链接(ui, vi)的矩阵表示

| $ \begin{array}{l} \boldsymbol{Z} = [{Q_{{u_i}}}, {\rm{ }}{Q_{{e_{i1}}}}, {\rm{ }}{Q_{{v_i}}}, {\rm{ }}{Q_{{e_{i2}}}}, {\rm{ }}{Q_{{u_i}}}, \cdots, {\rm{ }}{Q_{{u_i}}}]_{\left( {2m + 1} \right) \times d}^{\rm{T}}, 或\\ \;\;\;\;\;{\rm{ }}[{Q_{{u_i}}}, {\rm{ }}{Q_{{e_{i1}}}}, {\rm{ }}{Q_{{v_i}}}, {\rm{ }}{Q_{{e_{i2}}}}, {\rm{ }}{Q_{{u_i}}}, \cdots, {\rm{ }}{Q_{{v_i}}}]_{\left( {2n + 1} \right) \times d}^{\rm{T}}. \end{array} $ | (6) |

其中, m、n为共邻数目,m=2, 4, 6, …, 2k,n=0, 1, 3, …, 2k+1,d为节点向量维度.

这种链接序列化表示方法能够表达未连节点对在网络中与共邻间的局部拓扑关系.共邻与节点对交叉组合既表达其连接关系,又便于提取特定共邻与节点对的关系特征;共邻重排可以提升连接密切的共邻组合作用.

2 基于卷积神经网络的链接预测方法卷积神经网络[21]由于局部感受野具有极强的捕捉序列局部特征的能力.对于链接节点序列,局部的节点信息相关性较强,距离较远的节点信息相关性较弱,CNN可通过局部感受野提取潜在节点间关系特征,并在更高层将局部特征综合起来就得到全局的链接隐含结构特征,通过权值共享和池化,可显著降低网络的计算复杂度.

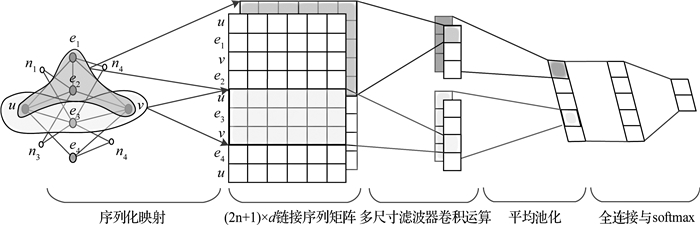

潜在链接的序列数据直观表达了节点对与共邻间的空间组合关系,通过卷积神经网络的多尺寸滤波器卷积运算即可提取其之间多种类型的节点序列组合特征.因此,本文的卷积神经网络模型结构(CNN-node2vec)就可设计如图 2所示.

|

图 2 链接预测的卷积神经网络结构图 Fig. 2 Convolution neural network structure of link prediction |

1) 潜在链接输入.

卷积神经网络的输入层I∈R(2n+1)×d为潜在链接的序列化矩阵表示Z.由于节点间共邻数目n不同,导致链接序列的不同长度输入问题,为此本文通过规定一个最大可输入节点序列长度,不足长度的序列部分进行零值填充,将链接序列长度化为一致.

2) 多尺寸滤波器卷积运算.

在卷积运算中,滤波器w∈Rh×d是一个高度为h个节点的卷积窗口,可以从链接序列中提取出局部的节点组合信息.

每个序列特征ci是滤波器窗口Si:i+h-1对链接矩阵经卷积运算得到

| $ {c_i} = f({w^i} \cdot {S_{i:i + h-1}} + {b^i}). $ | (7) |

其中, bi∈R是一个偏置项,f是一个非线性激活函数如双曲正切.

当滤波器w∈Rh×d从上到下以步幅2进行滑动,对链接矩阵的每个区域{S1:h, S3:h+2, S5:h+4,…,S2n-h+2:2n+1}进行卷积运算后将得到一个列数为1的序列特征图:

| $ c = [{c_1}, {c_2}, {c_3}, \cdots, {c_{2n-h + 2}}]. $ | (8) |

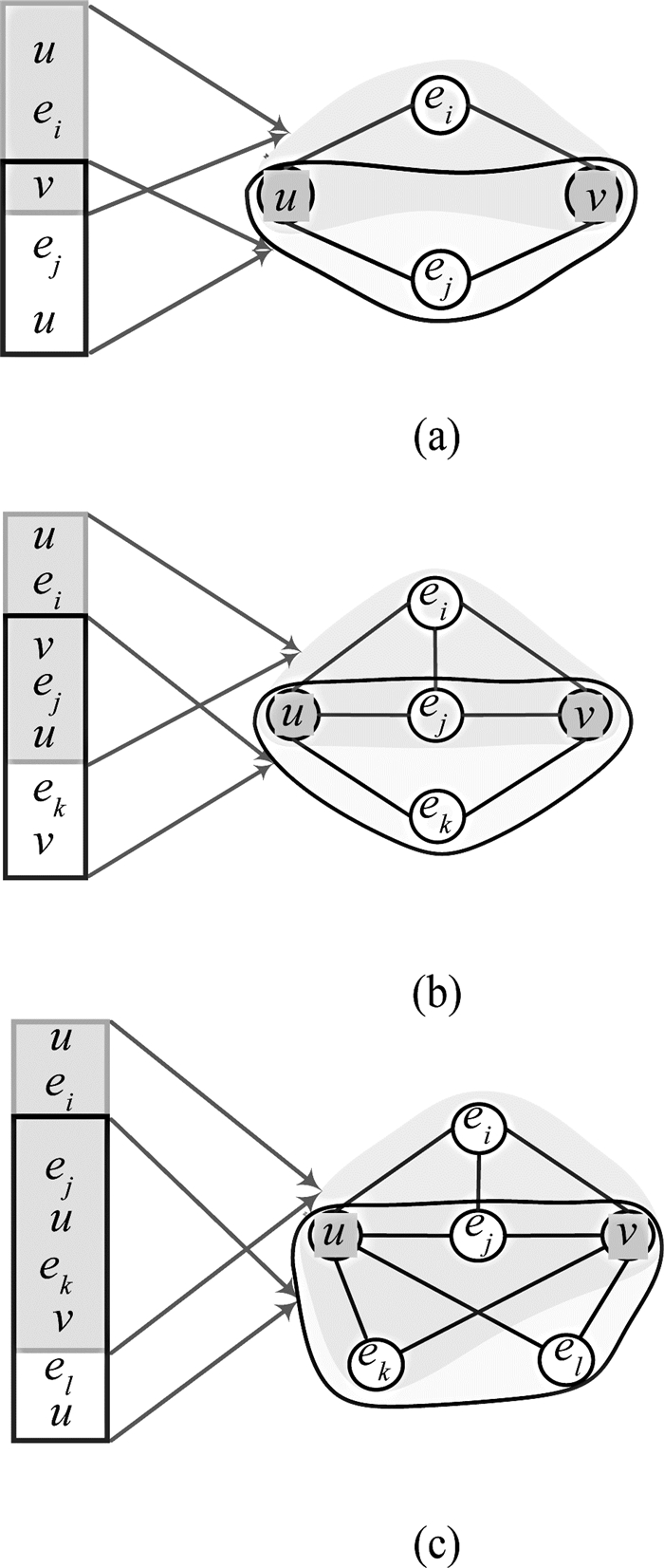

由1.2节的链接序列化表示方法可知,每间隔相邻的共邻连接较紧密,多种高度的卷积窗口可以从不同角度提取多样的相关共邻与节点对的隐含关系.高度h=3、5和7的卷积窗口将分别提取到序列中每个特定共邻(图 3(a))、2个连接紧密的共邻(图 3(b))和3个相关共邻(图 3(c))与节点对间的隐含关系特征ci.

|

图 3 多尺寸滤波器提取链接序列组合信息 Fig. 3 Link sequence combination information extracted by multi-size filters |

3) 平均池化.

在池化层,本文采用平均池化方式对序列特征图进行下采样处理.由于共邻数目为链接预测的影响因子,而链接序列化后的长度为2n+1,通过平均池化可将共邻数目进行权重化.节点间共邻数目越大,长度一致的链接序列中非零值就越多,平均池化后得到的特征值就越大.这种方式综合了所有共邻对链接预测产生的影响,全局决策潜在链接发生可能性.

4) 全连接与softmax.

每个序列特征图经过平均池化后将得到一个序列特征xi,对于有t个卷积核的卷积层则会在模型的倒数第二层形成t个对应的序列特征x={x1, x2,…,xt},并通过全连接方式连接softmax层,最终输出链接对应标签Y的概率分布.

为了提高模型的泛化能力,防止过拟合,在全连接层采用Dropout技术[22]对模型进行正则化处理,通过在前向传播过程中随机丢弃一些神经元(设置为0)来阻止隐含层单元的自适应.因此序列特征x经softmax层得到链接标签Y的概率分布将变为

| $ {\rm{P}}({\rm{Y}} = i\left| x \right., \boldsymbol{W}, \boldsymbol{b}) = {\rm{softma}}{{\rm{x}}_i}(\boldsymbol{W} \cdot (x \circ r) + \boldsymbol{b}). $ | (9) |

其中,“∘”为向量内积运算符,W为权值矩阵,b为偏置向量,i的取值为0或1, r∈ Rm服从以概率p随机生成0和1的Bernoulli分布.

5) 动态自适应.

由于预训练的节点特征向量是从网络全局学习的通用向量,为实现链接序列中节点向量能够更加贴近于具体的链接预测任务,本文在CNN模型训练过程中,通过将链接序列中节点向量经反向误差传播依据训练结果进行微调来动态更新节点向量,有效地实现了自适应提取潜在链接特征并提高分类精度.

3 实验与分析 3.1 数据集本文选取了4个不同领域的真实网络数据集验证方法,分别是Facebook社交网络(ego-Facebook)、Enron电子邮件通信网络(email-Enron)、Arxiv论文引用网络(cit-HepTh)和科学家合作网络(ca-AstroPh)[23],如表 1所示.表中,Vs为节点数,Es为边数,λ为平均聚类系数,Dn为平均节点度.由ego-Facebook的Vs=4 039,Dn=43.69,可知网络规模较小且稠密;由email-Enron的Vs=36 692,Dn=10.02,可知网络规模庞大且稀疏,cit-HepTh和ca-AstroPh网络稀疏度相似,但平均节点集聚程度差别较大.

| 表 1 社会网络数据集的属性参数 Table 1 Attribute parameters of social network datasets |

实验目标是预测不完整网络G=(V, E)中的缺失链接e∉E.为构造真实缺失部分边的网络,对上述4种完整网络数据集G′=(V′, E′),随机移除网络中50%的边作为数据集的正例,记作EP且EP⊂E′,此时更新后的不完整网络G中V=V′,E∪EP=E′.在网络G′中随机选取相等数量的不同最短路径长度的未连节点对作为负例,发现最短路径长度越大,预测效果越好,因此为提高本文模型的对抗性,以及考虑到随机选取网络中不存在链接容易出现大量不相关的未连节点对,不太符合实际中待预测的相关未连节点对,故选择最小最短路径长度为2的未连节点对作为负例,记作EN且EN∩E′=∅.

3.2 实验及结果分析 3.2.1 评价指标采用ROC曲线下面积AUC值和平均准确率(average precision, AP)指标作为该模型优劣的衡量标准.AP指标对应precision-recall曲线下面积,反映算法全局性能.而当数据集的类不平衡时,AUC指标能从整体上有效衡量算法的准确度,可理解为从测试集中随机选取一个链接的得分比一个随机选择不存在的链接得分高的概率,定义公式为

| $ {\rm{AUC}} = \frac{{n' + 0.5n''}}{n}. $ | (10) |

式中:n表示随机选择测试集中链接及不存在链接的独立比较次数,n′表示测试集中链接得分大于不存在链接的次数,n″表示两者得分相等的次数.AUC越接近1,则算法预测效果越好;若小于0.5,则算法比随机选择链接的准确度都低.

3.2.2 算法对比分析卷积神经网络模型的训练参数为:滤波器窗口的高度h=3,5和7,宽度w=128,每种尺寸滤波器的个数为20,Dropout率为0.5,非线性激活函数为修正线性单元ReLU,批处理大小为1 000,迭代次数为50次.

(1) 准确率对比分析.

分别选择基于共邻的经典方法Common Neighbors[19] (CN)、Jaccard系数、Adamic-Adar系数[24](AA),基于路径的预测方法PropFlow[25]、Katz系数、FriendLink[4]和基于节点向量的监督学习算法[14](LP-GBDT)进行对比,其中LP-GBDT的边特征g(u, v)是对未连节点对的节点向量fi(u)和fi(v)进行hadamard运算得到

| $ g(u, v) = {[f(u) \odot f(v)]_i} = {f_i}(u) \cdot {f_i}(v). $ | (11) |

采用一致性交叉验证和CNN参数初始化等方法消除随机因素影响,结果如表 2和3所示.由表 2和3可知,本文链接预测方法在4个典型数据集上的准确率均比已有方法具有显著提高,AUC值最大提高可达12.4%,对不同类型网络数据的适用及精确度提升,说明本文方法普适性较强.

| 表 2 不同链接预测算法的AP值比较 Table 2 AP comparison of different link prediction algorithms |

| 表 3 不同链接预测算法的AUC值比较 Table 3 AUC comparison of different link prediction algorithms |

大规模网络email-Enron和cit-HepTh结构上更稀疏,CNN-node2vec、LP-GBDT和基于路径的预测方法比基于共邻的方法的AUC值提高更多.因为采用监督学习网络的拓扑和路径游走,能训练和学习到稀疏网络中节点间隐含的拓扑关系特征;而基于共邻的方法结构比较单一,仅根据浅层邻近性质预测链接,当稀疏网络中链接邻近性质差别很小就难以区分.

针对不同的网络规模,本文方法在大规模网络ca-AstroPh中的效果提升比小规模网络ego-Facebook要高,因为该方法在训练中依据特定网络链接信息动态更新节点向量,能够从庞大数据集中学习到有用的链接拓扑信息,使其更适用于大规模网络;而LP-GBDT和基于路径的方法在ca-AstroPh上的效果却不理想,因为该网络平均节点集聚程度较大,网络分布不均匀,路径游走容易陷入局部稠密子网,而LP-GBDT通过二元操作节点向量无法获得动态的链接特征信息,在网络结构不规则时很难准确分类.

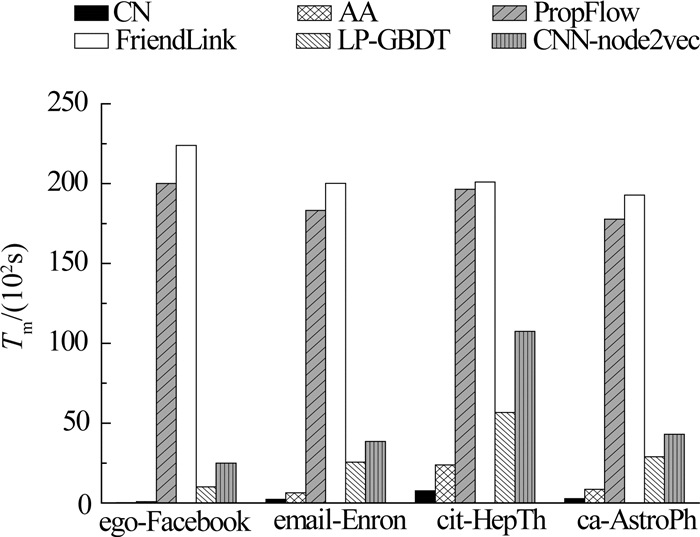

(2) 运算时间对比分析.

为比较算法的运行时间代价,将本文方法和已有方法在四个大规模网络数据集上的平均运算时间Tm进行了对比,结果如图 4所示.算法采用python2.7编程语言实现,运行环境为CPU 2.2GHZ,内存12 GB,硬盘465 G,64位windows10操作系统.

|

图 4 不同链接预测算法的平均运算时间比较 Fig. 4 Comparison of average operation times for different link prediction algorithms |

由图 4可知,基于路径的预测方法的平均运算时间远大于基于共邻的预测方法,特别是对于稠密网络ego-Facebook,而本文方法CNN-node2vec和LP-GBDT的平均运算时间介于两者之间.因为基于路径游走方法需要计算节点间的大量路径,将消耗许多时间,而基于监督学习方法的运算时间只耗费在训练过程中,对于CNN-node2vec方法训练好的模型参数可保存后再次利用,并可在网络变化后作迁移学习[26],利用效率较高.从图 4和表 3可看出,基于共邻的方法较适用于稠密网络,运算时间短而不失准确率,其他基于路径或监督学习的预测方法比较适用于稀疏网络.

(3) 稳定性对比分析.

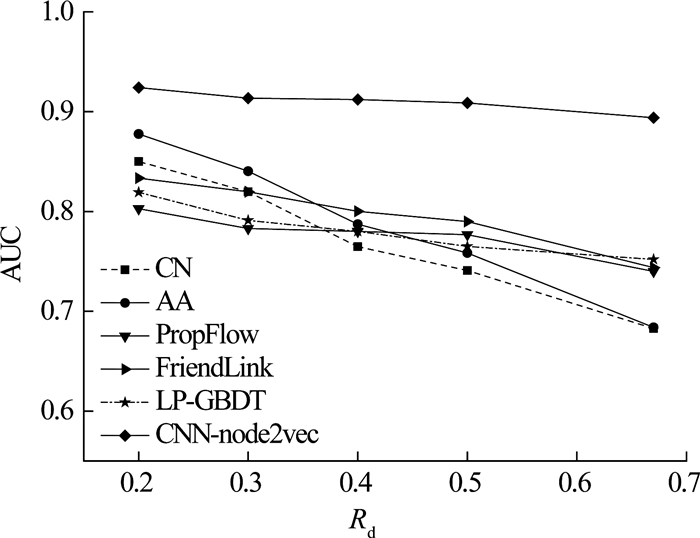

为验证算法的稳定性,实验中移除大规模稀疏网络email-Enron中不同比例Rd数量的边.针对节点规模相同但稀疏度不同的网络,进行已有方法和本文方法的稳定性比较,如图 5所示.

|

图 5 不同链接预测算法在稀疏度不等的网络中稳定性比较 Fig. 5 Comparison of stability for different link prediction algorithms in networks with different sparsities |

由图 5可知,随着网络的稀疏度增加,CNN-node2vec、LP-GBDT和基于路径的预测方法的AUC值变化很小,而基于共邻的方法则下降很快,稳定性较差,表明监督学习和路径游走方法对于稀疏网络数据具有可抗性;CNN-node2vec方法对不同稀疏度网络都有很好的效果,这是由于该方法融合网络全局拓扑信息和链接局部深层拓扑关系,能够从稀疏网络中挖掘到隐含的本质信息.

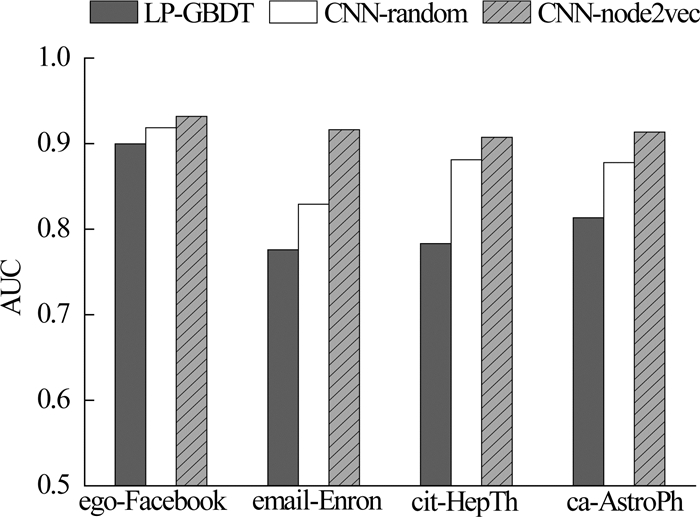

另外,为验证本文链接序列化表示及CNN提取链接序列组合特征的方法独立于node2vec算法的性能,实验对链接序列中的节点向量进行了随机化处理(CNN-random),即随机生成128维的值范围相同的随机向量,代替通过node2vec算法预训练得到节点向量表示.比较CNN-random与CNN-node2vec和LP-GBDT方法的效果,如图 6所示.

|

图 6 基于监督学习的链接预测算法准确率对比 Fig. 6 Comparison of accuracy for link prediction algorithms based on supervised learning |

由图 6可知,采用随机化节点向量的方法CNN-random比传统监督学习方法LP-GBDT的AUC值要高,表明链接序列化表示方法及CNN卷积操作提取序列中节点组合特征是有效的,不同节点向量预训练方法都可应用于本文模型,方法扩展性较强.但CNN-random方法比CNN-node2vec方法的AUC值要低于2%左右,说明预训练的全局节点向量更能充分表达一个特定节点,CNN能够依据网络结构挖掘特定节点对间的深层语义信息.

4 结语本文提出了一种链接序列化表示方法及CNN提取序列特征的链接分类模型,实现了自适应提取潜在链接特征,有效地预测了未知链接发生可能性.基于网络拓扑序列化思想,将未连节点对间的局部拓扑序列化映射为共邻连接紧密的有序节点序列,并用node2vec节点向量进行表达;受NLP中句子建模启发,采用CNN可变滤波器窗口卷积运算提取序列中共邻与节点对间多层次隐含关系特征,分类训练实现链接的有效预测.在4个真实数据集上对该模型和已有方法进行了对比实验,结果表明该方法相比已有的方法效果具有很大提升.

由于社会网络中有向网络皆可转化为无向网络,而加权的网络可在节点向量预训练方法的随机游走中融入边权进行加权随机游走获得节点序列,因此本文算法适用于所有类型的连通网络数据集,普适性及扩展性较强,特别适用于大规模稀疏网络.如何在大规模网络数据集中降低计算复杂度,是进一步研究的内容,未来工作可结合复杂网络结构的更多性质(如:动态性),融合表示学习和深度学习处理更多的图挖掘任务.

| [1] |

BUCCAFURRI F, LAX G, NOCERA A, et al. Discovering missing me edges across social networks[J]. Information Sciences, 2015, 319(C): 18-37. |

| [2] |

LIU H. Uncovering the network evolution mechanism by link prediction[J]. Scientia Sinica, 2011, 41(7): 816-823. |

| [3] |

KUMAR R, NOVAK J, TOMKINS A. Structure and evolution of online social networks[C]//Proceedings of the 12th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York:ACM, 2006:611-617. http://dl.acm.org/citation.cfm?id=1150476

|

| [4] |

PAPADIMITRIOU A, SYMEONIDIS P, MANOLOPO ULOS Y. Fast and accurate link prediction in social networking systems[J]. Journal of Systems and Software, 2012, 85(9): 2119-2132. DOI:10.1016/j.jss.2012.04.019 |

| [5] |

DONG Y, TANG J, WU S, et al. Link prediction and recommendation across heterogeneous social networks[C]//IEEE International Conference on Data Mining. Brussels:IEEE, 2013:181-190. http://ieeexplore.ieee.org/document/6413904/

|

| [6] |

BACKSTROM L, LESKOVEC J. Supervised random walks:predicting and recommending links in social networks[C]//Proceedings of the Fourth ACM International Conference on Web Search and Data Mining. Hong Kong:ACM, 2011:635-644. http://dl.acm.org/citation.cfm?id=1935914

|

| [7] |

KAYA B, POYRAZ M. Age-series based link prediction in evolving disease networks[J]. Computers in Biology and Medicine, 2015, 63(C): 1-10. |

| [8] |

刘智慧, 张泉灵. 大数据技术研究综述[J]. 浙江大学学报:工学版, 2014, 48(6): 957-972. LIU Zhi-hui, ZHANG Quan-ling. Research overview of big data technology[J]. Journal of Zhejiang University:Engineering Science, 2014, 48(6): 957-972. |

| [9] |

LIBEN-NOWELL D, KLEINBERG J. The link prediction problem for social networks[J]. Journal of the Association for Information Science and Technology, 2007, 58(7): 1019-1031. |

| [10] |

HASAN, MOHAMMAD A. Link prediction using supervised learning[J]//Workshop on Link Analysis Counter-terrorism and Security, 2006, 30(9):798-805. http://www.mendeley.com/catalog/link-prediction-using-supervised-learning-9/

|

| [11] |

LESKOVEC J, HUTTENLOCHER D, KLEINBERG J. Predicting positive and negative links in online social networks[C]//Proceedings of the 19th International Conference on World Wide Web. Raleigh:ACM, 2010:641-650. http://portal.acm.org/citation.cfm?doid=1772690.1772756

|

| [12] |

ZHOU T, LV L, ZHANG Y C. Predicting missing links via local information[J]. The European Physical Journal B, 2009, 71(4): 623-630. DOI:10.1140/epjb/e2009-00335-8 |

| [13] |

SCHLICHTKRULL M, KIPF T N, BLOEM P, et al. Modeling relational data with graph convolutional networks[EB/OL].[2017-04-14]. https://arxiv.org/pdf/1703.06103.pdf.

|

| [14] |

GROVER A, LESKOVEC J. node2vec:Scalable feature learning for networks[C]//Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. San Francisco:ACM, 2016:855-864. http://europepmc.org/articles/PMC5108654/table/T3/

|

| [15] |

KIM Y. Convolutional neural networks for sentence classification[EB/OL].[2017-04-14]. https://arxiv.org/pdf/1408.5882.pdf.

|

| [16] |

KALCHBRENNER N, GREFENSTETTE E, BLUNSOM P. A convolutional neural network for modelling sentences[EB/OL].[2017-04-14]. https://arxiv.org/pdf/1404.2188.pdf.

|

| [17] |

ZHANG Y, WALLACE B. A sensitivity analysis of (and practitioners' guide to) convolutional neural networks for sentence classification[EB/OL].[2017-04-14].https://arxiv.org/pdf/1510.03820.pdf.

|

| [18] |

PEROZZI B, ALRFOU R, SKIENA S. DeepWalk:online learning of social representations[C]//Proceedings of the 20th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York:ACM, 2014:701-710. http://dl.acm.org/citation.cfm?id=2623732

|

| [19] |

NEWMAN M E. Clustering and preferential attachment in growing networks[J]. Physical Review E Statistical Nonlinear and Soft Matter Physics, 2001, 64(2): 025102. DOI:10.1103/PhysRevE.64.025102 |

| [20] |

LV L, ZHOU T. Link prediction in complex networks:a survey[J]. Physical A:Statistical Mechanics and its Applications, 2011, 390(6): 1150-1170. DOI:10.1016/j.physa.2010.11.027 |

| [21] |

李彦冬, 郝宗波, 雷航. 卷积神经网络研究综述[J]. 计算机应用, 2016, 36(9): 2508-2515. LI Yan-dong, HAO Zong-bo, LEI Hang. Research overview of convolutional neural network[J]. Application of Computers, 2016, 36(9): 2508-2515. DOI:10.11772/j.issn.1001-9081.2016.09.2508 |

| [22] |

HINTON G E, SRIVASTAVA N, KRIZHEVSKY A, et al. Improving neural networks by preventing co-adaptation of feature detectors[J]. Computer Science, 2012, 3(4): 212-223. |

| [23] |

LESKOVEC J. Stanford large network dataset collection[EB/OL].[2017-04-14]. http://snap.stanford.edu/data/index.html.

|

| [24] |

ADAMIC L A, ADAR E. Friends and neighbors on the web[J]. Social Networks, 2003, 25(3): 211-230. DOI:10.1016/S0378-8733(03)00009-1 |

| [25] |

LICHTENWALTER R N, LUSSIER J T, CHAWLA N V. New perspectives and methods in link prediction[C]//Proceedings of the 16th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. Washington:ACM, 2010:243-252. http://dl.acm.org/citation.cfm?doid=1835804.1835837

|

| [26] |

庄福振, 罗平, 何清, 等. 迁移学习研究进展[J]. 软件学报, 2015, 26(1): 26-39. ZHUANG Fu-zhen, LUO Ping, HE Qing, et al. Survey on transfer learning research[J]. Journal of Software, 2015, 26(1): 26-39. |