2. 长春工程学院 机电工程学院, 吉林 长春 130000

2. School of Mechatronics Engineering, Changchun Institute of Technology, Changchun 130012, China

路口交通控制信号的作用是从时间上分离相互冲突的交通流, 使车辆在不同时间段通过, 保证行车安全.然而城市信号交叉口往往是整个城市路网的瓶颈, 其通行能力决定并制约着整个城市路网的通行能力[1].因此, 存在很多关于信号灯路口辅助驾驶的研究以期能够改善信号灯路口的通行效率.Rittger等[2]分析了信号灯路口前的驾驶行为, 认为辅助驾驶系统能够提升驾驶效率, 并提出了一个辅助驾驶系统, 该系统通过不同的传感器以及汽车-基础设施通信(vehicle-to-infrastructure, V2I)获得信号灯及道路信息.Barth等[3]通过传感器和车路通信装置获得路面的信号灯信息, 并通过辅助驾驶模型给出缓慢加速、平稳驾驶等建议以实现经济驾驶.Li等[4]通过车辆基础设施一体化技术获得道路信息并通过信号灯控制器获得信号灯的状态列表, 提出了新的驾驶报警系统, 该系统能够减少驾驶员在信号灯前的急刹车, 并研究了系统在节能方面的潜在效益.靳秋思等[5]提出了信号灯路口的生态驾驶轨迹优化策略, 通过短时无线通信技术获得信号灯配时信息.王建强等[6]开发了可变速度限制一体化的信号灯路口车辆驾驶辅助系统, 使用无线射频技术识别GPS和车速信息, 能够提高信号灯路口的行车安全.安实等[7]在默认信号灯相位信息可获得的情况下, 提出了基于多级的信号交叉口绿色驾驶控制方法, 能够降低交叉口的车辆延误.

以上研究成果都是基于交通信号灯相位信息可获得的基础上实现的, 其中, 信号灯相位是指路口信号灯显示状态的持续时间, 即红灯或绿灯的持续时间, 该信息的获取需要得到交通部门的允许和支持, 并安装信号灯接收和发送装置, 这在现有条件下难以实现.因此大部分信号灯路口辅助驾驶系统目前仍停留在理论研究和场地实验阶段[8-9].

针对上述情况, 提出一种基于单一摄像头的辅助驾驶方法.本文分3个方面展开研究:信号灯倒计时识别研究、信号灯与车辆间的距离估计模型以及提升通行效率的辅助驾驶方法.

1 信号灯倒计时识别及距离估计模型 1.1 信号灯及倒计时识别使用颜色生成信号灯候选区域.与很多只在单个色彩空间上考虑问题的现有方法不同, 为了能够适应复杂的环境和光照变化, 在生成候选区域时考虑多个不同的色彩空间.RGB色彩空间是设备相关的色彩空间, R、G、B分别表示红、绿、蓝3个独立的分量;HSV和LAB的色彩空间与人类的感知更为接近, H、S、V分别表示色调、饱和度和明度;LAB的3个通道中L通道表示亮度, A通道的正数代表红色, 负数代表绿色, B通道的正数代表黄色, 负数代表蓝色.将原始的RGB彩色图像分别转换为LAB色彩空间和HSV色彩空间, 并通过同时对LAB的A通道、HSV的H通道以及RGB空间的G通道与R通道的差值设定阈值来选定候选区域, 方法如下:

| $\begin{array}{l} I\left( {a,b} \right) = \left\{ {\begin{array}{*{20}{l}} {2,} & {{\rm{if\;conditions;}}}\\ {0,} & {\;\;{\rm{otherwise}}{\rm{.}}} \end{array}} \right.\\ {\rm{conditions}}:H\left( {a,b} \right) \in ({t_{{\rm{Hmi}}}},{t_{{\rm{Hma}}}})\\ \left| {A\left( {a,b} \right) \in ({t_{{\rm{Ami}}}},{t_{{\rm{Ama}}}})} \right|R\left( {a,b} \right) - G\left( {a,b} \right) > {t_{{\rm{RG}}}}. \end{array}$ | (1) |

式中:I(a, b)为图像在(a, b)位置的像素值;H(a, b)、A(a, b)、R(a, b)和G(a, b)分别表示HSV的H通道、LAB的A通道、RGB空间的G通道与R通道在(a, b)位置的值;tHmi、tHma为对H通道设定的最小和最大阈值;tAmi、tAma为对A通道设定的最小和最大阈值;tRG为对G通道与R通道的差值设定的阈值.

根据式(1), 通过二值化的方法获取图像中的候选区域.其中LAB空间的A通道在表示颜色时, 红色为正值, 绿色为负值, 非常适合区分红色和绿色[10];HSV空间的H通道能够适应较弱或较强的光照[11];RGB空间中的R通道与G通道的差值用来着重区分图像中的绿色部分.在综合考虑不同的色彩空间时, 并没有采用相互约束而是采用相互补充的方式来保证候选区域尽可能多地覆盖到交通信号灯.但该种方法在尽可能减少漏检的情况下, 也造成一定量的误检, 因而要通过大小、形状和位置信息去除掉一些误检的候选区域.通过大量路面实验发现, 当摄像的位置固定时, 信号灯一般位于摄像头视野的上方1/2处, 且形状上满足

| ${\rm{max }}(w,h) < 2 \cdot {\rm{min }}(w,h).$ | (2) |

式中:w和h分别为候选区域的宽和高, max (w, h)为取候选区域宽与高的最大值, min (w, h)为取其最小值.所选出的候选区域将通过加权的K近邻算法(weighted K-nearest neighbor, WKNN)进行筛选.

WKNN模型首先构建训练样本集Ω, Ω={(xi, ci)|i=1, 2, …, n}.其中xi=(xi1, xi2, …, xil)为l维特征向量, 每一个训练样本的特征向量维数是相同的, xih为第i个训练样本的第h个特征值, n为训练样本集的大小.ci表示第i个训练样本的类别, 且ci属于类别样本C={1, 2, …, t}, t为样本类别的个数.共存在2个类别:信号灯类和非信号灯类.测试样本集用φ={yj|j=1, 2, …, m}, 其中yj=(yj1, yj2, …, yjl), m为测试样本集的大小.通过相似度来计算测试样本yi的邻居样本, 并以相似度的值作为每个邻居的权重, 相似度的计算方法为

| ${\rm{sim}}\left( {{x_i},{y_j}} \right) = {\rm{exp}}\left[ { - {w_{\rm{e}}} \cdot {{\left( {\sum\limits_{h = 1}^l {{{\left( {x_i^h - y_j^h} \right)}^2}} } \right)}^{1/2}}} \right]$ | (3) |

式中:we为调节参数.

通过相似度的比较, 在训练样本中找到相似度值最大的K个样本, 用x1, x2, …, xK表示, 设离散的目标函数为g: Rn→ci, 表示第i个类别标签, Rn为待分类的集合.

| $\begin{array}{l} \tilde g\left( {{y_j}} \right) = \\ {\rm{arg max}}\sum\limits_{i = 1}^K {\{ \delta \left[ {c,g\left( {{x_i}} \right)} \right] \cdot {\rm{sim}}\left[ {g\left( {{x_i},{y_j}} \right)} \right]\} } . \end{array}$ | (4) |

| $\delta \left( {a,b} \right) = \left\{ {\begin{array}{*{20}{l}} {1,} & {a = b;}\\ {0,} & {a \ne b.} \end{array}} \right.$ | (5) |

式中:

通过WKNN对候选区域分类, 确定信号灯在图像中的位置.根据信号灯的安装方法, 倒计时与信号灯之间存在一定位置关系, 根据该位置关系, 找到倒计时所在的位置, 同时截取出信号灯倒计时图像, 如图 1所示.采集到的倒计时图像一般由2个数字组成, 如果按图像整体进行分类, 则类别数最多时会达到99个, 类别过多, 分类难度加大, 因此将倒计时图像分为2个数字, 并分别使用WKNN完成识别.

|

图 1 使用加权K近邻方法检测到的信号灯倒计时区域 Fig. 1 Detected countdown region of traffic light using weighted K-nearest neighbor |

在实际的辅助驾驶系统中, 实时地获得车辆与信号灯之间的距离以及速度信息, 能够使辅助驾驶控制更加精确有效.目前现有的大部分系统, 实时距离信息是根据车辆的地图定位信息和信号灯位置信息计算得到;也有一些使用道路设置的开关信息, 但该方法不能实时获得距离信息, 只能在到达某一固定距离时触发提示,而且上述系统都需要在道路或车辆上安装额外设备[12-14].本文提出的方法不需要安装其他设备, 仅通过单一摄像头就可以估计出车辆与信号灯之间的距离.根据国标GB14887[15]规定, 道路上的交通信号灯的实际尺寸是固定的, 正负误差不超过2 mm.因此, 可以根据识别出的信号灯在图像中的尺寸、实际尺寸、摄像头的视野宽度等估算出信号灯与车载摄像头间的距离, 即信号灯与车辆间的距离.

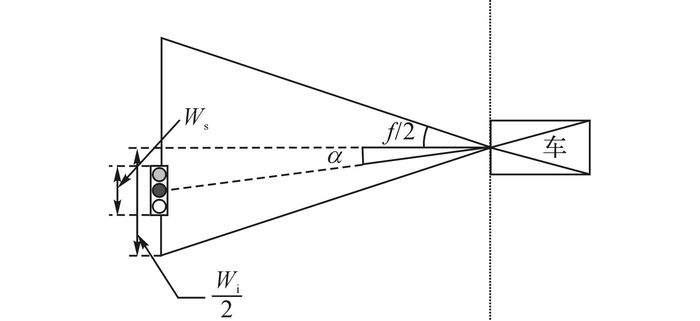

基于图像识别的车载摄像头与信号灯间距离计算示意图如图 2所示, f为摄像头的视野宽度, Ws为信号灯板的长度, Wi为图像的宽度, α为信号灯与车载摄像头正前方中心线之间的夹角, t时刻车载摄像头与信号灯之间的距离为

|

图 2 基于图像识别的车载摄像头与信号灯间距离计算示意图 Fig. 2 Schematic diagram of distance estimation between vehicle camera and traffic light based on image recognition |

| $d_{\rm{s}}^t = \frac{{{W_{\rm{i}}} \cdot \eta }}{{W_{\rm{s}}^t \cdot 2{\rm{tan}}\left( {f/2} \right) \cdot {\rm{cos}}\alpha }}$ | (6) |

| ${\rm{cos}}\alpha = \frac{{2W_{\rm{s}}^t}}{{\eta \cdot {W_{\rm{i}}} \cdot {{\left( {d_{\rm{s}}^t} \right)}^2} \cdot 2{\rm{tan}}\left( {f/2} \right)}}$ | (7) |

式中:η为真实场景下信号灯的宽度, Wst为t时刻图像中信号灯灯板的长度.

在具体实现过程中, 即使检测结果正确, 也会出现几个像素的偏差, 这种偏差容易导致距离信息的波动.同时, 在实际采集的图像中发现, 随着使用年限的增加, LED材质的信号, 灯的形状会发生细微变化(如:变小), 这些都容易导致距离的波动.因此, 当一幅图像中存在多个信号灯时, 需要根据前Nf帧的图像识别结果,选择趋势最接近的距离数据作为拟合优化距离的计算结果.但由于车辆突然强烈颠簸等问题, 在距离估计的过程中会出现一些异常点, 通过3σ法则判断数据是否在误差范围内, 如果误差在可接受范围内则作为最终结果, 如果误差在可接受范围外则通过傅里叶二阶拟合确定最终结果.通常对每Nf(Nf≤30) 帧图像的计算结果进行一次拟合, 数据重叠处理.由于目前的视频图像采样频率为30 fps, 为了保证拟合的准确性, 用于拟合的样本数据应该足够多, 在实验过程中Nf取值29.傅里叶二阶拟合公式为

| $\begin{array}{l} d\left( t \right) = {a_0} + {a_1} \cdot {\rm{cos}}\left( {t\lambda } \right) + {b_1} \cdot {\rm{sin}}\left( {t\lambda } \right) + \\ \quad \quad {a_2} \cdot {\rm{cos}}\left( {2t\lambda } \right) + {b_2} \cdot {\rm{sin}}\left( {2t\lambda } \right). \end{array}$ | (8) |

式中:d(t)为拟合得到的t时刻的距离, λ用来调整三角函数的周期.

通过相邻前29帧数据的拟合得到式(8) 中的a0、a1、a2、b1、b2、λ等参数, 然后估计第30帧图像, 距离拟合优化算法每次发现异常点时都会根据相邻数据计算出一组新的参数.每帧图像都可以得到当前时刻车辆与信号灯之间的距离, 当确定摄像头的配置参数时, 图像间的时间差可以同时确定(30 fps, 相邻帧间时间差为1/30 s), 则车辆在t时刻的行驶速度为

| ${V_t} = \frac{{d_{\rm{s}}^{t2} - d_{\rm{s}}^{t1}}}{{\left( {{t_2} - {t_1}} \right)/30}}.$ | (9) |

式中:t1、t2表示t时刻前的2个时刻, dst1、dst2表示t1、t2时刻时信号灯与车辆之间的距离.系统设定每秒计算得到10组距离和速度数据, 并将得到的距离和速度作为辅助驾驶系统的判断条件.

1.3 实验及分析加权K近邻算法在倒计时的识别中也取得了较好的效果.如表 2所示为车辆与信号灯处于不同距离时倒计时的识别准确率, D为图像采集时与信号灯间的距离.当距离为60 m左右时, 采集图像的识别准确率为97.13%, 完全能够满足辅助驾驶的要求.因此设定辅助驾驶的控制范围为信号灯前60 m.

| 表 2 基于加权K近邻方法模型的信号灯倒计时识别准确率 Table 2 Recognition results of traffic light countdown using weighted K-nearest neighbor model |

为了能够客观评价信号灯检测识别的效果通常用查准率Pre、查全率Rec和准确率Acc这3个评价指标进行评价[16], 评价计算方法如下:

| ${P_{{\rm{re}}}} = \frac{{{T_{\rm{P}}}}}{{{T_{\rm{P}}} + {F_{\rm{P}}}}}$ | (10) |

| ${R_{{\rm{ec}}}} = \frac{{{T_{\rm{P}}}}}{{{T_{\rm{P}}} + {F_{\rm{N}}}}}$ | (11) |

| ${A_{{\rm{cc}}}} = \frac{{{T_{\rm{P}}} + {T_{\rm{N}}}}}{{{T_{\rm{P}}} + {F_{\rm{N}}} + {F_{\rm{P}}} + {T_{\rm{N}}}}}$ | (12) |

式中:TP为正确的正例, FP为错误的正例, FN为错误的反例, TN为正确的反例.当检测出的信号灯区域和信号灯真实区域覆盖率大于40 %, 认为检测结果正确.

现有的信号灯验证数据集分为2类:公开的基准数据集[17-18]、作者自采集的本地数据集[19, 20].在公开基准数据集LaRA(由法国La Route Automatisée机构提供)[21]和作者采集的本地数据集上完成信号灯识别模型的验证实验, 如表 1所示.S为数据集规模, 即数据集中图像的个数;NTL为整个数据集的所有图像包含信号灯的个数;P为数据集中图像的尺寸, TC为每幅图像的平均时间开销.

| 表 1 信号灯识别模型验证试验结果 Table 1 Verification experiment results of traffic light recognition model |

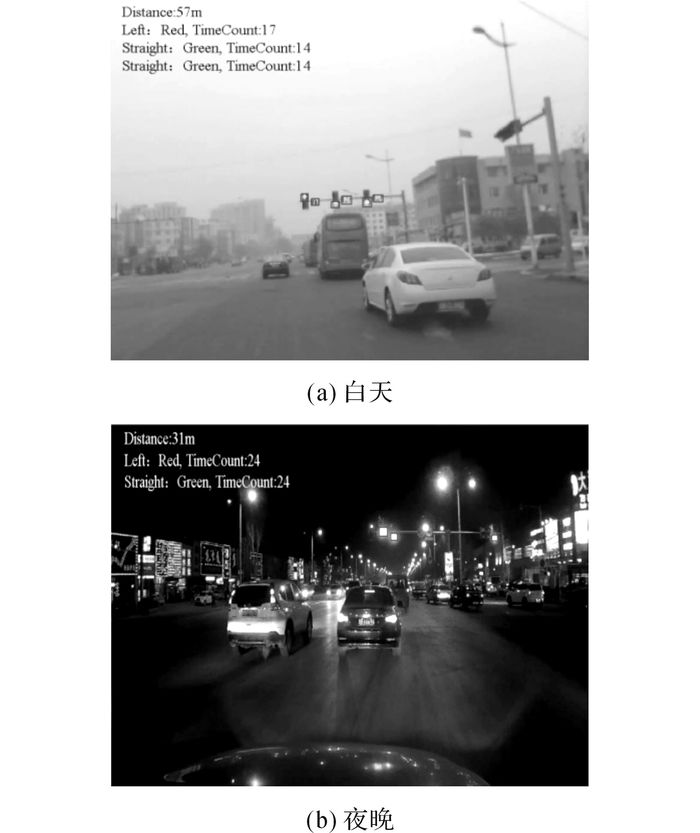

在实际图像上的图像识别系统结果如图 3所示, 系统自动将距离估计与信号灯颜色和倒计时识别的结果显示在图像的左上角.如图 3(a)所示, 车辆当前距离信号灯57 m(图中显示为Distance: 57 m);左转为红灯, 倒计时时间为17 s(图中显示为Left: Red;Countdown: 17);直行为绿灯, 倒计时时间为14 s(图中显示为Straight: Green;Countdown: 14).如图 3(b)所示, 车辆当前距离信号灯31 m(图中显示为Distance:31 m);左转为红灯, 倒计时时间24 s(图中显示为Left: Red;Countdown: 24);直行为绿灯, 倒计时时间24 s(图中显示为Straight: Green;Countdown: 24).

|

图 3 信号灯倒计时识别系统结果图 Fig. 3 Results of traffic light countdown recognition system |

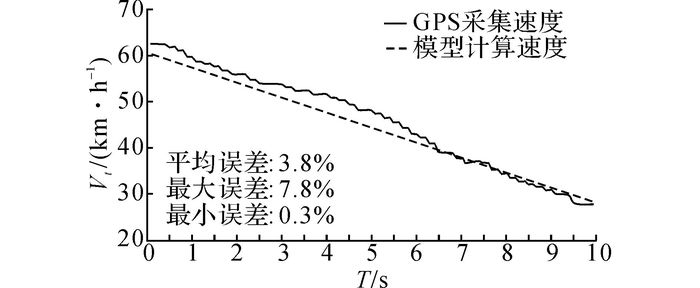

由于速度结果是根据距离计算得到, 通过将计算得到的速度与实测GPS车速对比, 既可以验证速度的准确性,也可以间接验证距离的准确性, 对比结果如图 4所示, T为时间,由于距离数据通过拟合的方式做了平滑处理, 由距离数据计算得到速度数据比较光滑.实验采用的GPS接收器型号为SUN-NVC300R, 位置精度为1.5 m, 速度精度为0.05 m/s, 更新率10 Hz.如图 4所示, 模型计算速度与GPS测量速度的平均误差绝对值小于5%.

|

图 4 基于图像识别结果的计算车速与GPS实际车速对比图 Fig. 4 Comparison between computing velocity based on image recognition results and GPS velocity |

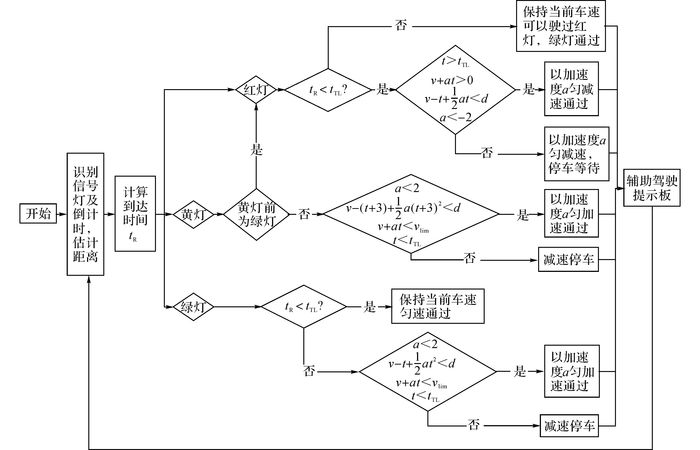

为了提出更准确的辅助驾驶建议, 首先应根据信号灯的相位、倒计时、距离和速度信息判断车辆和信号灯当前所处的状态.将当前行驶车辆和信号灯作为一个整体, 这一整体分为4个状态:持续绿灯、绿灯转红灯、持续红灯、红灯转绿灯.这4个状态分别对应4种控制工况:匀速通过(工况一)、加速通过(工况二)、减速通过(工况三)和减速停车(工况四).如图 5所示.

|

图 5 4种不同工况下的车速控制曲线 Fig. 5 Velocity control schematic diagram under four different conditions |

在具体判断所处状态时, 应首先识别出信号灯倒计时为tTL, 然后计算当前车辆与信号灯之间的距离dst和车辆速度Vt信息, 计算出车辆到达信号灯前的时间tR, 比较tTL和tR, 判断车辆是否能够通过信号灯, 并给出具体的建议, 具体的处理流程如图 6所示.另外, 当需要加速才能通过信号灯时, 加速后的速度不能超过道路限速, 加速过程中应保证平稳驾驶, 即加速度应尽可能小;需要减速通过时, 减速度尽可能小.在行驶过程中驾驶员根据驾驶建议完成操作后, 车辆速度随即发生变化, 系统将重新完成识别过程, 重新给出建议.

|

图 6 基于图像识别的辅助驾驶策略流程图 Fig. 6 Flowchart of driving assistance model based on image recognition |

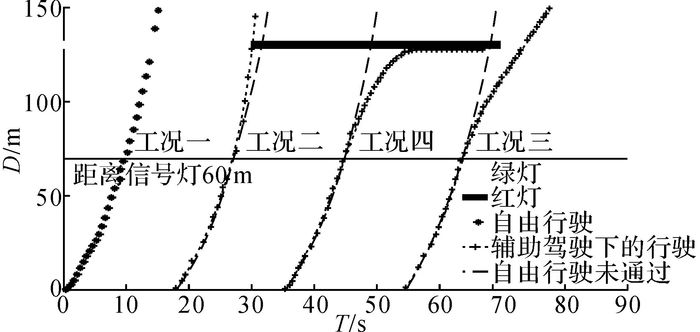

根据图像识别方法获得的信号灯信息和距离信息以及辅助驾驶方法, 由Matlab软件模拟获得的实际行驶工况下的时空轨迹图如图 7所示.从距离信号灯60 m处开始优化.在工况一时车辆能够通过信号灯无需优化;在工况二和工况三时, 自由行驶时需要停车等待, 优化后可以通过加速或减速的方式避免停车等待提升效率;当减速也无法通过时, 会提前减速停车, 提升驾驶的舒适性.所有实验所用的计算机, 硬件配置为2.5 GHz的Pentium (R) Dual-Core CPU, 2.0 G内存, 操作系统为Windows7, 软件环境为Matlab2010a.系统最主要的时间开销为图像处理时间, 其他时间开销可以忽略不计.图像像素不同, 则时间开销不同.经过多次反复实验, 尺寸为640×480图像的平均时间开销为65.09 ms, 尺寸为1 920×1 080图像的平均时间开销为85.84 ms.因此整个系统的时间开销约为65.09~85.84 ms, 能够满足实际要求.

|

图 7 车辆通过信号灯路口仿真模拟时空轨迹图 Fig. 7 Simulated space-time trajectory map of driving through traffic light intersection |

本研究提出了一种仅基于单一摄像头的辅助驾驶方法.该方法不需要任何其他辅助设备, 仅根据摄像头采集的图像, 使用图像处理方法获得信号灯的相位、倒计时信息以及距离和速度信息.所提出的加权K近邻模型能够准确识别出信号灯和倒计时, 信号灯的准确率在公开数据集上能达到97.49%, 在作者采集的本地数据集上能达到98.95%, 倒计时的准确率在车辆与信号灯之间的距离为60 m时能达到97.13%, 满足辅助驾驶系统的需要.由所提出的距离和速度估计方法求得的速度平均误差小于5%.基于得到的信号灯、距离和速度信息, 所提出的辅助驾驶方法在模拟验证实验中能够提升车辆的通行效率.

| [1] |

杨晓光, 庄斌, 李克平. 信号交叉口饱和流率和启动延误的影响分析[J].

同济大学学报:自然科学版, 2006, 34(6): 738–743.

YANG Xiao-guang, ZHUANG Bin, LI Ke-ping. Analysis of saturation flow rate and delay at signalized intersection[J]. Journal of Tongji University: Natural Science, 2006, 34(6): 738–743. |

| [2] | RITTGER L, SCHMIDT G, MAAG C, et al. Driving behaviour at traffic light intersections[J]. Cognition, Technology and Work, 2015, 17(4): 593–605. DOI:10.1007/s10111-015-0339-x |

| [3] | BARTH M, MANDAVA S, Boriboonsomsin K, et al. Dynamic ECO-driving for arterial corridors [C] //Proceedings of the IEEE Forum of Integrated Sustainable Transportation. Vienna Austria: IEEE, 2011: 182-188. |

| [4] | LI M, BORIBOONSOMSIN K, WU G Y, et al. Traffic energy and emission reductions at signalized intersections: a study of the benefits of advanced driver information[J]. International Journal of ITS Research, 2009, 7(1): 49–58. |

| [5] |

靳秋思, 宋国华, 叶蒙蒙, 等. 车辆通过交叉口的生态驾驶轨迹优化研究[J].

安全与环境工程, 2015, 5(3): 75–82.

JIN Qiu-si, SONG Guo-hua, YE Meng-meng, et al. Optimization of eco-driving trajectories at intersections for energy saving and emission reduction[J]. Safety and Environmental Engineering, 2015, 5(3): 75–82. |

| [6] |

王建强, 王海鹏, 刘佳熙, 等. 基于车路一体化的交叉口车辆驾驶辅助系统[J].

中国公路学报, 2013, 6(4): 169–175.

WANG Jian-qiang, WANG Hai-peng, LIU Jia-xi, et al. Intersection vehicle driving assistance system based on vehicle-to-infrastructure communication[J]. China Journal of Highway and Transport, 2013, 6(4): 169–175. |

| [7] |

安实, 姚焓东, 姜慧夫, 等. 信号交叉口绿色驾驶车速控制方法[J].

交通运输系统工程与信息, 2015, 15(5): 53–59.

AN Shi, YAO Han-dong, JIANG Hui-fu, et al. A green driving speed control method at signal intersection[J]. Journal of Transportation Systems Engineering and Information Technology, 2015, 15(5): 53–59. |

| [8] | CHEN W, BAI Y, YANG X. Delay estimation undera dynamic speed control based intersection [C] // Transportation Research Board 92nd Annual Meeting. Washington DC: [s.n.], 2013: 2570-2587. |

| [9] | RAKHA H, KAMALANATHSHARMA R K. Eco-driving at signalized intersections using V2I communication [C] // 2011 14th International IEEE Conference on Intelligent Transportation Systems. Washington DC: IEEE, 2011: 341-346. |

| [10] |

王可, 陆长德, 乐万德, 等. 基于Lab均匀色彩空间的色彩调和系统[J].

西北工业大学学报, 2004, 22(6): 695–698.

WANG Ke, LU Chang-de, YUE Wan-de, et al. Color harmony system based on Lab perceptual uniform color space[J]. Journal of North Western Polytechnical University, 2004, 22(6): 695–698. |

| [11] |

李微, 李德仁. 基于HSV色彩空间的MODIS云检测算法研究[J].

中国图象图形学报, 2011, 16(9): 1696–1701.

LI Wei, LI De-ren. The cloud detection study of modis based on HSV colors pace[J]. Journal of Image and Graphics, 2011, 16(9): 1696–1701. DOI:10.11834/jig.100407 |

| [12] | WU L N, CI Y S, CHU J W, et al. The influence of intersections on fuel consumption in urban arterial road traffic: a single vehicle test in Harbin, China[J]. PLoS One, 2015, 10(9): 1–10. |

| [13] | LEE J, PARK B. Development and evaluation of a cooperative vehicle intersection control algorithm un the connected vehicles environment[J]. IEEE Transactions on Intelligent Transportation Systems, 2012, 13(1): 81–90. DOI:10.1109/TITS.2011.2178836 |

| [14] | NIU D N, SUN J. Eco-driving versus green wave speed guidance for signalized highway traffic: a multi-vehicle driving simulator study[J]. Procedia-Social and Behavioral Sciences, 2013, 96: 1079–1090. DOI:10.1016/j.sbspro.2013.08.124 |

| [15] | DIAZ-CABRERA M, CERRI P, MEDICI P. Robust real-time traffic light detection and distance estimation using a single camera[J]. Expert Systems with Applications, 2015, 42(8): 391–3923. |

| [16] | 中华人民共和国质量监督检疫检疫质量总局. 道路交通信号灯: GB/T 14887-2011[S/OL]. 北京: 中国标准出版社, 2012: 3 [2015-12-22]. http://www.122.cn/zcfg/flfl/gjbz/570885.shtm. |

| [17] | HALTAKOV V, MAYR J, UNGER C, et al. Semantic segmentation based traffic light detection at day and at night[M]. Berlin: Pattern Recognition, 2015: 446-457. |

| [18] | SIOGKAS G, SKODRAS E, DERMATAS E. Traffic lights detection in adverse conditions using color, symmetry and spatiotemporal information [C] // International Conference on Computer Vision Theory and Applications. Rome: VISAPP, 2012: 620-627. |

| [19] | SOOKSATRA S, KONDO T. Red traffic light detection using fast radial symmetry transform [C] // International Conference on Electrical Engineering/electronics, Computer, Telecommunications and Information Technology. Nakhon Ratchasima: IEEE, 2014: 1-6. |

| [20] |

谷明琴, 蔡自兴, 李仪. 应用圆形度和颜色直方图的交通信号灯识别[J].

计算机工程与设计, 2012, 33(1): 243–247.

GU Ming-qin, CAI Zi-xing, LI Yi. Traffic light recognition with circulartiy and color histogram[J]. Computer Engineering and Design, 2012, 33(1): 243–247. |

| [21] | La Route Automatisée. Traffic lights recognition (TLR) public benchmarks [EB/OL]. [2013-10-29]. http://www.lara.prd.fr/benchmarks/trafficlightsrecognition. |